普通Java开发如何转型大模型方向?

说真的,这两年看着身边一个个搞Java的哥们开始卷大模型,挺唏嘘的。大家最开始都是写接口、搞Spring Boot、连数据库、配Redis,稳稳当当过日子。

结果一个ChatGPT火了之后,整条后端线上的人都开始有点慌了,谁还不是在想:“我是不是要学点AI,不然这饭碗还能保多久?”

我先给出最直接的答案,一定要把你们现有的java技术能力和大模型结合起来,而不是抛弃你们现有的java技术。因为工程和落地能力是你们的强项。后面的趋势一定是AI应用落地!!!

题主说自己是普通Java开发,对大模型完全空白,想转但不知道从哪下手——这事儿我太理解了。对于后端工程师来说,先保证自己有能力让大模型相关的项目落地。然后逐渐地补充算法的基础知识,因为你们已经有了工程技术背景,所以需要的做的是如何让既有的技术经验赋能新的技术。

我身边就有几个朋友,从普通Java后端,一步步搞成了现在的“AI工程师”,虽然不是研究院里的那种大神,但起码现在接的项目已经是“Prompt微调+API整合+大模型微服务框架落地”了,赚得也不少。

看看现在的招聘,用java做AI服务端的研发是一个很不错的选择,其实你发现没有,从云计算、大数据、到今天AI,都说Java已死,但是最后大数据、AI这些还是得老老实实接入服务端的接口。

他们的路径很接地气,也适合大多数人。

首先,别一上来就想着看深度学习,Transformer论文精读这种硬核的东西。就像学Java的时候,你不会先学JVM源码,而是搭个Spring Boot Hello World再说。

大模型这边也一样,建议你先搞清楚这几个问题:

大模型到底是干嘛的?ChatGPT、Claude 这些模型能做什么?为什么公司要用它们?你作为后端开发,怎么参与它们的应用?

这一步,建议你就老老实实看一些产品侧的落地案例,比如大模型在客服、智能文档生成、代码补全、金融投研分析中的用法。你可以去试试、GitHub Copilot、Kimi、ChatGPT这些工具,理解下大模型到底“智能”在哪。

然后,开始学点实际技能。别怕AI三个字,其实现在大多数大模型应用,后端开发背景的人非常有优势。你熟悉接口?你能写服务?你知道微服务怎么拆?你明白怎么做权限控制、数据缓存?

这些全都能直接迁移到“Agent编排”、“模型服务封装”这些任务里。

你可以从以下几块着手:

- 学会用OpenAI、阿里的通义千问、百度的文心一言这些API;

- 学会用LangChain或者LlamaIndex这样的框架进行简单的“RAG”开发;

- 搭建一个自己的私有化大模型微服务,比如部署一个ChatGLM,做个“公司文档搜索助手”;

- 学Prompt工程技巧,懂得“怎么问”和“怎么改回答”。

这个阶段,其实你只需要有点Python基础 + API调用能力就够了,不涉及复杂的数学和模型训练,跟你写Java接三方API是一个思路。

看到这里你可能会想:“这些东西看着好像也不难,那我怎么系统化地学?”

说实话,如果你自学能力强,确实可以靠B站+GitHub+知乎慢慢摸索,但效率可能不太高。而且现在市面上确实课程太杂,有的讲Prompt,有的讲模型压缩,有的讲TensorFlow,学到一半发现根本用不上。

我身边那几个成功转型的朋友,后来统一推荐的是知乎知学堂的大模型应用开发公开课。为啥?因为它课程设计就是从“普通后端”转向“大模型应用工程师”的路线,不是搞学术,也不是做科研,而是手把手教你怎么做一套实战项目,比如:

怎么用LangChain + ChatGLM 搭个企业智能客服系统?怎么对接飞书、钉钉做AI助手;

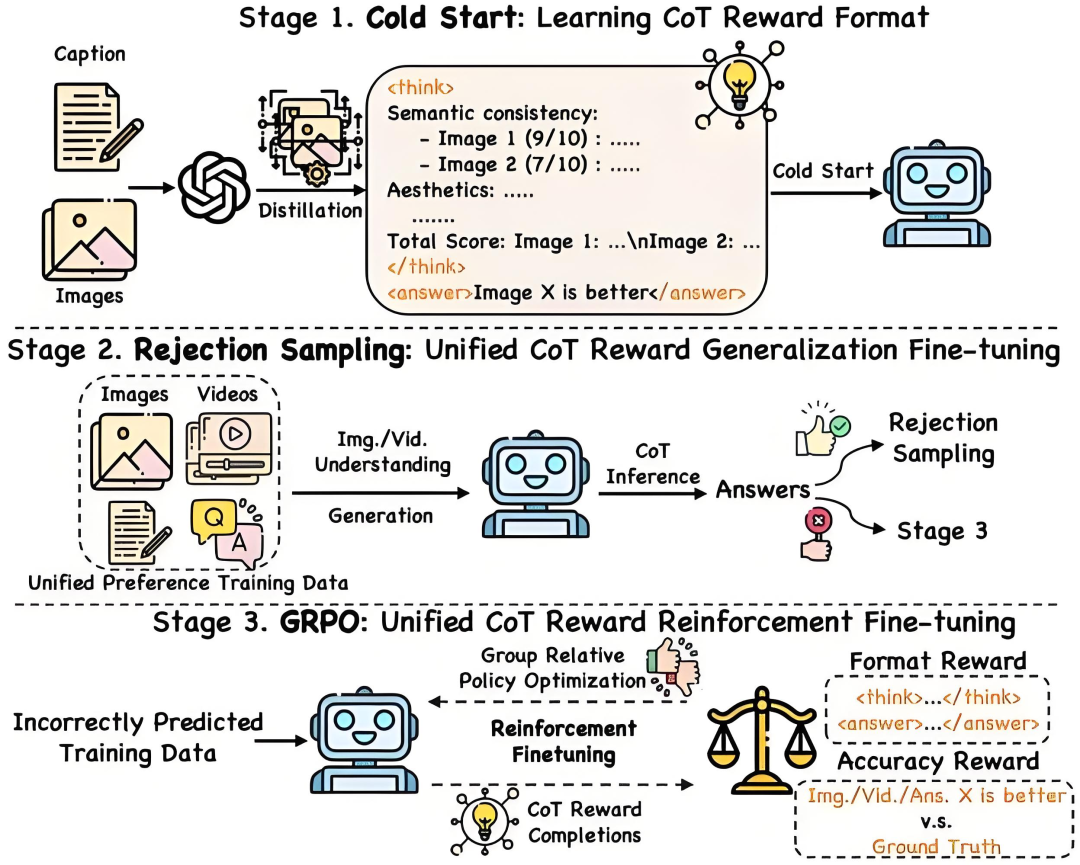

怎么利用开源模型搭建私有化问答?怎么做Prompt调优 + Agent任务拆解。以及Agent怎么做,多模态Qwen3VL如何推理和做微调,并且有如何做企业实际的RAG项目等干货。

而且知乎知学堂还有配套的项目实战包、代码托管、作业批改,有问题随时问。你不是一个人在卷,而是一群人一起卷。这个氛围其实特别重要。我那几个朋友学完之后都说:“早知道有这个,去年就报名了,不用在GitHub上摸黑一个月都看不懂LangChain文档。”

说到底,你要是打算转型,真的可以试试知乎知学堂的这个大模型应用开发公开课,至少能帮你少走很多弯路。大模型现在爆发期,这个窗口期也就1-2年,等普及之后,可能又得拼学历和项目经验了。别等潮水退了,才想起没准备好泳裤。

继续聊回正题。

很多人觉得AI、高大上,但你如果是后端开发,其实你就是搞“连接、封装、服务”的专家,而现在大模型最需要的,不正是“把模型接入业务”、“做成接口让前端调用”、“部署成服务跑在生产环境”这种能力吗?

说白了,90%的AI项目都不是在做模型,而是在做“模型应用”。这个部分完全是Java工程师的主场。

我给你举个实际案例:我有个朋友是某大厂Java中级,一年多前开始学LangChain + RAG,最近在一家AI创业公司,专门做一个多轮问答客服系统,给SaaS平台对接。他负责微服务框架和模型推理服务的部署,每天写的代码其实80%还是老老实实在做CRUD + API接口,但薪资涨了60%,还拿了点期权。核心原因?现在会“懂点模型的工程师”稀缺,懂产品、能接业务、有责任感的人更稀缺。

所以别管你现在几岁,也别管你会不会数学。你只要能拿出当年学Java时候的热情,跟上这波大模型热,就一定能在AI世界里找到一块属于自己的立足之地。

你不用成为做模型的人,但你可以成为“让模型有用”的人。所以发挥你的优势,就是让大模型落地!!!

总之,如果你是Java开发,又刚好对AI感兴趣,现在转型真的是好时机。别想着3个月能变身顶级AI专家,也别被一堆论文劝退。你只需要搞清楚应用场景、学会一些框架工具、掌握Prompt和接口整合的能力,未来就能参与到大模型各类落地项目中。

记住一点——你不是从零开始,而是从“后端能力+业务经验”出发,这才是你最大的优势。

能力,未来就能参与到大模型各类落地项目中。

大模型入门学习教程 (附PDF文档)

现在国内外关于大模型入门教程做的比较好的并不多,这其实也是一件好事,有难度和有门槛才能避免烂大街,现在大模型入门教程热度最高的包括李宏毅老师、吴恩达老师、Datawhale开源社区等

选择合适的入门学习教程,能少走弯路,抓住核心内容,快速达到前沿的水平,甚至是发表大模型相关的论文都是可以的

这一期主要是给大家推荐李宏毅老师的最新课程:大模型入门学习教程

这个教程的主要内容如下(总共11讲):

第1讲:总体介绍

这一讲主要介绍现在大模型作为生成式人工智能,其发展的历史过程,以及大模型落地的主要应用方向,了解大模型主要学习什么内容,难度不大,简单看一下就行

第2讲:提示词和AI代理人

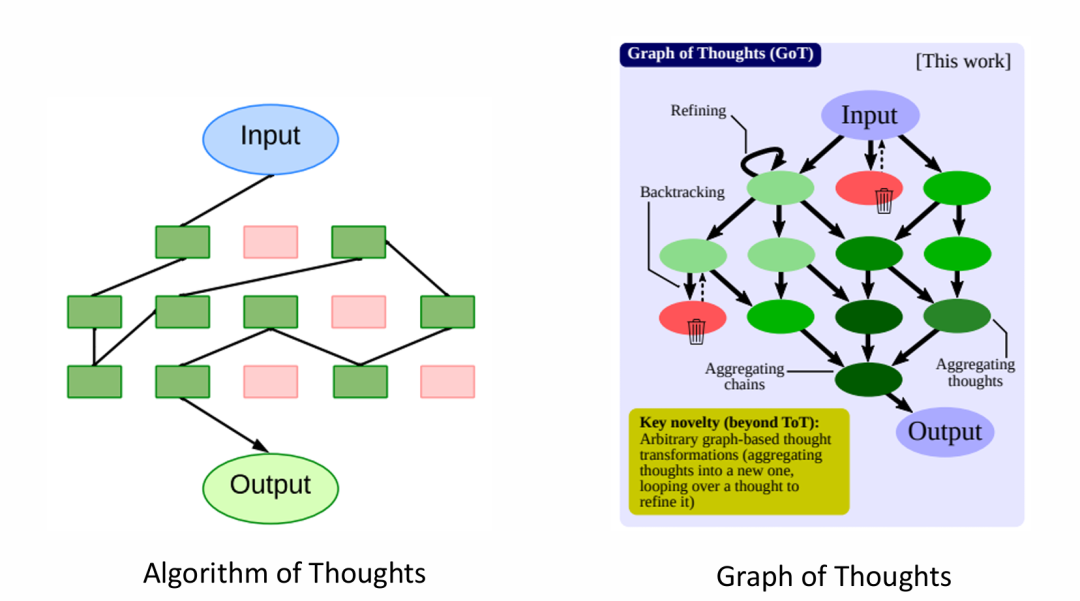

首先介绍什么是提示词工程,提示词就是人类和大模型交互的语言,对于大模型的引导需要通过提示词来完成,然后介绍如何引导模型进行思考,比如COT是什么,在模型训练过程中提供额外信息

第3讲:生成策略

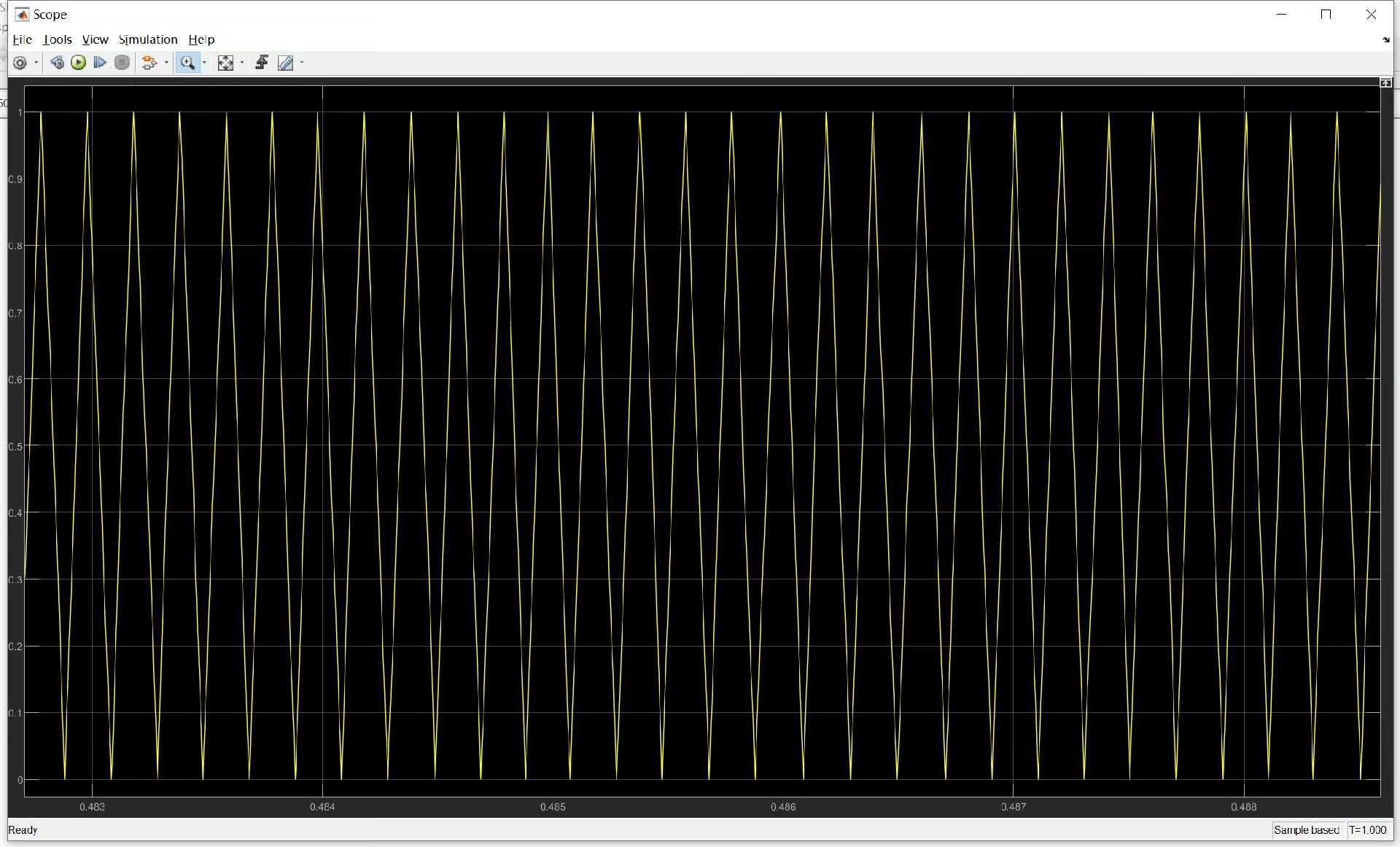

同一个问题,多次询问大模型,大模型会给出不同的回答,如何提高回复的准确率以及稳定性,是一个重要的大模型生成策略。了解大模型的生成概率与什么有关,比如top_p, top_k,temperature等

第4讲:深度学习和Transformer

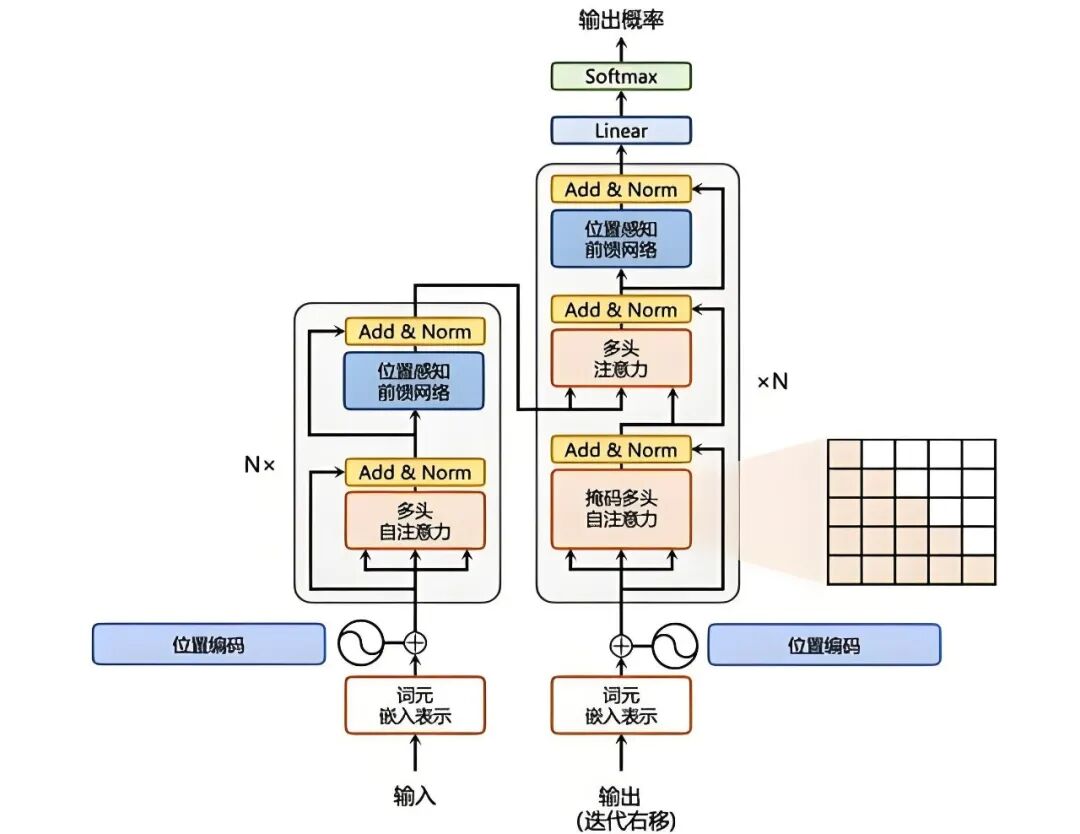

这一部分先介绍一些深度学习基础内容,大模型的模型都是深度学习模型,了解深度学习中基础内容是有必要的,比如损失函数,反向传播,梯度下降等,然后介绍大模型的基础框架transformer,transformer模型结构一定要非常熟悉,很重要

第5讲:大模型评估和道德问题

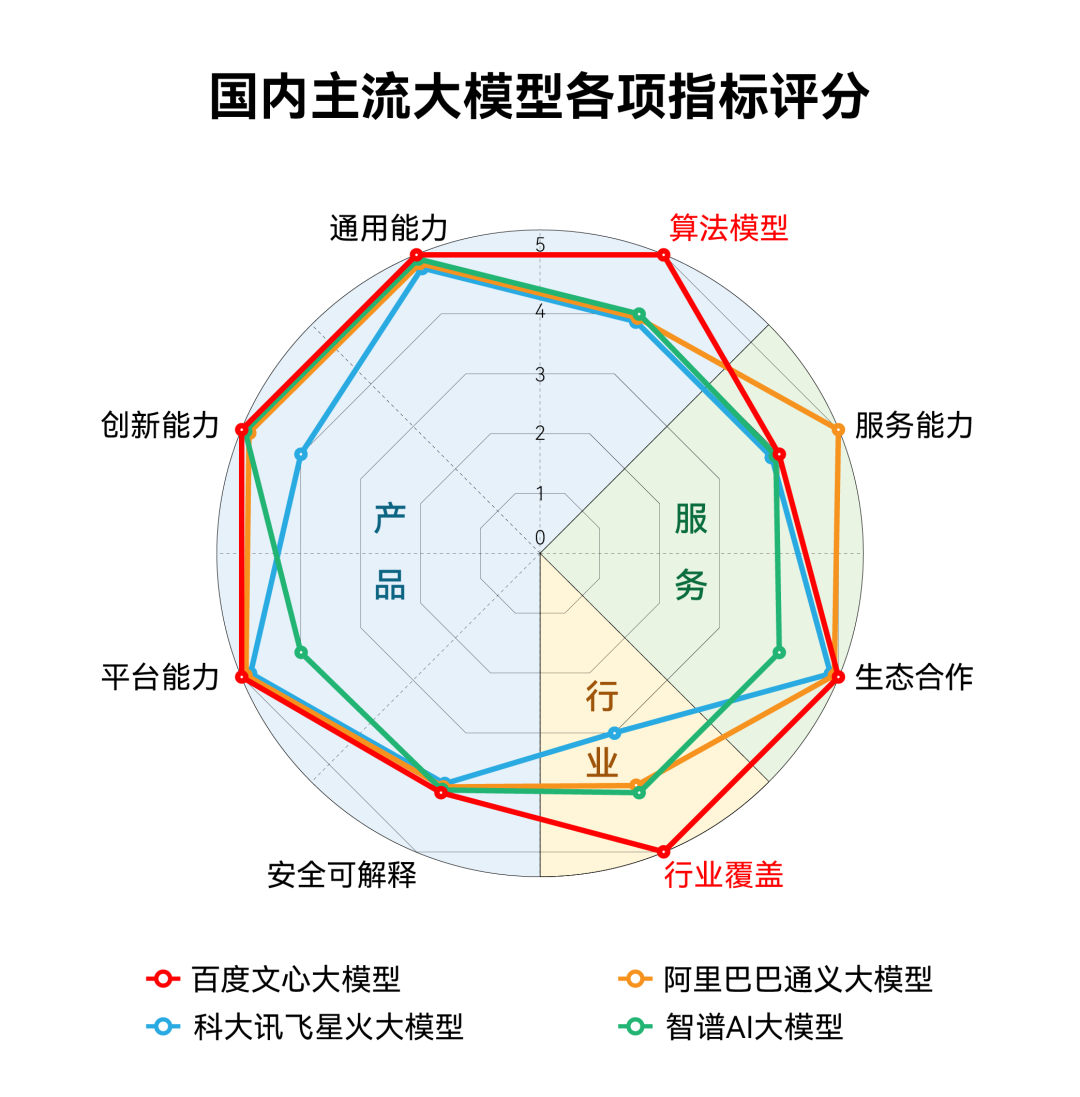

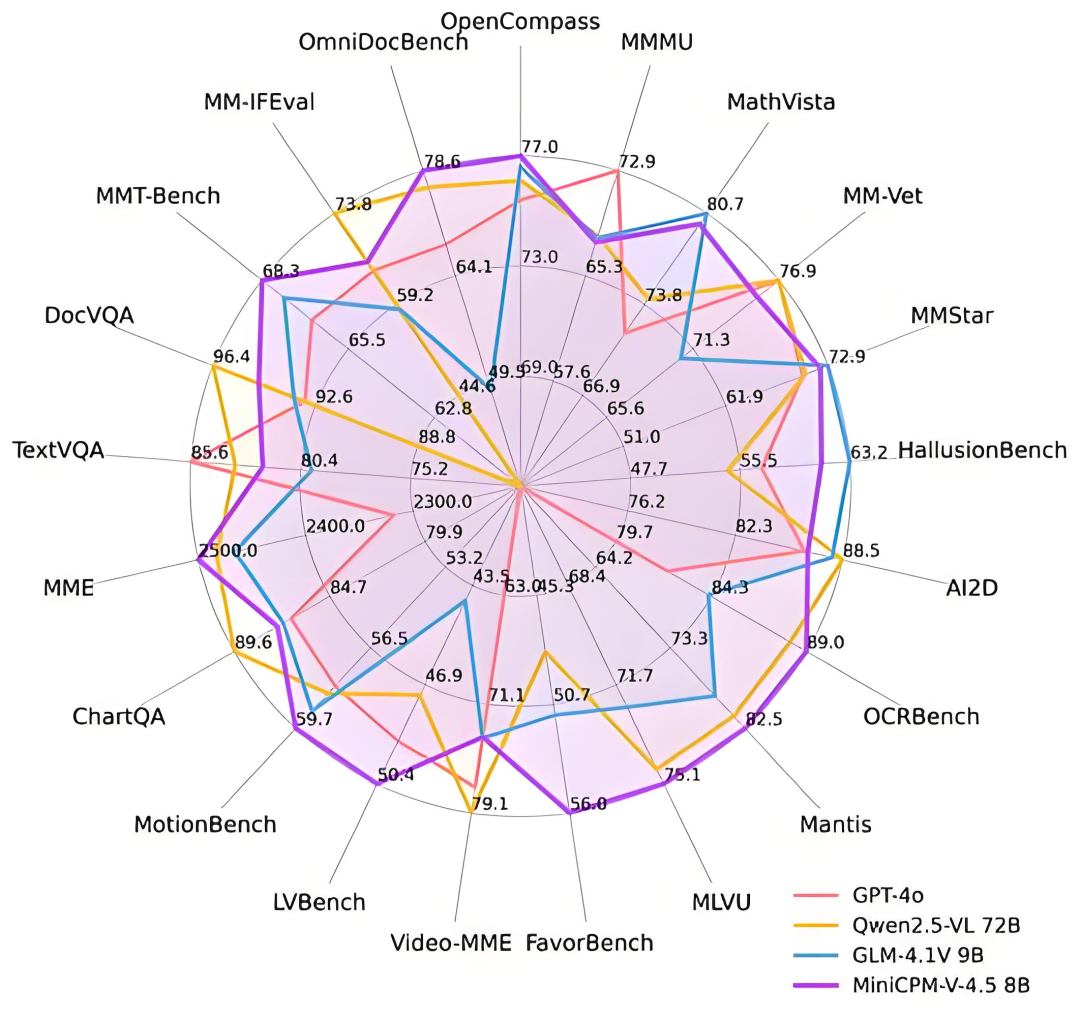

这一部分先介绍大模型的评估标准,现在有很多benchmark从各个方面来评测大模型的不同能力,评估指标很多,开源的模型往往会选择有利于自己的指标进行展示,然后介绍大模型中存在的道德问题,因为大模型不能随意生成一些不符合道德社会文明的内容

第6讲:AI的可解释性

给大模型一个输入,只能得到一个输出,但是我们并不清楚大模型的思考过程是怎么样的,这个问题,大模型是怎么思考的,提升大模型的可解释性有助于后续研究如何提升大模型的推理性能,像COT就是显式展示大模型的思考过程,然后还可以让语言模型来解释语言模型

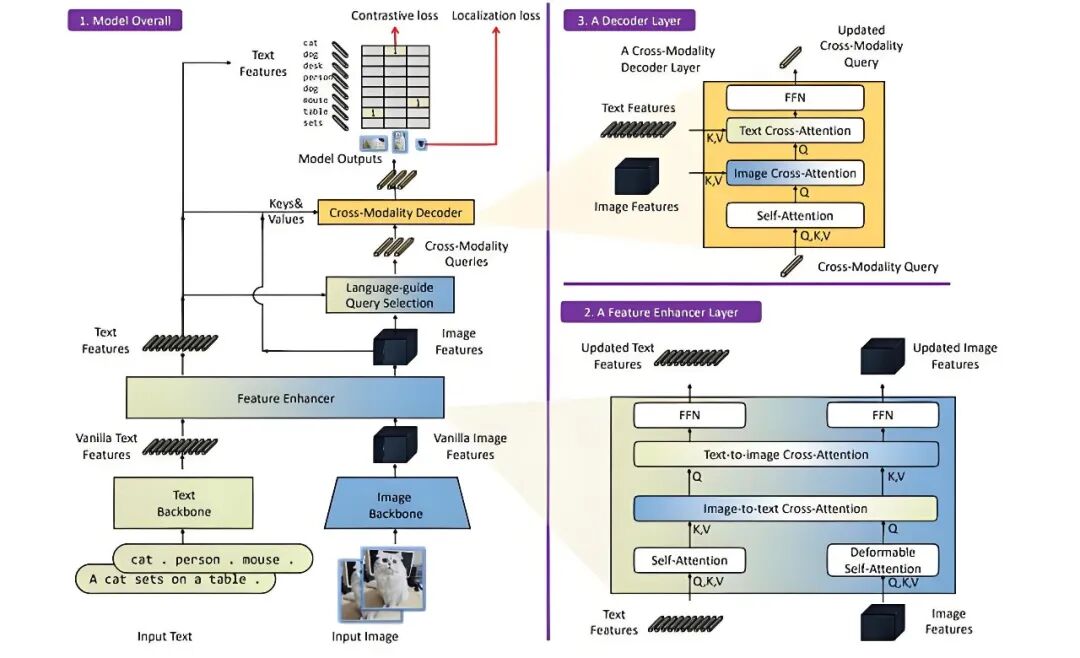

第7讲:视觉大模型

常说的大模型,都指的是文本大模型,输入是文本,输出也是文本,而现实世界中,可能我们的输入既有文本,又有图片和视频,输出也可能是多样化的,视觉大模型就是能解决文本和视觉两种模态的大模型

第8讲:GPT-4o

前面都是关于大 模型的理论,这一部分是拆解一个完整的大模型是怎么样的,以GPT-4o为例进行说明,GPT**-4o是首个端到端多模态通用模型**,是迈向AGI的一步,能够实现文本,音频和图片的多模态交互

上面就是大模型的入门教程的所有内容,学完这些可以去看看关于大模型微调,大模型训练,大模型推理加速,RAG和Agent等相关的内容,后面最好整一两个项目来实践一下

上述资料获取:

1. 关注公众号【大模型应用开发LLM】领取即可获取

2. 这份完整版的大模型 AI 学习资料已经上传CSDN,朋友们如果需要可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献18条内容

已为社区贡献18条内容

所有评论(0)