3名工程师5个月零代码构建百万行产品?OpenAI揭秘AI工程新范式——Harness Engineering!

2026年2月,OpenAI发布了一篇名为《Harness Engineering》的技术博客,披露了一项令人震惊的内部实验:一个仅由3名工程师组成的团队,在5个月内让Codex智能体从零构建了一个拥有100万行代码的完整产品——而没有一行代码是人类手写的。

这是正在发生的现实。

从Prompt Engineering到Harness Engineering:AI工程的三次跃迁

要理解Harness Engineering的意义,我们需要回顾AI工程范式的演进历程。这不是一个突然出现的概念,而是行业在踩过无数坑之后的必然选择。

第一阶段:Prompt Engineering(2022-2023)

当ChatGPT在2022年底爆火时,整个行业陷入了一场"提示词狂欢"。人们发现,只要给模型喂对提示词,它就能生成惊人的内容。

Prompt Engineering的核心假设是:模型的能力已经足够了,问题出在如何激活它。

于是出现了各种技巧:

- Zero-shot/Few-shot prompting:给模型几个例子,让它模仿

- Chain-of-Thought:让模型"一步步思考"

- Role prompting:让模型扮演专家角色

- Prompt模板库:把常用提示词封装成可复用的模板

但很快,Prompt Engineering的天花板显现了:

- 上下文窗口有限:模型能"记住"的信息是有限的(早期只有4K-8K tokens)

- 提示词脆弱:换个措辞,结果可能完全不同

- 无法处理长任务:单轮对话可以,多轮复杂任务就崩了

- 幻觉问题:模型会自信地胡说八道,且无法自我纠正

第二阶段:Context Engineering(2024)

前OpenAI联合创始人Andrej Karpathy提出了一个关键洞察:LLM是一种新型操作系统。

- LLM = CPU:负责推理和计算

- 上下文窗口 = RAM:有限的工作内存

- 工具调用 = I/O外设:搜索、代码执行、API调用

在这个框架下,Prompt Engineering的局限变得清晰:它只关注"CPU指令",却忽视了"内存管理"。

Context Engineering应运而生。Anthropic在2025年的博客中定义:

“Context Engineering是精心策划和维护最优token集合(信息)的策略,以在LLM的固有约束下持续实现期望的输出。”

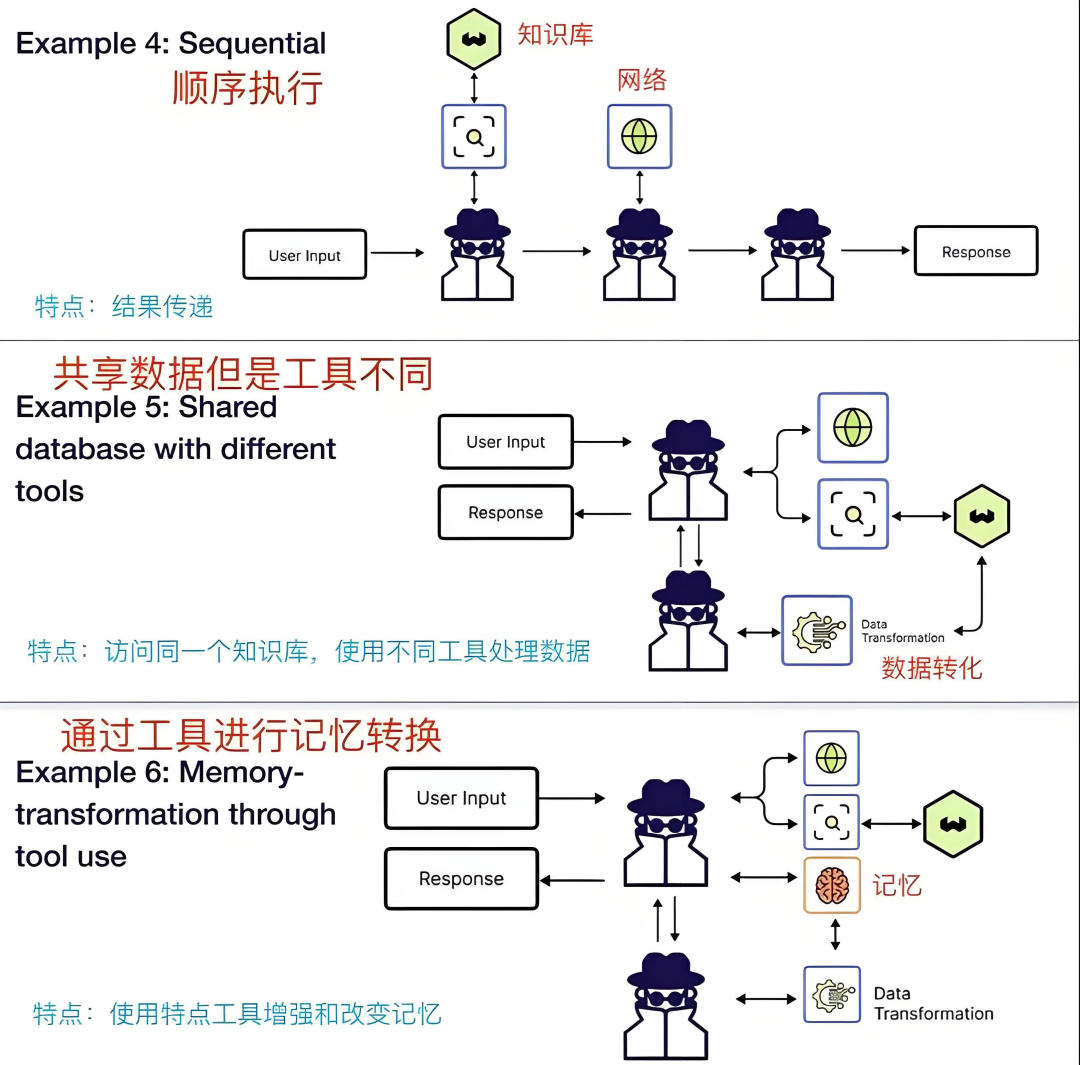

核心策略包括:

- Write(写入):把重要信息塞进上下文

- Select(选择):RAG检索、记忆筛选,只给模型看相关的

- Compress(压缩):摘要、向量化,在有限空间里塞更多信息

- Isolate(隔离):子智能体、多轮对话,避免上下文污染

LangChain的Harrison Chase进一步总结:Context Engineering是"在智能体轨迹的每一步,用恰到好处的信息填充上下文窗口的艺术和科学"。

但Context Engineering仍然有一个根本问题:它假设模型会按照我们期望的方式使用这些信息。实际上,模型可能:

- 忽略了关键指令

- 错误地理解了工具返回的结果

- 在长时间任务中"遗忘"了最初的意图

- 生成代码后无法验证是否正确

第三阶段:Harness Engineering(2025-2026)

Harness Engineering是对前两阶段的超越。它不再只关注"给模型什么信息",而是关注"如何让模型可靠地完成任务"。

Martin Fowler一针见血地指出:

“Harness的框架很有用,因为它将对话从提示词工艺转移到了执行面。”

换句话说:

- Prompt Engineering= 告诉AI"做什么"

- Context Engineering= 确保AI"知道什么"

- Harness Engineering= 保证AI"做对"并"持续做对"

从"写代码"到"驾驭智能体"

理解了这三阶段的演进,我们就能明白为什么OpenAI要做一个"零人工代码"的实验。

传统软件工程中,工程师的核心工作是编写代码、调试Bug、重构系统。但在Harness Engineering的范式下,这一切都被颠覆了。

OpenAI的实验有一个铁律:人类不许写代码。工程师的主要工作变成了三件事:

- 设计环境—— 搭建让智能体能够高效工作的基础设施

- 明确意图—— 将模糊的需求转化为机器可执行的约束

- 构建反馈回路—— 建立验证机制,让智能体能够自我修正

“人类掌舵。智能体执行。”

这个3人小团队(后来扩展到7人)在五个月内完成了约1500个Pull Request,平均每位工程师每天推进3.5个PR。效率是传统开发的10倍。

为什么Harness Engineering是质的跃迁?

让我们用一张表格来对比三个阶段的本质差异:

| 维度 | Prompt Engineering | Context Engineering | Harness Engineering |

|---|---|---|---|

| 核心关注点 | 如何提问 | 给什么信息 | 如何确保做对 |

| 时间维度 | 单轮交互 | 多轮对话 | 完整任务生命周期 |

| 错误处理 | 人工重试 | 人工筛选上下文 | 自动化反馈回路 |

| 可验证性 | 无 | 有限 | 内置验证机制 |

| 可扩展性 | 个人技巧 | 团队规范 | 系统工程 |

| 适用场景 | 简单问答 | 信息检索 | 复杂任务执行 |

Harness Engineering的优势在于它解决了前两个阶段无法解决的核心问题:

1. 从"一次性正确"到"持续正确"

Prompt和Context Engineering都假设:只要给模型足够好的输入,它就能给出正确的输出。但真实世界的任务是长期的、迭代的、会出错的。

Harness Engineering接受错误是不可避免的,并为此设计了:

- 自验证机制:智能体自己检查输出是否正确

- 自动重试:失败时自动调整策略再试

- 渐进式交付:把大任务拆成小步骤,每步都验证

2. 从"人类瓶颈"到"自动化流水线"

Context Engineering仍然依赖人类来决定"给模型看什么"。当任务复杂时,这成为瓶颈。

Harness Engineering把这一决策也自动化了:

- 文件系统作为外置内存:智能体自己决定读写什么文件

- 子智能体分工:复杂任务自动分解给专门的子智能体

- 智能体间协作:一个智能体生成,另一个审查

3. 从"黑盒"到"可观测"

Prompt和Context Engineering的调试是痛苦的——你不知道模型为什么给出了错误的答案。

Harness Engineering把一切都变得可观测:

- Tracing:记录智能体的每一步决策

- Metrics:任务完成率、token效率、延迟

- 可重现:同样的输入总是产生同样的输出(确定性)

4. 从"个人技能"到"团队工程"

Prompt Engineering很大程度上是个人技巧——有人就是"更会跟AI说话"。

Harness Engineering是可工程化的:

- 可版本控制:AGENTS.md、架构文档、CI配置都进Git

- 可复用:好的Harness可以在不同项目间迁移

- 可协作:团队成员可以共同改进Harness

什么是Harness?

Harness(马具/驾驭系统)这个隐喻非常精准。想象一匹强壮的马(AI模型)——它拥有巨大的力量,但需要缰绳、马鞍和骑手的引导才能跑对方向。

在AI工程语境下,Harness是包裹在模型外围的软件基础设施,负责:

- 约束机制:架构规范、代码风格、依赖规则

- 反馈回路:自动化测试、CI/CD、代码审查

- 生命周期管理:上下文窗口管理、状态持久化、错误恢复

- 工具编排:文件系统访问、API调用、子智能体调度

Martin Fowler和Birgitta Böckeler在Thoughtworks的文章中指出,Harness Engineering将对话焦点从"提示词工程"转移到了"执行面"——不是让AI更聪明,而是让AI的行为更可预测、更可控制。

核心实践:让代码仓库成为"唯一事实来源"

OpenAI实验中最具颠覆性的洞察是:代码仓库必须对智能体可读。

传统开发中,我们假设代码是写给人类看的。但在Agent-First的世界里,代码仓库需要同时服务于人类和智能体。这要求:

1. AGENTS.md:智能体的"导航地图"

OpenAI将原本1000页的产品说明书浓缩成100行的AGENTS.md文件。这份文档不是给人类读的详细手册,而是给智能体的"索引"——告诉它去哪里找什么信息,如何理解项目结构,遵循哪些架构约束。

2. 架构即代码

架构决策不再是存在于某个架构师脑海中的隐性知识,而是被编码为可执行的规则:

- ARCHITECTURE.md明确定义领域边界和依赖规则

- CI任务自动校验文档与代码的一致性

- 自定义Linter强制执行代码风格和质量门禁

3. 智能体对智能体的代码审查

随着代码吞吐量的爆炸式增长,人工代码审查成为瓶颈。OpenAI的解决方案是建立"智能体对智能体"的审查机制——让多个Codex实例相互评审代码,人类只在关键节点介入。

LangChain团队将这种模式称为"Ralph Wiggum Loop":一个Hook强制智能体在退出前继续执行验证,直到所有检查通过。

熵与垃圾收集:技术债的新定义

当智能体以10倍速生成代码时,技术债也在指数级累积。OpenAI用了一个精妙的比喻:技术债像高息贷款,最好持续、小步地偿还,而不是等堆成大手术再一次性还。

他们引入了"垃圾收集"(Garbage Collection)的概念:

- 专门的"文档园丁智能体"定期扫描并修复过时的文档

- 自动化的重构任务清理死代码和重复逻辑

- CI/CD流水线强制执行代码健康度检查

这不是可选的优化,而是Harness Engineering的核心组成部分。没有垃圾收集机制,智能体生成的代码库将在几周内陷入混乱。

工程师角色的重新定义

Harness Engineering不是让工程师失业,而是让工程师从"代码生产者"转变为"能力架构师"。

具体而言,工程师需要掌握的新技能包括:

| 传统工程师 | Harness工程师 |

|---|---|

| 编写业务逻辑 | 设计智能体工作环境 |

| 调试代码 | 调试智能体行为 |

| 代码审查 | 设计审查机制 |

| 写文档 | 设计文档结构 |

| 解决技术债 | 设计垃圾收集系统 |

LangChain创始人Harrison Chase在一次播客中说:“Harness比模型本身更重要。80%的生产力差距来自Harness——那个包裹在模型外面的’操作系统’。”

行业回响:从OpenAI到LangChain

Harness Engineering的概念正在迅速被行业采纳:

- OpenAI:Codex CLI和内部实验验证了可行性

- LangChain:推出了Deep Agents,一个开源的Agent Harness框架

- Martin Fowler/Thoughtworks:将Harness Engineering纳入AI-first软件工程的方法论体系

- Datadog:发布了关于可观测性驱动的Harness Engineering实践

这不是某个公司的内部实践,而是整个行业正在形成的共识:AI工程的未来可能不是更好的模型,或许是更好的Harness。

结语:我们仍在学习

OpenAI在博客结尾写道:“我们仍在学习。”

这句话的谦逊背后是一个激进的宣言:软件工程的基本范式正在发生转变。从"人类写代码"到"人类设计Harness让AI写代码",这不像是渐进式改进,更像是范式革命。

对于今天的工程师来说,这意味着:

- 停止与AI比拼写代码的速度—— 你赢不了

- 开始学习如何设计Harness—— 这是新的核心竞争力

- 拥抱"人类掌舵,智能体执行"的新角色—— 这不是降级,而是升级

Harness Engineering不是关于AI取代人类,而是关于人类与AI如何更好地协作。在这个新范式下,工程师的价值不再体现在写了多少行代码,而体现在设计了多么优雅的Harness——让AI能够在正确的约束下,产生正确的输出。

正如OpenAI的实验所证明的:当Harness设计得当,3个工程师+AI可以完成过去30个工程师的工作量。

这就是Harness Engineering的承诺。这就是AI时代软件工程的未来。

最近两年大模型发展很迅速,在理论研究方面得到很大的拓展,基础模型的能力也取得重大突破,大模型现在正在积极探索落地的方向,如果与各行各业结合起来是未来落地的一个重大研究方向

大模型应用工程师年包50w+属于中等水平,如果想要入门大模型,那现在正是最佳时机

2025年Agent的元年,2026年将会百花齐放,相应的应用将覆盖文本,视频,语音,图像等全模态

如果你对AI大模型入门感兴趣,那么你需要的话可以点击这里大模型重磅福利:入门进阶全套104G学习资源包免费分享!

扫描下方csdn官方合作二维码获取哦!

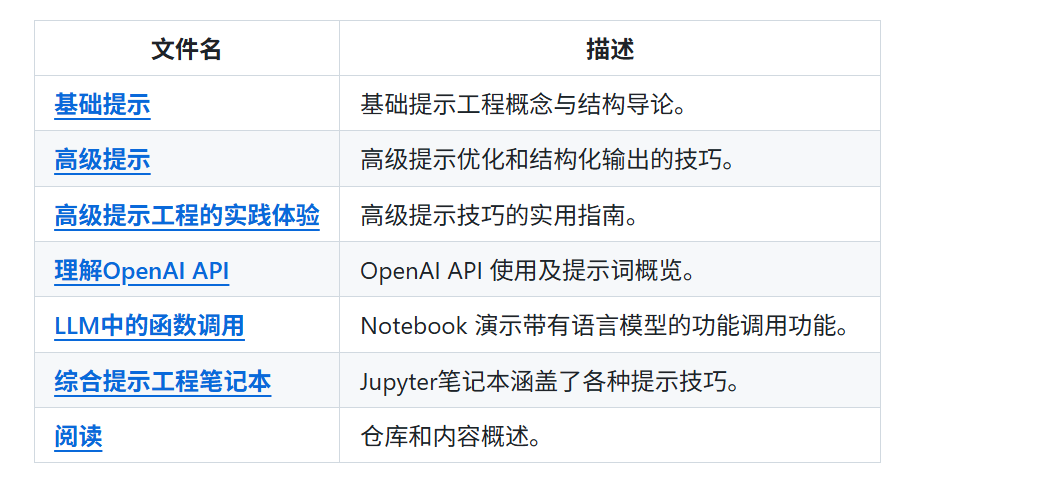

给大家推荐一个大模型应用学习路线

这个学习路线的具体内容如下:

第一节:提示词工程

提示词是用于与AI模型沟通交流的,这一部分主要介绍基本概念和相应的实践,高级的提示词工程来实现模型最佳效果,以现实案例为基础进行案例讲解,在企业中除了微调之外,最喜欢的就是用提示词工程技术来实现模型性能的提升

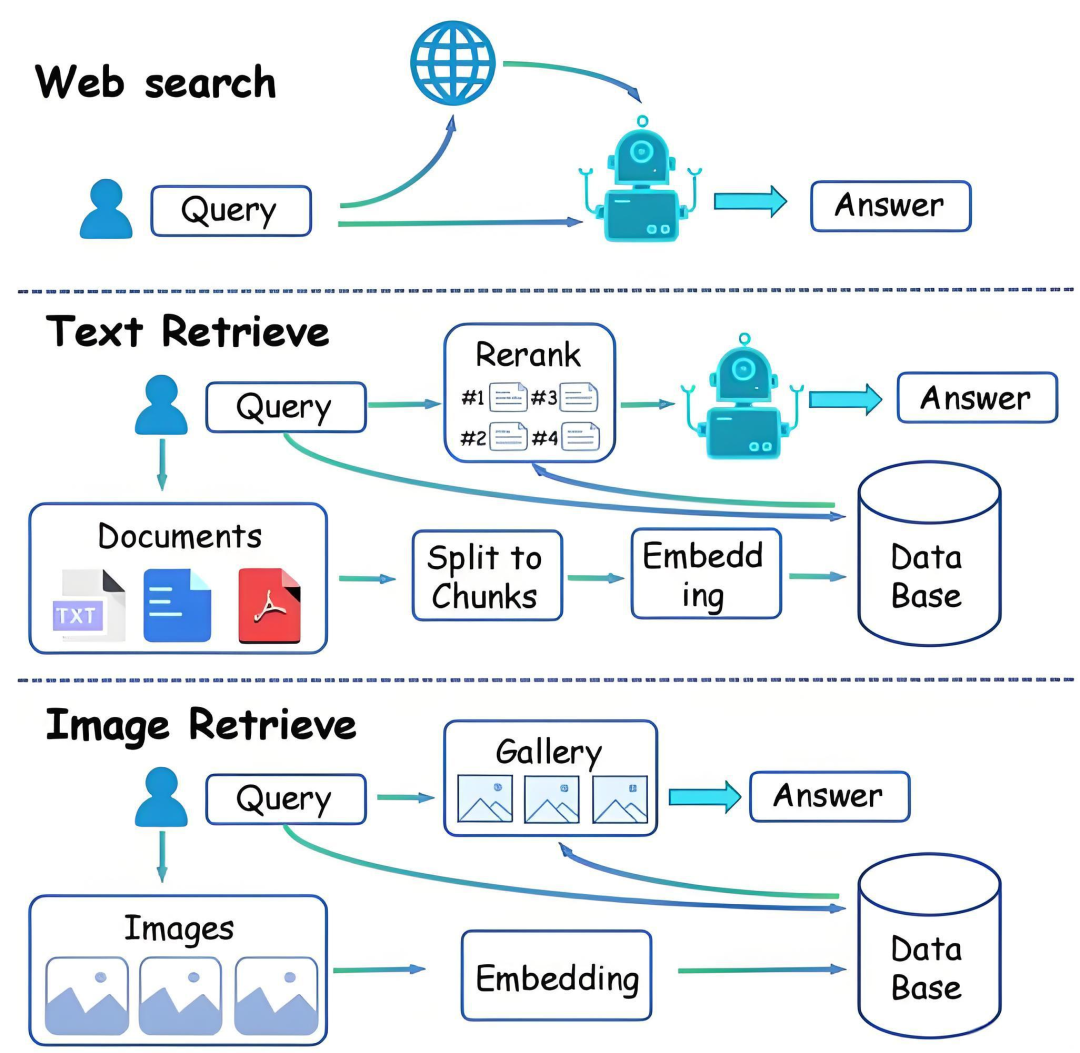

第二节:检索增强生成(RAG)

可能大家经常会看见RAG这个名词,这个就是将向量数据库与大模型结合的技术,通过外部知识来增强改进提升大模型的回答结果,这一部分主要介绍RAG架构与组件,从零开始搭建RAG系统,生成部署RAG,性能优化等

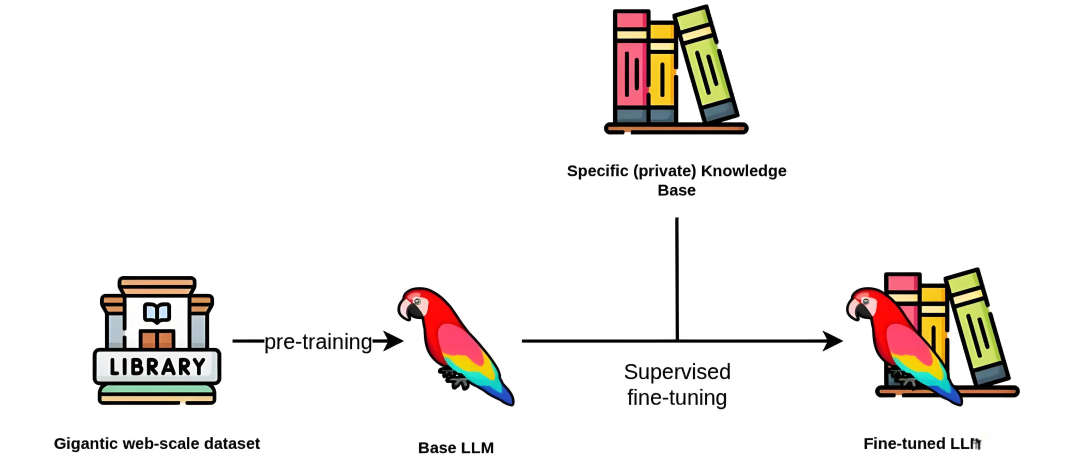

第三节:微调

预训练之后的模型想要在具体任务上进行适配,那就需要通过微调来提升模型的性能,能满足定制化的需求,这一部分主要介绍微调的基础,模型适配技术,最佳实践的案例,以及资源优化等内容

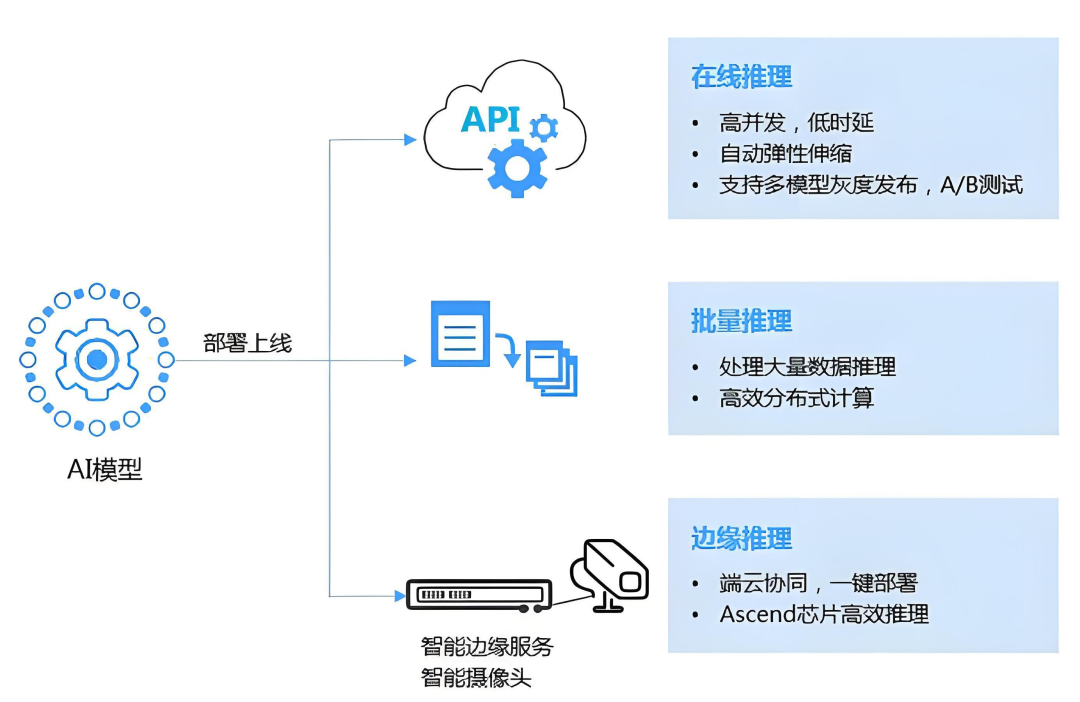

第四节:模型部署

想要把预训练或者微调之后的模型应用于生产实践,那就需要部署,模型部署分为云端部署和本地部署,部署的过程中需要考虑硬件支持,服务器性能,以及对性能进行优化,使用过程中的监控维护等

第五节:人工智能系统和项目

这一部分主要介绍自主人工智能系统,包括代理框架,决策框架,多智能体系统,以及实际应用,然后通过实践项目应用前面学习到的知识,包括端到端的实现,行业相关情景等

学完上面的大模型应用技术,就可以去做一些开源的项目,大模型领域现在非常注重项目的落地,后续可以学习一些Agent框架等内容

上面的资料做了一些整理,有需要的同学可以下方添加二维码获取(仅供学习使用)

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献30条内容

已为社区贡献30条内容

所有评论(0)