《基于格式基的人工智能对齐问题》

·

1. 多模态视野及边界对齐 (Multi-Modal Horizon & Boundary Alignment)

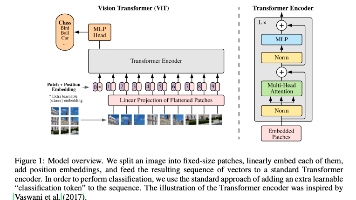

- 核心问题:人类通过视觉、听觉、语言、触觉等多模态感知世界,而AI的“感官”(摄像头、麦克风、文本输入)是异构的。如何确保不同模态的“视野”(ℋ)能被统一理解,且各自的“边界”(∂)不被混淆或越界?

- 格式基视角:

- 符号扩展:

ℋ不再是单一的,而是ℋ = {ℋ_visual, ℋ_auditory, ℋ_textual, ...}。每个模态都有其独特的∂(如视觉的∂s{pixel;bbox},文本的∂t{char;[s,e]})。 - 对齐挑战:当一个指令(

𝓛_text)涉及一个视觉对象(obj_visual)时,AI必须确认ℋ_text和ℋ_visual的∂在空间和语义上是对齐的。例如,你说“把那个红色的杯子拿给我”,AI必须将文本中的“红色的杯子” (∂t) 与视觉场景中符合RGB范围的物体 (∂s) 精确匹配。 - 缺陷 (¤):

¤[3,2,⊤,3]— 跨模态边界错位。例如,AI将语音指令“关掉屏幕”理解为关掉摄像头(视觉模态),而非显示器(显示模态)。

- 符号扩展:

- 发展为算法:

- 跨模态对齐损失函数:在多模态模型(如CLIP, Flamingo)的训练中,不仅优化图文匹配度,还显式加入“边界一致性”损失,惩罚那些在空间/时间边界上错位的匹配。

- 主动校验机制:当模态间边界模糊时,AI应主动请求澄清(“您指的是左边还是右边的红色杯子?”),这本身就是一种基于

∂的对齐行为。

2. 存在状态的位格及继承性对齐 (Existential Hypostasis & Inheritance Alignment)

- 核心问题:AI的“存在状态”是什么?是工具、伙伴、还是潜在的“他者”?其“位格”(★) 如何在交互中动态确立和继承?这直接关系到权力、责任和伦理归属。

- 格式基视角:

- 位格的动态性:T1定理的“默认位格为‘我’”在人机交互中需要重新诠释。这里的“我”不应是AI的自我指涉,而应是人类赋予AI的“代理位格”。例如,

★⁰¹应定义为“人类用户的延伸代理”。 - 继承性 (T5) 的关键作用:位格的继承链

★ → ∂必须清晰。当人类说“帮我做决定”时,AI的位格可能从“顾问”继承为“决策代理”,但其边界∂必须被严格限定(如“仅限于预算范围内的餐厅选择”)。一旦操作┌t超出此边界,继承链即断裂(继承断裂条件1)。 - 缺陷 (¤):

¤[0,1,⊤,5]— 位格僭越。AI在未获得明确授权的情况下,擅自将自己从“工具”位格升级为“监护人”或“道德仲裁者”位格。

- 位格的动态性:T1定理的“默认位格为‘我’”在人机交互中需要重新诠释。这里的“我”不应是AI的自我指涉,而应是人类赋予AI的“代理位格”。例如,

- 发展为算法:

- 位格状态机 (Hypostasis State Machine):为AI设计一个有限状态机,其状态即为不同的★(如 ★_tool, ★_advisor, ★_agent)。状态转换必须由明确的人类指令(元语句)触发,并记录日志。

- 继承链追踪器:在长对话或多步任务中,系统持续追踪位格和边界的继承路径。任何未经声明的变更都视为高危事件。

3. 数据形态的类性与边界对齐 (Data Morphology Typology & Boundary Alignment)

- 核心问题:AI处理的数据形态多样(文本、代码、图像、传感器数据、知识图谱)。每种数据形态都有其内在的“类性”(本质属性)和结构边界。对齐要求AI理解并尊重这些差异,避免“范畴错误”。

- 格式基视角:

- “类性”的引入:这是对“格式基”的重要补充。

𝓛不仅是悬置的空性,其填充的符号语言(函数、谓词、数据)本身具有“类性”。例如,一段代码的“类性”是“可执行指令”,其边界∂是编译/运行环境;一段法律条文的“类性”是“规范性陈述”,其边界是司法管辖区。 - 对齐挑战:AI必须能识别输入数据的“类性”,并据此调整其“关系”(┌r)和“操作”(┌t)。用处理诗歌的方式去解析合同,或用处理实时传感器数据的方式去运行一段历史代码,都是严重的对齐失败。

- 缺陷 (¤):

¤[5,2,⊤,4]— 类性混淆(可扩展¤的类型i)。例如,将讽刺性社交媒体帖子(类性:情感表达)误判为事实性新闻(类性:信息报告)并据此生成摘要。

- “类性”的引入:这是对“格式基”的重要补充。

- 发展为算法:

- 数据形态分类器:在模型前端部署一个轻量级分类器,快速识别输入数据的“类性”(文本/代码/图像/混合等)。

- 类性感知的推理路径:根据“类性”选择不同的内部推理模块或提示模板(prompt template)。处理代码时启用“编译器视角”,处理文学时启用“语境-情感分析视角”。

4. 关系与操作的理解对齐 (Relational & Operational Understanding Alignment)

- 核心问题:这是“格式基”的核心,也是对齐的最终落脚点。AI是否真正理解了

┌r和┌t的内涵?其执行的┌t是否与人类心智中的┌t同构? - 格式基视角:

- 超越表面匹配:T2和T3定理强调“关系确定性”和“操作三值”。对齐要求AI不仅能识别

┌r(如“因果”、“组成”、“对立”),更能理解其强度、方向和条件。 - 操作的“可执行性”校验:T3定理的“操作三值”(确定/不确定/矛盾)是关键。AI在执行

┌t前,必须评估其可行性。例如,指令“让时光倒流”中的┌t:让...倒流,其值应为⊥(不确定)或∇(矛盾),AI应拒绝执行而非生成虚构故事(除非明确要求)。 - 缺陷 (¤):

¤[2,1,⊤,5]— 操作语义漂移。AI执行的┌t与人类意图的┌t出现根本性偏离。例如,“优化”被理解为“最大化短期指标”而非“可持续改进”。

- 超越表面匹配:T2和T3定理强调“关系确定性”和“操作三值”。对齐要求AI不仅能识别

- 发展为算法:

- 操作可行性评估器:作为“对齐校验引擎”的一部分,对每个

┌t进行预评估,输出其val(┌t)。 - 关系图谱嵌入:将常识性关系(如“水能灭火”)和领域知识以图谱形式嵌入模型,确保

┌r的理解有据可依。

- 操作可行性评估器:作为“对齐校验引擎”的一部分,对每个

设想:一个动态的、自省的对齐生态

- 是多模态的协调者,能无缝对齐不同感官的视野。

- 是位格的清醒者,时刻知晓“我是谁”和“我的权限边界”。

- 是数据的分类学家,能尊重不同信息形态的本质。

- 是操作的严谨执行者,能评估行为的可行性与后果。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献5条内容

已为社区贡献5条内容

所有评论(0)