RAG:大模型“开卷考试”攻略,终结幻觉,解锁知识新维度!

RAG**(Retrieval-Augmented Generation,检索增强生成)是将外部知识检索与生成式大模型融合的AI架构范式**,通过先检索外部权威信息再生成内容,解决大模型幻觉、知识静态、私有数据不可达等核心痛点,为LLM构建可动态更新的“外置知识库”,无需频繁微调即可输出准确、溯源、合规的结果。

一、核心定义与价值定位

RAG的本质是“开卷考试”式AI:LLM(考生)遇到问题时,先通过检索器(电脑)查询外部知识库(最新资料),再结合自身能力生成答案,而非仅依赖“过期记忆”(训练数据)。

l核心目标:解决LLM三大痛点

a. 幻觉问题:生成无事实依据的虚假信息。

b. 知识时效性:训练数据截止后无法获取新信息(如2025年政策、实时数据)。

c. 私有数据隔离:企业内部文档、SOP等敏感数据无法用于公有云模型微调,RAG可通过权限控制安全访问。

l与微调的关系:互补而非替代

| 特性 | RAG | 微调(Fine-tuning) |

| 知识注入方式 | 外部检索动态补充 | 修改模型内部参数 |

| 更新成本 | 低(直接更新知识库) | 高(需重新训练、部署) |

| 适用场景 | 高频更新、多源异构、隐私敏感数据 | 固定领域深度优化、长期稳定知识 |

| 可解释性 | 强(可追溯引用来源) | 弱(黑盒参数,难溯源) |

二、核心组件与架构

RAG系统由五大核心模块构成,形成“数据准备-检索-增强-生成-反馈”的闭环。

-

外部知识库:存储结构化(数据库、Excel)、非结构化(文档、网页)、半结构化(JSON、XML)数据,支持实时更新。

-

文本处理与向量化模块:将文档拆分为小片段(Chunking),通过Embedding模型(如BERT、Sentence-BERT)转化为高维向量,捕捉语义信息。

-

向量数据库:存储向量与原文映射,支持近似最近邻(ANN)搜索,快速召回Top-K相关片段(如FAISS、Pinecone、Milvus)。

-

检索器(Retriever):负责“召回+重排”

○ 召回:将用户问题向量化后,在向量库中匹配相似向量,获取候选片段。

○ 重排:用交叉编码器(Cross-Encoder)等模型对候选片段重排序,提升相关性(如ColBERT、Rerankers)。

- 生成器(Generator):LLM(如GPT-4、Claude 3、文心一言)接收“问题+检索结果+提示词”,生成带引用的最终答案。

三、标准工作流程(端到端)

RAG流程分为“离线准备”和“在线推理”两大阶段,确保低延迟与高准确率。

- 离线准备(数据预处理)

a. 文档采集:接入企业文档、API数据、网页等多源数据。

b. 清洗与分片:去除冗余信息,按语义拆分(如按段落、标题,避免上下文断裂)。

c. 向量化与入库:Embedding生成向量,存储到向量数据库并建立索引。

- 在线推理(用户交互)

a. 问题理解:解析用户查询意图,优化检索关键词。

b. 检索增强:将问题向量化,召回Top-K片段并排序,过滤噪声数据。

c. 提示词构建:将“问题+检索结果+格式要求+引用规则”打包为Prompt。

d. 生成与溯源:LLM生成答案,标注引用来源,支持结果校验。

e. 反馈优化:收集用户反馈(如错误标记、相关性评分),用于调整分片策略、Embedding模型或检索参数。

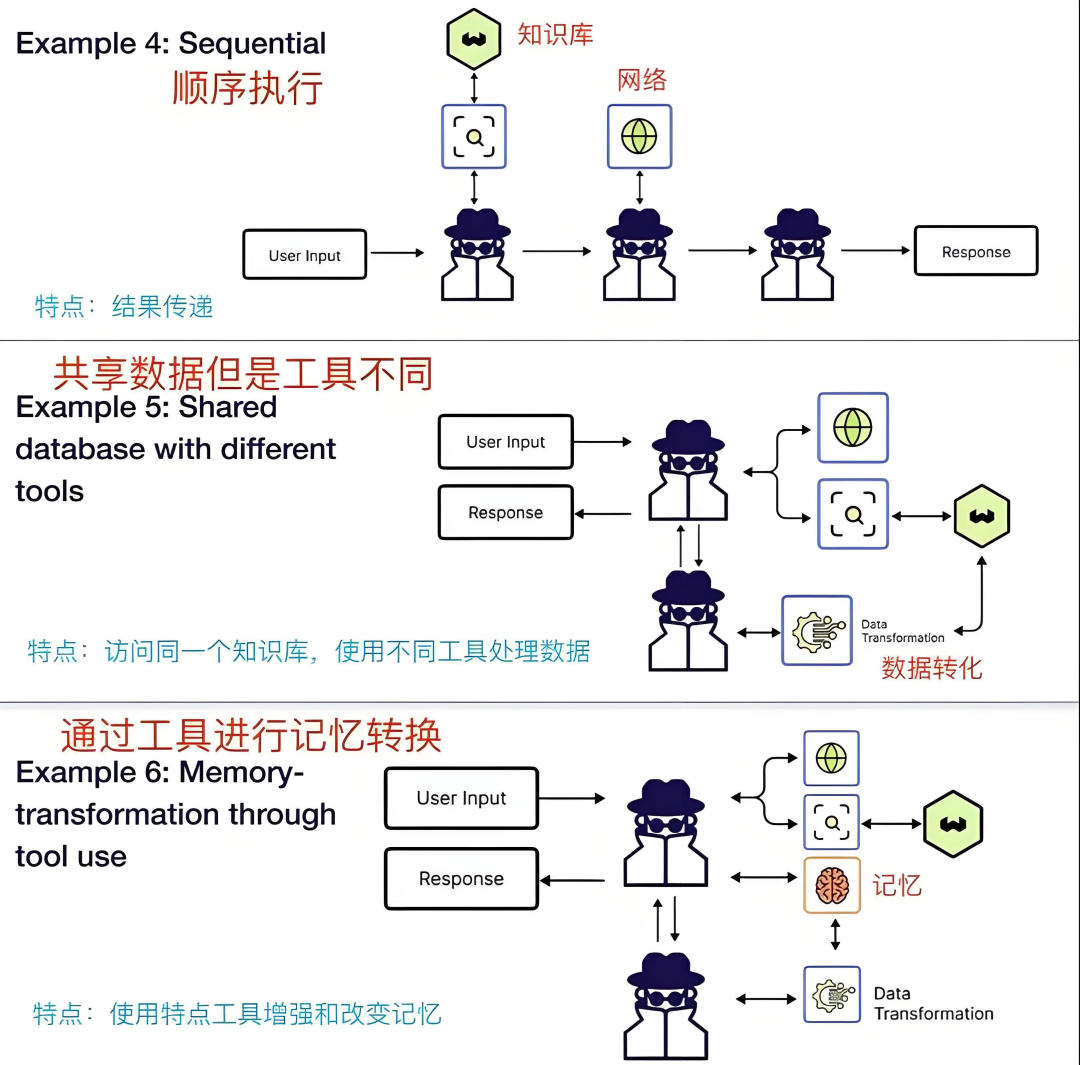

四、技术演进:从Naive到Agentic RAG

RAG架构随场景复杂度迭代,形成四代主流方案。

| 架构 | 核心特点 | 适用场景 |

| Naive RAG | 基础线性流程(检索→增强→生成) | 简单问答、FAQ、基础知识库查询 |

| Advanced RAG | 混合检索(向量+关键词+语义)、重排优化、提示词工程 | 复杂多轮问答、长文档分析 |

| Graph RAG | 引入知识图谱,强化实体关系推理 | 金融风控、医疗诊断、法律案例分析 |

| Agentic RAG | 融入智能体(Agent),支持自主规划、工具调用、动态调整检索策略 | 跨领域复杂任务(如欧洲游规划、运维故障排查) |

五、典型应用场景

RAG已成为企业AI落地的标准架构,覆盖多行业关键场景。

-

智能客服与企业知识助手:快速查询内部SOP、产品手册、故障排查指南,降低人工成本,提升响应速度。

-

金融/医疗合规生成:生成报告时引用最新监管政策、临床指南,确保合规性与可追溯性。

-

运维智能助手(电信/IT行业):实时检索系统日志、发布记录、故障手册,辅助工程师快速定位问题,生成运维报告。

-

法律/科研文档生成:自动引用判例、论文、专利,生成法律意见书或科研综述,减少手动检索时间。

-

实时数据分析:对接API获取实时数据(如天气、股价、流量),生成动态报告,支持决策。

六、总结

RAG是大模型工业化落地的“必备技能”,尤其适合需要快速知识更新、数据隐私保护、结果可解释的企业场景。通过“检索+生成”的协同,RAG让LLM从“闭卷考生”变为“开卷专家”,在电信运维、金融、医疗等领域释放巨大价值。下一步可结合智能体(Agentic RAG)实现自主决策,或融入多模态数据(图片、音频)拓展应用边界。

最近两年大模型发展很迅速,在理论研究方面得到很大的拓展,基础模型的能力也取得重大突破,大模型现在正在积极探索落地的方向,如果与各行各业结合起来是未来落地的一个重大研究方向

大模型应用工程师年包50w+属于中等水平,如果想要入门大模型,那现在正是最佳时机

2025年Agent的元年,2026年将会百花齐放,相应的应用将覆盖文本,视频,语音,图像等全模态

如果你对AI大模型入门感兴趣,那么你需要的话可以点击这里大模型重磅福利:入门进阶全套104G学习资源包免费分享!

扫描下方csdn官方合作二维码获取哦!

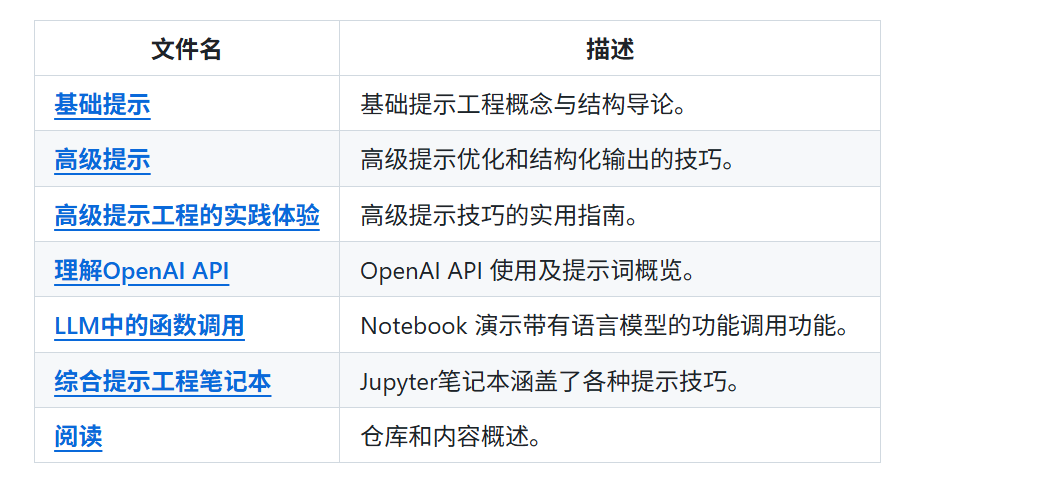

给大家推荐一个大模型应用学习路线

这个学习路线的具体内容如下:

第一节:提示词工程

提示词是用于与AI模型沟通交流的,这一部分主要介绍基本概念和相应的实践,高级的提示词工程来实现模型最佳效果,以现实案例为基础进行案例讲解,在企业中除了微调之外,最喜欢的就是用提示词工程技术来实现模型性能的提升

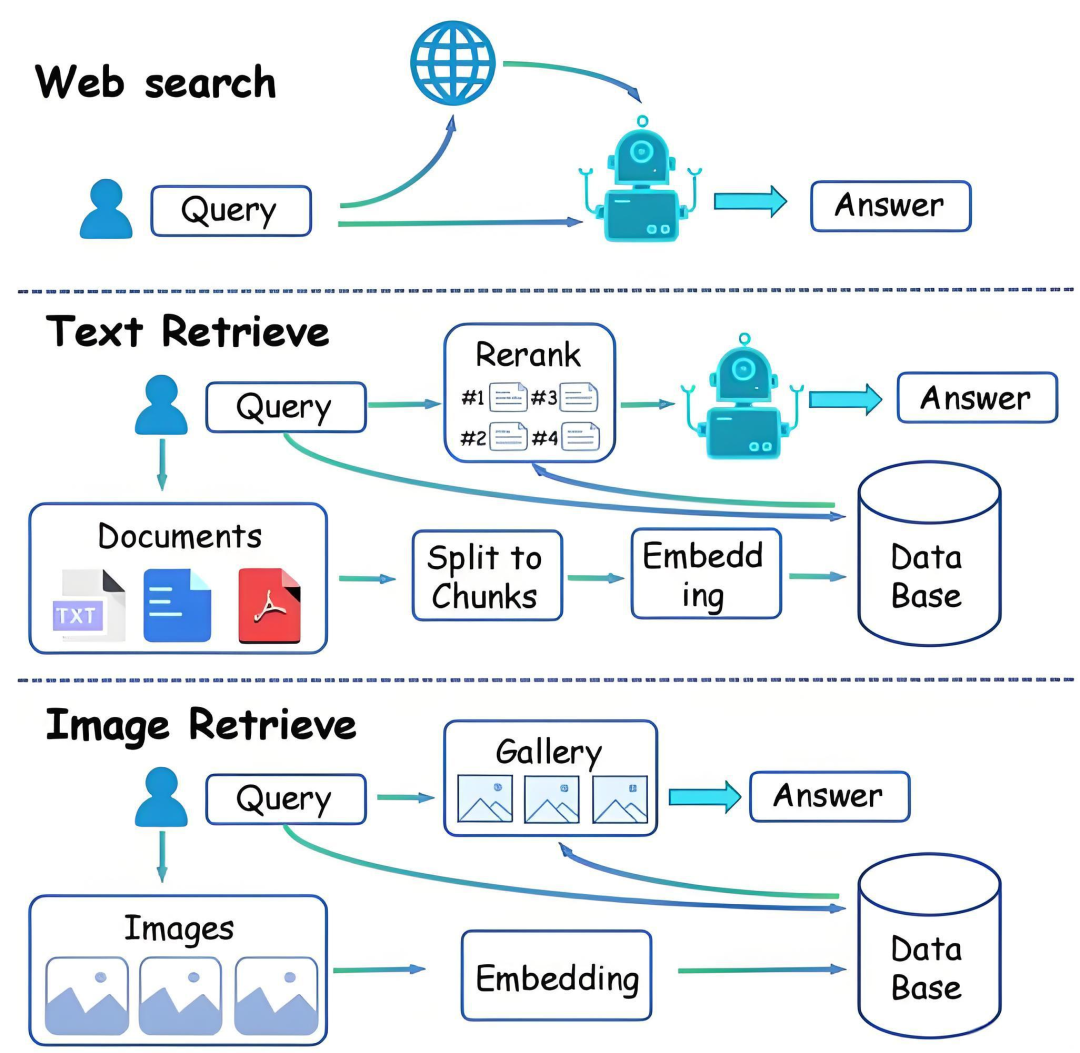

第二节:检索增强生成(RAG)

可能大家经常会看见RAG这个名词,这个就是将向量数据库与大模型结合的技术,通过外部知识来增强改进提升大模型的回答结果,这一部分主要介绍RAG架构与组件,从零开始搭建RAG系统,生成部署RAG,性能优化等

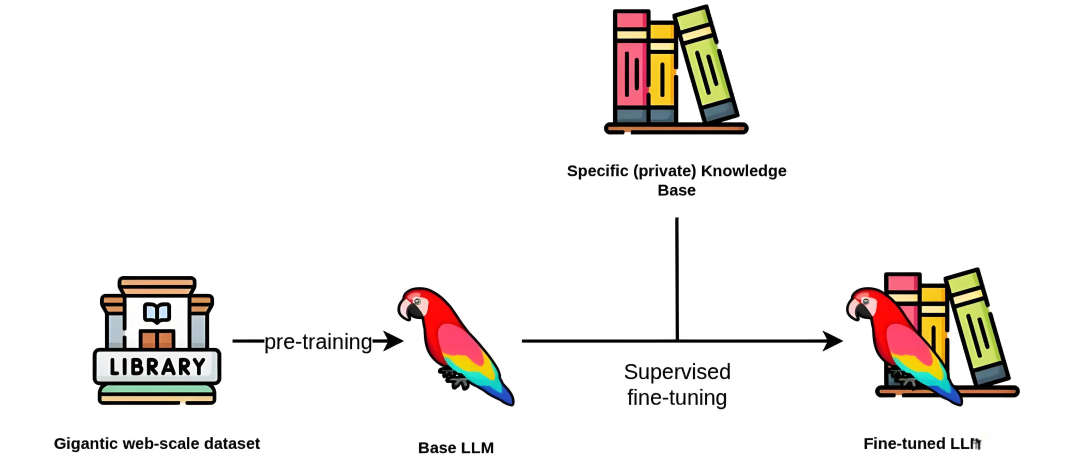

第三节:微调

预训练之后的模型想要在具体任务上进行适配,那就需要通过微调来提升模型的性能,能满足定制化的需求,这一部分主要介绍微调的基础,模型适配技术,最佳实践的案例,以及资源优化等内容

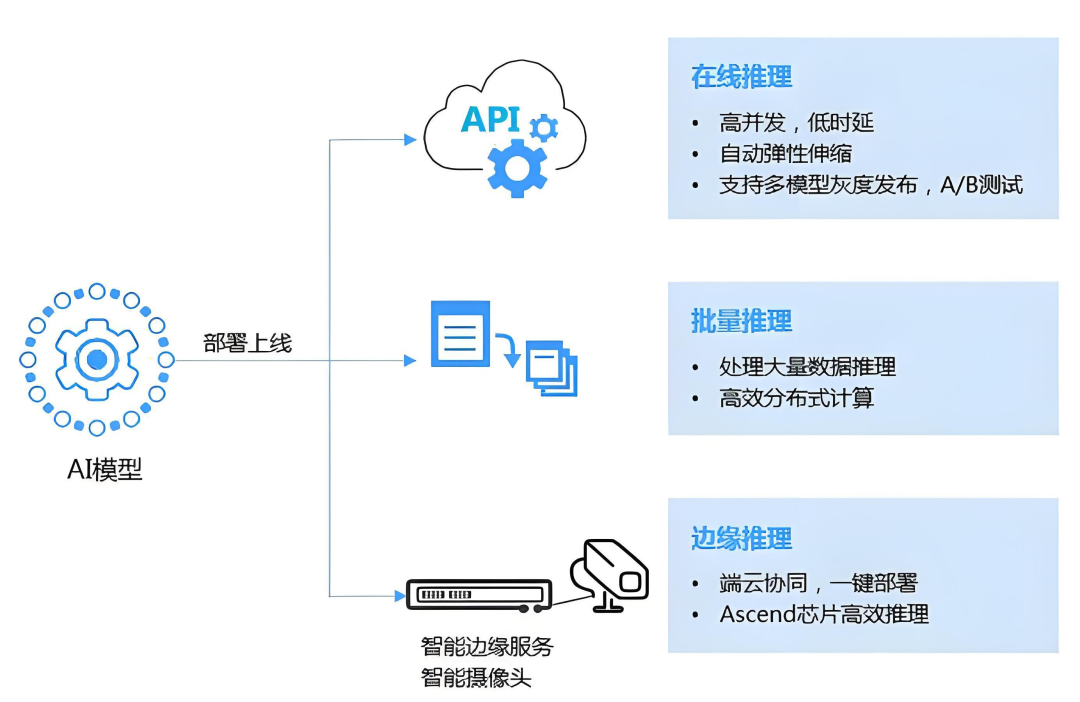

第四节:模型部署

想要把预训练或者微调之后的模型应用于生产实践,那就需要部署,模型部署分为云端部署和本地部署,部署的过程中需要考虑硬件支持,服务器性能,以及对性能进行优化,使用过程中的监控维护等

第五节:人工智能系统和项目

这一部分主要介绍自主人工智能系统,包括代理框架,决策框架,多智能体系统,以及实际应用,然后通过实践项目应用前面学习到的知识,包括端到端的实现,行业相关情景等

学完上面的大模型应用技术,就可以去做一些开源的项目,大模型领域现在非常注重项目的落地,后续可以学习一些Agent框架等内容

上面的资料做了一些整理,有需要的同学可以下方添加二维码获取(仅供学习使用)

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献42条内容

已为社区贡献42条内容

所有评论(0)