大模型也有“情绪病”?EmotionHallucer情感幻觉Benchmark全解,从入门到精通,收藏这一篇就够了!

01 — Introduction

情感理解是一项至关重要却又极具挑战性的任务。近年来,多模态大型语言模型(MLLM)的进步显著提升了其在这一领域的应用能力。然而,MLLM 常常会受到“幻觉”的影响,生成无关或无意义的内容。据我们所知,尽管这个问题十分重要,但目前尚无专门针对 MLLM 中情感相关幻觉的评估研究。本文介绍了 EmotionHallucer,这是首个用于检测和分析 MLLM 中情感幻觉的基准测试工具。与人类不同,人类的情感理解源于生物学和社会学习的相互作用,而 MLLM 则完全依赖于数据驱动的学习,缺乏内在的情感本能。幸运的是,情感心理学为我们提供了关于人类情感的坚实知识基础。基于这些知识,我们从两个角度评估情感幻觉:情感心理学知识和现实世界的多模态感知。为了支持稳健的评估,我们采用了一种对抗性的二元问答(QA)框架,该框架使用精心设计的基本情境和幻觉情境对来评估多模态线性模型(MLLM)的情绪幻觉倾向。通过在 EmotionHallucer 数据集上评估 41 个线性线性模型(LLM)和多模态线性模型(MLLM),我们发现:(1)大多数现有模型在情绪幻觉方面存在显著问题;(2)闭源模型在检测情绪幻觉方面优于开源模型,并且推理能力提供了额外的优势;(3)现有模型在情绪心理学知识方面的表现优于多模态情绪感知。基于这些发现,我们提出了 PEP-MEK 框架,该框架在选定的模型中使情绪幻觉检测的平均性能提高了 9.90%。

02 — Motivation

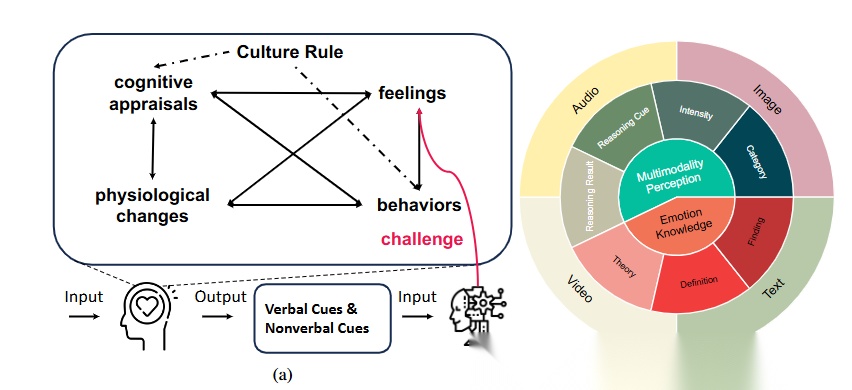

图 1:情绪理解差异与情绪幻觉模型。(a) 人类与多模态逻辑模型 (MLLM) 理解情绪方式的差异。基于成分过程模型 (Scherer, 2009) 和动态系统方法 (Lewis, 2005),人类的情绪理解涉及认知评价、生理变化、感受和行为之间的动态交互。相比之下,多模态逻辑模型依赖于从外部行为线索中获取数据驱动的学习,这限制了它们准确推断潜在情绪状态的能力。(b) 情绪幻觉模型围绕情绪知识和多模态感知两大维度构建,并包含四个模态的七个子类别。

尽管 MLLM 具有先进的能力,但在基于文本或视觉输入运行时,它们常常会产生错误或缺乏依据的响应(Li et al., 2023b; Tong et al., 2024; Petryk et al., 2024)。这种提供误导性信息的问题通常被称为“幻觉”(Rohrbach et al., 2018)。幻觉通常分为两类(Bai et al., 2024):(1)事实性幻觉,即输出结果与现实世界的事实相冲突;(2)忠实性幻觉,即输出结果与输入指令、提供的上下文不符,或存在内部矛盾。为了应对这些挑战,人们越来越重视对多层逻辑模型(MLLM)中的幻觉进行分析和缓解。然而,现有的幻觉基准测试主要针对通用任务(Wang et al., 2024),而对情绪理解任务中的幻觉研究尚不充分。

人类的情感源于先天生物机制和终身社会学习的共同作用(Zeidner et al., 2003),这使得情感建模极具挑战性,如图 1a 所示。与人类不同,多层学习模型(MLLM)依赖于数据驱动的学习,缺乏人类用来自然直觉地解读情感的具身认知和经验基础。幸运的是,了解情感的发展过程有助于我们更深入地理解情感本身(Shiota and Kalat, 2017)。此外,数十年来心理学研究为人类如何感知、处理和推理情绪提供了丰富的见解(Niedenthal 和 Ric,2017),为支持 MLLM 中更可靠的情绪理解提供了宝贵的知识来源。

03 — Contribution

-

据我们所知,我们提出了第一个幻觉基准,用于评估情绪心理学知识和多模态感知。

-

我们对 41 个 LLM 和 MLLM 进行了全面评估,从中得出三个主要结论。

-

基于这些见解,我们提出了 PEP-MEK,并通过实验证明了其在缓解情绪幻觉方面的有效性和潜力。

04 — Method

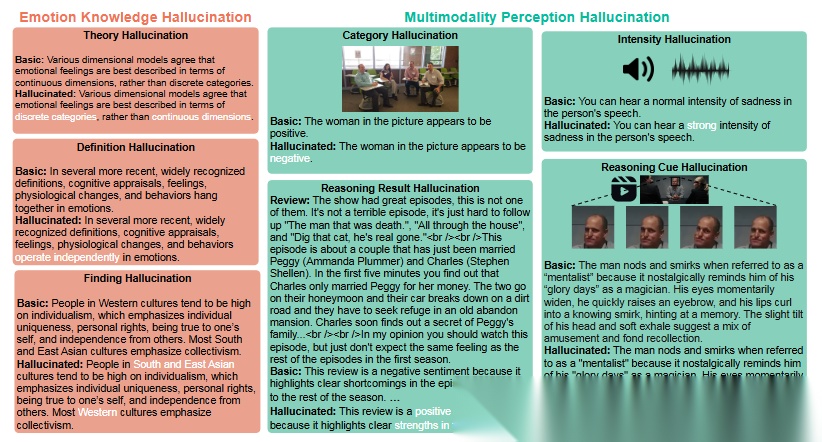

图 2:EmotionHallucer 中的示例任务。每对由一个基本问题组成,用于测试 MLLM 的基本能力,以及一个包含幻觉内容的幻觉问题,用于评估模型检测幻觉的能力。情感知识幻觉针对的是情感心理学知识(Scherer,2009;刘易斯,2005 年;Shiota 和 Kalat,2017),而多模态感知幻觉则聚焦于现实世界的情感理解(Deng 等,2023;Zhang 等人,2018;利文斯通和鲁索,2018 年;Lian 等,2023a;Zadeh 等,2019;Wilf 及其合作者,2023 年)。更多细节可见附录 D。

为了评估情感理解中的幻觉,我们将基准分为两大类:情绪心理学知识和现实世界的多模态情绪感知。该设计产生了七个具体的评估设置,涵盖四种模态,如图 2 所示。在情绪知识方面,我们收集并整理了情绪心理学权威教材中的事实陈述(Shiota 和 Kalat,2017)。在多模态感知维度方面,我们利用了多个广泛使用的数据集,涵盖不同模态:SOUL(Deng 等,2023)用于文本,Twitter15 和 Twitter17(Zhang 等,2018)用于图像,RAVDESS(Livingstone 和 Russo,2018)用于语音,MER 2023(Lian 等,2023a)和 Social-IQ 2.0(Zadeh 等,2019;Wilf 及其合作者,2023 年)视频作品。这些多样的来源使我们能够构建出反映知识和感知情感理解挑战的幻觉实例。

- 情绪心理学知识幻觉

据我们所知,EmotionHallucer 是首个评估大型语言模型(LLM)和多层次语言模型(MLLM)对情感心理学知识理解的幻觉基准,重点关注情感科学的核心理论(Scherer,2009;刘易斯,2005)。我们首先从权威的情绪心理学教材(Shiota 和 Kalat,2017)中挑选了一组成熟且明确的陈述,这些陈述作为真实的依据。基于这些陈述,我们构建了有意与原始内容相矛盾、扭曲或歪曲的幻觉对应体。这种环境使得能够考察模型对幻觉的敏感性情感知识领域,提供了一个框架,用于评估知识基础和幻觉行为,结合人类情绪理论的背景。

理论。我们的工作在情绪心理学理论背景下引入了一种情感心理学理论幻觉环境(Cannon, 1927;Scherer,2009;Lewis,2005),如图 2 所示。为支持这一设定,我们收集了一套核心陈述,这些陈述源自情绪心理学中成熟的理论框架,涵盖了一系列基础视角(Cannon,1927;Scherer,2009;刘易斯,2005 年;Shiota 和 Kalat,2017)。基于这些陈述,并通过注释过程,我们构建了 81 对问答对,作为评估情感理论知识中幻觉的测试实例。

定义。我们还构建了一个情绪心理学定义幻觉环境,针对情绪心理学中广泛接受的概念定义(Berkowitz,1999),如图 2 所示。为支持这一设定,我们从权威学术来源收集了一套关键情绪相关术语的定义,确保每个定义都反映该领域内的共识。这一过程产生了 133 对问答对,作为评估情感科学中与定义知识相关幻觉的评估实例。

寻找。我们进一步构建了一个情绪心理学发现幻觉环境,重点关注描述观察到现象但尚未被正式化为完整理论框架的情绪研究实证发现(Kagitcibasi, 1997),如图 2 所示。该类别包括有充分记录的结果,如跨文化情感表达差异(Hareli 等,2015)、婴幼儿与成人之间的发育差异(Best 等,2013)以及文献中报道的其他实证观察。该设置产生 178 对问答对,使得与情绪心理学中非理论但实证基础知识相关的幻觉行为进行评估成为可能。

2.多模态感知幻觉

除了情绪心理学知识外,我们还构建了一个现实世界的多模态情绪感知幻觉环境,重点评估情绪中幻觉风险。涉及多模态输入(如文本、音频和视觉信号)的直接任务,如图 2 所示。为构建该环境,我们收集了广泛使用的情绪理解数据集样本(Deng 等,2023;Zhang 等人,2018;利文斯通和鲁索,2018 年;Lian 等,2023a;Zadeh 等,2019;Wilf 及其合作者,2023 年)。随后,我们对这些样本进行了筛选和优化,构建出幻觉描述与输入所传达情感内容相矛盾或误解的实例。这种环境使得在真实的多模态环境中评估幻觉成为可能,在这些环境中,情感理解需要整合来自多个来源的模糊且依赖情境的线索(Zadeh 等,2017)。

类别。继先前关于物体幻觉的研究(Rohrbach 等,2018),如图 2 所示,我们引入了情感类别幻觉环境,指的是情绪类别的错误生成或识别(Dzedzickis 等,2020)。具体来说,这种类型的幻觉指的是模型生成不存在或不恰当的情绪类别的情况。此外,该情境中的情绪类别不仅限于文本任务中常用的二元情感标签(如正面/负面),还涵盖视觉和多模态情绪识别任务中常见的离散基本情绪类别(如幸福、愤怒、悲伤)。

强烈。我们还引入了情绪强度幻觉设置,涉及对情绪表达强度的误解,如图 2 所示。与传统情感计算方法用连续价值-唤醒维度表示情绪不同(Russell,1980),我们采用了离散强度描述符(如轻度/轻度、正常、强烈),这些描述符更符合大型语言模型的表征能力。在这种情况下,当模型夸大、淡化或以其他方式不准确描述输入所传达的情绪强度时,就会产生幻觉。

推理结果。继之前的研究(Lian 等,2023a;Cheng 等,2024),我们引入了推理结果幻觉环境。这种类型的幻觉发生在模型能够准确地从多模态输入(如面部表情、语音音调或文本)中提取情感线索,但仍然产生错误的情感解读,如图 2 所示。在这种情况下,幻觉并非源于对输入信号本身的误判,而是情绪推理的错误。这种设计反映了情感理解中感知与推理之间的关键区别,强调准确的信号识别并不一定能保证得出恰当的情感结论。

推理提示。继之前的研究(Lian 等,2023a;Cheng 等,2024),我们引入了推理提示幻觉设置,如图 2 所示。在这种情况下,幻觉发生在模型忽视、误解或捏造关键多模态信号(例如,缺少愤怒语气、误读面部表情或从文本中推断出无根据的情感语境),导致推理过程不可靠。关键是,推理提示幻觉捕捉了由于错误的提示选择或解读导致推理路径本身有缺陷的情况,而这些因素与最终情绪判断的正确性无关。

3.基准分析

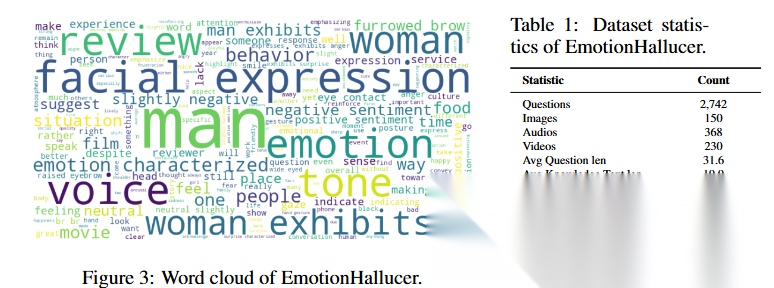

定量分析。表 1 概述了 EmotionHallucer。基准测试共包含 2742 道题,平均字数为 31.6 个单词。EmotionHallucer 涵盖了四种模式:文本、图像、音频和视频。我们进一步对 MER 2023 收集的数据进行了分类:Lian 等(2023a)和 Social-IQ 2.0Zadeh 等(2019);Wilf 和合作者(2023)分为短视频和长视频子集。更多描述可见附录 A.3。

定性分析。为了更直观地理解 EmotionHallucer,关键术语通过词云呈现,如图 3 所示。可视化突出了情绪、声音、面部表情和语调等常见概念,这些与我们基准测试中的核心模态和推理成分密切相关。这些结果表明 EmotionHallucer 有效地聚焦于情感幻觉所需的多模态线索。

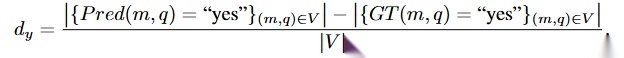

偏见评估。除了准确性外,我们还计算了是百分差(Pct. Diff)和假阳性比(FP Ratio)(Guan 等,2024;Wang 等,2024)以揭示多层次多层次(MLLM)中的偏差。具体来说,是百分比差异的计算方式为

其中 V 是问题对集合,m 表示额外的模态信息,如图像、音频或视频(纯文本问题缺少这一成分),q 指问题本身,GT (m, q) 是基本真相。较小的表示模型中“是”的回答更接近真实情况,显示语言偏差较少。假阳性比率的计算方式为

其中 W 是错误回答的问题对集合。表示所有错误预测答案中“是”的百分比。接近 50%的数值表示模型偏差较小。

05 — Experiment

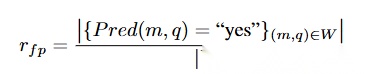

如表 2 所示,我们比较了 EmotionHallucer 上所有可用模态的模型。虽然最强的闭源 Gemini 模型优于开源模型,但整体表现仍不理想,反映出情感理解和幻觉带来的固有挑战。值得注意的是,所有开源模型都未能超过随机猜测预期的 25%准确率,这也凸显了 MLLM 在处理情感推理方面目前的局限性。在“是/否偏见”评估中,通用多层次营销人员表现出更好的中立性,较少过度自信的肯定语。相比之下,情感特异模型 EmotionLLaMA 在这方面表现明显差。这可能归因于其对情感内容的细致调整。这也可能是因为该模型相较于近期的 MLLM 相对过时,可能缺乏最新的进展。

鉴于大多数流行的 MLLM 针对视觉模态进行了优化,且不支持仅音频输入,我们开发了 EmotionHallucer–NoAudio 基准子集,排除了音频模态(见表 3)。由于篇幅限制,我们报告了 11 个代表性模型的结果。与早期发现一致,闭源模型在整体准确性和“是/否偏差”评估中均优于开源模型。Gemini-2.5-Pro 性能最佳,紧随其后的是 Gemini-2.5-Flash。在开源模型中,Qwen2.5 VL 表现最佳,显著超过随机猜测基线。

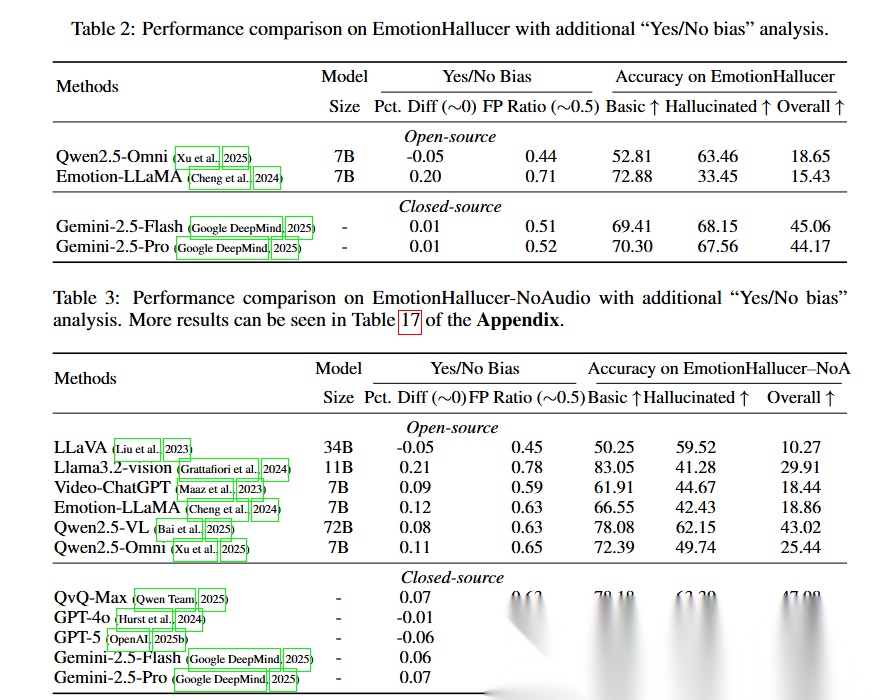

图 4:部分选定模型的单模性能。T、I、A、V/S 和 V/L 分别代表文本、图像、音频、短视频和长视频。更多模型和实现细节见附录 C。

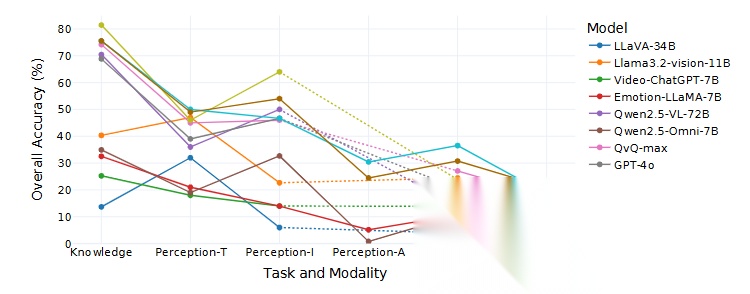

单模态:为了更细致地理解 MLLM 在任务和模态间的行为,我们报告了每种具体模态的表现。如图 4 所示,模型在情感知识方面表现最佳,准确率在感知任务中稳步下降,从文本到图像,再到音频和视频。这一趋势可归因于两个主要因素:(1)当前训练主要聚焦于文本数据,提升模型在知识导向任务中的表现;以及(2)模态中缺乏高质量的情感注释,这限制了模型学习细粒度情感理解的能力。这些结果强调了一个关键的未来方向:通过更好的数据质量和均衡的模态训练,提升跨模态情感的理解。

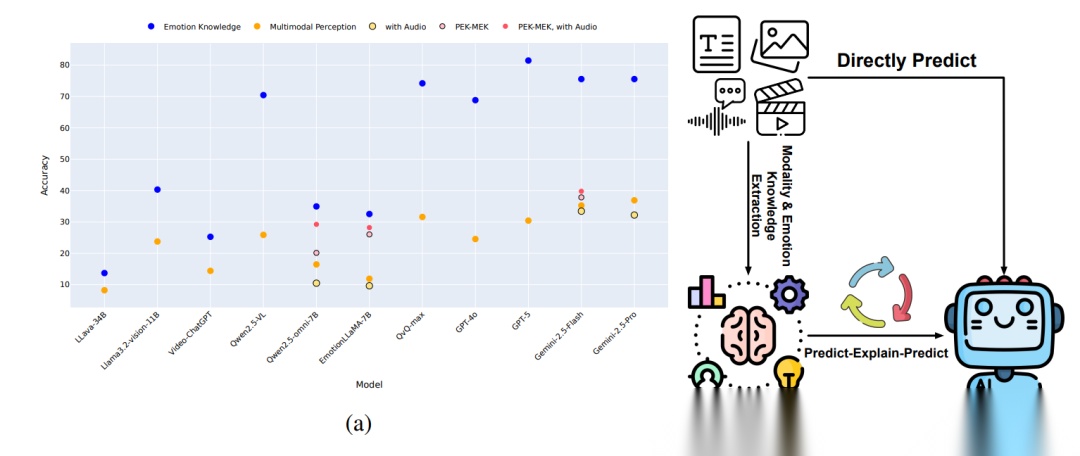

图 5:情绪幻觉分析及我们提出的框架。(a)情感知识与多模态感知中幻觉检测的比较。(b)PEP-MEK 框架。

我们观察到,大多数模型在多模态感知幻觉环境下表现明显差于 EmotionHallucer 中的情感知识幻觉场景。基于这一观察,我们提出了一种简单但有效的基于解释的方法,以减轻多模态情绪感知错误引发的幻觉问题。

模型在情感知识和多模态感知方面的表现如图 5a 所示。一个关键观察是,大多数模型在多模态感知上的准确率显著降低,这凸显了与其在结构化情绪知识表现上的巨大差距。这一结果表明,虽然现有模型对结构化知识的处理较为良好,但在理解现实情感方面存在困难。因此,本节重点提升模型对多模态感知幻觉的鲁棒性。在评估模型中,QvQ-Max 优于 Qwen2.5-VL,我们认为这与其推理范式的不同有关。鉴于 LLM 通常比幻觉检测更擅长事实检测(Ji 等,2023),我们假设引入更具结构性和针对性的推理框架,并富含情感特异性知识,可能进一步减少 MLLM 中的情绪幻觉。

基于这些发现,我们提出了一个新框架——以模态与情绪知识预测-解释-预测(PEP-MEK)框架,旨在提升 MLLM 检测多模态情绪幻觉的表现。图 5b 展示了 PEP-MEK 的框架。PEP-MEK 不依赖直接预测,而是引入中间推理阶段,以提高模型透明度和情感理解决策可靠性。首先,PEP-MEK 通过提示引导模型自主从输入(文本、图像、音频、视频)中提取特定模态和情感知识。提取出的信息随后与原始输入结合,进行初步预测。接下来,模型利用输入和提取的知识,生成预测的解释。然后,将解释纳入以精细预测。这一过程使模型能够更有效地推理并减少幻觉。

学AI大模型的正确顺序,千万不要搞错了

🤔2026年AI风口已来!各行各业的AI渗透肉眼可见,超多公司要么转型做AI相关产品,要么高薪挖AI技术人才,机遇直接摆在眼前!

有往AI方向发展,或者本身有后端编程基础的朋友,直接冲AI大模型应用开发转岗超合适!

就算暂时不打算转岗,了解大模型、RAG、Prompt、Agent这些热门概念,能上手做简单项目,也绝对是求职加分王🔋

📝给大家整理了超全最新的AI大模型应用开发学习清单和资料,手把手帮你快速入门!👇👇

学习路线:

✅大模型基础认知—大模型核心原理、发展历程、主流模型(GPT、文心一言等)特点解析

✅核心技术模块—RAG检索增强生成、Prompt工程实战、Agent智能体开发逻辑

✅开发基础能力—Python进阶、API接口调用、大模型开发框架(LangChain等)实操

✅应用场景开发—智能问答系统、企业知识库、AIGC内容生成工具、行业定制化大模型应用

✅项目落地流程—需求拆解、技术选型、模型调优、测试上线、运维迭代

✅面试求职冲刺—岗位JD解析、简历AI项目包装、高频面试题汇总、模拟面经

以上6大模块,看似清晰好上手,实则每个部分都有扎实的核心内容需要吃透!

我把大模型的学习全流程已经整理📚好了!抓住AI时代风口,轻松解锁职业新可能,希望大家都能把握机遇,实现薪资/职业跃迁~

这份完整版的大模型 AI 学习资料已经上传CSDN,朋友们如果需要可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献165条内容

已为社区贡献165条内容

所有评论(0)