从图灵测试到Openclaw:一部80年AI“智慧觉醒”史诗

2023 年,美国高中生艾米丽为历史课作业发愁:她需要写一篇关于 “大萧条” 的论文,但毫无头绪。她试着问 ChatGPT:“能帮我列个论文大纲吗?要包含普通人的故事。”

几秒后,ChatGPT 返回了一个详细大纲,还附上了 1933 年芝加哥面包店前排队领食物的照片描述、一位失业父亲的日记摘录。艾米丽按照大纲写作,最终论文得了 A+。她在致谢中写道:“ChatGPT 不是老师,而是一个‘知识伙伴’—— 它让我学会了如何从海量信息中提取有价值的内容。”

艾米丽与ChatGPT的互动,是人工智能从实验室走向人类生活的缩影,几秒钟的背后是AI近80年走完的进化之路。人工智能从一个模糊的科学幻想,到如今深度渗透人类生活的各个领域,其发展历程充满了突破、挫折与重生。

一、理论奠基期(1940s-1950s):一个数学家的战时执念

AI 的起点,其实是一场战争。

1943 年,英国数学家艾伦·图灵坐在布莱切利庄园的地下室,面前是他为破解德国"恩尼格玛密码机"设计的计算装置。后来的研究估算,图灵团队的工作缩短了二战进程约两年,间接挽救了超过 1400 万人的生命。但图灵本人更着迷的,是另一个问题:“机器能思考吗?”

1950 年,他在论文《计算机器与智能》里给出了一种检验方法:让机器和人类同时接受文字对话测试,如果考官无法区分哪个是机器,机器就算通过了。这就是图灵测试。

六年后,1956 年的达特茅斯会议上,约翰·麦卡锡把这个方向正式命名为"人工智能"。参会者里,一个叫马文·明斯基的年轻人在笔记本上写下:"我们要让机器学会学习。"这句话后来成了整个领域的暗线。

二、符号主义探索期(1956-1970s):规则驱动的“早期智能”*

早期 AI 研究者相信,只要把规则写得足够完备,机器就能像人一样推理。用代码定义:“如果下雨,那么带伞”,然后让机器处理更复杂的问题。

这个路子走到了 1966 年。

那年,麻省理工的约瑟夫·维森鲍姆开发了聊天机器人 ELIZA。程序只有 200 行,逻辑极简单:识别关键词,套用预设回应。用户说"我很伤心",ELIZA 就问"你为什么伤心?"

但有件事让维森鲍姆震惊了——他的秘书开始依赖 ELIZA,甚至请他离开办公室,以便单独"聊天"。后来还有患者声称 ELIZA 比心理医生更懂自己。维森鲍姆在回忆录里写道:“我没想到,人类会如此轻易地把情感投射到一段代码上。”

这件事现在读起来仍然有点不安。不是因为 ELIZA 多聪明,而是因为它暴露了人类有多渴望被倾听。

ELIZA的成功让科学家乐观,但现实很快泼来冷水:它无法理解“下雨”和“带伞”的因果关系,更无法处理复杂对话。

到 1974 年,这条路走不下去了。规则系统无法处理语言里的歧义,早期计算机算力极低(大约是现代手机的百万分之一),处理速度慢、存储容量小,无法满足复杂人工智能算法的需求。AI 研究经费大幅缩减,进入第一次"寒冬"。

三、专家系统复兴期(1980s):知识工程的“实用尝试”

寒冬过后,科学家换了思路:与其写通用规则,不如把特定领域的专家知识直接编进数据库。这就是"专家系统"。

最有名的案例是 1976 年斯坦福开发的 MYCIN。它存储了 600 条抗生素使用规则,根据症状推荐治疗方案,准确率在测试中甚至超过年轻医生。

但 1982 年出了事。一位脑膜炎患者入院,MYCIN 按症状推荐了青霉素,却没有调取到病历里的"青霉素过敏"记录——因为规则库里根本没有"过敏史"这个字段。患者出现严重反应,虽然抢救成功,但事件让整个医学界警觉:专家系统只能处理被编码过的知识,遇到规则库之外的情况,它没有任何应对能力。

更实际的问题是钱。维护一套专家系统每年需要投入数百万美元更新规则。1987 年,随着普通电脑性能提升,专家系统的成本优势彻底消失,AI 再次进入寒冬。

四、机器学习崛起期(1990s-2000s):从“规则”到“数据学习”

互联网带来了真正的转机。不是因为算法更聪明,而是因为数据第一次变得足够多。

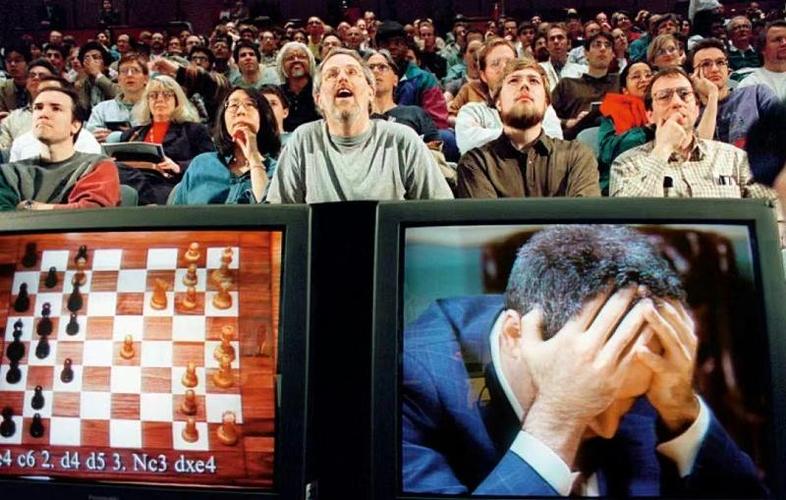

1997 年 5 月 11 日,纽约曼哈顿。国际象棋冠军加里·卡斯帕罗夫对阵 IBM 的"深蓝"。

首局卡斯帕罗夫赢了,赛后嘲笑深蓝走法像新手。但第二局,深蓝下出一步让他愣住的棋:主动牺牲一个车,换取后续进攻机会。卡斯帕罗夫后来说,那步棋"不像机器的计算,倒像人类的直觉"。

最终深蓝以 3.5:2.5 获胜。背后的逻辑其实不神秘:它用 3000 万局棋谱训练,找出了胜率最高的策略模式。机器不再需要人类告诉它怎么下棋,它从数据里自己总结出来了。这标志着AI从“规则驱动”转向“数据驱动”。

这一步转变,事后看来比任何人当时意识到的都更深远。

五、深度学习革命期(2010s-2020s):从“感知”到“认知”的跨越

2012 年是个分水岭。辛顿团队的 AlexNet 在 ImageNet 图像识别竞赛上,将错误率从 26% 压到了 15%,远超所有传统算法。深度学习从学术圈的边缘方向,变成了整个行业押注的主赛道。

2016 年 3 月,首尔,围棋冠军李世石和 AlphaGo 的第四局。李世石走出一步"78 手挖",这步棋在人类职业棋谱中几乎从未出现。现场解说员说这步棋太冒险。

AlphaGo 只用了 1 秒回应,随后赢下这局。

李世石赛后说了一句让我印象深刻的话:“那步棋,我是想看看 AI 有没有创造力。它的应对让我意识到,它不只是在计算。”

AlphaGo 的方法是强化学习——通过每天自我对弈 300 万局,它学到了人类无法用语言描述的"棋感"。规则没法教会你这个,数据也不够,必须靠大量试错积累出来的直觉。这标志着AI从“感知”(识别图像、语音)迈向“认知”(理解、创造)。

六、大模型与智能体时代(2020s至今):从“工具”到“自主智能体”

2020 年,OpenAI 发布 GPT-3(1750 亿参数),证明了一件事:语言本身就是智能的一种压缩形式。2022 年 ChatGPT 发布后,大语言模型从实验室走向了普通人的日常。2023 年 GPT-4 开始理解图像,Sora 生成视频,AI 进入了所谓的"多模态"阶段。此后开源模型崛起,具身智能诞生,模型迭代迈向日更级别。

但真正改变游戏规则的,是几个不那么显眼的技术进展。

Function Calling(函数调用):2023 年 OpenAI 在 GPT-4 中推出这个功能,让模型可以主动调用外部工具——查天气 API、查数据库、跑代码。在这之前,大模型只能根据训练数据"背答案";之后,它能实时获取外部信息,回答范围突破了知识边界。

AI Agent(智能体):能感知环境、自主决策、调用工具完成任务的 AI 系统。它能记住历史对话,把抽象目标拆解成可执行步骤,并根据执行结果动态调整。说得直白点,它不只是回答"应该怎么做",而是直接去做。

MCP(模型上下文协议):2024 年 11 月 Anthropic 发布,本质上是 AI 连接外部工具的统一接口标准。在这之前,每个 AI 模型接入每个外部服务,都需要写一套定制化代码,维护成本极高。MCP 把这个过程标准化了——就像 USB 接口让各种设备能直接插拔一样。

Agent Skills:2025 年 10 月 Anthropic 推出,把特定领域的任务流程、Prompt 逻辑、外部知识库打包成标准化文件(SKILL.md),让智能体按需加载。AI 开发的方式,开始从"写提示词"变成"写上下文配置"。

OpenClaw:2025 年 11 月,奥地利程序员 Peter Steinberger 随手做了个周末项目 Clawdbot,后来改名 OpenClaw。没有人预料到接下来会发生什么——GitHub star数在 3 个月内突破 27.8 万,增速超过 Linux 内核早期。这个框架让 AI 智能体真正能在本地运行:读写文件、操控浏览器、执行脚本。不是聊天助手,是能实际干活的"数字员工"。

国内阿里、字节、腾讯、百度随后跟进,"百虾大战"打响。Steinberger 说:“OpenClaw 的目标是让每个人都能有自己的 AI 员工,而不是 AI 玩具。”

思考与未来图景

从 ELIZA 的 200 行代码,到 OpenClaw 的 27.8 万星标;从图灵破译密码时的执念,到 ChatGPT 帮艾米丽写论文——这中间发生了很多次预测失败。

每一次"寒冬"来临,都是因为有人高估了当前技术,低估了某个还没出现的要素(数据量、算力、标准化接口)。每一次复苏,都不是靠理论突破,而是靠某个具体的、可量化的工程进展触发。

现在我们说 AGI(通用人工智能),说人机协作,说 AI 会"替代人类"或"解放人类"。这些叙事我都半信半疑。让我更有把握的,是 MYCIN 那个案例:一套 600 条规则的系统,因为"过敏史"字段的缺失,差点造成事故。这个细节没有过时。AI 系统能做的事越来越多,但它仍然只能处理已经被编码、被设计、被预见到的情况。那些没有被写进去的字段,依然是它的盲区。

技术在进化,这个问题的本质没有变。

在2026年的今天,我们既是AI历史的书写者,也是这场智慧觉醒的见证人。或许正如维特根斯坦所说:“语言的边界即世界的边界”。当AI突破语言桎梏之日,我想那便是人类文明新纪元的破晓之时。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献5条内容

已为社区贡献5条内容

所有评论(0)