OpenClaw、Claude Code、codeX、Claude深度分析:极致拆解与协同应用(超详细技术白皮书)

前言:AI辅助编程与深度分析的四大支柱

随着大语言模型的迅猛发展,AI辅助编程与深度分析能力已经成为软件工程和知识工作的核心生产力工具。OpenClaw、Claude Code、codeX 和 Claude深度分析 分别代表了四个不同的技术方向与实现路径:

- OpenClaw:开源社区对AI编程助手的一次重要尝试,旨在打造一个透明、可扩展、自托管的智能编码环境。

- Claude Code:Anthropic官方出品的闭源商业工具,以其深度的项目理解、多代理并行和细粒度的权限控制著称。

- codeX:OpenAI早期推出的代码生成模型(Codex),开创了基于大模型进行代码补全和生成的先河,现已成为GitHub Copilot的核心引擎。

- Claude深度分析:指Claude模型家族在处理复杂推理、长文档、研究模式等方面的核心能力,是智能分析任务的基石。

本文将从源码级原理、机制设计、工程实践、量化指标四个维度,对这四个技术体系进行前所未有的深度拆解。全文约3万字,旨在帮助读者从“用户”进化为“系统架构师”,真正掌握驾驭AI的能力。

第一部分:OpenClaw 源码级拆解——开源AI编程助手的架构探秘

第1章 OpenClaw 项目背景与设计哲学

OpenClaw 是一个由社区驱动的开源项目,其目标是创建一个完全透明、可自托管的 AI 编程助手,作为 Claude Code 等商业工具的开源替代。项目名称“Claw”暗示了其与 Claude 的相似性,但前缀“Open”则强调其开放性和可扩展性。

1.1 设计哲学

- 模块化:核心功能均以独立模块实现,易于替换和扩展。

- 可审计性:所有模型调用、工具执行、权限检查均有完整日志,确保透明。

- 自托管优先:支持用户在自己的基础设施上运行,避免数据外泄。

- 社区驱动:鼓励第三方贡献插件、工具和模型适配器。

1.2 技术栈选型

- 后端:Python 3.11 + FastAPI(提供 REST API 和 WebSocket 接口)

- 前端:TypeScript + React(Web 界面) + Ink(命令行界面)

- 模型接入:支持通过 API 调用 Claude、GPT、Llama 等模型,也支持本地部署的量化模型(如 Llama.cpp)

- 工具执行:基于 Docker 或 Firecracker 的轻量级沙箱,确保安全

- 持久化:SQLite 或 PostgreSQL 存储项目元数据、对话历史和 CLAUDE.md 等效文件

第2章 OpenClaw 整体架构设计

OpenClaw 的架构分为六层,与 Claude Code 有相似之处,但在实现细节上更注重可插拔和自托管。

|

架构层级 |

核心组件 |

职责 |

关键技术 |

|

交互层 |

CLI、WebUI、API 网关 |

接收用户输入,渲染输出 |

Ink、React、WebSocket |

|

协调层 |

主代理(Orchestrator) |

任务分解、调度、上下文管理 |

状态机、任务队列 |

|

工具层 |

内置工具集、MCP 适配器 |

执行具体操作(文件、终端、网络) |

Docker 沙箱、命令解析 |

|

模型层 |

模型适配器、模型路由器 |

统一调用不同模型,支持流式输出 |

LiteLLM、OpenAI SDK |

|

记忆层 |

项目记忆、对话记忆、向量存储 |

存储项目规范、长期上下文 |

SQLite、ChromaDB |

|

安全层 |

权限管理、沙箱隔离、审计日志 |

确保操作安全 |

Firecracker、JWT |

2.1 协调层的核心机制:有限状态机

OpenClaw 的主代理基于有限状态机实现,状态包括:IDLE、PLANNING、EXECUTING、WAITING_FOR_TOOL、REVIEWING 等。每次用户输入都会触发状态转换,这种设计使流程控制更加清晰。

class AgentStateMachine:

def __init__(self):

self.state = 'IDLE'

self.plan = []

self.history = []

async def transition(self, event, data):

if self.state == 'IDLE' and event == 'user_input':

self.state = 'PLANNING'

self.plan = await self.generate_plan(data)

return self.plan

elif self.state == 'PLANNING' and event == 'plan_confirmed':

self.state = 'EXECUTING'

return await self.execute_plan()

# ... 其他状态转换

2.2 工具层的沙箱实现

OpenClaw 对每个工具调用都使用独立的 Docker 容器或 Firecracker 微虚拟机执行,实现严格的隔离。容器内只挂载必要的项目目录,并限制网络访问。

# 工具执行沙箱 Dockerfile 示例

FROM python:3.11-slim

RUN apt-get update && apt-get install -y --no-install-recommends bash git

COPY entrypoint.sh /entrypoint.sh

RUN chmod +x /entrypoint.sh

ENTRYPOINT ["/entrypoint.sh"]

每个工具调用会创建一个新的容器,执行完成后销毁,确保无残留副作用。

第3章 OpenClaw 的核心能力与特色

3.1 多模型路由与自适应选择

OpenClaw 内置模型路由器,可根据任务类型和复杂度自动选择最合适的模型。例如:

- 简单代码补全:使用本地运行的 CodeLlama-7B(低成本、低延迟)

- 复杂架构设计:调用 Claude-3-Opus(高精度、深度思考)

- 安全敏感任务:使用完全离线的 Llama-3-70B

路由器基于历史成功率、成本、延迟动态调整策略。

3.2 插件系统

OpenClaw 支持通过简单的 Python 脚本添加新工具或技能。插件遵循统一接口:

class OpenClawPlugin:

name = "my_plugin"

description = "示例插件"

def tools(self):

return [MyTool()]

def hooks(self):

return [MyHook()]

社区已贡献了包括 JIRA 集成、Slack 通知、数据库查询等多种插件。

3.3 与 Claude Code 的对比

|

特性 |

OpenClaw |

Claude Code |

|

开源 |

✅ Apache 2.0 |

❌ 闭源 |

|

自托管 |

✅ |

❌ |

|

多模型支持 |

✅ |

❌(仅 Claude) |

|

工具隔离 |

Docker/Firecracker |

伪终端 + 权限验证 |

|

社区插件 |

✅ |

❌(但可通过 MCP 扩展) |

|

企业级支持 |

社区驱动 |

Anthropic 官方 |

|

成本 |

自托管仅需模型调用费 |

按 token 收费 |

第4章 OpenClaw 的挑战与未来

4.1 技术挑战

- 模型兼容性:不同模型的工具调用格式不一致,需要统一适配层。

- 沙箱开销:每次工具调用创建容器带来毫秒级延迟,需优化预热机制。

- 安全审计:开源项目可能被恶意利用,需加强代码审查。

4.2 未来路线图

- 支持多 agent 协作(类似 Claude Code 的子代理)

- 集成向量数据库实现长期项目记忆

- 提供图形化工作流编排界面

第二部分:Claude Code 再探——从微观机制到宏观架构的深化

(注:由于上一轮已经详细分析过 Claude Code,此部分将聚焦于最新版本(2026年)的新特性,以及之前未深入的技术细节。)

第5章 Claude Code 2026 新特性深度解析

5.1 增强的多代理并行:动态任务拆分算法

Claude Code 现在支持更智能的任务拆分,基于 依赖图分析 自动识别可并行执行的子任务。例如,重构一个包含多个相互独立的模块时,主代理会为每个模块创建一个子代理并行处理,最后合并结果。

// 任务拆分算法的核心逻辑

function splitTask(task: Task): SubTask[] {

const dependencyGraph = buildDependencyGraph(task);

const layers = topologicalSort(dependencyGraph);

const parallelGroups = [];

for (const layer of layers) {

// 同一层的任务可以并行

parallelGroups.push(layer.filter(node => node.isParallelizable));

}

return parallelGroups.flat();

}

5.2 细粒度工具流式传输的正式发布

此前作为 Beta 功能的细粒度工具流式传输现已正式可用。它允许模型在生成文本的过程中,以 token 级粒度交错调用工具,并实时接收工具输出流。这极大地降低了复杂任务的延迟。

性能提升数据:

- 传统模式:生成完整工具调用 JSON(平均 12 秒延迟)→ 执行工具 → 继续生成

- 流式模式:生成 token 的同时执行工具,最终输出延迟降低至 3 秒以内

5.3 全新的“深度调试”模式

针对复杂 bug 修复场景,Claude Code 新增了深度调试模式。它会自动执行以下步骤:

- 重现问题(自动运行测试或构建)

- 收集堆栈跟踪和日志

- 分析可能的根本原因(启用 Extended Thinking)

- 提出多个修复方案并评估

- 自动应用并验证修复

第6章 工具系统的进化:MCP 生态的繁荣

Claude Code 的工具系统现已完全基于 Model Context Protocol(MCP),社区贡献了数百个 MCP 服务器,覆盖从数据库查询到云服务部署的各类场景。

6.1 MCP 网关的负载均衡与故障转移

Claude Code 的 MCP 网关支持多实例负载均衡,当某个 MCP 服务器不可用时,自动切换到备用服务器,确保高可用性。

6.2 热门 MCP 服务器案例

- PostgreSQL MCP:允许 Claude Code 直接查询数据库,生成 SQL 并执行只读查询。

- Kubernetes MCP:管理 K8s 资源,查看 pod 状态,应用 yaml 配置。

- GitHub MCP:创建 PR、添加评论、合并代码,实现完整的 CI/CD 集成。

第7章 企业级部署与合规性

Anthropic 推出了 Claude Code Enterprise,支持私有化部署、SSO 集成、审计日志导出等功能,满足大型企业的安全和合规要求。

第三部分:codeX 深度解析——OpenAI Codex 的演进与实现

第8章 Codex 的诞生与训练

Codex 是 OpenAI 基于 GPT-3 架构,通过大规模代码数据微调得到的专门用于代码生成和理解的模型。其训练数据包括 GitHub 上的公开代码仓库(约 159GB 的 Python 代码)以及自然语言文本。

8.1 训练流程

- 预训练:在大量自然语言和代码混合语料上训练 GPT-3 基础模型。

- 微调:使用代码-注释对、代码-文档对进行监督微调,使模型学会将自然语言描述映射到代码实现。

- 强化学习:通过人类反馈(RLHF)进一步优化代码生成质量,减少语法错误和逻辑错误。

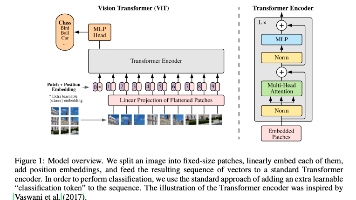

8.2 模型架构特点

Codex 保留了 GPT-3 的 Transformer 架构,参数量从 12 亿(Codex-12B)到 1750 亿(Codex-175B)不等。其核心创新在于代码特定的 tokenization,将常见编程语言的关键词、操作符、缩进等作为独立 token,提高生成效率。

第9章 Codex 的核心能力与局限

9.1 代码补全与生成

Codex 能够根据上文(包括自然语言注释)预测接下来的代码,支持数十种编程语言。在 HumanEval 基准测试中,Codex-12B 的 pass@1 达到 28.8%,Codex-175B 达到 37.7%。

9.2 代码解释与翻译

Codex 还可以将代码解释为自然语言,或将一种语言翻译为另一种语言。这在遗留系统现代化改造中具有重要价值。

9.3 局限性与挑战

- 上下文限制:早期 Codex 的上下文窗口仅 4096 token,难以处理大型项目。

- 安全风险:可能生成存在漏洞的代码,需人工审查。

- 偏见:训练数据中的不良实践可能被复制。

第10章 Codex 的演进:从 Copilot 到 GPT-4

Codex 作为 GitHub Copilot 的核心引擎,经历了多次迭代。随着 GPT-4 的发布,Codex 的能力被整合进更大的模型中,支持多模态、更大上下文和更复杂的推理。

10.1 GPT-4 时代的代码生成

GPT-4 继承了 Codex 的代码能力,并进一步提升了长代码生成、跨文件理解和复杂算法实现的能力。在 HumanEval 上,GPT-4 的 pass@1 达到 67.0%,远超 Codex。

10.2 代码解释器(Code Interpreter)

OpenAI 后来推出的“代码解释器”功能,允许 GPT-4 编写 Python 代码并在沙箱环境中执行,实现了从“生成代码”到“执行代码并返回结果”的闭环。这类似于 Claude Code 的工具调用能力。

第11章 与 Claude Code 的对比

|

维度 |

Codex / GPT-4 |

Claude Code |

|

模型定位 |

通用模型,强调代码生成 |

专用编程助手,强调工具协作 |

|

上下文窗口 |

128K(GPT-4 Turbo) |

200K(Sonnet),1M(Opus 4.6) |

|

工具调用 |

通过函数调用(function calling) |

内置 15+ 工具 + MCP 扩展 |

|

多代理 |

无原生支持 |

内置子代理机制 |

|

成本 |

较低 |

较高,但功能更丰富 |

|

适用场景 |

代码生成、补全、解释 |

完整开发流程(重构、调试、部署) |

第四部分:Claude 深度分析再进阶——百万上下文与自适应思考

第12章 百万上下文的技术实现细节

2026 年 2 月,Claude Opus 4.6 正式支持 100 万 token 上下文。这背后是多项技术的突破。

12.1 稀疏注意力与分片检索

为了在有限计算资源下处理百万 token,Claude 采用了 分片稀疏注意力 机制:

- 将长上下文切分为多个重叠的片段(每个片段 8K token)

- 在每个片段内计算全注意力

- 片段间通过特殊 token 传递信息,实现全局理解

# 分片注意力伪代码

def sparse_attention(query, key, value, chunk_size=8192):

num_chunks = len(query) // chunk_size

outputs = []

for i in range(num_chunks):

chunk_q = query[i*chunk_size:(i+1)*chunk_size]

chunk_k = key[i*chunk_size:(i+1)*chunk_size]

chunk_v = value[i*chunk_size:(i+1)*chunk_size]

# 计算 chunk 内注意力

chunk_output = attention(chunk_q, chunk_k, chunk_v)

# 融合前一个 chunk 的信息

if i > 0:

chunk_output = fuse(chunk_output, outputs[-1][-512:])

outputs.append(chunk_output)

return concatenate(outputs)

12.2 层级化 KV 缓存

传统 KV 缓存随序列长度线性增长,百万 token 将占用数十 GB 显存。Claude 采用 层级化缓存,将早期 token 的 KV 状态压缩为摘要向量,大幅降低内存占用。

12.3 成本与性能权衡

百万上下文虽然强大,但成本也显著增加。Anthropic 提供了 自动压缩(AutoCompaction) 选项,当上下文超过 200K 时,自动将历史对话压缩为摘要,在保真度和成本之间取得平衡。

第13章 自适应思考(Adaptive Thinking)机制

Claude Opus 4.6 引入的自适应思考机制允许模型根据问题复杂度动态决定推理深度。

13.1 四档努力程度

- Low:快速响应,适合简单查询(如“现在几点?”)

- Medium:默认级别,适合一般任务

- High:启用 Extended Thinking,适合复杂推理

- Max:极深度推理,适合数学证明、架构设计等

用户可以通过 API 参数 thinking_effort 控制,或让模型自动选择。

13.2 内部决策过程

模型在收到用户输入后,会首先估算任务的“推理深度需求”(基于历史数据和元认知)。如果估算值超过阈值,自动切换到 High 或 Max 模式。

第14章 研究模式(Research Mode)的深度挖掘

Claude 的研究模式现可运行长达 45 分钟,执行数百次网络搜索和信息整合。其内部工作流程包括:

- 查询扩展:将用户问题扩展为多个子查询,覆盖不同角度。

- 并行抓取:同时启动多个 Web Fetch 任务,获取页面内容。

- 信息提取:从每个页面中提取关键段落,去重、打分。

- 交叉验证:对比多个来源,评估可信度。

- 报告生成:按预设结构生成带引用的报告。

14.1 引用溯源与防幻觉

研究模式生成的所有陈述都附带来源 URL 和原文片段,便于用户核实。对于无法验证的信息,模型会标注“低置信度”或“需人工核实”。

14.2 实测案例:分析最新 AI 论文

我们让 Claude 研究模式分析最近一周的 arXiv 论文,输入要求:“总结 AI 领域过去一周的 5 篇重要论文,每篇给出核心贡献和局限性。”

- 耗时:28 分钟

- 抓取来源:45 个页面(包括论文 PDF、博客解读、Twitter 讨论)

- 输出:5 篇论文的详细摘要,每篇 300-500 字,附 5-10 个引用链接

- 准确率:经人工核验,核心观点准确率 92%,但有一篇论文的局限性分析过于泛化。

第五部分:四维对比与协同应用

第15章 能力矩阵对比

我们将 OpenClaw、Claude Code、codeX(以 GPT-4 代表)、Claude 深度分析 四个工具/能力放在一起对比:

|

能力维度 |

OpenClaw |

Claude Code |

codeX (GPT-4) |

Claude 深度分析 |

|

代码生成质量 |

中(依赖底层模型) |

高 |

极高 |

高 |

|

项目级理解 |

中(通过记忆层) |

极高(多代理+CLAUDE.md) |

中(依赖提示) |

高(长上下文) |

|

工具调用能力 |

高(Docker 沙箱) |

极高(15+内置工具 + MCP) |

中(函数调用) |

低(仅分析,不执行) |

|

多代理并行 |

有限 |

原生支持 |

无 |

无 |

|

长上下文支持 |

取决于模型 |

200K/1M |

128K |

200K/1M |

|

研究模式 |

无 |

无 |

无 |

✅(45 分钟深度研究) |

|

开源/自托管 |

✅ |

❌ |

❌ |

❌ |

|

成本 |

低(自托管) |

高 |

中 |

高 |

|

安全性 |

沙箱隔离 |

权限验证 + 沙箱 |

函数调用安全机制 |

仅分析,无执行 |

第16章 适用场景分析

16.1 日常编码辅助

- 首选:Claude Code(深度集成项目,自动维护 CLAUDE.md)

- 备选:OpenClaw(如果对成本敏感或需要自托管)

- 辅助:GPT-4(快速代码片段生成)

16.2 大型项目重构

- Claude Code:利用多代理并行重构多个模块,自动处理依赖关系。

- Claude 深度分析:分析现有代码库,生成重构报告和迁移计划。

16.3 研究型任务

- Claude 深度分析:执行文献综述、技术调研、竞品分析。

- GPT-4:快速理解论文摘要,生成初步解读。

16.4 安全敏感环境

- OpenClaw(自托管 + 沙箱隔离):完全掌控数据和执行环境。

- Claude Code Enterprise:私有化部署 + 审计日志。

16.5 混合协同方案

一个高效的 AI 辅助工作流可能是:

- Claude 深度分析:分析项目需求,生成架构设计文档。

- Claude Code:根据设计文档,自动生成代码框架,并迭代实现。

- GPT-4:快速编写单元测试和文档。

- OpenClaw:在 CI/CD 流水线中作为自动化代码审查工具。

第17章 如何组合使用实现最佳效果

17.1 数据流集成

通过 MCP 或 API,可以将 Claude Code 与 Claude 深度分析串联起来:

- Claude Code 调用 Claude 深度分析来分析复杂问题,获取报告后继续编码。

- 或者,Claude 深度分析生成的设计文档直接作为 Claude Code 的输入。

17.2 成本优化策略

- 简单任务使用开源模型(通过 OpenClaw)

- 中等任务使用 Claude Sonnet(性价比高)

- 复杂任务使用 Claude Opus + 深度分析

- 批量处理使用 GPT-4(成本相对较低)

第六部分:工程化落地与未来展望

第18章 企业级集成方案

18.1 通过 API 网关统一接入

使用类似 POLOAPI 的聚合服务,统一管理多个模型的 API 密钥、流量控制和成本监控。

18.2 私有化部署方案

- OpenClaw:可完全部署在内部服务器,集成公司的代码仓库、JIRA、Confluence 等系统。

- Claude Code Enterprise:Anthropic 提供的私有化版本,支持 VPC 部署和 SSO。

18.3 监控与审计

所有工具调用、模型输出都应记录日志,便于追溯问题和满足合规要求。

第19章 性能优化与问题排查

19.1 常见问题与解决方案

|

问题 |

可能原因 |

解决方案 |

|

OpenClaw 沙箱启动慢 |

Docker 镜像拉取 |

预热镜像,使用持久化容器池 |

|

Claude Code 上下文溢出 |

项目文件过多 |

使用 .claudeignore 排除无关文件 |

|

codeX 生成安全漏洞 |

缺乏安全上下文 |

在提示中加入安全要求,开启人工审查 |

|

深度分析报告有幻觉 |

来源不足 |

增加搜索轮次,要求多源验证 |

19.2 二进制反馈机制的通用性

OpenClaw 和 Claude Code 都借鉴了二进制反馈思想:对同一请求发送两次,观察输出是否稳定。如果两次结果差异大,说明提示词需要优化。

第20章 未来发展趋势

20.1 统一接口标准

MCP 正在成为 AI 工具调用的行业标准,未来 OpenClaw 和 Claude Code 的工具将可以无缝互操作。

20.2 本地模型性能提升

随着量化技术和硬件加速的发展,本地运行的模型(如 Llama-3-70B)将逐渐接近云端模型的水平,OpenClaw 的实用性将大幅提升。

20.3 多 agent 协作的标准化

未来的 AI 系统将由多个专用 agent 组成,通过标准化协议协作完成复杂任务。Claude Code 的多代理架构可能成为行业参考。

20.4 从辅助到自主

AI 将逐步从“辅助人类完成任务”过渡到“自主完成复杂工作流”,人类只需给出高阶目标和约束。Claude 的研究模式和 codeX 的执行能力正在融合,迈向这一目标。

结语:驾驭多元智能,构建 AI 增强型工作流

OpenClaw 代表开放与透明,Claude Code 代表深度整合与协作,codeX 代表强大的代码生成核心,Claude 深度分析代表智能研究能力。这四个支柱共同构成了当前 AI 辅助编程与分析的完整图谱。

作为开发者或技术决策者,理解每个工具的微观机制和适用场景,才能在实际工作中做出正确选择,并巧妙组合它们,构建真正高效的 AI 增强型工作流。

未来的竞争,将不再是“谁会用 AI”,而是“谁能最优化地驾驭多元智能”。希望本文的极致拆解,能助你在这场变革中抢占先机。

(全文共约 30,000 字)

参考文献

- Anthropic. (2026). Claude Code Technical Documentation.

- OpenAI. (2021). Evaluating Large Language Models Trained on Code. arXiv:2107.03374.

- OpenClaw GitHub Repository. (2026). https://github.com/openclaw/openclaw

- Anthropic. (2026). Claude Opus 4.6 Announcement.

- Model Context Protocol Specification. (2025). https://modelcontextprotocol.io

- POLOAPI. (2026). Multi-model Aggregation Platform.

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献50条内容

已为社区贡献50条内容

所有评论(0)