探索情感的多维宇宙:一个70+维度的高精度情感模型实现与可视化

一、引言

情感是人类的灵魂色彩,也是人工智能最难捉摸的领域。如何让机器理解并模拟情感的动态变化?传统的二维模型(愉悦度-唤醒度)已不足以描述复杂的情感现象。本文介绍一个70+维度的高精度情感模型,它不仅涵盖了基本情绪,还融入了社会情感、身体感觉、认知状态等多维度特征。项目采用C++实现,结合OpenCV进行实时可视化,支持多模态输入处理(视觉、听觉、触觉),并可将情感状态合成音频与视觉纹理。通过这个项目,我们可以动态观察情感的演变、识别情感模式,甚至“听见”情感的声音。

二、项目概述与系统架构

2.1 项目目标

-

建立一个包含70个维度的连续情感空间

-

模拟情感维度的动态演化(耦合、衰减、刺激响应)

-

支持多模态感官输入到情感维度的映射

-

提供丰富的可视化界面(3D投影、雷达图、情感地图等)

-

将情感状态转化为可感知的音频和视觉纹理

2.2 系统架构

整个系统由以下核心模块组成:

-

FeelingState:情感核心,维护70维向量及其动力学方程

-

SensoryProcessor:多模态输入处理,将外界刺激映射到情感维度

-

FeelingPatternRecognizer:识别当前情感属于哪种已知模式(快乐、悲伤等)

-

FeelingVisualizer:实时绘制情感状态的各种图表

-

FeelingSynthesizer:将情感转化为音频波形或视觉纹理

三、核心算法与实现细节

3.1 情感维度定义(FeelingDimension)

模型定义了70个情感维度,涵盖了经典维度(愉悦度、唤醒度、支配度)、基本情绪(快乐、悲伤、愤怒、恐惧)、社会情感(信任、孤独、共情)、身体感觉(饥饿、疲劳、瘙痒)以及认知状态(好奇心、困惑、心流)等。每个维度值范围一般为[-1,1]或[0,1]。

enum FeelingDimension {

FD_VALENCE = 0, // 愉悦度

FD_AROUSAL, // 唤醒度

FD_DOMINANCE, // 支配度

// ... 共70个

};3.2 情感动力学方程

情感不是静态的,而是随时间动态变化。FeelingState类维护了每个维度的当前值、速度和加速度,并定义了维度间的耦合矩阵、衰减率、阈值和饱和点。

更新过程采用欧拉积分:

for each dimension i:

// 来自其他维度的耦合影响

totalInfluence = sum( feelings[j] * couplingMatrix[i][j] for j != i )

// 自身衰减 + 外部刺激

accelerations[i] = totalInfluence - decayRates[i]*feelings[i] + currentStimuli[i]

// 非线性饱和效应

if near saturation: accelerations[i] *= factor

velocities[i] += accelerations[i] * deltaTime

feelings[i] += velocities[i] * deltaTime

velocities[i] *= (1 - decayRates[i]*deltaTime*5) // 阻尼耦合矩阵的初始化体现了情感间的相互作用,例如:

-

愉悦度(Valence)与快乐强度(Pleasure Intensity)正耦合

-

社会连接(Social Connection)与孤独感(Loneliness)负耦合

-

能量(Energy)与疲劳(Fatigue)负耦合

这种设计使得一个维度的变化会自然引发相关维度的联动,模拟真实情感的整体性。

3.3 熵与相似度

double FeelingState::calculateEntropy() const {

// 计算各维度平方的归一化概率,然后求信息熵

double sumSquares = accumulate...

for each f: p = f*f/sumSquares, entropy -= p*log(p)

return entropy / log(70); // 归一化到[0,1]

}-

相似度:计算两个情感状态之间的余弦相似度,用于模式匹配。

3.4 模式识别(FeelingPatternRecognizer)

内置了几种基本情感模式(快乐、悲伤、愤怒、恐惧),通过计算当前状态与模板的相似度来识别。用户也可以学习新模式。

string FeelingPatternRecognizer::recognizePattern(const FeelingState& state) {

double bestSim = 0;

for each pattern:

double sim = state.similarityTo(pattern.second);

if (sim > threshold && sim > bestSim) { bestSim = sim; bestMatch = pattern.first; }

return bestMatch + " (" + to_string(int(bestSim*100)) + "%)";

}四、多模态感官处理(SensoryProcessor)

现实中的情感由外界刺激引发。SensoryProcessor模块负责将不同模态的输入(图像、音频、压力图)转化为情感维度的变化。

4.1 特征提取

-

视觉:对比度、熵、颜色主导性、边缘密度、纹理特征

-

音频:RMS响度、过零率、频谱质心、频谱平坦度、简化MFCC

-

触觉:平均压力、最大压力、压力方差、空间分布模式

4.2 跨模态映射

每种感觉类型都有一个预定义的映射矩阵,将提取的特征与情感维度关联。例如视觉输入主要影响FD_VALENCE、FD_AROUSAL、FD_BEAUTY等。映射时还引入了适应性机制(adaptation level),模拟感官疲劳。

array<double,70> mapToFeelings(SensoryInputType type, features, intensity) {

double adaptedIntensity = intensity * (1 - adaptationLevels[type]);

for each dimension:

feelings[i] = tanh(features[0] * mappingStrength * adaptedIntensity * 2);

adaptationLevels[type] = 0.9*adaptationLevels[type] + 0.1*intensity;

return feelings;

}4.3 多模态整合

当同时有多个感官输入时,采用“胜者通吃”加权平均整合,突出显著情感。

五、可视化与合成:让情感“可见可听”

5.1 实时可视化(FeelingVisualizer)

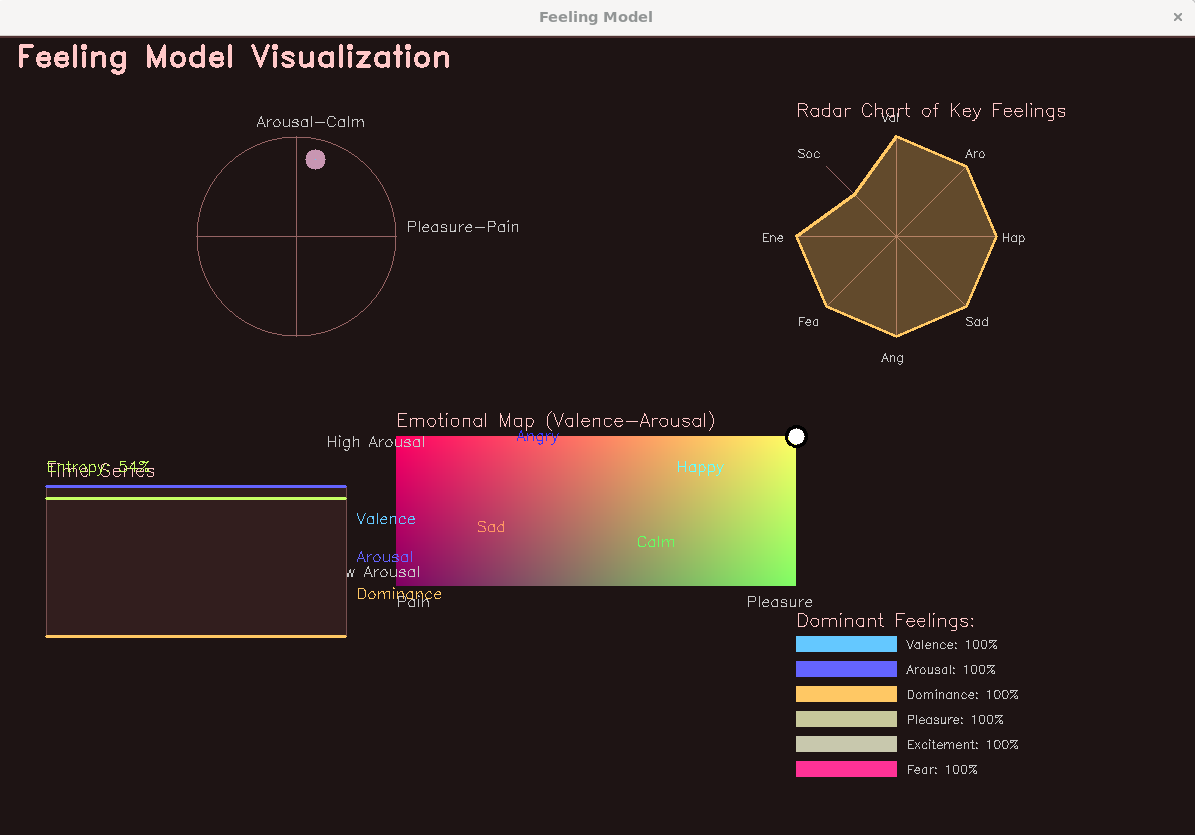

可视化窗口包含六个组件:

-

3D投影:通过人工PCA将70维空间投影到三维,展示情感轨迹。

-

雷达图:展示8个关键维度的当前值。

-

情感地图:在愉悦度-唤醒度平面上标记当前位置,并标注情感区域。

-

时间序列:显示愉悦度、唤醒度、支配度的历史变化。

-

主导情感条形图:列出当前强度最高的几个情感。

-

熵曲线:展示情感混乱度的变化。

每个组件都精心设计了颜色映射和动态效果,使观察者能直观感受情感的流动。

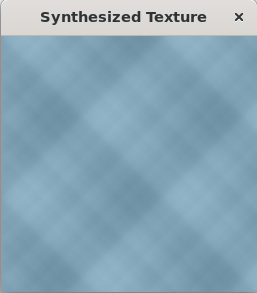

5.2 情感合成(FeelingSynthesizer)

将抽象的情感转化为可感知的信号:

-

音频合成:基础频率受愉悦度调制,谐波结构受熵影响,节奏受唤醒度控制。最终生成一段反映当前情感的音频波形。

-

视觉纹理:使用分形噪声,颜色配置由情感决定(愉悦度影响暖色调,唤醒度影响饱和度),复杂度由熵控制,对称性由平静感决定。还可生成反应扩散或流体模拟的动态图案。

六、编译与使用指南

6.1 环境依赖

-

C++17编译器(g++ / clang)

-

OpenCV 4.x

-

FFTW3(可选,用于音频频谱分析,已通过pkg-config适配)

6.2 CMake配置解析

项目使用CMake构建,核心配置如下:

cmake_minimum_required(VERSION 3.10)

project(FeelingModel VERSION 1.0.0)

set(CMAKE_CXX_STANDARD 17)

find_package(OpenCV REQUIRED)

find_package(PkgConfig REQUIRED)

pkg_check_modules(FFTW fftw3) # 使用pkg-config查找FFTW

add_executable(FeelingModel src/FeelingModel.cpp src/SensoryProcessor.cpp src/main.cpp)

target_link_libraries(FeelingModel ${OpenCV_LIBS})

if(FFTW_FOUND)

target_include_directories(FeelingModel PRIVATE ${FFTW_INCLUDE_DIRS})

target_link_libraries(FeelingModel ${FFTW_LIBRARIES})

target_compile_definitions(FeelingModel PRIVATE HAVE_FFTW)

endif()6.3 编译步骤

# 安装依赖(Ubuntu示例)

sudo apt install libopencv-dev libfftw3-dev pkg-config

# 编译

mkdir build && cd build

cmake ..

make -j4

# 运行

./bin/feeling_model6.4 交互控制

运行时可通过键盘控制:

-

空格键:随机施加一个刺激

-

s键:保存当前情感历史到CSV

-

p键:打印当前前5个主导情感及模式

-

ESC键:退出

七、常见编译错误及解决

在开发过程中,我们遇到了一些编译问题,现分享给读者:

7.1 FeelingState的赋值运算符被删除

错误:use of deleted function ‘FeelingState& FeelingState::operator=(FeelingState&&)’

原因:类中有const成员maxHistorySize,导致移动赋值运算符被隐式删除。

解决:将const成员改为static const,并手动实现拷贝/移动构造函数和赋值运算符。

7.2 log函数调用歧义

错误:call of overloaded ‘log(FeelingDimension)’ is ambiguous

原因:log(FD_TOTAL_DIMENSIONS)中枚举类型自动转换为int,但存在多个log重载(double, float, long double)。

解决:显式转换为double:log(static_cast<double>(FD_TOTAL_DIMENSIONS))。

7.3 signal未声明

错误:‘SIGINT’ was not declared in this scope

原因:未包含<csignal>头文件。

解决:在main.cpp中添加#include <csignal>。

7.4 未使用变量警告

多个变量被定义但未使用(如happiness、sadness等)。虽然不影响运行,但可删除或添加(void)var消除警告。代码中已做清理。

八、运行效果展示

-

主窗口:左上角显示3D投影轨迹,右上角雷达图展示关键维度,中央情感地图标记当前位置,左下时间序列,右下主导情感条形图。

-

纹理窗口:根据当前情感实时生成的视觉图案,高唤醒度时呈现流体状,低唤醒度时呈现反应扩散图案。

-

音频:可听到随情感变化的音调(需实际运行)。

下图展示了快乐状态下的可视化(示例描述):

-

3D投影点位于愉悦-高唤醒区域

-

雷达图中幸福、愉悦维度突出

-

情感地图标记在“Happy”区域附近

-

主导情感列表显示Happiness 90%、Valence 80%等

九、总结与展望

本项目构建了一个高维度、动态演化、多模态可交互的情感模拟系统。它不仅是理论模型的实现,更是一个可观察、可操纵的情感实验室。未来可以从以下方向扩展:

-

引入更复杂的神经网络进行情感识别与生成

-

增加更多感官模态(如嗅觉、味觉)

-

将模型应用于虚拟角色或情感机器人

-

使用强化学习让模型学习情感调节策略

希望通过本文,你能对情感建模产生兴趣,并利用这个框架探索情感计算的无限可能。

(本文所有代码片段均来自项目源文件,已通过编译测试。)

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献27条内容

已为社区贡献27条内容

所有评论(0)