【GitHub项目推荐--OpenRelay:打破AI配额壁垒的智能代理网关】⭐⭐⭐

|

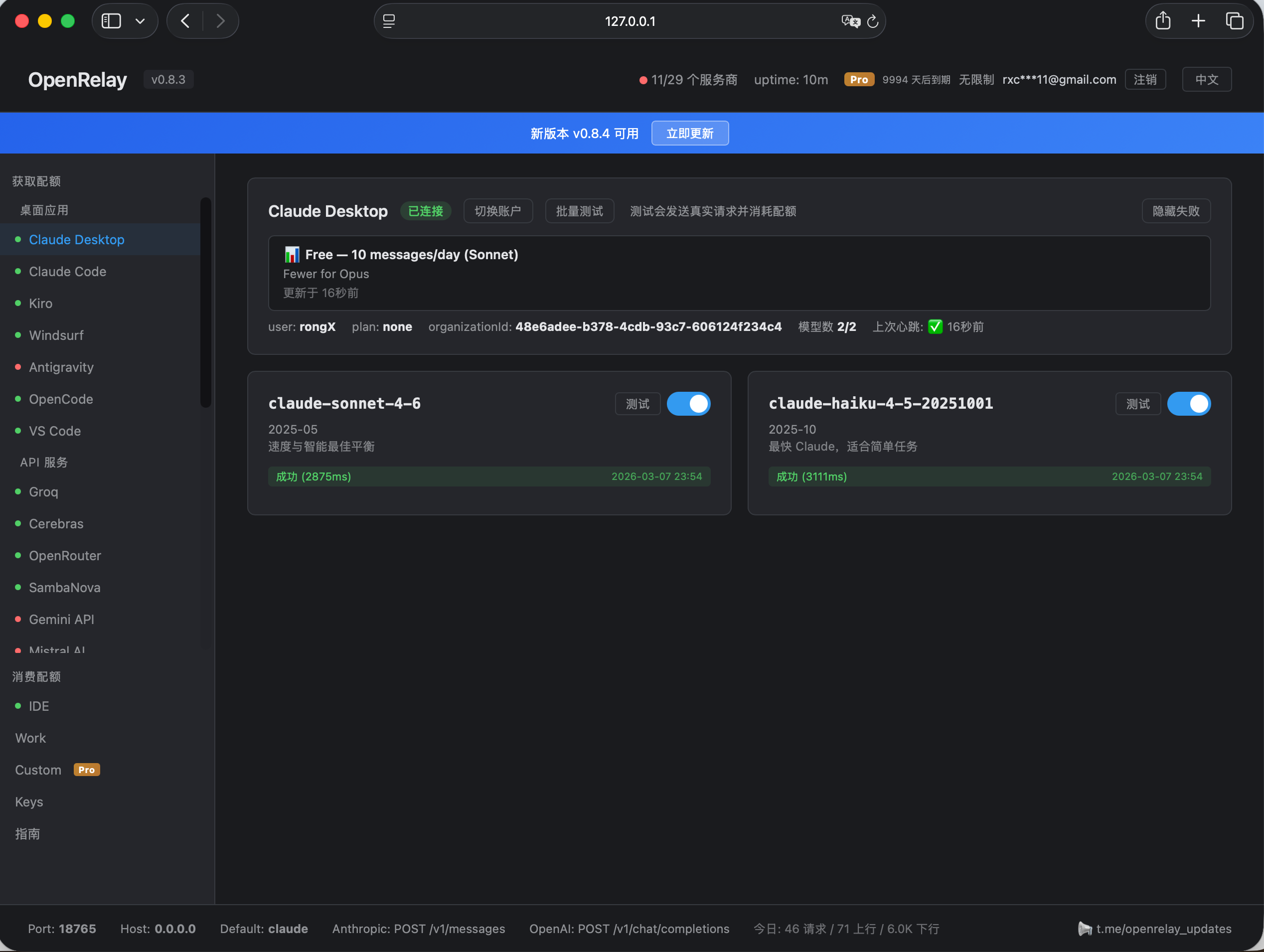

自动发现的 Provider 和配额状态 |

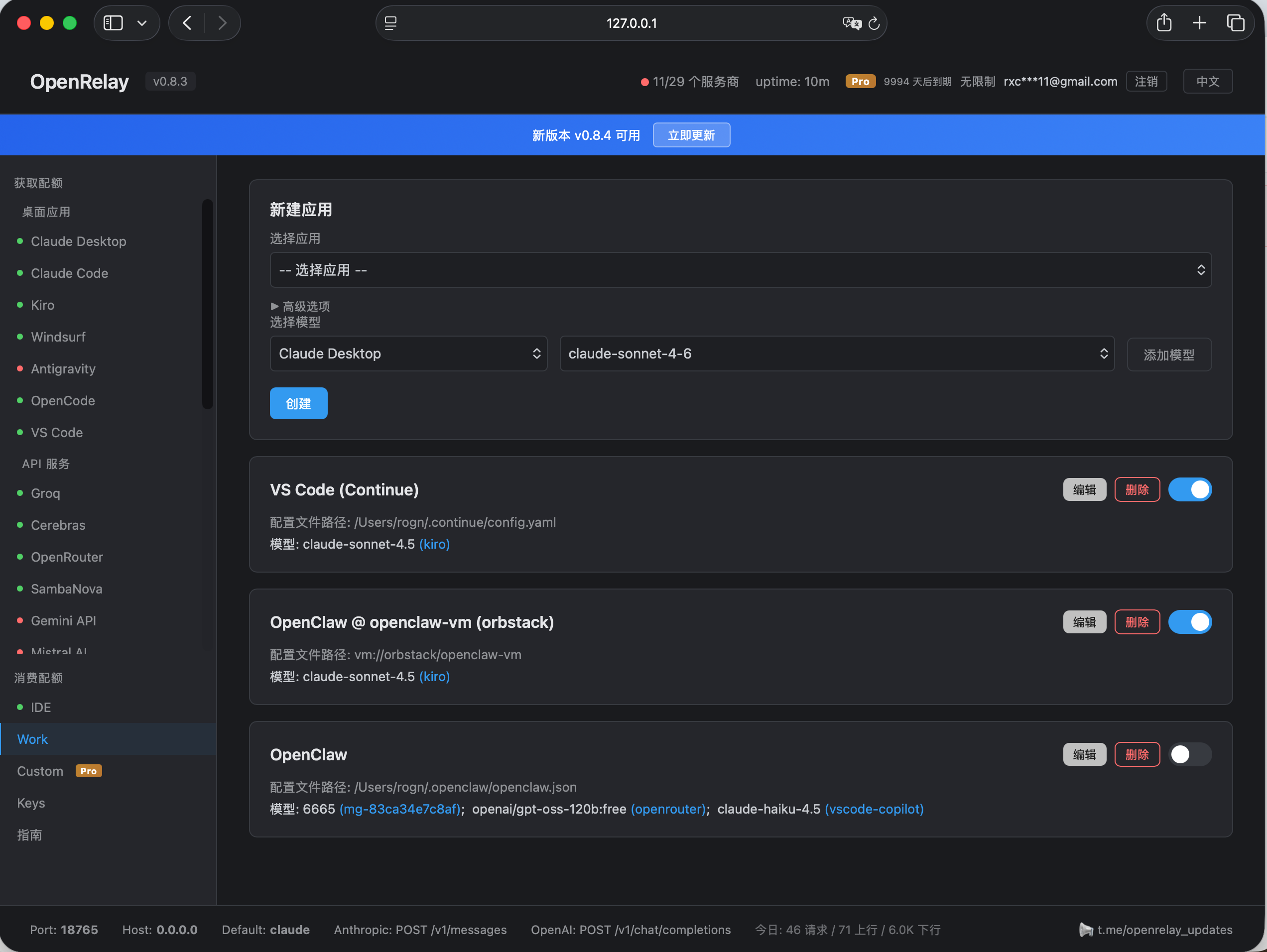

一键配置 Claude Code、OpenClaw、Aider... |

|

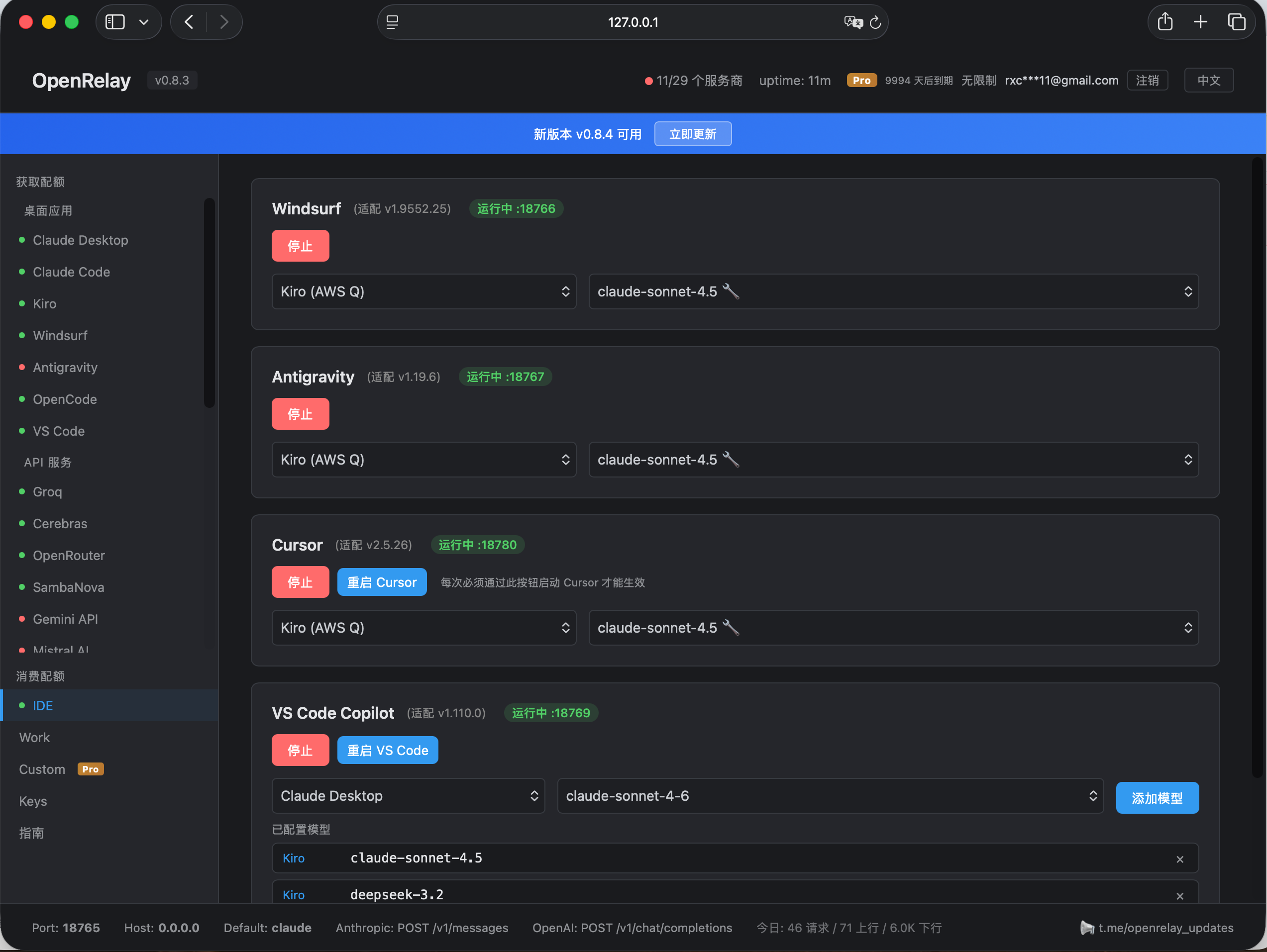

IDE 代理——Cursor、Windsurf、VS Code Copilot |

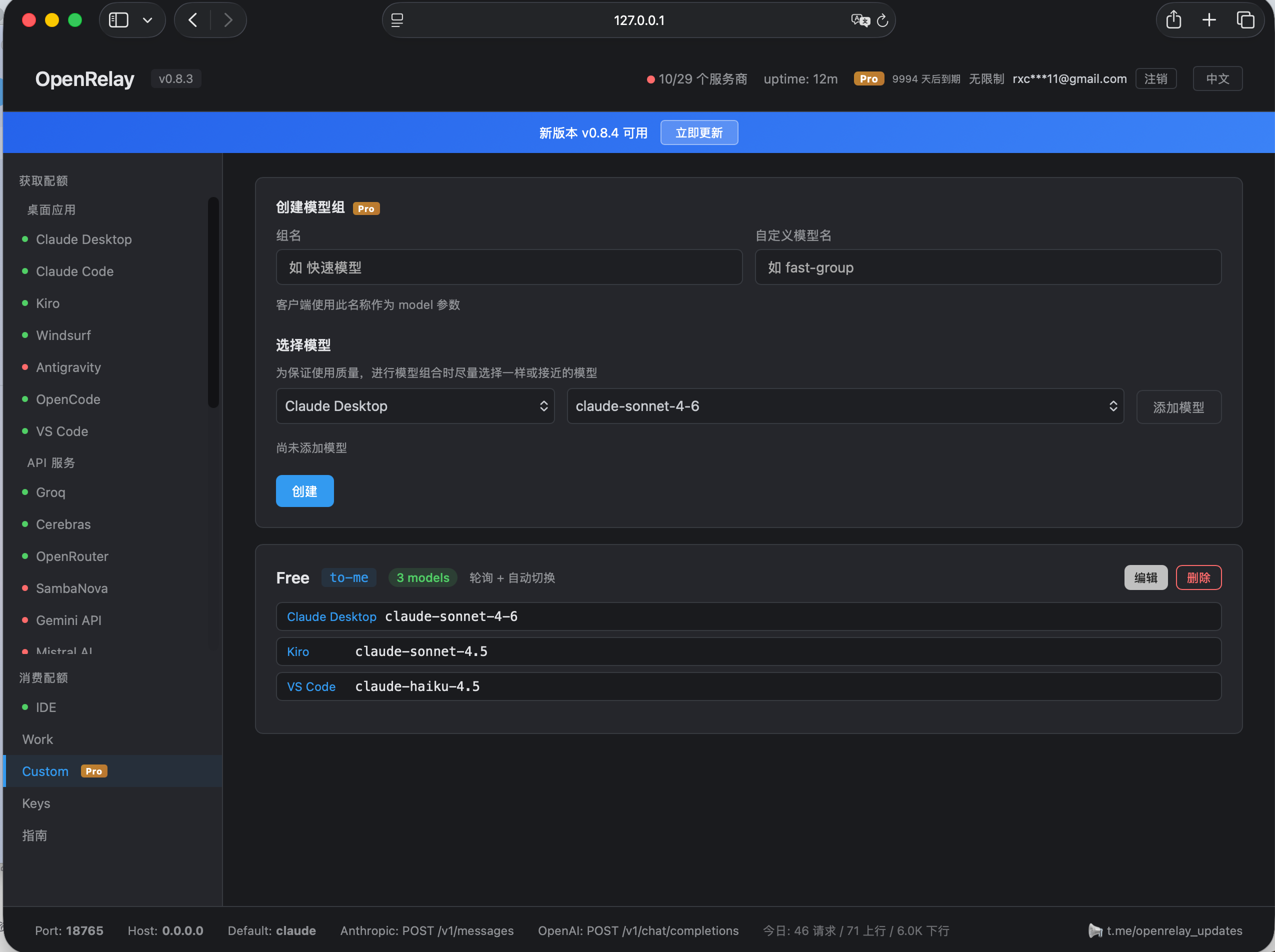

自定义模型组,自动故障转移 |

简介

OpenRelay 是由开发者 romgX 构建的一款开源 AI 代理工具,旨在解决当前 AI 生态中“订阅孤岛”的痛点。在当前的 AI 使用环境中,用户往往拥有多个来源的 AI 配额:Claude Pro 订阅绑定在 Claude Desktop、Kiro 提供免费额度、Groq 提供高速推理,以及各类 IDE 内置的 Copilot 额度。这些配额通常无法互通,导致资源浪费或工具中断。

OpenRelay 扮演了一个本地智能路由器的角色。它通过自动发现机制,扫描本地环境中的各类 AI 订阅(包括 IDE 内置配额、浏览器 Cookie、API Key),并将它们统一聚合为一个标准的 OpenAI/Anthropic 兼容 API 端点(http://localhost:18765)。用户只需将任意支持 OpenAI API 的工具指向该端点,即可自由调度所有被发现的配额,实现“一个工具用尽所有模型”的目标。

主要功能

-

自动发现与聚合:自动提取 Claude Desktop、Claude Code、Kiro、Windsurf、Antigravity、OpenCode、VS Code Copilot 等 32 个提供商(8 个 IDE 提供商 + 24 个直连 API 提供商)的配额,无需手动配置 API Key。

-

协议转换与代理:将不同提供商的原生协议(如 Claude 的 Message API、Gemini 的 REST API)统一转换为标准的 OpenAI Chat Completions API 格式,兼容绝大多数 AI 工具。

-

IDE 无缝接入:提供针对特定 IDE 的深度代理模式,包括 Cursor RPC 代理、Windsurf RPC 代理、VS Code Copilot BYOK 桥接,允许用户使用外部模型替换 IDE 内置的耗尽模型。

-

模型组与故障转移:支持创建虚拟模型组(如

fast-group),将 Groq、Cerebras、SambaNova 等多个后端组合,当一个后端配额耗尽或超时,自动切换到下一个,确保 AI 永不停机。 -

零数据泄露安全:所有凭据(Cookie、Token、Key)仅在本地内存处理,请求直连 AI 后端,不经过任何中转服务器,且不记录请求内容。

安装与配置

OpenRelay 提供预编译的单一二进制文件,支持 macOS (Intel/Apple Silicon)、Linux 和 Windows。

-

下载二进制:从 GitHub Releases 页面下载对应平台的

openrelay-{platform}文件。 -

赋予执行权限(Unix 系统):

chmod +x openrelay-macos-arm64 -

解除隔离(macOS 必需):由于二进制未签名,需移除隔离属性:

xattr -d com.apple.quarantine openrelay-macos-arm64 -

运行:执行

./openrelay-macos-arm64,服务将启动在http://localhost:18765。 -

访问面板:浏览器打开

http://localhost:18765,界面支持中英双语。首次启动后,工具会自动扫描并列出所有可用的提供商及其配额状态。

如何使用

1. 配置 CLI 工具(如 Aider, Claude Code)

对于命令行工具,只需修改环境变量,将请求指向 OpenRelay 的本地端点:

-

Anthropic 系工具(Claude Code, Aider):

export ANTHROPIC_BASE_URL=http://localhost:18765 export ANTHROPIC_API_KEY=unused # 此处填任意值即可 -

OpenAI 系工具:

export OPENAI_BASE_URL=http://localhost:18765 export OPENAI_API_KEY=unused

2. 使用 Web 面板一键配置

在 Web 面板的“工具配置”页面,选择对应的工具(如 Claude Code),点击“启用”开关,面板会直接显示需要复制的环境变量命令,执行后即可生效。

3. 路径路由

OpenRelay 支持通过 URL 路径指定提供商。例如,想让 Aider 专门使用 Kiro 的免费配额,只需设置:

export ANTHROPIC_BASE_URL=http://localhost:18765/kiro4. 使用模型组

在面板中创建模型组,添加多个后端(如 Groq + DeepSeek)。在工具配置中,将模型名称设置为自定义的组名(如 my-group),OpenRelay 会自动进行负载均衡和故障转移。

应用场景实例

实例 1:续命耗尽 IDE 配额

场景:开发者使用的 Cursor IDE 每月 500 次免费请求已用完,但手头有 Groq 的免费额度或 Claude Pro 订阅。

应用:启动 OpenRelay,在面板中开启 Cursor RPC 代理。OpenRelay 会劫持 Cursor 的 RPC 通信,将请求路由至 Groq 或 Claude。开发者无需修改 Cursor 配置,即可继续享受无限制的 AI 编程辅助,且响应速度可能更快。

实例 2:统一管理散落配额

场景:用户同时是 Kiro 用户(50 免费 credits)、Groq 用户(免费高速)、Gemini 用户(免费 100 万上下文)。平时需要在不同终端窗口切换不同的环境变量来使用不同工具。

应用:OpenRelay 启动后自动发现这三者。用户只需统一设置 OPENAI_BASE_URL=localhost:18765,然后在不同场景下通过面板切换默认提供商,或使用路径路由(如 /groq用于需要速度的代码生成,/gemini用于需要长上下文的分析)。

实例 3:构建高可用 AI 工作流

场景:自动化脚本依赖 LLM 进行决策,不能因为单一 API 的速率限制或故障而中断。

应用:在 OpenRelay 中创建名为 backup的模型组,优先级设置为:Groq (最快) -> DeepSeek (便宜) -> 本地 Ollama (兜底)。脚本始终请求 model=backup。当 Groq 免费额度超限返回 429 错误时,OpenRelay 会在 1 秒内自动重试 DeepSeek,保证脚本连续运行。

GitHub 地址

项目仓库:https://github.com/romgX/openrelay

许可证:框架部分(代理、格式转换)采用 MIT 许可证;高级功能(模型组、无限请求)需商业授权(Open Core 模式)。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献110条内容

已为社区贡献110条内容

所有评论(0)