vLLM-Kunlun:高性能、易开发、全生态兼容的国产芯适配

本文整理自 26 年 3 月 15 日 vLLM-Kunlun Meetup 北京站活动的同名主题演讲。

在公众号回复「vLLM-Kunlun」,可以获得此次 Meetup 上半场的 6 个演讲主题材料。

大家好,非常高兴能组织这次 meetup,来给大家介绍我们的 vLLM-Kunlun 项目。vLLM-Kunlun 从名字就能看出,是两个项目的结合,其核心目的是将百度自研的昆仑芯适配到 vLLM 这个主流的大模型推理框架上。

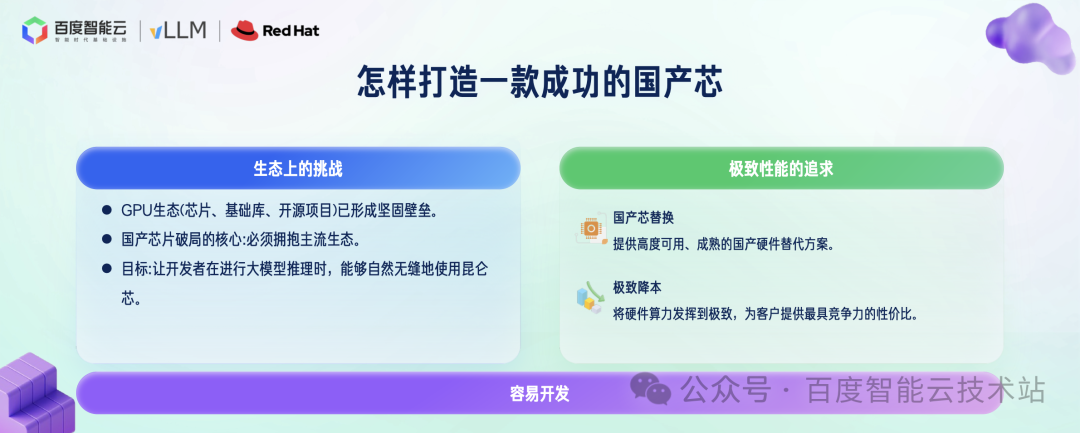

我们在开展昆仑芯首次适配工作时就在思考,一款国产芯片该如何实现商业化成功?

大家都知道,GPU 的生态体系庞大且成熟,不仅自身拥有性能优异的芯片和完善的基础库,众多开源项目也在无形中进一步巩固了它的行业地位。因此,在这样的行业背景下,国产芯片要想实现突破、站稳脚跟,就必须主动拥抱现有生态,而非另起炉灶打造新生态。这也是我们决定直接适配 vLLM 的核心动因,希望大家在进行大模型推理开发时,能够自然、便捷地使用昆仑芯。

解决了国产芯片的可运行问题后,又该用什么驱动力让大家选择这款芯片呢?在当下的市场环境中,核心驱动力有两个,一是国产芯片替代需求,二是降本需求。通过充分释放芯片的算力潜能,让客户和使用者能切实享受到超高的性价比。

目前,大模型技术仍在飞速发展,新模型、新的推理技术不断涌现,这也是 vLLM-Kunlun 项目持续迭代的原因。我们将项目开源至社区,也是希望能汇聚更多开发者共同完善这个框架,让它支持更多模型和推理技术,唯有如此,才能真正建立起国产芯片的行业生命力。

vLLM-Kunlun 项目地址:https://github.com/baidu/vLLM-Kunlun

这便是我们打造 vLLM-Kunlun Plugin 的核心驱动力:依托 vLLM 的生态体系,完成昆仑芯的深度适配,实现极致的性价比,同时让框架的开发与扩展更加便捷。这是我们当前整个项目的架构图。

接下来我将从三个方面,详细介绍我们的工作内容与成果。

首先是生态适配。为了做好 vLLM 的适配工作,早在 2024 年,我们就直接将 vLLM 部署到昆仑芯的运行环境中,逐一攻克各类兼容性问题。后续 vLLM 推出了 Device Plugin 抽象机制,这无疑为国产芯片的适配工作带来了极大便利。借助 Python EntryPoint 机制,结合 vLLM 引擎本身的抽象设计,我们仅需针对芯片的不同特性完成对应模块开发,就能实现芯片的适配,不仅大幅降低了调试难度,也显著减少了生态适配的工作量。在这一机制的支撑下,结合一系列专属优化处理,我们累计完成了:

-

50 + 主流大语言模型的推理适配,包括当下主流的 Qwen 系列、GLM 系列、Kimi 系列、Deepseek 系列等;

-

上层软件的原生兼容,包括后续会介绍的 playground、veRL 等强化学习框架。

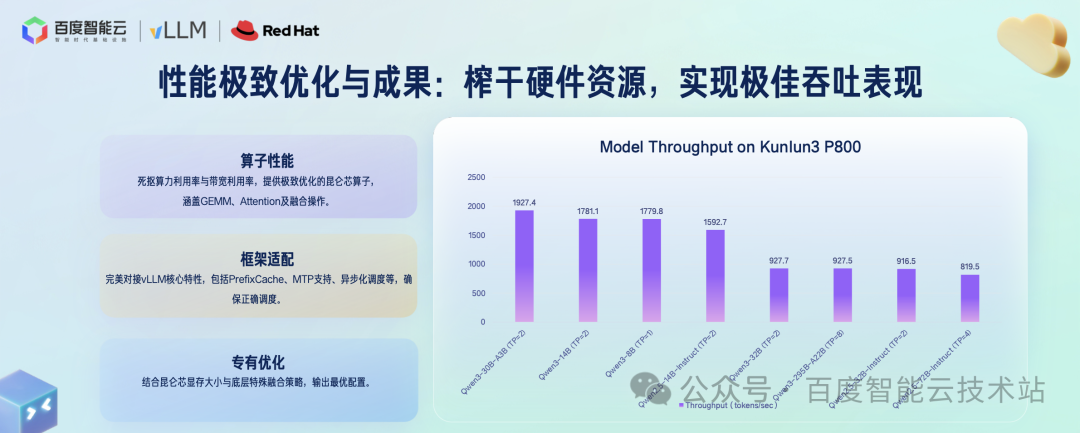

第二个是实现极致性价比,我们投入了大量精力对 vLLM-Kunlun 项目的性能进行优化。性能优化主要围绕以下三个方面展开:

-

算子性能优化,这是提升整体性能的基础。GPU 领域已有诸多成熟项目,将通用矩阵乘法(GEMM)、注意力机制(Attention)、算子融合等操作的性能发挥到了极致。因此在 vLLM-Kunlun 项目中,我们也为大家提供了经过极致优化的昆仑芯专属算子。我们会精细打磨每个算子的算力利用率和带宽利用率,充分挖掘芯片的硬件资源潜力,开发者可直接调用这些优化后的算子。

-

框架功能适配,确保各类功能的完整性。为了充分释放芯片性能,框架层面开发了前缀缓存(prefix cache)、多令牌预测(MTP)支持、异步化调度等大量功能,我们对每一项功能都完成了完善适配,确保 vLLM 框架能精准调用对应算子、执行正确的业务逻辑。

-

硬件专属优化,结合昆仑芯的硬件特性,比如显存规格、底层算子的特殊融合策略等,调优出最优的运行配置和策略。

在这三方面优化的加持下,我们的方案在绝大多数模型的推理场景中,都展现出了优异的性能表现。

第三个方面,为了降低昆仑芯的开发门槛,我们还从易开发的角度,打造了一系列功能与工具链:

-

完善的算子开发工具链。新模型的落地往往伴随新算子的需求,我们提供了原生 API、Triton 等多种开发方式,同时配套了从编译、调试到性能分析(Profile)的全流程工具链,使用方式与行业主流标准基本兼容。

-

极简的项目抽象设计。我们认为,一款优秀的多芯片适配项目,对原有框架的扩充应尽可能下沉至底层。因此无论是基础库还是扩展的算子库,我们都在算子层完成兼容适配;同时借助 vLLM 的 OOT 机制,注册了大量自定义算子,这些算子的调用方式与上层框架原生兼容;而在模型运行器(model runner)、工作节点(worker)等上层模块,则尽可能减少修改,甚至做到无修改。

-

AI 辅助开发。人工智能技术为开发工作带来了极大便利,为了进一步降低大家理解和开发项目的难度,目前我们正持续沉淀大量 AI 开发技能包,进一步降低整体开发成本。

总而言之,我们从多个维度降低 vLLM-Kunlun 项目的开发难度,希望能让更多开发者参与到项目的共建中来。

以上就是我们对 vLLM-Kunlun 项目的整体思考。依托 vLLM 框架的强大抽象能力,结合我们对昆仑芯软件层的持续完善,为大家提供一款优质的国产芯片选择,让大家的 Token 推理成本能够持续降低。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献2条内容

已为社区贡献2条内容

所有评论(0)