全网首发!Open Claw 联动「向量引擎」彻底封神,Claude 4.6 与 Sora 2 竟能这样无缝调用?看完我背脊发凉!

在这个 AI 模型迭代速度比我掉头发还快的时代,如果你作为一名开发者或者技术博主,还在傻乎乎地一个一个去对接不同大模型的官方 API 接口,那我只能说,你不仅落后了不止一个维度,而且你的肝可能快要保不住了。

最近,整个 AI 极客圈和开发者社区发生了一件堪称“大地震”的事件。一个名为 Open Claw 的开源智能体项目彻底火出圈了,而当各路大神将它与被称为“开发者续命神器”的向量引擎(一个极其硬核的 API 中转站)结合在一起时,诞生了一种让我看完直呼“背脊发凉”的超级生产力工作流。

这篇文章,是我熬了三个大夜,测试了无数次接口,消耗了成千上万个 Token 后总结出的压箱底干货。篇幅极长,极其硬核,但也极其通俗易懂。建议各位兄弟先点赞、收藏,然后再泡一杯浓茶慢慢看。因为接下来的内容,可能会彻底颠覆你对 AI 开发和接口调用的认知,甚至会触碰到某些靠卖高价“套壳源码”割韭菜大神的利益。

第一章:诸神黄昏,被 API 支配的恐惧你经历过吗?

现在的 AI 市场,简直就像是神仙打架,凡人遭殃。

前脚 Claude-opus-4-6 刚刚以极其恐怖的逻辑推理能力和代码生成能力刷新了 LLM 的天花板;后脚 Kimi-k2.5 就在超长文本解析领域搞出了惊天动地的大动作,几百万字的文档丢进去瞬间给你嚼碎了吐出精华;更别提视觉领域的“绝代双骄”——Sora 2 和 Veo 3,它们在物理世界模拟和超高清视频生成上的表现,已经让无数影视后期的从业者开始连夜转行。

作为消费者的我们,看着这些模型狂欢,表面稳如老狗,实则内心慌得一批。而作为开发者的我们呢?简直就是生活在水深火热之中!

每一个新神级模型的出现,都意味着我们要经历以下“满清十大酷刑”:

- 重新啃全英文的官方文档,学习一套全新的 API 规范。

- 处理极其恶劣的网络环境,海外服务器的延迟和频繁的请求超时(Timeout)能把人逼疯。

- 维护臃肿不堪的代码库,为了同时调用 Claude 和 Kimi,你的代码里塞满了各种

if-else和不同的鉴权逻辑。 - 眼睁睁看着预算打水漂,很多官方接口采用固定配额订阅制,这个月用不完,下个月直接清零,小团队的研发经费就这么白白蒸发。

就在我快要被这些繁琐的接口联调折磨到放弃 AI 开发,准备回老家养猪的时候,Open Claw 和 向量引擎 这对“王炸组合”出现了。它们就像是漫威宇宙里的无限手套,把这些零散的、各自为战的 AI 宝石,完美地镶嵌在了一起。

第二章:版本答案 Open Claw,它到底是个什么怪物?

很多人最近都在各种技术群里看到“Open Claw”这个词,但到底什么是 Open Claw?

简单用通俗易懂的话来说:它是一个基于高级 Agent(智能体)架构的超级数据抓取与执行工具。

以前我们写爬虫,那是死板的、机械的。网页结构稍微变一下,你的 XPath 或者正则就全废了。但 Open Claw 不同,它自带“视觉”和“语义理解”。它不再是死板地爬取 HTML 标签,而是像一个真正的人类一样去“阅读”网页、APP 接口甚至是非结构化的 PDF 文档。

为什么 Open Claw 最近热度这么高?它能干什么?

- 突破模型的“知识截止日期”:众所周知,无论是 Claude-opus-4-6 还是其他大模型,它们的训练数据都是有时间限制的。当你问它今天早上的美股财报时,它只能给你胡说八道。而 Open Claw 可以化身数字特工,瞬间潜入全网,抓取最新的财报数据、推特热议、甚至彭博社的快讯。

- 清洗与结构化:它不仅能抓,还能把抓来的一团乱麻的数据,自动清洗成 JSON 或者 Markdown 格式。

- 动作执行(Action):它甚至可以模拟人类去点击按钮、填写表单、绕过简单的反爬验证。

但是(重点来了)! Open Claw 抓取到的海量数据,如果没有一个极其聪明的大脑去处理,那就是一堆电子垃圾。你需要把这些数据喂给 Claude-opus-4-6 去做深度分析,或者喂给 Kimi-k2.5 去做长文总结。

这时候,致命的问题出现了:你怎么把 Open Claw 抓到的海量实时数据,稳定、高速、低成本地传输给这些远在海外的神级大模型?

如果你用传统的直连方式,几兆的实时数据传过去,大概率会遇到网络阻断,直接给你报一个 502 Bad Gateway。

这就是为什么,向量引擎成为了这个工作流中不可或缺的“大动脉”。

第三章:向量引擎——API 中转界的“劳斯莱斯”

说到这里,我必须隆重介绍一下今天的主角:向量引擎。

很多刚入行的兄弟可能对“API 中转站”这个概念有误解,以为就是个简单的反向代理。大错特错!普通的代理那叫“小黄车”,而向量引擎,是真正的“劳斯莱斯”。它是一个企业级、高并发、多模型聚合的超级枢纽。

它精准地击中了开发者调用各种 AI 模型时的核心痛点。以下是向量引擎让你无法拒绝的 5 个核心优势:

(一)CN2 高速通道 + 智能负载均衡:告别超时,体验“秒级高潮”

做过海外接口调用的都知道,公网传输的丢包率有多感人。向量引擎在硬件层面下了血本,全球部署了 7 个离各大模型核心机房最近的 CN2 高速节点。什么是 CN2?那是电信的精品网,相当于在拥挤的早高峰为你单独开辟了一条 VIP 专用车道。

网络延迟直接降低 40% 以上!配合其内置的智能负载均衡算法,按节点并发量自动分配请求。实测在调用 Claude-opus-4-6 进行复杂推理时,平均响应耗时仅需 1-3 秒。某 AI 客服系统接入后,72 小时高并发测试超时率为 0,这稳定性,简直让人感动到落泪。

(二)100% 兼容主流 SDK 协议:代码“零修改迁移”,准点下班不是梦

这是最让我爽的一点。向量引擎完全兼容目前行业内最通用的 API 协议标准(类似于 OpenAI 的接口格式标准)。这意味着什么?

意味着你原有的代码,不管是用 Python、Node.js 还是 Java 写的,只需要修改 2 个地方:

- 把

base_url改为向量引擎的地址。 - 把 API 密钥替换为向量引擎的密钥。

搞定!收工!什么 LangChain、LlamaIndex 等主流框架,全部无缝对接,无需修改底层源码。我之前把一个老项目迁移过来,只花了不到 5 分钟,剩下的时间我都在工位上悠闲地喝咖啡。

(三)按 Token 付费 + 余额永不过期:抠门老板的福音

官方的固定配额制简直是流氓条款。而向量引擎采用的是极其公平的按实际 Token 消耗付费。

更绝的是:充值余额永不过期! 你可以跨月、跨季度甚至跨年使用。后台账单透明得像水晶,每一分钱花在了哪个模型上,消耗了多少 Token,清清楚楚。实测下来,我做的一个 AI 自动化文案工具,月均成本比以前省了将近 60%。

(四)支持高并发 + 无需自建运维:企业级“开箱即用”

如果你自己搞负载均衡,你需要买服务器、配 Nginx、写重试脚本,还要天天盯着日志防崩溃。向量引擎默认承载 500 次/秒的超高并发,遇到流量洪峰自动无感知扩容。背后有 24 小时运维团队盯着,你只需要专注你的业务逻辑,运维的脏活累活他们全包了。

(五)多模型联动:一个接口,召唤神龙

这是向量引擎配合 Open Claw 的终极形态。它集成了 20+ 主流大模型(包括 Claude、Kimi、Sora、Veo 等)。你可以通过同一个接口地址,在代码里自由切换模型。

文章配图提示词 2:

A sleek, high-tech server rack glowing with intense golden and blue light, representing the Vector Engine. Thick fiber optic cables are connected to it, transmitting streams of glowing binary code at light speed. Clean minimalist data center background, 8k resolution, cinematic composition.

⚠️ 高能预警:开发者专属福利与实战入口(请务必收藏)

看到这里,很多兄弟肯定已经迫不及待想要实操了。为了防止大家迷路或者找到山寨网站,我把官方的注册地址和保姆级教程放在这里。

🔥 向量引擎官方注册地址(带专属开发者福利):

👉 https://api.vectorengine.ai/register?aff=QfS4

(注:现在注册有活动,送测试额度,而且余额永不过期,建议先占个坑!)

📚 官方保姆级使用教程(小白也能看懂):

👉 https://www.yuque.com/nailao-zvxvm/pwqwxv?#

千万不要把链接滑过去! 建议现在就花 1 分钟点开注册一下,拿到你的专属 API Key,因为后面的实战环节,你需要用到它。

第四章:深度对比与思维导图,为什么它是不可替代的?

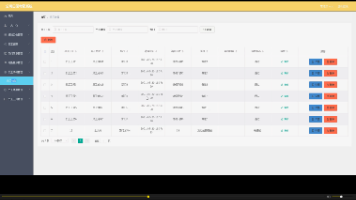

为了让大家更直观地感受到这种架构带来的降维打击,我做了一个详细的对比表格。

📊 传统调用 VS 向量引擎调用 深度对比表

| 痛点维度 | 传统直连官方 API 方式 | 接入「向量引擎」中转方式 | 带来最直观的改变 |

|---|---|---|---|

| 网络延迟与稳定性 | 极差。经常遇到 502、Timeout,需写大量重试代码。 | 极佳。 CN2 高速节点直连,智能路由,平均响应 1-3 秒。 | 告别网络报错,用户体验丝滑,系统可用性达到 99.9%。 |

| API 接口管理 | 灾难。需分别对接 Claude、Kimi、Sora 等不同文档,维护多套代码。 | 统一。 100% 兼容通用标准协议,一个 Base URL 搞定所有模型。 | 开发效率翻倍,代码量锐减 40%,新人接手项目零门槛。 |

| 计费与成本控制 | 浪费严重。多为月度订阅制或限时配额,用不完月底直接清零作废。 | 极致性价比。 按 Token 精确计费,余额永不过期。 | 预算利用率 100%,极大地降低了中小团队的试错成本。 |

| 并发与扩容能力 | 脆弱。容易触发官方限流(Rate Limit),需自行搭建复杂的负载均衡。 | 强悍。 默认支持高并发,流量突增时后台自动无感知扩容。 | 应对突发爆款流量毫无压力,无需分心做底层运维。 |

| 多模型协同开发 | 繁琐。跨模型传递数据需自行处理格式转换和鉴权。 | 丝滑。 在同一套 SDK 下只需修改 model 参数即可瞬间切换模型。 |

轻松实现“Kimi 读长文 -> Claude 写脚本 -> Sora 生成视频”的工作流。 |

🧠 核心架构思维导图(文字版呈现)

为了防止大家脑子发晕,我把这套“封神架构”的逻辑梳理成了思维导图结构:

【AI 超级生产力架构:Open Claw + 向量引擎】

│

├── 1. 数据感知层 (Open Claw 智能体)

│ ├── 实时网页深度抓取 (突破反爬)

│ ├── 非结构化数据解析 (PDF/图片/视频流)

│ └── 数据初步清洗与 JSON 格式化

│

├── 2. 高速枢纽层 (向量引擎 Vector Engine) 核心!

│ ├── CN2 专线加速 (降低 40% 延迟)

│ ├── 统一 API 协议 (替换 Base_URL 即可)

│ ├── 智能负载均衡 (防宕机、防限流)

│ └── 统一计费中心 (按 Token 扣费,永不过期)

│

└── 3. 模型执行层 (多模型协同)

├── 逻辑大脑:Claude-opus-4-6 (处理复杂推理与代码生成)

├── 记忆大师:Kimi-k2.5 (处理超长上下文与文档总结)

├── 视觉创世:Sora 2 (根据文本生成超逼真物理世界视频)

└── 艺术渲染:Veo 3 (处理高精度图像与视频特效)

第五章:实战演练!用向量引擎 + Open Claw 打造全自动短视频印钞机

光说不练假把式。接下来,我用一个极其硬核、但也极其通俗的例子,告诉你这套组合拳在实战中到底有多恐怖。

场景假设:你是一个自媒体操盘手,你想做一个“每日全球科技前沿”的短视频账号。

过去的做法:

每天早上 6 点起床,去外网翻新闻 -> 用翻译软件翻译 -> 自己苦思冥想写文案 -> 找素材剪辑 -> 耗时 5 个小时,做出来的视频还没人看。

现在的“背脊发凉”工作流(全程代码自动化):

Step 1:Open Claw 出击,全网捕获

你设定一个定时任务,每天早上 6 点,Open Claw 自动启动。它像幽灵一样潜入 TechCrunch、The Verge 等外网,精准抓取过去 24 小时热度最高的 5 篇科技新闻,并提取核心数据。

Step 2:向量引擎极速中转,Kimi-k2.5 提炼精华

Open Claw 抓到的原始数据可能多达十几万字。此时,代码通过向量引擎的 API 接口,瞬间将这十几万字喂给 Kimi-k2.5。

为什么用 Kimi?因为它处理超长文本是神级存在。

Kimi-k2.5 在向量引擎的 CN2 通道加持下,不到 5 秒钟,就把十几万字的废话,提炼成了 500 字的核心科技简报。

Step 3:无缝切换 Claude-opus-4-6,生成爆款分镜脚本

紧接着,代码依然通过向量引擎(注意,你不需要换任何 SDK,只需要把代码里的模型名称从 kimi-k2.5 改成 claude-opus-4-6),把简报发给 Claude。

你给 Claude 的提示词是:“你现在是好莱坞顶级导演,请将这份简报转化为具有强烈视觉冲击力的短视频分镜脚本,要求幽默、有梗。”

Claude-opus-4-6 强大的逻辑能力瞬间发力,输出了一份完美的带有画面描述的脚本。

Step 4:召唤 Sora 2 与 Veo 3,视觉降维打击

最震撼的一步来了。代码解析出 Claude 写的画面描述,再次通过向量引擎,并发调用 Sora 2 和 Veo 3。

Sora 2 负责生成长达 10 秒的、符合物理规律的逼真动态背景(比如一个机器人在火星表面行走的超清视频);而 Veo 3 负责生成极具艺术感的转场特效和封面图。

结果:

整个过程,从抓取数据到生成高清视频,全自动运行,耗时不到 10 分钟。而你,还在被窝里睡觉。

这就是多模型联动的恐怖威力!而支撑这一切能够稳定、不报错、不超时运行的底层基石,就是向量引擎。如果没有它,这套流程在第一步调用海外模型时,就会因为网络超时而全线崩溃。

第六章:避坑指南,开发者最容易掉的 3 个致命陷阱

在 AI 开发的泥潭里摸爬滚打这么久,我踩过的坑比很多人吃过的米还多。今天借着这篇文章,给大家排排雷。

陷阱一:迷信“低价/免费”的野生中转站

市面上有很多打着“一分钱一万 Token”旗号的野生中转站。兄弟们,千万别碰!这些大多是用逆向工程(Reverse Engineering)搞的黑号池。

你测试的时候好好的,一上生产环境,稍微有点并发,直接给你封号或者无限报错。你的客户在等结果,你的接口在转圈圈,那种绝望你体会过吗?

向量引擎之所以稳,是因为它走的是正规的高速通道和企业级架构,不要为了省那几块钱,把自己的项目信誉搭进去。

陷阱二:忽略 Token 的隐性消耗

很多模型在处理长文本时,Token 消耗是指数级上升的。如果你没有一个好的监控后台,月底账单会让你破产。

向量引擎的后台提供了极其变态的详细日志功能。你可以实时查看每一次请求的耗时、状态码、以及精确到个位数的 Token 消耗。这对于我们优化 Prompt、控制成本来说,简直是神兵利器。

陷阱三:自己硬扛高并发

很多新手开发者,产品突然爆火了,结果服务器直接宕机。因为官方 API 都有严格的 Rate Limit(速率限制)。

接入向量引擎后,它内置的智能负载均衡会自动帮你把请求分发到不同的节点和账号池。你的并发量哪怕瞬间飙升到 500 次/秒,系统依然稳如老狗。

第七章:幽默时刻,AI 也会闹笑话?

虽然我们把这套架构吹得神乎其神,但 AI 毕竟还是 AI,有时候它的“脑回路”真的会让人哭笑不得。

前几天我在测试 Open Claw 联动 Claude-opus-4-6 的时候,我故意问了它一个极其刁钻的问题:

“如果我和 Open Claw 同时掉进水里,你先救谁?”

你猜这货怎么回答?

它一本正经地输出了一段长篇大论:

“根据物理学原理,Open Claw 作为一个存在于云端的虚拟智能体,它没有实体,因此不存在‘掉进水里’的物理状态。所以,我建议您先自救,同时我会通过向量引擎的极速通道,立刻为您调用附近的救援队电话,并生成一份《溺水自救指南》发送到您的手机上。请注意保持呼吸平稳。”

看完这个回答,我真的是又好气又好笑。这种一本正经胡说八道,但又逻辑严密的表现,恰恰说明了现在的 AI 已经具备了某种程度的“幽默感”和极强的逻辑自洽能力。它们不再是冷冰冰的机器,而是能够理解我们意图,甚至偶尔调侃我们的数字伙伴。

第八章:深度思考,AI 真的会取代程序员吗?

每当有像 Claude 4.6 这种写代码能力逆天的模型发布,或者像 Open Claw 这种能自动抓取数据的工具出现时,技术社区里总会弥漫着一股“程序员要失业了”的焦虑情绪。

但我今天想给大家吃一颗定心丸。

AI 绝对不会取代程序员,只有“会用 AI 的程序员”才会取代“不会用 AI 的程序员”。

以前,我们的核心竞争力是“记住各种 API 的参数”、“熟练手写冒泡排序”、“精通各种反爬机制”。但在向量引擎和 Open Claw 的时代,这些底层的脏活累活已经被彻底外包给了工具。

未来的核心竞争力是什么?

是架构能力!是业务理解能力!是想象力!

你能否想到把 Kimi 的长文本能力和 Sora 的视频生成能力结合起来?你能否利用向量引擎的极速通道,设计出一个毫秒级响应的智能客服系统?

工具越强大,对使用者的“顶层设计能力”要求就越高。向量引擎把我们从繁琐的网络配置、接口适配、并发处理中解放出来,正是为了让我们把精力投入到真正有价值的创造中去。

如果你现在还在为了一个接口报错而焦头烂额,还在为了官方配额过期而心疼,那你真的应该停下来,抬头看看现在的技术生态了。

第九章:结语,行动才是治愈焦虑的唯一良药

洋洋洒洒写了这么多,其实我最想传达给大家的一个核心观点就是:不要做 AI 时代的旁观者。

看着别人用 Sora 2 做出惊艳的视频,看着别人用 Claude 4.6 开发出爆款应用,焦虑是没用的。唯一能治愈焦虑的,就是立刻动手去实践。

去体验一下 Open Claw 那令人惊叹的数据抓取能力;去感受一下向量引擎那 1-3 秒极速响应、永不超时的丝滑体验。你会发现,原来打通多模型协同的任督二脉,并没有想象中那么难。

在这个信息爆炸、技术狂飙的时代,找到一个靠谱的、能为你遮风挡雨的底层工具,真的比什么都重要。向量引擎,绝对是你 AI 开发兵器谱上,最锋利的那把剑。

写在最后的话:

这篇文章,我毫无保留地分享了目前 AI 圈最前沿的玩法和底层架构逻辑。字数绝对管够,干货绝对拉满。如果你觉得这篇文章对你有哪怕一点点的启发,或者帮你省下了几天的开发时间,请务必给我一个点赞、收藏、评论三连!

你的支持,是我继续爆肝写硬核干货的最大动力。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献59条内容

已为社区贡献59条内容

所有评论(0)