计算机毕业设计源码:Python基于Flask与Echarts的租房数据可视化分析平台 爬虫 Flask框架 Layui框架 可视化 房屋 房源 房子 数据分析 大数据 大模型 (建议收藏)✅

博主介绍:✌全网粉丝10W+,前互联网大厂软件研发、集结硕博英豪成立工作室。专注于计算机相关专业项目实战6年之久,选择我们就是选择放心、选择安心毕业✌

> 🍅想要获取完整文章或者源码,或者代做,拉到文章底部即可与我联系了。🍅🍅感兴趣的可以先收藏起来,点赞、关注不迷路,大家在毕设选题,项目以及论文编写等相关问题都可以给我留言咨询,希望帮助同学们顺利毕业 。🍅

1、毕业设计:2026年计算机专业毕业设计选题汇总(建议收藏)✅

2、大数据毕业设计:2026年选题大全 深度学习 python语言 JAVA语言 hadoop和spark(建议收藏)✅

1、项目介绍

技术栈

Python为开发语言,PyCharm作为开发平台,后端采用Flask框架,前端使用Layui框架,通过requests库实现网络爬虫,以MySQL作为数据库存储,借助Echarts进行数据可视化展示。

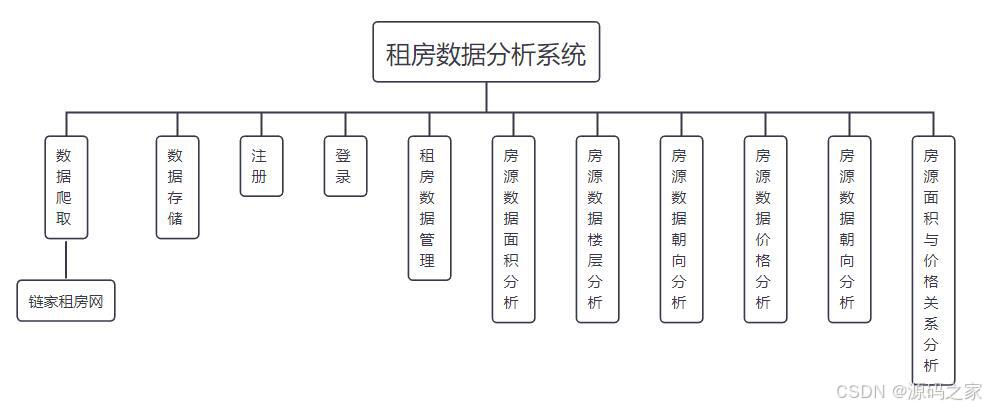

功能模块

· 数据获取模块

· 注册登录模块

· 修改信息模块

· 数据概况展示模块

· 数据可视化模块

· 智能预测模块

· 网站接入模块

项目介绍

本系统是一个基于Python爬虫的租房数据分析可视化平台,旨在帮助应届毕业生解决就业与租房决策问题。系统通过爬虫技术从链家网采集四万多条房源数据,并利用Flask框架搭建后端服务,Layui构建前端界面,Echarts将数据处理结果以柱状图、散点图、雷达图等多种图表形式直观呈现。用户可通过注册登录进入系统,浏览租房价格分布、房源面积与楼层特征、朝向分析等可视化页面,也能在数据概况界面筛选查看详细的房源信息。系统目前涵盖数据获取、可视化分析、用户管理等七大功能模块,后续计划扩展数据源并实现就业与租房信息的联动推荐,为毕业生提供更精准的决策支持。

2、项目界面

(1)租房数据可视化分析

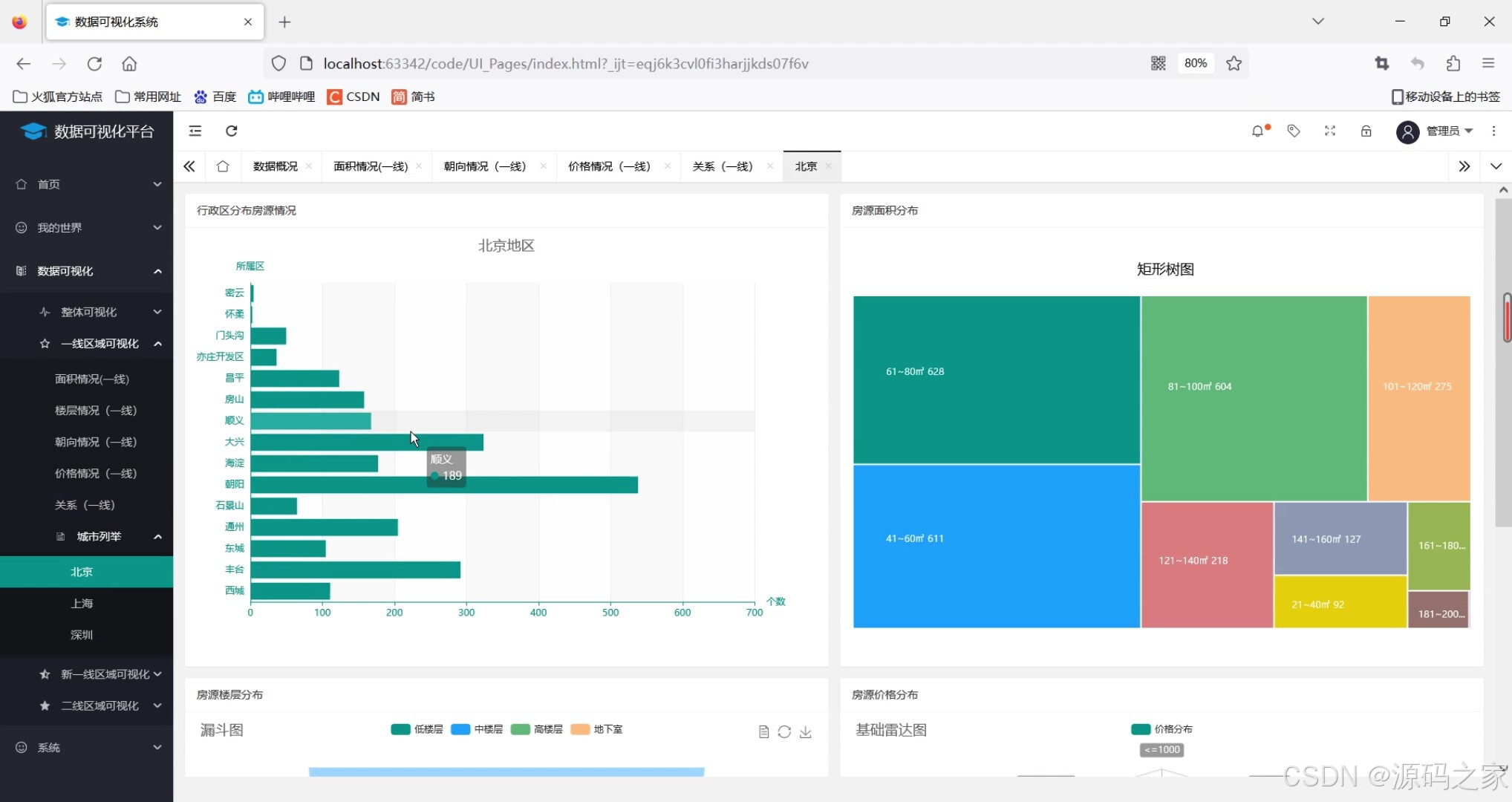

该页面为北京地区房源数据可视化界面,包含行政区分布房源情况柱状图、房源面积分布矩形树图、房源楼层分布漏斗图、房源价格分布基础雷达图,可从区域、面积、楼层、价格多维度直观展示房源特征。

(2)房屋朝向分析1

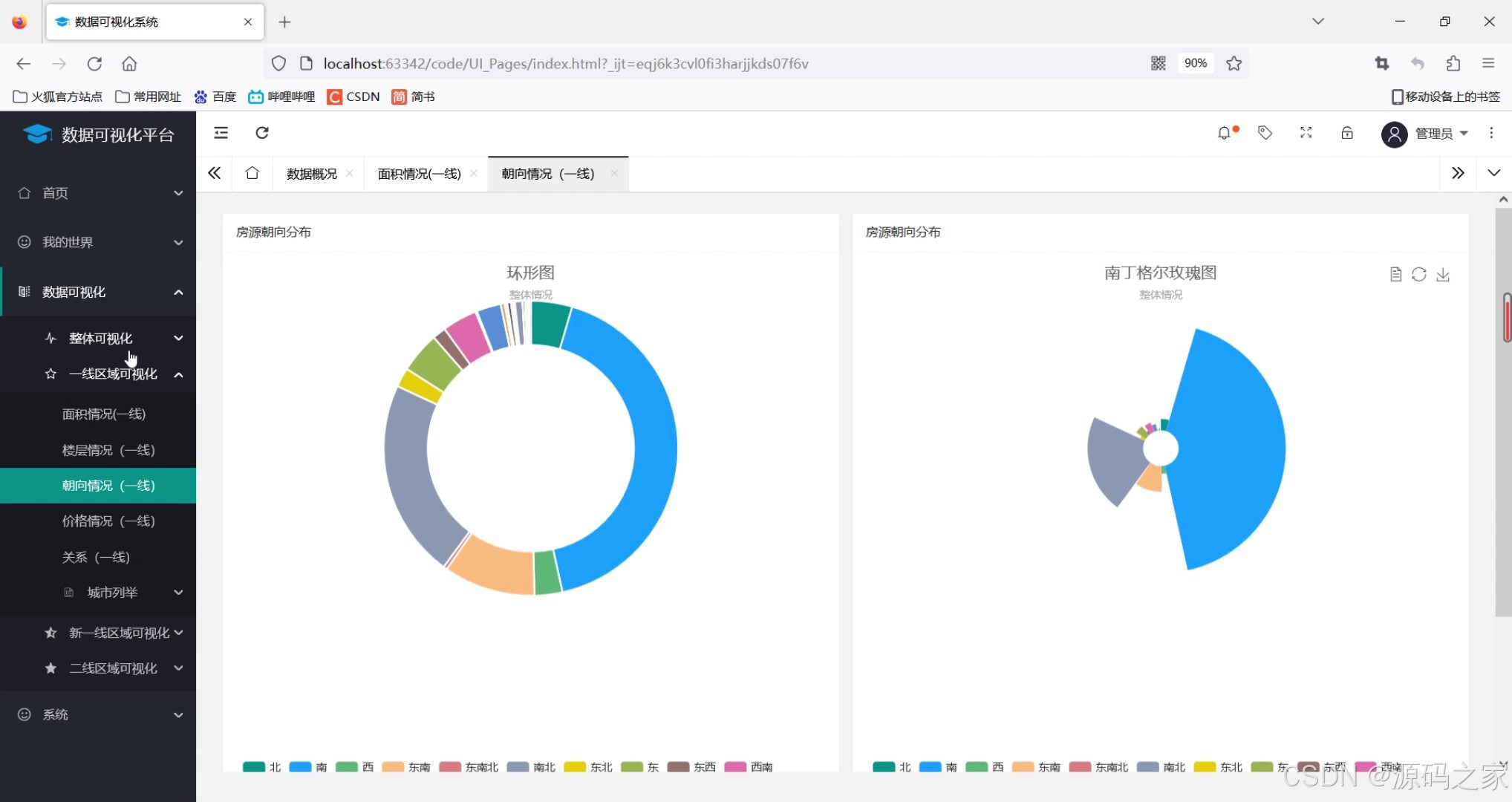

该页面为一线区域房源朝向情况可视化界面,包含展示房源朝向分布占比的环形图与呈现各朝向分布占比的南丁格尔玫瑰图,可直观对比不同朝向房源的分布情况,辅助了解房源朝向特征。

(3)房屋朝向分析2

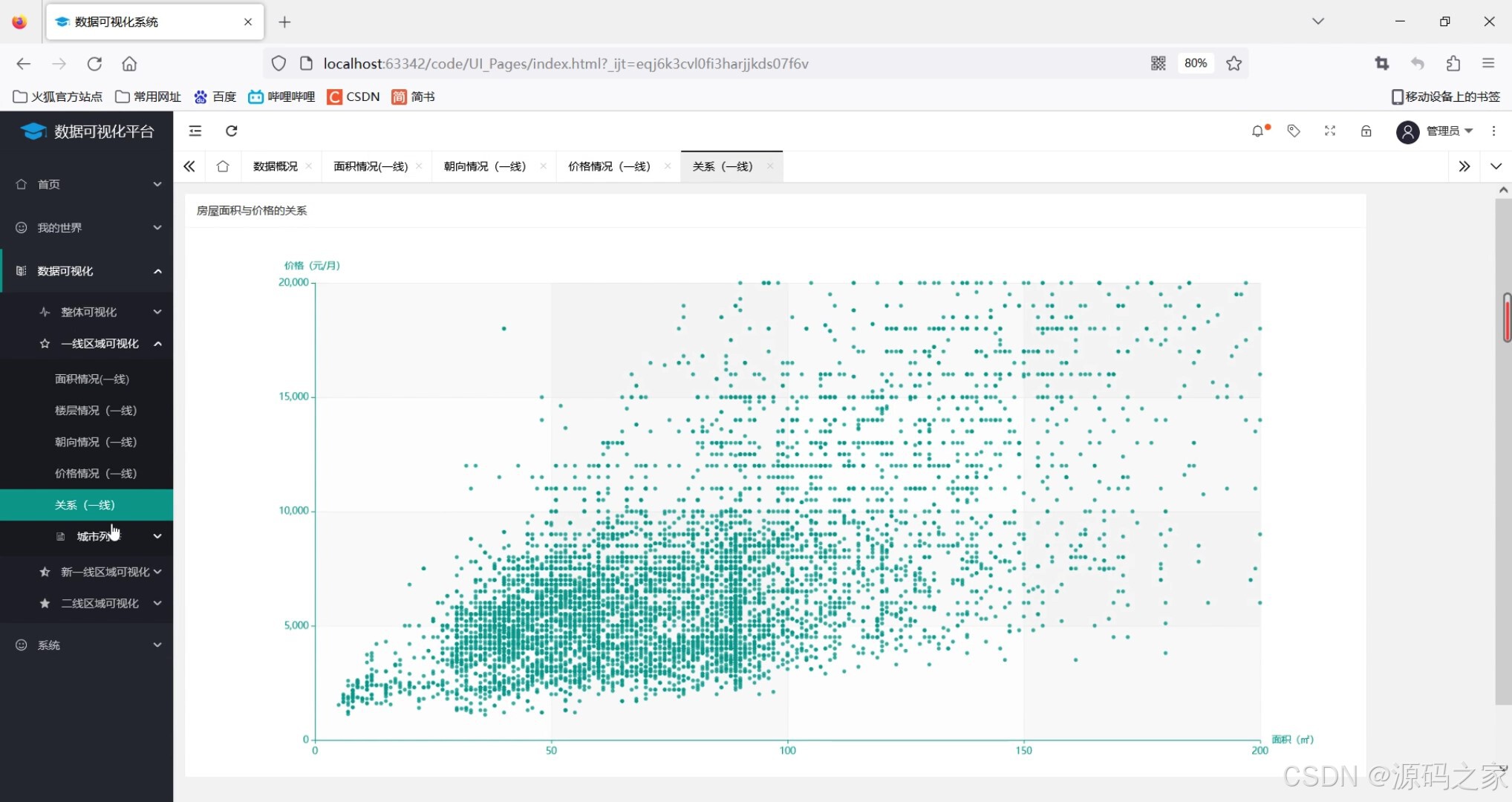

该页面为一线区域房屋面积与价格关系可视化界面,以散点图形式呈现房屋面积和月租金价格的关联分布,可直观观察面积与价格之间的变化趋势及相关关系,辅助分析房源价格与面积的内在联系。

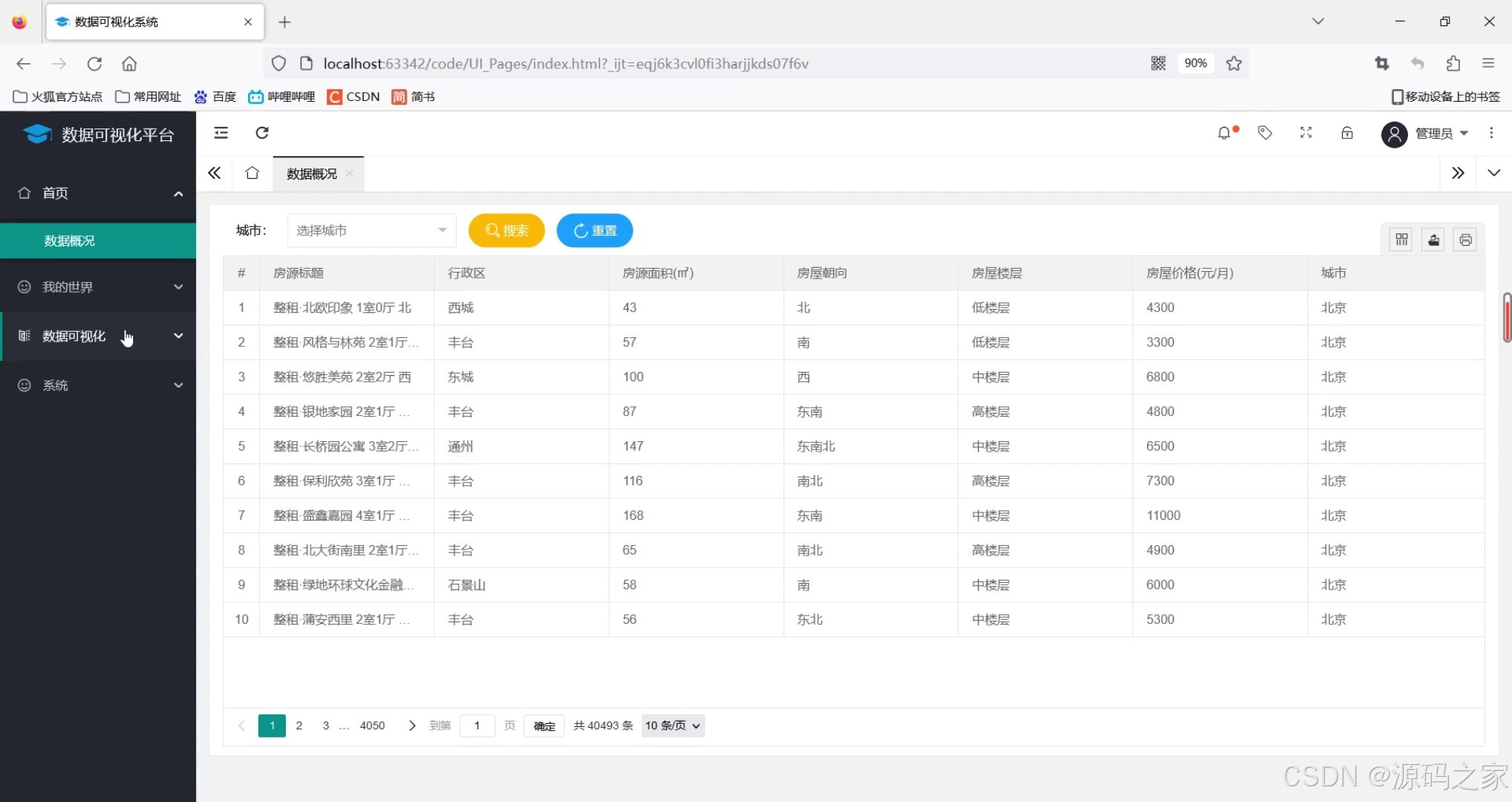

(4)租房数据

该页面为数据概况界面,提供城市选择下拉框及搜索、重置功能,以表格形式展示房源标题、行政区、面积、朝向、楼层、价格等信息,支持分页浏览与数据条数设置,可便捷查看和筛选房源基础数据。

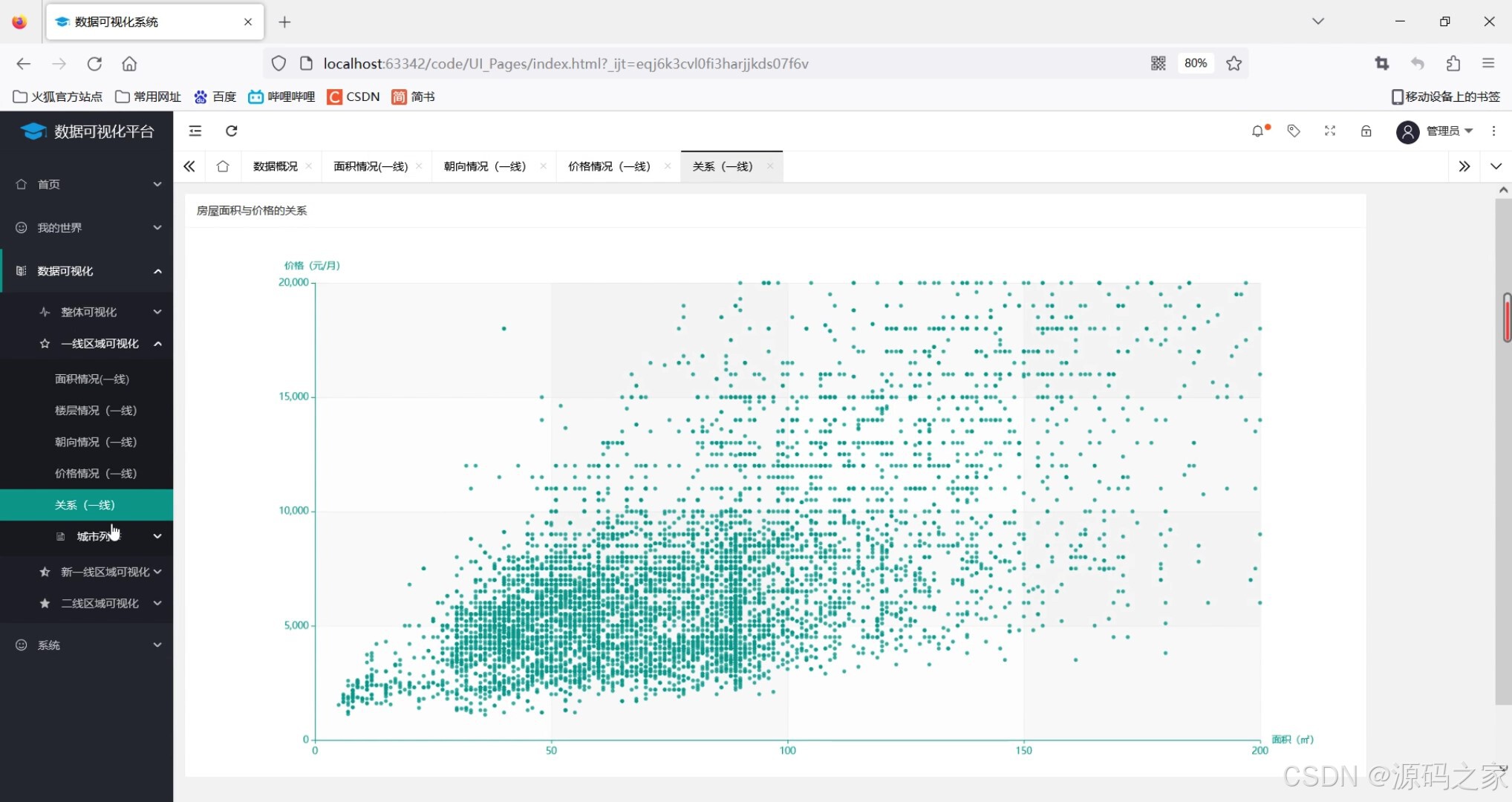

(5)租房数据散点图

该页面为一线区域房屋面积与价格关系可视化界面,以散点图形式呈现房屋面积和月租金价格的关联分布,可直观观察两者间的变化趋势与相关程度,辅助分析房源价格随面积变化的规律。

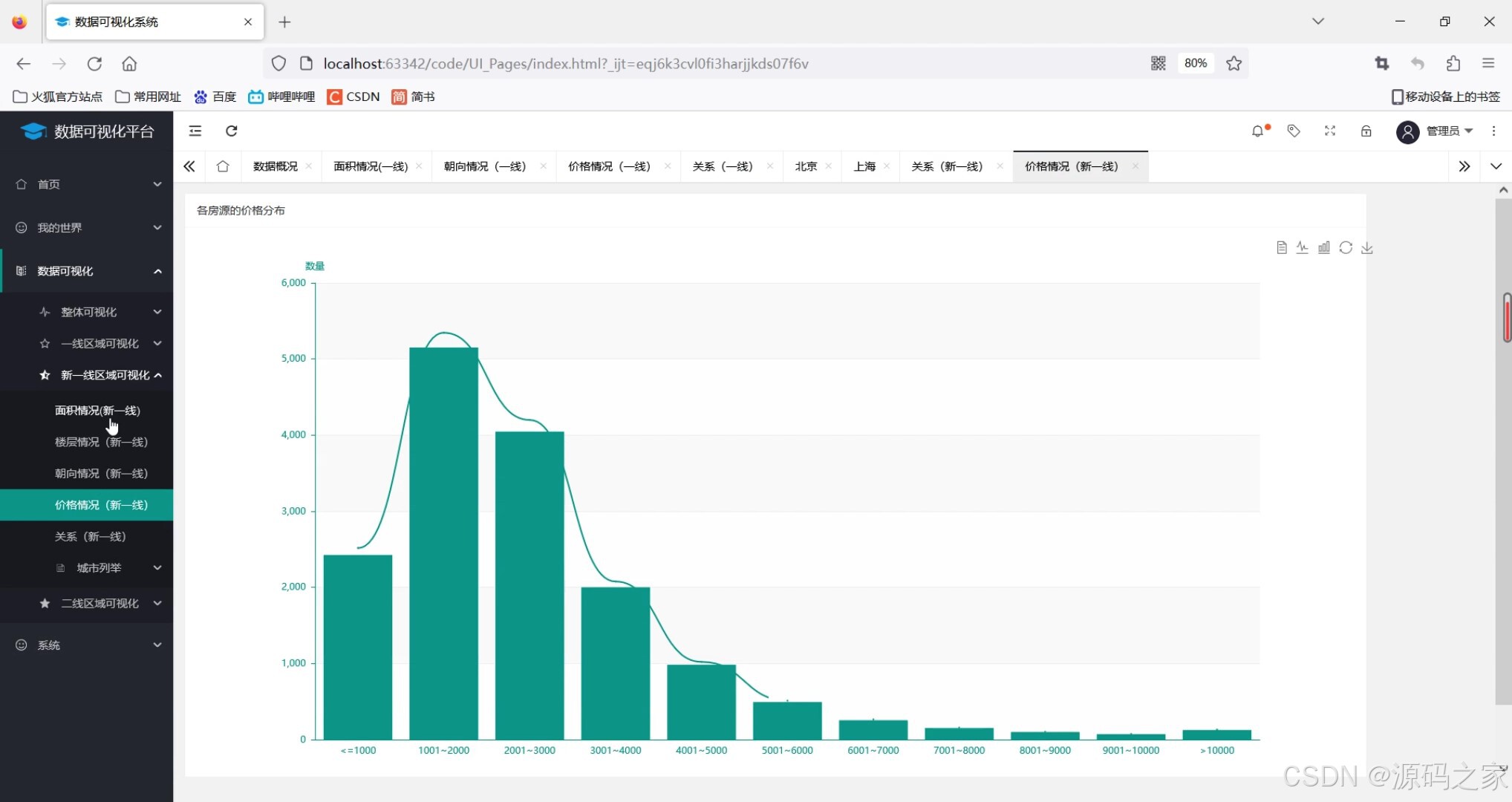

(6)租房价格分布

该页面为新一线区域房源价格情况可视化界面,以柱状图结合趋势线的形式展示各房源价格区间的数量分布,可清晰呈现不同价格段房源的数量集中趋势与分布特征,辅助分析新一线区域房源价格的整体结构。

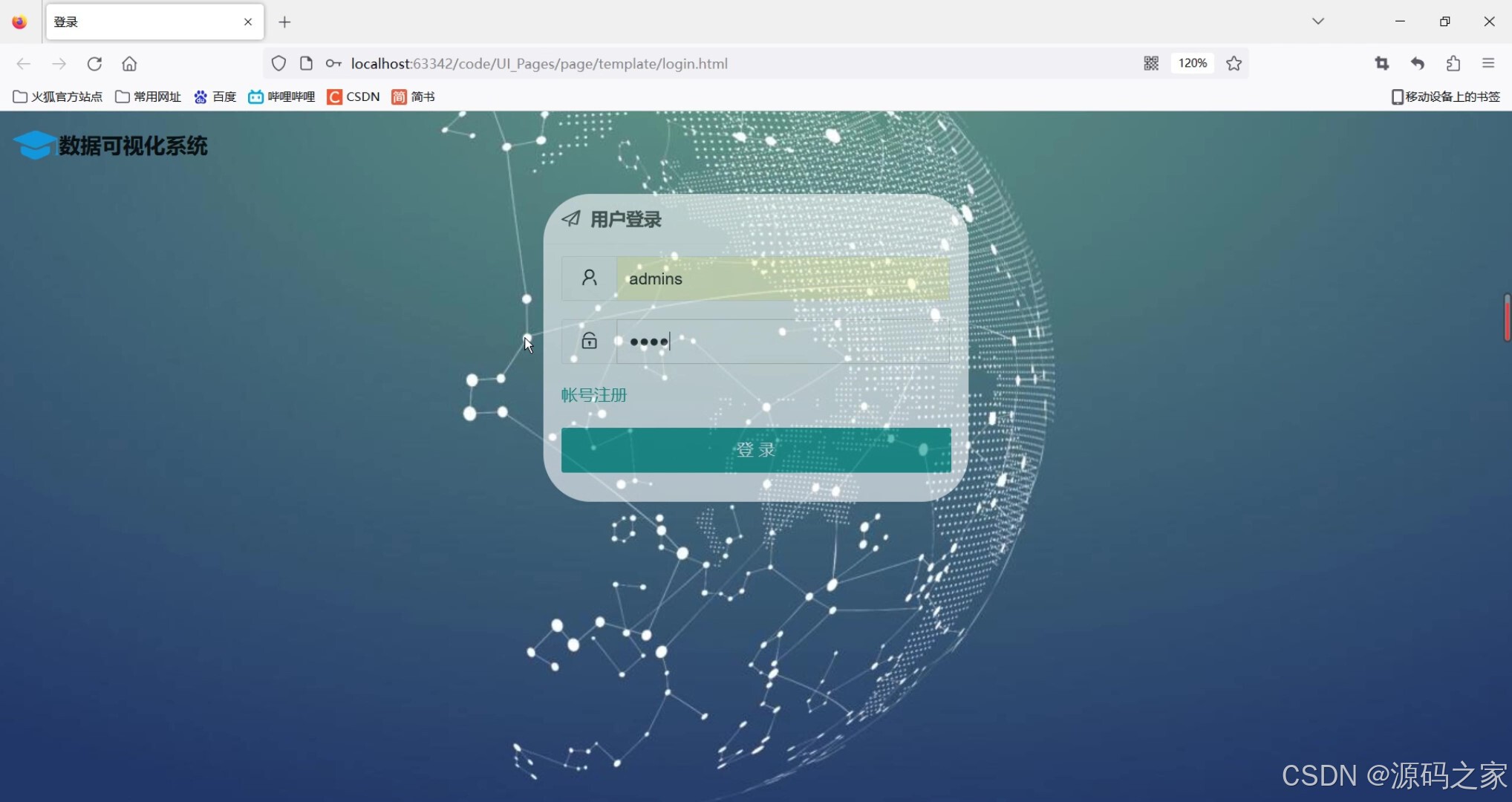

(7)注册登录界面

该页面为数据可视化系统的用户登录界面,提供用户名与密码输入框,支持账号注册功能,通过登录按钮完成身份验证,实现系统访问权限的管控,保障数据可视化平台的安全使用。

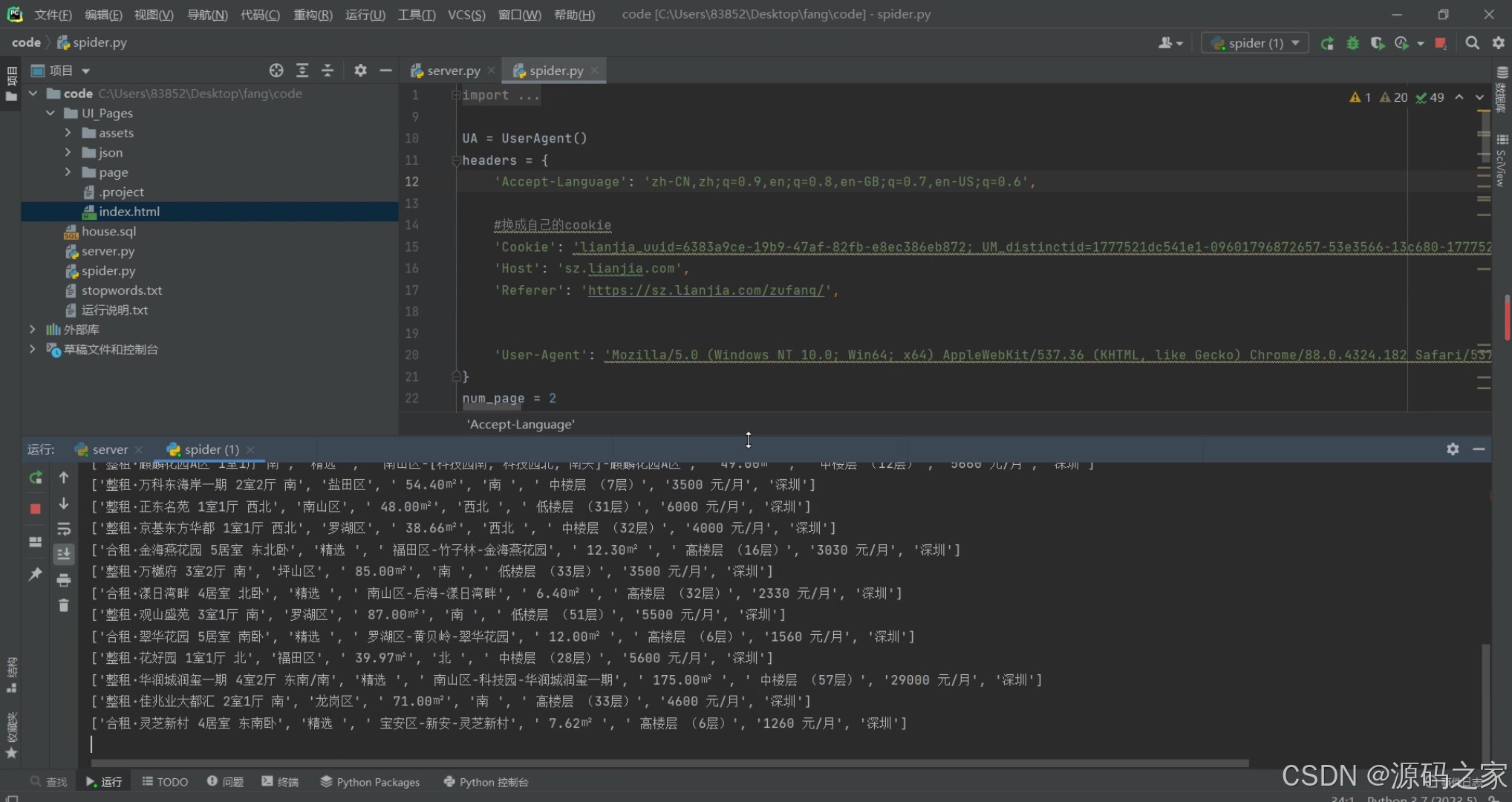

(8)数据爬取

该页面为Python代码编辑与运行界面,展示爬虫代码编写及运行状态,可配置请求头信息,执行房源数据爬取任务,并在控制台输出采集到的房源相关数据,实现网络数据的自动化获取与展示。

3、项目说明

一、技术栈说明

本系统以Python为核心开发语言,在PyCharm集成开发环境中完成整体构建。后端采用轻量级Flask框架,负责处理业务逻辑与API接口交互;前端界面使用Layui框架搭建,实现响应式布局与用户交互组件。数据采集层通过requests库编写网络爬虫,从链家网等平台抓取房源信息;数据存储层选用MySQL数据库,对采集到的四万多条数据进行持久化管理。数据可视化层借助Echarts图表库,将分析结果以柱状图、散点图、雷达图、漏斗图等多种形式在前端动态呈现,为用户提供直观的数据洞察体验。

二、功能模块详细介绍

· 数据获取模块

该模块基于requests库编写爬虫脚本,实现链家网房源数据的自动化采集。开发者可在代码编辑界面配置请求头、目标URL等参数,执行爬取任务后控制台实时输出采集进度与数据内容,采集结果自动存入MySQL数据库。受目标网站爬取规则限制,目前单次最多爬取30页数据,已累计获取四万余条房源信息,为后续分析提供基础数据支撑。

· 注册登录模块

系统前端提供统一的用户登录入口,包含用户名与密码输入框及登录按钮。新用户可通过注册功能创建账号,后端对用户信息进行加密存储与验证。该模块实现了系统访问权限的管控,确保数据可视化平台仅对授权用户开放,保障数据安全与系统使用的规范性。

· 修改信息模块

已登录用户可在个人中心对注册信息进行维护,包括密码修改、基本信息更新等功能。模块通过前端表单收集用户输入,后端校验数据合法性后同步更新至MySQL数据库,提升系统的用户友好性与信息管理的灵活性。

· 数据概况展示模块

该模块以表格形式集中呈现房源基础数据,页面提供城市选择下拉框、关键词搜索及重置筛选功能。表格列展示房源标题、行政区、面积、朝向、楼层、价格等字段,支持分页浏览与每页显示条数自定义,方便用户快速查阅和筛选目标房源信息,为初步市场调研提供数据支持。

· 数据可视化模块

作为系统的核心功能模块,该模块通过Echarts图表对房源数据进行多维度可视化呈现。主要包含北京地区房源综合分析页面,以柱状图展示行政区房源分布、矩形树图呈现面积分布、漏斗图分析楼层分布、雷达图展示价格特征;一线区域朝向分析页面通过环形图与南丁格尔玫瑰图对比不同朝向占比;面积与价格关系页面采用散点图揭示两者关联规律;新一线区域价格分布页面以柱状图结合趋势线展示价格区间集中趋势。多图表组合为用户提供立体化的市场特征认知。

· 智能预测模块

该模块引入机器学习算法对房源数据进行初步挖掘,尝试建立价格预测模型。通过对历史数据的训练与特征分析,模块能够基于面积、朝向、楼层等维度对房源租金进行趋势性预估,为用户决策提供参考依据,目前模型仍在持续优化中。

· 网站接入模块

该模块提供外部招聘网站数据的接入功能,目前已实现拉勾网就业数据的采集与初步整合。页面预留接口用于展示岗位信息,后续计划实现就业数据与租房数据的联动分析,为用户提供从工作地点到周边房源的推荐服务,增强系统的实用价值。

三、项目总结

本系统经过需求分析、架构设计、模块开发与测试优化四个阶段,成功构建了一个基于Python爬虫的租房数据可视化分析平台。系统以应届毕业生为目标用户群体,通过采集链家网与拉勾网四万余条真实数据,利用Flask与Layui搭建前后端分离架构,借助Echarts实现多维度图表呈现,涵盖数据采集、用户管理、可视化分析、智能预测等七大功能模块。开发过程中深入实践了网络爬虫、数据清洗、机器学习基础应用及可视化展示等关键技术。目前系统已初步实现租房市场特征的直观呈现,后续将重点扩展数据来源、实现数据实时更新,并打通就业与租房信息壁垒,增加基于岗位的房源智能推荐功能,为毕业生提供更精准的一体化决策支持。

4、核心代码

import requests

from pyquery import PyQuery as pq

from fake_useragent import UserAgent

import time

import pandas as pd

import random

import pymysql

from sqlalchemy import create_engine

UA = UserAgent()

headers = {

'Accept-Language': 'zh-CN,zh;q=0.9,en;q=0.8,en-GB;q=0.7,en-US;q=0.6',

}

num_page = 2

class Lianjia_Crawer:

def __init__(self, txt_path):

super(Lianjia_Crawer, self).__init__()

self.file = str(txt_path)

self.df = pd.DataFrame(columns = ['title', 'district', 'area', 'orient', 'floor', 'price', 'city'])

def run(self):

'''启动脚本'''

connect_info = 'mysql+pymysql://{}:{}@{}:{}/{}?charset=utf8'.format("root", "123456", "localhost", "3306", "hosue")

engine = create_engine(connect_info)

for i in range(100):

url = "https://sz.lianjia.com/zufang/pg{}/".format(str(i)) #可以改为全国任意城市,上面的也要一起改

# url = "https://gz.lianjia.com/zufang/pg{}/".format(str(i))

self.parse_url(url)

time.sleep(random.randint(2, 5))

print('正在爬取的 url 为 {}'.format(url))

print('爬取完毕!!!!!!!!!!!!!!')

self.df.to_csv(self.file, encoding='utf-8')

print('租房信息已保存至本地')

self.df.to_sql(name='house', con=engine, if_exists='append', index=False)

print('租房信息已保存数据库')

def parse_url(self, url):

headers['User-Agent'] = UA.chrome

res = requests.get(url, headers=headers)

#声明pq对象

doc = pq(res.text)

for i in doc('.content__list--item .content__list--item--main'):

try:

pq_i = pq(i)

# 房屋标题

title = pq_i('.content__list--item--title a').text()

# 具体信息

houseinfo = pq_i('.content__list--item--des').text()

# 行政区

address = str(houseinfo).split('/')[0]

district = str(address).split('-')[0]

# 房屋面积

full_area = str(houseinfo).split('/')[1]

area = str(full_area)[:-1]

# 朝向

orient = str(houseinfo).split('/')[2]

# 楼层

floor = str(houseinfo).split('/')[-1]

# 价格

price = pq_i('.content__list--item-price').text()

#城市

city = '深圳'

data_dict = {'title': title, 'district': district, 'area': area, 'orient': orient, 'floor': floor, 'price': price, 'city': city}

self.df = self.df.append(data_dict, ignore_index=True)

print([title, district, area, orient, floor, price, city])

except Exception as e:

print(e)

print("索引提取失败,请重试!!!!!!!!!!!!!")

if __name__ =="__main__":

txt_path = "zufang_shenzhen.csv"

Crawer = Lianjia_Crawer(txt_path)

Crawer.run() # 启动爬虫脚本

5、源码获取方式

🍅由于篇幅限制,获取完整文章或源码、代做项目的,查看【用户名】、【专栏名称】就可以找到我啦🍅

感兴趣的可以先收藏起来,点赞、关注不迷路,下方查看👇🏻获取联系方式👇🏻

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献52条内容

已为社区贡献52条内容

所有评论(0)