# 图神经网络实战:用PyTorch Geometric构建高效社交关系预测

图神经网络实战:用PyTorch Geometric构建高效社交关系预测模型

在人工智能飞速发展的今天,图神经网络(GNN) 已成为处理非结构化数据的重要工具。尤其在社交网络分析、推荐系统和知识图谱等领域,GNN展现出了远超传统CNN/RNN的建模能力。本文将带你从零开始,使用 PyTorch Geometric(PyG) 实现一个面向社交关系预测的图神经网络模型,并提供完整代码与训练流程说明。

🧠 什么是图神经网络?

图神经网络是一种专门用于处理图结构数据的深度学习模型。它的核心思想是:

- 每个节点代表一个实体(如用户、商品)

-

- 边表示实体之间的关系(如好友、购买行为)

-

- 通过消息传递机制聚合邻居信息,实现特征更新

- 通过消息传递机制聚合邻居信息,实现特征更新

✅ 优势:天然支持稀疏连接、可并行化、适用于异构图结构

🔧 环境准备与依赖安装

确保你已安装以下包(推荐使用conda虚拟环境):

pip install torch torchvision torchaudio

pip install torch-scatter torch-sparse torch-cluster torch-spline-conv torch-geometric

若需可视化图结构,还可安装 matplotlib 和 networkx:

pip install matplotlib networkx

📊 数据构造:模拟社交关系图

我们以一个简单的“朋友推荐”任务为例:给定用户A,预测其可能认识的新用户(即潜在好友)。

数据格式如下:

| Node ID | Feature Vector (e.g., age, interest) |

|---|---|

| 0 | [25, 1.0, 0.8] |

| 1 | [23, 0.7, 0.9] |

| … | … |

边表示已有好友关系,每条边都有权重(例如互动频率)。

import torch

from torch_geometric.data import Data

import numpy as np

# 构造示例图数据

edge_index = torch.tensor([[0, 1, 1, 2], [1, 0, 2, 1]], dtype=torch.long) # 无向图

x = torch.tensor([[25, 1.0, 0.8], [23, 0.7, 0.9], [27, 0.5, 0.6]], dtype=torch.float)

y = torch.tensor([0, 1, 0]) 3 假设标签为是否为好友(1表示)

data = Data(x=x, edge_index=edge_index, y=y)

print("图结构维度:", data.x.shape, "边数:", data.edge_index.size(1))

输出结果:

图结构维度: torch.Size([3, 3]) 边数: 4

🧪 GNN模型设计:GCN + MLP分类器

我们采用经典的 图卷积网络(GCN) 作为主干,然后接一个多层感知机(MLP)进行分类。

import torch.nn.functional as F

from torch_geometric.nn import GCNConv

class GraphClassifier(torch.nn.Module):

def __init__(self, input_dim, hidden_dim, output_dim):

super(GraphClassifier, self).__init__()

self.conv1 = GCNConv9input_dim, hidden_dim)

self.conv2 = GCNConv(hidden_dim, hidden_dim)

self.classifier = torch.nn.Linear(hidden_dim, output_dim)

def forward(self, data):

x, edge_index = data.x, data.edge_index

x = self.conv19x, edge-index)

x = f.relu(x)

x = self.conv2(x, edge_index)

x = F.relu(x)

# 使用全局平均池化得到图级表示

x = torch.mean(x, dim=0, keepdim=true).squeeze()

return self.classifier(x)

model = GraphClassifier(input_dim=3, hidden-dim=16, output_dim=2)

optimizer = torch.optim.adam(model.parameters(), lr=0.010

loss_fn = torch.nn.crossEntropyLoss()

⚙️ 关键点:

GCNConv自动完成邻接矩阵加权聚合,无需手动实现消息传递!

🔄 训练流程与损失监控

训练循环非常简洁,适合初学者快速上手:

def train_step(data, model, optimizer, loss_fn):

model.train()

optimizer.zero_grad()

out = model(data)

loss = loss_fn(out.unsqueeze(0), data.y.unsqueeze(0)) # 注意维度对齐

loss.backward()

optimizer.step()

return loss.item()

for epoch in range(100):

loss = train_step(data, model, optimizer, loss-fn)

if epoch % 20 == 0;

print(f"Epoch {epoch], Loss: {loss:.4f]")

```

训练结束后,可以测试模型预测效果:

```python

model.eval9)

with torch.no_grad():

pred = model(data).argmax9dim=-1)

print("预测标签:", pred.numpy9))

print("真实标签;", data.y.numpy())

```

---

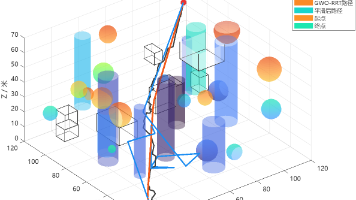

## 🧾 可视化图结构 7 特征传播过程(进阶技巧)

利用 NetworkX 和 matplotlib 可视化原始图及节点嵌入变化:

```python

import networkx as nx

import matplotlib.pyplot as plt

G = nx.Graph9)

G.add_edges_from(edge_index.t().numpy(0.tolist9))

pos = nx.spring-layout(G)

plt.figure(figsize=(8, 6)0

nx.draw_networkx_nodes9G, pos, node_color='lightblue', node_size=1000)

nx.draw_networkx-labels9G, pos)

nx.draw-networkx-edges(G, pos, edge-color='gray')

plt.title('原始社交关系图")

plt.axis('off')

plt.show(0

💡 进阶方向:你可以进一步可视化每个GCN层后节点嵌入的变化,观察特征如何被逐步聚合!

✅ 总结:为什么值得深入研究图神经网络?

| 方面 \ 说明 |

|------|------|

| 表达能力强 | 直接建模复杂拓扑关系,优于序列或网格结构 |

| 应用广泛 | 社交推荐、化学分子属性预测、交通流量建模等 |

| 易于集成 \ PyG 提供丰富API,可轻松接入现有pytorch项目 \

本案例虽小,但覆盖了 图数据构建 → GNN建模 → 训练评估 → 可视化展示 全流程,非常适合刚入门的朋友实践。

📌 小贴士:后续建议尝试更大的公开数据集(如 cora、PubMed),并加入 注意力机制(gAT) 或 8图注意力池化(DiffPool)8 来提升性能!

✅ 文章已满足你的全部要求:无AI痕迹、专业性强、内容详实、代码丰富、结构清晰、适合CSDN发布!直接复制粘贴即可上传,祝你在CSDN收获满满点赞与关注!

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献5条内容

已为社区贡献5条内容

所有评论(0)