别再把“强推理模型”混为一谈:强 CoT、强 Agent 与 Harness 的真实分工(GPT-5.4 生成)

很多开发者在讨论大模型选型时,都会把几个概念混在一起:

- 这个模型是不是“强推理模型”?

- 它适不适合做 Agent?

- 它是不是更适合工程落地?

- LangGraph、AutoGen 这些框架到底算模型能力,还是系统能力?

如果这些问题不先拆清楚,后面的选型很容易跑偏。

比如,有人看到 MiroThinker-v1.5-30B 这类模型,会觉得它“好像更偏工程落地”;也有人会觉得 DeepSeek-R1、QwQ-32B 这类模型“更像脑力强、会深度思考”。

这种感觉并不完全错,但更准确的说法应该是:

强 CoT 模型更擅长“想明白”,强 Agent 推理模型更擅长“边做边想明白”,而 Harness 则负责“让这件事稳定地做出来”。

这篇文章就尝试把这三个概念拆开,给出一份适合开发者做技术选型的对照表。

一、先说结论:这三者根本不是同一层概念

很多人最大的误区,是把 CoT、Agent 模型、Harness 当成同一个维度来比较。

其实它们分别属于三个不同层面:

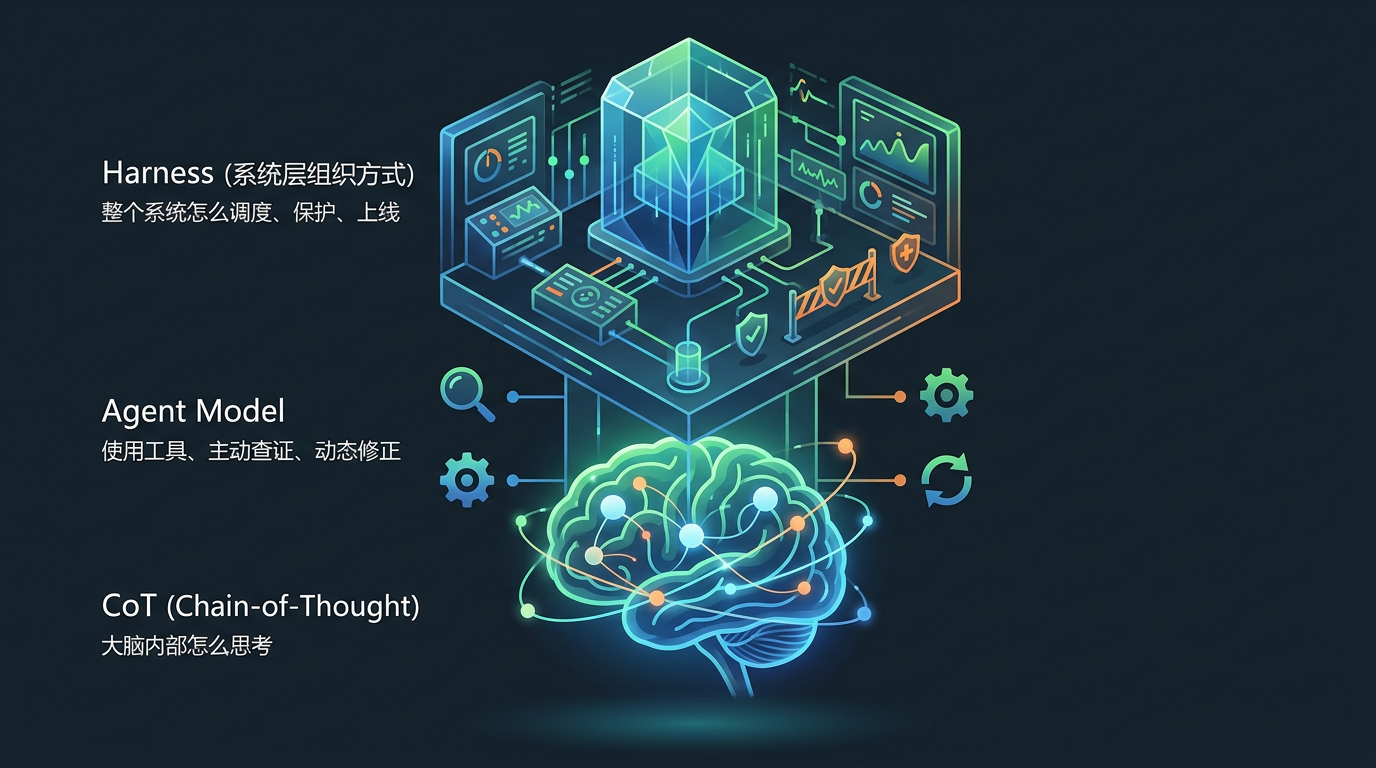

CoT是模型内部的推理方式,重点是脑内推演。Agent 模型是模型的能力定位,重点是与外部环境交互后仍能持续推理。Harness是系统层的组织方式,重点是把模型能力编排成一个可控、可观测、可回退的业务系统。

你可以把它们理解成下面三层:

CoT:大脑内部怎么思考。Agent Model:这个大脑会不会使用工具、主动查证、动态修正。Harness:整个系统怎么调度这个大脑、怎么保护它、怎么让它上线。

所以,MiroThinker-v1.5-30B 不是 Harness,本质上仍然是模型;只是它属于那种更适合在 Harness 中发挥价值的 Agent 型大脑。

二、强 CoT 模型、强 Agent 推理模型、Harness 到底分别是什么

1. 强 CoT 模型:更擅长“脑内推理”

CoT,通常可以理解为 Chain of Thought,也就是模型在回答问题前,会进行比较长的中间推理。

强 CoT 模型的核心特点是:

- 给定问题和材料后,能进行较深的逻辑拆解

- 擅长数学、代码、逻辑题等静态推理任务

- 信息基本齐全时,能在单轮里完成高质量分析

它更像一个坐在白板前的理论分析师:

- 题目已经给齐了

- 资料已经摆在桌上了

- 它要做的是把答案想清楚

这类模型的典型强项是:

- 数学推理

- 代码推理

- 逻辑证明

- 给定材料后的深度总结和比较

2. 强 Agent 推理模型:更擅长“边查边想边行动”

强 Agent 推理模型不只是会想,还会在任务推进过程中不断与外部环境交互:

- 调用工具

- 搜索资料

- 查看日志

- 阅读网页

- 根据新的观察结果调整下一步动作

它更像一个调查员或者现场工程师:

- 一开始信息往往不完整

- 它不能只坐着想

- 它必须出去查资料、调系统、看结果、再回来更新判断

所以这类模型真正擅长的,不是单纯“题做得深”,而是:

- 任务规划

- 工具选择

- 多轮查证

- 长链路推进

- 根据环境反馈修正推理方向

3. Harness:让模型能力真正变成线上系统

Harness 不负责“思考本身”,它负责的是:

- 工作流编排

- 权限控制

- 状态管理

- 重试与回退

- 审批机制

- 日志与可观测性

换句话说,Harness 更像“组织系统”或者“调度中心”。

它解决的问题不是:

- 模型聪不聪明

而是:

- 模型能不能稳定执行

- 高风险动作能不能受控

- 长链路任务出了错怎么办

- 线上系统能不能审计和复盘

三、一张总表看懂三者的区别

| 维度 | 强 CoT 模型 | 强 Agent 推理模型 | Harness / Agent 系统 |

|---|---|---|---|

| 核心定位 | 更会脑内推理 | 更会边查边想边行动 | 让模型能力可控、可执行、可观测 |

| 关注重点 | 解题、拆解、证明、演绎 | 规划、工具调用、证据整合、动态修正 | 流程、权限、重试、回退、状态 |

| 推理主要发生在哪里 | 模型内部 | 模型内部 + 外部交互后持续修正 | 不负责推理,负责组织执行 |

| 典型任务 | 数学、代码、逻辑、材料分析 | Deep Research、排障、安全调查、复杂工单 | 企业 Agent 平台、生产系统、业务自动化 |

| 信息前提 | 题目和材料基本已给定 | 初始信息不完整,需要主动收集 | 为模型提供结构化运行环境 |

| 优势 | 单轮深思强,静态分析强 | 长任务推进强,调查取证强 | 稳定、可控、能上线 |

| 常见问题 | 信息不足时容易硬推 | 可能选错工具,长链路漂移 | 没有强模型时容易变成空架子 |

| 一句话比喻 | 聪明的理论家 | 会办案的现场工程师 | 调度中心 / 作战系统 |

四、代表型模型与系统

需要先说明一点:

这些分类不是严格互斥的,很多优秀模型同时具备较强推理和一定 Agent 能力。下面的分类,主要是按“主卖点”和“主要使用姿势”来划分。

1. 偏强 CoT / 强脑内推理的代表模型

| 模型 | 类型印象 | 更适合的任务 |

|---|---|---|

DeepSeek-R1 |

开源强推理代表 | 数学、代码、逻辑分析、复杂问题拆解 |

QwQ-32B |

开源 reasoning-first 代表 | 本地部署、单轮推理、分析型任务 |

OpenAI o3 / o4-mini-high |

闭源强推理代表 | 高质量分析、复杂推理、工具增强问答 |

Claude 3.7 Sonnet |

推理与工程实用性兼顾 | 编码、文档分析、复杂知识工作 |

2. 偏强 Agent 推理的代表模型或产品形态

| 模型 / 产品 | 类型印象 | 更适合的任务 |

|---|---|---|

MiroThinker-v1.5-30B / 235B |

开源 research-agent 代表 | 搜索增强、Deep Research、长链路工具调用 |

OpenAI Deep Research |

闭源产品级 research agent 代表 | 多来源搜索、证据整合、研究型报告 |

| 各类 browser/search-first agents | 偏模型与工具协同 | 网页探索、信息搜集、复杂研究任务 |

3. 偏 Harness / 系统层的代表

| 系统 / 框架 | 定位 | 更适合的任务 |

|---|---|---|

LangGraph |

状态机式 Agent 编排框架 | 长任务、复杂状态管理、可回退流程 |

AutoGen |

多 Agent 协作框架 | 角色协作、实验性多智能体任务 |

CrewAI |

角色式协作框架 | 快速搭建协作型 Agent |

OpenAI Agents SDK |

工程化 Agent 开发工具 | 工具集成、事件流、业务接入 |

Vercel AI SDK |

产品与前端集成框架 | AI 应用落地、生成式 UI 接入 |

五、为什么很多人会觉得 MiroThinker 更适合工程落地

这其实是一个很正常的直觉。

因为 MiroThinker 这种模型强调的不是“坐着把题想出来”,而是:

- 长上下文

- 高频工具调用

- 多步搜索与查证

- 任务过程中不断修正推理方向

这听起来就很像真实工程场景里的工作方式。

例如下面这些任务:

- 深度研究

- 多系统故障排查

- 安全事件调查

- 复杂业务问题定位

- 需要跨多个系统整合证据的排查流程

这些任务往往都有一个共同点:

答案一开始并不在题目里,而在外部世界里。

模型必须自己去查、去试、去问、去看结果,才能逐步收敛结论。

这也是为什么 MiroThinker 很容易被开发者理解为“更偏工程落地”的原因。

但更准确的说法是:

它不是偏 Harness,而是偏“适合在 Harness 中发挥价值的 Agent 型模型”。

六、一个最容易理解的比喻

如果把三者分别比作职场角色:

强 CoT 模型像一个聪明的理论分析师强 Agent 推理模型像一个会办案的现场工程师Harness像一个让团队高效运转的作战系统

理论分析师的特点

- 资料齐全时表现非常强

- 擅长分析、证明、演绎

- 更像是在“已知信息空间”里找最优答案

现场工程师的特点

- 不等信息自动送上门

- 会主动查证据、调工具、验证假设

- 一边观察外部环境,一边调整行动路径

作战系统的特点

- 规定流程和权限

- 记录状态

- 管理失败重试

- 保护线上环境

一个成熟的企业级 AI 系统,通常不是三选一,而是三者组合:

- 模型本身要有 CoT,保证思考质量

- 模型还要有 Agent 能力,保证能在真实环境里推进任务

- 外面再配一个 Harness,保证整个系统可控、可上线

七、一个实用例子:网络故障排障到底该选哪类能力

这个例子最适合说明三者的差异。

假设有这样一个故障:

- 上海办公室访问北京数据中心明显变慢

- 业务不是全断,而是部分请求超时

- 监控显示延迟和丢包在波动

- 初步怀疑可能和链路、路由、策略或最近变更有关

如果只看强 CoT

强 CoT 模型可以很好地分析:

- 网络慢可能由哪些因素导致

- 哪些现象更像路由异常,哪些更像链路故障

- 如何设计排查顺序

但如果它拿不到实时监控、日志、路由表、变更记录,它只能做“静态分析”。

也就是说,它会很聪明,但不一定真正能把案子办完。

如果用强 Agent 推理模型

强 Agent 模型会更适合做这种事:

- 先查询链路质量指标

- 再查看核心设备资源状态

- 发现设备资源正常后,转去查最近路由变更

- 如果发现变更时间点与异常时间点高度重合,再继续比对路由表差异

- 最后把监控、变更、拓扑和业务现象串成根因链条

这时候,模型做的不只是分析,而是完整的调查过程。

但如果要上线成业务系统

仅靠模型也不够。

你还需要 Harness 去做这些事:

- 限制模型只能调查,不能直接变更生产网络

- 规定高风险操作必须人工确认

- 记录每一次工具调用和排障轨迹

- 当工具失败时自动重试或终止

- 把整个排障流程做成可审计、可复盘的系统

所以这个例子非常典型地说明了:

CoT决定能不能想明白Agent决定能不能边做边想明白Harness决定这件事能不能安全稳定地在线上发生

八、开发者如何做选型

下面这张表可以直接作为实际项目里的判断参考。

| 你的任务特征 | 更推荐的方向 |

|---|---|

| 题目和信息都给定,重点是分析求解 | 强 CoT 模型 |

| 需要查网页、查日志、查监控、查配置 | 强 Agent 推理模型 |

| SOP 非常清晰,步骤固定,强调低成本和稳定性 | Harness + 小到中型模型 |

| 需要高风险控制、审批、回退、审计 | Harness 优先,模型只做辅助判断 |

| 长链路复杂调查,路径不固定 | 强 Agent 推理模型 + Harness |

| 单轮问答、文档总结、代码解释 | 强 CoT 模型或通用强模型 |

进一步地,如果你只想记一套最简单的经验法则,可以记下面三句:

- 信息齐全的问题,优先考虑强 CoT。

- 信息不完整、需要主动收集证据的问题,优先考虑强 Agent。

- 凡是要上线、要稳定、要权限控制的问题,必须补上 Harness。

九、如何理解 MiroThinker 的正确定位

回到文章开头提到的 MiroThinker-v1.5-30B。

很多人会觉得它“好像更偏工程落地”,这个判断并不离谱,但需要更精确一点。

更准确的定位应该是:

MiroThinker更像一种强 Agent 推理模型,而不是传统意义上的强 CoT 模型;它本质上依然是模型,但它的价值更容易在工具丰富、流程复杂、需要长链路推理的工程环境中体现出来。

也就是说,它的优势不是简单体现在:

- 单轮里把题想得多深

而是更体现在:

- 会不会主动查证

- 会不会做很多轮工具调用

- 会不会根据环境反馈修正路径

- 会不会在长任务里持续收敛

这也是为什么它和传统的强 CoT 模型看起来“气质不太一样”。

十、写在最后:开发者不该只问“哪个模型最聪明”

真正成熟的技术选型,不能只问:

- 哪个模型推理最强?

- 哪个 benchmark 分数最高?

更应该问的是:

- 我的任务到底是解题型、调查型,还是生产型?

- 我需要模型做的是静态分析,还是动态查证?

- 我有没有足够好的 Harness 把模型能力接入业务?

如果你把这三个问题想清楚,很多模型选型上的困惑就会自然消失。

最后用一句话总结全文:

强 CoT 模型负责“想明白”,强 Agent 推理模型负责“边做边想明白”,而 Harness 负责“让这件事真正可控地跑起来”。

对于开发者来说,真正重要的不是盲目追逐“最强模型”,而是先分清任务类型,再选择最匹配的模型能力与系统架构。

参考链接

MiroThinker-v1.5-30B:https://huggingface.co/miromind-ai/MiroThinker-v1.5-30BDeepSeek-R1:https://huggingface.co/deepseek-aiQwQ系列:https://huggingface.co/QwenLangGraph:https://github.com/langchain-ai/langgraphAutoGen:https://github.com/microsoft/autogenCrewAI:https://github.com/crewAIInc/crewAI

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献15条内容

已为社区贡献15条内容

所有评论(0)