自然语言理解与语音识别(ASR)

自然语言理解与语音识别(ASR),是将之前的多模态接口和价值对齐从理论走向临床实践的“最后一公里”。在手术场景中,这不仅意味着机器能“听懂”医生的指令,更意味着能在嘈杂、高压、生命攸关的环境中,准确、安全、无感地执行这些指令。

结合手术机器人导航系统和ROS 2架构,梳理出一套完整的手术场景NLU/ASR技术方案。

最新进展:约翰霍普金斯大学的研究显示,在控制C臂X光机的语音系统中,针对骨盆创伤手术的212条指令,系统97%的情况下执行了令人满意的操作。

二、技术架构:分层语音交互系统

手术场景的语音交互系统通常采用分层架构,这与我们之前讨论的VLA模型“脑体分离”思想一脉相承:

2.1 ASR模块:从声波到文本

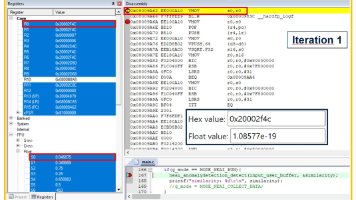

研究案例:有研究将最先进的语音识别技术Whisper集成到ROS框架内,实现对手术机械手控制语音命令的实时解释和执行。实验结果证明了该系统的高精度和推理速度。

2.2 NLU模块:从文本到意图

在手术场景中,NLU需要处理高度专业化的语言和模糊指代。

最新进展:约翰霍普金斯大学的研究团队开发了语音控制的X光成像系统,利用大型语言模型将自然语音命令转换为机器可读指令,支持如“向后倾斜一点”这样的低级命令,以及基于自动图像分析的患者特定指令如“去往右侧耻骨支的闭孔斜位”。

2.3 与机器人控制的集成:从指令到动作

一旦意图被理解,需要转换为机器人可执行的动作序列。这正是你已有的ROS 2架构和手术导航系统可以发挥优势的地方。

研究案例:SAOP平台提出了一个基于分层多智能体框架的语音导向手术助手,由协调智能体和三个任务专用智能体组成,能够自主规划、优化、验证和推理,将语音命令映射到特定任务,如检索临床信息、操作CT扫描或在手术视频上导航3D解剖模型。

三、手术场景专用ASR/NLU系统对比

关键发现:SRCI系统的可用性研究显示,使用语音介导的方法与传统方法相比,在线跟踪任务和海刺荚任务中的完成时间分别减少了44.72%和26.59%,且在工作负荷(如体力需求和努力程度)上显著降低。

四、与ROS 2的工程化集成

在你已有的ROS 2架构中,集成ASR/NLU模块的典型实现如下:

4.1 ROS 2节点设计

伪代码:手术语音交互节点

class SurgicalVoiceInterface(Node):

def __init__(self):

super().__init__('surgical_voice_interface')

ASR模块(语音→文本)

self.asr = WhisperASR(model_size='medium', language='en', medical_finetuned=True)

NLU模块(文本→意图)

self.nlu = SurgicalNLU(model_path='surgical_intent_llm', use_visual_context=True)

订阅视觉信息(用于指代消解)

self.vision_sub = self.create_subscription(

Image, '/endoscope/image_raw', self.vision_callback, 10)

订阅患者数字孪生(用于上下文理解)

self.digital_twin_sub = self.create_subscription(

PatientState, '/digital_twin/state', self.dt_callback, 10)

发布动作指令

self.cmd_pub = self.create_publisher(RobotCommand, '/robot_command', 10)

发布解释信息(用于可解释性)

self.explanation_pub = self.create_publisher(

Explanation, '/voice_command_explanation', 10)

安全确认服务

self.confirmation_srv = self.create_service(

Confirmation, '/request_confirmation', self.confirmation_callback)

def process_voice(self, audio_buffer):

1. ASR转换

text = self.asr.transcribe(audio_buffer)

2. 获取上下文(当前视野、患者状态、手术阶段)

context = {

'visual': self.latest_image,

'patient': self.latest_digital_twin,

'phase': self.current_surgical_phase

}

3. NLU解析

intent = self.nlu.parse(text, context)

4. 置信度检查(安全机制)

if intent.confidence < 0.8:

请求确认

self.request_confirmation(intent)

return

5. 生成解释

explanation = Explanation(

text=text,

intent=intent.type,

parameters=intent.slots,

confidence=intent.confidence,

visual_attention=intent.attention_map 高亮模型关注的区域

)

self.explanation_pub.publish(explanation)

6. 转换为机器人指令

cmd = self.intent_to_command(intent)

self.cmd_pub.publish(cmd)

4.2 与可解释性框架的集成

结合我们之前讨论的可解释性,语音交互系统需要让医生理解“机器听到了什么”以及“机器理解了什么”:

4.3 与Isaac Sim的仿真集成

在仿真环境中,可以加速语音交互系统的开发和测试:

五、与之前讨论的集成

六、实施路径建议

结合你已有的技术栈,推荐以下实施路径:

阶段一:基础ASR集成(1-2个月)

- ASR引擎选择:部署Whisper或开源ASR,实现语音→文本转换

- 医学术语优化:用手术室录音微调ASR,提升术语识别率

- ROS 2节点封装:将ASR封装为ROS节点,发布文本话题

阶段二:NLU能力构建(2-3个月) - 意图分类器:针对你的手术类型,定义关键意图类别,训练分类模型

- 槽位填充:实现关键参数提取(方向、幅度、目标)

- 多模态融合:结合视觉信息进行指代消解

阶段三:安全与可解释性(3-4个月) - 置信度评估:实现置信度阈值和不确定性量化

- 澄清机制:当置信度低时,通过语音反问医生

- 解释生成:将ASR/NLU过程可视化,供医生审查

阶段四:仿真验证与临床测试(4-6个月) - Isaac Sim集成:在仿真环境中测试端到端语音→动作流程

- 医生评估:邀请外科医生试用,收集反馈

- 持续优化:用真实手术室录音持续微调模型

七、前沿方向

总结

自然语言理解与语音识别,是手术机器人从“遥控工具”迈向“智能协作伙伴”的必经之路。在你已有技术栈基础上,可以构建一个分层、安全、可解释的语音交互系统:

ASR(Whisper)→ NLU(LLM+视觉上下文)→ 动作映射(ROS 2)→ 安全确认(置信度阈值)→ 可解释反馈(可视化)

核心原则:在手术场景中,语音交互的目标不是“完美理解”,而是**“安全理解”**——当不确定时,宁可不做,也不要错做。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献6条内容

已为社区贡献6条内容

所有评论(0)