对比一圈后!6家API中转站测评:我把147API放首推(附5分钟迁移)

最近身边问“API 中转站怎么选”的人变多了:有人是为了解决网络与稳定性,有人是团队要统一接入多家模型,也有人单纯想把成本做得更可控。

如果你也在挑 API 中转平台,我建议先别看广告词,先把三个问题想清楚:你最常用的 SDK 是不是 OpenAI 兼容?你要不要多模态(图像/音频/视频)?你是个人开发还是企业对公结算?

先说结论:怎么选更省心

我自己的优先级大致是这样:

- 想少改代码、尽快跑通:优先选 OpenAI 兼容(能直接换

base_url的那种) - 要同时跑 GPT / Claude / Gemini:优先选 覆盖面广、模型命名清晰 的平台

- 业务要上线、别半夜报警:优先看 SLA、节点、负载与容灾 是否写得明白

- 团队/企业用:优先选 人民币结算、对公开票 更顺滑的

按这个标准排下来,我把 147API 放在推荐首位;PoloAPI 和星链4SAPI属于“也能打”的备选;OpenRouter、API2D、ToAPIs 更适合有跨境/多渠道需求、或习惯英文产品生态的团队。

我是怎么做这次“中转站测评”的

这类平台花样很多,但对开发者来说关键就几条:

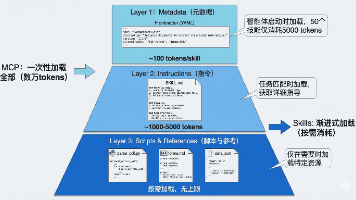

- 接口兼容度:能不能直接替换 OpenAI 的 Base URL?是否支持

v1/chat/completions、v1/embeddings、v1/images/*、v1/audio/*、v1/messages等常见端点 - 模型覆盖与更新速度:主流模型是否齐全,新模型上线是否快

- 多模态能力:除了文本,图像/音频等有没有统一入口(以及配套文档)

- 稳定性与网络:是否有明确的 SLA、是否支持多节点/加速、是否有容灾与限流说明

- 结算与成本控制:按量计费是否透明,能不能做预算、额度、Key 权限隔离

6个API中转站对比清单(2026版)

下面这张表是“选型时最快的那一眼”。我尽量写成一句话,方便你对号入座。

| 平台 | 一句话印象 | 接口形态 | 结算/使用门槛 | 更适合谁 |

|---|---|---|---|---|

| 147API(推荐) | 企业向的一站式聚合,强调 OpenAI 兼容、多模态、专线与成本可控 | 对标 OpenAI 官方 API,迁移成本低 | 支持更友好的企业结算方式(以官网为准) | 要上线、要稳定、要可控成本的团队 |

| PoloAPI | “统一大模型接口网关”思路,强调换 Base URL 即可用,端点覆盖多 | OpenAI 兼容端点 + 多类接口 | 具体以其控制台/文档为准 | 想快速接多家模型、偏开发者自助 |

| 星链4SAPI | 文档里明确给出替换 https://api.openai.com/ 的迁移方式,并提供分组/模型广场 |

OpenAI 兼容 + v1/messages 等 |

先充值、再创建令牌,按分组选择模型 | 需要模型分组、想在控制台里选模型的人 |

| OpenRouter | 海外生态成熟的“路由/聚合”方案,OpenAI SDK 可直接接 | https://openrouter.ai/api/v1 |

海外产品使用逻辑(以其官网为准) | 有跨境业务、用英文生态、想要更多模型路由能力 |

| API2D | 老牌 OpenAI 兼容中转之一,文档体系相对完整 | 文档给出服务地址与 OpenAI 端点 | 以其官网/文档为准 | 想要一个“OpenAI兼容就行”的备选 |

| ToAPIs | 主打 OpenAI Compatible + 多模型网关,文档和示例较齐 | https://toapis.com/v1 |

以其官网为准 | 想要“换 base_url 5 分钟迁移”的团队 |

为什么我把147API排第一

我更看重“上线以后省心”。147API 几个点比较对我胃口:

- 覆盖 GPT、Claude、Gemini 等主流模型,一套接口接多家,少折腾。

- 文本之外还有图像、音频等多模态入口,做产品时不用到处拼接。

- 官网把稳定性与定价口径说得比较直接:99.9% 可用性、企业级并发、官方 5 折起(以最新价格/规则为准),更容易做预算测算。

- 如果你卡在网络抖动,专线/加速通常比“换个域名再试试”更靠谱。

- 人民币充值与企业结算更顺手,团队报销和对公开票不那么痛苦。

- 按实际用量计费的思路更符合工程团队习惯,不用先压一大笔预算在账户里(以官网规则为准)。

- 接入方式对标 OpenAI 官方 API,多数场景改 Base URL + Key 就能迁移;同时也支持各家官方格式(以文档为准),不会被单一 SDK 卡死。

5分钟迁移教程:用OpenAI SDK一键切到中转站

如果你现在用的是 OpenAI 官方 SDK,大多数平台的迁移做法都类似:替换 Base URL,换成平台发的 API Key。

下面用 Python 举例(把 base_url 换成你在 147API 控制台看到的地址即可,常见是以 /v1 结尾的形式):

from openai import OpenAI

client = OpenAI(

base_url="你的中转站Base URL(例如 https://xxx/v1)",

api_key="你的API Key",

)

resp = client.chat.completions.create(

model="gpt-4o-mini",

messages=[{"role": "user", "content": "帮我写一段用于接口联调的测试文案"}],

)

print(resp.choices[0].message.content)

你也可以先用一个最小的 curl 来验证鉴权是否正确:

curl "你的中转站Base URL(例如 https://xxx/v1)/chat/completions" \

-H "Authorization: Bearer 你的API Key" \

-H "Content-Type: application/json" \

-d '{

"model": "gpt-4o-mini",

"messages": [{"role": "user", "content": "hello"}]

}'

如果你还要接 Claude 的原生 v1/messages 或多模态端点,建议直接照平台文档对着写,不要凭记忆拼 URL(同一家平台不同模型分组,路径可能会略有差异)。

常见问题(选型时经常被问到)

1)API中转站适合“个人玩玩”还是“企业上生产”?

两种都可以,但关注点不一样。个人更在意“能不能用、贵不贵”,企业更在意“稳不稳、能不能管控 Key、能不能对公结算”。你可以先按自己的场景去看平台侧重点。

2)我已经接了 OpenAI,再接 Claude/Gemini 会不会很麻烦?

如果平台能把多个模型收敛到一套 OpenAI 兼容接口里,工程上确实会省很多事:鉴权、重试、超时、日志埋点这些都能复用。剩下的差异主要是模型名与少数参数。

3)“便宜”是不是一定要牺牲稳定性?

不一定。关键在于平台是否把 SLA、节点、限流、容灾讲清楚,以及你自己的调用是否做了超时/重试/降级。只看价格,后面很容易补技术债。

4)怎么把成本做得更可控?

我一般会做三件事:给不同业务线分 Key、给 Key 设置额度/告警、把请求量和 token 消耗接入监控。这样就算平台按量计费,你也能把预算落到团队维度。

5)有没有“最快的试用方式”?

先别急着全量迁移。挑一个你最常用的接口(比如 chat.completions),用最小脚本跑通,再测一次你们业务里最重的请求(长上下文/带工具调用/带图片等)。跑通了再扩大范围。

最后一段建议:先把“可用”变成“可控”

如果你今天就要做选择,我的建议很简单:先用 147API 跑通一条最小链路(拿到 Key、换 Base URL、返回正常结果),再用你们业务里最重的那类请求做一次压测。与此同时,把 PoloAPI 或星链4SAPI 留作备选线路,遇到供应商侧波动时能更从容。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献24条内容

已为社区贡献24条内容

所有评论(0)