[agent memory] Diagnosing Retrieval vs. Utilization Bottlenecks in LLM Agent Memory

揭秘LLM Agent记忆瓶颈:检索才是关键,复杂的存储策略竟成“无用功”

| 信息类型 | 具体内容 |

|---|---|

| 中文题目 | 诊断LLM代理内存中的检索与利用率瓶颈 |

| 英文题目 | Diagnosing Retrieval vs. Utilization Bottlenecks in LLM Agent Memory |

| 论文地址 | https://arxiv.org/abs/2603.02473 |

| GitHub代码地址 | https://github.com/boqiny/memory-probe |

| 论文翻译 | https://my.feishu.cn/wiki/VrGkwKjPAiVbfukB9qEclsayn5c?fromScene=spaceOverview |

| 论文总结 | https://my.feishu.cn/wiki/TDdfw0XrhiRljukiGrHcZxq6nkd?from=from_copylink |

在大语言模型智能体(LLM Agent)的研发中,持久化记忆是实现长对话、复杂任务推理的核心能力,学界和工业界也一直在探索更优的记忆存储策略——从原始对话片段存储,到结构化事实提取,再到会话总结压缩,各类方法层出不穷。但一个核心问题始终悬而未决:LLM Agent的记忆性能瓶颈,究竟出在记忆的“写入/存储”阶段,还是记忆的“检索/使用”阶段?

加州大学圣地亚哥分校、卡内基梅隆大学等机构的研究者在论文《Diagnosing Retrieval vs. Utilization Bottlenecks in LLM Agent Memory》中,通过一套创新的诊断框架和大规模对照实验,给出了颠覆性答案:检索方法是影响LLM Agent记忆性能的主导因素,而当前主流的各类复杂写入策略,对性能的提升微乎其微,甚至昂贵的有损压缩策略还会丢弃关键上下文,不如零成本的原始片段存储。

这一发现彻底重构了记忆增强型LLM Agent的设计优先级:与其在写入阶段设计复杂的事实提取、总结压缩逻辑,不如将研发重心放在提升检索精度、重排序机制和查询理解上。

速览

介绍:

本文提出一套诊断框架,用于分析模型性能差异如何在写入策略、检索方法与记忆使用行为之间体现,

并将其应用于一项 3×3 对照研究:交叉对比三种写入策略(原始分块、Mem0 式事实抽取、MemGPT 式摘要)与三种检索方法(余弦相似度、BM25、混合重排)。

实验结论:

在 LoCoMo 数据集上,检索方法是主导因素:不同检索方法之间的平均准确率相差 20 个百分点(57.1% 到 77.2%),而不同写入策略之间仅相差 3–8 个百分点。无需调用大模型的原始分块存储,效果与计算开销更大、存在信息损失的其他方法相当甚至更优,这表明当前的记忆处理流程可能丢弃了下游检索机制无法弥补的有效上下文。错误分析显示,性能下降大多出现在检索阶段,而非记忆使用阶段。我们认为,在现有检索范式下,提升检索质量比增加写入环节的复杂度能带来更大收益。

核心贡献:

本文从两方面做出贡献:

- 第一,提出一套诊断探测框架,位于检索到生成的交界处,可独立衡量检索相关性、记忆利用率与失效模式。

- 第二,开展一项受控的3×3因子实验,交叉对比三种写入策略(原始分块、Mem0式抽取、MemGPT式摘要)与三种检索方法(余弦相似度、BM25、混合重排);设计动机详见附录B。在 LoCoMo(1540 个非对抗性问题)上的评估表明:检索方法是主导因素——不同检索方法间准确率相差20个百分点,而写入策略仅相差3–8个百分点。成本最低的写入方式(直接存储原始分块、无需调用LLM),效果与更昂贵的方法相当甚至更优。

一、研究背景:端到端评估的“致命缺陷”

此前对LLM Agent记忆系统的评估,大多只关注端到端准确率,这一单一指标无法拆解性能下降的真正原因:是存储阶段丢失了关键信息?是检索阶段没找到相关记忆?还是模型在生成阶段未能有效利用检索到的上下文?

同时,现有记忆系统的设计差异主要集中在写入策略上:

- 基础RAG. :直接存储原始对话片段,无需LLM调用;

- Mem0风格. :提取结构化事实并做冲突解决,每个会话至少1次LLM调用; 【抽取事实 】

- MemGPT风格:将每个会话压缩为总结段落,每个会话1次LLM调用。 【摘要会话 】

而检索方法则相对单一,主流以余弦相似度匹配为主,缺乏对不同检索策略与写入策略组合的系统性验证。为了厘清核心瓶颈,研究者设计了一套检索-生成边界的诊断框架,并开展了3×3的全因子对照实验。

二、核心实验设计:3种写入策略 × 3种检索方法

研究者的实验设计遵循严格控制变量原则,所有配置均使用GPT-5-mini作为base LLM、text-embedding-3-small作为嵌入模型,在LoCoMo长上下文对话记忆基准(1540个非对抗性问题)上完成评估,核心变量为3种写入策略和3种检索方法。

2.1 三类写入策略:从无成本原始存储到高成本有损压缩

覆盖了当前LLM Agent记忆存储的主流思路,核心差异在信息保留程度和计算成本:

| 写入策略 | 核心做法 | LLM调用成本 | 信息特征 |

|---|---|---|---|

| Basic RAG | 存储带说话人、时间戳的3轮原始对话片段 | 0 | 无信息丢失,保留完整上下文 |

| Extracted Facts | Mem0风格,提取会话独立事实+嵌入匹配+LLM冲突解决(ADD/UPDATE/NOOP) | ≥1次/会话 | 结构化,有损压缩,丢弃非事实细节 |

| Summarized Episodes | MemGPT风格,将每个会话压缩为单段总结 | 1次/会话 | 叙事化,有损压缩,词汇更密集 |

2.2 三类检索方法:从单一匹配到混合重排序,精度逐步提升

覆盖了语义匹配、词汇匹配和混合策略,核心差异在信号利用和检索精度,默认检索预算k=5:

- 余弦相似度:通过查询与存储条目嵌入的余弦距离返回Top-k,捕捉语义相似性,但易遗漏词汇不同的相关条目;

- BM25:基于词频的关键词重叠打分,补全词汇匹配,但对词汇不一致的相关记忆无效;

- Hybrid+Rerank(混合重排序):先融合余弦和BM25的Top-2k候选,再用GPT-5.2作为LLM裁判重排序至Top-k,1次/查询LLM调用,同时利用语义和词汇信号,解决两种检索的分歧。

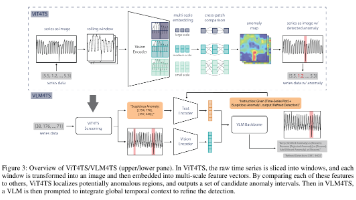

2.3 创新诊断框架:三个探针拆解记忆性能瓶颈

对于每个带有标准答案 a ∗ a^* a∗ 的问题 q q q,我们使用相同的大模型和提示模板,分别生成加入检索记忆(提示中包含 top‑k 记忆条目)的答案 a mem a_{\text{mem}} amem,以及不使用任何记忆的答案 a no a_{\text{no}} ano。随后我们执行三项诊断探测。

- 探测1(检索相关性):由大模型评判器判断每条检索到的记忆条目 m i m_i mi 是否包含回答问题 q q q 所需的相关信息;我们计算并报告检索精确率 @ k = ∣ { m i : r e l e v a n t } ∣ / k @k = |\{m_i:relevant\}| / k @k=∣{mi:relevant}∣/k。

- 探测2(记忆利用率):由大模型评判器将 a mem a_{\text{mem}} amem 和 a no a_{\text{no}} ano 与标准答案 a ∗ a^* a∗ 进行对比,并将每个问题归类为:有益(记忆提升了答案)、有害(记忆降低了答案质量)、忽略(答案未发生变化)或中性(答案发生变化但正确性不受影响)。

- 探测3(错误分类):针对错误答案,我们将失效情况分为三类:

- 检索失效:指系统在推理阶段未能提供足够信息来回答问题。这包括(i)相关信息存在于记忆库中但未被检索出来;(ii)存储的记忆本身不包含足以支撑回答的详细信息。我们将这两种情况都归为检索阶段失效,因为问题都出现在检索到生成的衔接环节;

- 利用失效【记忆利用实效】:指至少检索到一条相关记忆,但模型仍然生成错误答案,表明存在下游推理问题;

- 幻觉:指模型给出的答案与自身检索到的记忆内容直接矛盾,这类情况较为少见。

三、实验核心发现:检索主导性能,写入策略近乎“无关紧要”

实验结果颠覆了此前对LLM Agent记忆设计的认知,三个核心结论直指检索是记忆系统的核心瓶颈,而复杂写入策略的投入产出比极低。

3.1. 写入策略对性能的影响微乎其微,原始存储完胜高成本策略

![[图片]](https://i-blog.csdnimg.cn/direct/8901ab334c9a4e0c92d5ad9724d5cf1f.png#pic_center)

表1显示,在任意检索方法列内,写入策略仅带来3–8个百分点的准确率差异。基础RAG直接存储原始文本分块且无需调用LLM,在余弦检索下达到77.9%,在混合检索下达到81.1%,在所有检索方法中均与事实抽取、会话摘要两种策略持平或更优。唯一例外是BM25:会话摘要(62.7%)略高于基础RAG(59.2%),这可能是因为关键词检索更受益于压缩摘要带来的更密集词汇。总体来看,开销更高的写入策略并不划算:有损压缩会丢弃原本可被基座大模型直接利用的对话细节(图2)。

3.2. 检索方法是性能主导因素,准确率差异高达20个百分点

![[图片]](https://i-blog.csdnimg.cn/direct/505a6684d55b4eb2a1489c79b46551ce.png#pic_center)

更换检索方法会带来14–23个百分点的准确率变化,远超过写入策略的影响。混合重排在三种写入策略下平均准确率为77.2%,而余弦检索为73.4%,BM25仅57.1%。无论存储内容如何,混合检索与BM25之间都存在约20个百分点的差距,这证实:能否检索到正确的上下文,远比上下文如何格式化更重要。检索精确率与下游准确率近乎完美相关(r=0.98,图3),有力说明检索质量与最终性能的关联最强。我们还注意到,Token F1对这类准确率差异不敏感(20个百分点的差距仅对应0.221与0.168的区别),凸显了基于LLM评判的评估比表层重叠指标更重要。

3.3 失败分析:90%以上的错误源于检索失败,模型利用记忆的能力已足够强

![[图片]](https://i-blog.csdnimg.cn/direct/6b50436448b54d29b7987651c02791ae.png#pic_center)

表2和图4拆解了错误的实际来源。检索失效是最主要的错误类型,在不同配置下占所有问题的11%–46%。在BM25+事实抽取的组合中,仅检索失效就高达46.3%,几乎等于总错误率。混合重排能将检索失效大致减半(例如基础RAG从35.3%降至11.4%)。相比之下,无论配置如何,记忆利用失效稳定在4%–8%,幻觉仅0.4%–1.4%,说明只要提供相关上下文,大模型就能可靠地使用它。记忆利用探测也印证了这一点:在基础RAG+混合检索的组合中,有益比例达到79.0%,意味着只要检索质量好,模型有五分之四的概率能提升答案。这些结果一致指向同一结论:性能瓶颈大多出现在检索阶段,而非记忆利用阶段。

这一结果彻底回答了研究的核心问题:当前LLM Agent记忆系统的性能瓶颈,几乎完全出在检索阶段,而非写入或利用阶段。

![[表2:全部九种配置下的诊断探测结果(%)。探测1:检索精确率。探测2:记忆利用率。探测3:以占全部问题的百分比表示的错误模式(其余为正确)。详见3.3节。]](https://i-blog.csdnimg.cn/direct/18a9aef11ec84fabb0da83392fdfb6d4.png#pic_center)

四、研究结论与设计启示:重构记忆增强LLM Agent的研发优先级

研究者基于实验结果得出核心结论:现代LLM本身已具备强大的上下文推理能力,记忆增强型Agent的性能差异,更多来自信息的“选择(检索)”,而非信息的“表示(写入/存储)”。

这一结论为LLM Agent记忆系统的设计带来了三大关键启示:

- 放弃过度复杂的写入策略:事实提取、会话总结等有损压缩策略不仅增加计算成本,还会丢失关键上下文,零成本的原始对话片段存储是更优选择,除非受严格的上下文窗口限制而必须压缩;

- 将研发重心放在检索优化上:混合重排序、检索精度提升、查询理解优化、重排序机制设计,是提升记忆性能的最高效方向,远胜于在写入阶段的“内卷”;

- 优化检索-生成的衔接:既然模型能可靠利用相关记忆,那么后续研发应聚焦于如何让检索系统更精准地匹配用户查询,为生成阶段提供高质量的上下文。

五、研究局限性与未来方向

当然,本研究也存在一定的局限性,为后续研究留下了探索空间:

- 实验仅使用GPT-5-mini作为骨干LLM、LoCoMo作为基准,且检索预算固定为k=5,结论的通用性需在更多模型、数据集和检索预算下验证;

- 写入策略为基于提示的重实现,未涉及联合优化写入和检索的强化学习方法,这类方法的性能表现仍需探索;

- 原始存储的优势可能在更严格的上下文预算下减弱,此时压缩策略的设计需更注重“关键信息保留”而非单纯的“精简”;

- 所有评估均基于LLM裁判,虽经人类标注验证,但仍可能存在偏见,未来可结合更精细化的人类评估。

未来的研究方向也随之明确:探索更高效的混合检索与重排序机制、研究上下文预算受限下的高效无损压缩策略、开发联合优化检索与生成的记忆管理方法、构建更全面的记忆系统诊断基准。

六、总结

这篇研究为LLM Agent记忆系统的研发踩下了“刹车”——让研究者和工程师从“为了复杂而复杂”的写入策略设计中抽离,重新聚焦于记忆系统的核心需求:把正确的信息,在正确的时间,检索到模型面前。

在大模型技术快速迭代的今天,这样的“诊断性研究”尤为珍贵:它不追求新的模型或新的策略,而是通过严谨的实验拆解核心问题,为后续研发指明方向,避免行业在无效的方向上浪费资源。而对于实际应用而言,这一研究也带来了直接的工程价值:简化记忆写入流程,降低计算成本,将资源倾斜到检索优化,就能实现LLM Agent记忆性能的高效提升。

论文代码已开源:https://github.com/boqiny/memory-probe,感兴趣的开发者可直接复现实验并开展后续优化。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献3条内容

已为社区贡献3条内容

所有评论(0)