langchain v1.2新概念探索

目录

引子

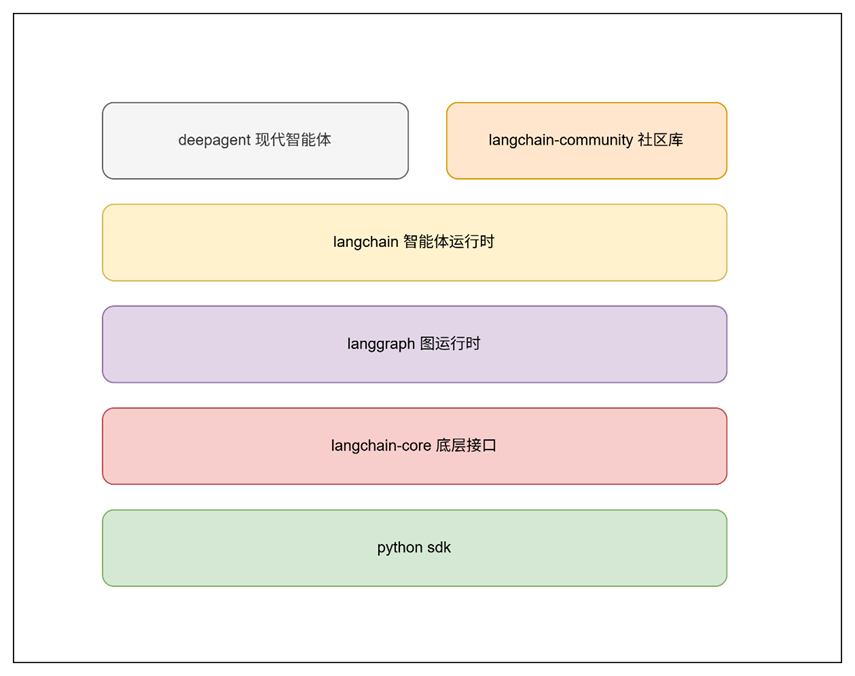

在 LangChain v1.0 刚刚发布时,我曾经写过一篇关于其新架构的分析。当时 LangChain 正在经历一次比较大的框架重构:Agent、Tool、Runtime 等概念被重新整理,LangGraph 也逐渐成为 Agent 运行时的核心基础设施。

不过,在那个时间点上,很多设计仍然处在快速演进阶段。不少 API 和概念还在不断调整,一些官方推荐的使用方式也并没有完全稳定下来。因此,当时的分析更多只能算是一次“阶段性观察”。

随着 LangChain 版本逐渐演进到 1.2,整个框架的核心理念开始变得更加清晰:

Agent 的运行模型、工具调用机制、状态管理方式以及可观测体系,都逐渐形成了一套相对完整的工程化思路。

因此,这篇文章并不是简单介绍 LangChain 的使用方法,而是尝试在 v1.2 的语境下重新审视 LangChain 的一些核心概念,看看在这段时间的迭代中:

- 哪些设计思路被保留下来了

- 哪些概念发生了演进

- LangChain 在 Agent 框架方向上到底想解决什么问题

如果你之前接触过 LangChain,或者正在设计自己的 Agent 系统,希望这次基于 LangChain v1.2 的再探索,能够帮助你更清晰地理解这个框架的整体架构。

Langchain更新日志

2026-03-10 langgraph v1.1

类型安全的流式输出(version=“v2”)

-

在

stream()/astream()中传入version="v2",即可获得统一的 StreamPart 输出结构。 -

每个数据块都包含以下字段:

typensdata

-

每种流式模式都有对应的

TypedDict类型定义,均可从langgraph.types导入。

类型安全的 invoke 调用(version=“v2”)

-

在

invoke()/ainvoke()中传入version="v2",返回一个 GraphOutput 对象:.value.interrupts

Pydantic 与 dataclass 自动转换

-

在

version="v2"模式下:invoke()返回结果values模式的 stream 输出

会自动转换为你声明的 Pydantic 模型或 dataclass 类型。

修复 time travel 与 interrupt / subgraph 的问题

- 回放(replay)不再复用旧的

RESUME值 - 子图(subgraph)现在可以正确恢复父图的历史 checkpoint

完全向后兼容

version="v2"为 可选功能(opt-in)GraphOutput仍支持 旧版 dict 风格访问,方便渐进迁移

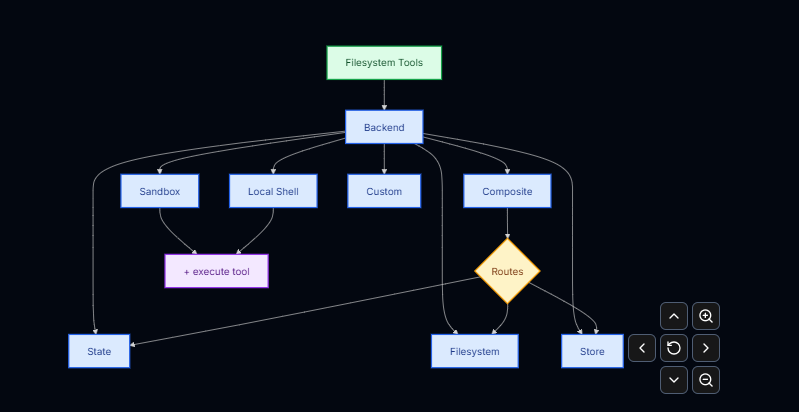

2026-02-10 deepagents v0.4

新增可插拔沙箱集成包

新增三个集成:

langchain-modallangchain-daytonalangchain-runloop

可用于可插拔的沙箱环境。

参考:

- sandboxes guide

- data analysis 示例教程

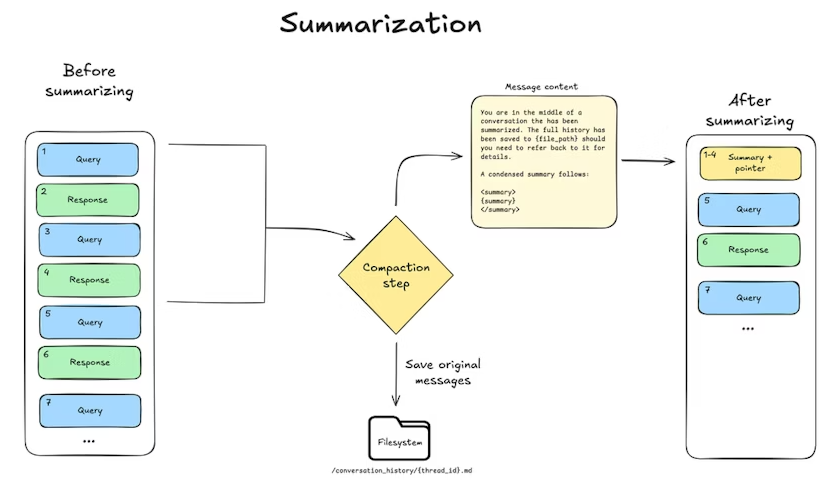

对会话历史总结机制的修改

- Summarization 现在在 model node 中通过

wrap_model_call事件触发 - 因此现在会 在 graph state 中保留完整的 message history

更准确的 Token 计算

自动触发上下文总结

如果模型抛出:

ContextOverflowError

将自动触发 summarization。

目前支持:

langchain-anthropiclangchain-openai

OpenAI Responses API 成为默认

当模型字符串以:

openai:

开头时,默认使用 Responses API。

2025-12-15 langchain v1.2.0

create_agent 改进

通过工具上的新属性 extras,简化对 provider-specific tool 参数与定义 的支持。

示例能力:

-

Provider 特定配置

- 如 Anthropic 的 programmatic tool calling

- tool search

-

客户端执行的内置工具

- Anthropic

- OpenAI

- 其他 provider 均支持

-

支持 严格 schema 的 agent 输出格式

2025-12-08 langchain-google-genai v4.0.0

Google GenAI 集成已被完全重写,现在使用 Google 的统一 Generative AI SDK。

新 SDK 同时支持:

- Gemini API

- Vertex AI Platform

通过同一接口访问。

变化包括:

- 少量 breaking change

langchain-google-vertexai中部分包被弃用

2025-11-25 langchain v1.1.0

Model Profiles

Chat Model 现在通过 .profile 属性暴露模型能力,例如:

- 支持的功能

- 能力列表

Summarization Middleware

- 支持更灵活的触发机制

- 可以结合 model profile 进行上下文感知总结

Structured Output

ProviderStrategy(原生结构化输出)现在可以通过 model profile 自动推断

create_agent 支持 SystemMessage

现在可以直接向 system_prompt 传入:

SystemMessage

支持:

- cache control

- structured content blocks

Model Retry Middleware

新增中间件:

- 自动重试失败的模型调用

- 支持可配置的 指数退避(exponential backoff)

内容审核 Middleware

新增 OpenAI 内容审核中间件,用于检测不安全内容:

支持检测:

- 用户输入

- 模型输出

- 工具执行结果

OK,接下来让我们看看Langchain又整了哪些花活出来。

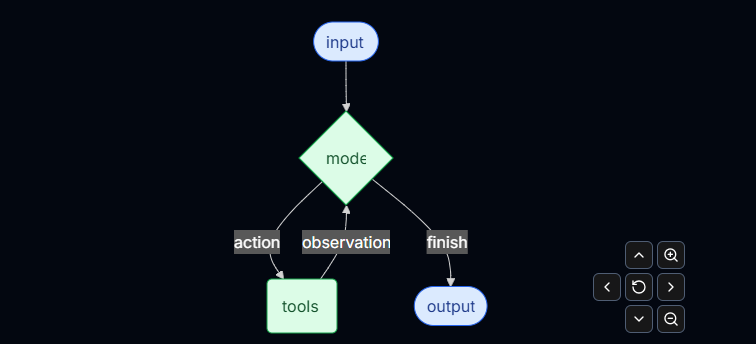

Agent Loop

一个 LLM Agent 会在一个循环中调用工具来完成目标任务。Agent 会持续运行,直到满足某个 停止条件,例如:

- 模型生成了最终输出(final output)

- 达到预设的迭代次数上限

其基本流程可以理解为:

即:

- 接收输入(input)

- 模型进行推理(model)

- 决定要执行的操作(action)

- 调用工具(tools)

- 获得工具返回结果(observation)

- 再次进行推理(model)

- 最终输出结果(finish)

create_agent 基于 LangGraph 构建了一个 图结构的 Agent 运行时(runtime)。

在这个图中:

- 节点(nodes) 表示执行步骤

- 边(edges) 表示步骤之间的连接关系

这些节点和连接共同定义了 Agent 如何处理信息以及执行任务流程。Agent 会在这个图结构中不断移动,并执行不同的节点,例如:

-

model node

调用语言模型进行推理 -

tools node

执行工具调用 -

middleware

在执行过程中进行拦截、增强或处理逻辑

LangGraph Runtime

Pregel 实现了 LangGraph 的运行时(runtime),负责管理 LangGraph 应用的执行。

当你:

- 编译一个 StateGraph

- 或创建一个

@entrypoint

时,最终都会生成一个 Pregel 实例,这个实例可以通过输入参数进行调用(invoke)。

注意:

Pregel runtime 的名称来源于 Google 的 Pregel 算法,该算法描述了一种利用图结构进行大规模并行计算的高效方法。

在 LangGraph 中,Pregel 将 Actor(执行单元) 和 Channel(通信通道) 组合成一个完整的应用。

基本机制是:

- Actor 从 Channel 读取数据

- Actor 向 Channel 写入数据

Pregel 会按照 Pregel Algorithm / Bulk Synchronous Parallel(BSP)模型,将应用执行组织成多个步骤(steps)。

每个步骤包含 三个阶段:

1.Plan(规划阶段):确定本步骤需要执行哪些 Actor。

例如:

- 第一步:选择订阅了 输入 channel 的 Actor

- 后续步骤:选择订阅了 上一轮更新过的 channel 的 Actor

2.Execution(执行阶段):并行执行所有选定的 Actor,直到:

- 所有 Actor 执行完成

- 某个 Actor 执行失败

- 达到超时时间

在此阶段:

- Actor 写入 channel 的数据 不会立即可见

- 这些更新 只会在下一步中生效

3.Update(更新阶段):将 Actor 在本步骤中写入的值 更新到对应的 Channel 中。

整个流程会不断重复,直到没有新的 Actor 需要执行或达到最大执行步数

Actors

Actor 在 LangGraph 中对应一个 PregelNode。它会订阅若干 Channel,从这些 Channel 中读取数据,并将结果写回到 Channel 中。

可以将其理解为 Pregel 算法中的计算节点(Actor)。在实现上,PregelNode 实现了 LangChain 的 Runnable 接口。

Channels

Channel 用于在 Actor(PregelNode)之间传递数据。每个 Channel 都包含三个核心要素:

- value type(值类型)

- update type(更新类型)

- update function(更新函数)

更新函数会接收一组更新,并据此修改 Channel 当前存储的值。

Channel 可以用于:

- 在不同 chain 之间传递数据

- 将数据在未来的执行步骤中再次发送给当前 chain

LangGraph 提供了多种内置 Channel 类型:

-

LastValue:默认的 Channel 类型,用于保存最近一次发送到该 Channel 的值。适合用于输入输出数据,或在不同执行步骤之间传递数据。

-

Topic:一种可配置的 发布-订阅(Pub/Sub)Topic。适合在 Actor 之间传递多个值,或用于累积输出结果。可以配置为对数据进行去重,或在多个步骤中持续累积数据。

-

BinaryOperatorAggregate:用于存储一个持续累积的值。每次更新时,会通过一个二元操作符,将当前值与新发送到 Channel 的更新值进行合并。适合用于跨多个步骤进行聚合计算,例如:

total = BinaryOperatorAggregate(int, operator.add)

示例1:单节点

大多数用户通常通过:

- StateGraph API

@entrypoint装饰器

来间接使用 Pregel,但实际上也可以 直接使用 Pregel API 构建应用。

下面是一个简单示例。

from langgraph.channels import EphemeralValue

from langgraph.pregel import Pregel, NodeBuilder

node1 = (

NodeBuilder().subscribe_only("a")

.do(lambda x: x + x)

.write_to("b")

)

app = Pregel(

nodes={"node1": node1},

channels={

"a": EphemeralValue(str),

"b": EphemeralValue(str),

},

input_channels=["a"],

output_channels=["b"],

)

app.invoke({"a": "foo"})

输出结果:

{'b': 'foofoo'}

这个示例的逻辑是:

node1订阅 channel a- 接收到数据后执行函数

lambda x: x + x - 将结果写入 channel b

- 输入

"foo",输出"foofoo"

示例2:多节点

代码中定义了两个节点:

- node1:订阅 Channel

a,将接收到的字符串进行一次拼接(x + x),并将结果写入 Channelb - node2:订阅 Channel

b,对其结果再次进行拼接(x + x),并将结果写入 Channelc

from langgraph.channels import LastValue, EphemeralValue

from langgraph.pregel import Pregel, NodeBuilder

node1 = (

NodeBuilder().subscribe_only("a")

.do(lambda x: x + x)

.write_to("b")

)

node2 = (

NodeBuilder().subscribe_only("b")

.do(lambda x: x + x)

.write_to("c")

)

接下来创建一个 Pregel 应用实例。在这个实例中:

nodes定义了参与执行的节点channels定义了各个 Channel 及其类型input_channels指定输入数据来源output_channels指定最终输出的 Channel

app = Pregel(

nodes={"node1": node1, "node2": node2},

channels={

"a": EphemeralValue(str),

"b": LastValue(str),

"c": EphemeralValue(str),

},

input_channels=["a"],

output_channels=["b", "c"],

)

其中:

- EphemeralValue 表示临时 Channel,仅在当前执行过程中使用

- LastValue 表示保存最近一次写入值的 Channel

最后调用 invoke 执行该流程:

app.invoke({"a": "foo"})

执行结果为:

{'b': 'foofoo', 'c': 'foofoofoofoo'}

执行过程可以理解为:

- 输入

"foo"写入 Channela - node1 读取

a→"foo"→ 处理后得到"foofoo"→ 写入b - node2 读取

b→"foofoo"→ 处理后得到"foofoofoofoo"→ 写入c

因此最终输出:

b = "foofoo"c = "foofoofoofoo"

示例3:Topic

下面的代码示例展示了 Topic 类型 Channel 的使用方式,用于在多个节点之间传递并累积多个结果。

代码中定义了两个节点:

- node1:订阅 Channel

a,将输入字符串进行一次拼接(x + x),并将结果同时写入 Channelb和c - node2:订阅 Channel

b,读取b中的数据并再次拼接(x["b"] + x["b"]),然后将结果写入 Channelc

from langgraph.channels import EphemeralValue, Topic

from langgraph.pregel import Pregel, NodeBuilder

node1 = (

NodeBuilder().subscribe_only("a")

.do(lambda x: x + x)

.write_to("b", "c")

)

node2 = (

NodeBuilder().subscribe_to("b")

.do(lambda x: x["b"] + x["b"])

.write_to("c")

)

随后创建一个 Pregel 应用实例:

app = Pregel(

nodes={"node1": node1, "node2": node2},

channels={

"a": EphemeralValue(str),

"b": EphemeralValue(str),

"c": Topic(str, accumulate=True),

},

input_channels=["a"],

output_channels=["c"],

)

其中:

a:使用 EphemeralValue,表示临时 Channelb:使用 EphemeralValue,用于在节点之间传递中间结果c:使用 Topic 类型 Channel,并设置accumulate=True,表示该 Channel 会 累积多个结果值

最后执行:

app.invoke({"a": "foo"})

执行结果:

{'c': ['foofoo', 'foofoofoofoo']}

执行过程可以理解为:

- 输入

"foo"写入 Channela - node1 读取

a→"foo"→ 处理后得到"foofoo"→ 写入b和c - node2 读取

b→"foofoo"→ 处理后得到"foofoofoofoo"→ 写入c - 由于

c是 Topic(accumulate=True),因此会累积所有写入结果

最终 c 中保存:

['foofoo', 'foofoofoofoo']

示例4:BinaryOperatorAggregate

该示例演示了如何使用 BinaryOperatorAggregate Channel 来实现一个 reducer(聚合函数)。

from langgraph.channels import EphemeralValue, BinaryOperatorAggregate

from langgraph.pregel import Pregel, NodeBuilder

首先定义两个节点:

- node1:订阅 Channel

a,将输入字符串进行拼接(x + x),并将结果写入 Channelb和c - node2:订阅 Channel

b,对其结果再次拼接(x + x),并将结果写入 Channelc

node1 = (

NodeBuilder().subscribe_only("a")

.do(lambda x: x + x)

.write_to("b", "c")

)

node2 = (

NodeBuilder().subscribe_only("b")

.do(lambda x: x + x)

.write_to("c")

)

接着定义一个 reducer 函数,用于指定 Channel c 在接收到多个更新值时如何进行合并:

def reducer(current, update):

if current:

return current + " | " + update

else:

return update

该函数的逻辑是:

- 如果 Channel 中已经存在值,则使用

" | "将新值追加到后面 - 如果当前还没有值,则直接返回新值

然后创建 Pregel 应用实例:

app = Pregel(

nodes={"node1": node1, "node2": node2},

channels={

"a": EphemeralValue(str),

"b": EphemeralValue(str),

"c": BinaryOperatorAggregate(str, operator=reducer),

},

input_channels=["a"],

output_channels=["c"],

)

其中:

a:使用 EphemeralValue,用于输入数据b:使用 EphemeralValue,用于中间数据传递c:使用 BinaryOperatorAggregate,并指定reducer作为聚合函数

最后执行:

app.invoke({"a": "foo"})

执行流程为:

- 输入

"foo"写入 Channela - node1 读取

a→"foo"→ 处理后得到"foofoo"→ 写入b和c - node2 读取

b→"foofoo"→ 处理后得到"foofoofoofoo"→ 写入c - Channel

c使用 reducer 对多个更新值进行聚合

最终 c 的结果为:

foofoo | foofoofoofoo

示例5:Cycle

该示例演示了如何在 图(graph)中引入循环(cycle):让一个节点将结果写回到它自己订阅的 Channel 中。这样,执行过程会不断循环,直到某次写入的值为 None 时才停止。

from langgraph.channels import EphemeralValue

from langgraph.pregel import Pregel, NodeBuilder, ChannelWriteEntry

首先定义一个节点:

- 订阅 Channel

value - 如果字符串长度小于 10,就执行

x + x(字符串翻倍) - 如果长度已经达到或超过 10,则返回

None

example_node = (

NodeBuilder().subscribe_only("value")

.do(lambda x: x + x if len(x) < 10 else None)

.write_to(ChannelWriteEntry("value", skip_none=True))

)

这里的关键点是:

write_to("value")会把结果重新写回 同一个 Channelskip_none=True表示如果结果为None,则不会写入 Channel

这样就不会再触发下一轮执行,从而结束循环

接着创建一个 Pregel 应用实例:

app = Pregel(

nodes={"example_node": example_node},

channels={

"value": EphemeralValue(str),

},

input_channels=["value"],

output_channels=["value"],

)

其中:

value使用 EphemeralValue,作为输入和输出的 Channel

最后执行:

app.invoke({"value": "a"})

执行过程大致如下:

"a"→"aa""aa"→"aaaa""aaaa"→"aaaaaaaa""aaaaaaaa"→"aaaaaaaaaaaaaaaa"- 此时长度 ≥ 10,返回

None,循环停止

最终输出:

{'value': 'aaaaaaaaaaaaaaaa'}

StateGraph(Graph API)

StateGraph(Graph API) 是一种更高层的抽象,用于简化 Pregel 应用的构建过程。

通过该 API,可以定义一个由 节点(nodes) 和 边(edges) 组成的图结构。

当图被 编译(compile) 时,StateGraph API 会自动为你生成对应的 Pregel 应用实例。

from typing import TypedDict

from langgraph.constants import START

from langgraph.graph import StateGraph

首先定义一个状态结构 Essay:

class Essay(TypedDict):

topic: str

content: str | None

score: float | None

然后定义两个处理节点:

def write_essay(essay: Essay):

return {

"content": f"Essay about {essay['topic']}",

}

def score_essay(essay: Essay):

return {

"score": 10

}

接下来创建一个 StateGraph:

builder = StateGraph(Essay)

builder.add_node(write_essay)

builder.add_node(score_essay)

builder.add_edge(START, "write_essay")

builder.add_edge("write_essay", "score_essay")

最后对图进行编译:

graph = builder.compile()

编译完成后,这个 Pregel 实例会包含一组 节点(nodes) 和 Channel。

可以通过打印它们进行查看。

print(graph.nodes)

可能会看到类似输出:

{

'__start__': <langgraph.pregel.read.PregelNode ...>,

'write_essay': <langgraph.pregel.read.PregelNode ...>,

'score_essay': <langgraph.pregel.read.PregelNode ...>

}

说明 Graph API 会自动创建:

__start__节点write_essay节点score_essay节点

同样可以查看 Channel:

print(graph.channels)

可能会看到类似输出:

{

'topic': <LastValue ...>,

'content': <LastValue ...>,

'score': <LastValue ...>,

'__start__': <EphemeralValue ...>,

'write_essay': <EphemeralValue ...>,

'score_essay': <EphemeralValue ...>,

...

}

这些 Channel 包括:

-

状态字段对应的 Channel

topiccontentscore

-

节点之间通信使用的 Channel

__start__write_essayscore_essay- 以及内部自动生成的

branchChannel

这些 Channel 由 StateGraph 在编译时自动创建,用于实现节点之间的数据传递。

create_agent

create_agent 提供了一个 可用于生产环境的 Agent 实现。

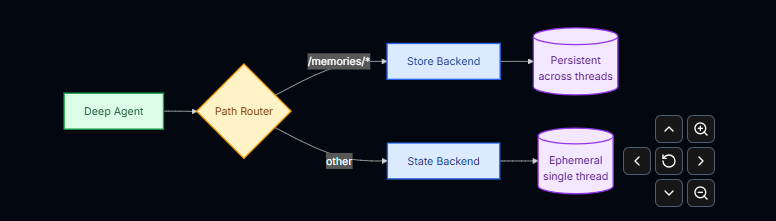

上面我们知道langgraph实现了langchain-core的Runable协议,并且提供了一个图运行时,该运行时可以将输入,输出,节点,状态转换串联起来,而langchain基于langgraph构建,其底层必然是一个图结构,这里就从源码开始入手解析create_agent是如何构建这个图结构的:

def create_agent(

model: str | BaseChatModel,

tools: Sequence[BaseTool | Callable[..., Any] | dict[str, Any]] | None = None,

*,

system_prompt: str | SystemMessage | None = None,

middleware: Sequence[AgentMiddleware[StateT_co, ContextT]] = (),

response_format: ResponseFormat[ResponseT] | type[ResponseT] | dict[str, Any] | None = None,

state_schema: type[AgentState[ResponseT]] | None = None,

context_schema: type[ContextT] | None = None,

checkpointer: Checkpointer | None = None,

store: BaseStore | None = None,

interrupt_before: list[str] | None = None,

interrupt_after: list[str] | None = None,

debug: bool = False,

name: str | None = None,

cache: BaseCache[Any] | None = None,

) -> CompiledStateGraph[

AgentState[ResponseT], ContextT, _InputAgentState, _OutputAgentState[ResponseT]

]:

我们快速构建一个agent,然后输出其channels和nodes:

from langchain.agents import create_agent

from langchain_openai import ChatOpenAI

from langchain.tools import tool

from pydantic import SecretStr

from pprint import pprint as print

@tool

def add(a:int, b:int) -> int:

"""

Add two integers

"""

return a + b

agent = create_agent(

system_prompt="你是一个有用的助手",

tools=[add],

model=ChatOpenAI(

model="deepseek-ai/DeepSeek-R1-Distill-Qwen-7B",

base_url="https://api.siliconflow.cn/v1",

api_key=SecretStr("****")

)

)

if __name__ == '__main__':

print("-"*20+"nodes"+"-"*20)

print(agent.nodes)

print("-" * 20 + "channels" + "-" * 20)

print(agent.channels)

'--------------------nodes--------------------'

{'__start__': <langgraph.pregel._read.PregelNode object at 0x000001D65A3BDBE0>,

'model': <langgraph.pregel._read.PregelNode object at 0x000001D65A24FC50>,

'tools': <langgraph.pregel._read.PregelNode object at 0x000001D65A24FED0>}

'--------------------channels--------------------'

{'__pregel_tasks': <langgraph.channels.topic.Topic object at 0x000001D65A1A7400>,

'__start__': <langgraph.channels.ephemeral_value.EphemeralValue object at 0x000001D65A0FD540>,

'branch:to:model': <langgraph.channels.ephemeral_value.EphemeralValue object at 0x000001D65A44BCC0>,

'branch:to:tools': <langgraph.channels.ephemeral_value.EphemeralValue object at 0x000001D65A475280>,

'jump_to': <langgraph.channels.ephemeral_value.EphemeralValue object at 0x000001D65A44B040>,

'messages': <langgraph.channels.binop.BinaryOperatorAggregate object at 0x000001D65A44AF00>,

'structured_response': <langgraph.channels.last_value.LastValue object at 0x000001D65A44B2C0>}

这个输出其实非常有价值,因为它把 create_agent() 在 LangGraph Runtime(Pregel)层面真实构建出来的 Graph暴露出来了。我们逐层拆一下。

nodes:Agent 实际是 3 个 PregelNode

{'__start__': PregelNode,

'model': PregelNode,

'tools': PregelNode}

说明 Agent Graph 非常简单:

START

↓

model

↓

tools

↓

model

↓

...

循环执行直到模型停止调用 tool。

-

__start__这是 Graph API 自动生成的 起始节点。

作用:

输入 state ↓ 触发 model类似:

START → model -

model这是 LLM 调用节点。

职责:

messages ↓ LLM ↓ AIMessage如果模型输出:

tool_calls就跳转:

model → tools否则结束。

3 tools

这是 **工具执行节点**。

职责:

```

读取 AIMessage.tool_calls

↓

执行 tool

↓

生成 ToolMessage

```

然后再把 ToolMessage 写回:

```

messages

```

再回到:

```

tools → model

```

所以 Agent Loop 是:

```

model → tools → model → tools ...

```

channels:Agent 的 State

{

'__pregel_tasks': Topic,

'__start__': EphemeralValue,

'branch:to:model': EphemeralValue,

'branch:to:tools': EphemeralValue,

'jump_to': EphemeralValue,

'messages': BinaryOperatorAggregate,

'structured_response': LastValue

}

这些其实就是 Graph State + Runtime Control Channels。

我们分两类看。

-

messagesmessages: BinaryOperatorAggregate这是 最核心的 channel。

因为 Agent State 是:

messages: list[BaseMessage]但 Pregel 是 step-based execution,所以要用 reducer。

这里使用:

BinaryOperatorAggregate作用是:

messages = messages + new_messages类似 reducer:

state.messages.append(...)所以执行流程:

HumanMessage ↓ AIMessage ↓ ToolMessage ↓ AIMessage全部累计在

messages里。 -

structured_responsestructured_response: LastValue只有当你使用:

response_format=...才会真正用到。

作用:

最终结构化输出LastValue表示:只保留最后一次写入

Runtime 控制 channels

这些是 LangGraph 内部控制执行流的 channel。

-

__pregel_tasksTopic这是 Pregel runtime 用来调度 下一轮执行任务 的。

类似:

scheduler queue -

branch:to:modelEphemeralValue用于:

触发 model node类似:

edge → model -

branch:to:toolsEphemeralValue触发:

model → tools当 LLM 生成 tool_calls。

-

jump_toEphemeralValue用于:

动态跳转节点例如:

middleware interrupt resume都会用这个。

-

__start__Graph start signal。

invoke() ↓ 写入 __start__ ↓ 触发 model

完整执行流程

根据这些 node + channel,可以推导完整运行过程:

invoke()

↓

__start__ channel

↓

branch:to:model

↓

model node

↓

LLM output

↓

messages reducer

↓

如果有 tool_calls

↓

branch:to:tools

↓

tools node

↓

ToolMessage

↓

messages reducer

↓

branch:to:model

循环:

model → tools → model

直到:

没有 tool_calls

结束。

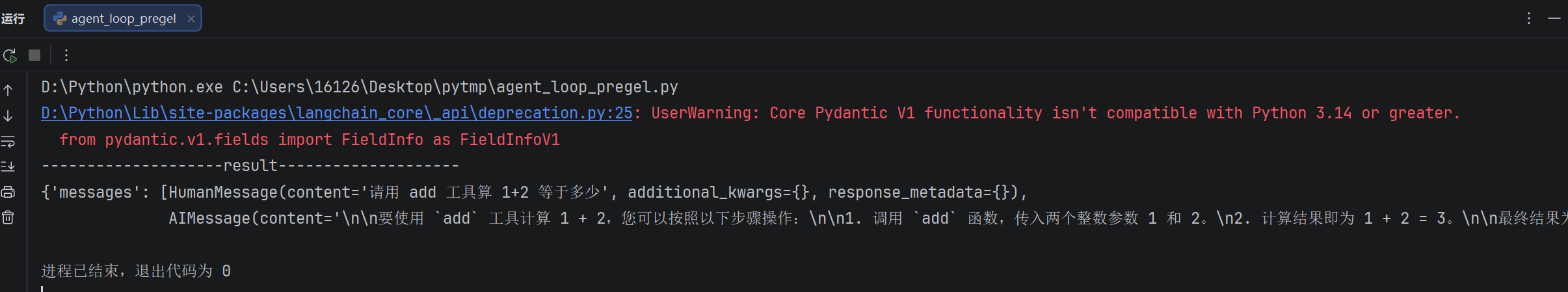

为了加深对create_agent的理解,现在使用低级API来模仿实现一个Agent Loop:

"""

基于 LangGraph Pregel + NodeBuilder 完全手写实现的 Agent Loop。

与官方 create_agent 编译后的结构对齐:

- nodes: __start__, model, tools

- channels: messages, branch:to:model, branch:to:tools, jump_to, structured_response 等

"""

from langgraph.pregel import Pregel, NodeBuilder

from langgraph.pregel._write import ChannelWriteEntry

from langgraph.channels import (

EphemeralValue,

BinaryOperatorAggregate,

LastValue,

)

from langchain_openai import ChatOpenAI

from langchain.tools import tool

from langchain_core.messages import (

AIMessage,

HumanMessage,

SystemMessage,

ToolMessage,

AnyMessage,

)

from pydantic import SecretStr

# ---------------------------------------------------------------------------

# 工具定义

# ---------------------------------------------------------------------------

@tool

def add(a: int, b: int) -> int:

"""Add two integers."""

return a + b

TOOLS_BY_NAME = {"add": add}

# ---------------------------------------------------------------------------

# 模型

# ---------------------------------------------------------------------------

LLM = ChatOpenAI(

model="deepseek-ai/DeepSeek-R1-Distill-Qwen-7B",

base_url="https://api.siliconflow.cn/v1",

api_key=SecretStr("sk-qluvqlqupbpcoirxikfukgtmiiovvcpjxxyzhytizbntsxvq"),

)

LLM_BOUND = LLM.bind_tools([add])

SYSTEM_PROMPT = "你是一个有用的助手,在涉及数学计算时请调用 add 工具。"

# ---------------------------------------------------------------------------

# messages 通道的 reducer:累加消息列表

# ---------------------------------------------------------------------------

def messages_reducer(current: list[AnyMessage] | None, update: list[AnyMessage] | None):

if update is None:

return current or []

if current is None:

return list(update) if update else []

return current + list(update)

# ---------------------------------------------------------------------------

# __start__ 节点:仅在「尚无 AI 回复」时写入 branch:to:model,触发首轮 model

# ---------------------------------------------------------------------------

def start_node(messages: list[AnyMessage] | None) -> dict:

if not messages:

return {"branch:to:model": True}

if any(isinstance(m, AIMessage) for m in messages):

return {}

return {"branch:to:model": True}

def _write_branch_to_model(out: dict):

v = out.get("branch:to:model")

return v if v is not None else (object() if "branch:to:model" in out else None) # skip_none 只跳过 None

start_node_builder = (

NodeBuilder()

.subscribe_only("messages")

.do(start_node)

.write_to(ChannelWriteEntry("branch:to:model", skip_none=True, mapper=lambda o: o.get("branch:to:model")))

)

# ---------------------------------------------------------------------------

# model 节点:订阅 branch:to:model,读取 messages,调用 LLM,写 messages 和可选的 branch:to:tools

# ---------------------------------------------------------------------------

def call_model(data: dict) -> dict:

messages: list[AnyMessage] = data.get("messages") or []

if not messages:

return {}

with_system = [SystemMessage(content=SYSTEM_PROMPT)] + list(messages)

response: AIMessage = LLM_BOUND.invoke(with_system)

out = {"messages": [response]}

if response.tool_calls:

out["branch:to:tools"] = True

return out

model_node_builder = (

NodeBuilder()

.subscribe_to("branch:to:model", read=True)

.read_from("messages")

.do(call_model)

.write_to(

ChannelWriteEntry("messages", mapper=lambda o: o.get("messages")),

ChannelWriteEntry("branch:to:tools", skip_none=True, mapper=lambda o: o.get("branch:to:tools")),

)

)

# ---------------------------------------------------------------------------

# tools 节点:订阅 branch:to:tools,读取 messages,执行 tool_calls,写 messages 和 branch:to:model

# ---------------------------------------------------------------------------

def call_tools(data: dict) -> dict:

messages: list[AnyMessage] = data.get("messages") or []

if not messages:

return {}

last = messages[-1]

if not isinstance(last, AIMessage) or not last.tool_calls:

return {}

tool_messages = []

for tc in last.tool_calls:

name = tc["name"]

args = tc.get("args") or {}

tool_fn = TOOLS_BY_NAME.get(name)

if not tool_fn:

tool_messages.append(

ToolMessage(content=f"Unknown tool: {name}", tool_call_id=tc["id"])

)

continue

result = tool_fn.invoke(args)

tool_messages.append(

ToolMessage(content=str(result), tool_call_id=tc["id"])

)

return {

"messages": tool_messages,

"branch:to:model": True,

}

tools_node_builder = (

NodeBuilder()

.subscribe_to("branch:to:tools", read=True)

.read_from("messages")

.do(call_tools)

.write_to(

ChannelWriteEntry("messages", mapper=lambda o: o.get("messages")),

ChannelWriteEntry("branch:to:model", mapper=lambda o: o.get("branch:to:model")),

)

)

# ---------------------------------------------------------------------------

# 构建 Pregel 图(对齐官方 channels / nodes 命名)

# ---------------------------------------------------------------------------

app = Pregel(

nodes={

"__start__": start_node_builder.build(),

"model": model_node_builder.build(),

"tools": tools_node_builder.build(),

},

channels={

"messages": BinaryOperatorAggregate(list, operator=messages_reducer),

"branch:to:model": EphemeralValue(bool),

"branch:to:tools": EphemeralValue(bool),

"jump_to": EphemeralValue(str),

"structured_response": LastValue(str),

},

input_channels=["messages"],

output_channels=["messages"],

)

# ---------------------------------------------------------------------------

# 运行

# ---------------------------------------------------------------------------

if __name__ == "__main__":

from pprint import pprint

result = app.invoke({

"messages": [

HumanMessage(content="请用 add 工具算 1+2 等于多少"),

]

})

pprint(result)

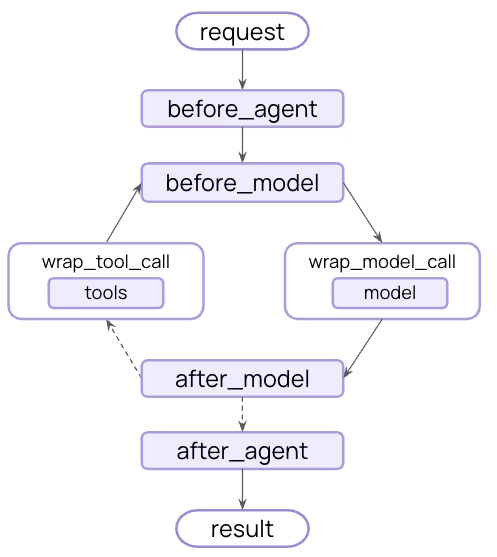

中间件

Middleware(中间件)提供了一种方式,可以 更精细地控制 Agent 内部发生的事情。中间件在以下场景中非常有用:

- 通过 日志、分析和调试 来跟踪 Agent 的行为

- 修改或转换 Prompt、工具选择以及输出格式

- 添加 重试(retry)、回退(fallback)和提前终止(early termination) 的逻辑

- 实施 速率限制(rate limit)、安全护栏(guardrails)以及 PII(敏感信息)检测

Agent 的核心循环包括以下步骤:

- 调用模型(Model)

- 让模型决定要执行哪些工具(Tools)

- 执行工具

- 如果模型不再调用任何工具,则结束

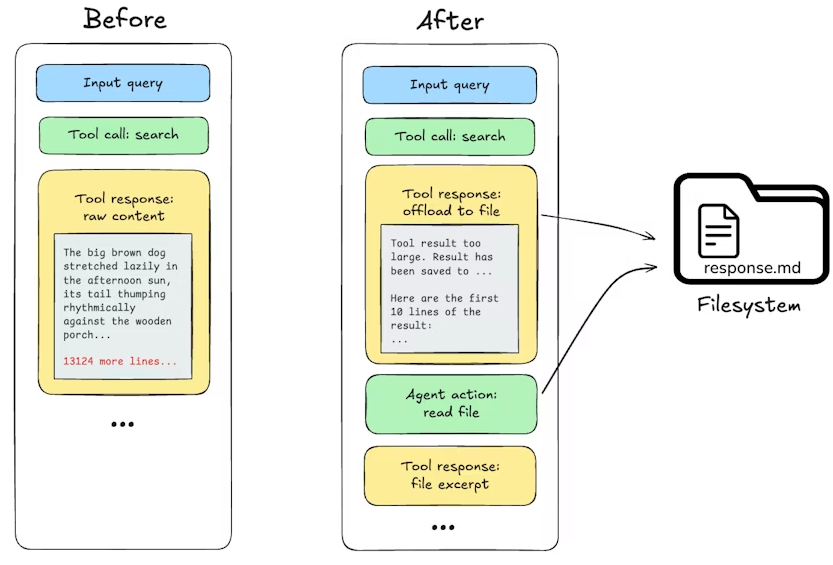

这张图片需要记住:

Middleware 可以在这些步骤 前后插入 Hook,从而对整个流程进行干预或增强。

Hooks

可以通过实现 Hook(钩子) 来构建自定义 Middleware,这些 Hook 会在 Agent 执行流程的特定阶段 被触发。

Middleware 提供两种类型的 Hook,用于拦截和控制 Agent 的执行流程:

Node 风格 Hook(Node-style hooks)

在 特定执行阶段按顺序运行。

常见用途:

- 日志记录(logging)

- 数据校验(validation)

- 状态更新(state updates)

可用 Hook

-

before_agent

在 Agent 开始执行之前触发(每次调用只执行一次) -

before_model

在每一次调用模型之前触发 -

after_model

在每一次模型返回结果之后触发 -

after_agent

在 Agent 执行结束之后触发(每次调用只执行一次)

示例(推荐:类写法)

from langchain.agents.middleware import AgentMiddleware, AgentState, hook_config

from langchain.messages import AIMessage

from langgraph.runtime import Runtime

from typing import Any

class MessageLimitMiddleware(AgentMiddleware):

def __init__(self, max_messages: int = 50):

super().__init__()

self.max_messages = max_messages

@hook_config(can_jump_to=["end"])

def before_model(

self,

state: AgentState,

runtime: Runtime

) -> dict[str, Any] | None:

if len(state["messages"]) >= self.max_messages:

return {

"messages": [AIMessage("Conversation limit reached.")],

"jump_to": "end"

}

return None

def after_model(

self,

state: AgentState,

runtime: Runtime

) -> dict[str, Any] | None:

print(f"Model returned: {state['messages'][-1].content}")

return None

这个 Middleware 实现了两个功能:

1️⃣ 对话长度限制

- 在

before_model阶段检查messages - 如果消息数量超过设定值

- 直接返回

"jump_to": "end"提前结束 Agent

2️⃣ 模型返回日志

- 在

after_model阶段打印模型输出 - 方便调试或记录日志

Wrap 风格 Hook(Wrap-style hooks)

Wrap-style Hook 会 包裹(wrap)模型调用或工具调用。

适合用于:

- 重试机制(retry)

- 缓存(caching)

- 输入输出转换(transformation)

与 Node-style Hook 的区别是:

你可以控制 handler 被调用的次数:

- 0 次 → 直接短路(short-circuit)

- 1 次 → 正常执行

- 多次 → 实现重试逻辑

可用 Hook:

-

wrap_model_call

包裹每一次模型调用 -

wrap_tool_call

包裹每一次工具调用

示例(推荐:类写法)

from langchain.agents.middleware import AgentMiddleware, ModelRequest, ModelResponse

from typing import Callable

class RetryMiddleware(AgentMiddleware):

def __init__(self, max_retries: int = 3):

super().__init__()

self.max_retries = max_retries

def wrap_model_call(

self,

request: ModelRequest,

handler: Callable[[ModelRequest], ModelResponse],

) -> ModelResponse:

for attempt in range(self.max_retries):

try:

return handler(request)

except Exception as e:

if attempt == self.max_retries - 1:

raise

print(f"Retry {attempt + 1}/{self.max_retries} after error: {e}")

这个 Middleware 实现了 模型调用自动重试:

-

每次模型调用都会被

wrap_model_call包裹 -

如果调用失败:

- 自动重试

- 最多重试

max_retries次

-

最后一次仍然失败则抛出异常

两类Hock的区别

AgentMiddleware 接口实际上定义了所有 Hook 方法,因此从 底层实现角度 来看,并不存在严格的 “Hook 类型” 或 “Middleware 类型” 的区分。无论是 Node-style 还是 Wrap-style,本质上都是在 Agent 执行流程中的某个阶段插入自定义逻辑。

不过在设计和文档层面,LangChain 仍然将其划分为两类,这样做主要有两个原因:

-

功能解耦

将 Middleware 按执行模式划分,可以让开发者更容易理解各类逻辑的职责边界。例如日志记录、状态检查等逻辑适合放在 Node-style Hook 中,而重试、缓存、调用拦截等逻辑则更适合使用 Wrap-style Hook。这种划分能够使 Middleware 的职责更加清晰,避免在同一逻辑中混杂过多不同类型的控制行为。 -

执行语义不同

两类 Hook 在执行方式上存在明显差异。Node-style Hook 是在固定节点按顺序执行的,它们更像是 Agent 流程中的“生命周期回调”;而 Wrap-style Hook 则是包裹在模型或工具调用外部,通过接管handler来控制实际执行过程。开发者可以决定是否调用handler、调用几次,甚至完全替换执行逻辑,因此具有更强的控制能力。

简单来说,Node-style Hook 更侧重于 在流程节点上扩展行为,而 Wrap-style Hook 更侧重于 拦截并控制具体调用过程。这种区分并不是底层强制的,而是为了让 Middleware 的使用方式更加清晰和可维护。

还记得之前的动态替换模型的中间件吗,

from langchain_openai import ChatOpenAI

from langchain.agents import create_agent

from langchain.agents.middleware import wrap_model_call, ModelRequest, ModelResponse

basic_model = ChatOpenAI(model="gpt-4.1-mini")

advanced_model = ChatOpenAI(model="gpt-4.1")

@wrap_model_call

def dynamic_model_selection(request: ModelRequest, handler) -> ModelResponse:

"""Choose model based on conversation complexity."""

message_count = len(request.state["messages"])

if message_count > 10:

# Use an advanced model for longer conversations

model = advanced_model

else:

model = basic_model

return handler(request.override(model=model))

这里实现 @wrap_model_call 的目的,其实就是 “狸猫换太子”——在真正调用模型之前,动态替换掉原本要使用的模型实例。

之所以必须使用 Wrap-style Hook,是因为它可以直接拦截模型调用,并拿到当前的 ModelRequest。开发者可以在这个阶段:

- 修改请求参数

- 替换模型实例

- 修改 Prompt

- 或者直接短路调用

在这个例子中,中间件通过读取 request.state["messages"] 的长度来判断当前对话复杂度,然后使用 request.override(model=model) 替换实际调用的模型。

最终流程实际上变成了:

Agent -> wrap_model_call -> 选择模型 -> handler() -> 实际调用模型

如果使用 Node-style Hook(例如 before_model)其实也能读取状态,但它 无法直接控制模型调用本身,只能通过返回新的 state 来影响后续流程。因此像 模型切换、调用重试、缓存命中、请求改写 这类需要拦截调用的逻辑,更适合使用 Wrap-style Hook。

换句话说:

- Node-style Hook 更像是 Agent 生命周期中的“观察点”和“修正点”

- Wrap-style Hook 更像是对关键调用过程的“拦截器”或“代理层”

因此在实际开发中,一个复杂的 Agent 系统往往会同时使用两种 Middleware:

- Node-style 用于 监控与流程控制,而 Wrap-style 用于 调用层面的增强与接管。

状态更新(State updates)

无论是 Node-style Hook 还是 Wrap-style Hook,都可以对 Agent 的状态(state)进行更新。不过两者的实现机制有所不同。

Node-style Hook

(before_agent、before_model、after_model、after_agent)

- 直接 返回一个 dict

- 这个 dict 会通过图(graph)的 reducers 合并到 Agent 的状态中

Wrap-style Hook

(wrap_model_call、wrap_tool_call)

- 在模型调用时,需要返回

ExtendedModelResponse - 同时通过

Command注入状态更新 - 在工具调用时,可以 直接返回

Command

这种方式适用于以下场景:

- 在模型调用过程中统计使用情况(usage metadata)

- 在某些触发点进行总结(summarization)

- 根据请求或响应计算新的状态字段

- 记录自定义信息

Node-style Hook 更新状态

Node-style Hook 只需要返回一个 dict,其中的 key 会映射到 Agent 的 state 字段。

from langchain.agents.middleware import after_model, AgentState

from langgraph.runtime import Runtime

from typing import Any

from typing_extensions import NotRequired

class TrackingState(AgentState):

model_call_count: NotRequired[int]

@after_model(state_schema=TrackingState)

def increment_after_model(

state: TrackingState,

runtime: Runtime

) -> dict[str, Any] | None:

return {

"model_call_count": state.get("model_call_count", 0) + 1

}

这个示例实现的逻辑是:

- 每次模型调用完成后

model_call_count自动加 1- 最终统计 Agent 总共调用了多少次模型

Wrap-style Hook 更新状态

在 wrap_model_call 中,需要返回 ExtendedModelResponse,并使用 Command 注入状态更新。

from typing import Callable

from langchain.agents.middleware import (

wrap_model_call,

ModelRequest,

ModelResponse,

AgentState,

ExtendedModelResponse

)

from langgraph.types import Command

from typing_extensions import NotRequired

class UsageTrackingState(AgentState):

"""带 token 使用统计的 Agent state"""

last_model_call_tokens: NotRequired[int]

@wrap_model_call(state_schema=UsageTrackingState)

def track_usage(

request: ModelRequest,

handler: Callable[[ModelRequest], ModelResponse],

) -> ExtendedModelResponse:

response = handler(request)

return ExtendedModelResponse(

model_response=response,

command=Command(

update={"last_model_call_tokens": 150}

),

)

在这个例子中:

- 先调用

handler(request)执行真实模型调用 - 然后通过

Command更新 Agent 状态 - 最终返回

ExtendedModelResponse

Command 会通过 Graph 的 reducer 机制 合并到状态中,因此:

- state 更新是 正确合并的

messages这类字段是 追加(additive) 而不是覆盖

多 Middleware 组合(Composition)

当多个 Middleware 同时返回 ExtendedModelResponse 时,它们的 Command 会自动组合。

合并规则:

1️⃣ 通过 reducer 合并

每个 Command 都会被当作一次独立的 state 更新。

对于 messages 这种字段:

- 更新是 追加的

- 不会覆盖之前的消息

2️⃣ 冲突时外层优先(Outer wins)

对于没有 reducer 的普通字段:

- 更新顺序是 inner → outer

- 如果 key 冲突,最外层 Middleware 的值会覆盖内部值

3️⃣ 支持重试安全(Retry-safe)

如果外层 Middleware 存在 重试逻辑(例如多次调用 handler()):

- 只有 最终成功的那一次调用 的

Command会被保留 - 之前失败调用产生的更新会被丢弃

示例:多 Middleware 组合

from typing import Annotated, Callable

from langchain.agents.middleware import (

AgentMiddleware,

AgentState,

ExtendedModelResponse,

ModelRequest,

ModelResponse,

)

from langchain.messages import SystemMessage

from langgraph.types import Command

from typing_extensions import NotRequired

定义 reducer:

def _last_wins(_a: str, b: str) -> str:

"""Reducer:最后写入者生效(outer 覆盖 inner)"""

return b

定义 Agent state:

class CustomMiddlewareState(AgentState):

"""

Agent state:

trace_layer 使用 last-wins reducer

messages 使用追加 reducer

"""

trace_layer: NotRequired[Annotated[str, _last_wins]]

class OuterMiddleware(AgentMiddleware):

def wrap_model_call(

self,

request: ModelRequest,

handler: Callable[[ModelRequest], ModelResponse],

) -> ExtendedModelResponse:

response = handler(request)

return ExtendedModelResponse(

model_response=response,

command=Command(update={

"trace_layer": "outer",

"messages": [SystemMessage(content="[Outer ran]")],

}),

)

class InnerMiddleware(AgentMiddleware):

"""

同样写入 trace_layer 和 messages

规则:

trace_layer → outer 覆盖 inner

messages → 追加

"""

def wrap_model_call(

self,

request: ModelRequest,

handler: Callable[[ModelRequest], ModelResponse],

):

response = handler(request)

return ExtendedModelResponse(

model_response=response,

command=Command(update={

"trace_layer": "inner",

"messages": [SystemMessage(content="[Inner ran]")],

}),

)

假设两个 Middleware 同时执行:

-

trace_layerinner → outer最终值为:

outer -

messages[Inner ran] [Outer ran]

消息会 按顺序追加,而不会覆盖。

LangChain 的 Middleware 状态更新本质依赖于 LangGraph 的 reducer 机制:

- Node-style Hook:直接返回 dict

- Wrap-style Hook:通过

Command注入 state 更新 - 多 Middleware:通过 reducer 自动组合状态更新

这种设计使得 复杂 Middleware 组合、重试机制、并发更新 都能够稳定工作。

中间件状态机

Middleware 可以通过 扩展 Agent 的 state 来添加自定义字段。这使得 Middleware 能够在 Agent 执行过程中维护和共享额外的信息。

from langchain.agents import create_agent

from langchain.messages import HumanMessage

from langchain.agents.middleware import AgentState, AgentMiddleware

from typing_extensions import NotRequired

from typing import Any

定义自定义 state:

class CustomState(AgentState):

model_call_count: NotRequired[int]

user_id: NotRequired[str]

在这个 state 中新增了两个字段:

model_call_count:记录模型调用次数user_id:记录当前用户 ID

定义 Middleware:

class CallCounterMiddleware(AgentMiddleware[CustomState]):

state_schema = CustomState

def before_model(self, state: CustomState, runtime) -> dict[str, Any] | None:

count = state.get("model_call_count", 0)

if count > 10:

return {"jump_to": "end"}

return None

def after_model(self, state: CustomState, runtime) -> dict[str, Any] | None:

return {

"model_call_count": state.get("model_call_count", 0) + 1

}

这个 Middleware 实现的逻辑:

- 在

before_model中检查模型调用次数 - 如果超过 10 次,则通过

jump_to="end"提前终止 Agent - 在

after_model中累加model_call_count

创建 Agent:

agent = create_agent(

model="gpt-4.1",

middleware=[CallCounterMiddleware()],

tools=[],

)

调用 Agent,并传入自定义 state:

result = agent.invoke({

"messages": [HumanMessage("Hello")],

"model_call_count": 0,

"user_id": "user-123",

})

这里的调用参数中:

messages是默认 state 字段model_call_count和user_id是 自定义 state 字段

Middleware 可以在整个 Agent 执行过程中 持续读取和更新这些值。

有人可能会好奇,这里的状态机和create_agent时传入的state_schema有什么区别?

我们都知道,LangChain 会做一件事情:

把所有 middleware 声明的 state_schema 自动合并成一个最终 schema。

类似:

FinalAgentState =

AgentState

+ MiddlewareAState

+ MiddlewareBState

+ ...

LangChain 这样设计其实是为了实现:

Middleware 可插拔(Plug-in Architecture)

如果 middleware 需要字段:

model_call_count

它不需要修改 Agent:

create_agent(...)

只需要:

middleware=[CallCounterMiddleware()]

state 就会自动扩展,这就是 插件式 state 扩展。

执行顺序(Execution order)

当同时使用多个 Middleware 时,需要理解它们的执行顺序。例如:

agent = create_agent(

model="gpt-4.1",

middleware=[middleware1, middleware2, middleware3],

tools=[...],

)

1️⃣ before_* Hook 按顺序执行

middleware1.before_agent()

middleware2.before_agent()

middleware3.before_agent()

随后 Agent Loop 开始:

middleware1.before_model()

middleware2.before_model()

middleware3.before_model()

2️⃣ wrap_* Hook 像函数调用一样嵌套

middleware1.wrap_model_call()

→ middleware2.wrap_model_call()

→ middleware3.wrap_model_call()

→ model

也就是说:

第一个 middleware 会包裹后面所有 middleware。

3️⃣ after_* Hook 按相反顺序执行

middleware3.after_model()

middleware2.after_model()

middleware1.after_model()

4️⃣ Agent Loop 结束

middleware3.after_agent()

middleware2.after_agent()

middleware1.after_agent()

| Hook 类型 | 执行顺序 |

|---|---|

before_* hooks |

从前到后执行 |

after_* hooks |

从后到前执行(逆序) |

wrap_* hooks |

嵌套执行(类似函数包装) |

这种执行顺序其实和很多框架中的 Middleware / Interceptor / Filter 机制类似。

Agent 跳转(Agent jumps)

如果希望在 Middleware 中 提前结束或改变执行流程,可以返回一个包含 jump_to 的字典。

-

"end"

跳转到 Agent 执行结束(或第一个after_agentHook) -

"tools"

跳转到 tools 节点 -

"model"

跳转到 model 节点(或第一个before_modelHook)

from langchain.agents.middleware import AgentMiddleware, hook_config, AgentState

from langchain.messages import AIMessage

from langgraph.runtime import Runtime

from typing import Any

class BlockedContentMiddleware(AgentMiddleware):

@hook_config(can_jump_to=["end"])

def after_model(

self,

state: AgentState,

runtime: Runtime

) -> dict[str, Any] | None:

last_message = state["messages"][-1]

if "BLOCKED" in last_message.content:

return {

"messages": [AIMessage("I cannot respond to that request.")],

"jump_to": "end"

}

return None

这个 Middleware 的逻辑是:

- 在

after_model阶段检查模型返回内容 - 如果检测到

"BLOCKED"关键词 - 则返回新的回复

- 并通过

jump_to="end"直接结束 Agent 执行

这里@hook_config(can_jump_to=["end"]) 的作用其实是:

声明这个 Hook 允许跳转到哪些节点。

换句话说,它是在 编译 Agent Graph 时给 Hook 配置“合法跳转目标”。

在 Middleware 里你可以返回:

return {

"jump_to": "end"

}

但 Agent 的执行实际上是一个 LangGraph Graph。

Graph 在编译时必须提前知道:

这个节点可以跳到哪些节点

否则 Graph 是 无法构建边(edge) 的。

所以需要:

@hook_config(can_jump_to=["end"])

来告诉系统:

这个 Hook 可能会跳到

end节点。

LangChain 在内部编译 Graph 时会创建对应的边。

如果不写会发生什么?如果你这样写:

class BlockedMiddleware(AgentMiddleware):

def after_model(self, state, runtime):

return {"jump_to": "end"}

但没有:

@hook_config(can_jump_to=["end"])

那么在运行时通常会报类似错误:

Invalid jump target 'end'

或者 Graph 编译阶段报错。

因为 Graph 不知道:

after_model

↓

可以跳到哪里

hook_config 本质干了什么

它只是给 Hook 附加一些 元信息(metadata)。

类似:

hook_config = {

"can_jump_to": ["end"]

}

LangChain 在编译 Agent 时会读取这个配置,然后:

after_model node

├── normal edge → next step

└── jump edge → end

可以允许多个跳转

例如:

@hook_config(can_jump_to=["end", "tools"])

那这个 Hook 就可以返回:

return {"jump_to": "tools"}

或者:

return {"jump_to": "end"}

为什么官方要设计成装饰器

因为 Hook 只是普通函数:

def after_model(...)

LangChain 需要一种方式给函数附加 Graph 配置。

所以用了 decorator。

其实效果类似:

after_model._hook_config = {

"can_jump_to": ["end"]

}

如果你在研究 Agent Loop + Pregel,这里其实还有一个很有意思的点:

LangChain 的 jump_to 在 LangGraph 里其实是一个:

Command(goto=...)

也就是说:

return {"jump_to": "end"}

最后会变成:

Command(goto="end")

这也是为什么 Agent Middleware 本质就是 LangGraph 的语法糖。

中间件最佳实践(Best practices)

保持 Middleware 职责单一

每个 Middleware 应该只负责一件事情。

优雅处理错误

不要让 Middleware 内部错误导致 Agent 崩溃。

选择合适的 Hook 类型

-

Node-style Hook:适合顺序逻辑,例如

- 日志记录

- 数据校验

-

Wrap-style Hook:适合控制执行流程,例如

- 重试(retry)

- 回退(fallback)

- 缓存(cache)

清晰记录自定义 State 字段

如果 Middleware 扩展了 state,需要明确说明这些字段的含义。

在集成前单独测试 Middleware

Middleware 最好先进行单元测试,再加入 Agent。

注意 Middleware 执行顺序

如果某些 Middleware 非常关键,应当放在列表的前面。

尽量使用内置 Middleware

如果官方已经提供了对应功能,优先使用官方实现。

Agent 的运行时上下文管理

Runtime 和 Context Engineering 在 Agent 里是强相关的两个概念,因为:

- Runtime 负责在执行过程中提供环境信息(state、config、runtime object)

- Context Engineering 负责把这些信息组织成 模型真正看到的上下文

Runtime

在 LangChain 中,create_agent 实际上是运行在 LangGraph 的 Runtime 之上的。

LangGraph 会向 Agent 暴露一个 Runtime 对象,其中包含以下信息:

- Context:静态信息,例如用户 ID、数据库连接或其他与一次 Agent 调用相关的依赖。

- Store:一个

BaseStore实例,用于实现 长期记忆(long-term memory)。 - Stream writer:用于在

"custom"stream 模式下 实时流式输出信息 的对象。

Runtime 中的 context 提供了一种 依赖注入(Dependency Injection)机制,可用于工具(tools)和中间件(middleware)。

相比于将这些信息写死在代码里,或者使用全局变量,你可以在 调用 Agent 时动态注入运行时依赖,例如:

- 数据库连接

- 用户 ID

- 运行配置

这种方式可以让工具更加:

- 易于测试

- 可复用

- 灵活可配置

在工具和中间件中都可以访问 Runtime 中的信息。

在使用 create_agent 创建 Agent 时,可以通过 context_schema 指定 Runtime context 的结构。

在调用 Agent 时,通过 context 参数传入对应的运行时信息。

from dataclasses import dataclass

from langchain.agents import create_agent

@dataclass

class Context:

user_name: str

agent = create_agent(

model="gpt-5-nano",

tools=[...],

context_schema=Context

)

agent.invoke(

{"messages": [{"role": "user", "content": "What's my name?"}]},

context=Context(user_name="John Smith")

)

在工具内部可以通过 Runtime 完成以下操作:

- 访问 context

- 读取或写入 长期记忆(store)

- 向 custom stream 写入信息(例如工具执行进度)

可以使用 ToolRuntime 参数在工具中访问 Runtime。

from dataclasses import dataclass

from langchain.tools import tool, ToolRuntime

@dataclass

class Context:

user_id: str

@tool

def fetch_user_email_preferences(runtime: ToolRuntime[Context]) -> str:

"""Fetch the user's email preferences from the store."""

user_id = runtime.context.user_id

preferences: str = "The user prefers you to write a brief and polite email."

if runtime.store:

if memory := runtime.store.get(("users",), user_id):

preferences = memory.value["preferences"]

return preferences

在这个示例中:

- 从

runtime.context中读取user_id - 从

runtime.store中读取用户的长期偏好信息 - 返回用户偏好的邮件风格

在中间件中也可以访问 Runtime 信息,例如:

- 构建 动态 Prompt

- 修改消息

- 根据用户上下文控制 Agent 行为

访问方式:

- Node-style hooks:通过

Runtime参数获取 - Wrap-style hooks:通过

ModelRequest.runtime获取

示例:

from dataclasses import dataclass

from langchain.messages import AnyMessage

from langchain.agents import create_agent, AgentState

from langchain.agents.middleware import dynamic_prompt, ModelRequest, before_model, after_model

from langgraph.runtime import Runtime

@dataclass

class Context:

user_name: str

# 动态 Prompt

@dynamic_prompt

def dynamic_system_prompt(request: ModelRequest) -> str:

user_name = request.runtime.context.user_name

system_prompt = f"You are a helpful assistant. Address the user as {user_name}."

return system_prompt

# before_model hook

@before_model

def log_before_model(state: AgentState, runtime: Runtime[Context]) -> dict | None:

print(f"Processing request for user: {runtime.context.user_name}")

return None

# after_model hook

@after_model

def log_after_model(state: AgentState, runtime: Runtime[Context]) -> dict | None:

print(f"Completed request for user: {runtime.context.user_name}")

return None

agent = create_agent(

model="gpt-5-nano",

tools=[...],

middleware=[dynamic_system_prompt, log_before_model, log_after_model],

context_schema=Context

)

agent.invoke(

{"messages": [{"role": "user", "content": "What's my name?"}]},

context=Context(user_name="John Smith")

)

在这个示例中:

dynamic_system_prompt根据 Runtime 中的用户信息动态生成 System Promptbefore_model在模型调用前记录日志after_model在模型调用后记录日志

所有这些逻辑都可以通过 Runtime context 获取当前用户信息,而不需要依赖全局变量或硬编码配置。

Context

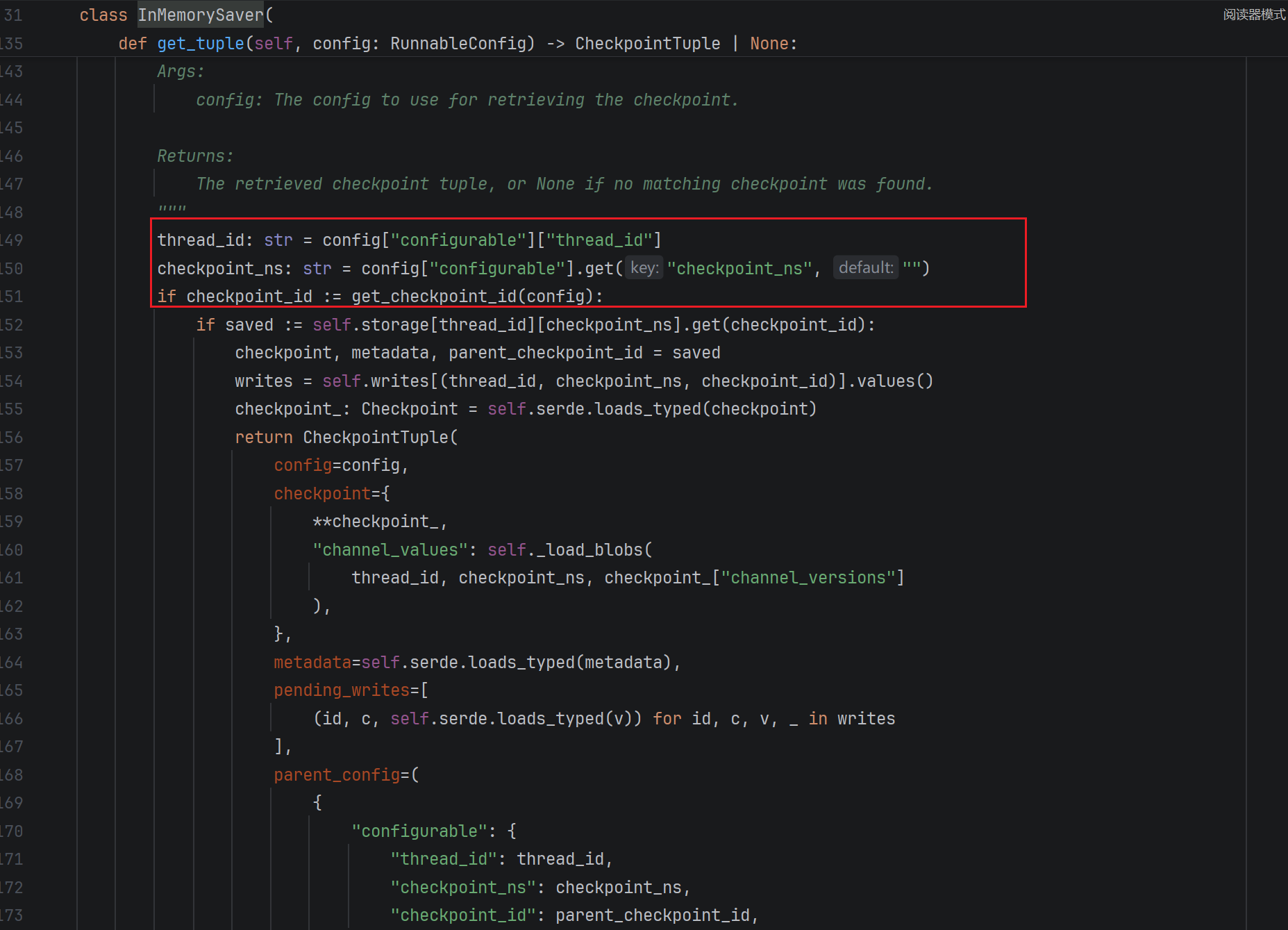

在Runtime小节中,我们提到了Context,什么是Context?从源码可以直观的看出,Context是Runtime的组成部分:

@dataclass(**_DC_KWARGS)

class Runtime(Generic[ContextT]):

context: ContextT = field(default=None) # type: ignore[assignment]

"""Static context for the graph run, like `user_id`, `db_conn`, etc.

Can also be thought of as 'run dependencies'."""

store: BaseStore | None = field(default=None)

"""Store for the graph run, enabling persistence and memory."""

stream_writer: StreamWriter = field(default=_no_op_stream_writer)

"""Function that writes to the custom stream."""

previous: Any = field(default=None)

"""The previous return value for the given thread.

Only available with the functional API when a checkpointer is provided.

"""

只要是一个思维正常的开发者,都应该明白,运行时的概念是最大的,比如Go的各种特性都是基于Runtime去实现的,而langchain的Context也是Langchain Runtime的一种特性。

要构建可靠的 Agent,你需要控制:

- Agent Loop 每个步骤发生的事情

- 各个步骤之间发生的事情

| Context 类型 | 可控制内容 | 生命周期 |

|---|---|---|

| Model Context | 模型调用时输入的内容(指令、消息历史、工具、返回格式) | 瞬时 |

| Tool Context | 工具可以访问或生成的数据(state、store、runtime context) | 持久 |

| Life-cycle Context | 模型调用和工具调用之间发生的逻辑(摘要、guardrails、日志等) | 持久 |

瞬时上下文(Transient Context)

指 某一次 LLM 调用时看到的上下文。

例如:

- 修改 messages

- 修改 prompt

- 修改 tools

这些修改 不会改变 state 中保存的数据。

持久上下文(Persistent Context)

指 跨多轮对话持续存在的数据。

例如:

- 生命周期 hook 修改 state

- tool 写入 store

- 系统记录用户信息

这些数据会在之后的执行中继续存在。

在整个执行过程中,Agent 会访问不同的数据来源(读或写)。

| 数据来源 | 也称为 | 作用范围 | 示例 |

|---|---|---|---|

| Runtime Context | 静态配置 | 单次对话 | 用户 ID、API Key、数据库连接、权限、环境配置 |

| State | 短期记忆 | 单次对话 | 当前消息、上传文件、认证状态、工具结果 |

| Store | 长期记忆 | 跨对话 | 用户偏好、提取的知识、历史数据 |

在 LangChain 中,Middleware(中间件)是实现 Context Engineering 的核心机制。

Middleware 允许你在 Agent 生命周期的任何阶段进行干预,例如:

- 更新上下文

- 跳转到 Agent 生命周期中的其他步骤

在接下来的内容中,你会看到 Middleware API 被频繁使用,因为它是 实现 Context Engineering 的核心工具。

Model context(模型上下文)

Model Context 指的是:

每一次模型调用时传递给 LLM 的所有信息。

它包括:

- 指令(instructions)

- 可用工具

- 使用哪个模型

- 输出格式

这些决策会 直接影响 Agent 的可靠性和成本。

模型上下文通常由以下几个部分组成:

System Prompt

开发者提供给 LLM 的基础指令,用于定义模型的行为方式。

Messages

发送给 LLM 的完整消息列表(即对话历史)。

Tools

Agent 可以使用的工具,用于执行操作或获取外部信息。

Model

实际调用的模型(包括模型配置)。

Response Format

模型最终输出的 结构化格式或 Schema 约束。

System Prompt

System Prompt 用于定义 LLM 的行为和能力。

在不同的情况下,Agent 可能需要不同的指令,例如:

- 不同用户

- 不同上下文

- 不同对话阶段

一个优秀的 Agent 会根据:

- 用户历史记忆

- 用户偏好

- 当前配置

动态生成 适合当前对话状态的系统指令。

示例:基于 State 的动态 System Prompt

下面的示例根据 对话轮数 动态调整系统提示词。

from langchain.agents import create_agent

from langchain.agents.middleware import dynamic_prompt, ModelRequest

@dynamic_prompt

def state_aware_prompt(request: ModelRequest) -> str:

# request.messages 是 request.state["messages"] 的快捷方式

message_count = len(request.messages)

base = "You are a helpful assistant."

if message_count > 10:

base += "\nThis is a long conversation - be extra concise."

return base

agent = create_agent(

model="gpt-4.1",

tools=[...],

middleware=[state_aware_prompt]

)

在这个例子中:

request.messages用于访问当前对话历史- 当对话超过 10 条消息时

- System Prompt 会增加额外指令,要求模型 更加简洁地回答

这就是 基于 State 的动态 Prompt 构建。

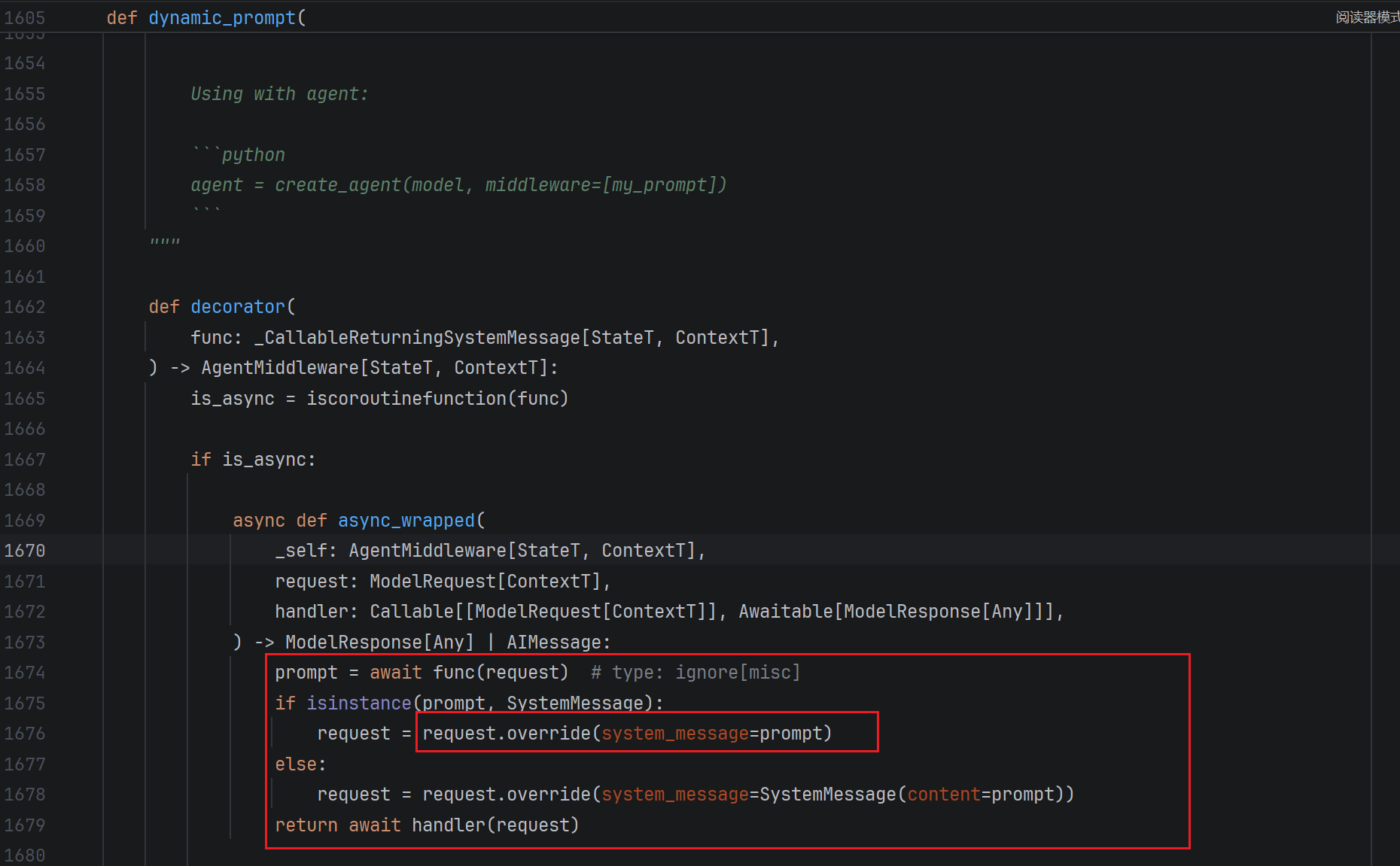

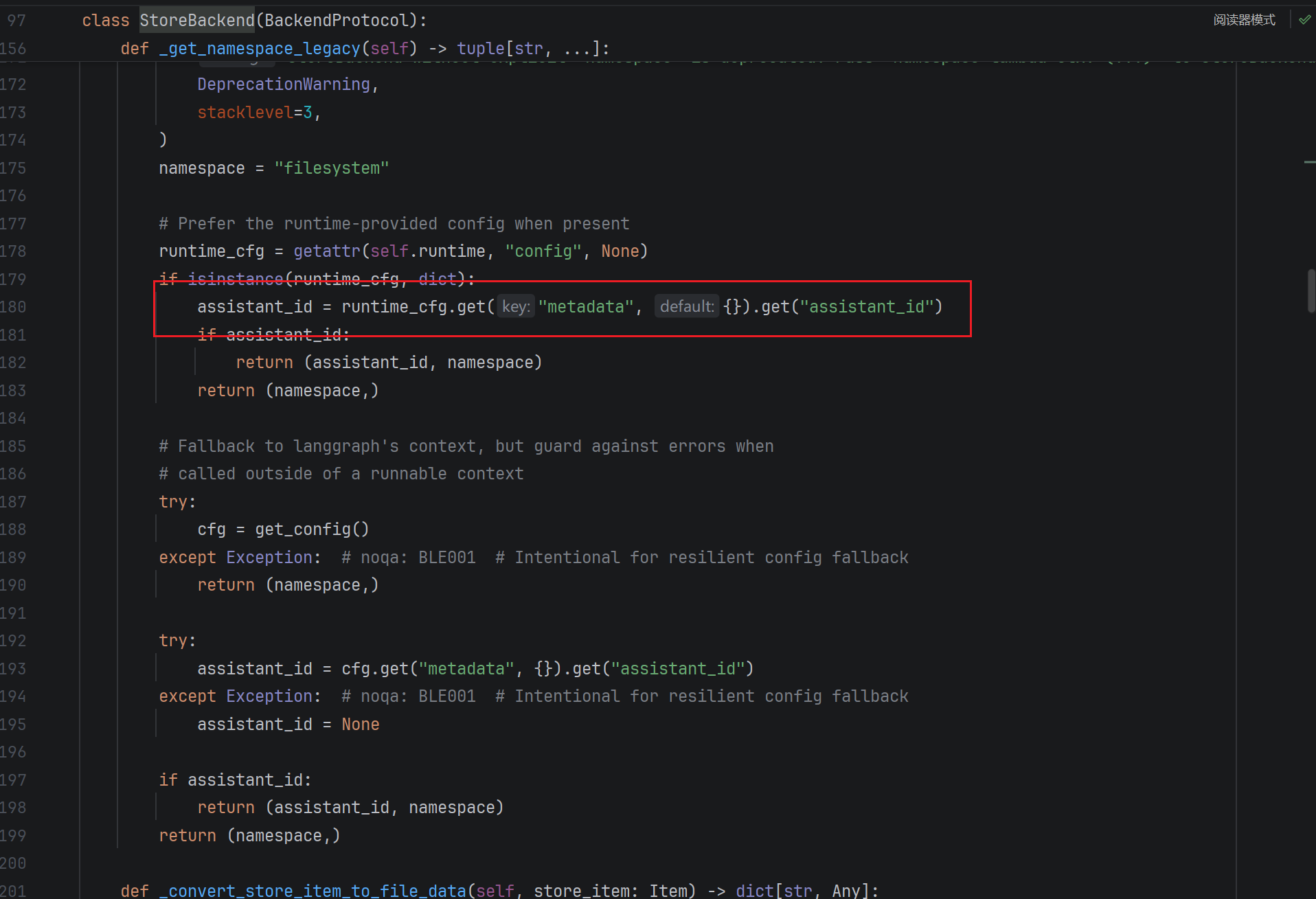

我们打开dynamic_prompt的源码部分:

可以看到dynamic_prompt这个语法糖将我们传入的函数的返回值作为了系统的提示词,并且使用override覆盖写入,而这个System Prompt会替换请求的messages列表中的System Prompt!

示例:从长期记忆(Store)中访问用户偏好

下面的示例展示了如何从 Store(长期记忆) 中读取用户偏好,并动态构建 System Prompt。

from dataclasses import dataclass

from langchain.agents import create_agent

from langchain.agents.middleware import dynamic_prompt, ModelRequest

from langgraph.store.memory import InMemoryStore

@dataclass

class Context:

user_id: str

@dynamic_prompt

def store_aware_prompt(request: ModelRequest) -> str:

user_id = request.runtime.context.user_id

# 从 Store 中读取用户偏好

store = request.runtime.store

user_prefs = store.get(("preferences",), user_id)

base = "You are a helpful assistant."

if user_prefs:

style = user_prefs.value.get("communication_style", "balanced")

base += f"\nUser prefers {style} responses."

return base

agent = create_agent(

model="gpt-4.1",

tools=[...],

middleware=[store_aware_prompt],

context_schema=Context,

store=InMemoryStore()

)

在这个示例中:

- Runtime Context 提供

user_id - 使用

runtime.store访问 Store(长期记忆) - 从

"preferences"命名空间中读取用户偏好 - 根据用户的

communication_style动态调整 System Prompt

例如:

如果用户偏好是:

communication_style = concise

那么最终生成的 System Prompt 可能会变成:

You are a helpful assistant.

User prefers concise responses.

这种方式可以让 Agent 根据用户历史偏好动态调整行为,从而提升个性化体验和回答质量。

我们打开ModelRequest的源码:

@dataclass(init=False)

class ModelRequest(Generic[ContextT]):

"""Model request information for the agent.

Type Parameters:

ContextT: The type of the runtime context. Defaults to `None` if not specified.

"""

model: BaseChatModel

messages: list[AnyMessage] # excluding system message

system_message: SystemMessage | None

tool_choice: Any | None

tools: list[BaseTool | dict[str, Any]]

response_format: ResponseFormat[Any] | None

state: AgentState[Any]

runtime: Runtime[ContextT]

model_settings: dict[str, Any] = field(default_factory=dict)

可以看到request里面是提供了runtime结构的,除此之外的一些字段则可以通过override方法进行覆写。

示例:基于 Runtime Context 的用户权限过滤工具

下面的示例展示了如何根据 Runtime Context 中的用户权限,动态过滤 Agent 可使用的工具。

from dataclasses import dataclass

from langchain.agents import create_agent

from langchain.agents.middleware import wrap_model_call, ModelRequest, ModelResponse

from typing import Callable

@dataclass

class Context:

user_role: str

@wrap_model_call

def context_based_tools(

request: ModelRequest,

handler: Callable[[ModelRequest], ModelResponse]

) -> ModelResponse:

"""根据 Runtime Context 中的权限过滤工具。"""

# 从 Runtime Context 中读取用户角色

user_role = request.runtime.context.user_role

if user_role == "admin":

# 管理员可以使用所有工具

pass

elif user_role == "editor":

# 编辑者不能删除数据

tools = [t for t in request.tools if t.name != "delete_data"]

request = request.override(tools=tools)

else:

# 只读用户只能使用读取类工具

tools = [t for t in request.tools if t.name.startswith("read_")]

request = request.override(tools=tools)

return handler(request)

agent = create_agent(

model="gpt-4.1",

tools=[read_data, write_data, delete_data],

middleware=[context_based_tools],

context_schema=Context

)

在这个示例中:

-

Runtime Context 提供

user_role(用户角色)。 -

中间件根据角色 动态过滤工具列表:

- admin:可以使用所有工具

- editor:不能使用

delete_data - viewer:只能使用以

read_开头的只读工具

-

通过

request.override(tools=tools)修改当前模型调用时可见的工具。

这种方式可以实现 基于权限的工具访问控制(RBAC),确保不同角色的用户只能调用符合权限范围的工具,同时避免将权限逻辑硬编码到 Agent 或工具内部。

总之大体上就是这三类,你只需要逮着一个参数点点点,总能达到你的目的!

Tool Context(工具上下文)

工具(Tools)的特殊之处在于:

它们既可以读取上下文,也可以写入上下文。

在最基本的情况下,当一个工具被执行时:

- 工具接收 LLM 生成的调用参数

- 执行对应逻辑

- 返回 Tool Message 作为执行结果

也就是说:

- 工具完成具体任务

- 并将执行结果返回给 Agent

除此之外,工具还可以 获取重要信息并提供给模型,从而帮助模型更好地完成任务。

Reads(读取上下文)

在真实场景中,大多数工具不仅仅依赖 LLM 提供的参数,还需要额外信息,例如:

- 用户 ID(用于数据库查询)

- API Key(用于调用外部服务)

- 当前会话状态(用于决策逻辑)

因此,工具通常会从以下数据源读取信息:

- State(短期记忆)

- Store(长期记忆)

- Runtime Context(运行时配置)

下面的示例展示了如何从 State(短期记忆) 中读取当前会话信息。

from langchain.tools import tool, ToolRuntime

from langchain.agents import create_agent

@tool

def check_authentication(

runtime: ToolRuntime

) -> str:

"""检查用户是否已经认证。"""

# 从 State 中读取当前认证状态

current_state = runtime.state

is_authenticated = current_state.get("authenticated", False)

if is_authenticated:

return "User is authenticated"

else:

return "User is not authenticated"

agent = create_agent(

model="gpt-4.1",

tools=[check_authentication]

)

在这个例子中:

runtime.state提供当前会话的 短期状态- 工具通过

authenticated字段判断用户是否已登录 - 然后返回对应的认证状态信息

这种方式可以让工具根据 当前会话状态 做出不同的行为决策。

而从Store以及Context中读取数据只需要用runtime去点出各种属性即可!毕竟runtime都有了,相当于整个agent运行的”堆栈“都在你手中,还有什么数据是拿不到的。

store = runtime.store

existing_prefs = store.get(("preferences",), user_id)

db_connection = runtime.context.db_connection

Writes(写入上下文)

工具执行的结果不仅可以帮助 Agent 完成当前任务,还可以 更新 Agent 的记忆,从而让后续步骤能够访问这些重要信息。

工具可以通过两种方式产生影响:

- 直接将结果返回给模型

- 更新 Agent 的记忆(State 或 Store)

下面的示例展示了如何通过 Command 向 State 写入数据,以记录当前会话中的状态信息。

当工具需要 更新图(graph)的状态 时,应返回一个

Command(例如设置用户偏好或应用状态)。

Command可以 只包含状态更新,也可以 同时包含一个ToolMessage。如果模型需要看到工具执行成功的信息(例如确认用户偏好已经修改),那么在

update中应包含一个ToolMessage,并使用runtime.tool_call_id作为tool_call_id参数。

from langchain.tools import tool, ToolRuntime

from langchain.agents import create_agent

from langgraph.types import Command

@tool

def authenticate_user(

password: str,

runtime: ToolRuntime

) -> Command:

"""Authenticate user and update State."""

# 执行认证逻辑(简化示例)

if password == "correct":

# 写入 State:标记用户已认证

return Command(

update={"authenticated": True},

)

else:

return Command(update={"authenticated": False})

agent = create_agent(

model="gpt-4.1",

tools=[authenticate_user]

)

在这个示例中:

- 工具接收用户输入的

password - 执行简单的认证逻辑

- 使用

Command(update=...)更新 State - 将

authenticated字段写入当前会话状态

这样,在后续步骤中:

- 其他工具

- Middleware

- Agent 逻辑

都可以通过 state["authenticated"] 判断用户是否已经登录。

ToolRuntime

ToolRuntime是Runtime的一个“受限视图(restricted view)”,专门给 Tool 使用。

也就是说:

Runtime → Agent / Middleware 用

ToolRuntime → Tool 用

Tool 是 模型可以调用的东西,而 Middleware / Agent 是 开发者控制的代码。

所以框架必须保证:

Tool 不能随便操作整个 Runtime

如果直接给 Tool 完整 Runtime,理论上工具就可以:

- 改 Agent 执行流程

- 修改 Graph 运行结构

- 跳节点

- 改调度逻辑

这显然不合理。

所以 ToolRuntime 只暴露 工具真正需要的能力:

常见字段:

runtime.state

runtime.context

runtime.store

runtime.stream_writer

runtime.tool_call_id

但不会暴露:

graph

scheduler

node control

jump control

middleware control

所以:

Runtime = 完整执行环境

ToolRuntime = 工具执行环境

类似 沙箱化 API。

如果工具直接接收 Runtime:

def my_tool(runtime: Runtime)

开发者会误以为:

工具可以控制 Agent 运行

但实际上工具应该只是:

读取上下文

执行动作

返回结果

而不是:

控制 Agent Loop

所以 LangChain 用 ToolRuntime 明确表达:

这是工具的运行环境

不是 Agent 的运行环境

这是一种 语义边界(semantic boundary)。

LangChain 会通过 参数类型自动注入依赖:

例如:

ToolRuntime → 注入工具运行环境

Runtime → 注入 middleware runtime

如果统一用 Runtime,就会出现:

工具 runtime

middleware runtime

混在一起,容易出错。

现在类型是:

ToolRuntime

Runtime

框架一眼就知道该注入哪个对象。

LangGraph 未来可能会让 ToolRuntime 支持:

- 限制 Store 访问

- 限制 Namespace

- 限制 Stream

- 沙箱权限

例如:

ToolRuntime(read_only_store=True)

如果工具拿到完整 Runtime,这些控制就很难做。

为什么 Tool 写 state 要用 Command,而不是直接改 runtime.state

这个设计其实是 LangGraph 的核心思想之一:让 Agent 执行过程保持“可控、可回放、可合成”。

如果 Tool 可以直接改 runtime.state,很多关键能力都会被破坏。

保证 Graph 执行是“可回放”的(deterministic execution)

LangGraph 本质上是一个 状态机 + 图执行引擎。

每一步执行都会形成:

(state_before)

↓

Node 执行

↓

(state_update)

↓

(state_after)

如果 Tool 直接这样改:

runtime.state["authenticated"] = True

那么问题来了:

state 是什么时候被改的?

是:

工具内部

Graph 引擎是 不知道的。

但如果用:

return Command(update={"authenticated": True})

Graph 会记录:

node: authenticate_user

update: {"authenticated": True}

于是整个执行变成:

(state_before)

↓

tool node

↓

Command(update)

↓

reducer

↓

(state_after)

这样就可以 完全回放执行过程。

这对很多能力很重要:

- Debug

- Replay

- Agent trace

- LangSmith 可视化

统一 State 更新入口(Reducer 机制)

LangGraph 的 State 更新不是简单的 dict.update,而是通过 Reducer。

例如 messages:

messages: Annotated[list, add_messages]

更新时不是:

覆盖

而是:

append

如果 Tool 直接写:

runtime.state["messages"] = [...]

就会破坏 reducer 逻辑。

而 Command(update=...) 会经过 reducer:

Command

↓

Reducer

↓

State update

例如:

old messages = [A, B]

update = [C]

结果 = [A, B, C]

而不是覆盖。

支持 Middleware 组合(非常关键)

LangChain 支持多个 middleware 叠加。

比如:

retry middleware

logging middleware

tracking middleware

这些 middleware 都可能返回:

ExtendedModelResponse(

command=Command(...)

)

LangGraph 会做:

Command 合成

执行顺序:

inner middleware

↓

outer middleware

如果 Tool 直接改 state:

runtime.state["x"] = ...

那 middleware 就 没法合成这些更新。

但用 Command:

Command(update={...})

Graph 可以统一处理:

Command1

Command2

Command3

↓

Reducer

↓

Final State

支持“失败回滚”

想象一种情况:

Tool 执行

↓

State 已经被改

↓

Tool 抛异常

如果 Tool 直接改 state:

状态已经被污染

但用 Command:

Tool 成功 → Command 才会应用

Tool 失败 → Command 丢弃

这样状态就不会被破坏。

还有一个很高级的能力:Execution Trace

LangGraph 内部可以记录:

step1

step2

step3

每一步都有:

state diff

例如:

step 5

node: authenticate_user

state diff:

authenticated: False → True

如果 Tool 直接改 state:

这个 diff 就没法计算

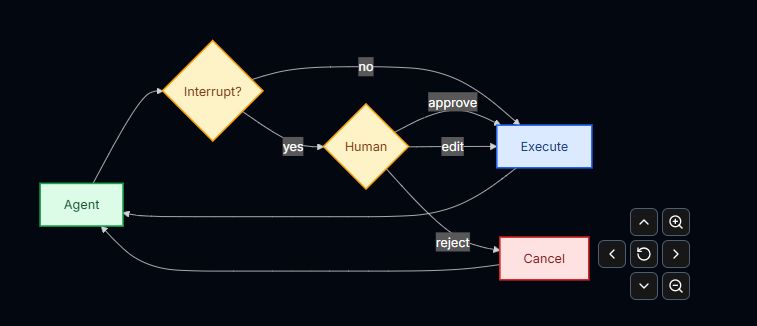

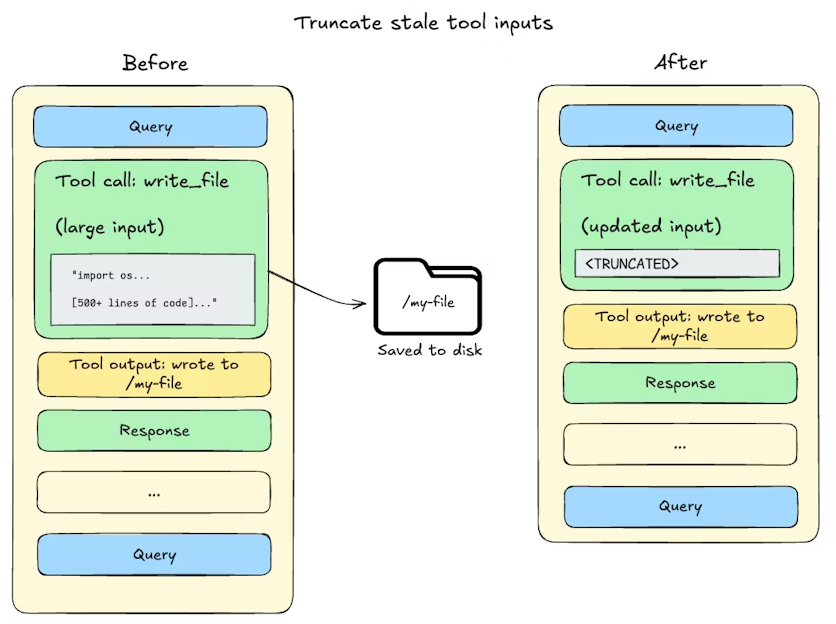

Human-in-the-loop

某些工具操作可能具有较高风险,因此在执行之前需要 人工审批。

Deep Agents 通过 LangGraph 的 interrupt(中断)机制 来支持 Human-in-the-loop 工作流。

你可以通过 interrupt_on 参数指定 哪些工具在执行前需要人工确认。

基本流程如下:

人工可以:

- approve:批准执行

- edit:修改参数后执行

- reject:拒绝执行

interrupt_on 参数接收一个字典,用于 将工具名称映射到对应的中断配置。

每个工具可以配置为:

-

True

启用中断,使用默认行为(允许 approve / edit / reject) -

False

禁用中断,工具可以直接执行 -

{“allowed_decisions”: […]}

自定义允许的人工决策类型

示例:

from langchain.tools import tool

from deepagents import create_deep_agent

from langgraph.checkpoint.memory import MemorySaver

@tool

def delete_file(path: str) -> str:

"""Delete a file from the filesystem."""

return f"Deleted {path}"

@tool

def read_file(path: str) -> str:

"""Read a file from the filesystem."""

return f"Contents of {path}"

@tool

def send_email(to: str, subject: str, body: str) -> str:

"""Send an email."""

return f"Sent email to {to}"

# Human-in-the-loop 必须使用 Checkpointer

checkpointer = MemorySaver()

agent = create_deep_agent(

model="claude-sonnet-4-6",

tools=[delete_file, read_file, send_email],

interrupt_on={

"delete_file": True, # 默认允许 approve / edit / reject

"read_file": False, # 不需要人工确认

"send_email": {"allowed_decisions": ["approve", "reject"]}, # 不允许修改参数

},

checkpointer=checkpointer # 必须提供

)

需要注意的是:

Human-in-the-loop 功能必须启用 Checkpointer,因为中断时需要保存当前执行状态,以便人工处理完成后继续执行。

决策类型(Decision Types):

allowed_decisions 用于控制 人工可以对工具调用做出哪些操作。

可选值包括:

“approve”

按照 Agent 提出的原始参数 直接执行工具。

“edit”

在执行前 修改工具参数。

“reject”

完全跳过这次工具调用,不执行该工具。

你可以为不同风险级别的工具配置不同的审批策略:

interrupt_on = {

# 高风险操作:允许所有选项

"delete_file": {"allowed_decisions": ["approve", "edit", "reject"]},

# 中等风险:只能批准或拒绝

"write_file": {"allowed_decisions": ["approve", "reject"]},

# 必须执行(只能批准)

"critical_operation": {"allowed_decisions": ["approve"]},

}

通过这种方式,可以为 Agent 的工具调用建立 细粒度的安全控制机制,确保关键操作在执行前得到人工确认。

delete_file,write_file,critical_operation 均为工具名字

处理中断(Handle interrupts)

当触发中断时,Agent 会暂停执行并将控制权返回。你需要在结果中检查是否存在中断,并根据情况进行处理。

import uuid

from langgraph.types import Command

# 创建包含 thread_id 的配置,用于状态持久化

config = {"configurable": {"thread_id": str(uuid.uuid4())}}

# 调用 agent

result = agent.invoke(

{"messages": [{"role": "user", "content": "Delete the file temp.txt"}]},

config=config,

version="v2",

)

# 检查执行是否被中断

if result.interrupts:

# 提取中断信息

interrupt_value = result.interrupts[0].value

action_requests = interrupt_value["action_requests"]

review_configs = interrupt_value["review_configs"]

# 创建从工具名称到 review_config 的映射

config_map = {cfg["action_name"]: cfg for cfg in review_configs}

# 向用户展示待处理的操作

for action in action_requests:

review_config = config_map[action["name"]]

print(f"Tool: {action['name']}")

print(f"Arguments: {action['args']}")

print(f"Allowed decisions: {review_config['allowed_decisions']}")

# 获取用户决策(按 action_request 顺序,一一对应)

decisions = [

{"type": "approve"} # 用户批准删除操作

]

# 根据用户决策恢复执行

result = agent.invoke(

Command(resume={"decisions": decisions}),

config=config, # 必须使用相同的 config!

version="v2",

)

# 处理最终结果

print(result.value["messages"][-1].content)

当 Agent 调用多个需要审批的工具时,所有中断会被 合并(batch)到一个 interrupt 中。

你必须 按顺序为每个工具提供对应的决策。

config = {"configurable": {"thread_id": str(uuid.uuid4())}}

result = agent.invoke(

{"messages": [{

"role": "user",

"content": "Delete temp.txt and send an email to admin@example.com"

}]},

config=config,

version="v2",

)

if result.interrupts:

interrupt_value = result.interrupts[0].value

action_requests = interrupt_value["action_requests"]

# 有两个工具需要审批

assert len(action_requests) == 2

# 决策必须与 action_requests 顺序一致

decisions = [

{"type": "approve"}, # 第一个工具:delete_file

{"type": "reject"} # 第二个工具:send_email

]

result = agent.invoke(

Command(resume={"decisions": decisions}),

config=config,

version="v2",

)

如果 allowed_decisions 中包含 "edit",你可以在执行工具之前 修改工具参数:

if result.interrupts:

interrupt_value = result.interrupts[0].value

action_request = interrupt_value["action_requests"][0]

# Agent 原始参数

print(action_request["args"]) # {"to": "everyone@company.com", ...}

# 用户决定修改收件人

decisions = [{

"type": "edit",

"edited_action": {

"name": action_request["name"], # 必须包含工具名称

"args": {"to": "team@company.com", "subject": "...", "body": "..."}

}

}]

result = agent.invoke(

Command(resume={"decisions": decisions}),

config=config,

version="v2",

)

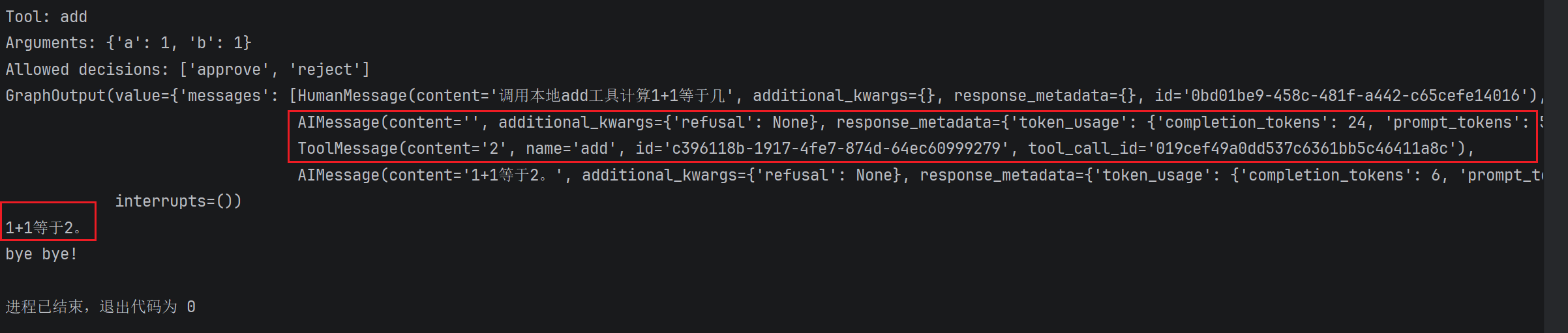

另外需要注意的是,在前后端交互的环境中,我们需要把中断内容发给前端进行渲染,并且需要实现一个resume接口进行重启会话:

def chat():

config = {"configurable": {"thread_id": "generalzy"}}

# Invoke the agent

result:GraphOutput = agent.invoke(

{"messages": [{"role": "user", "content": "调用本地add工具计算1+1等于几"}]},

config=config,

version="v2",

)

# Check if execution was interrupted

if result.interrupts:

# Extract interrupt information

interrupt_value = result.interrupts[0].value

action_requests = interrupt_value["action_requests"]

review_configs = interrupt_value["review_configs"]

# Create a lookup map from tool name to review config

config_map = {cfg["action_name"]: cfg for cfg in review_configs}

# Display the pending actions to the user

for action in action_requests:

review_config = config_map[action["name"]]

print(f"Tool: {action['name']}")

print(f"Arguments: {action['args']}")

print(f"Allowed decisions: {review_config['allowed_decisions']}")

# 生产环境中直接把中断发给前端

return {

"status": "interrupt",

"Tool": action['name'],

"Arguments": action['args'],

"Allowed decisions": review_config['allowed_decisions']

}

else:

pprint(result)

# 正常返回

return {

"status": "completed",

"message": result.value["messages"][-1].content

}

def resume(decisions):

config = {"configurable": {"thread_id": "generalzy"}}

result = agent.invoke(

Command(resume={"decisions": decisions}),

config=config,

version="v2",

)

# Check if execution was interrupted

if result.interrupts:

# Extract interrupt information

interrupt_value = result.interrupts[0].value

action_requests = interrupt_value["action_requests"]

review_configs = interrupt_value["review_configs"]

# Create a lookup map from tool name to review config

config_map = {cfg["action_name"]: cfg for cfg in review_configs}

# Display the pending actions to the user

for action in action_requests:

review_config = config_map[action["name"]]

print(f"Tool: {action['name']}")

print(f"Arguments: {action['args']}")

print(f"Allowed decisions: {review_config['allowed_decisions']}")

# 生产环境中直接把中断发给前端

return {

"status": "interrupt",

"Tool": action['name'],

"Arguments": action['args'],

"Allowed decisions": review_config['allowed_decisions']

}

else:

pprint(result)

# 正常返回

return {

"status": "completed",

"message": result.value["messages"][-1].content

}

def main():

result = chat()

if result["status"] == "completed":

print(result["message"])

elif result["status"] == "interrupt":

result = resume(decisions=[{"type": "approve"}])

print(result["message"])

print("bye bye!")

if __name__ == '__main__':

main()

可以看到,我们在前端允许了add操作,后台agent自然进行了一次Tool Call得到了ToolMessage:

其他类型的中断处理大致一样,这里就不再赘述!

子 Agent 中的中断(Subagent interrupts)

在使用 子 Agent(subagents) 时,可以在两种地方使用中断:

- 工具调用时触发中断(Interrupts on tool calls)

- 工具内部触发中断(Interrupts within tool calls)

工具调用时的中断(Interrupts on tool calls)

每个 子 Agent 都可以拥有自己的 interrupt_on 配置,用于 覆盖主 Agent 的设置:

agent = create_deep_agent(

tools=[delete_file, read_file],

interrupt_on={

"delete_file": True,

"read_file": False,

},

subagents=[{

"name": "file-manager",

"description": "Manages file operations",

"system_prompt": "You are a file management assistant.",

"tools": [delete_file, read_file],

"interrupt_on": {

# 覆盖设置:在这个子 agent 中读取文件也需要审批

"delete_file": True,

"read_file": True, # 与主 agent 不同

}

}],

checkpointer=checkpointer

)

含义是:

主 Agent:

delete_file → 需要审批

read_file → 不需要审批

子 Agent:

delete_file → 需要审批

read_file → 需要审批

当 子 Agent 触发中断 时,处理方式与普通 Agent 相同:

- 在结果中检查

result.interrupts - 使用

Command(resume=...)恢复执行

工具内部触发中断(Interrupts within tool calls)

子 Agent 的工具也可以 直接调用 interrupt() 来暂停执行并等待用户审批。

示例:

from langchain.agents import create_agent

from langchain_anthropic import ChatAnthropic

from langchain.messages import HumanMessage

from langchain.tools import tool

from langgraph.checkpoint.memory import InMemorySaver

from langgraph.types import Command, interrupt

from deepagents.graph import create_deep_agent

from deepagents.middleware.subagents import CompiledSubAgent

定义一个需要审批的工具:

@tool(description="Request human approval before proceeding with an action.")

def request_approval(action_description: str) -> str:

"""使用 interrupt() 请求人工审批"""

# interrupt() 会暂停执行,并返回 Command(resume=...) 中传入的值

approval = interrupt({

"type": "approval_request",

"action": action_description,

"message": f"Please approve or reject: {action_description}",

})

if approval.get("approved"):

return f"Action '{action_description}' was APPROVED. Proceeding..."

else:

return f"Action '{action_description}' was REJECTED. Reason: {approval.get('reason', 'No reason provided')}"

完整示例

def main():

checkpointer = InMemorySaver()

model = ChatAnthropic(

model_name="claude-sonnet-4-6",

max_tokens=4096,

)

compiled_subagent = create_agent(

model=model,

tools=[request_approval],

name="approval-agent",

)

parent_agent = create_deep_agent(

checkpointer=checkpointer,

subagents=[

CompiledSubAgent(

name="approval-agent",

description="An agent that can request approvals",

runnable=compiled_subagent,

)

],

)

thread_id = "test_interrupt_directly"

config = {"configurable": {"thread_id": thread_id}}

print("Invoking agent - sub-agent will use request_approval tool...")

result = parent_agent.invoke(

{

"messages": [

HumanMessage(

content="Use the task tool to launch the approval-agent sub-agent. "

"Tell it to use the request_approval tool to request approval for 'deploying to production'."

)

]

},

config=config,

version="v2",

)

检测中断并恢复执行

# 检查是否触发中断

if result.interrupts:

interrupt_value = result.interrupts[0].value

print("\nInterrupt received!")

print(f" Type: {interrupt_value.get('type')}")

print(f" Action: {interrupt_value.get('action')}")

print(f" Message: {interrupt_value.get('message')}")

print("\nResuming with Command(resume={'approved': True})...")

result2 = parent_agent.invoke(

Command(resume={"approved": True}),

config=config,

version="v2",

)

if not result2.interrupts:

print("\nExecution completed!")

# 找到工具执行结果

tool_msgs = [m for m in result2.value.get("messages", []) if m.type == "tool"]

if tool_msgs:

print(f" Tool result: {tool_msgs[-1].content}")

else:

print("\nAnother interrupt occurred")

else:

print("\n No interrupt - the model may not have called request_approval")

运行输出示例

Invoking agent - sub-agent will use request_approval tool...

Interrupt received!

Type: approval_request

Action: deploying to production

Message: Please approve or reject: deploying to production

Resuming with Command(resume={'approved': True})...

Execution completed!

Tool result: Great! The approval request has been processed. The action "deploying to production" was APPROVED. You can now proceed with the production deployment.

在工具函数内部调用:

interrupt({...})

这种方式更灵活,可以:

- 动态构造审批信息

- 实现复杂的 human-in-the-loop 流程

- 自定义审批逻辑

interrupt_on和 interrupt的使用场景

1️⃣ interrupt_on(Agent 自动拦截工具调用)

如果你配置了:

interrupt_on = {

"delete_file": True

}

当 Agent 准备调用这个工具时,LangGraph 会 自动触发 interrupt。

返回的数据类似:

{

"action_requests": [

{

"name": "delete_file",

"args": {"path": "temp.txt"}

}

],

"review_configs": [

{

"action_name": "delete_file",

"allowed_decisions": ["approve","reject","edit"]

}

]

}

特点:

- 不需要在工具里写

interrupt() - 在 工具调用之前暂停

- 属于 Agent runtime 控制

流程:

LLM

↓

决定调用 tool

↓

interrupt_on 拦截

↓

interrupt

↓

等待用户 approve

↓

resume

↓

真正执行 tool

2️⃣ 工具内部 interrupt()(工具主动暂停)

如果你在工具里写:

approval = interrupt({

"type": "approval_request",

"action": "deploy",

})

此时:

- 工具执行过程中暂停

- interrupt 返回的是你传入的数据

例如:

{

"type": "approval_request",

"action": "deploy"

}

恢复时:

Command(resume={"approved": True})

这个数据会返回给:

approval = interrupt(...)

也就是说:

approval == {"approved": True}

特点:

- 完全自定义 interrupt 数据

- 在 工具内部逻辑中断

实际生产系统一般同时用两种

例如安全 Agent:

run_shell → interrupt_on

deploy_prod → interrupt_on

而发布流程:

create_release

↓

interrupt() 请求审批

interrupt() 实际做的是:

raise GraphInterrupt

LangGraph 捕获后:

保存 graph state

返回 interrupt

暂停执行

resume 时:

恢复 graph stack

继续执行

所以它其实是 Graph execution pause。

Streaming(流式输出V2)

该功能要求:

LangGraph >= 1.1

并且需要在调用 stream() 或 astream() 时指定:

version="v2"

在 v2 版本中,所有返回的数据块都采用统一格式:

{

"type": "values" | "updates" | "messages" | "custom" | "checkpoints" | "tasks" | "debug",

"ns": (), # namespace(子图时会使用)

"data": ..., # 实际数据(取决于 stream mode)

}

其中:

| 字段 | 含义 |

|---|---|

type |

数据类型 |

ns |

命名空间(子图事件会使用) |

data |

具体数据 |

每种 stream mode 对应一个 TypedDict 类型:

ValuesStreamPartUpdatesStreamPartMessagesStreamPartCustomStreamPartCheckpointStreamPartTasksStreamPartDebugStreamPart

这些类型可以从langgraph.types导入。

所有类型的联合类型是:

StreamPart

它是一个 以 part["type"] 为判别字段的联合类型(discriminated union),因此在编辑器或类型检查器中可以实现 精确的类型推断(type narrowing)。

v1 与 v2 的区别

默认版本是 v1,其输出结构会根据 streaming 配置发生变化,例如:

- 单个 mode → 返回原始数据

- 多个 mode → 返回

(mode, data) - subgraph → 返回

(namespace, data)

而 v2 的格式始终统一:

for chunk in graph.stream(inputs, stream_mode="updates", version="v2"):

print(chunk["type"]) # "updates"

print(chunk["ns"]) # ()

print(chunk["data"]) # {"node_name": {"key": "value"}}

由于 type 字段是判别字段,可以按类型分支处理数据:

for part in graph.stream(

{"topic": "ice cream"},

stream_mode=["values", "updates", "messages", "custom"],

version="v2",

):

if part["type"] == "values":

# 完整 state 快照

print(f"State: topic={part['data']['topic']}")

elif part["type"] == "updates":

# 仅包含节点更新的数据

for node_name, state in part["data"].items():

print(f"Node `{node_name}` updated: {state}")

elif part["type"] == "messages":

# LLM message chunk

msg, metadata = part["data"]

print(msg.content, end="", flush=True)

elif part["type"] == "custom":

# 自定义流式数据

print(f"Progress: {part['data']['progress']}%")

Stream 模式(Stream modes)

在调用 stream() 或 astream() 方法时,可以传入一个 stream modes 列表,用于指定你希望接收的流式数据类型。

| Mode | Type | 说明 |

|---|---|---|

values |

ValuesStreamPart |

每一步执行后返回 完整的 state |

updates |

UpdatesStreamPart |

每一步执行后返回 state 的更新部分。同一步中多个更新会分别流式输出 |

messages |

MessagesStreamPart |

LLM 调用产生的 (token, metadata) 二元组 |

custom |

CustomStreamPart |

通过 get_stream_writer() 从节点中发送的 自定义数据 |

checkpoints |

CheckpointStreamPart |

Checkpoint 事件(格式与 get_state() 相同),需要配置 checkpointer |

tasks |

TasksStreamPart |

任务开始/结束事件,包含执行结果和错误信息,需要 checkpointer |

debug |

DebugStreamPart |

所有可用信息(包含 checkpoints 和 tasks,并附加额外 metadata) |

这些 stream modes 本质上是在解决一个问题:

Agent / Graph 执行过程中,你希望实时看到什么信息?

不同 mode 对应 不同粒度的运行信息。如果你在做 Agent 平台 / UI / 调试工具,这些 mode 的用途会非常明显。

生产环境最常用的是这四个:

messages

updates

values

custom