大模型必读:一文读懂向量Embedding与RAG,新手进阶建议收藏

很多人第一次接触大模型,会把注意力放在“生成”上:它为什么能写方案、改代码、做客服、答法律问题。

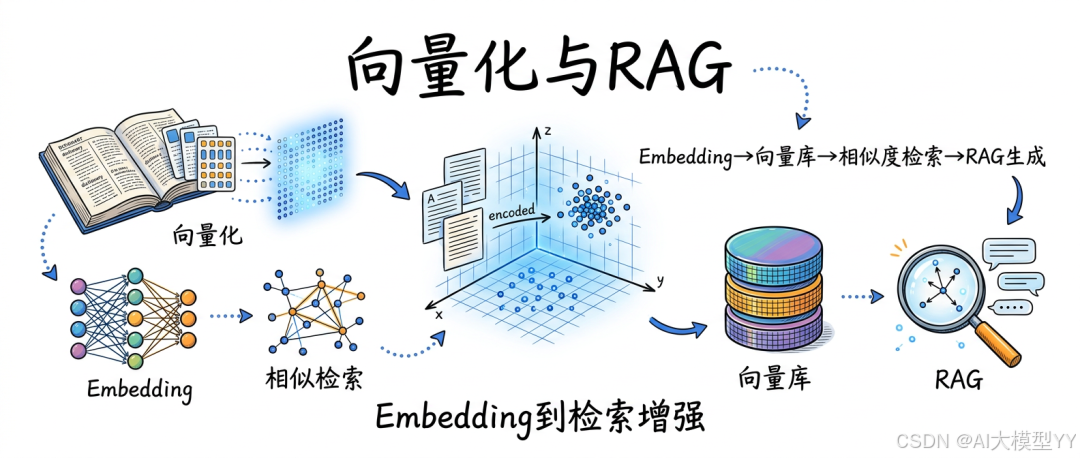

但如果把大模型比作一家大型咨询公司,真正决定它“看懂了什么、记住了什么、能不能在海量资料里找到答案”的,不是嘴巴,而是它的“坐标系统”——Vector Embedding(向量嵌入,简单说,就是把文字、图片、音频这些人类内容,翻译成机器能计算的数字坐标)。

今天的 AI 应用,尤其是 RAG(Retrieval-Augmented Generation,检索增强生成,可以理解成“先查资料,再带着资料回答”),本质上都建立在这套坐标系统上。没有向量,模型只能“会说”;有了向量,它才开始“会找、会比、会联想”。

更重要的是,这已经不是实验室话题,而是一个快速变成基础设施的产业:

- Vector Database(向量数据库,专门用来存储和检索这些“语义坐标”的数据库)市场在 2024–2025 年约为 22–25.8 亿美元;

- 2026 年预计到 32 亿美元;

- 到 2032 年可能到 100–110 亿美元,年复合增长率约 21%–22%。

来源:Fortune Business Insights,Vector Database Market

链接:https://www.fortunebusinessinsights.com/vector-database-market-112428

来源:Actian Dev,What’s Changing in Vector Databases in 2026

链接:https://dev.to/actiandev/whats-changing-in-vector-databases-in-2026-3pbo

这篇文章,我想把几个问题一次讲透:

- 向量到底是什么,为什么它比关键词更接近“理解”?

- Embedding(把内容变成数字坐标)为什么从 Word2Vec(早期词向量方法,可理解为“让机器通过词和词经常一起出现的关系来认识意义”)一路演进到 Transformer(当前主流大模型架构,像一个会前后文一起看的阅读系统),再到多模态统一空间(让文字、图片、音频进入同一张“意义地图”)?

- OpenAI、Gemini、Cohere、Voyage 这些主流 embedding 模型/服务提供商,差别到底在哪里?

- RAG 的完整链路究竟怎么工作,为什么很多项目“看起来做了 RAG,实际效果却很一般”?

- 向量化的边界是什么,哪些坑是产品经理和技术负责人最容易踩的?

一、什么是向量化:机器如何给“意义”定位

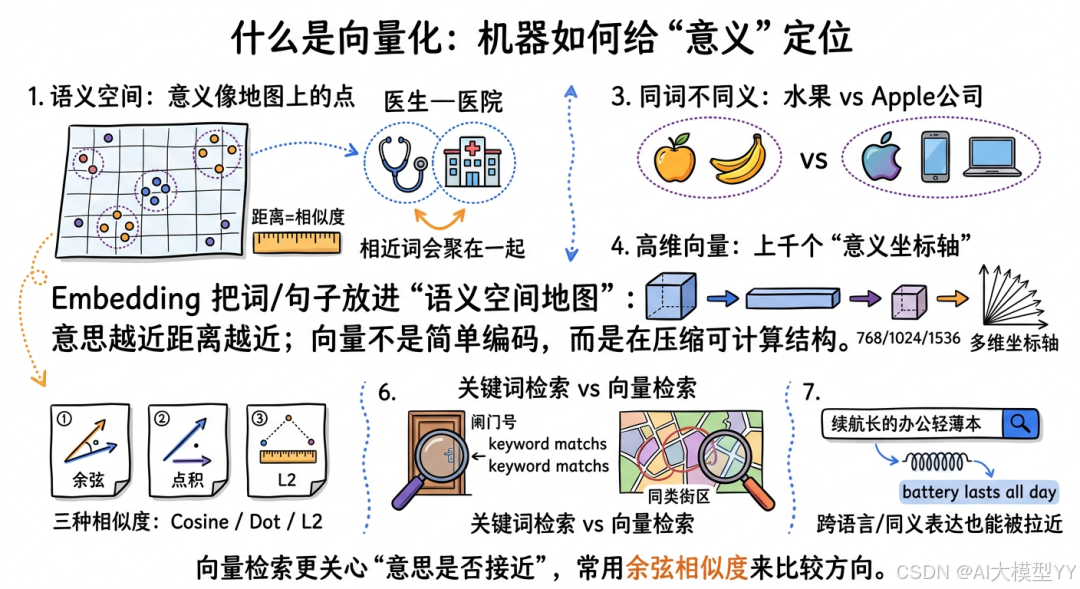

如果你把每个词都当成地图上的一个点,Embedding 做的事,就是把“意义相近”的词放得更近,把“意义相反或无关”的词放得更远。

比如:

- “医生”和“医院”应该靠近;

- “苹果(水果)”和“香蕉”应该靠近;

- “苹果(Apple 公司)”又可能和“iPhone”“MacBook”更近。

这就是语义空间(semantic space,像一张看不见的地图)。

在这张地图里,文字不再是字符串,而是一串浮点数(带小数的数字坐标),比如 768 维、1024 维、1536 维。你可以把它理解成:不是用经纬度 2 个数字定位,而是用上千个“意义坐标轴”同时定位。

一个最常见的误解是:向量就是“给文本编码”。

不完全对。更准确地说,向量是在压缩“意义结构”。

就像外卖平台不会真的理解“这家店温暖治愈、适合下雨天吃”,但它可以通过海量行为数据,知道“搜索番茄牛腩的人也常点罗宋汤”。Embedding 也类似:它并不“像人一样思考”,但它能把语义相关性变成可计算的距离。

常见的相似度计算方式有三种:

- Cosine Similarity(余弦相似度,比较两个方向是否接近,像看两支箭头是否指向同一边)

- Dot Product(点积,同时比较方向和“劲儿”的大小)

- L2 Distance(欧氏距离,直接比较两点物理距离)

在文本检索里,最常用的是 Cosine Similarity,因为我们通常更关心“意思是否接近”,而不是数值本身有多大。

一个非常直观的比喻是:

关键词搜索像“按字面找门牌号”;

向量搜索像“按你想去的那类街区找地方”。

所以用户搜“续航长的办公轻薄本”,即便文档里没写“续航长”,但写了“battery lasts all day”,向量也可能把它们拉近。

来源:IBM,What is Vector Embedding?

链接:https://www.ibm.com/think/topics/vector-embedding

来源:The New Stack,The Building Blocks of LLMs: Vectors, Tokens and Embeddings

链接:https://thenewstack.io/the-building-blocks-of-llms-vectors-tokens-and-embeddings/

来源:Stack Overflow Blog,An intuitive introduction to text embeddings

链接:https://stackoverflow.blog/2023/11/09/an-intuitive-introduction-to-text-embeddings/

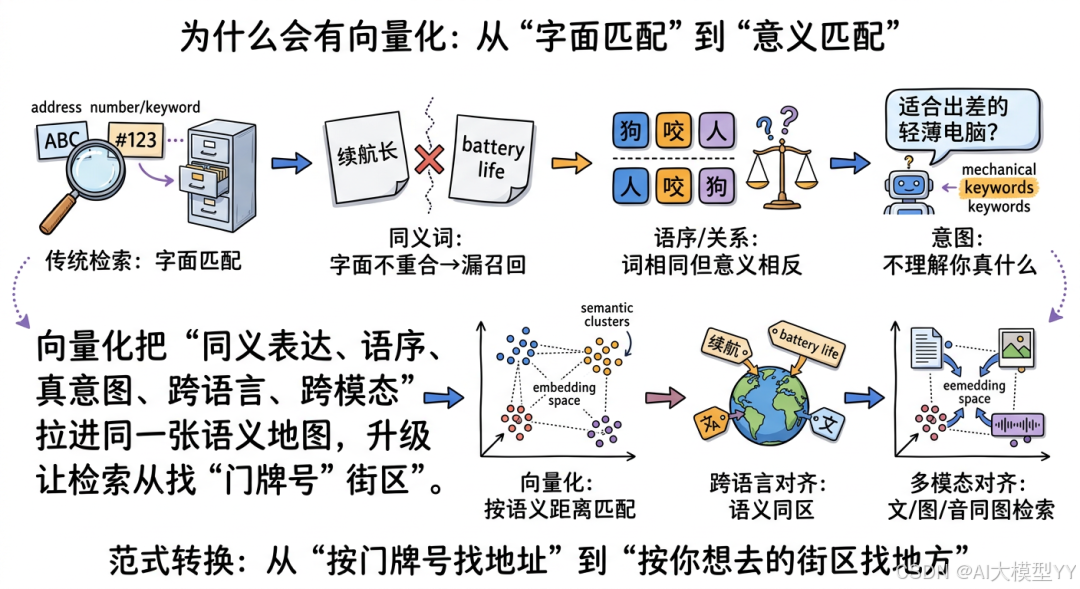

补充一:为什么会有向量化:从"字面匹配"到"意义匹配"

如果把传统关键词搜索想成“拿着一串门牌号找地址”,它的优点是简单、快、可控;但一旦用户的问题开始接近自然语言,它的天花板也会立刻暴露。

第一,同义词经常搜不到。用户搜“续航长”,文档里写的是 “battery life”;用户搜“裁员”,材料里写的是“组织优化”;字面不重合,系统就容易漏掉真正相关的内容。第二,很多传统检索对语序并不敏感,或者说敏感度远低于语义本身。“狗咬人”和“人咬狗”包含相同的词,但意义完全相反;如果系统主要按词频和命中率算分,就很难稳定区分。第三,它不理解查询意图。用户问“适合出差用的轻薄电脑”,真正想找的可能是轻、稳、续航长、开会方便,而不是网页里机械出现过“出差”“轻薄”四个字的内容。

这正是向量化出现的背景。它先解决的是语义理解:不是看你有没有用同一个词,而是看你是不是在说同一件事。于是“续航长”和 “battery life lasts all day” 会被拉到更近的位置;“退款规则”和“退货政策”也更容易互相召回。

再往前一步,向量空间天然适合做跨语言对齐。中文里的“续航”、英文里的 “battery life”、其他语言里的相近表达,只要语义接近,就可以被压到同一片区域。对全球化产品、跨境电商、跨语言知识库来说,这意味着搜索不再被语言边界硬切开。

更重要的是,向量化最终把多模态也带进了同一张地图。文字可以变向量,图片可以变向量,音频也可以变向量;只要模型把它们对齐到同一语义空间里,系统就能做到“用一句话找图片”“上传一张图找说明文档”“根据一段语音找相关会议纪要”。这已经不是单纯的搜索优化,而是在重写机器理解信息的接口。

所以,向量化真正带来的,不只是“搜索更聪明了一点”,而是一种范式转换:

从“按门牌号找地址”,变成“按你想去的街区找地方”。

来源:IBM,What is Vector Embedding?

链接:https://www.ibm.com/think/topics/vector-embedding

来源:Stack Overflow Blog,An intuitive introduction to text embeddings

链接:https://stackoverflow.blog/2023/11/09/an-intuitive-introduction-to-text-embeddings/

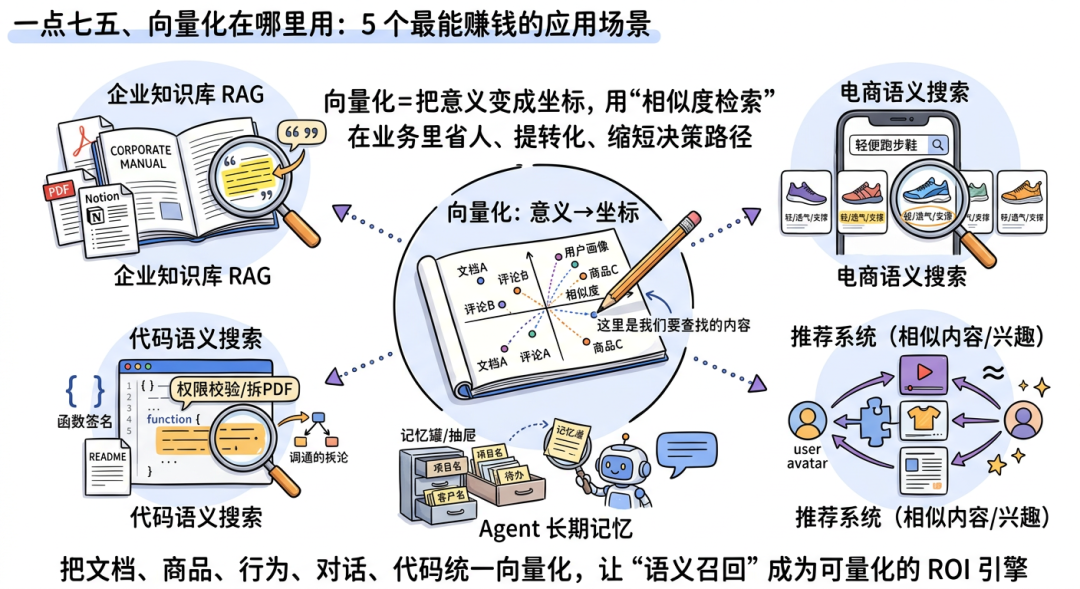

补充二:向量化在哪里用:5 个最能赚钱的应用场景

如果说向量化是“把意义变成坐标”,那它最有商业价值的地方,往往不是论文里,而是那些每天都在帮企业省人、提转化、缩短决策路径的业务环节。下面这 5 类,是今天最常见、也最容易直接看到 ROI 的场景。

1. 企业知识库 RAG

这是很多公司最先落地的方向:把制度、SOP、产品文档、客服话术向量化,让 AI 助手先查资料再回答。它的价值不只是“回答更像人”,而是把原本分散在 PDF、Notion、工单系统里的知识,变成一个可检索、可引用、可持续更新的统一入口。

2. 电商语义搜索

用户搜“适合跑步的轻便鞋”,真正想找的是轻、透气、支撑好、适合运动,而不一定是标题里正好出现“跑步”“轻便鞋”这几个词。向量搜索能把商品描述、评论、标签和用户意图拉到一起,因此更容易把“不写这些词、但确实符合需求”的商品找出来。

3. 推荐系统

“看过这个的人也喜欢”背后,很多时候本质就是向量相似度:内容像不像、用户兴趣像不像、行为轨迹像不像。无论是短视频、资讯、电商还是音乐平台,只要要做“相似内容推荐”,向量几乎都是底层标配。

4. Agent 长期记忆

AI 助手如果每次对话都像“失忆”,就很难真的成为工作助手。把对话历史、用户偏好、任务上下文向量化后,系统就能在下一次对话里按语义召回关键记忆,像“回忆起”你上次提过的项目、客户和待办事项。

5. 代码搜索

开发者不一定记得函数名,但往往记得“我要找一个做权限校验的模块”或“一个把 PDF 拆页的工具函数”。把代码注释、函数签名、README 和调用关系一起向量化后,团队就可以用自然语言找代码,而不是靠记忆翻仓库。

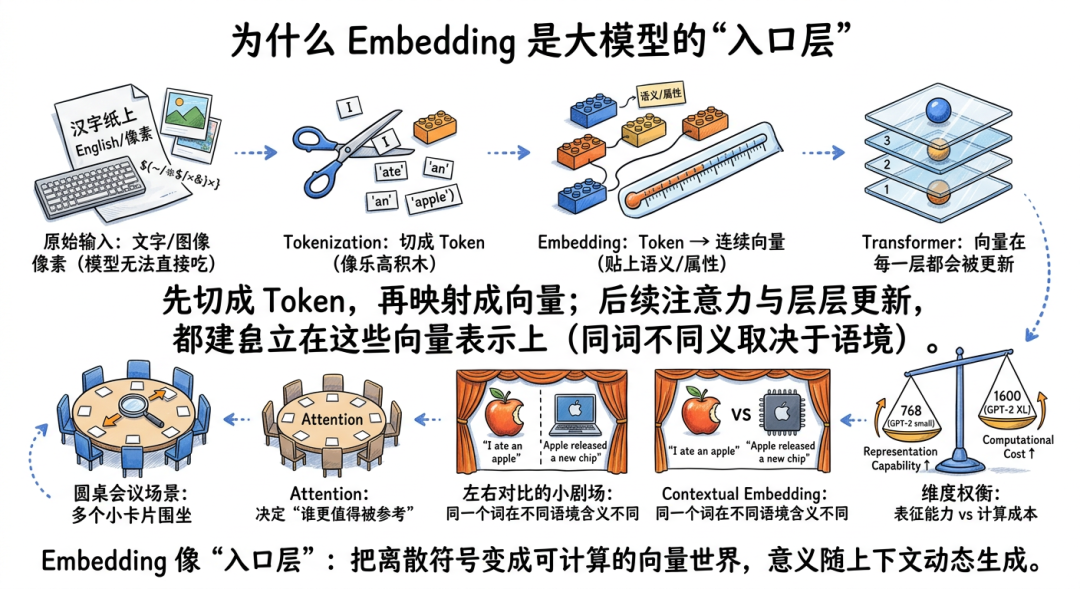

二、为什么 Embedding 是大模型的“入口层”

大模型不能直接处理汉字、英文单词、图片像素。

它首先要做两步:

- Tokenization(分词/切词,把输入拆成更小的处理单元)

- Embedding(嵌入,把这些离散单元变成连续向量)

你可以把 Token 想成“乐高积木块”,把 Embedding 想成“给每块积木贴上物理属性和语义属性标签”。

模型后面所有的注意力机制(Attention,像团队开会时决定“谁更值得被重点参考”)都建立在这些向量之上。

在早期模型里,一个 token 对应一个相对固定的向量。

但在 Transformer(当前主流大模型架构)里,向量不只是“入场券”,它还会在每一层网络里被不断更新。也就是说,同一个词在不同上下文中,最终形成的表示会不同。

最经典的例子是“Apple”:

- 在 “I ate an apple” 里,它更接近水果;

- 在 “Apple released a new chip” 里,它更接近科技公司。

这就是 Contextual Embedding(上下文化嵌入,意思是“词的意义要看语境”)。

如果说 Word2Vec 时代的词向量像“给每个人发一张静态身份证”,那 Transformer Embedding 更像“根据今天所处场景,动态生成的一张身份画像”。

关于维度,一个公开常被引用的例子是 GPT-2 small 的 embedding 维度为 768,GPT-2 XL 为 1600。这个数字本身不是“越大越强”,但它大致反映了模型表征能力和计算成本之间的平衡。

来源:Mike X Cohen,LLM breakdown #36: Embeddings

链接:https://mikexcohen.substack.com/p/llm-breakdown-36-embeddings

来源:HatchWorks,Large Language Models Guide

链接:https://hatchworks.com/blog/gen-ai/large-language-models-guide/

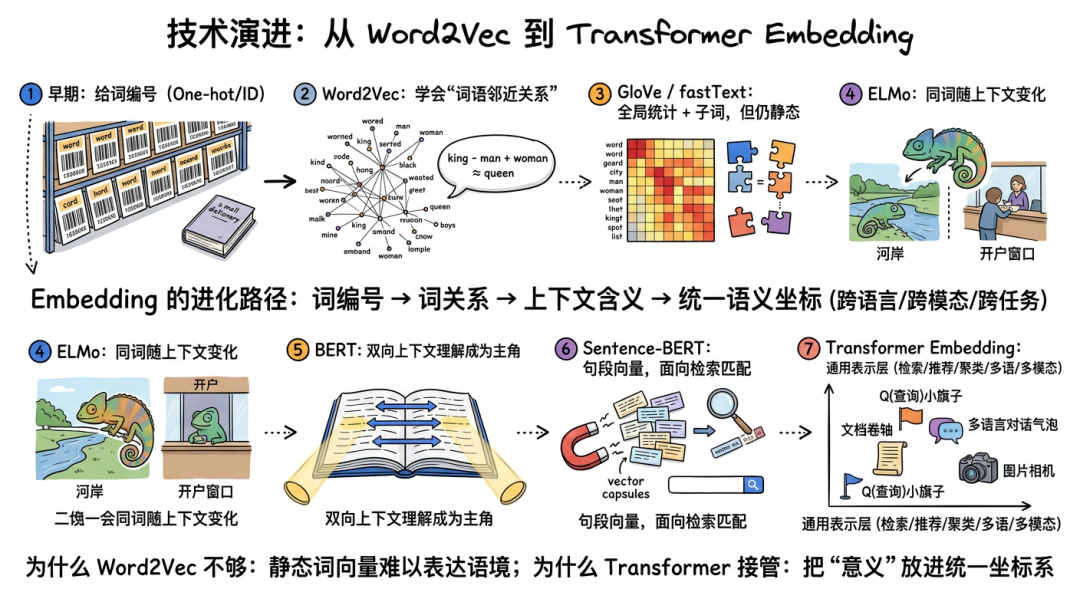

三、技术演进:Word2Vec 为什么不够,Transformer 为什么接管一切

如果把 Embedding 的历史压缩成一句话,就是:

从“给词编号”,到“给词建模”,再到“给上下文建模”,最后走向“给世界建统一坐标”。

1. Word2Vec:第一次让机器学会“词语邻近关系”

Word2Vec(早期词向量方法,像让机器根据“谁经常和谁一起出现”来画关系图)的重要性,不在于今天还在不在用,而在于它第一次证明:

只要喂给模型足够多上下文,它就能学出“国王 - 男 + 女 ≈ 女王”这种结构化关系。

它的核心思想很朴素:

- CBOW(Continuous Bag of Words,连续词袋,可以理解成“看周围词,猜中间这个词是什么”)根据上下文猜中心词;

- Skip-gram(跳字模型,可以理解成“给你中心词,反过来猜它常和谁一起出现”)根据中心词猜上下文。

白话说,像让一个新员工通过同事关系图,慢慢学会“谁和谁是一个部门、谁和谁经常一起出现”。

但它的问题也很明显:

- 一个词只有一个向量;

- 不理解上下文;

- 对长句子、段落、文档的表达能力有限。

2. GloVe / fastText:补结构、补子词,但还是“静态世界”

GloVe(基于全局共现统计的词向量方法,像先看整张城市热力图,再决定词和词该离多近)更强调全局共现统计;

fastText(把词拆成更小的字片段来学习的词向量方法,像不只认识整词,还认识词的“零件”)引入子词信息,对拼写变化、低频词和多语言更友好。

但它们本质上仍然属于 Static Embedding(静态嵌入):

“银行”不管出现在“河岸边的银行”还是“去银行开户”,向量基本是同一个。

3. ELMo / BERT / Sentence-BERT:上下文成为主角

ELMo(早期上下文化词表示模型,意思是“同一个词会随句子环境变化”)、BERT(Bidirectional Encoder Representations from Transformers,双向编码器表征模型)和 Sentence-BERT(专门把整句、整段压成更适合检索的向量模型)代表了一个关键转折点。

它们不再只问“这个词通常是什么意思”,而是问“这个词在这句话里是什么意思”。

再往后,Sentence-BERT 这类模型开始专门优化句子级和段落级向量,让它更适合 search(搜索)、matching(匹配)、retrieval(检索)这些真实业务。

4. Transformer Embedding:从“词向量”变成“通用表示层”

今天主流 Embedding 模型几乎都建立在 Transformer 家族之上。

它们的特点不是只会做词表示,而是能做:

- query embedding(查询向量,把用户问题变成坐标)

- document embedding(文档向量,把资料内容变成坐标)

- instruction-tuned embedding(带任务偏好的向量,像“先告诉模型这次是做检索,再去编码”)

- multilingual embedding(多语言向量,让不同语言的相近意思落到相近位置)

- multimodal embedding(多模态向量,让文字、图片、音频等内容进入同一张地图)

这意味着 Embedding 已经不是语言模型的附属品,而是 Retrieval(检索)、Recommendation(推荐)、Clustering(聚类,也就是把相似内容自动分堆)、Reranking(重排,把候选结果再排一次)甚至 Agent memory(智能体记忆,可以理解成给 AI 建一个可检索的外部笔记本)的基础层。

来源:OpenLayer,What are Embedding Models? Complete Guide

链接:https://www.openlayer.com/blog/post/what-are-embedding-models-complete-guide

来源:BentoML,A Guide to Open-Source Embedding Models

链接:https://www.bentoml.com/blog/a-guide-to-open-source-embedding-models

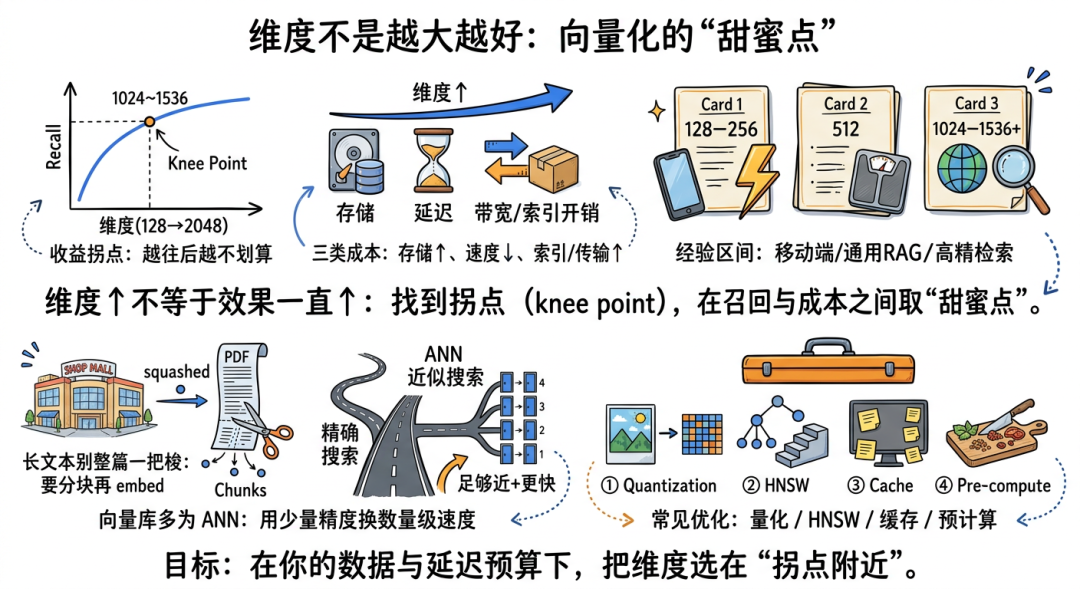

四、维度不是越大越好:向量化里的“甜蜜点”

很多团队第一次做向量检索,特别容易陷入一个直觉:

维度越大,信息越丰富,效果一定越好。

这句话只对了一半。

维度(dimension,向量长度,可以理解成“描述一个对象用了多少个特征刻度”)越大,确实有机会容纳更细腻的语义差异;但同时也会带来三类成本:

- 存储成本上升

- 检索速度下降

- 索引和网络传输开销增加

公开实践里,经常会提到一个“knee point”(拐点,意思是投入继续增加,但收益开始明显变小)。

也就是当维度从 512 提升到 1024 时,Recall(召回率,能不能把相关结果找回来)可能提升明显;但从 1536 再到更高,收益可能开始趋缓。

一个常见经验区间是:

- 向量维度: 128–256,典型场景: 移动端、实时 API(程序调用接口,像系统之间的标准插座),优点: 延迟低、索引小,代价: 语义容易“糊”

- 向量维度: 512,典型场景: 通用 RAG,优点: 精度/成本平衡较好,代价: 复杂语境略吃亏

- 向量维度: 1024–1536+,典型场景: 多语言、多模态、高精度检索,优点: 召回高、上下文表达更强,代价: 存储贵、检索慢

还有两个经常被忽略的现实问题:

第一,长文本不是“整篇一把梭”就能 embed

Embedding 模型即便支持长上下文,也不意味着你应该把几十页 PDF 整体编码成一个向量。

因为一个向量只能代表一个“综合语义中心”,内容越长,主题越混杂,就越像“把整栋商场压缩成一个坐标”,最后什么都不够精准。

第二,向量数据库不是“精确搜索”,而是“近似搜索”

生产环境里,大家用的通常是 ANN(Approximate Nearest Neighbor,近似最近邻搜索,意思是“不求 100% 找到最接近的点,但求足够快地找到非常接近的点”)。

这是一个典型工程妥协:用极少量精度损失,换取数量级的性能提升。

常见优化手段包括:

- Quantization(量化,把浮点数压缩成 int8/fp16,像把高清照片压缩到肉眼几乎看不出差异的程度)

- HNSW(分层近邻图索引,像先走高速路定位大概区域,再走小路找具体门牌)

- Cache(缓存高频查询,相当于把常被问的问题先放到手边)

- Pre-computation(预计算,提前把热门内容向量化,像先把常用食材切好备菜)

来源:Artsmart,Top Embedding Models in 2025

链接:https://artsmart.ai/blog/top-embedding-models-in-2025/

来源:Milvus,We Benchmarked 20 Embedding APIs with Milvus

链接:https://milvus.io/blog/we-benchmarked-20-embedding-apis-with-milvus-7-insights-that-will-surprise-you.md

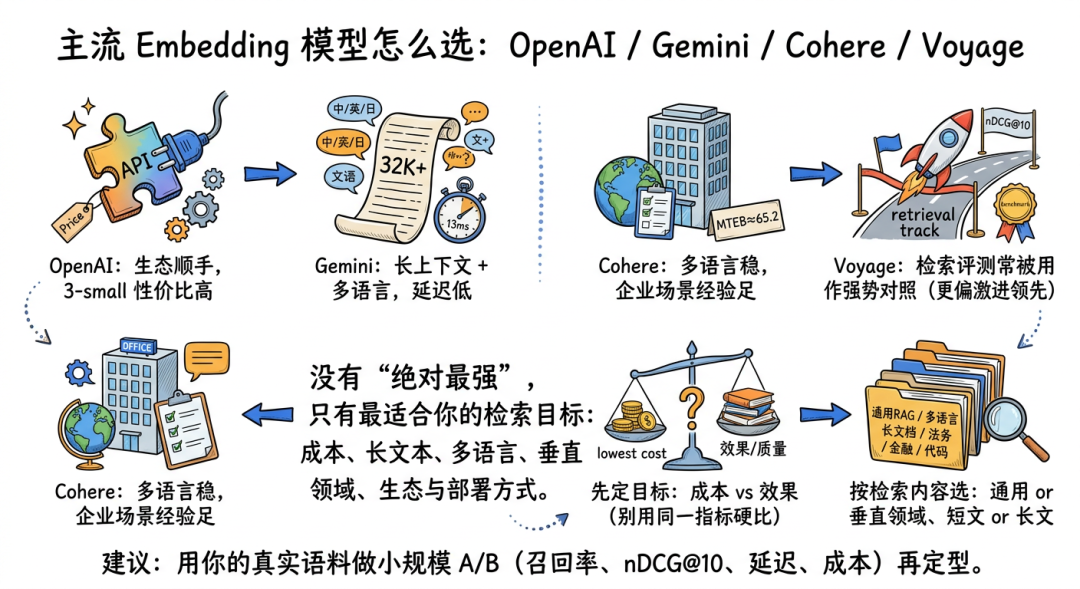

五、主流 Embedding 模型横评:OpenAI、Gemini、Cohere、Voyage 怎么选

说结论之前,先说一句最重要的话:

没有“绝对最强”的 embedding model,只有“最适合你的 retrieval target(检索目标,也就是你到底想把什么内容找回来)”。

因为你真正优化的,可能不是同一个指标:

- 有的人要 lowest cost(最低成本)

- 有的人要 long context(长文本支持)

- 有的人要 multilingual(多语言)

- 有的人要 legal / finance / code 这类垂直领域效果

- 有的人要 self-hosted(私有部署,自己掌控运行环境)

但如果只看 2025 年公开 benchmark(基准测试,可以理解成统一考场里的公开成绩单)和对比数据,四家商业模型大概可以这样理解。

1. OpenAI:生态友好,text-embedding-3-small 性价比极高

OpenAI 的优势不是“所有榜单第一”,而是“整体够强 + 生态最顺手”。

公开数据里:

| text-embedding-3-small | 1536 维 | 可降维,最大输入 8191 tokens | 约 $0.02 / 1M tokens |

| text-embedding-3-large | 3072 维 | 可降维,最大输入 8191 tokens | 约 $0.13 / 1M tokens |

- 在一些公开对比中,

text-embedding-3-large的 MTEB(Massive Text Embedding Benchmark,文本向量综合评测基准,可以理解成 embedding 界的“高考总分榜”)约 64.6

如果你的目标是:

- 英文或中英混合知识库

- 成本敏感的通用 RAG

- 已经在 OpenAI 生态里开发应用

那 3-small 反而常常比 3-large 更值得先试。

来源:Dataa.dev,Embedding Models Compared: OpenAI vs Cohere vs Voyage vs Open Source

链接:https://dataa.dev/2025/01/17/embedding-models-compared-openai-vs-cohere-vs-voyage-vs-open-source/

来源:AIlog,Choosing Embedding Models

链接:https://app.ailog.fr/en/blog/guides/choosing-embedding-models

2. Gemini:长上下文和多语言是亮点,延迟也很漂亮

Google Gemini 的 embedding 路线,最大的吸引力在于:

- context length(上下文长度)更长,公开资料中可到 32K+

- multilingual(多语言)表现强

- 在一些对比中平均延迟可低至 13ms

如果你的文档有明显的跨语言特性,比如中文、英文、日文混合知识库,或者企业搜索场景里资料非常长,Gemini 很值得重点测试。

但从某些公开 ELO(原本用于棋手强弱排名的积分法,这里可理解为“模型对战积分”)和 nDCG@10(归一化折损累计增益,简单理解为“排在前面的结果到底准不准”)对比看,Gemini 在部分 retrieval 评测上并不总是领先。

来源:Agentset,voyage-3-large vs gemini-text-embedding-004

链接:https://agentset.ai/embeddings/compare/voyage-3-large-vs-gemini-text-embedding-004

来源:Slashdot Compare,Gemini Embedding vs voyage-3-large

链接:https://slashdot.org/software/comparison/Gemini-Embedding-vs-voyage-3-large/

3. Cohere:多语言传统强项明显,企业场景一直有存在感

Cohere 一直是 embedding 赛道的老牌选手。

公开比较里,embed-v4 在多语言任务上表现稳定,MTEB 约 65.2,在某些统计里甚至略高于 OpenAI text-embedding-3-large 的 64.6。

它的特点更像“均衡型选手”:

- 多语言覆盖广

- 企业搜索场景经验足

- 对文本理解任务比较稳

短板也比较现实:

- 在一些 retrieval benchmark 上,不如 Voyage 那么激进领先

- 上下文长度和成本表现,视具体版本和套餐而变化较大

来源:AIlog,Choosing Embedding Models

链接:https://app.ailog.fr/en/blog/guides/choosing-embedding-models

来源:ZenML,Best Embedding Models for RAG

链接:https://www.zenml.io/blog/best-embedding-models-for-rag

4. Voyage:如果你要“检索精度优先”,它经常会进入第一候选

在很多 2025 年公开对比里,Voyage 的 voyage-3-large 是 retrieval 场景的“明星选手”。

公开数据大致包括:

- 1024 维

- 最大输入 32K tokens

- 价格约 $0.18 / 1M tokens

- ELO 约 1528

- nDCG@10 约 0.837

- 某些平均域任务上比 OpenAI v3-large 高约 9.74%

- 相比 Cohere v3 平均高约 20.71%

- 在 law、finance、code 等场景表现突出

如果你做的是“文档检索质量直接决定业务价值”的系统,比如:

- 法律检索

- 金融研究助手

- 代码知识库

- 企业内部复杂 SOP(Standard Operating Procedure,标准操作流程,可理解为公司内部“照着做就不会错”的步骤文档)检索

Voyage 往往值得把预算倾斜过去。

但代价也明显:

- 单价更高

- 延迟通常高于 Gemini

- 你需要确认 ROI(投入产出比)是否真能覆盖成本

来源:Agentset,voyage-3-large vs gemini-text-embedding-004

链接:https://agentset.ai/embeddings/compare/voyage-3-large-vs-gemini-text-embedding-004

来源:SourceForge Compare,Gemini Embedding vs voyage-3-large

链接:https://sourceforge.net/software/compare/Gemini-Embedding-vs-voyage-3-large/

一张表看懂四家主流模型

数据来源:OpenAI/Google/Cohere/Voyage 官方文档 + MTEB 基准测试 + Dataa.dev 对比报告(2025)

那开源呢?

如果你对成本、隐私和可控性更敏感,开源 embedding 已经非常能打。

2025 年公开讨论里,Qwen3-Embedding-8B、BGE-M3 等都被频繁提及,特别适合:

- 本地部署

- 数据不出域

- 大规模离线向量化

- 对 API 成本敏感的 SaaS 产品

但要提醒一句:

开源不是“免费午餐”。你省下 API 账单,可能会换成 GPU、运维、评测、模型升级和量化部署成本。

来源:Tavily Search Snippet,Best Embedding Models for 2025

链接:https://www.baseten.co/blog/the-best-open-source-embedding-models/

来源:Towards AI,Building a Modern RAG Pipeline in 2026: Qwen3 Embeddings and Vector Database in Qdrant

链接:https://pub.towardsai.net/building-a-modern-rag-pipeline-in-2026-qwen3-embeddings-and-vector-database-in-qdrant-ebeca2bbe338

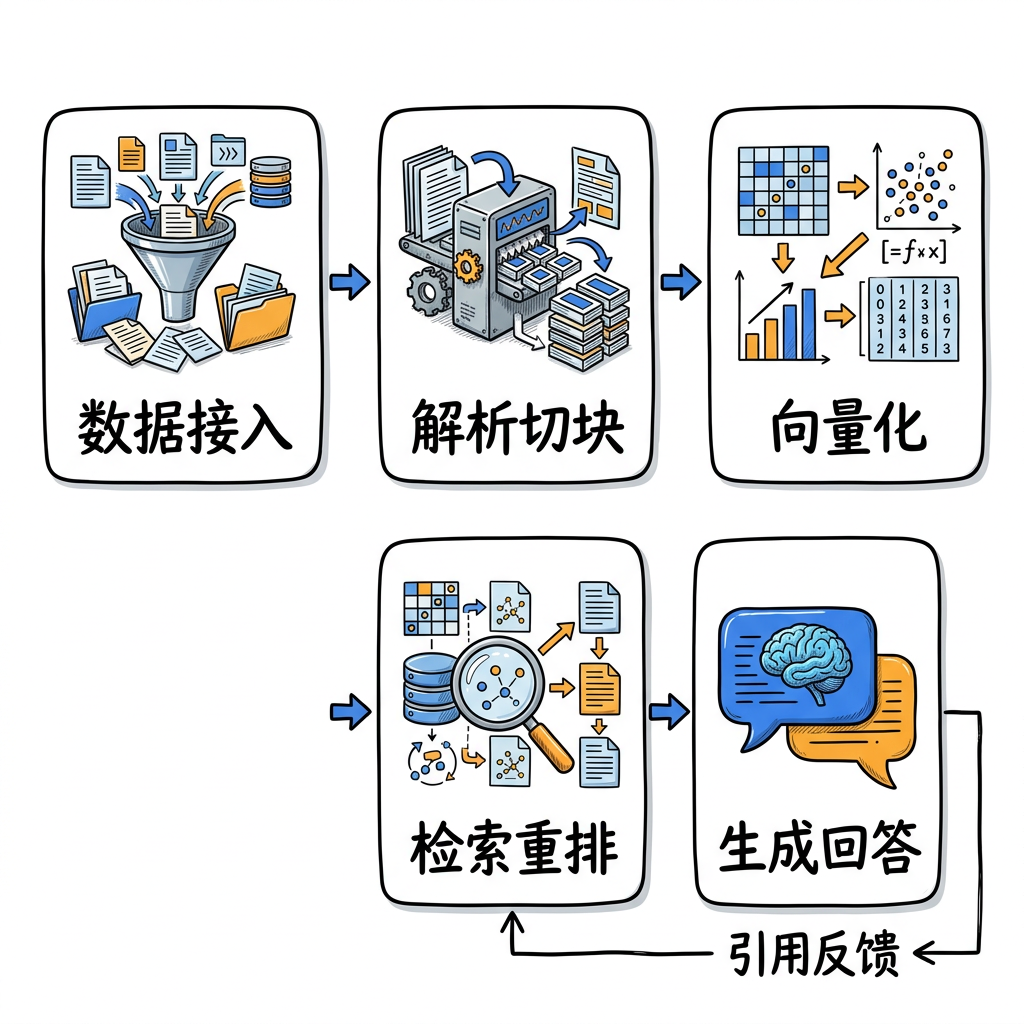

六、从 Embedding 到 RAG:真正的完整链路长什么样

如果只用一句话定义 RAG,它就是:

“先把企业知识变成可检索的向量,再把检索结果喂给生成模型回答。”

但真正上线过的人都知道,RAG 从来不只是“向量检索 + 大模型”这么简单。

它是一条完整的生产流水线。

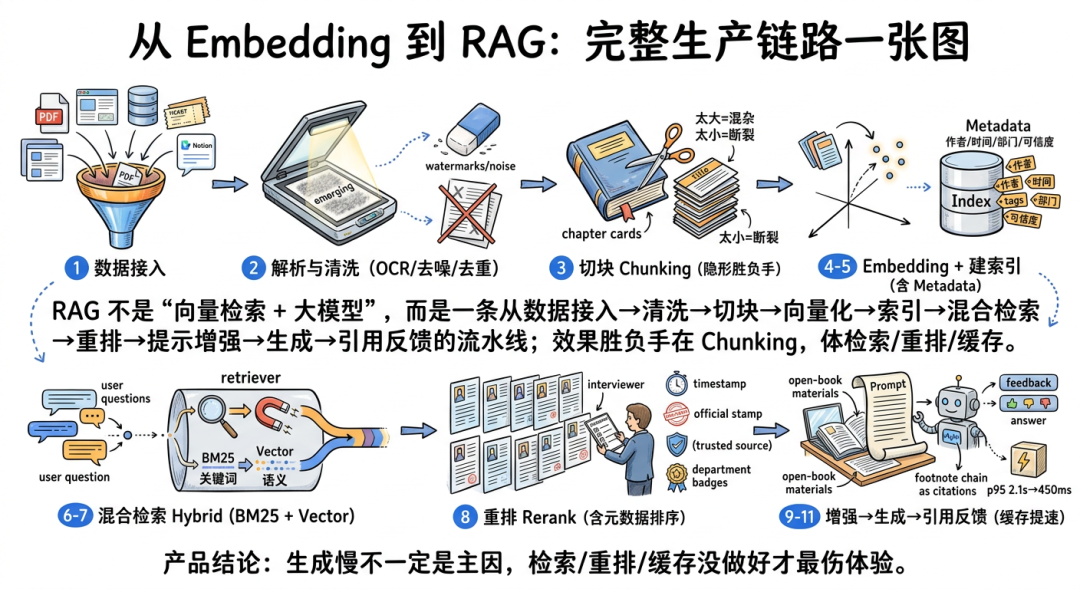

RAG 完整链路

步骤1 → 数据接入(PDF、网页、数据库、工单、飞书/Notion 文档进入系统)

步骤2 → 解析与清洗(OCR,光学字符识别,像把扫描图片里的字重新“抄”成可编辑文本;再做去噪、去模板页、去重复)

步骤3 → 切块 Chunking(把长文档切成可检索的小段,就像把一本书拆成便于查找的章节卡片)

步骤4 → 向量化 Embedding(每个 chunk 变成语义坐标)

步骤5 → 建索引(写入向量数据库,并附 metadata 元数据,也就是“文档的说明标签”,如作者、时间、部门、可信度)

步骤6 → 用户提问(query 查询也被向量化,变成同一套坐标里的一个点)

步骤7 → 检索 Retrieval(按向量相似度,或 BM25 + Vector hybrid 混合检索;BM25 是经典关键词检索算法,可以理解成“按关键词命中率和重要性打分”)

步骤8 → 重排 Rerank(第二轮“复审”,让更相关、更权威、更新的内容排前面)

步骤9 → 增强 Augmentation(把检索片段拼进 prompt 提示词;prompt 就是你给模型的指令和上下文,这一步很像“开卷考试前,把参考资料摊到桌上”)

步骤10 → 生成 Generation(LLM 基于外部资料回答)

步骤11 → 引用与反馈(附来源、记录点击、用户纠错、进入评估闭环)

为什么切块是 RAG 的“隐形胜负手”

Chunking(切块)最像“把一本书拆成便于检索的章节卡片”。

- 切得太大,语义太混;

- 切得太小,上下文断裂。

这就是很多团队 RAG 效果差的根源:

不是模型不够强,而是块切坏了。

例如:

- FAQ(Frequently Asked Questions,常见问题清单)适合小块、精确匹配

- 法律合同适合按条款/章节切

- 技术文档适合按标题层级切

- 代码知识库适合按函数、类、模块切

为什么混合检索比纯向量更稳

BM25 擅长找精确字面匹配;

向量检索擅长找语义相近内容。

两者混合,像“一个实习生负责找关键词,一个资深顾问负责找意思相近的材料”,组合起来更稳。

2025 年很多 RAG 最佳实践都在强调 Hybrid Retrieval(混合检索),常见权重如 0.3 的 BM25 + 0.7 的 Vector。

这对客服、知识库、企业文档搜索特别有效。

为什么重排是“第二次拯救结果”的机会

向量检索通常负责粗召回:先找一批“可能相关”的文档。

但最终给 LLM 的上下文窗口很有限,所以你还需要 Reranker(重排模型,像二面面试官,负责从候选人里挑出最该上场的几个)。

尤其在多主题知识库里,加入 metadata-aware ranking(基于元数据的排序,也就是参考作者、时间、部门、来源等“说明标签”来排结果)很关键,比如:

- 时间新的优先

- 官方文档优先

- 可信来源优先

- 当前用户部门相关内容优先

一个经常被忽略的数据现实

公开实践数据显示:

- retrieval 阶段常见延迟大约 50–200ms

- generation 阶段常见为 1–5s

- 对高频问题做缓存和预热,可以把 p95 latency(95 分位延迟,理解成“绝大多数用户体感到的慢”)从 2.1s 降到 450ms

这说明一个非常关键的产品结论:

RAG 的用户体验,往往不是败在“模型思考太慢”,而是败在“检索、重排、缓存没做好”。

来源:Google Cloud,Optimizing RAG Retrieval

链接:https://cloud.google.com/blog/products/ai-machine-learning/optimizing-rag-retrieval

来源:Morphik,Retrieval-Augmented Generation Strategies

链接:https://www.morphik.ai/blog/retrieval-augmented-generation-strategies

来源:Tomoro AI,Retrieval-Augmented Generation in 2025

链接:https://tomoro.ai/insights/retrieval-augmented-generation-in-2025

来源:Towards AI,RAG Techniques You Must Know in 2025

链接:https://towardsai.net/p/machine-learning/rag-techniques-you-must-know-in-2025

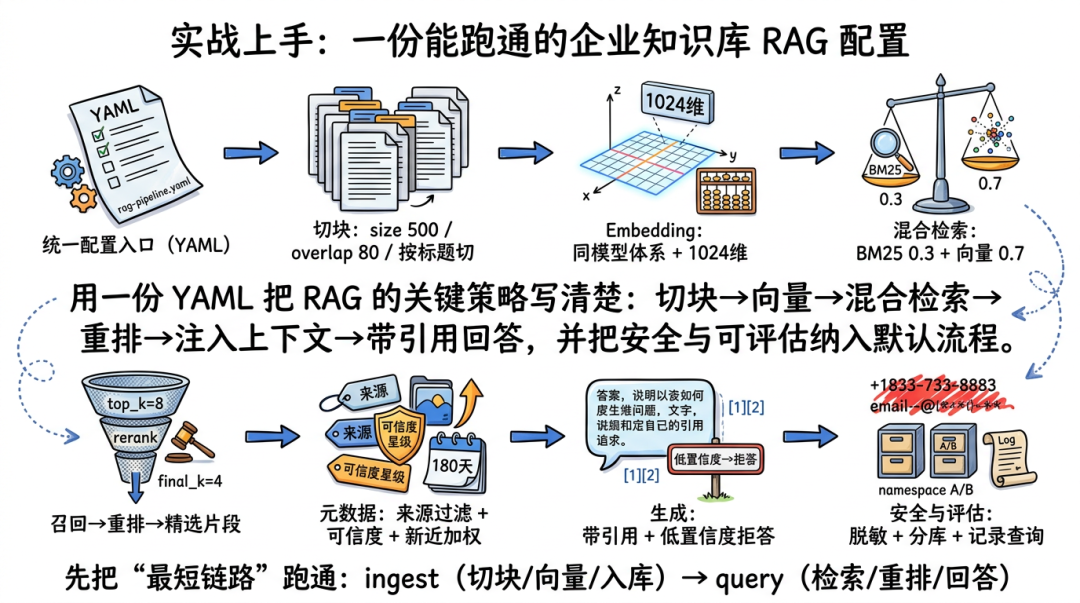

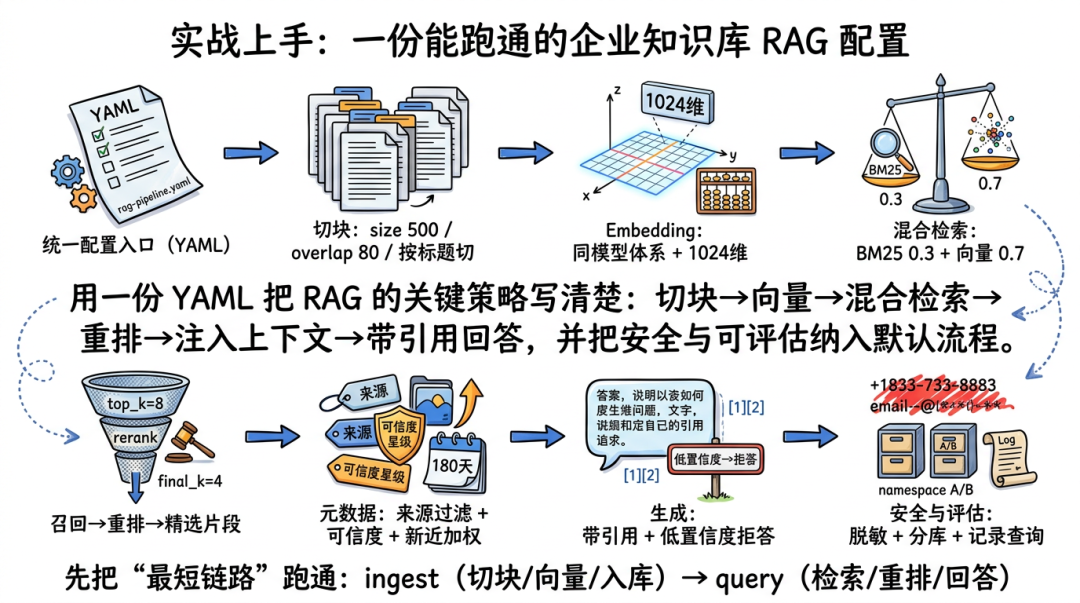

七、实战上手:一个能跑通的 RAG 配置长什么样

很多人读完理论,最大的问题其实是:

“所以我到底该怎么配置?”

下面给一个非常实用的“通用企业知识库 RAG”思路。

这里用到 Qdrant(开源向量数据库,专门用来存储和过滤高维向量,像一个特别擅长按“意思相近”找资料的仓库)作为向量库;用 OpenAI embedding 作为示例模型。你也可以替换成 Gemini、Voyage 或开源模型。

示例一:RAG 流水线 YAML 配置

是什么:这是一份 YAML(人能看懂的配置文件格式,像把系统开关写成清单)格式的 RAG pipeline 配置文件,用来统一定义“切块多大、用哪个 embedding、检索怎么加权、是否做脱敏”等关键参数。

为什么要这么做:RAG 项目最怕“参数散落在代码里”,后期没人知道为什么 top/_k 是 8、为什么 overlap 是 80。把策略写成 YAML,团队协作和 A/B 测试会轻松很多。

怎么用:把这份配置保存成文件,服务启动时读取;产品经理、算法工程师和后端都可以围绕同一份策略沟通。

```yamlembedding:provider: openai # 向量服务提供商;文档向量和查询向量必须使用同一模型体系model: text-embedding-3-small # 预算优先的通用模型;适合大多数知识库 RAGdimensions: 1024 # 降维后的向量长度;越小越省存储,但可能损失精度chunking:size: 500 # 每个 chunk 的 token 数;过大语义混杂,过小上下文断裂overlap: 80 # 相邻 chunk 重叠 token 数;避免重要信息被硬切断strategy: heading_aware # 按标题层级切块;适合技术文档、SOP、手册retrieval:mode: hybrid # 混合检索:关键词 BM25 + 向量检索bm25_weight: 0.3 # 关键词权重;精确术语命中更稳vector_weight: 0.7 # 向量权重;语义召回更强top_k: 8 # 初筛召回文档数;太小可能漏召回,太大增加后续成本reranker: cross_encoder # 重排模型;二次筛选更相关的片段final_k: 4 # 最终送给大模型的 chunk 数量metadata:filter_by_source: true # 是否允许按来源过滤,如 only_official_docstrust_score: true # 是否纳入可信度评分,如官方>社区>论坛recency_boost_days: 180 # 新近内容加权天数;适合版本变化快的产品文档generation:answer_with_citations: true # 让模型输出引用来源,降低“张口就来”的风险max_context_chunks: 4 # 上下文最多注入几段;太多会稀释重点并增加 token 成本refusal_when_low_confidence: true # 低置信度时允许模型明确说“不确定”security:redact_pii: true # 入库前脱敏;避免手机号、身份证、邮箱等直接进向量库separate_namespaces: true # 不同业务或租户分开存储,避免串库log_queries_for_eval: true # 记录查询用于后续评估,但需注意隐私合规```

上述配置保存到 /app/config/rag-pipeline.yaml。

示例二:Python 版最小可用 ingest + query 示例

是什么:这是一段 Python(常用编程语言) 的最小可用示意代码,展示“文档切块 → 生成向量 → 写入向量库 → 查询检索”的主干流程。

为什么要这么做:很多团队卡在“概念都懂,但链路串不起来”。把最短路径先跑通,比一开始追求完美架构更重要。

怎么用:把自己的文档解析结果替换 docs,把向量库连接替换成你的实际环境,然后先验证检索结果是否符合预期,再考虑 rerank、cache 和权限系统。

```pythonfrom openai import OpenAIfrom qdrant_client import QdrantClientfrom qdrant_client.models import Distance, VectorParams, PointStructimport uuidclient = OpenAI()qdrant = QdrantClient(url="http://localhost:6333")COLLECTION = "company_kb"qdrant.recreate_collection(collection_name=COLLECTION,vectors_config=VectorParams(size=1024, # 向量维度;要和 embedding dimensions 保持一致distance=Distance.COSINE # 相似度度量;文本检索常用 cosine))docs = [{"text": "退款政策:用户在购买后7天内可申请全额退款。","source": "policy_v3.md","category": "policy"},{"text": "企业版支持 SSO(单点登录)登录与审计日志导出。","source": "enterprise_features.md","category": "product"}]def embed_text(text: str):resp = client.embeddings.create(model="text-embedding-3-small",input=text,dimensions=1024)return resp.data[0].embeddingpoints = []for doc in docs:vector = embed_text(doc["text"])points.append(PointStruct(id=str(uuid.uuid4()),vector=vector,payload={"text": doc["text"], # 原始 chunk 文本"source": doc["source"], # 来源文件"category": doc["category"] # 元数据,方便过滤}))qdrant.upsert(collection_name=COLLECTION, points=points)query = "企业版能不能接公司统一登录?"query_vector = embed_text(query)hits = qdrant.search(collection_name=COLLECTION,query_vector=query_vector,limit=3)for hit in hits:print(hit.score, hit.payload["source"], hit.payload["text"])```

上述代码保存到 /app/examples/rag/_minimal/_demo.py。

这段代码故意没有一步到位加上:

- BM25 混合检索

- rerank

- 权限过滤

- 缓存

- 评测指标

因为真实项目里,第一步不是“做全”,而是“先确定检索是不是找对了东西”。

如果检索都不准,后面提示词工程(prompt engineering,也就是不断打磨“怎么问模型”这件事)再花哨也救不回来。

来源:Towards AI,Building a Modern RAG Pipeline in 2026: Qwen3 Embeddings and Vector Database in Qdrant

链接:https://pub.towardsai.net/building-a-modern-rag-pipeline-in-2026-qwen3-embeddings-and-vector-database-in-qdrant-ebeca2bbe338

来源:Google Cloud,How to use Grounding for your LLMs with text embeddings

链接:https://cloud.google.com/blog/products/ai-machine-learning/how-to-use-grounding-for-your-llms-with-text-embeddings

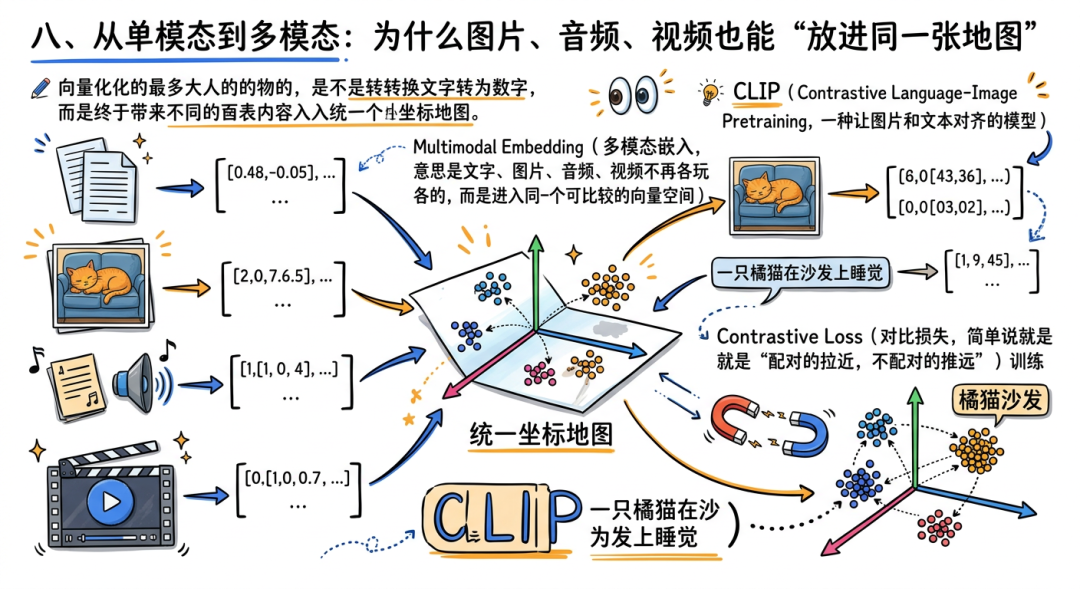

八、从单模态到多模态:为什么图片、音频、视频也能“放进同一张地图”

向量化最迷人的地方,不是把文本变成数字。

而是它最终把不同模态的内容,拉进了一张统一的坐标地图。

这就是 Multimodal Embedding(多模态嵌入,意思是文字、图片、音频、视频不再各玩各的,而是进入同一个可比较的向量空间)。

比如 CLIP(Contrastive Language-Image Pretraining,一种让图片和文本对齐的模型)做的事情就是:

- 给图片生成向量

- 给描述图片的文字也生成向量

- 用 Contrastive Loss(对比损失,简单说就是“配对的拉近,不配对的推远”)训练

- 最终让“一只橘猫在沙发上睡觉”这句话,和那张真实图片在向量空间里尽量靠近

这意味着什么?

意味着你可以做:

- text-to-image retrieval(用文字找图片)

- image-to-text retrieval(上传图片找相关文本)

- video semantic search(按片段意义搜视频)

- cross-modal recommendation(跨模态推荐,比如用户看了某类图片,也能推荐相关文字内容)

这会直接改变很多产品形态:

- 电商不再只是搜关键词,而是“拍照搜同款”

- 企业知识库可以“搜截图里的界面”

- 媒体平台可以“按场景情绪”搜视频素材

- 医疗或工业系统可以把图像、文本报告、设备日志统一检索

公开资料显示,OpenAI CLIP、EVA-CLIP/EVA-02、LLaVA-Next 等都在推动 text-image 对齐能力;更大的行业趋势则是迈向 unified multimodal space(统一多模态空间)。

这也是为什么 2025–2026 的搜索趋势里,越来越多人在谈“text is no longer enough”。

当语音、图片、视频和文档共同构成企业数据时,未来的“搜索框”会越来越像一个“万能输入框”。

来源:Artsmart,Top Embedding Models in 2025

链接:https://artsmart.ai/blog/top-embedding-models-in-2025/

来源:Pureinsights,7 Tech Trends in AI and Search for 2026

链接:https://pureinsights.com/blog/2026/7-tech-trends-in-ai-and-search-for-2026/

来源:TechTarget,4 trends that will shape data management and AI in 2026

链接:https://www.techtarget.com/searchdatamanagement/feature/4-trends-that-will-shape-data-management-and-AI-in-2026

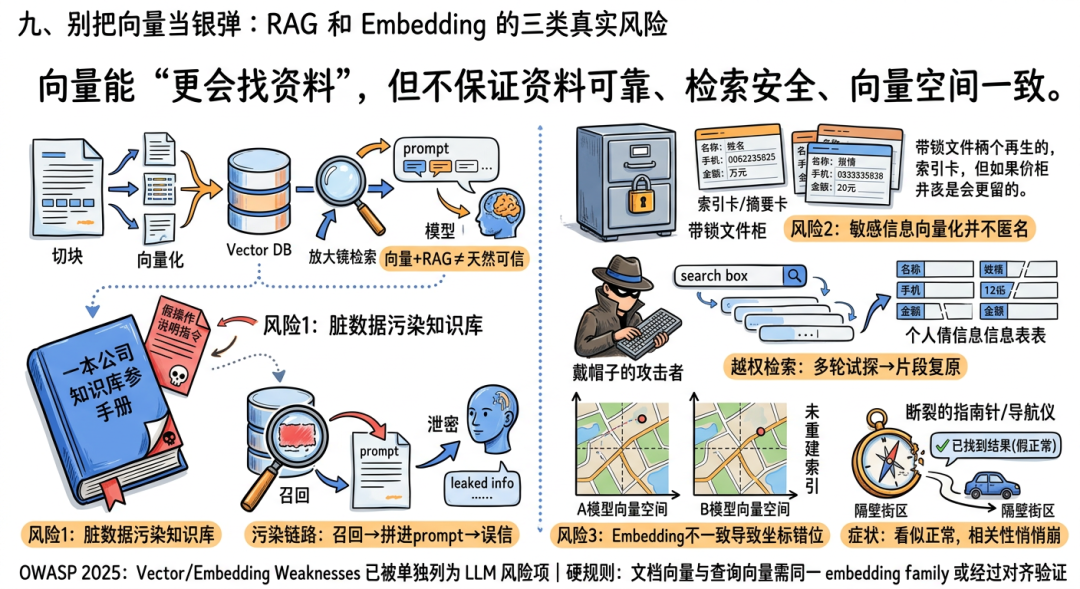

九、别把向量当银弹:RAG 和 Embedding 的三类真实风险

讲到这里,容易出现另一种误区:

只要上了 embedding + vector DB + RAG,答案就会更可靠。

事实是,向量会明显提升“找资料”的能力,但它不能天然解决“资料是否可靠、检索是否安全、上下文是否被污染”的问题。

OWASP(Open Web Application Security Project,开放式 Web 应用安全项目,业界常用的风险清单制定组织)在 2025 年已经把 Vector/Embedding Weaknesses(向量/嵌入弱点)单独列入 LLM 风险项。

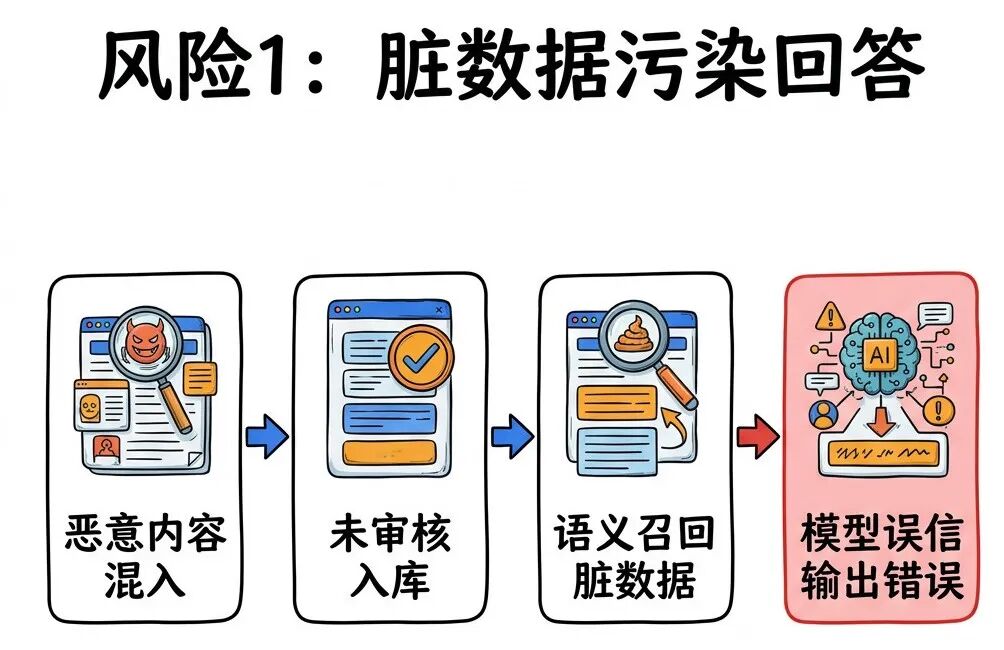

风险一:脏数据进入知识库,最后污染回答

这类问题最常见,也最容易被低估。你可以把它想成:有人偷偷把一张“假操作说明”塞进公司手册,之后每个来查手册的人都可能被带偏。

完整攻击链路是:

步骤1 → 恶意内容混入知识库

步骤2 → 正常切块向量化,未审核

步骤3 → 用户提问,脏内容被召回

步骤4 → 脏片段拼入 prompt

步骤5 → 模型误信恶意指令

步骤6 → 输出错误答案或泄密

这和传统搜索引擎被 SEO 垃圾页面污染很像。

只不过在 RAG 里,被污染的不只是“结果页排序”,而是模型生成本身。

来源:IronCore Labs,OWASP LLM Top 10 2025 Update

链接:https://ironcorelabs.com/blog/2025/owasp-llm-top10-2025-update/

来源:OWASP GenAI,LLM Risk

链接:https://genai.owasp.org/llmrisk/llm08-excessive-agency/

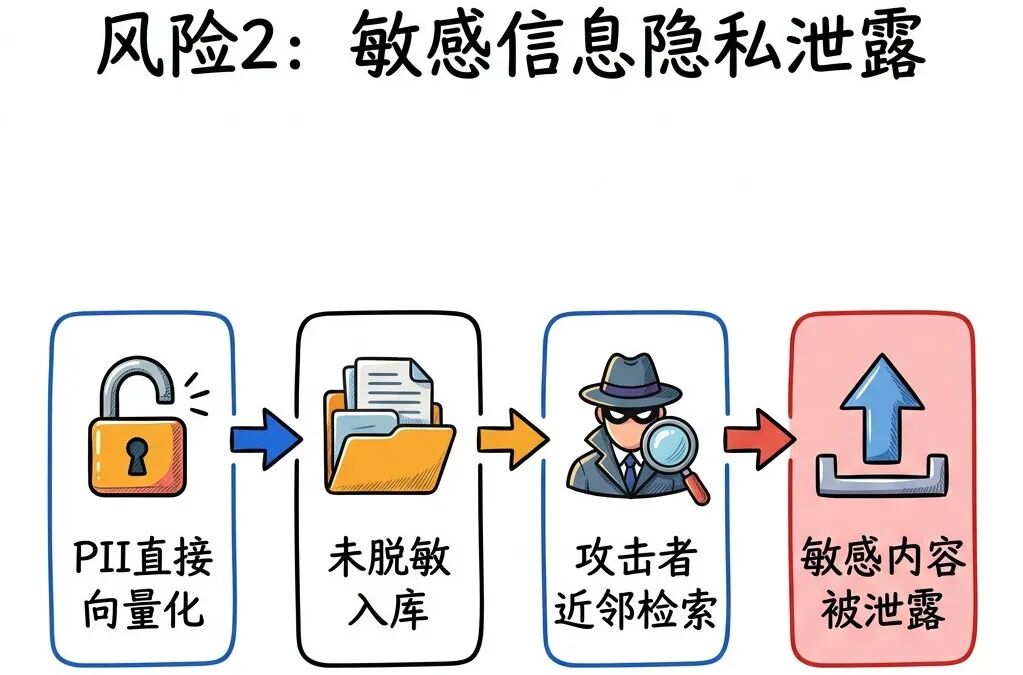

风险二:敏感信息直接向量化,可能导致隐私泄露

很多团队会误以为:“我存的是向量,不是原文,所以安全。”

这其实是一种危险的乐观。更贴切的比喻是:你把文件锁进柜子里了,但柜子上还贴着索引卡和部分摘要;真正被拿走的,往往是这些“顺手就能读懂”的内容。

完整攻击链路是:

步骤1 → 敏感文档直接向量化

步骤2 → 向量连同 payload 入库

步骤3 → 越权接口暴露检索结果

步骤4 → 多轮试探逼近敏感信息

步骤5 → 片段与字段被拼接复原

步骤6 → 无权限用户看到隐私内容

向量不是明文,但也绝不是天然匿名化。

尤其当你把向量和原文 payload 绑定存储时,真正暴露的往往不是向量本身,而是“检索后返回的上下文”。

来源:IronCore Labs,OWASP LLM Top 10 2025 Update

链接:https://ironcorelabs.com/blog/2025/owasp-llm-top10-2025-update/

来源:arXiv,RAG/LLM system risks and evaluation discussions

链接:https://arxiv.org/abs/2501.07391

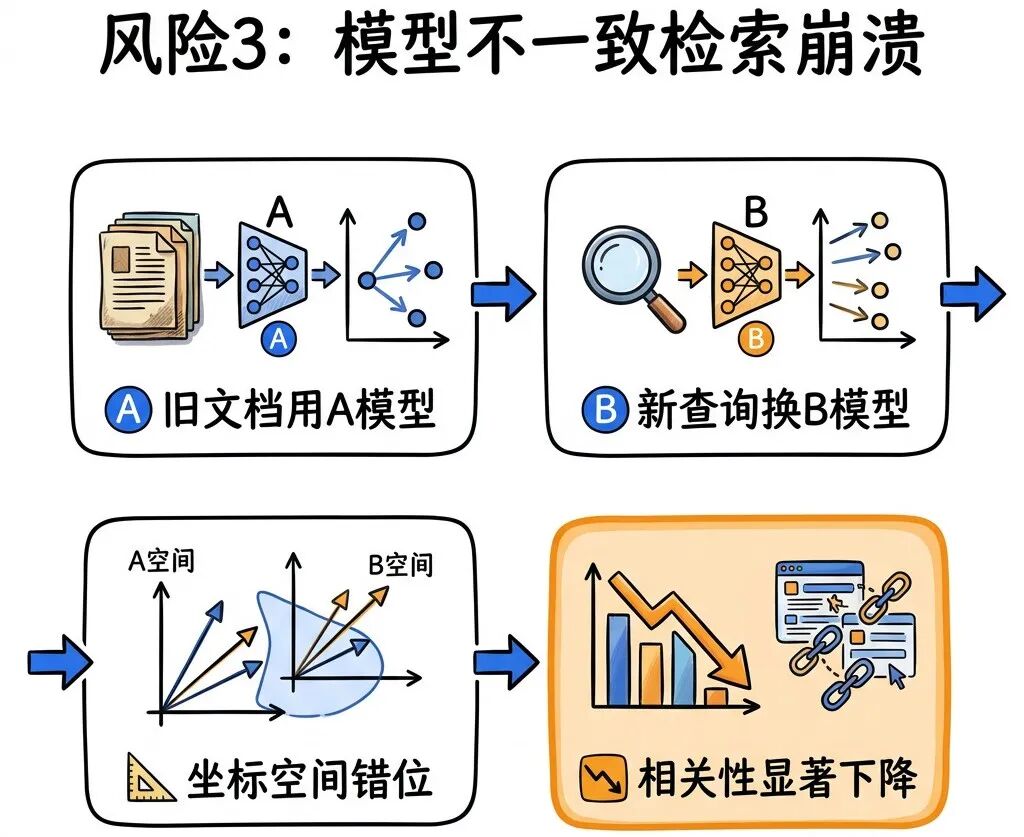

风险三:模型和向量空间不一致,检索效果会悄悄崩掉

这是一个很工程、但极其常见的坑。它不像“系统直接报错”那么明显,更像导航软件还能给你路线,但其实把你带到了隔壁街区。

完整失效链路是:

步骤1 → 旧库用 A模型 产文档向量

步骤2 → 新查询改用 B模型

步骤3 → 团队未重建索引

步骤4 → 查询与文档坐标错位

步骤5 → 系统仍返回结果,假正常

步骤6 → 相关性下降,团队误调参

所以请记住一个硬规则:

文档向量和查询向量,必须来自同一 embedding family(同一套向量模型体系,像同品牌同标尺的地图),或经过明确对齐验证。

来源:Milvus,We Benchmarked 20 Embedding APIs with Milvus

链接:https://milvus.io/blog/we-benchmarked-20-embedding-apis-with-milvus-7-insights-that-will-surprise-you.md

来源:BentoML,A Guide to Open-Source Embedding Models

链接:https://www.bentoml.com/blog/a-guide-to-open-source-embedding-models

那应该怎么防?

最实用的办法,不是“追求绝对安全”,而是建立最小闭环:

- 入库前:清洗、脱敏、去重、内容审查

- 入库时:metadata 打标、租户隔离、来源可信度标注

- 检索时:权限过滤、敏感分级、hybrid retrieval(混合检索)

- 生成时:要求引用来源、低置信度拒答

- 运营时:保留 telemetry(可观测日志和运行指标,像给系统装“行车记录仪”)、做周级失败分析和重训

这套闭环的本质不是防黑客玄学,而是把 RAG 从“演示系统”变成“可运营系统”。

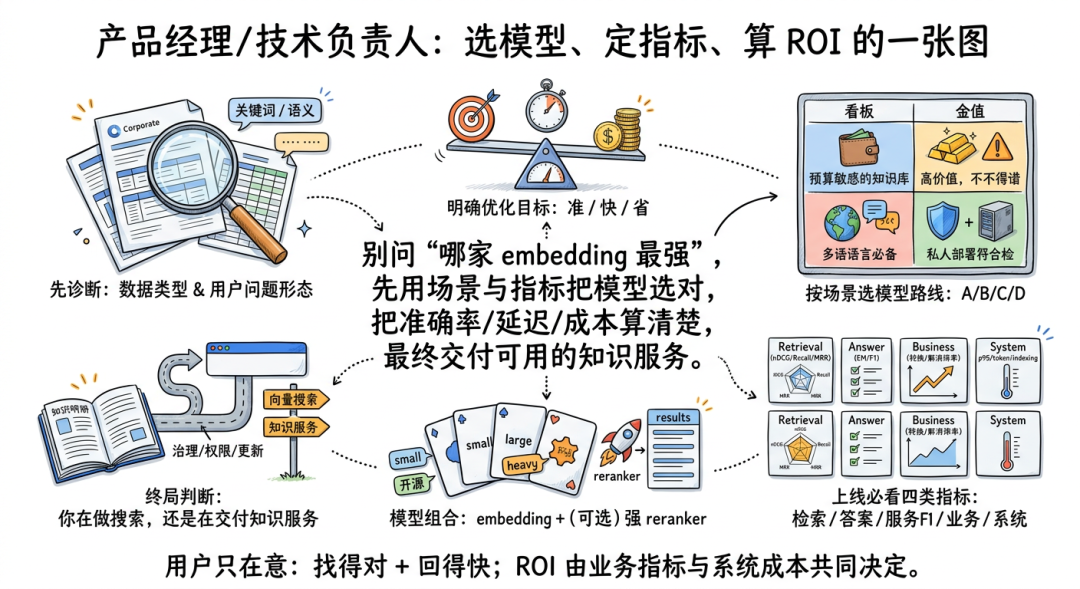

十、产品经理和技术负责人真正该关心的:如何选模型、定指标、算 ROI

如果你是产品经理,最容易问错的问题是:

“哪家 embedding 最强?”

真正有用的问题应该是:

- 我的数据是什么类型?

- 我的用户问题是关键词型,还是语义型?

- 我要优化的是准确率、延迟、还是成本?

- 我需不需要多语言、长文本、多模态?

- 我的评测集准备好了吗?

一个实用决策框架

场景 A:预算敏感的企业知识库

优先试:

- OpenAI

text-embedding-3-small - BGE / Qwen3 等开源方案

原因:

- 成本可控

- 足够覆盖多数 FAQ / SOP / Help Center 场景

- 适合先跑 MVP(最小可用产品)

场景 B:高价值检索,答案错不起

优先试:

- Voyage-3-large

- 再搭配强 reranker

原因:

- 检索精度直接决定业务价值

- 法律、金融、代码类文档,对“前几条结果是否真相关”极其敏感

场景 C:全球化产品,多语言是刚需

优先试:

- Gemini embedding

- Cohere embed-v4

- 开源 BGE-M3

原因:

- 多语言覆盖和跨语言语义对齐更重要

- 不要只看英文 leaderboard(排行榜)

场景 D:私有部署、强合规

优先试:

- Qwen3-Embedding

- BGE-M3

- 配合 Qdrant / Weaviate / pgvector 等自托管方案

原因:

- 数据不出域

- 权限控制更灵活

- 能更深度结合企业现有数据栈

指标别只看一个 MTEB 分数

Benchmark 很重要,但别把 leaderboard 当圣旨。

真正上线时,你至少要看四类指标:

- Retrieval quality:nDCG@10、Recall@k(前 k 个结果里找回了多少相关内容)、MRR(Mean Reciprocal Rank,平均倒数排名,简单理解为“第一个正确结果排得够不够靠前”)

- Answer quality:Exact Match(答案是否完全命中标准答案)、F1(同时衡量“答对多少”和“多答漏答多少”的综合分)、人工偏好打分

- Business metrics:转化率、工单解决率、搜索成功率

- System metrics:p95 latency、token cost、索引大小、更新时延

因为用户不关心你的 MTEB 是 64.6 还是 65.2。

用户只关心两件事:

- 我的问题你有没有找对资料

- 你回答得够不够快

来源:MTEB/Benchmark overview

链接:https://www.emergentmind.com/topics/mteb-benchmark

来源:CodeSOTA,MTEB Leaderboard

链接:https://www.codesota.com/benchmarks/mteb

最后一个判断:你的系统是在“做向量搜索”,还是在“做知识服务”?

这是两件看起来相近、但完全不同的事。

- 做向量搜索,目标是“把相似的东西找出来”

- 做知识服务,目标是“把正确的、可信的、最新的东西交给用户”

前者解决的是算法问题;

后者解决的是产品、工程、治理三者共同问题。

所以,向量化的价值,从来不在“把文字变成一串数字”。

而在于它第一次给了机器一种能力:

不是只看字面,而是去捕捉“意思”。

Word2Vec 让机器看到了“邻近关系”;

Transformer 让机器看到了“上下文”;

多模态 embedding 正在让机器看到“跨媒介的一致意义”;

而 RAG 则让这套能力,真正开始接入企业知识、业务流程和真实世界。

这也是为什么我会说:

大模型时代,真正的基础设施,不只是 model inference(模型推理),也是 vectorization(向量化)。

谁把向量空间设计得更合理,谁就更可能拥有下一代 AI 产品里的“认知底盘”。

来源:Redis,The Future of AI: Why Embeddings Are Here to Stay

链接:https://redis.io/blog/why-vector-embeddings-are-here-to-stay/

来源:ForesightFox,Vector Databases and Semantic SEO

链接:https://foresightfox.com/blog/vector-databases-and-semantic-seo-how-ai-search-is-redefining-content-discovery/

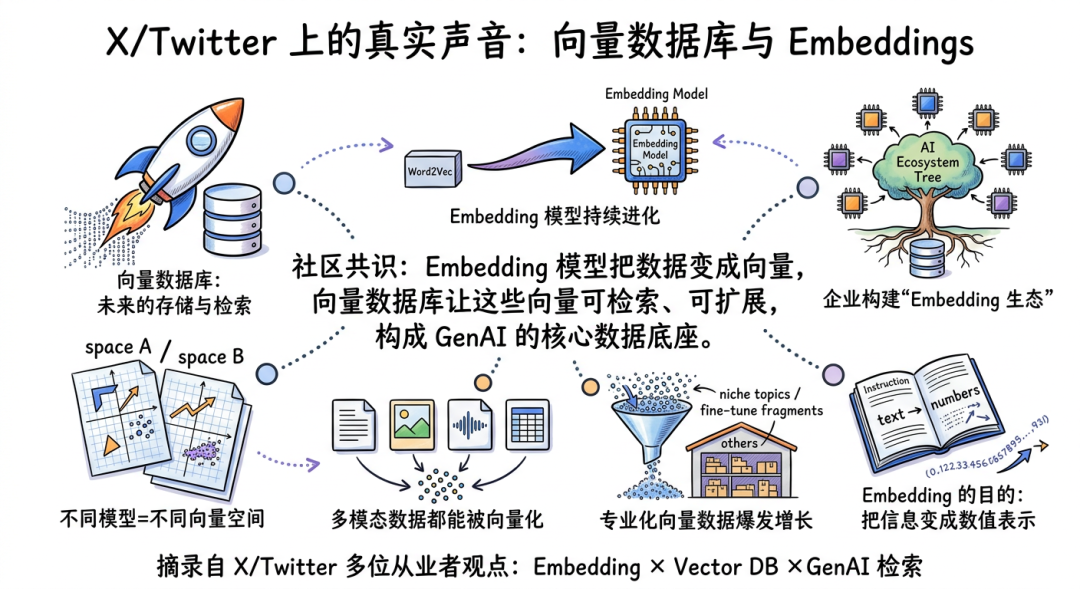

X/Twitter 上的真实声音

@femke/_plantinga: “Vector databases are the FUTURE of data storage and retrieval in AI … Embedding Models → These are the special AI models that create those vector embeddings. They’ve evolved from simple models like Word2Vec to”

— 查看原文

@weaviate/_io: “AI enterprises do not just use embeddings. They build ecosystems … Different embedding models create unique vector spaces due to variations in architecture, training methods and datasets. A query vector from a”

— 查看原文

@Defi/_Zee: “In the rapidly evolving world of artificial intelligence, data is no … As AI systems expand, they generate massive volumes of highly specialized data vector embeddings for niche topics, fine-tuned model fragments,”

— 查看原文

@Aurimas/_Gr: “Fundamentals of a Vector Database. With the rise of GenAI … 1. Choose a ML model to be used to generate Vector Embeddings. · 2. Embed any type of information: text, images, audio, tabular. · 3. Get a Vector”

— 查看原文

@senthazalravi (Senthazal Ravi): “Purpose: Embedding models are designed to convert text (or other types of data) into numerical representations, often referred to as embeddings.”

— 查看原文

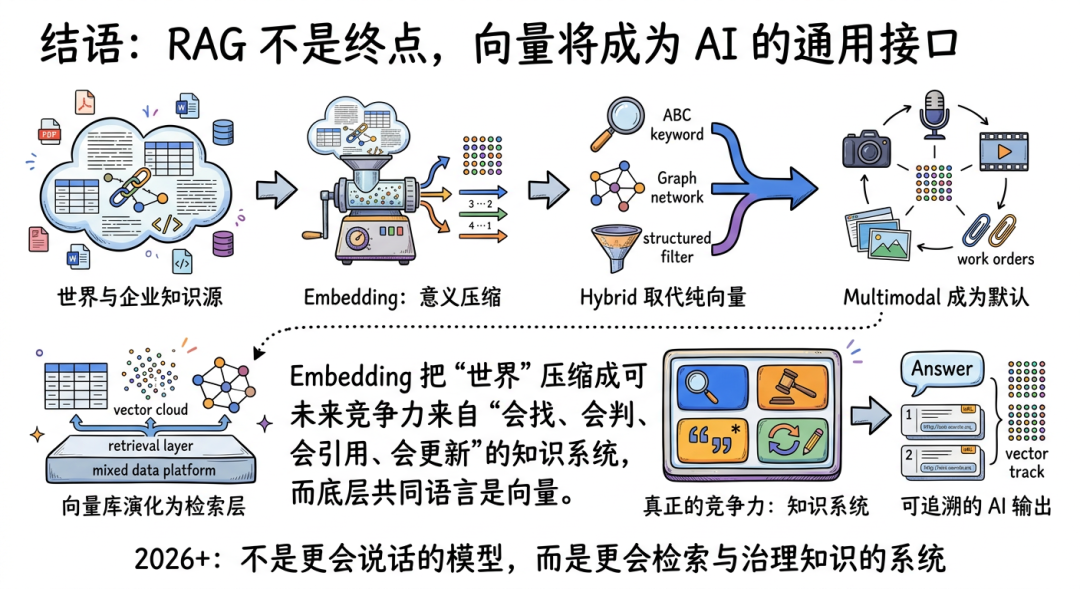

十一、结语:RAG 不是终点,向量会成为 AI 的通用接口

未来两年,有三个趋势几乎是确定的:

-

Hybrid 会取代“纯向量崇拜”

单纯 semantic search(语义搜索)不够,关键词、图谱、结构化过滤、权限系统都会重新回到主舞台。 -

Multimodal 会从“高级能力”变成“默认能力”

未来企业知识不只在 Word 和 PDF 里,也在截图、录屏、会议音频、工单附件里。 -

向量数据库会越来越像“AI 时代的检索层”,而不是一个独立新物种

很多企业最终不会只买一个“纯向量库”,而是选择能把 relational(关系型数据)、graph(图谱数据)和 vector(向量数据)混合起来的平台。

2026 年后,真正有竞争力的 AI 系统,大概率都不是“一个更会说话的模型”,而是“一个更会找、会判、会引用、会更新的知识系统”。

而它们共同的底层语言,就是向量。

来源:TechTarget,4 trends that will shape data management and AI in 2026

链接:https://www.techtarget.com/searchdatamanagement/feature/4-trends-that-will-shape-data-management-and-AI-in-2026

来源:National Law Review,Graph Database Vector Search Market projected growth

链接:https://natlawreview.com/press-releases/graph-database-vector-search-market-projected-witness-growth-us-685-bn-2029

如果你只记住一句话,我希望是这句:

Embedding 不是 RAG 里的一个小零件,

它是大模型把“世界”压缩成“可计算意义”的第一步。

普通人如何抓住AI大模型的风口?

领取方式在文末

为什么要学习大模型?

目前AI大模型的技术岗位与能力培养随着人工智能技术的迅速发展和应用 , 大模型作为其中的重要组成部分 , 正逐渐成为推动人工智能发展的重要引擎 。大模型以其强大的数据处理和模式识别能力, 广泛应用于自然语言处理 、计算机视觉 、 智能推荐等领域 ,为各行各业带来了革命性的改变和机遇 。

目前,开源人工智能大模型已应用于医疗、政务、法律、汽车、娱乐、金融、互联网、教育、制造业、企业服务等多个场景,其中,应用于金融、企业服务、制造业和法律领域的大模型在本次调研中占比超过 30%。

随着AI大模型技术的迅速发展,相关岗位的需求也日益增加。大模型产业链催生了一批高薪新职业:

人工智能大潮已来,不加入就可能被淘汰。如果你是技术人,尤其是互联网从业者,现在就开始学习AI大模型技术,真的是给你的人生一个重要建议!

最后

只要你真心想学习AI大模型技术,这份精心整理的学习资料我愿意无偿分享给你,但是想学技术去乱搞的人别来找我!

在当前这个人工智能高速发展的时代,AI大模型正在深刻改变各行各业。我国对高水平AI人才的需求也日益增长,真正懂技术、能落地的人才依旧紧缺。我也希望通过这份资料,能够帮助更多有志于AI领域的朋友入门并深入学习。

真诚无偿分享!!!

vx扫描下方二维码即可

加上后会一个个给大家发

【附赠一节免费的直播讲座,技术大佬带你学习大模型的相关知识、学习思路、就业前景以及怎么结合当前的工作发展方向等,欢迎大家~】

大模型全套学习资料展示

自我们与MoPaaS魔泊云合作以来,我们不断打磨课程体系与技术内容,在细节上精益求精,同时在技术层面也新增了许多前沿且实用的内容,力求为大家带来更系统、更实战、更落地的大模型学习体验。

希望这份系统、实用的大模型学习路径,能够帮助你从零入门,进阶到实战,真正掌握AI时代的核心技能!

01 教学内容

-

从零到精通完整闭环:【基础理论 →RAG开发 → Agent设计 → 模型微调与私有化部署调→热门技术】5大模块,内容比传统教材更贴近企业实战!

-

大量真实项目案例: 带你亲自上手搞数据清洗、模型调优这些硬核操作,把课本知识变成真本事!

02适学人群

应届毕业生: 无工作经验但想要系统学习AI大模型技术,期待通过实战项目掌握核心技术。

零基础转型: 非技术背景但关注AI应用场景,计划通过低代码工具实现“AI+行业”跨界。

业务赋能突破瓶颈: 传统开发者(Java/前端等)学习Transformer架构与LangChain框架,向AI全栈工程师转型。

vx扫描下方二维码即可

【附赠一节免费的直播讲座,技术大佬带你学习大模型的相关知识、学习思路、就业前景以及怎么结合当前的工作发展方向等,欢迎大家~】

本教程比较珍贵,仅限大家自行学习,不要传播!更严禁商用!

03 入门到进阶学习路线图

大模型学习路线图,整体分为5个大的阶段:

04 视频和书籍PDF合集

从0到掌握主流大模型技术视频教程(涵盖模型训练、微调、RAG、LangChain、Agent开发等实战方向)

新手必备的大模型学习PDF书单来了!全是硬核知识,帮你少走弯路(不吹牛,真有用)

05 行业报告+白皮书合集

收集70+报告与白皮书,了解行业最新动态!

06 90+份面试题/经验

AI大模型岗位面试经验总结(谁学技术不是为了赚$呢,找个好的岗位很重要)

07 deepseek部署包+技巧大全

由于篇幅有限

只展示部分资料

并且还在持续更新中…

真诚无偿分享!!!

vx扫描下方二维码即可

加上后会一个个给大家发

【附赠一节免费的直播讲座,技术大佬带你学习大模型的相关知识、学习思路、就业前景以及怎么结合当前的工作发展方向等,欢迎大家~】

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献78条内容

已为社区贡献78条内容

所有评论(0)