AI智能的理论的概述

人工智能(Artificial Intelligence),英文缩写为AI。是研究、开发用于模拟、延伸和扩展人的智能的理论、方法、技术及应用系统的一门新技术科学。人工智能是计算机科学的一个分支,它企图了解智能的实质,并生产出一种新的能以人类智能相似的方式做出反应的智能机器,该领域的研究包括机器人、语言识别、图像识别、自然语言处理和专家系统等

人工智能(AI)智能理论是一个涵盖多个学科领域的宏大体系,旨在理解、构建和实现智能行为。其核心在于让机器模拟、延伸甚至超越人类的认知能力。以下是对其关键理论的概述:

-

核心目标与定义

- 目标: 创造能够执行需要人类智能才能完成的任务的机器系统。这包括学习、推理、问题解决、感知、理解语言、决策等。

- 智能的定义: AI 理论尝试从不同角度定义智能。一种实用主义观点认为,一个系统若能在特定环境中有效达成目标,即可视为具有智能(行为主义)。另一种观点则强调对内部认知过程的模拟(认知主义)。

-

核心支柱理论

-

a. 机器学习

- 核心思想: 让机器从数据中“学习”经验,并利用这些经验改进其性能,而无需为每个特定任务进行显式编程。这是当前 AI 发展的主要驱动力。

- 关键分支:

- 监督学习: 使用带标签的数据训练模型(例如:图像分类、垃圾邮件检测)。模型学习从输入到已知输出的映射关系。 $$ y = f(x) + \epsilon $$ 其中 $y$ 是目标变量(标签),$x$ 是特征向量,$f$ 是学习的目标函数,$\epsilon$ 是噪声。

- 无监督学习: 在无标签数据中发现隐藏模式或结构(例如:聚类、降维)。

- 强化学习: 智能体通过与环境交互,根据获得的奖励或惩罚信号学习最优策略(例如:游戏 AI、机器人控制)。 $$ \text{目标是最大化期望累积奖励 } \mathbb{E}[\sum_{t=0}^{\infty} \gamma^t r_t] $$ 其中 $r_t$ 是时刻 $t$ 的奖励,$\gamma$ 是折扣因子。

- 理论基础: 统计学、概率论(如贝叶斯理论)、优化理论、计算学习理论。 $$ P(A|B) = \frac{P(B|A)P(A)}{P(B)} \quad \text{(贝叶斯定理)} $$

-

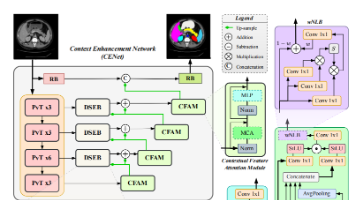

b. 人工神经网络与深度学习

- 核心思想: 受生物神经网络启发,构建由大量简单处理单元(神经元)连接而成的网络模型。通过调整连接权重,网络能够学习复杂的非线性关系。

- 关键特点: 多层次结构(输入层、隐藏层、输出层),强大的表示学习能力(自动学习数据的有效特征表示)。 $$ \text{神经元输出:} \quad a_j = \sigma(\sum_{i} w_{ji} a_i + b_j) $$ 其中 $\sigma$ 是激活函数(如 Sigmoid, ReLU),$w_{ji}$ 是权重,$b_j$ 是偏置,$a_i$ 是输入。

- 理论基础: 神经科学、模式识别、函数逼近理论、优化(如反向传播算法)。

-

c. 认知计算与知识表示

- 核心思想: 模拟人类思维过程,如推理、知识存储与运用、问题求解、规划等。关注如何让机器“理解”和运用知识。

- 关键分支:

- 知识表示: 研究如何用计算机可处理的形式(如逻辑、规则、语义网络、本体论)来表达领域知识。

- 推理机制: 基于已有知识推导出新结论(如演绎推理、归纳推理、溯因推理)。

- 规划: 在给定目标和约束下,生成一系列动作以达到目标。

- 符号主义 AI: 早期 AI 的重要范式,强调显式的符号操作和逻辑推理。

- 理论基础: 逻辑学、认知心理学、语言学。

-

-

其他重要理论方向

- 计算智能: 包括模糊逻辑(处理不确定性)、进化计算(如遗传算法,模拟自然选择)、群体智能(如蚁群算法)等,提供不同于传统符号逻辑和神经网络的问题解决方法。

- 感知与交互:

- 计算机视觉: 让机器“看懂”图像和视频(理论基础:图像处理、模式识别、几何学)。

- 自然语言处理: 让机器理解、生成和使用人类语言(理论基础:语言学、统计学、深度学习)。

- 机器人学: 结合感知、决策、控制理论,使机器能够在物理世界中自主行动。

- 多智能体系统: 研究多个智能体如何协作或竞争以实现目标(理论基础:博弈论、分布式系统)。

- 通用人工智能: 探索构建具备人类水平广泛认知能力的 AI 系统的可能性(目前仍是理论前沿和挑战)。

-

理论基础 AI 智能理论建立在多个学科的交叉之上:

- 数学: 线性代数、概率论、统计学、微积分、优化理论、离散数学。

- 计算机科学: 算法、数据结构、计算复杂性理论。

- 认知科学与心理学: 对人类智能和认知过程的理解。

- 神经科学: 对生物大脑结构和功能的启示。

- 哲学: 探讨智能的本质、意识、伦理等问题。

总结: AI 智能理论是一个不断发展的领域,旨在构建能够感知、学习、推理和行动的智能系统。机器学习(特别是深度学习)是目前实现实际应用的主要途径。人工神经网络提供了强大的模型表示能力。认知计算则关注知识表示和推理。该领域融合了数学、计算机科学、认知科学等多学科知识,其终极目标之一是探索通用人工智能的可能性。理解这些理论有助于把握 AI 技术的原理、潜力和局限性。

AI智能模块理论:

import numpy as np

import tensorflow as tf

from sklearn.preprocessing import StandardScaler

class AIModule:

def __init__(self, input_dim, hidden_layers=[64, 32], output_dim=1):

self.model = tf.keras.Sequential()

self.model.add(tf.keras.layers.InputLayer(input_shape=(input_dim,)))

for units in hidden_layers:

self.model.add(tf.keras.layers.Dense(units, activation='relu'))

self.model.add(tf.keras.layers.Dense(output_dim))

self.scaler = StandardScaler()

def preprocess_data(self, X):

return self.scaler.fit_transform(X)

def train(self, X_train, y_train, epochs=100, batch_size=32):

X_train_scaled = self.preprocess_data(X_train)

self.model.compile(optimizer='adam', loss='mse')

self.model.fit(X_train_scaled, y_train, epochs=epochs, batch_size=batch_size)

def predict(self, X):

X_scaled = self.scaler.transform(X)

return self.model.predict(X_scaled)

def save_model(self, path):

self.model.save(path)

def load_model(self, path):

self.model = tf.keras.models.load_model(path)

功能说明

该模块实现了一个基础的AI智能系统,包含以下核心功能:

- 神经网络架构搭建

- 数据预处理(标准化)

- 模型训练功能

- 预测功能

- 模型保存与加载

使用示例

# 初始化模块

ai = AIModule(input_dim=10, hidden_layers=[128, 64, 32])

# 训练模型

ai.train(X_train, y_train, epochs=50)

# 进行预测

predictions = ai.predict(X_test)

# 保存模型

ai.save_model('ai_model.h5')

参数说明

input_dim: 输入特征维度hidden_layers: 隐藏层结构配置列表output_dim: 输出维度epochs: 训练轮数batch_size: 批次大小

该模块可根据具体需求扩展更多功能,如添加不同的损失函数、优化器或评估指标。

技术研究

播报

用来研究人工智能的主要物质基础以及能够实现人工智能技术平台的机器就是计算机,人工智能的发展历史是和计算机科学技术的发展史联系在一起的。除了计算机科学以外,人工智能还涉及信息论、控制论、自动化、仿生学、生物学、心理学、数理逻辑、语言学、医学和哲学等多门学科。人工智能学科研究的主要内容包括:知识表示、自动推理和搜索方法、机器学习和知识获取、知识处理系统、自然语言理解、计算机视觉、智能机器人、自动程序设计等方面。

研究方法

如今没有统一的原理或范式指导人工智能研究。许多问题上研究者都存在争论。其中几个长久以来仍没有结论的问题是:是否应从心理或神经方面模拟人工智能?或者像鸟类生物学对于航空工程一样,人类生物学对于人工智能研究是没有关系的?智能行为能否用简单的原则(如逻辑或优化)来描述?还是必须解决大量完全无关的问题?

智能是否可以使用高级符号表达,如词和想法?还是需要“子符号”的处理?JOHN HAUGELAND提出了GOFAI(出色的老式人工智能)的概念,也提议人工智能应归类为SYNTHETIC INTELLIGENCE,这个概念后来被某些非GOFAI研究者采纳。

大脑模拟

20世纪40年代到50年代,许多研究者探索神经病学,信息理论及控制论之间的联系。其中还造出一些使用电子网络构造的初步智能,如W. GREY WALTER的TURTLES和JOHNS HOPKINS BEAST。 这些研究者还经常在普林斯顿大学和英国的RATIO CLUB举行技术协会会议。直到1960年, 大部分人已经放弃这个方法,尽管在80年代再次提出这些原理。

符号处理

主条目:GOFAI

当20世纪50年代,数字计算机研制成功,研究者开始探索人类智能是否能简化成符号处理。研究主要集中在卡内基梅隆大学, 斯坦福大学和麻省理工学院,而各自有独立的研究风格。JOHN HAUGELAND称这些方法为GOFAI(出色的老式人工智能)。 [31] 60年代,符号方法在小型证明程序上模拟高级思考有很大的成就。基于控制论或神经网络的方法则置于次要。 [32]60~70年代的研究者确信符号方法最终可以成功创造强人工智能的机器,同时这也是他们的目标。

认知模拟经济学家赫伯特·西蒙和艾伦·纽厄尔研究人类问题解决能力和尝试将其形式化,同时他们为人工智能的基本原理打下基础,如认知科学, 运筹学和经营科学。他们的研究团队使用心理学实验的结果开发模拟人类解决问题方法的程序。这方法一直在卡内基梅隆大学沿袭下来,并在80年代于SOAR发展到高峰。基于逻辑不像艾伦·纽厄尔和赫伯特·西蒙,JOHN MCCARTHY认为机器不需要模拟人类的思想,而应尝试找到抽象推理和解决问题的本质,不管人们是否使用同样的算法。他在斯坦福大学的实验室致力于使用形式化逻辑解决多种问题,包括知识表示, 智能规划和机器学习. 致力于逻辑方法的还有爱丁堡大学,而促成欧洲的其他地方开发编程语言PROLOG和逻辑编程科学.“反逻辑”斯坦福大学的研究者 (如马文·闵斯基和西摩尔·派普特)发现要解决计算机视觉和自然语言处理的困难问题,需要专门的方案-他们主张不存在简单和通用原理(如逻辑)能够达到所有的智能行为。ROGER SCHANK 描述他们的“反逻辑”方法为 "SCRUFFY" .常识知识库 (如DOUG LENAT的CYC)就是"SCRUFFY"AI的例子,因为他们必须人工一次编写一个复杂的概念。基于知识大约在1970年出现大容量内存计算机,研究者分别以三个方法开始把知识构造成应用软件。这场“知识革命”促成专家系统的开发与计划,这是第一个成功的人工智能软件形式。“知识革命”同时让人们意识到许多简单的人工智能软件可能需要大量的知识。

子符号法

80年代符号人工智能停滞不前,很多人认为符号系统永远不可能模仿人类所有的认知过程,特别是感知,机器人,机器学习和模式识别。很多研究者开始关注子符号方法解决特定的人工智能问题。

自下而上, 接口AGENT,嵌入环境(机器人),行为主义,新式AI机器人领域相关的研究者,如RODNEY BROOKS,否定符号人工智能而专注于机器人移动和求生等基本的工程问题。他们的工作再次关注早期控制论研究者的观点,同时提出了在人工智能中使用控制理论。这与认知科学领域中的表征感知论点是一致的:更高的智能需要个体的表征(如移动,感知和形象)。计算智能80年代中DAVID RUMELHART 等再次提出神经网络和联结主义. 这和其他的子符号方法,如模糊控制和进化计算,都属于计算智能学科研究范畴。

统计学法

90年代,人工智能研究发展出复杂的数学工具来解决特定的分支问题。这些工具是真正的科学方法,即这些方法的结果是可测量的和可验证的,同时也是人工智能成功的原因。共用的数学语言也允许已有学科的合作(如数学,经济或运筹学)。STUART J. RUSSELL和PETER NORVIG指出这些进步不亚于“革命”和“NEATS的成功”。有人批评这些技术太专注于特定的问题,而没有考虑长远的强人工智能目标。

集成方法

智能AGENT范式智能AGENT是一个会感知环境并作出行动以达致目标的系统。最简单的智能AGENT是那些可以解决特定问题的程序。更复杂的AGENT包括人类和人类组织(如公司)。这些范式可以让研究者研究单独的问题和找出有用且可验证的方案,而不需考虑单一的方法。一个解决特定问题的AGENT可以使用任何可行的方法-一些AGENT用符号方法和逻辑方法,一些则是子符号神经网络或其他新的方法。范式同时也给研究者提供一个与其他领域沟通的共同语言--如决策论和经济学(也使用ABSTRACT AGENTS的概念)。90年代智能AGENT范式被广泛接受。AGENT体系结构和认知体系结构研究者设计出一些系统来处理多ANGENT系统中智能AGENT之间的相互作用。一个系统中包含符号和子符号部分的系统称为混合智能系统 ,而对这种系统的研究则是人工智能系统集成。分级控制系统则给反应级别的子符号AI 和最高级别的传统符号AI提供桥梁,同时放宽了规划和世界建模的时间。RODNEY BROOKS的SUBSUMPTION ARCHITECTURE就是一个早期的分级系统计划。

智能模拟

机器视、听、触、感觉及思维方式的模拟:指纹识别,人脸识别,视网膜识别,虹膜识别,掌纹识别,专家系统,智能搜索,定理证明,逻辑推理,博弈,信息感应与辨证处理。

学科范畴

人工智能是一门边沿学科,属于自然科学、社会科学、技术科学三向交叉学科。

涉及学科

哲学和认知科学,数学,神经生理学,心理学,计算机科学,信息论,控制论,不定性论,仿生学,社会结构学与科学发展观。

研究范畴

语言的学习与处理,知识表现,智能搜索,推理,规划,机器学习,知识获取,组合调度问题,感知问题,模式识别,逻辑程序设计,软计算,不精确和不确定的管理,人工生命,神经网络,复杂系统,遗传算法人类思维方式,最关键的难题还是机器的自主创造性思维能力的塑造与提升。

安全问题

人工智能还在研究中,但有学者认为让计算机拥有智商是很危险的,它可能会反抗人类。这种隐患也在多部电影中发生过,其主要的关键是允不允许机器拥有自主意识的产生与延续,如果使机器拥有自主意识,则意味着机器具有与人同等或类似的创造性,自我保护意识,情感和自发行为。因此,人工智能的安全可控问题要同步从技术层面来解决。 [22]随着技术的发展成熟,监管形式可能逐步发生变化,但人工智能必须接受人工监管的本质不能改变。 [23]生成式AI可能引发大规模隐私或者个人信息泄露问题。 [31]

实现方法

人工智能在计算机上实现时有2种不同的方式。一种是采用传统的编程技术,使系统呈现智能的效果,而不考虑所用方法是否与人或动物机体所用的方法相同。这种方法叫工程学方法(ENGINEERING APPROACH),它已在一些领域内作出了成果,如文字识别、电脑下棋等。另一种是模拟法(MODELING APPROACH),它不仅要看效果,还要求实现方法也和人类或生物机体所用的方法相同或相类似。遗传算法(GENERIC ALGORITHM,简称GA)和人工神经网络(ARTIFICIAL NEURAL NETWORK,简称ANN)均属后一类型。遗传算法模拟人类或生物的遗传-进化机制,人工神经网络则是模拟人类或动物大脑中神经细胞的活动方式。为了得到相同智能效果,两种方式通常都可使用。采用前一种方法,需要人工详细规定程序逻辑,如果游戏简单,还是方便的。如果游戏复杂,角色数量和活动空间增加,相应的逻辑就会很复杂(按指数式增长),人工编程就非常繁琐,容易出错。而一旦出错,就必须修改原程序,重新编译、调试,最后为用户提供一个新的版本或提供一个新补丁,非常麻烦。采用后一种方法时,编程者要为每一角色设计一个智能系统(一个模块)来进行控制,这个智能系统(模块)开始什么也不懂,就像初生婴儿那样,但它能够学习,能渐渐地适应环境,应付各种复杂情况。这种系统开始也常犯错误,但它能吸取教训,下一次运行时就可能改正,至少不会永远错下去,用不到发布新版本或打补丁。利用这种方法来实现人工智能,要求编程者具有生物学的思考方法,入门难度大一点。但一旦入了门,就可得到广泛应用。由于这种方法编程时无须对角色的活动规律做详细规定,应用于复杂问题,通常会比前一种方法更省力。

与人类差距

2023年,中国科学院自动化研究所(中科院自动化所)团队最新完成的一项研究发现,基于人工智能的神经网络和深度学习模型对幻觉轮廓“视而不见”,人类与人工智能的“角逐”在幻觉认知上“扳回一局”。

/主要AI智能,信息数据库,智能模块,参考信息智能模型/

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献2条内容

已为社区贡献2条内容

所有评论(0)