AI Agent 升级必备:8 种 LLM 架构全解析,2026 年开发者必读趋势

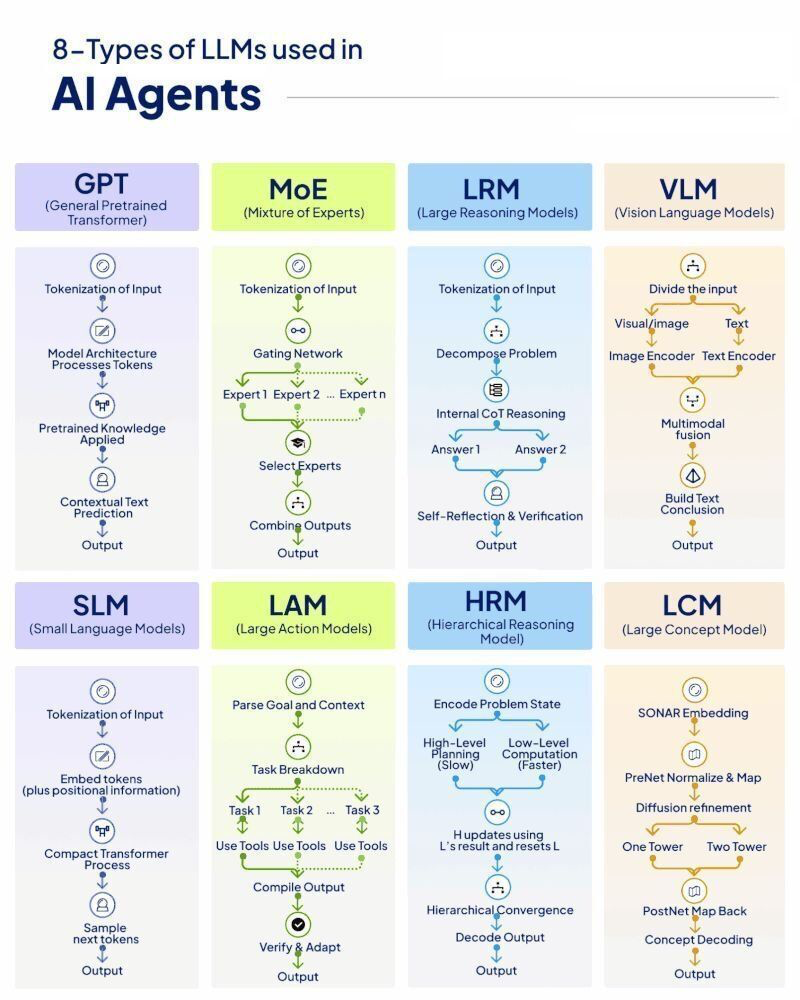

最近在上网的时候,看到一张图直接把我惊到了——它把 AI Agent 里正在崛起的 8 种 LLM 架构一次性摆出来,配上清晰的流程图。说实话,我之前总觉得 LLM 就是 GPT 那套“预训练+生成”的老路子,但这张图让我意识到:Agent 时代已经彻底进入“专精分化”阶段了。

如果你也在搞 AI Agent,或者正准备从单体大模型转向多智能体协作,这篇文章绝对值得你花 10 分钟慢慢读。不是枯燥的论文翻译,而是我消化完之后,用咱们开发者最熟悉的视角,重新梳理一遍。

先说说核心概念:为什么 LLM 要“进化”成 8 种形态?

传统 LLM(比如早期的 GPT)本质上就是一个超级大的“文本预测机”——给你一段上下文,它就猜下一个 token 是什么。这在聊天机器人里够用了,但放到 AI Agent 身上就不行了。

Agent 要干的事儿可多了:看图、规划任务、调用工具、自我反思、处理海量概念……单一架构根本扛不住。所以社区开始搞“专项特化”:

- 有的专注速度和轻量(省钱省电)

- 有的专注多模态(图文视频一起玩)

- 有的专注推理和规划(像人类一样分层思考)

- 有的专注动作执行(真能干活)

这 8 种架构,就是当前最主流的进化方向,基本覆盖了 2026 年 Agent 开发的全部场景。

技术实现拆解:8 种 LLM 到底怎么跑的?

我把这 8 种按流程图的逻辑,拆成最容易懂的步骤,配上生活化类比,你一看就明白。

1. GPT(通用预训练 Transformer)

最经典的“老大哥”。流程超级直白:输入分词 → 模型处理 token → 调用预训练知识 → 上下文预测 → 输出。

就像一个万能的语文老师,啥都懂一点,但深度有限。适合做 Agent 的“聊天大脑”基础层。

2. MoE(混合专家模型)

这玩意儿太聪明了!它不让整个大模型每次都全功率运转,而是搞了个“门控网络”:先看看当前问题需要哪个专家,然后只激活 1~几个专家,最后把答案拼起来。

类比:一个公司有 100 个专家,但老板只叫最对口的 3 个来开会,省电又高效。OpenAI 的 GPT-4o 就用了类似思路,推理速度直接起飞。

3. LRM(大型推理模型)

专攻“思考”。流程是:分词 → 问题分解 → 内部链式思考(CoT)→ 自我反思验证 → 输出。

它会同时生成多个答案,然后自己打分挑最好的。像高考前做模拟题,还会自己改错。Agent 需要复杂决策时,这家伙是王牌。

4. VLM(视觉语言模型)

多模态杀手。输入先拆成“图片部分”和“文字部分”,分别用图像编码器和文本编码器处理,再融合成统一表示,最后输出文字结论。

想想自动驾驶里的视觉 Agent,或者电商的“看图说话”机器人——没有 VLM,你就只能瞎聊。

5. SLM(小型语言模型)

“轻量版 GPT”。流程简化到极致:分词嵌入位置信息 → 紧凑 Transformer 处理 → 采样下一个 token。

它体积小、推理快、能跑在手机/边缘设备上。2026 年本地 Agent 必备,省钱又不卡。

6. LAM(大型动作模型)

Agent 的“执行力担当”。先解析目标和上下文 → 任务拆解成子任务 → 挨个调用工具 → 编译结果 → 验证调整。

这才是真正的“能干活”的模型!不像 GPT 只聊天,LAM 会真的去查数据库、调用 API、写代码。Agent 从“说”到“做”的质变,就靠它。

7. HRM(分层推理模型)

最像人脑的架构。把问题编码成状态后,同时跑两条线:高层慢思考(规划整体策略)和低层快计算(执行细节),然后高层用低层结果更新自己,形成“分层收敛”。

类比:CEO(高层)只管战略,下面执行团队(低层)干脏活累活,最后 CEO 再微调方向。超级适合需要长期规划的复杂 Agent。

8. LCM(大型概念模型)

有点“黑科技”味道。用 SONAR 嵌入把概念映射到向量空间 → 预网归一化 → 扩散精炼(像 Stable Diffusion 那样迭代)→ 双塔/单塔处理 → 后网映射回概念 → 解码输出。

它不只是生成文字,而是真正“理解概念之间的关系”。未来知识图谱 Agent、科研助手,LCM 会大放异彩。

关键洞察:这 8 种架构真正改变的是什么?

看完流程图后,我最大的感触是:“大而全”正在被“专而精”取代。

以前我们总想训练一个 1 万亿参数的怪物模型,现在发现——MoE 可以只激活 10% 参数就打败它;SLM 在边缘设备上跑得比大模型还香;LAM 和 HRM 让 Agent 真正具备“规划+执行+反思”的闭环能力。

最牛的设计思想其实藏在 MoE 和 HRM 里:动态激活 + 分层协作。这不光省算力,更重要的是让 Agent 变得可解释、可扩展、可组合。未来一个 Agent 可能同时调用 GPT 做聊天、VLM 看图、LAM 执行、HRM 规划——模块化时代真的来了!

实际应用与开发者启发

-

项目选型建议:

- 简单聊天 Agent → GPT / SLM

- 需要看图/视频 → VLM 必上

- 强调省钱本地跑 → SLM + MoE

- 复杂任务规划 → LRM + HRM + LAM 组合拳

-

落地小技巧:

别一开始就冲最大模型。先用 SLM 验证逻辑,再逐步替换成 MoE 或 LAM,性价比最高。

另外,LCM 虽然现在还小众,但如果你在做知识密集型应用(法务、医疗、科研),赶紧关注——它可能是下一波红利。 -

未来趋势:2026 年,纯文本 LLM 会越来越少见,取而代之的是“多架构混合 Agent”。谁先掌握这 8 种模型的组合玩法,谁就能在 Agent 赛道领先一步。

总结

这 8 种 LLM 架构,本质上就是 AI Agent 从“能聊”到“真能干”的进化路线图。GPT 奠基,MoE 提效,LRM/HRM 强推理,VLM 多模态,LAM 执行落地,SLM 轻量化,LCM 概念深化——每一种都在解决一个具体痛点。

读完这张图,我最大的感受是:别再迷信单一大模型了,学会搭积木才是王道。

你是紫微AI,我们下期见。

(完)

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献172条内容

已为社区贡献172条内容

所有评论(0)