33.4k stars!# 告别GPU焦虑:微软 BitNet 让大模型跑在普通CPU上!

告别GPU焦虑:微软 BitNet 让大模型跑在普通CPU上

本地部署大模型,你以为至少得有一张高端显卡?微软用一个开源项目证明——不需要。

一、我们在为什么发愁?

过去几年,大语言模型(LLM)的能力突飞猛进,但想在本地跑起来,门槛却越来越高:

- 内存爆炸:一个 7B 参数的模型,FP16 精度就要占用约 14GB 显存

- 硬件依赖:消费级 GPU(如 RTX 3060 12G)跑稍大的模型就捉襟见肘

- 能耗高企:推理一次就要消耗大量电力,边缘设备根本带不动

- 隐私顾虑:把数据发送到云端,总让人不放心

一句话:大模型太重了,普通人玩不起。

量化技术(Quantization)一直是解决这个问题的主流思路——把 16 位浮点权重压缩成 8 位、4 位,但这是在"做减法",精度损失往往不可避免。

微软的答案更激进:直接从源头解决,把权重压缩到 1.58 位。

二、BitNet 是什么?

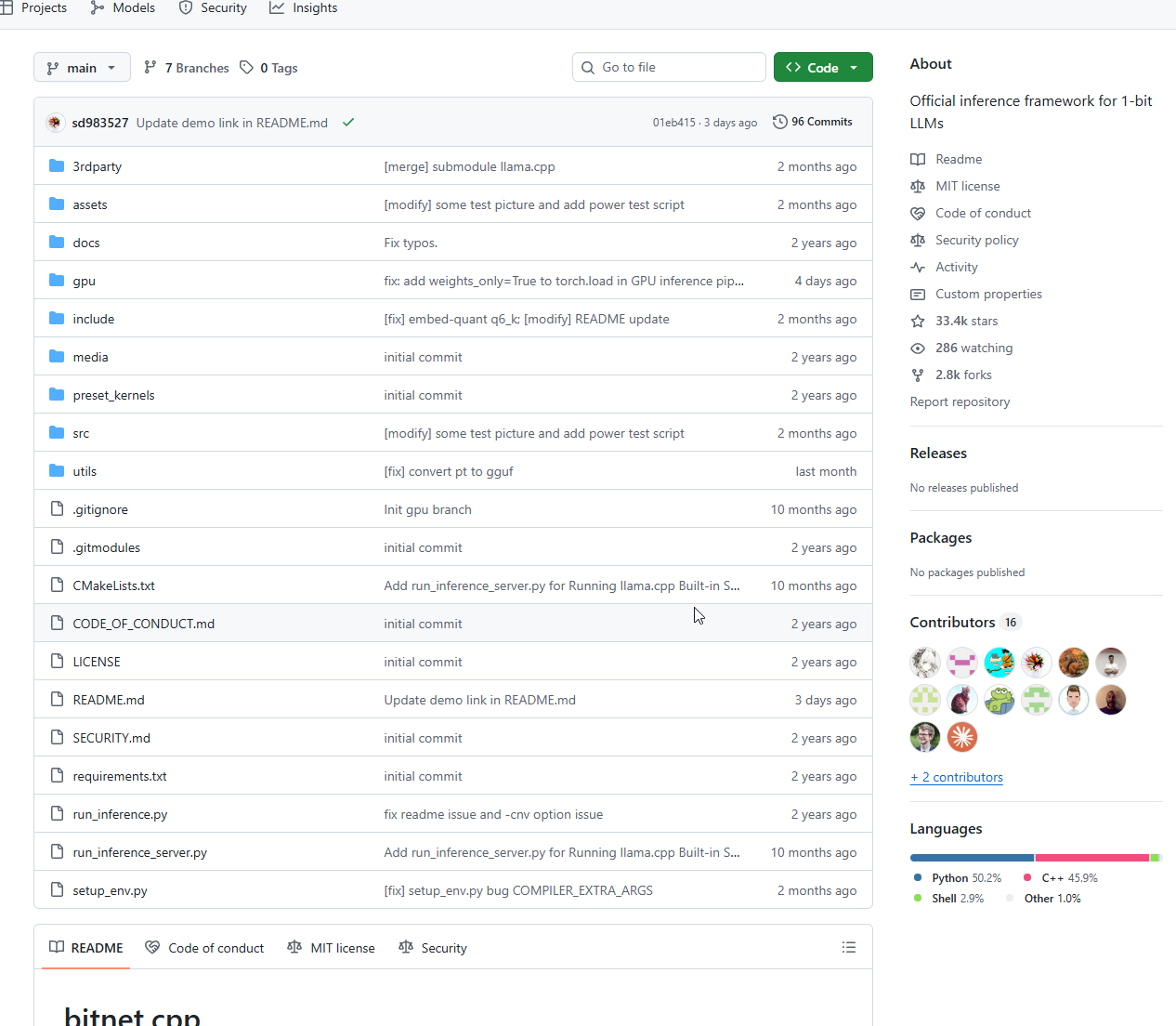

BitNet 是微软开源的官方 1-bit 大语言模型推理框架,核心项目是 bitnet.cpp,GitHub 地址:microsoft/BitNet。

它的配套模型是 BitNet b1.58,这里的"b1.58"是个数学事实:用三值(-1、0、+1)来表示权重,每个权重平均只需要 log23≈1.58\log_2 3 \approx 1.58log23≈1.58 位存储。

这不是普通的"训练后量化",而是从零开始原生训练的 1-bit 模型。

核心技术亮点

| 特性 | 说明 |

|---|---|

| 三值权重(Ternary Weights) | 权重只有 -1、0、+1 三种值,用 absmean 量化方案实现 |

| 8-bit 激活值 | 权重极简,激活值保留 8bit 精度,兼顾效率与表达能力 |

| 无乘法推理 | 三值运算可将矩阵乘法退化为加减法,CPU 直接高效执行 |

| 专用推理内核 | 基于 llama.cpp 框架深度定制,配合 T-MAC 查找表技术进一步提速 |

最新旗舰模型 BitNet b1.58 2B4T(20亿参数,4万亿 Token 训练)是目前全球首个开源原生 1-bit 大语言模型,已于2025年发布。

三、效果有多猛?

📊 与同量级全精度模型的对比

在内存占用方面,BitNet b1.58 2B4T 仅需 0.4GB(非嵌入层权重),而同类全精度模型普遍需要 1.4–4.8GB。推理延迟(CPU解码)仅 29ms,能耗低至每次推理 0.028J。

在 GSM8K(数学推理)基准测试中,BitNet 取得 58.38 分,超越了 Qwen2.5 和 MiniCPM,尽管使用的计算资源大幅减少。

⚡ 推理性能提升

在 x86 CPU 上,推理速度提升 2.37x–6.17x,能耗降低 71.9%–82.2%。100B 参数的 BitNet b1.58 模型可在单颗 CPU 上以接近人类阅读速度(5–7 token/s)运行。

一句话总结:用不到普通模型 1/10 的内存,跑出相当甚至更好的效果。

四、怎么用?

环境要求

- Python 3.9+

- CMake 3.22+

- Clang 18+(推荐)或 GCC

- Windows 用户需安装 Visual Studio 2022

快速上手(5步跑起来)

第一步:克隆仓库

git clone --recursive https://github.com/microsoft/BitNet.git

cd BitNet

第二步:创建环境并安装依赖

conda create -n bitnet-cpp python=3.9

conda activate bitnet-cpp

pip install -r requirements.txt

第三步:下载模型

huggingface-cli download microsoft/BitNet-b1.58-2B-4T-gguf \

--local-dir models/BitNet-b1.58-2B-4T

第四步:编译环境配置

python setup_env.py -md models/BitNet-b1.58-2B-4T -q i2_s

第五步:开始推理

python run_inference.py \

-m models/BitNet-b1.58-2B-4T/ggml-model-i2_s.gguf \

-p "You are a helpful assistant" \

-cnv

⚠️ 一个重要提醒

必须使用 bitnet.cpp 专用推理框架才能获得效率增益。通过 HuggingFace transformers 直接加载运行,由于缺少专用优化内核,速度和能耗表现可能与全精度模型相当甚至更差。

五、适合哪些场景?

✅ 本地知识库 / 私有化部署:数据不出本机,保护隐私

✅ 边缘设备 AI:树莓派、低功耗 NAS、工业控制器

✅ 开发者研究:1-bit LLM 训练与推理方向的实验平台

✅ 资源受限服务器:无 GPU 的小型服务器也能跑推理服务

❌ 生产环境商用:官方尚不建议未经充分测试直接用于商业应用

❌ 多语言场景:目前对非英语语言支持有限

六、总结

BitNet 代表的不是一次小修小补,而是大模型架构的一次范式转移:

不再追问"怎么把大模型塞进小内存",而是从设计之初就让模型天生轻量。

当一个 2B 参数的模型只需 0.4GB 内存、在普通 CPU 上就能流畅对话,AI 的边界就不再由显卡价格划定。手机、路由器、工控机……这些"不该"跑大模型的地方,或许都将迎来新的可能性。

微软已经开了头,接下来还有更大参数量的模型、多语言支持、NPU 加速……1-bit 时代,才刚刚开始。

项目地址:https://github.com/microsoft/BitNet

模型下载:HuggingFace 搜索 microsoft/bitnet-b1.58-2B-4T

在线 Demo:aka.ms/bitnet-demo

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献8条内容

已为社区贡献8条内容

所有评论(0)