ALOE:VLA模型后训练的动作-级离线策略评估

26年2月来自智元机器人、港科大和复旦的论文“ALOE: Action-Level Off-Policy Evaluation for Vision-Language-Action Model Post-Training”。

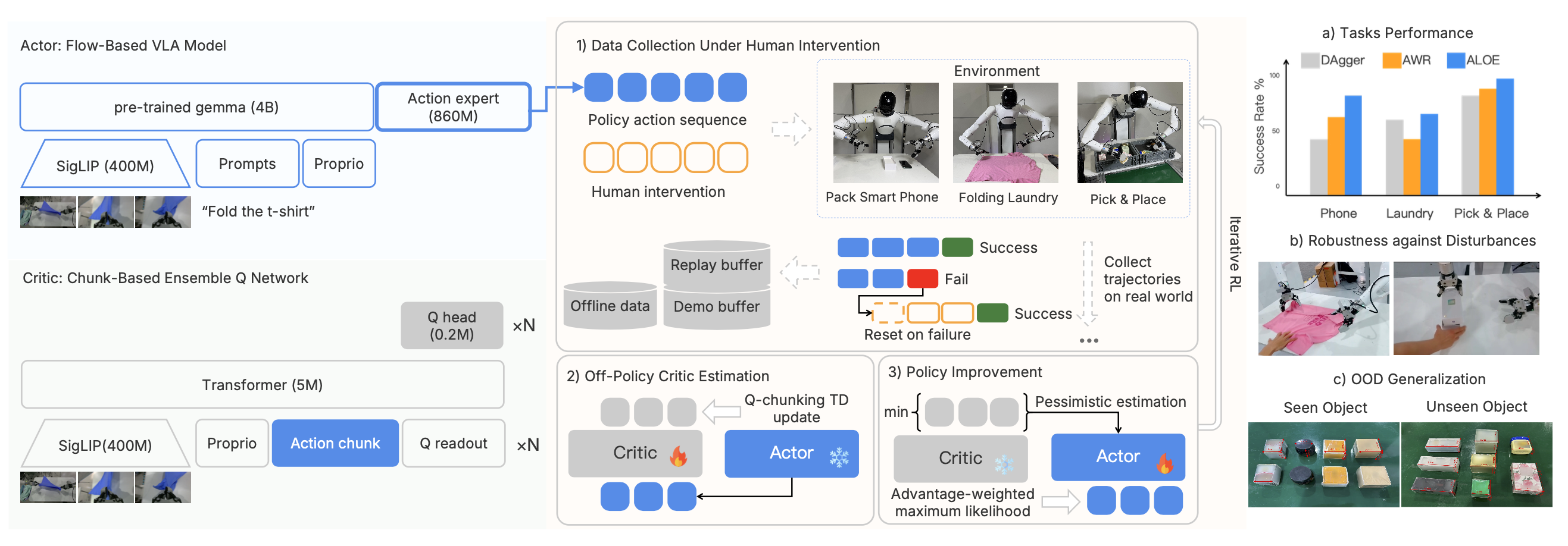

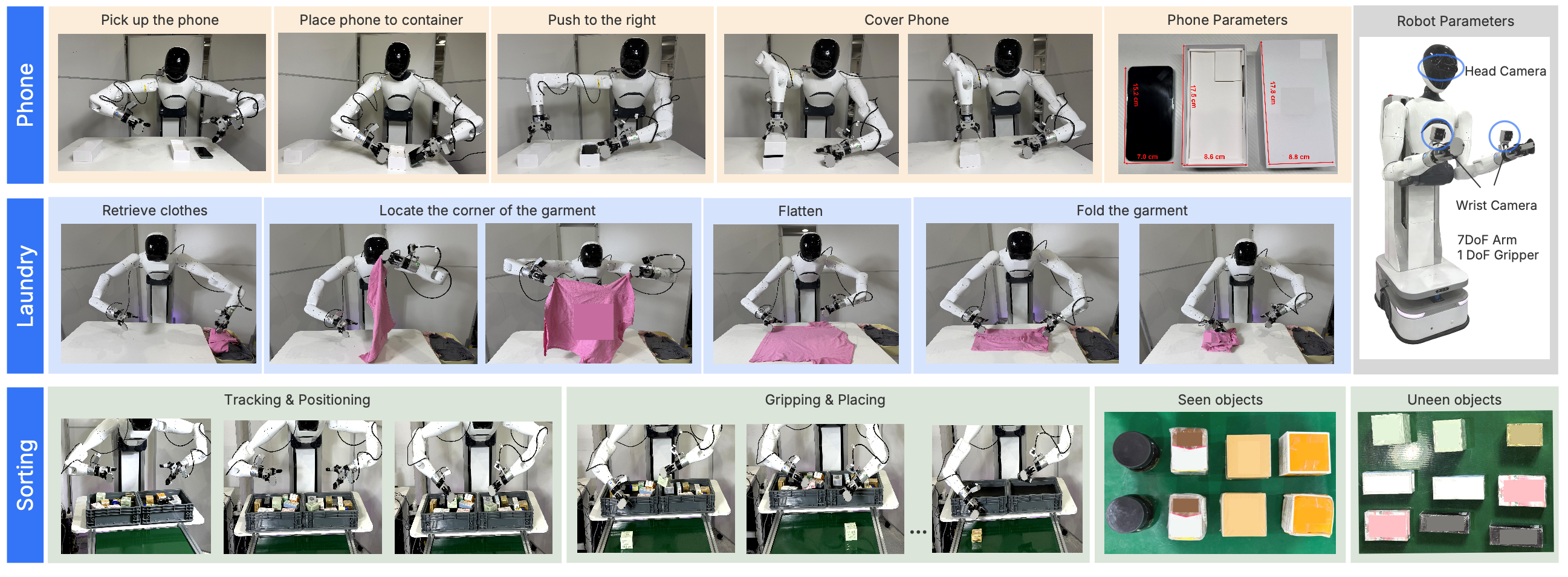

本文研究如何在真实场景下通过在线强化学习(RL)改进大型基础视觉-语言-动作(VLA)系统。该过程的核心是价值函数,它提供学习信号来指导VLA从经验中学习。在实践中,价值函数是通过从不同数据源(包括历史策略和间歇性人工干预)收集的轨迹片段来估计的。从混合数据中估计当前行为质量的价值函数,本质上是一个离线策略评估问题。然而,以往的工作通常为了稳定性而采用保守的在策略估计,这避免对当前高容量策略的直接评估,从而限制学习效果。ALOE是一个用于VLA后训练的动作-级离线策略评估框架。ALOE应用基于分块的时序差分引导法来评估单个动作序列,而不是预测最终任务结果。这种设计提高在稀疏奖励下对关键动作块的有效权重分配,并支持稳定的策略改进。在三个真实世界的操作任务上评估方法,包括高精度智能手机打包任务、长距离可变形体折叠衣物任务以及涉及多物体感知的双手抓取放置任务。

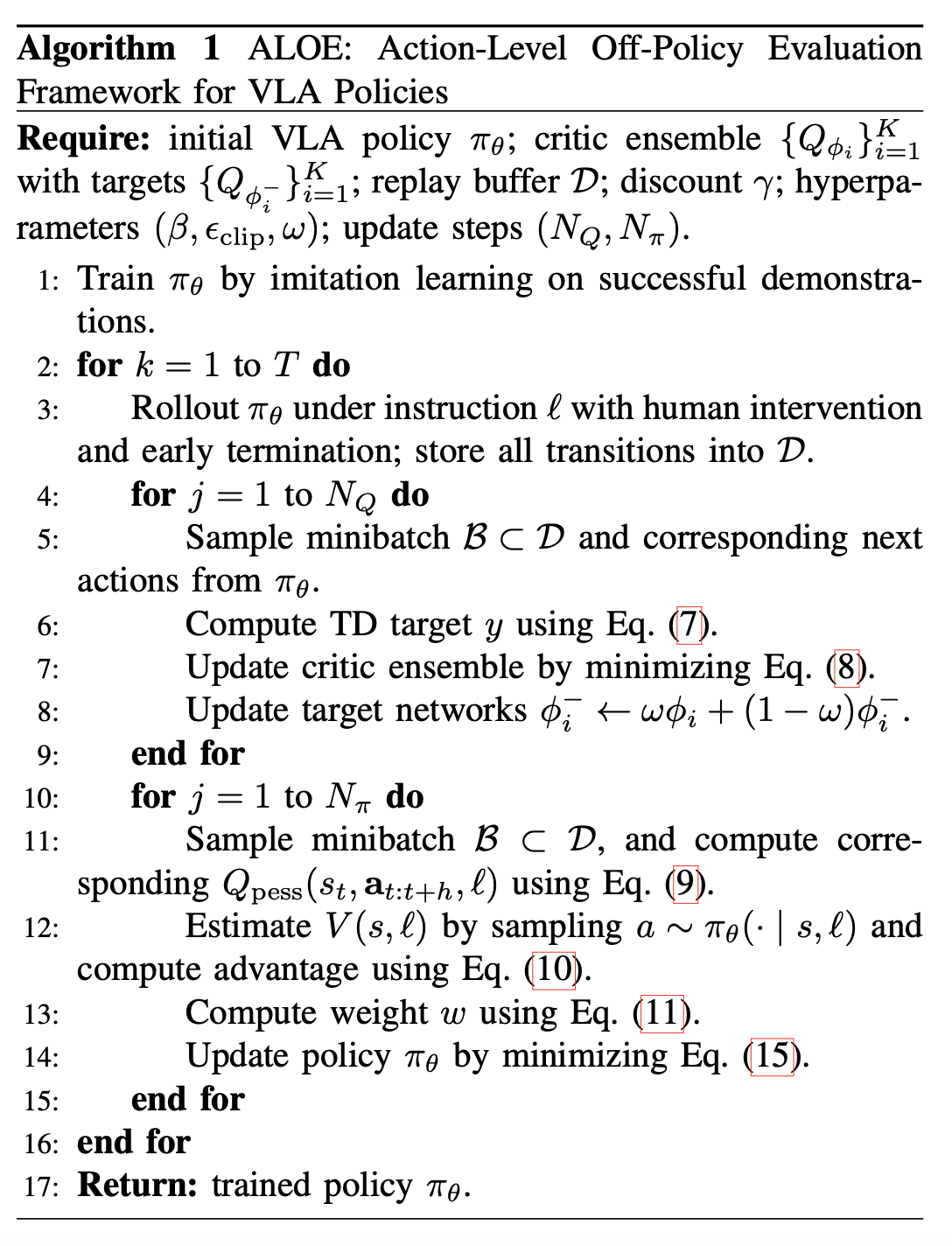

该方法针对人机交互数据采集下的真实世界VLA强化学习,其中由于安全干预,经验轨迹呈现碎片化和策略混合的特点。故此将学习过程分解为策略评估和策略改进。利用基于Q-分块(chunking)的TD学习和一个悲观集成方法,学习一个离线策略动作-值函数,从而实现高效的长时程信用传播和鲁棒的值估计。将critic视为相对偏好信号,并进行优势加权策略更新。最后,将强化学习框架适配到基于流的VLA架构中。由此得到的算法能够对算法1中的基于流VLA策略进行可靠且数据高效的后训练。

基于真实世界数据采集的离线策略critic估计

如图所示,遵循先前真实世界 VLA 训练范式 [14, 46, 7, 36, 51]。数据通过不断演进的 VLA 策略的重复部署进行增量式采集。在在线部署过程中,当策略执行不安全行为(例如碰撞或关节限位违规)时,部署过程会频繁中断。在这种情况下,轨迹会被截断,并标记为失败结果,然后由人工操作员介入以纠正机器人的动作,之后执行才会恢复。此过程可能会重复多次,直到任务成功完成。因此,回放缓冲区 D 不仅包含由混合行为策略生成的数据,还包含碎片化的轨迹,其中单个任务执行的不同片段可能源自不同的策略或人工纠正。因此,从 D 中学习本质上是相对于当前actor而言的离线策略行为,并且很少观察到由单一策略生成的连续长期任务执行。

在这种情况下,目标是估计在给定状态下,根据语言指令采取某个动作的预期长期结果,即动作-值函数。现实世界中 VLA 系统的一个常见替代方案是使用轨迹-级蒙特卡罗 (MC) 返回值作为价值信号 [14, 23],它通过累积沿同一轨迹观察的未来奖励来赋予价值,并隐式地假设可以访问完整的轨迹后缀(suffix)。在现实世界的训练中,由于安全驱动的截断和人为干预,这一假设经常被打破,导致在异构行为策略下收集的任务执行数据是碎片化的。因此,动作之后的未来回报通常只能是部分观察的,这使得基于蒙特卡罗的估计器难以在稀疏奖励的情况下分配可靠的权重。这种局限性在长时程任务中尤为严重,因为需要将不同策略中的信息轨迹片段组合起来,才能推断出从未以连续展开形式观察的结果。

为了缓解这些挑战,本文采用TD学习[43],它利用后续的价值估计进行引导,并允许价值信息在时间上反向传播。TD学习从贝尔曼方程(即动作值函数Qπ(s, a, l)的计算)出发,用基于观测转移构建的单步目标来代替对未来轨迹的期望。给定一个转移 (s_t, a_t, r_t, s_t+1, d_t, l) ∼ D,定义 TD 目标

y_t = r_t + γ(1 − d_t) Q_φ− (s_t+1, a_t+1, l),

其中 φ− 表示目标网络的参数,下一个动作从当前策略 a_t+1 ∼ π_θ(· | s_t+1, l) 中采样。

在此设置下,TD 学习相对于 MC 估计的优势源于贝尔曼算子的收缩性 [3]。与 MC 估计需要观察完整的轨迹 τ = (s_t,a_t) 来为初始状态-动作对进行赋值不同,TD 学习在每次转移时局部应用贝尔曼更新方程。这种局部性使得价值信息能够在状态-动作空间中逐步传播,即使轨迹被分割或截断。因此,该过程允许将来自不同片段的价值信息隐式地拼接在一起,从而使critic能够聚合来自不相交的真实世界部署权重,并分配有意义的长期权重,而无需连续的任务执行。这减轻了在真实世界环境中对手动轨迹组织和人工标注的依赖。此外,TD学习估计的是动作-条件价值函数Q(s, a, l),而不是状态相关的基线V(s)。这使得细粒度的动作-级权重分配成为可能。这种动作级反馈对于识别具有复杂中间动态的长期操作任务中容易出错的决策和关键状态至关重要。

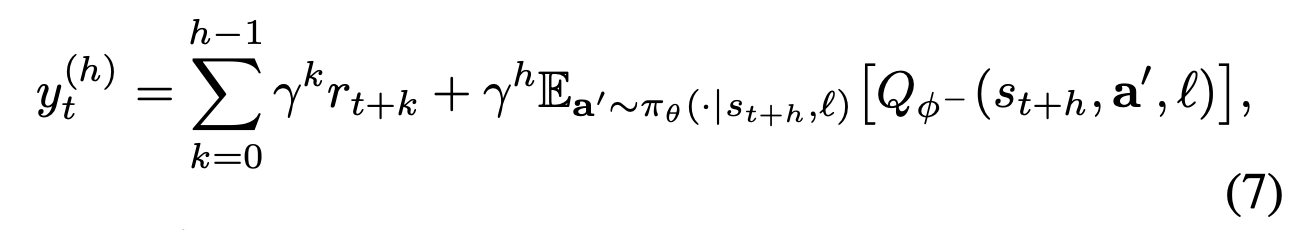

尽管TD学习能够实现动作级的信用分配,但标准的单步TD更新仅将价值信息向后传播一个时间步。在具有稀疏终端奖励的长时域操纵任务中,这会导致信用传播缓慢和学习效率低下,因为有意义的奖励信号可能需要经过数千次状态转移。为了解决这个问题,采用一种Q-分块[24]价值备份方法,该方法能够在保持无偏性的同时,将价值传播到多个时间步。具体来说,定义一个分块动作序列a_t:t+h ≜ (a_t, a_t+1, …, a_t+h−1),并学习一个分块动作-价值函数Q(s_t, a_t:t+h, l),该函数评估在指令l下从状态s_t执行该精确动作序列的回报。对于一个转换段 (s_t,a_t:t+h,r_t:t+h−1,s_t+h,l) ∼ D,Q-分块贝尔曼目标定义为:

其中 a′ = a_t+h:t+2h 表示从当前策略中采样的下一个动作块。与标准的 n 步 TD 不同,备份使用生成中间奖励的精确动作序列,从而消除回报估计器与行为策略之间的不匹配。因此,Q-分块在保持无偏估计的同时,实现了更快的值传播 [24]。

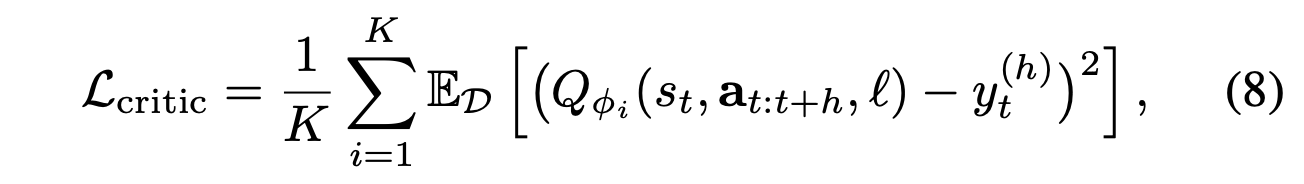

在状态-动作空间中观测值不足的区域,传统的基于 TD 方法可能会过度外推,导致动作值被高估。这种效应在安全-紧要操作任务中更为显著,因为这类任务的探索受到限制,数据多样性本身也有限。为了缓解不确定性导致的过度估计,采用由 K 个动作-值函数 {Q_φ_i} 组成的一个悲观集成。每个评价器都使用公式 (7) 中相同的分块 TD 目标进行训练,目标是最小化目标函数

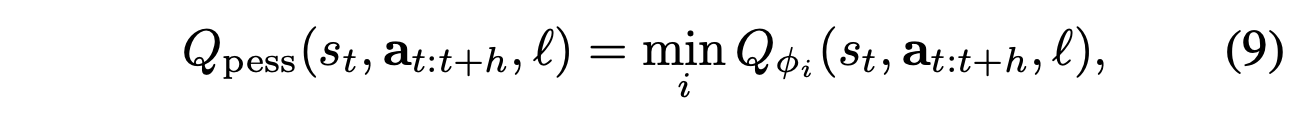

其中 y(h)_t 表示分块 TD 目标。在策略更新时,形成一个保守(悲观)估计

该估计近似于真实动作值的置信下限 [9, 28]。这种聚合方法在评估当前策略的同时,能够更灵敏地识别不确定性,从而提高在实际部署中的鲁棒性。

VLA 策略的优势加权策略改进

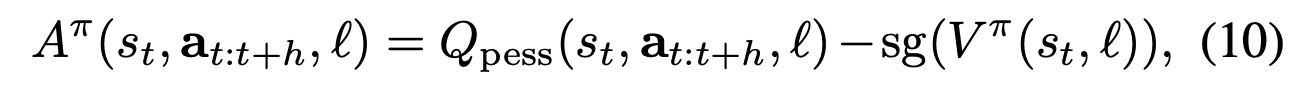

尽管critic是在离线策略学习的,但值评估自然地与 RECAP [14] 中使用的约束策略更新策略相结合,将critic视为相对偏好信号。这保留约束更新,并确保在线迭代中策略改进的稳定性。给定一个状态转移,通过定义优势来评估数据动作相对于当前策略 π 的质量:

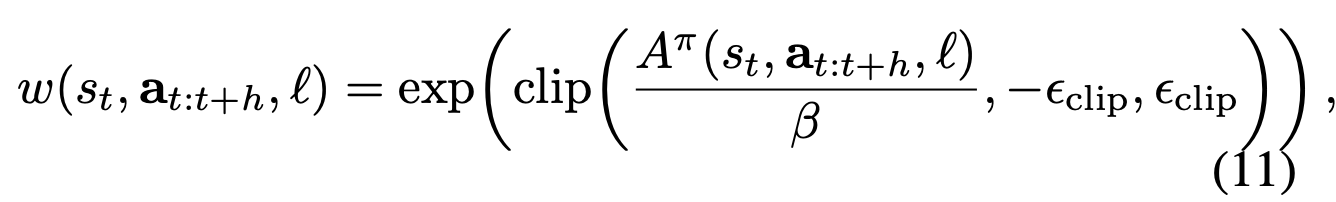

其中 Vπ(s_t,l) 表示当前策略的状态-值函数。停止梯度算子 sg 防止梯度流经最后一项,从而将策略优化与critic学习解耦,并提高训练稳定性。根据构造,该优势提供一个局部的、策略相关的改进信号,它将数据中观察的动作与当前策略在相同状态和指令下的行为进行比较。策略改进通过优势加权的对数似然目标函数来实现。为了在保持稳定性的同时强调相对动作质量,用截断指数函数将优势转换为非负权重:

其中 β 控制权重的锐度,ε_clip 限制任何单个状态转移的最大影响,类似于 PPO 风格更新中的信任域截断 [48]。然后,通过最大化整个回放缓冲区上的加权对数似然 L_actor 来更新策略。

此更新规则具有几个理想的特性。首先,策略改进是显式正则化的。该策略鼓励增加数据中观察的动作概率,从而防止不受控制地外推到回放缓冲区之外。其次,由于优势是相对于当前策略定义的,因此更新侧重于纠正策略的局部缺陷,同时保持对全局值估计误差的鲁棒性。这些特性表明,该策略更新实现一种保守但有原则的策略改进步骤:

定理(约束策略改进)。对于给定的状态 s,令 π_ref 表示表示 D 中数据分布的隐行为策略。优势加权目标的最优解是约束优化问题的解析解,其中约束 ε 由温度参数 β 隐式控制(不同于公式 (11) 中的裁剪参数 ε_clip)。

该定理通过证明由此产生的策略更新对应于约束策略优化问题的最优解来形式化这种解释,其中改进明确地限制在数据分布的支持范围内。

实现细节

采用 π0.5 流匹配 VLA 模型 [4] 作为 Actor。给定视觉观察、机器人本体感觉和语言指令,Actor 通过流匹配动作头预测连续的动作块。在强化学习 (RL) 过程中对 Actor 进行端到端的微调。对于Critic,采用 π0.5 预训练的 SigLIP 视觉编码器 [54] 提取图像特征,并使用 Transformer 骨干网络与其他模态融合。为了提高稳定性并降低计算量,冻结 SigLIP 编码器。用 K 个 Q-函数的集成,这些 Q-函数通过附加到 Transformer 输入序列的 K 个可学习Q 读取 tokens来实现。每个读取token都由一个独立的 Q-头映射以预测一个标量 Q 值。采用稀疏终端奖励,并带有每步惩罚,这遵循之前的 VLA 强化学习实践 [14]。

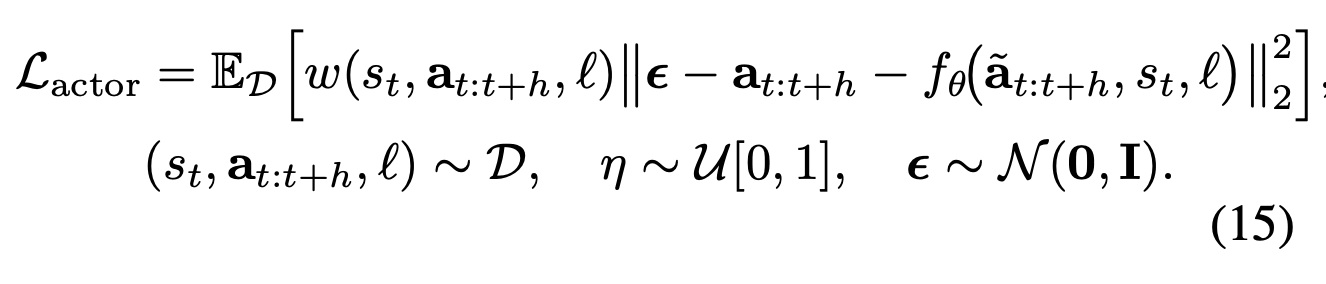

Actor 通过流匹配对连续动作块进行参数化,因此连续对数似然项 log π_θ (a_t:t+h | s_t , l) 难以精确计算。借鉴先前的流/扩散 VLA 训练方法 [14],将负的流匹配目标作为连续对数似然的一个代理(proxy)来优化一个易于处理的替代(surrogate),即:

其中噪声动作定义为 a ̃_t:t+h = η a_t:t+h + (1 − η) ε。直观地说,最大化加权策略对数似然对应于在相同输入下最小化动作块的加权流匹配损失。actor和critic的状态输入为 s_t = [X1_t, X2_t, X3_t, q_t],其中 Xi_t 表示来自第 i 个摄像头的图像,q_t 表示机器人本体感受观测值。

评估 ALOE 在一系列真实世界的机器人操作任务上的性能,这些任务旨在强调长时程推理、精确动作选择以及在人机交互数据采集下的鲁棒性。具体来说,考虑三个代表性任务:打包智能手机、折叠衣物和产品分类。这些任务需要结合细粒度操作、多阶段任务组合(例如,抓取-放置-推送)以及对视觉模糊的中间状态进行推理。所有实验均在如图所示的真实机器人平台上进行。

机器人平台

用于所有任务的机器人平台和感知设置。实验平台基于Agibot机器人系统,该系统由安装在移动底座上的双7自由度机械臂组成,并配备可调节的腰部机构。该平台支持模块化末端执行器,可根据任务需求灵活配置标准夹爪或6自由度灵巧机械手。感知系统包含多种摄像头模式:一个RGB摄像头提供前视视野,每个末端执行器上还安装有RGB摄像头,用于近距离观察操作过程。这种多摄像头配置能够从全局和局部视角进行全面的视觉观察,这对于精细操作任务至关重要。为了进行人机交互数据采集,采用基于VR的远程操控控制。操作员使用VR头显和控制器来控制机器人。VR控制器的手势被映射到末端执行器的平移和旋转,然后通过逆运动学转换为关节角度指令。控制器的摇杆和按钮用于控制底座和机器人本体的运动,而触发按钮则用于驱动末端执行器。该远程操作界面允许操作员在策略部署期间提供实时演示、重置和干预,从而能够收集高质量的演示数据并在需要时进行安全干预。

人机协同数据收集下的后训练流程

人机协同环境下的后训练流程。对于每个任务,首先收集若干人类演示,并使用它们通过模仿学习对 π0.5 进行预启动。在每次强化学习迭代中,部署 π0.5,同时由人工监控执行过程。当即将出现不安全行为(例如手机掉落或损坏)时,人工通过远程操作进行干预,从而触发提前终止。如果策略失败或超时,人工将环境重置到失败状态,并演示纠正措施以完成任务。所有轨迹,包括自主执行和人工干预,都存储在回放缓冲区中。最终得到的数据集包含成功和失败的片段,反映人机交互数据采集的异质性。数据采集持续进行,直到达到预设的成功轨迹数量(例如,电话任务为 50 条轨迹)。然后,应用 ALOE(算法 1)更新critic和 actor,之后再进行下一次强化学习迭代。在早期迭代中,人为干预较为频繁,但随着策略的改进,干预频率会逐渐降低。

训练细节和超参

总结Actor 架构、Critic 设计、优化设置和基线实现。

-

ALOE Actor:用 π0.5 流匹配 VLA 模型 [4] 作为策略骨干,该模型包含约 30 亿个参数。策略进行端到端微调。部署时,推理在单个 RTX 4090 GPU 上运行。控制频率为 30Hz,机械臂采用异步控制以降低延迟。

-

ALOE Critic:采用基于 Transformer 的多模态 Critic 来估计分块动作-值。视觉观测使用预训练的 SigLIP 编码器进行编码,该编码器保持冻结状态以确保稳定性。本体感觉和动作块被投影到维度为 D = 256 的共享嵌入空间中。K 个 Q tokens作为读取token添加到输入序列的前面,每个token通过一个独立的 MLP 头映射到一个标量 Q 值。 Transformer 模型使用 6 层和 8 个注意头。critic使用 Q 分组 TD 目标公式(7)和悲观聚合进行训练。目标网络通过系数为 0.005 的 Polyak 平均进行更新。优化采用 AdamW 优化器,参数为 β1 = 0.9,β2 = 0.95,余弦学习率调度(峰值 3 × 10−5,100 个预热步),梯度裁剪值为 1.0,折扣因子 γ = 0.99,批大小为 256。

-

基线:所有基线模型均使用相同的 π0.5 骨干网络,以确保公平比较。对于排序和手机打包任务,训练从开源检查点开始。对于衣物折叠任务,由于任务难度较高,用额外的任务数据进行预热。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献106条内容

已为社区贡献106条内容

所有评论(0)