AI面试系统选型指南:为什么企业级安全是不可妥协的底线

AI面试系统正在成为现代招聘流程中不可缺少的组成部分。它不仅能够显著压缩面试周期、降低HR的重复性工作负担,更重要的是,通过标准化的评估框架,有效减少人为偏见对招聘决策的影响。然而,当越来越多的企业开始将AI面试纳入正式招聘流程时,一个至关重要却常被忽视的议题正逐渐浮现:这些系统的安全性是否真的值得企业信赖?

一、AI面试系统的数据风险:你真的了解吗

AI面试系统在运行过程中会产生和处理大量高度敏感的数据:候选人的视频录像、语音录音、面部特征数据、行为模式分析结果,以及通过AI推断出的性格特质和情绪状态。这些数据中的许多类别,在《个人信息保护法》的分类体系下属于"敏感个人信息",企业在收集、使用这类信息时须取得候选人的单独同意,并对其进行更高级别的保护。

部分开源或低成本的AI面试工具,在数据安全基础设施的投入上相当有限。以类似OpenClaw这样的开源框架为例,其本身并不内置企业所需的访问控制、加密存储和合规审计机制,企业在使用此类工具时,等同于在一个几乎无围墙的环境中存放候选人最私密的数据。一旦发生数据泄露,除了直接的法律责任和罚款,对企业雇主品牌造成的长期声誉损伤往往难以量化。

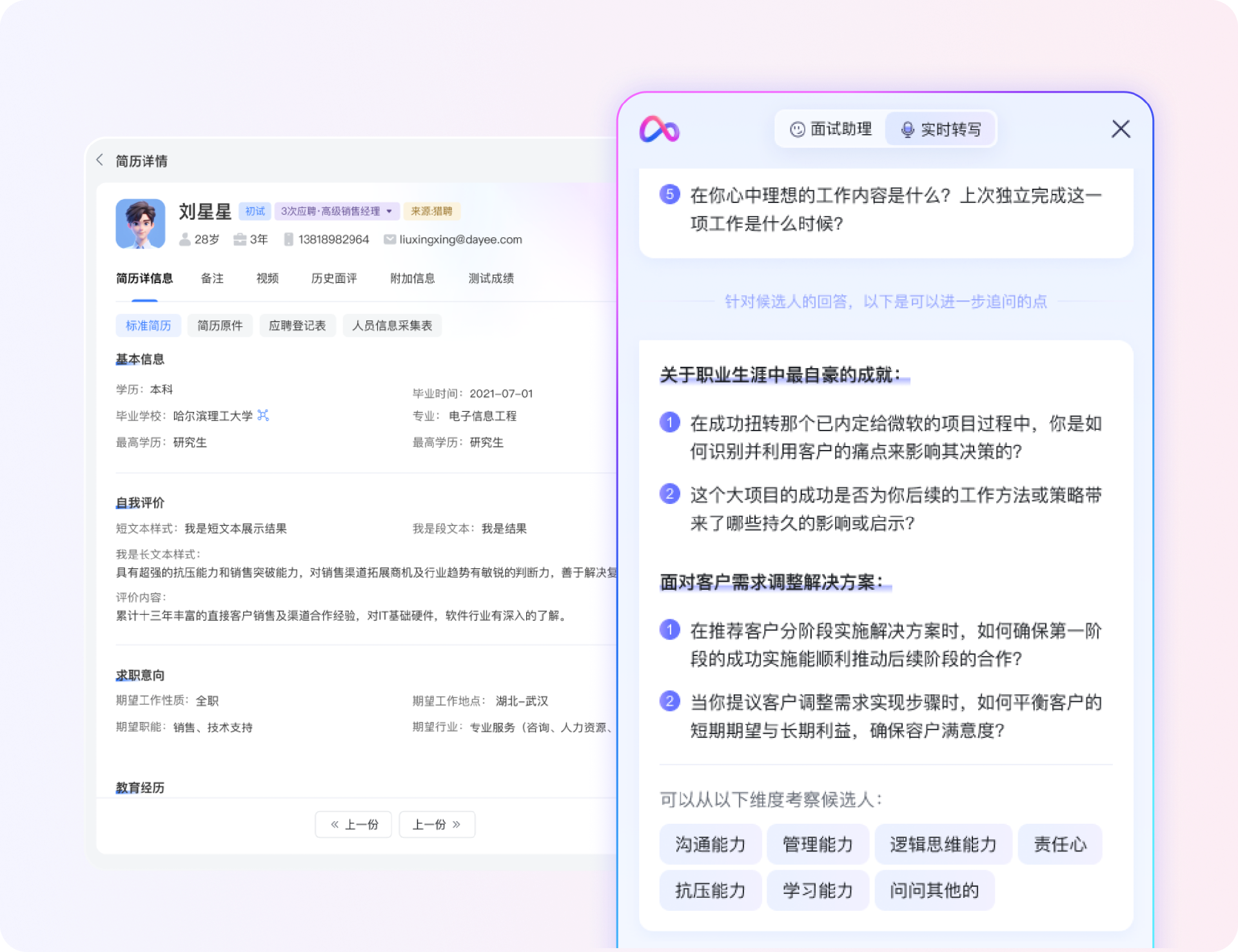

▲ 用友大易面试助理:实时转写+AI追问建议,帮助面试官精准把握候选人核心能力

此外,AI面试数据还存在另一重风险——算法歧视。如果AI评分模型的训练数据存在性别、年龄、地域等维度的样本偏差,其输出的评估结果可能系统性地对特定群体不公平。这一风险在缺乏可解释性机制和人工审核流程的自动化面试系统中尤为突出。欧盟已经开始通过《人工智能法案》对高风险AI应用(包括招聘AI)实施严格监管,国内监管框架的完善也是大势所趋。

二、企业级AI面试系统的安全标准

真正适合企业大规模使用的AI面试系统,应当在以下几个安全维度上达到基本标准:数据传输采用TLS 1.2及以上加密协议;存储数据进行AES-256或同等强度加密;支持基于角色的访问控制(RBAC),确保只有授权人员可以查阅候选人面试录像和评估报告;提供完整的操作审计日志,记录所有数据访问和导出行为;并在系统层面支持候选人数据的定期清理和删除,满足"被遗忘权"相关要求。

用友大易的AI面试管理模块在上述安全维度上均有完整的产品能力覆盖。其系统部署于符合等保三级认证的云环境,数据存储完全在境内,对于有私有化需求的大型企业,亦支持本地化部署方案。在功能层面,用友大易提供结构化面试题库管理、AI评分辅助、面试录像云端存储与权限管理等完整能力,帮助企业在提升面试效率的同时,构建符合监管要求的合规招聘档案。

▲ 用友大易测评报告:性格行为特征分析、心理风险评估、胜任力结果三维一体,全面支撑合规面试决策

除了技术层面的安全保障,用友大易还从流程设计上降低了AI面试的合规风险:系统内置候选人知情同意管理流程,在面试开始前自动向候选人推送数据使用说明并记录其授权确认,确保每一次AI面试都有完整的合规留存记录。

三、AI面试系统的落地误区与正确打开方式

许多企业在引入AI面试系统时,存在几个典型误区。第一个误区是"AI万能论"——认为AI面试系统可以完全替代人工判断,完全依赖AI评分进行录用决策。事实上,无论AI评分模型多么精准,对于高层岗位、稀缺技能岗位或文化匹配度要求高的岗位,人工判断仍然不可替代。

第二个误区是"低价优先"——将采购成本作为AI面试系统选型的首要指标,忽视系统的安全性、稳定性和长期服务能力。数据安全事故的处置成本、候选人投诉引发的公关危机,以及监管处罚的潜在风险,往往远超采购阶段节省的费用。

▲ 用友HRSaaS核心优势:基于YonGPT大模型,覆盖人才引进、运营、发展、员工体验、组织洞察全链路AI能力

正确的打开方式应是:将AI面试定位为HR专业能力的放大器,在标准化评估、海量初筛、数据记录等环节充分发挥AI的效率优势,而在最终录用决策、特殊情况处理等关键节点保留充分的人工主导权。同时,选择具备完整安全合规体系和持续产品迭代能力的企业级平台,才是AI面试系统落地的正确路径。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献43条内容

已为社区贡献43条内容

所有评论(0)