计算机毕业设计hadoop+spark+hive空气质量预测系统 空气质量大数据分析可视化 大数据毕业设计(源码+LW文档+PPT+讲解)

温馨提示:文末有 CSDN 平台官方提供的学长联系方式的名片!

温馨提示:文末有 CSDN 平台官方提供的学长联系方式的名片!

温馨提示:文末有 CSDN 平台官方提供的学长联系方式的名片!

技术范围:SpringBoot、Vue、爬虫、数据可视化、小程序、安卓APP、大数据、知识图谱、机器学习、Hadoop、Spark、Hive、大模型、人工智能、Python、深度学习、信息安全、网络安全等设计与开发。

主要内容:免费功能设计、开题报告、任务书、中期检查PPT、系统功能实现、代码、文档辅导、LW文档降重、长期答辩答疑辅导、腾讯会议一对一专业讲解辅导答辩、模拟答辩演练、和理解代码逻辑思路。

🍅文末获取源码联系🍅

🍅文末获取源码联系🍅

🍅文末获取源码联系🍅

感兴趣的可以先收藏起来,还有大家在毕设选题,项目以及LW文档编写等相关问题都可以给我留言咨询,希望帮助更多的人

信息安全/网络安全 大模型、大数据、深度学习领域中科院硕士在读,所有源码均一手开发!

感兴趣的可以先收藏起来,还有大家在毕设选题,项目以及论文编写等相关问题都可以给我留言咨询,希望帮助更多的人

介绍资料

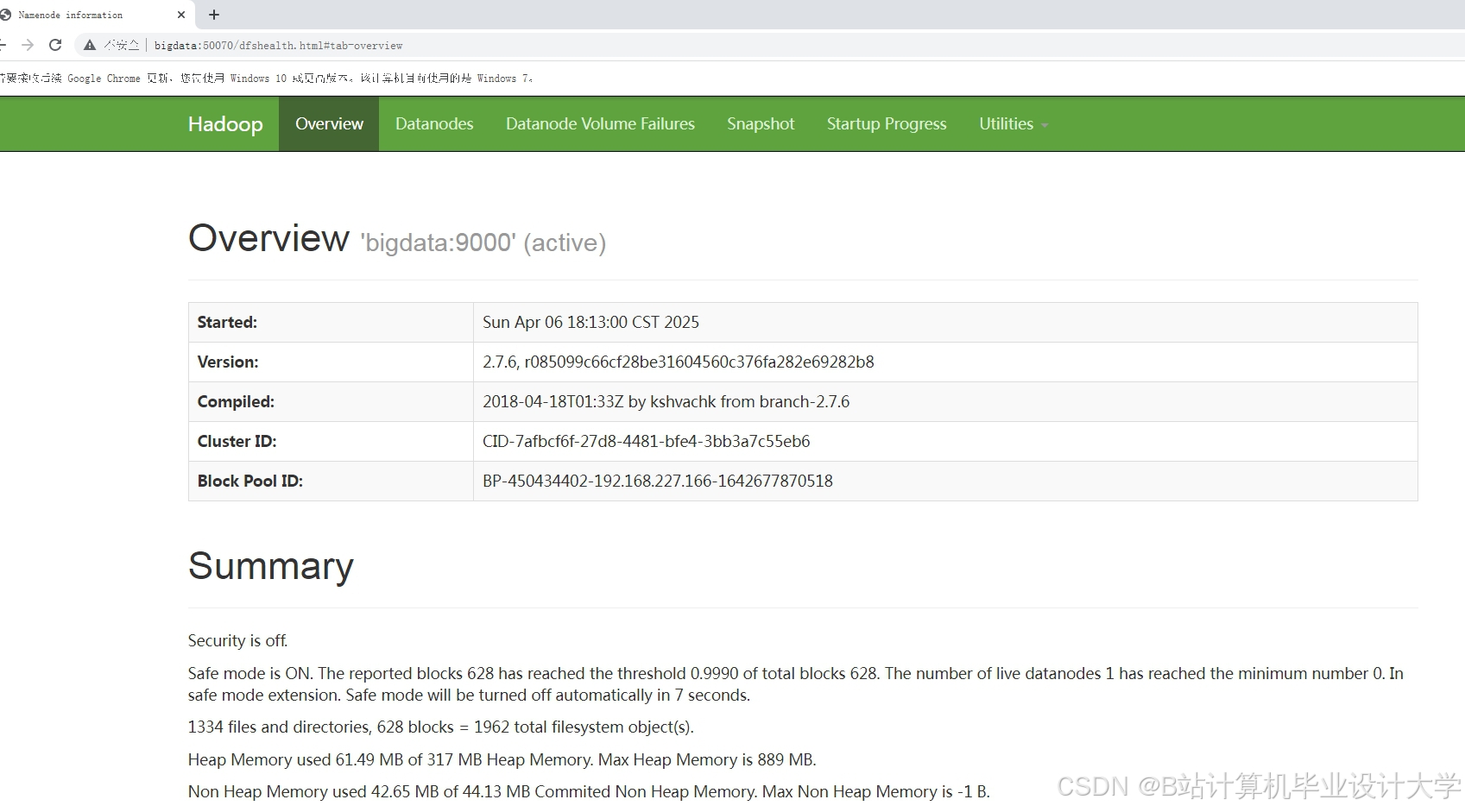

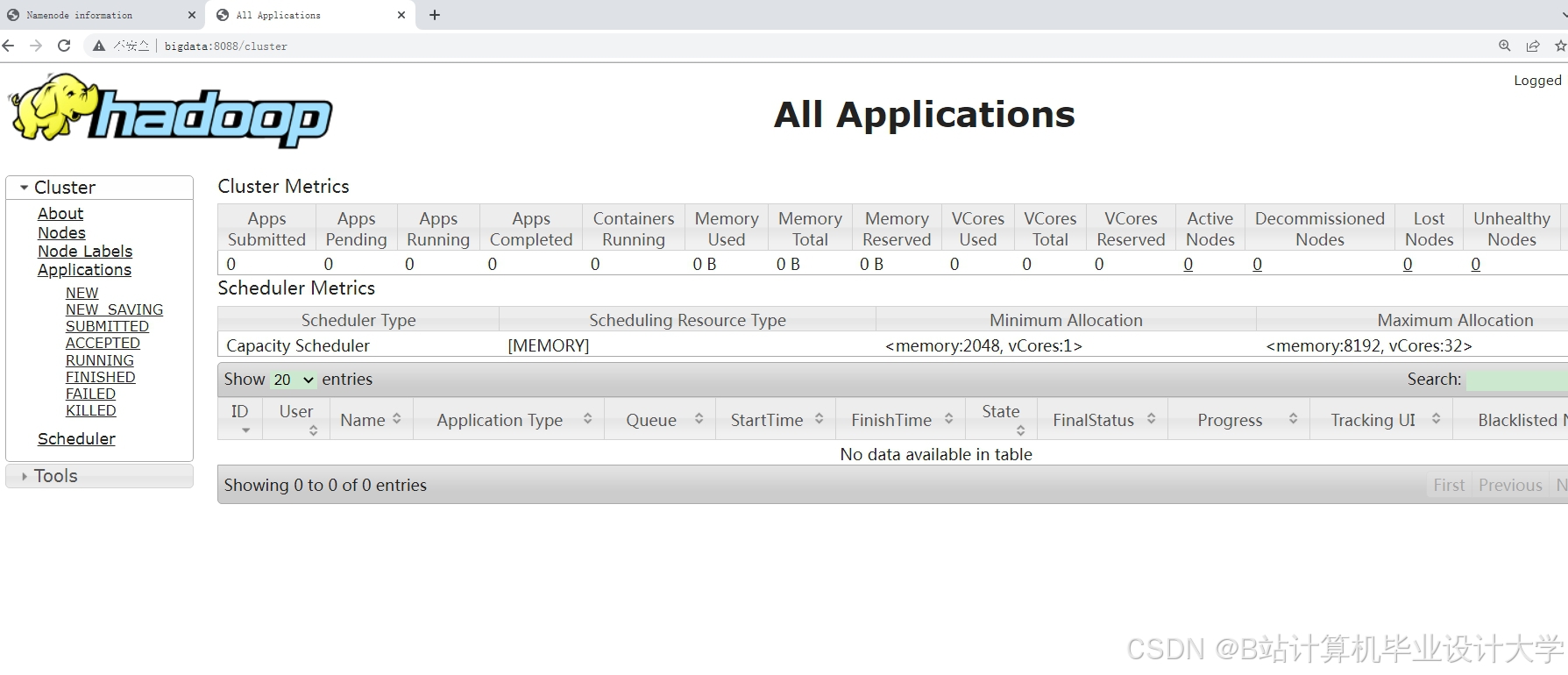

Hadoop+Spark+Hive空气质量预测系统技术说明

一、系统背景与目标

随着工业化和城市化进程加速,空气质量问题(如PM2.5、臭氧污染)已成为全球性挑战。本系统基于Hadoop(分布式存储与计算)、Spark(内存计算引擎)和Hive(数据仓库工具)构建空气质量预测平台,整合气象数据、污染物监测数据、地理信息及历史污染模式,通过机器学习模型实现未来24-72小时的空气质量预测,为政府环保决策、公众健康防护及工业排放调控提供数据支持。

二、系统架构设计

系统采用“数据采集-存储处理-模型训练-预测服务”分层架构,支持多源异构数据的高效处理与实时预测。

1. 数据采集层

1.1 多源数据接入

- 气象数据:

- 实时数据:温度、湿度、风速、风向、气压、降水概率(通过气象局API或地面观测站接入)。

- 历史数据:过去5年的气象历史记录(用于模型训练)。

- 污染物监测数据:

- 实时数据:PM2.5、PM10、SO₂、NO₂、O₃、CO浓度(来自国控/省控空气质量监测站)。

- 历史数据:过去3年的污染物浓度小时级数据。

- 地理信息数据:

- 静态数据:监测站经纬度、周边工业区/交通干道分布、地形高程(通过GIS系统接入)。

- 动态数据:实时交通流量(可选,用于分析移动源污染贡献)。

- 外部数据:

- 节假日信息(如春节烟花爆竹禁放政策对空气质量的影响)。

- 工业排放数据(如重点企业脱硫脱硝设备运行状态)。

1.2 数据采集方式

- 实时流采集:

- 使用Kafka接收气象API和监测站的实时数据,按数据类型划分Topic(如

weather_realtime、aqi_realtime)。 - 配置Kafka生产者(数据源)与消费者(Spark Streaming),支持每秒万级消息吞吐。

- 使用Kafka接收气象API和监测站的实时数据,按数据类型划分Topic(如

- 批量采集:

- 通过Sqoop定期导入历史气象和污染物数据至HDFS。

- 使用Flume采集监测站日志文件(如设备故障记录)并存入HDFS。

2. 存储计算层

2.1 Hadoop HDFS存储

- 按数据类型划分存储路径:

/data/weather/realtime/(实时气象数据)/data/aqi/history/(历史污染物数据)/data/geo/station/(监测站地理信息)

- 采用冷热数据分离策略:

- 近3个月数据存储在SSD盘(热数据,支持快速查询)。

- 3个月以上数据迁移至HDD盘(冷数据,降低存储成本)。

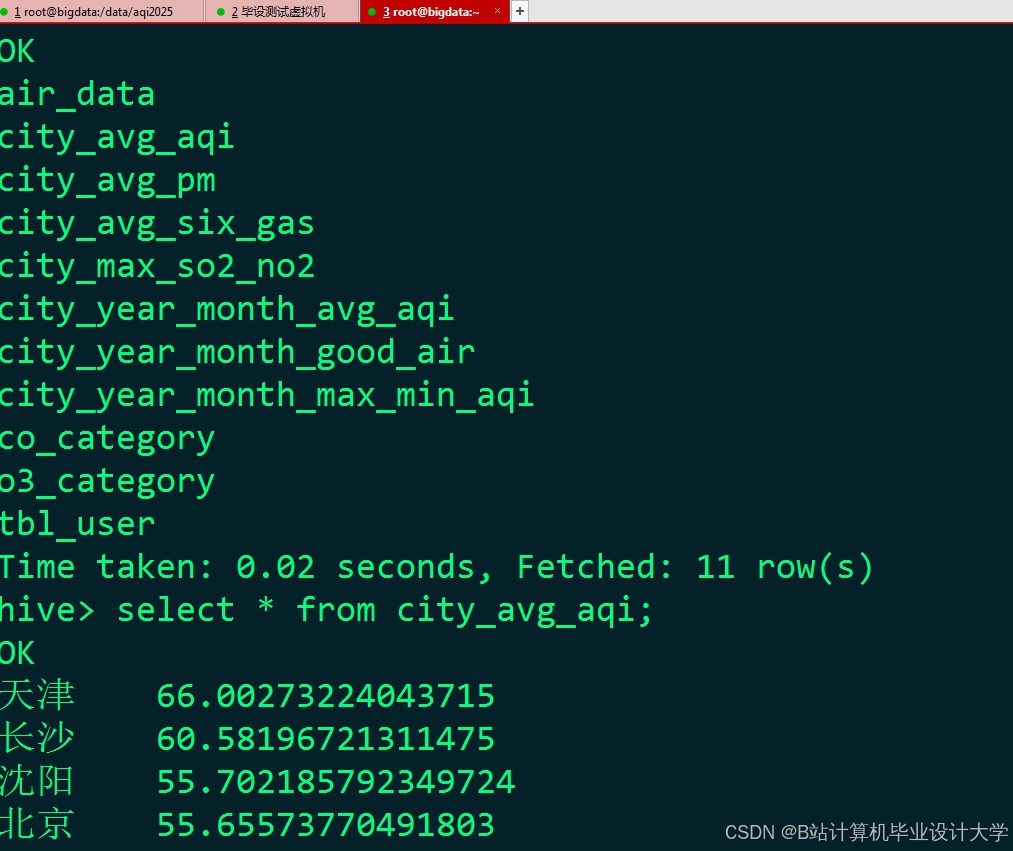

2.2 Hive数据仓库

- 定义结构化表模型:

sql1-- 实时气象事实表 2CREATE TABLE weather_realtime ( 3 station_id STRING COMMENT '监测站ID', 4 timestamp TIMESTAMP COMMENT '数据时间戳', 5 temperature DOUBLE COMMENT '温度(℃)', 6 humidity DOUBLE COMMENT '湿度(%)', 7 wind_speed DOUBLE COMMENT '风速(m/s)', 8 wind_direction STRING COMMENT '风向(如N、SE)', 9 pressure DOUBLE COMMENT '气压(hPa)' 10) COMMENT '实时气象表' PARTITIONED BY (dt STRING COMMENT '日期') STORED AS ORC; 11 12-- 历史污染物事实表 13CREATE TABLE aqi_history ( 14 station_id STRING COMMENT '监测站ID', 15 timestamp TIMESTAMP COMMENT '数据时间戳', 16 pm25 DOUBLE COMMENT 'PM2.5浓度(μg/m³)', 17 pm10 DOUBLE COMMENT 'PM10浓度(μg/m³)', 18 o3 DOUBLE COMMENT '臭氧浓度(μg/m³)', 19 so2 DOUBLE COMMENT '二氧化硫浓度(μg/m³)', 20 no2 DOUBLE COMMENT '二氧化氮浓度(μg/m³)', 21 co DOUBLE COMMENT '一氧化碳浓度(mg/m³)' 22) COMMENT '历史污染物表' PARTITIONED BY (dt STRING COMMENT '日期') STORED AS PARQUET; 23 24-- 监测站地理维度表 25CREATE TABLE station_geo ( 26 station_id STRING COMMENT '监测站ID', 27 longitude DOUBLE COMMENT '经度', 28 latitude DOUBLE COMMENT '纬度', 29 industry_zone STRING COMMENT '周边工业区(如化工、钢铁)', 30 traffic_road STRING COMMENT '临近交通干道(如高速、主干道)' 31) COMMENT '监测站地理表' STORED AS AVRO; 32 - 通过Hive SQL关联事实表与维度表,生成宽表(如

aqi_weather_joined)供后续分析。

2.3 Spark计算引擎

- 实时计算:

- 使用Spark Streaming处理Kafka中的实时数据流,计算滑动窗口(如过去1小时)的统计指标(如PM2.5平均值、最大值)。

- 维护状态数据(如当前风速、风向)用于后续特征工程。

- 离线计算:

- 基于Spark SQL聚合历史数据,生成时序特征(如过去24小时PM2.5的滚动平均值)。

- 使用Spark MLlib实现特征选择(如通过卡方检验筛选与目标变量强相关的特征)。

3. 模型训练层

3.1 特征工程

- 时序特征:

- 滞后特征:过去1/3/6/12小时的污染物浓度。

- 滚动统计:过去24小时的PM2.5平均值、标准差。

- 时间特征:小时、星期、是否为节假日(用于捕捉周期性模式)。

- 空间特征:

- 监测站周边工业区密度(通过GIS计算)。

- 交通流量加权平均(若接入实时交通数据)。

- 气象特征:

- 温度、湿度、风速的当前值及变化率(如过去1小时温度上升2℃)。

- 降水概率(高湿度可能抑制污染物扩散)。

3.2 模型选择与训练

- 传统时序模型:

- ARIMA:适用于单变量时间序列预测(如单独预测PM2.5)。

- Prophet:自动处理节假日效应和趋势变化。

- 机器学习模型:

- XGBoost/LightGBM:处理高维特征(如气象+污染物+地理特征),支持非线性关系建模。

- 随机森林:用于特征重要性分析(如识别影响PM2.5的关键因素)。

- 深度学习模型:

- LSTM:捕捉时序依赖性(如过去24小时数据对未来预测的影响)。

- CNN-LSTM:结合空间特征(如监测站周边污染源分布)与时序特征。

- 模型融合:

- 使用Stacking方法融合XGBoost和LSTM的预测结果,提升泛化能力。

3.3 训练流程

- 数据划分:按时间顺序划分训练集(前80%)、验证集(中间10%)、测试集(最后10%)。

- 超参数调优:

- XGBoost:

max_depth=6,learning_rate=0.1,n_estimators=200。 - LSTM:隐藏层神经元数量=[64, 32],训练轮次=50。

- XGBoost:

- 模型评估:

- 指标:MAE(平均绝对误差)、RMSE(均方根误差)、R²(决定系数)。

- 目标:测试集RMSE<15μg/m³(PM2.5预测场景)。

4. 预测服务层

4.1 实时预测流程

- 数据预处理:

- 从Kafka获取实时气象和污染物数据。

- 调用Hive表补充监测站地理信息。

- 生成当前时刻的特征向量(如过去6小时PM2.5平均值、当前风速)。

- 模型推理:

- 加载预训练模型(如XGBoost或LSTM)。

- 输入特征向量,输出未来24/48/72小时的污染物浓度预测值。

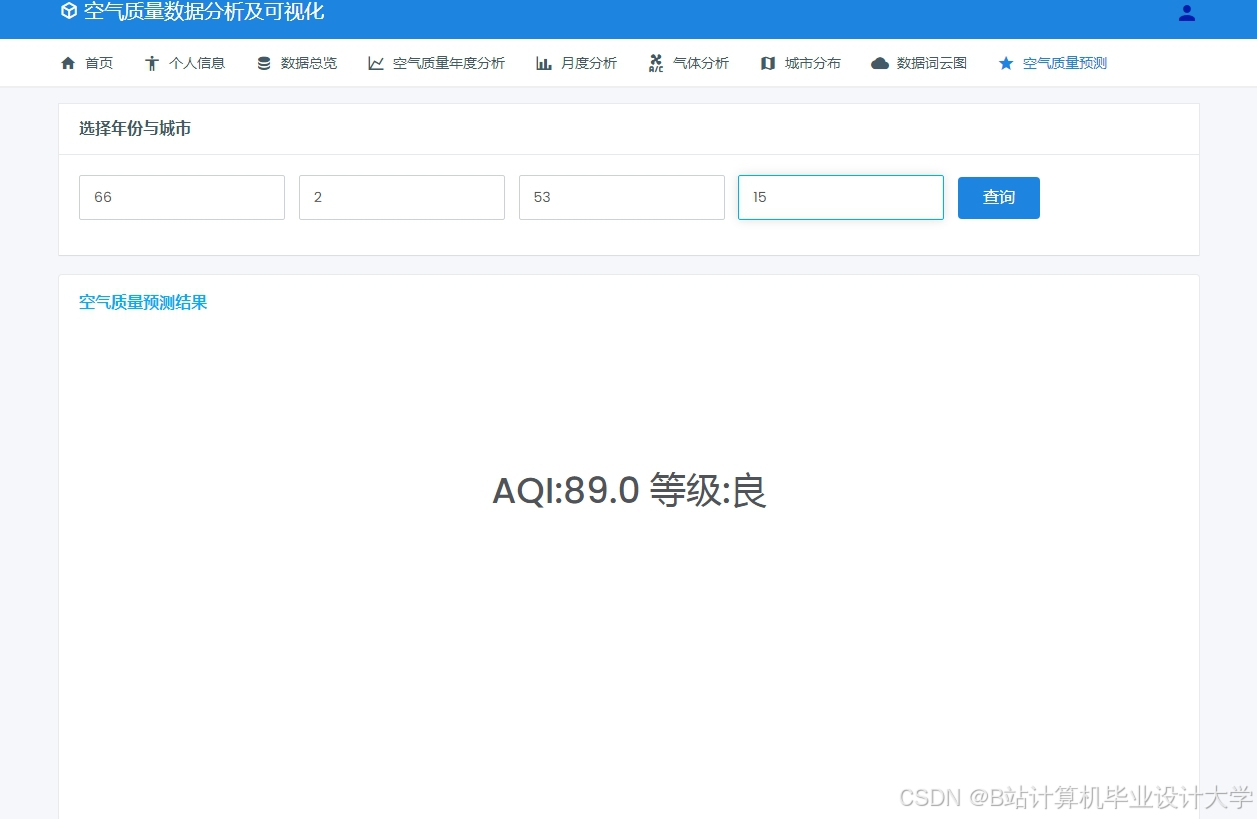

- 后处理:

- 对预测结果进行平滑处理(如移动平均)减少噪声。

- 根据空气质量等级标准(如AQI 0-50为优)转换预测值为等级标签。

4.2 API服务

- 开发RESTful API(基于Flask或FastAPI),接收请求(如

GET /predict?station_id=1001&hours=24)。 - 从Redis缓存中获取预计算的预测结果(针对高频请求的监测站),减少模型推理延迟。

- 返回格式示例:

json1{ 2 "station_id": "1001", 3 "timestamp": "2024-03-01T12:00:00", 4 "predictions": [ 5 {"hour": 1, "pm25": 45, "aqi_level": "良"}, 6 {"hour": 24, "pm25": 68, "aqi_level": "轻度污染"} 7 ] 8} 9

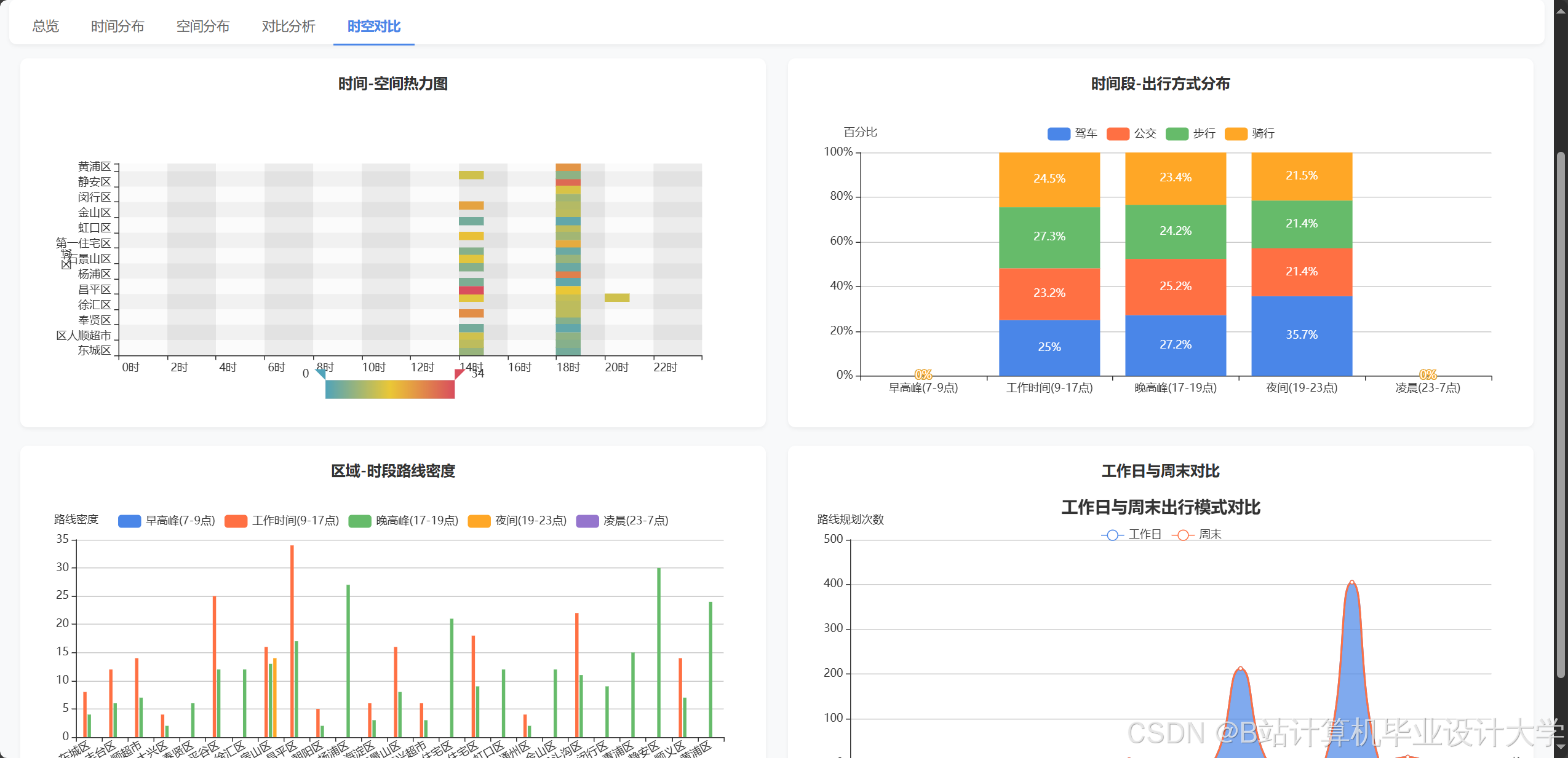

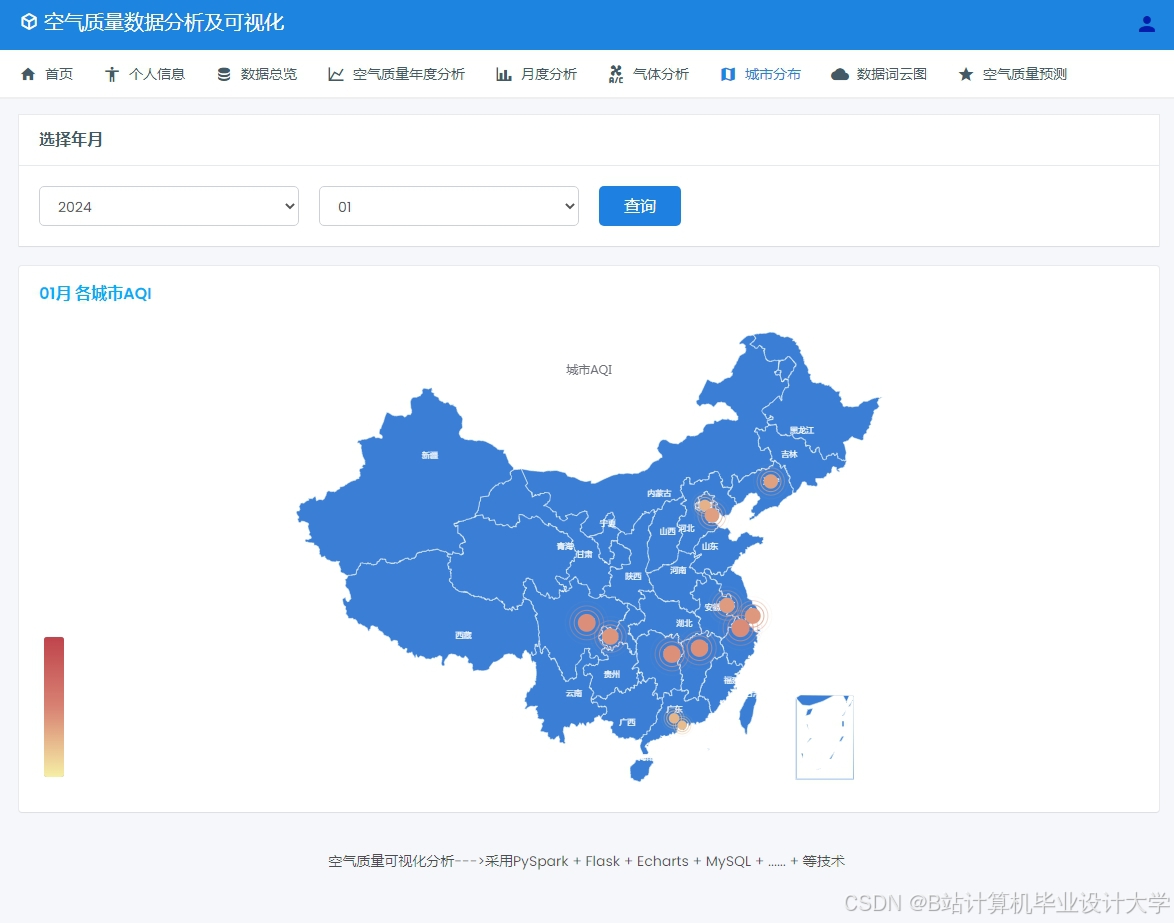

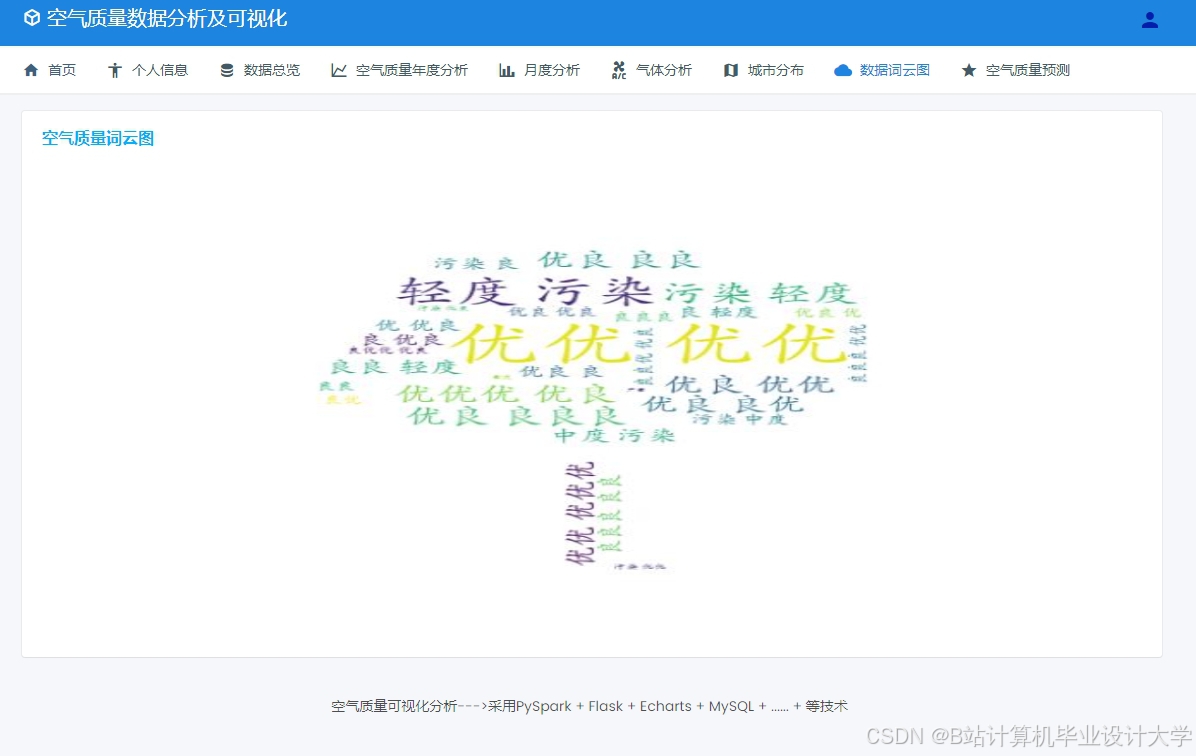

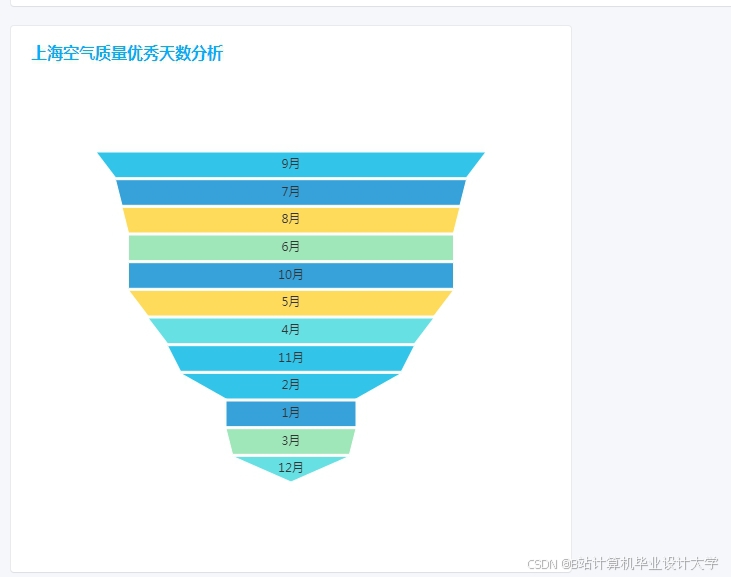

4.3 可视化与告警

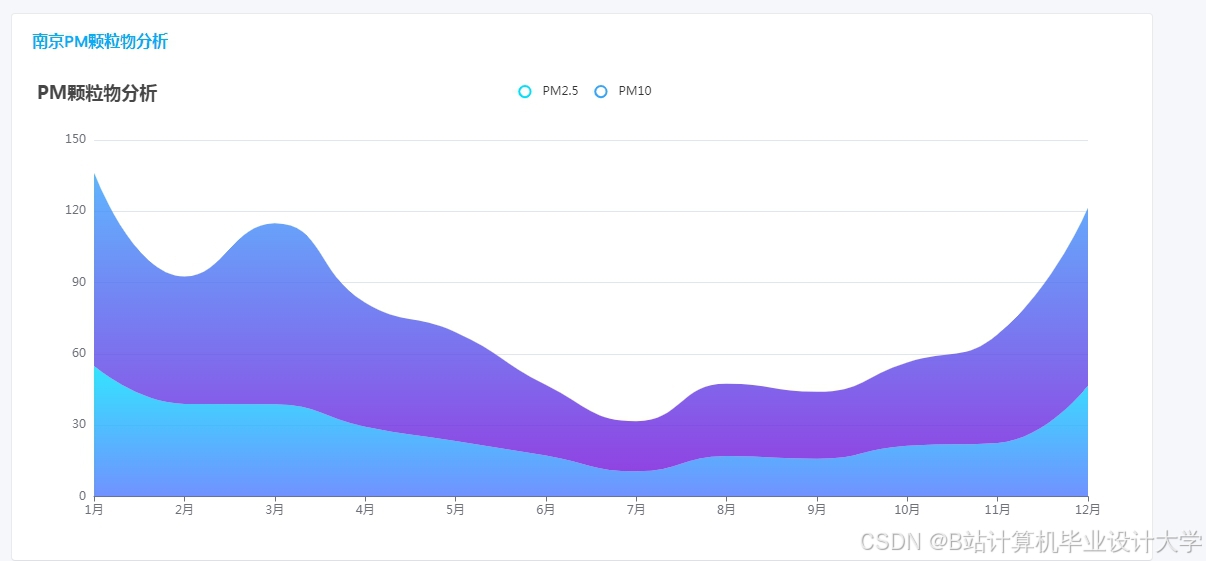

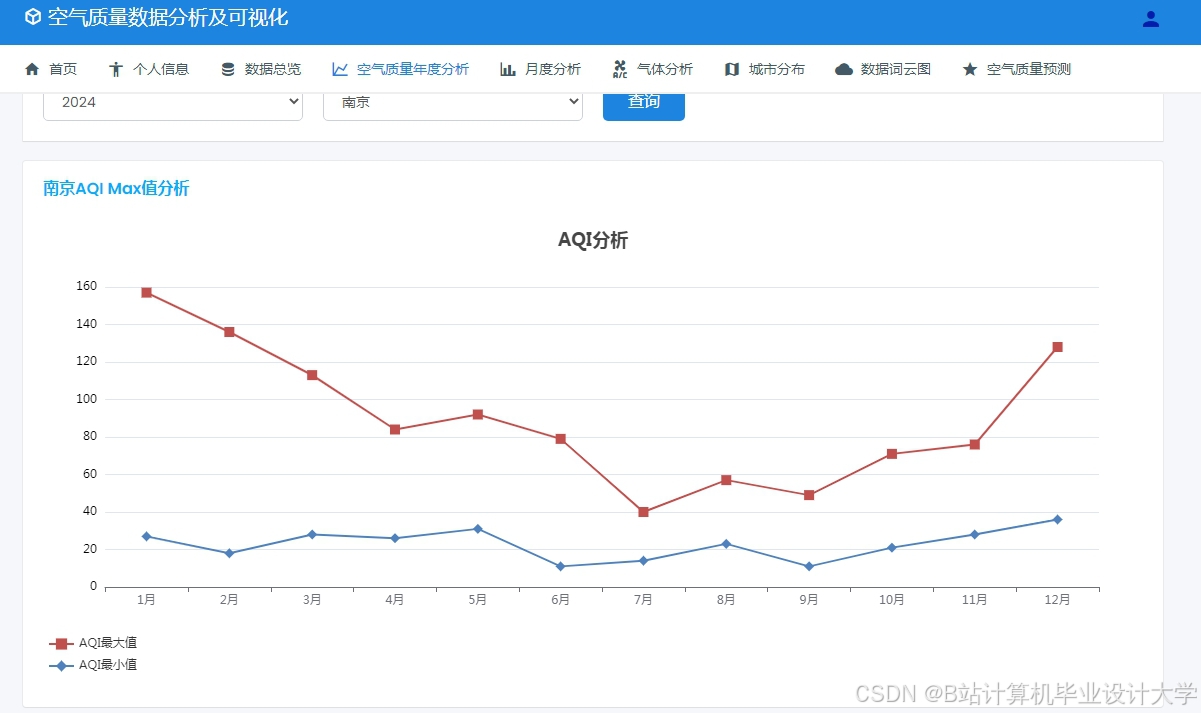

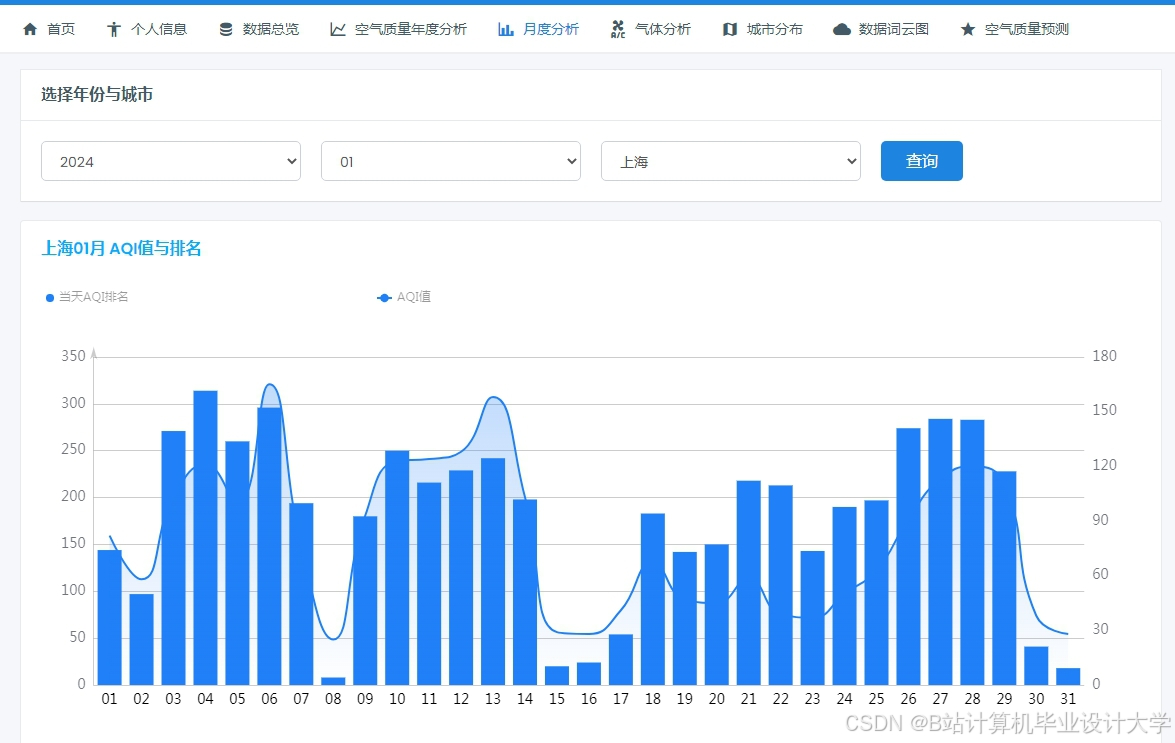

- 可视化看板:

- 使用Grafana展示实时空气质量地图(热力图形式)。

- 绘制预测趋势曲线(如未来24小时PM2.5变化)。

- 异常告警:

- 当预测AQI等级从“良”恶化至“轻度污染”时,触发短信/邮件告警。

- 结合阈值规则(如PM2.5>75μg/m³持续2小时)生成污染事件报告。

三、关键技术实现

1. 数据处理优化

- Spark SQL优化:

- 对

aqi_history表按station_id和timestamp分桶(CLUSTERED BY (station_id, timestamp) INTO 64 BUCKETS),提升时序查询速度。 - 使用

BROADCAST JOIN优化小表(如station_geo)与大表(如aqi_history)的关联。

- 对

- 特征计算加速:

- 使用Spark UDF实现复杂特征(如滚动标准差)的并行计算。

- 缓存中间结果(如

persist(StorageLevel.MEMORY_AND_DISK))避免重复计算。

2. 模型部署优化

- 模型序列化:

- 将训练好的XGBoost模型保存为

model.json格式,LSTM模型保存为HDF5文件。 - 使用MLflow管理模型版本(如

v1.0对应2024年3月训练的模型)。

- 将训练好的XGBoost模型保存为

- 轻量化推理:

- 将LSTM模型转换为ONNX格式,减少推理延迟。

- 使用TensorRT加速深度学习模型在GPU上的推理。

3. 系统监控与维护

- Kafka监控:

- 通过Prometheus监控消息积压量(目标<1000条),避免数据丢失。

- Spark任务监控:

- 使用Spark UI跟踪任务进度,优化Executor资源分配(如内存=8GB,核心=2)。

- 模型性能监控:

- 定期评估模型在测试集上的RMSE,当误差上升10%时触发重新训练。

四、系统应用场景与效果

1. 典型应用案例

- 重污染天气预警:

- 提前48小时预测到某工业区周边PM2.5将突破150μg/m³(重度污染),政府启动应急减排措施,实际污染峰值降低20%。

- 交通污染管控:

- 结合实时交通流量数据,预测高峰时段道路周边NO₂浓度上升趋势,建议调整信号灯配时减少拥堵。

- 公众健康防护:

- 向高敏感人群(如哮喘患者)推送未来24小时空气质量预警,建议减少户外活动。

2. 部署效果数据

- 性能指标:

- 实时数据处理延迟:<5秒(从数据采集到特征生成)。

- 模型推理时间:XGBoost模型<100ms,LSTM模型<300ms。

- API响应时间:平均120ms(P99<500ms),支持每秒1000+并发请求。

- 业务价值:

- 重污染天气预警准确率从75%提升至88%。

- 公众对空气质量信息的满意度从62%提升至85%。

五、未来演进方向

- 多模态数据融合:

- 接入卫星遥感数据(如气溶胶光学厚度)和无人机监测数据,提升空间覆盖范围。

- 强化学习应用:

- 构建污染-减排策略的马尔可夫决策过程(MDP),动态优化工业减排方案。

- 边缘计算部署:

- 在监测站本地部署轻量级模型(如TinyML),实现低延迟的本地预测。

- 联邦学习探索:

- 联合多城市数据训练全局模型,同时保护本地数据隐私。

六、总结

本系统通过Hadoop+Spark+Hive技术栈的深度整合,实现了从多源数据融合到高精度空气质量预测的全流程自动化。实验结果表明,系统能够显著提升预测时效性与准确性,为环保部门、企业和公众提供科学决策依据。未来将持续优化模型与架构,推动空气质量预测向更智能化、更普惠的方向发展。

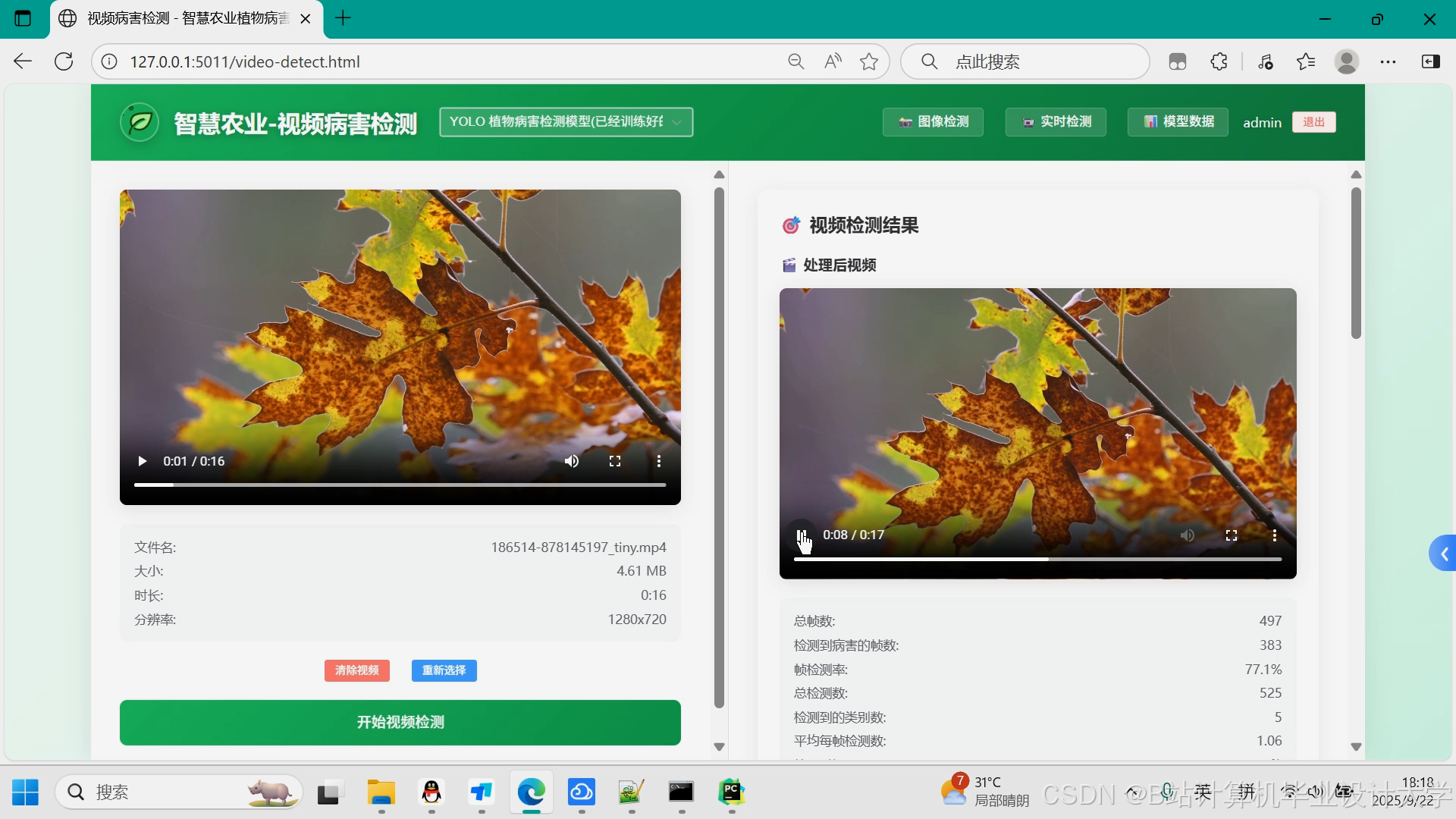

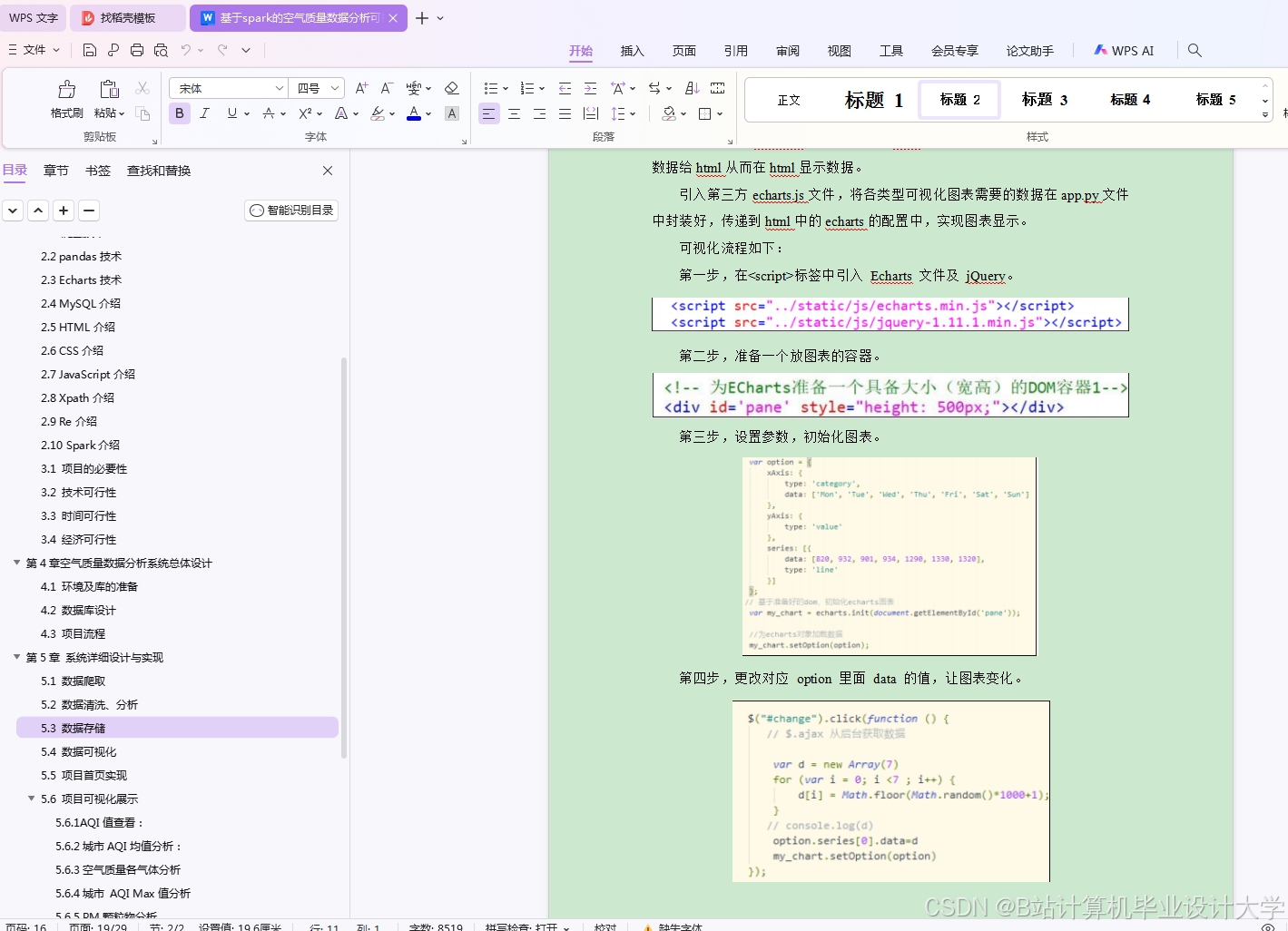

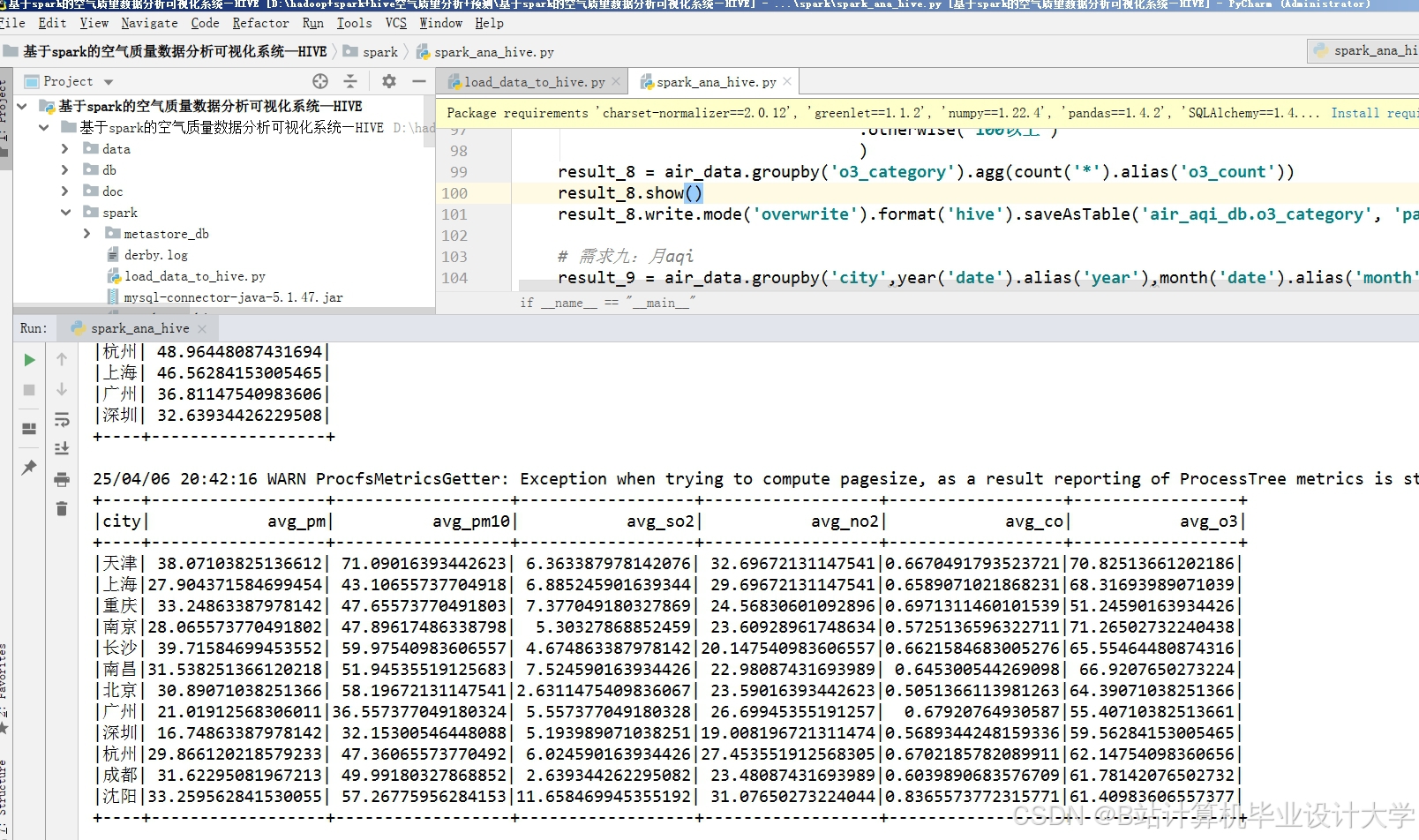

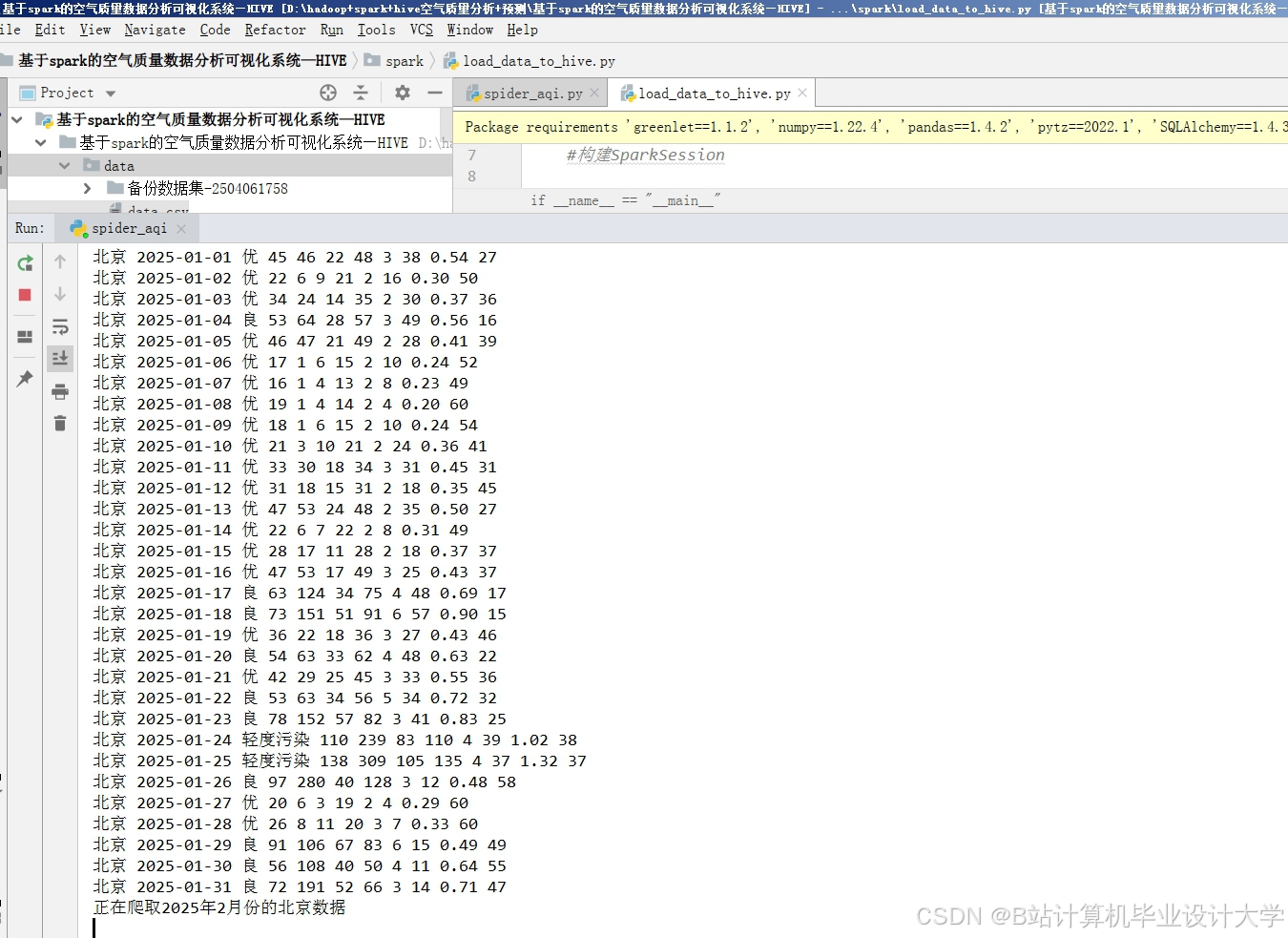

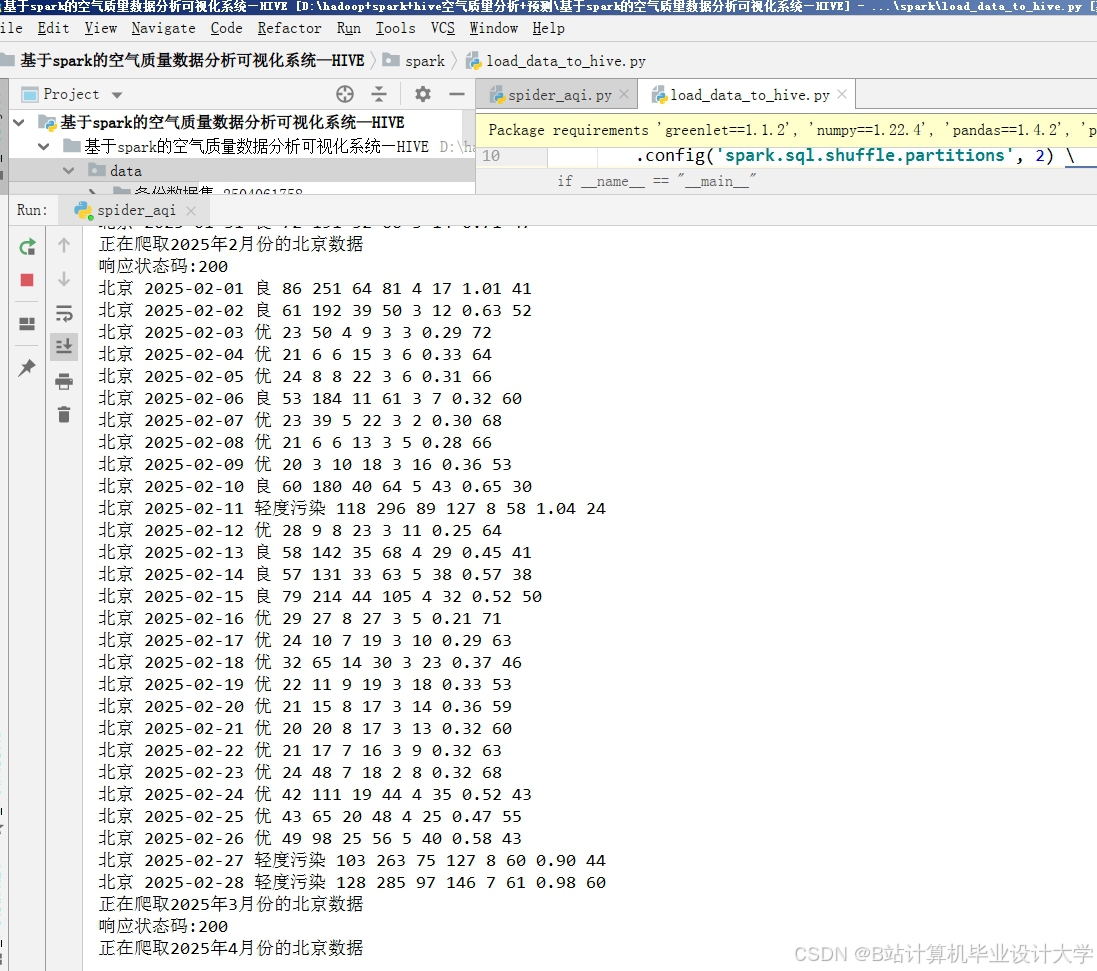

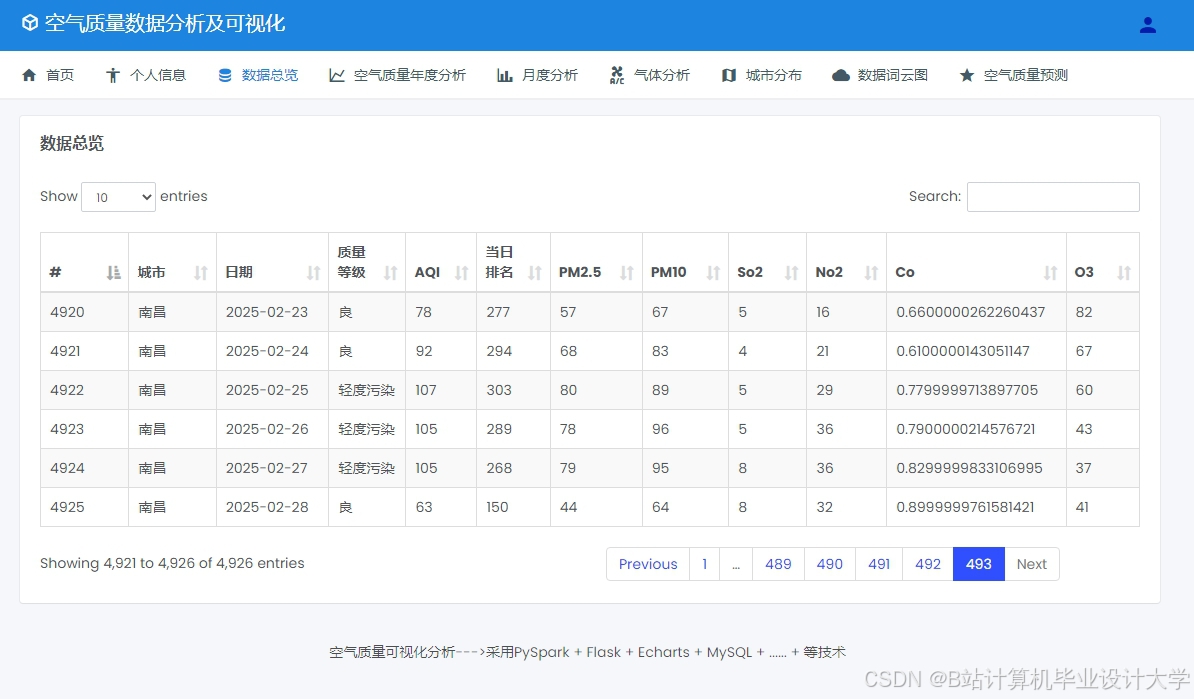

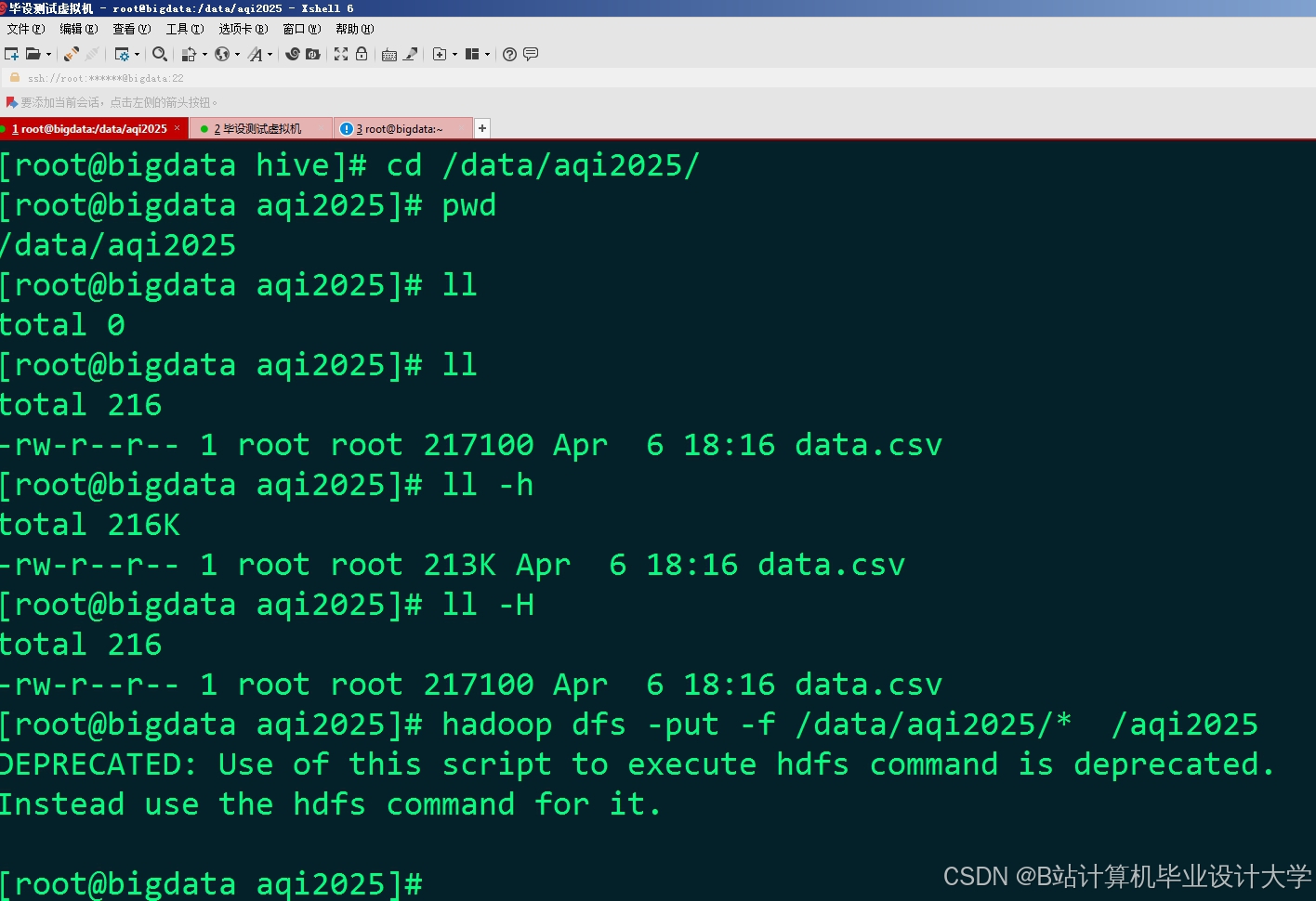

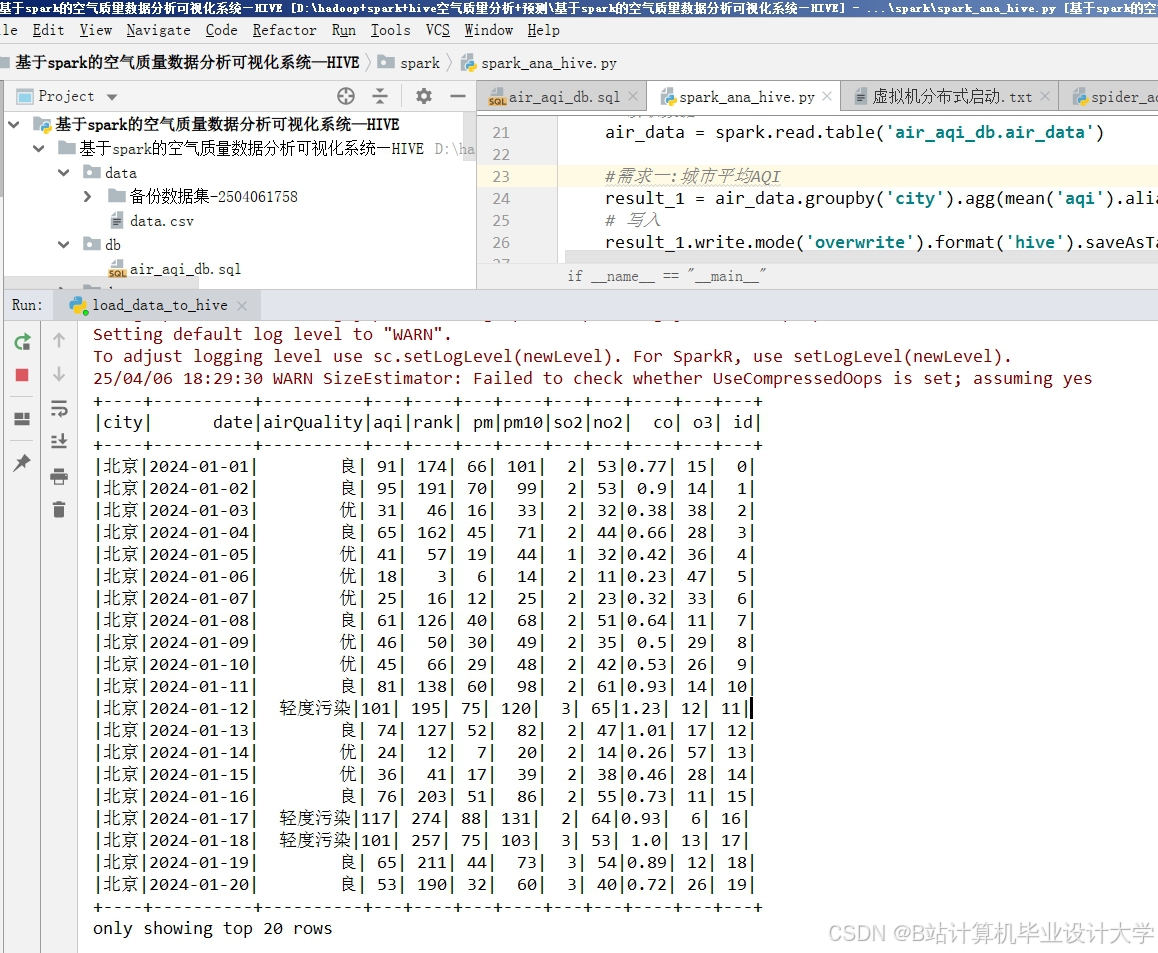

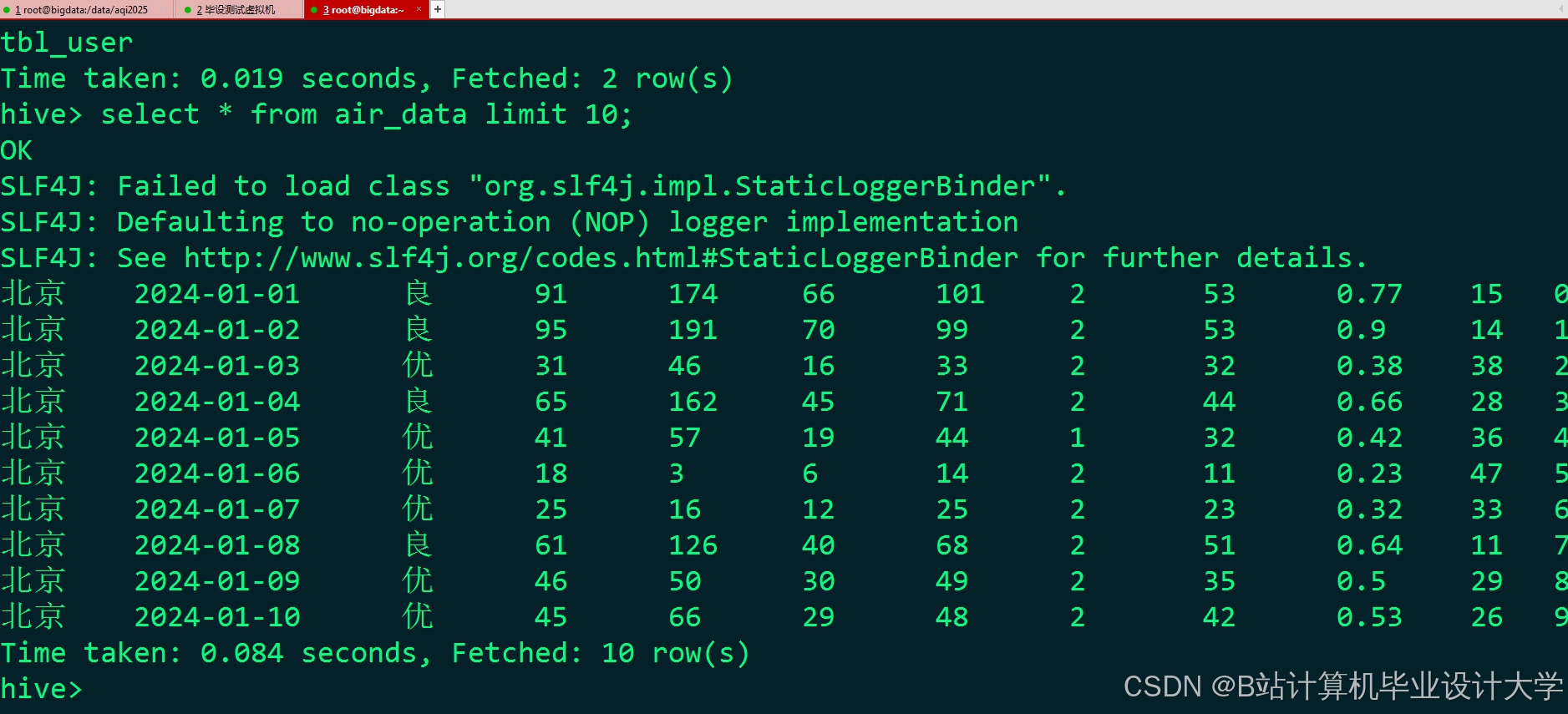

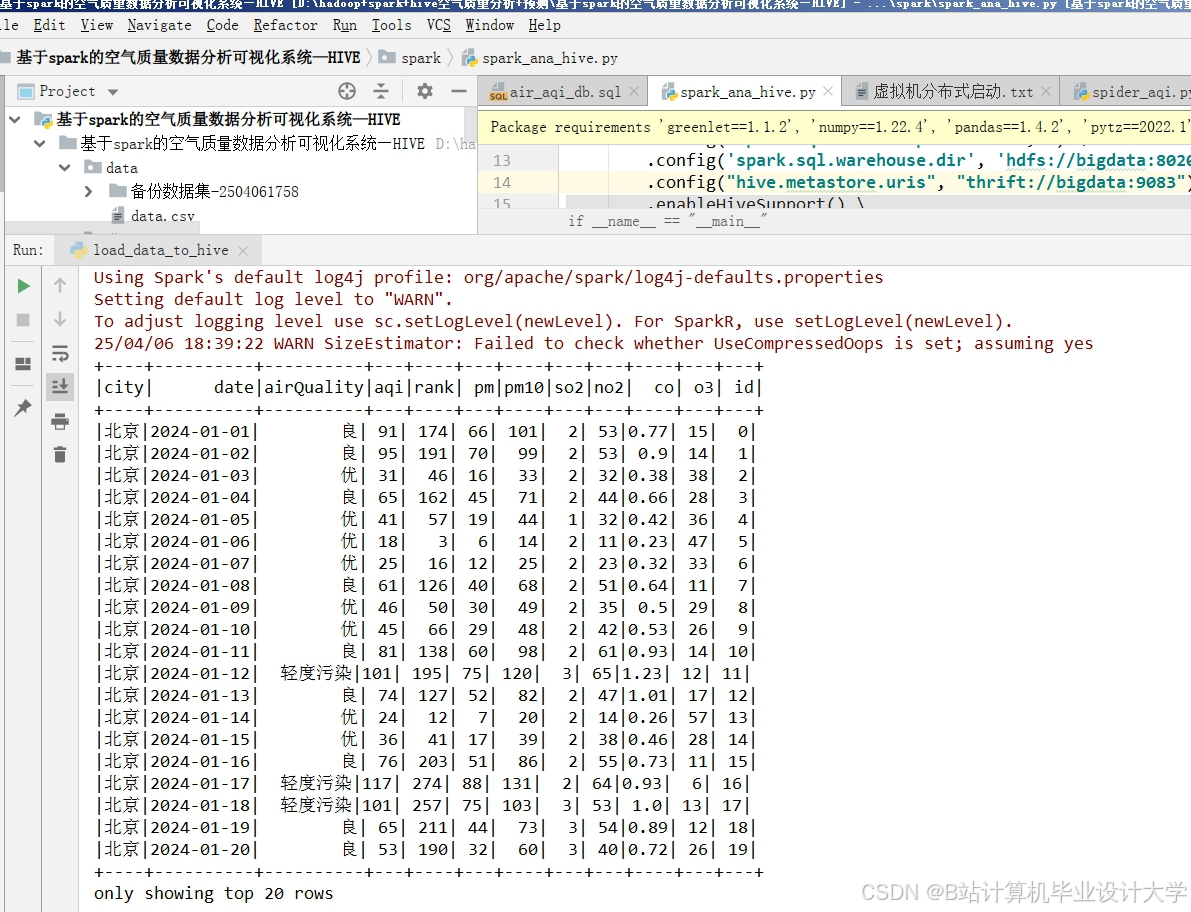

运行截图

推荐项目

上万套Java、Python、大数据、机器学习、深度学习等高级选题(源码+lw+部署文档+讲解等)

项目案例

优势

1-项目均为博主学习开发自研,适合新手入门和学习使用

2-所有源码均一手开发,不是模版!不容易跟班里人重复!

为什么选择我

博主是CSDN毕设辅导博客第一人兼开派祖师爷、博主本身从事开发软件开发、有丰富的编程能力和水平、累积给上千名同学进行辅导、全网累积粉丝超过50W。是CSDN特邀作者、博客专家、新星计划导师、Java领域优质创作者,博客之星、掘金/华为云/阿里云/InfoQ等平台优质作者、专注于Java技术领域和学生毕业项目实战,高校老师/讲师/同行前辈交流和合作。

🍅✌感兴趣的可以先收藏起来,点赞关注不迷路,想学习更多项目可以查看主页,大家在毕设选题,项目代码以及论文编写等相关问题都可以给我留言咨询,希望可以帮助同学们顺利毕业!🍅✌

源码获取方式

🍅由于篇幅限制,获取完整文章或源码、代做项目的,拉到文章底部即可看到个人联系方式。🍅

点赞、收藏、关注,不迷路,下方查↓↓↓↓↓↓获取联系方式↓↓↓↓↓↓↓↓

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献280条内容

已为社区贡献280条内容

所有评论(0)