玩转OpenClaw|本地OpenClaw接入企业微信笔记

OpenClaw(前身为 Clawdbot/Moltbot)是一款开源、本地优先、可执行任务的 AI 自动化代理引擎,遵循 MIT 协议。它以自然语言指令为驱动,在本地或私有云环境中完成文件操作、流程编排、浏览器自动化、多 IM 平台交互等任务,实现从 “对话式建议” 到 “自动化执行” 的跨越,是面向个人与企业的自托管式 AI 数字员工。

1、安装 OpenClaw

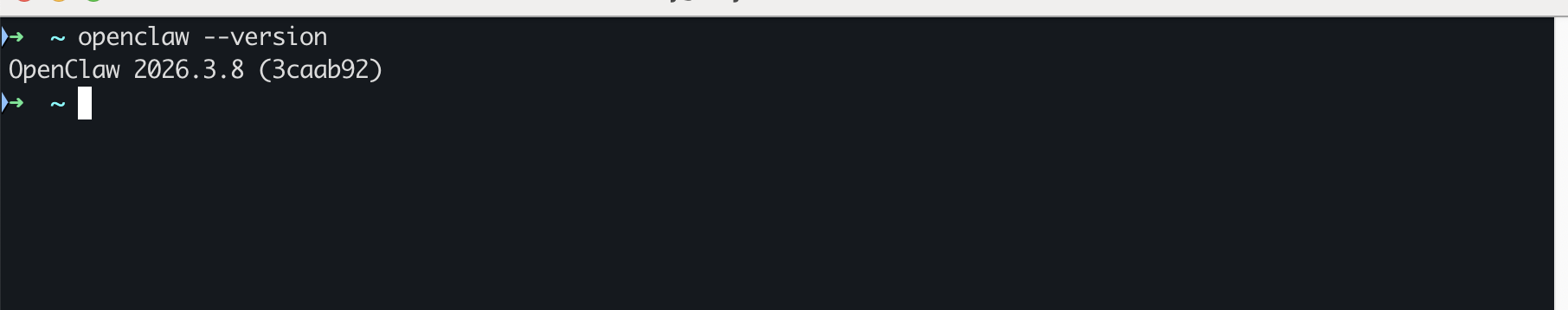

打开终端,执⾏以下命令:

#curl -fsSL --proto '=https' --tlsv1.2 https://openclaw.ai/install.sh | bash 安装完成后,验证安装:

openclaw --version

2、安装企业微信插件

#openclaw plugins install @wecom/wecom-openclaw-plugin3、创建企业微信智能机器人

OpenClaw接入企业微信支持两种不同的通道(Channel),分别是企业微信机器人和企业微信应用,二者支持的消息类型有所差异。为了实现尽量全面的功能,我们建议您同时接入企业微信机器人和企业微信应用,如果其中一个通道无法响应您的需求(比如企业微信机器人回复时无法发送文件),OpenClaw可以自动切换另外一个通道来进行响应(比如通过企业微信应用发送文件)。

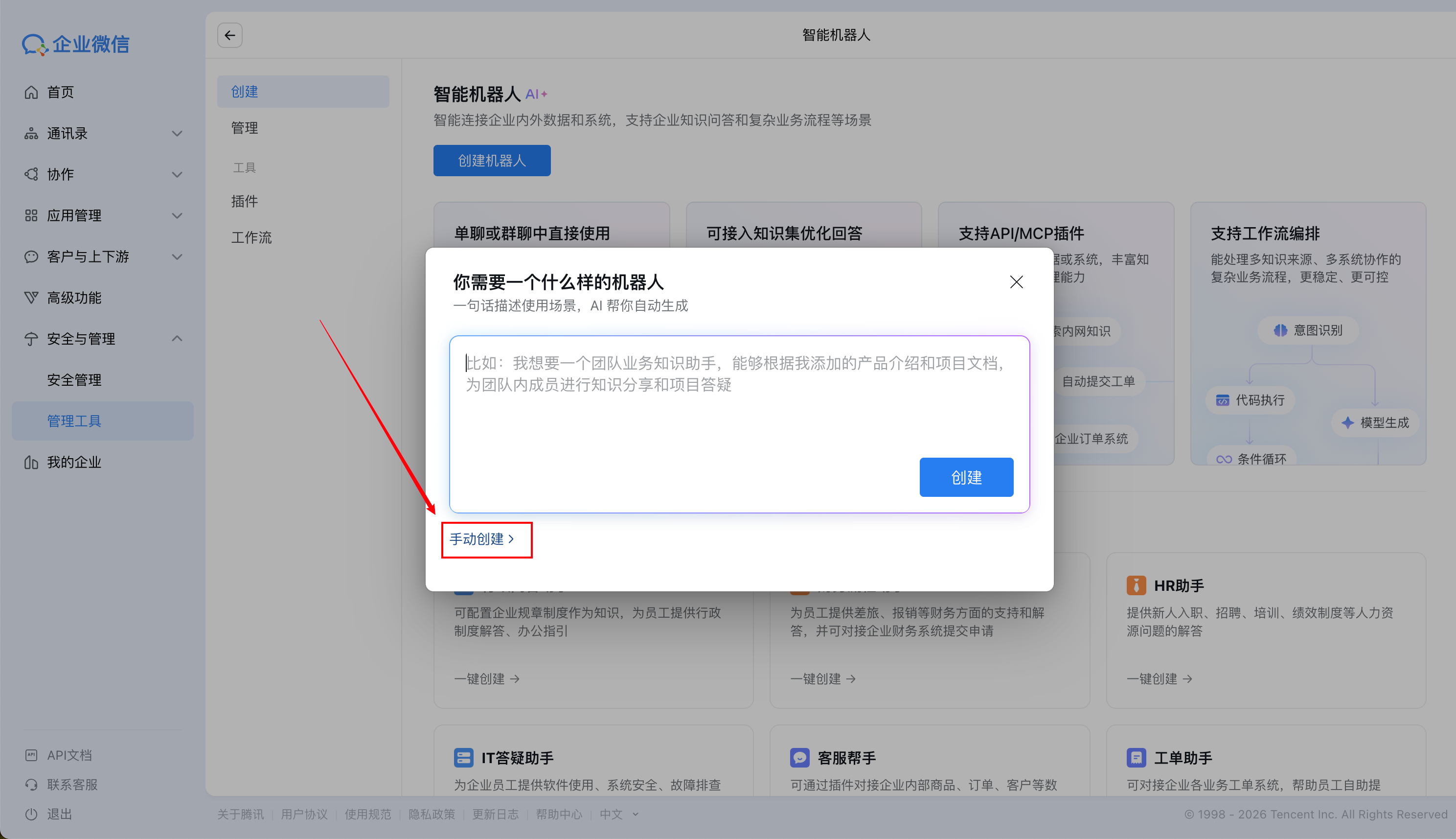

在企业微信管理后台左侧导航依次找到并进入安全与管理 > 管理工具,选择智能机器人,然后在页面内点击创建机器人。

在弹出的弹窗中点击手动创建按钮:

滑到页面最底端,点击API模式创建按钮。

使用长连接方式接入企微机器人

选择以「长连接」方式创建,在配置方法中的Secret处单击点击获取:

Bot ID 和 Secret 后面配置 OpenClaw 是需要用到。

最后单击页面内的保存:

至此企业微信智能机器人创建完成;可以在 企业创建列表内查看到;

4、继续配置 OpenClaw

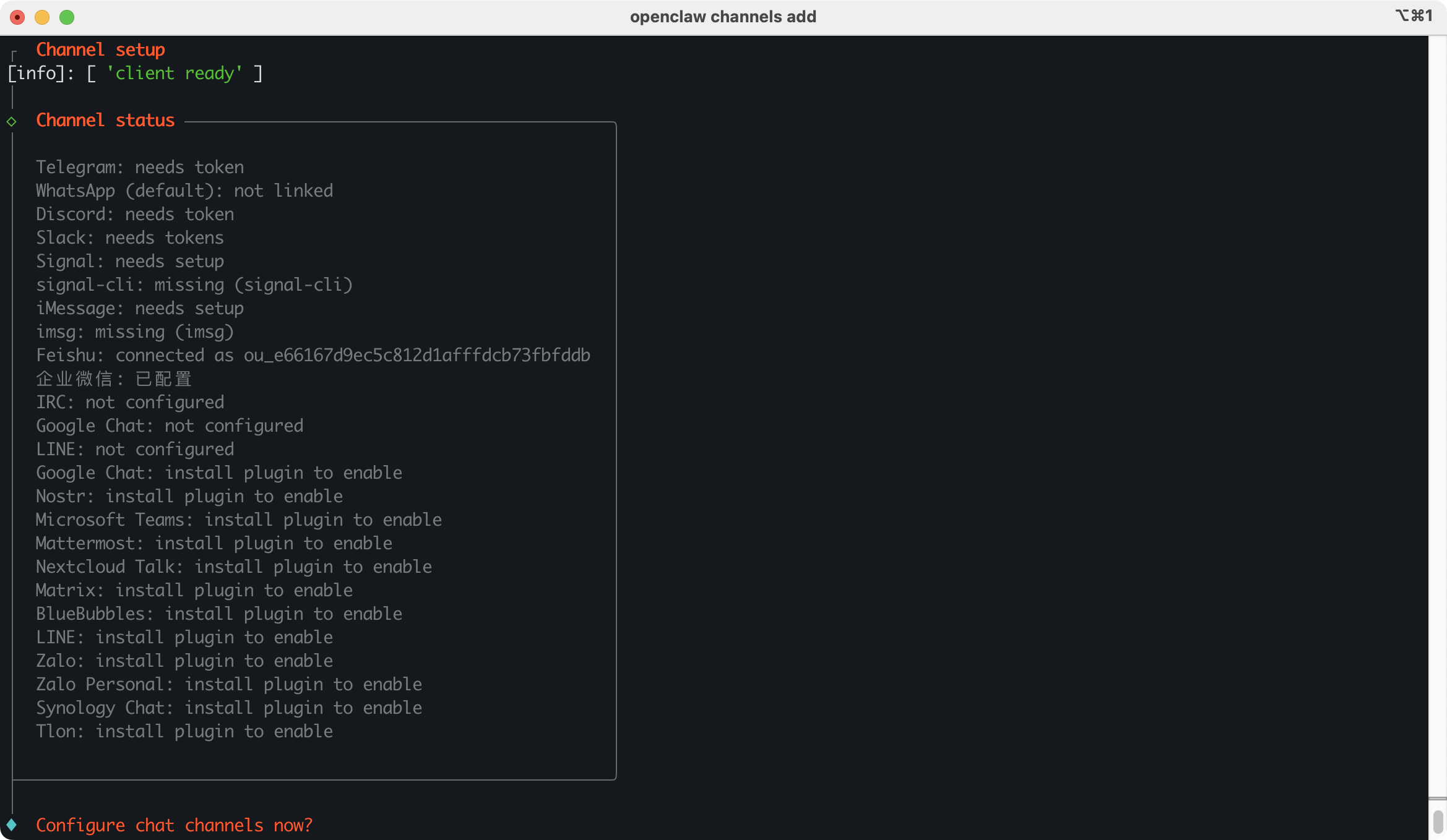

配置渠道:

openclaw channels add

确认开始渠道配置

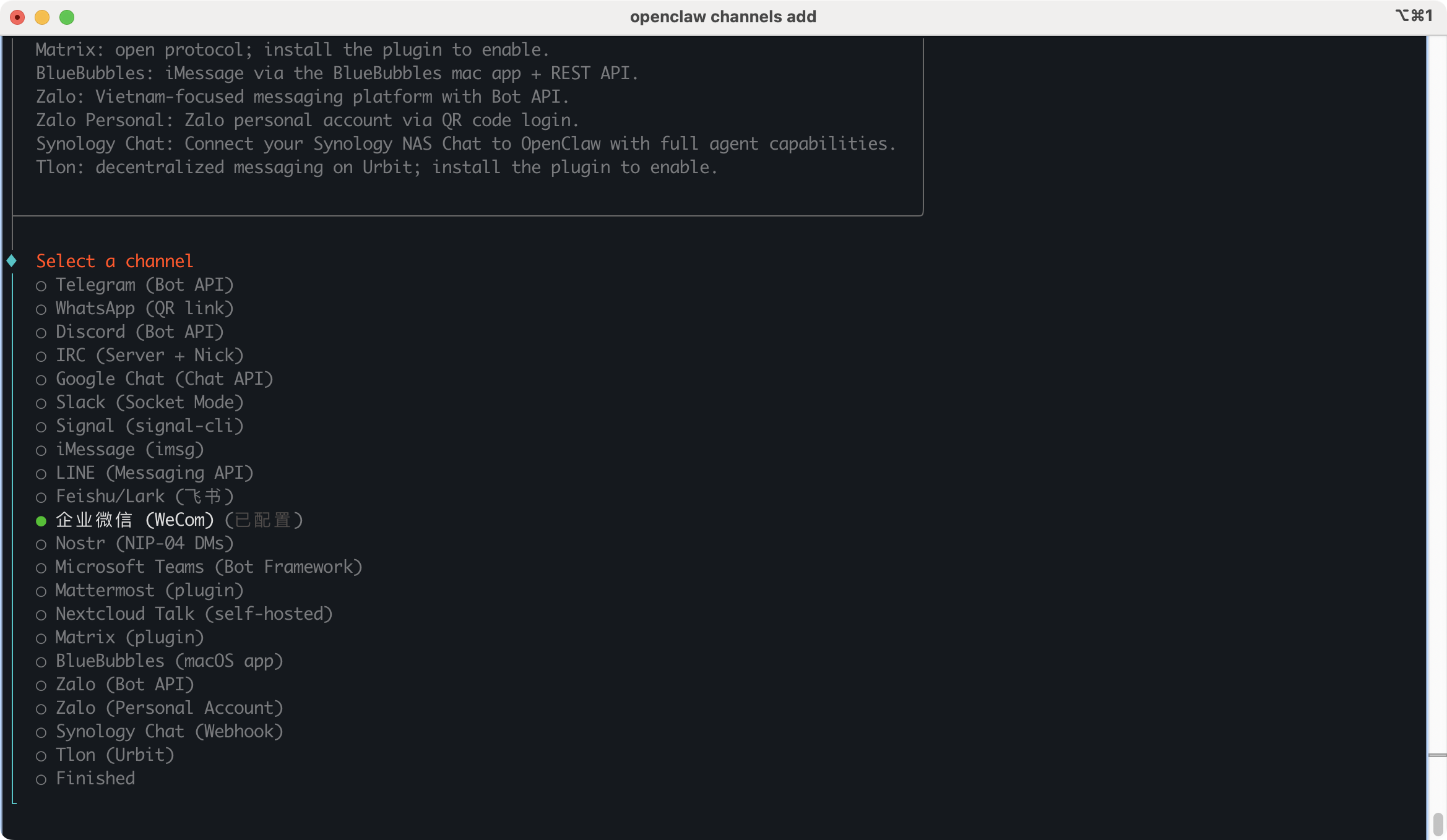

选择企业微信插件

企业微信机器人 Bot ID、企业微信机器人 Secret

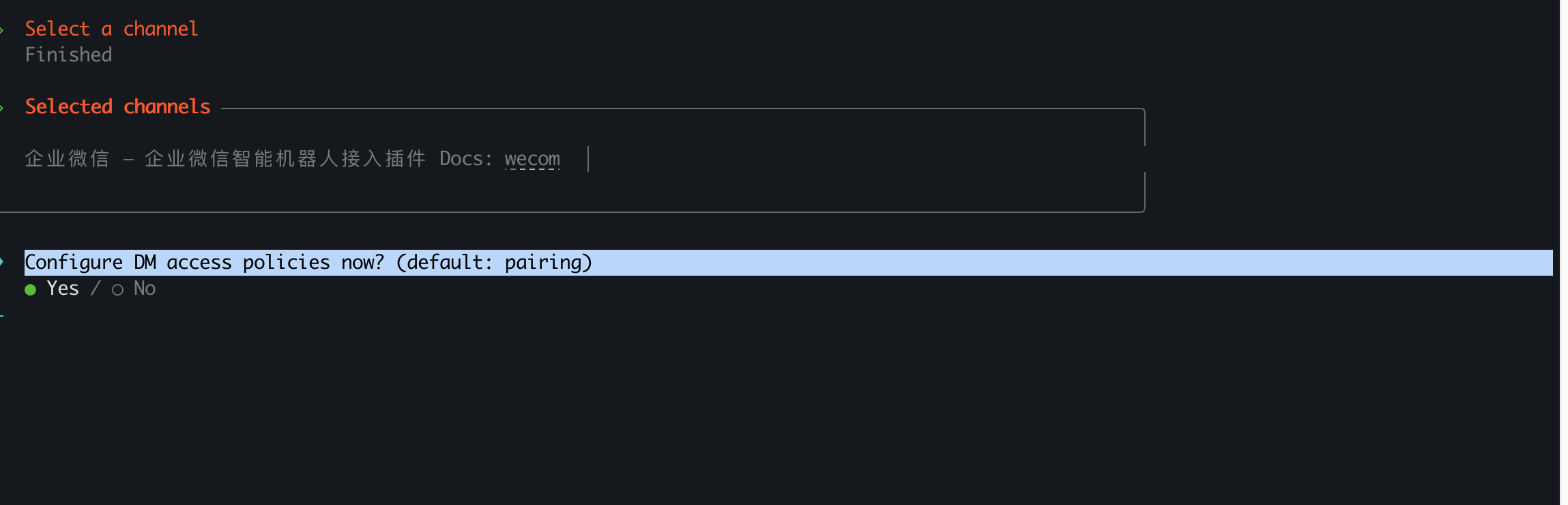

现在配置DM访问策略吗?(默认:配对)

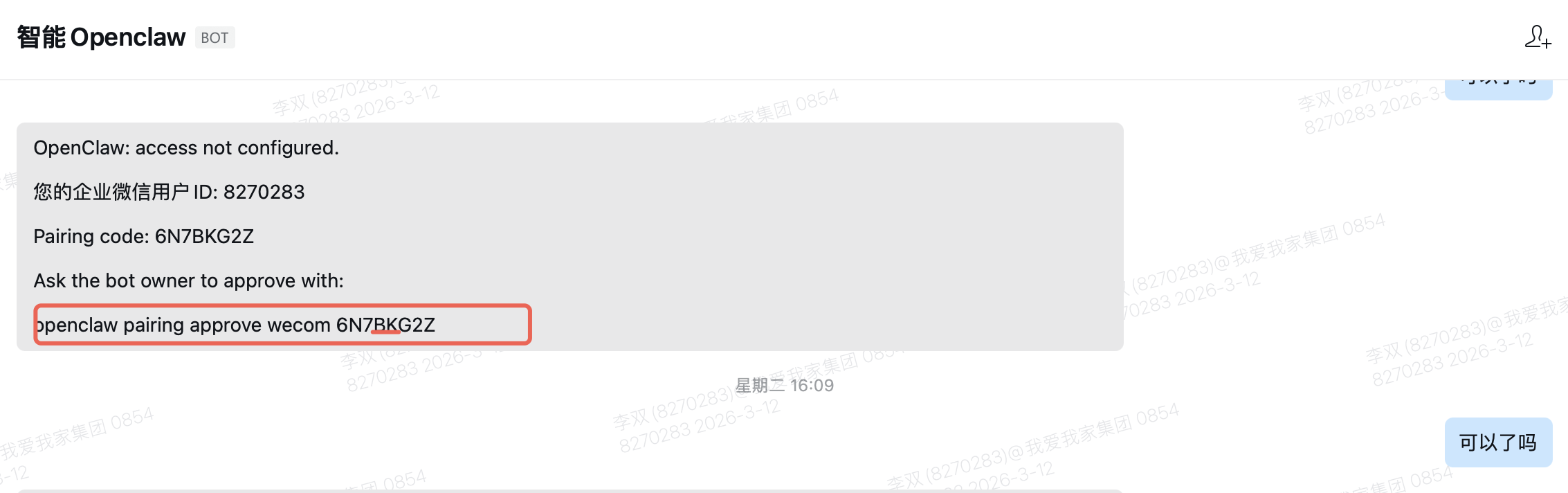

需要通过企业微信给机器人发一条消息 任意内容,会收到机器的配对相应;

复制在客户端内执行一下即可;

配对后理论上就可以使用了;

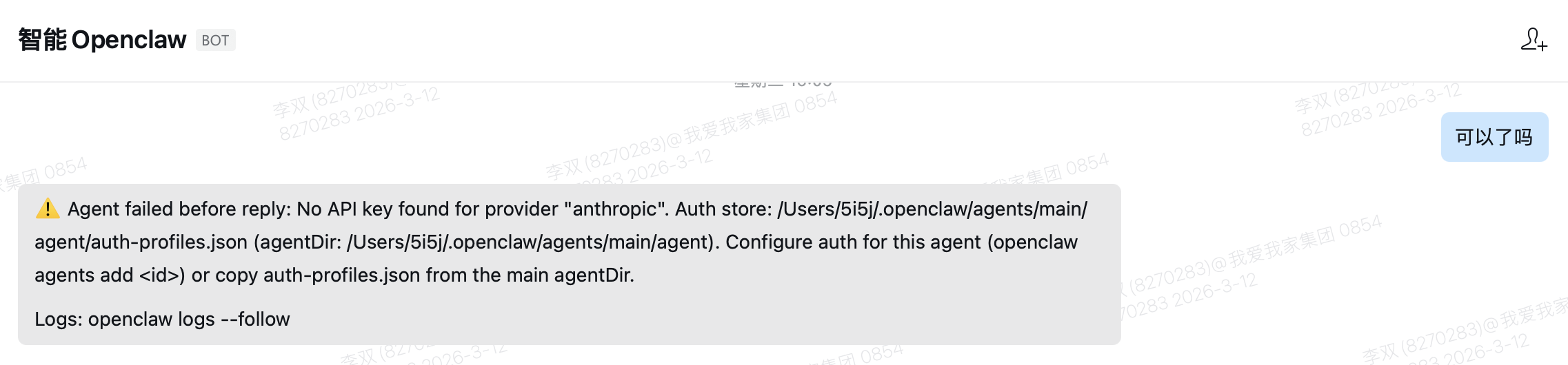

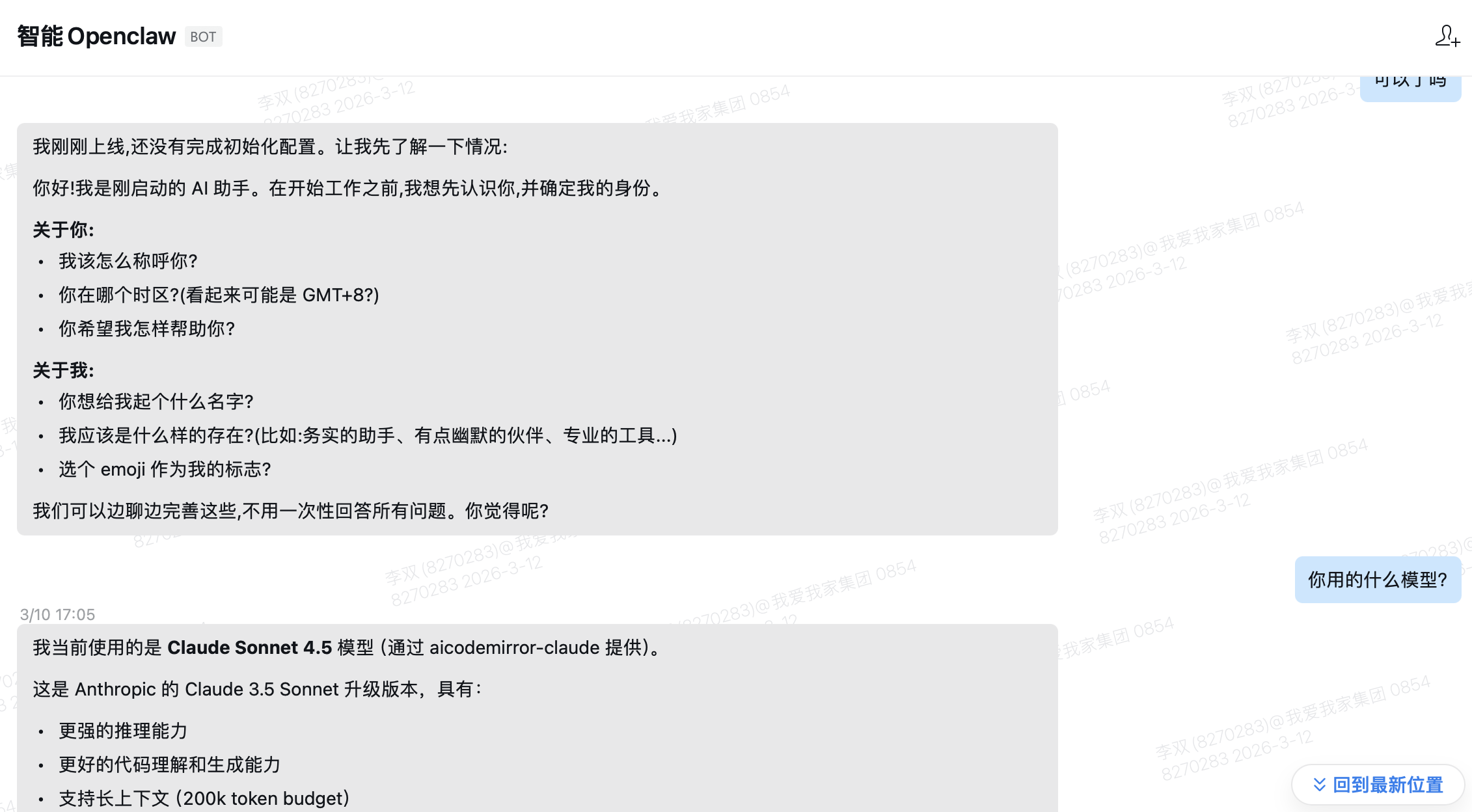

我这里报错,因为我没有配置智能体使用啥模型

5、启动Openclaw⽹关

启动⽹关服务:

openclaw gateway start

检查⽹关状态:

openclaw gateway status

查看实时⽇志:

openclaw logs --follow

遇到问题:

Warm-up: launch agents can take a few seconds. Try again shortly.

RPC probe: failed

RPC target: ws://127.0.0.1:18789

gateway closed (1006 abnormal closure (no close frame)): no close reason

Gateway target: ws://127.0.0.1:18789

Source: cli --url

Config: /Users/lee/.openclaw/openclaw.json

Gateway port 18789 is not listening (service appears running).

Last gateway error: 2026-03-10T15:46:56.040+08:00 Gateway start blocked: set gateway.mode=local (current: unset) or pass --allow-unconfigured.

Logs: ~/.openclaw/logs/gateway.log

Errors: ~/.openclaw/logs/gateway.err.log问题原因:

网关启动被阻止,因为其运行模式 (gateway.mode) 未被配置。当前状态为 “unset“(未设置)。这通常发生在首次运行或配置不完整时。

解决方法:

您需要按照错误信息的提示,为网关设置运行模式。主要有以下两种方式:

修改配置文件(推荐,一劳永逸)

- 打开配置文件:编辑错误信息中提到的配置文件

/Users/5i5j/.openclaw/openclaw.json。 - 添加网关配置:在配置文件中,添加或修改

gateway字段,将其模式 (mode) 设置为local。修改后的配置应类似如下结构:

{

// ... 其他现有配置 ...

"gateway": {

"mode": "local"

}

}- 保存并重启:保存配置文件,然后重新启动 OpenClaw 网关服务。

6、配置Openclaw使用模型

这里我用的 Claude,非常好用的服务平台(推荐)

我的邀请码6NTMYT

注册链接 https://www.aicodemirror.com/register

请打开 ~/.openclaw/openclaw.json 文件,将其中的 models 部分替换成下面的内容,请一定注意将 apiKey 更换为您自己的:

{

"models": {

"providers": {

"aicodemirror-claude": {

"baseUrl": "https://api.aicodemirror.com/api/claudecode",

"apiKey": "换成你的【CC外场景专用渠道/三方逆向渠道】key",

"api": "anthropic-messages",

"models": [

{

"id": "claude-sonnet-4-5-20250929",

"name": "Claude Sonnet 4.5"

},

{

"id": "claude-opus-4-5-20251101",

"name": "Claude Opus 4.5"

}

]

},

"aicodemirror-gpt": {

"baseUrl": "https://api.aicodemirror.com/api/codex/backend-api/codex",

"apiKey": "换成你的key",

"api": "openai-responses",

"models": [

{

"id": "gpt-5.2",

"name": "GPT-5.2"

},

{

"id": "gpt-5.4",

"name": "GPT-5.4"

}

]

},

"aicodemirror-gemini": {

"baseUrl": "https://api.aicodemirror.com/api/gemini/v1",

"apiKey": "换成你的key",

"api": "openai-completions",

"models": [

{

"id": "gemini-3-pro-preview",

"name": "Gemini 3 Pro Preview"

},

{

"id": "gemini-3-flash-preview",

"name": "Gemini 3 Flash Preview"

}

]

}

}

}

}当让 模型可选性很多呀,可以配置国内的模型使用;

最后重启 Openclaw

openclaw gateway restart

7、开始使用使用

大功告成了。

8、常⽤命令OpenClaw

9、写在最后

问:openclaw 是单独装在服务器上还是自己本地安装更好?

答:OpenClaw 作为一款开源工具,推荐优先在本地安装,这样能获得最佳的性能体验和隐私保护。不过,如果你没有合适的硬件或不想折腾环境,云服务器也是一个省心的选择。

1. 本地安装(推荐)

- 优点:性能最强,延迟最低,数据完全私有,无需联网。

- 缺点:对电脑配置要求高(尤其是显卡),安装过程可能遇到环境依赖问题。

- 适合谁:有高性能电脑(特别是带独立显卡的),喜欢折腾技术,或者对数据隐私要求极高的用户。

2. 云服务器安装

- 优点:无需购买昂贵硬件,环境配置简单(通常一键部署),随时随地可用。

- 缺点:需要付费(按小时或包月),网络延迟可能影响体验,数据存储在云端。

- 适合谁:电脑配置不够,或者不想在本地安装复杂环境的用户。

3. 怎么选?

- 看硬件:如果你有 RTX 3060 12G 或更高性能的显卡,本地跑起来会很流畅。

- 看需求:如果只是偶尔用一下,或者不想折腾,租个云服务器更划算。

问:安装一个ooenclaw可以多人一起用吗?

当然可以!OpenClaw 天生就支持多人同时使用,而且它最强大的地方在于,可以给不同的人分配不同的“AI员工”,实现真正的团队协作。

1. 基础共享:局域网/公网访问

如果你只是想把安装好的 OpenClaw 分享给同事或家人用,不需要复杂的配置:

- 局域网共享:在配置文件(

openclaw.json)中,将gateway.bind设置为lan,并配置好token。这样,同一个 WiFi 或局域网下的设备,输入服务器 IP 地址就能直接访问 。 - 公网共享:如果你把 OpenClaw 装在云服务器上,只要放行端口(默认 18789),大家就能通过公网 IP 随时随地访问 。

2. 进阶协作:多智能体(Multi-Agent)

这才是 OpenClaw 的精髓。你可以把它打造成一个“AI公司”,每个人都能直接调用专属的专家:

- 角色分工:你可以配置多个独立的 Agent(智能体)。比如,给程序员配一个“代码专家”,给文案配一个“写作专家”。他们互不干扰,各自拥有独立的记忆和技能 。

- 群聊模式:通过接入飞书、钉钉等办公软件,你可以把不同的 AI 拉进群聊。在群里,大家可以直接 @ 对应的 AI 助手,实现透明化的团队协作 。

3. 安全提醒

多人使用意味着数据暴露风险增加,请务必做好安全措施:

- 设置强密码/Token:不要使用默认的弱密码,务必配置复杂的认证令牌 。

- 防火墙管控:如果只在局域网用,不要随意暴露公网端口,避免被外部攻击

问:多个智能体就是创建多个机器人吗?

答:是的,你的理解完全正确!在 OpenClaw 中,“多个智能体”本质上就是创建多个独立的机器人。

你可以把它们想象成公司里的不同员工,每个都有自己专属的工位、技能和记忆。

1. 核心概念:智能体 = 机器人

- 独立身份:每个智能体(Agent)都是一个独立的“AI员工”。它们拥有不同的名字、头像、性格设定(System Prompt)和专属技能(Tools)。

- 独立记忆:它们拥有独立的对话记忆(Memory)。你和A聊的内容,B是完全不知道的,除非你主动把对话记录复制过去。

- 独立配置:你可以给不同的智能体配置不同的模型(如 GPT-4o 或本地模型)、不同的知识库(RAG)或不同的联网搜索权限。

2. 为什么要创建多个?

这就像你不会让一个员工既当厨师又当司机,分工合作效率更高:

- 专业分工:创建“代码专家”专门写代码,“文案助手”专门写文章,“翻译官”专门做翻译。

- 权限隔离:给不同的人(如开发、运营、老板)分配不同的智能体,避免数据混乱。

- 体验优化:你可以为不同的使用场景(如工作、学习、娱乐)创建专属的机器人,保持对话的连贯性。

3. 如何实现?

在 OpenClaw 的配置文件中,你可以通过 agents字段来定义多个智能体。每个智能体都是一个独立的配置块,拥有自己的 name、model和 prompt。

问:需要每个员工配置一个机器人吗?

答:不用。“一个萝卜一个坑”并不是唯一的选择,具体怎么配,完全取决于你的管理需求和团队规模。

1. 按“角色”分(推荐)

这是最灵活、最省资源的方式。一个机器人可以服务多个员工,只要他们的工作性质相似。

- 场景:比如公司有10个程序员,他们都需要代码助手。你不需要配10个机器人,只需要创建一个“代码专家”机器人,大家共用即可。

- 优点:管理成本低,资源利用率高,维护简单。

2. 按“人”分(特定场景)

如果员工的工作内容差异巨大,或者需要严格的权限隔离,才需要单独配置。

- 场景:老板需要一个能看财务报表的“财务顾问”,而普通员工不需要这个权限。这时就需要单独给老板配一个专属机器人。

- 优点:数据隔离好,个性化程度高。

3. 按“项目”分

如果团队是项目制,也可以按项目来分配机器人。

- 场景:A项目组需要一个懂法律的机器人,B项目组需要一个懂设计的机器人。这时可以创建两个机器人,分别给两个项目组使用。

总结

建议优先按“角色”分配。先梳理一下公司有哪些工种(如程序员、文案、客服),然后为每个工种创建一个机器人,让同类型的员工共享使用。

问:集团性公司是不是局域网部署比较合适呢?

答:对于集团性公司,局域网部署(私有化部署)是绝对的首选方案,这不仅是“合适”,更是保障数据安全和业务连续性的核心要求。

为什么必须局域网部署?

- 数据不出域,绝对安全

-

- 核心资产保护:集团公司的业务数据、财务数据、客户信息都是最高机密。如果使用公网服务,数据需要上传到第三方服务器,存在泄露风险。局域网部署确保所有数据只在公司内网流转,物理隔离外部网络,杜绝数据泄露。

- 网络稳定,性能极速

-

- 零延迟:局域网内网速通常能达到千兆甚至万兆,AI模型推理和文件传输速度极快,员工体验丝滑。

- 不依赖外网:即使公司断网(如运营商故障),内部AI服务依然可以正常使用,不影响核心业务。

- 合规与审计要求

-

- 很多行业(如金融、政务、医疗)有严格的合规要求,规定敏感数据必须存储在本地。局域网部署是满足这些法规(如等保、GDPR)的硬性条件。

部署建议

- 硬件选型:建议采购专业服务器(如戴尔、惠普)或高性能工作站,配备大内存(建议64G起步)和高端显卡(如NVIDIA A100/H100),以满足多人并发使用的算力需求。

- 网络架构:如果集团有多个办公区(如北京、上海分公司),建议采用专线(MPLS VPN或SD-WAN)将各分支机构的局域网打通,形成一个大的“集团内网”,这样所有员工都能安全、高速地访问部署在总部的AI服务。

好啦,今天就分享到这里,你学到了吗?

如果觉得这篇内容有用,点赞收藏走一波,我们下期见!

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献2条内容

已为社区贡献2条内容

所有评论(0)