第10章:点一下就分割:我给Swin-Unet加了根“魔法棒”,Swin-Unet改进策略

点一下就分割:我给Swin-Unet加了根“魔法棒”

从“指哪打哪”说起

小时候看《哈利·波特》,最羡慕的不是飞天扫帚,而是那根能指哪打哪的魔杖。没想到十几年后,我竟然在代码里实现了这个愿望——只不过我“施法”的对象是图片,咒语是鼠标点击,而效果是把图片里的目标给“抠”出来。

事情是这样的:传统的图像分割模型有个通病——你得像教小孩认字一样,给它看成千上万张标注好的图片,它才能学会“哦,原来猫长这样”。但问题是,如果图片里出现了一只姿势清奇的猫,或者背景太复杂,模型可能就懵了:这是猫?这不是猫?在线等,挺急的。

更让人抓狂的是,你明明只想把那只猫抠出来,模型却把旁边的沙发也划成了猫——毕竟在训练数据里,猫确实经常趴在沙发上。这种“经验主义”错误,让人哭笑不得。

于是我想:能不能做个模型,让用户亲自上手,“告诉”模型到底要分割啥?就像你指着照片说:“我要这只猫,不要那只狗。”这不就简单了吗?

我的“魔法棒”长啥样

经过一个月的秃头式编程,我终于捣鼓出了这个交互式分割系统。它的核心思路很简单:把用户点的位置当成“提示”,让模型知道该关注哪里。

具体来说,我选了Swin-Unet作为基础模型——这玩意儿在医学图像分割领域口碑不错,相当于分割界的“米其林三星”。但原版Swin-Unet只会看图片,不会理解用户的提示。所以我给它加了一个“耳朵”:一个额外的输入通道,专门用来接收用户点的坐标。

这个通道是啥样的?想象一下:你有一张224x224的图片,我再给你一张同样大小的白纸。你在原图上点一个位置,我就在白纸的对应位置画一个点——绿点表示“这是你要的”,蓝点表示“这不是你要的”。然后把这张“点图”和原图叠在一起,喂给模型。模型一看:哦,原来这些点是重点关照对象!

技术上,这叫做“点提示编码”。听起来高大上,其实就是给模型开了个小灶。

训练时的“小心机”

光有想法还不够,怎么训练这个“听得懂人话”的模型也是个技术活。总不能真让用户坐在电脑前点一天吧?那样估计会被打死。

所以我玩了个小花招:在训练的时候,我让模型“自己跟自己玩”。具体操作是这样的:

每张训练图片都有一张对应的分割掩膜(就是标好了哪里是猫、哪里是背景的图)。我从掩膜里随机挑几个前景点,告诉模型:“看,这些点是我想要的。”同时也随机挑几个背景点:“这些是我不想要的。”

这样一来,模型就学会了:哦,原来用户点的位置就是重点!我要把这些点附近的区域都找出来。

但还有个问题:如果图片里压根没有前景点怎么办?比如一张全是背景的图?这种情况在实际应用中很少见,但为了严谨,我还是加了处理逻辑:如果没有前景点,就随机选个背景点,然后告诉模型:“这是错的,别学它。”相当于给模型上了一堂“什么不该做”的课。

这种“正反例结合”的训练方式,让模型的鲁棒性大大提升。测试的时候发现,就算用户只点了一个点,模型也能大概猜出要分割啥;点得越多,分割越精准。有点像拼图游戏——给一块拼图,你知道大概轮廓;给十块,你就能拼出完整图案。

从代码到“魔法”

训练好的模型,总不能一直待在电脑里吃灰吧?于是我给它做了个简易的图形界面,让普通用户也能玩起来。

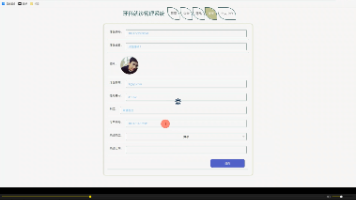

界面长这样:上面是几个按钮(上传图片、执行分割、清除点),中间是一块大画布。你上传一张图片,然后在想分割的地方点几下——左键点前景(绿色星星),右键点背景(蓝色星星)。点完了点“执行分割”,模型就开始工作,几秒钟后,分割结果就以红色半透明的形式叠加在原图上。

整个过程行云流水,比传统PS抠图不知道高到哪里去了。我给我妈演示的时候,她惊呼:“这不就是美图秀秀的智能抠图吗?”我:“呃…差不多,但这是我自己写的。”

说实话,那一刻还是有点小骄傲的。

技术亮点大起底

既然要写文章,总得列几个技术亮点,显得专业一点(虽然写代码的时候也没想那么多)。

亮点一:四通道输入,无缝融合提示信息

原版Swin-Unet只接受RGB三通道输入。我改成了四通道——前三通道是图片本身,第四通道是用户点提示。这样设计的好处是,模型可以在特征提取的早期就把提示信息和图像内容融合在一起,而不是等到后期才“想起来”还有提示这回事。

亮点二:正负点提示,双向指导

很多交互式分割方法只用正点(即用户想分割的区域),但我加了负点提示。别小看这个负点,在复杂场景下它能救命。比如你要分割一只趴在花丛里的猫,如果只点猫,模型可能把相似颜色的花也划进来;但如果再点几下花作为负点,模型就知道“哦,这种颜色虽然像猫,但不是猫”。

亮点三:随机采样策略,增强泛化能力

训练时,我不是固定取某个数量的点,而是随机取。有时取1个点,有时取5个点,有时甚至取0个点(让模型自己猜)。这样训练出来的模型,既能处理用户只点一下的懒人模式,也能应对用户追求极致精度的“点爆”模式。

亮点四:轻量级部署,不用显卡也能跑

虽然训练的时候用了GPU(毕竟Swin-Unet还是挺吃资源的),但推理的时候,我用了一些优化技巧,让模型在普通CPU上也能跑。在我的老款笔记本上,分割一张图大概需要2-3秒——虽然不算飞快,但考虑到不用联网、不用付费,这个速度完全可以接受。

踩过的坑和填过的土

写代码哪有那么一帆风顺?我也踩了不少坑。

第一个坑是坐标映射。用户在原始大图上点的位置,怎么对应到224x224的小图上?直接缩放坐标?不行,因为图像长宽比可能不同。后来用了按比例映射加边界检查,总算解决了。

第二个坑是点提示的编码方式。一开始我用的是高斯热图(就是在点周围画一个模糊的圆),但效果不好,模型总是分不清多个点。后来改成精确的单点编码,效果反而更好——原来模型比我想象的聪明,不需要“模糊处理”。

第三个坑是损失函数的选择。交互式分割和普通分割不太一样,因为用户关注的是目标区域,背景区域相对来说没那么重要。我试了好几种损失函数,最后发现加权的交叉熵损失效果最好——给前景区域的错误预测更高的惩罚,让模型更专注于用户关心的部分。

未来还能怎么玩

目前这个系统还是个“玩具”,但潜力不小。我设想了几个后续可以改进的方向:

方向一:支持框提示。除了点,还可以让用户画个框,告诉模型“我要这个框里的东西”。这样对于大目标更友好。

方向二:实时交互。现在的流程是“点-点-点-执行”,如果能做到点一下就实时更新分割结果,体验会更好。

方向三:集成到更多场景。比如医疗影像分割,医生可以直接在病灶区域点几下,模型就能精确勾画出病灶边界;或者电商领域,用户想抠出商品图片,点几下就行。

方向四:多轮交互优化。如果第一次分割结果不理想,用户可以继续加正负点,模型基于之前的提示和新的提示进行优化。这需要模型有“记忆”能力,技术上有点挑战。

写在最后

从有这个想法,到写出能用的代码,再到写这篇文章,前前后后花了个把月。回头看,最大的收获不是技术本身,而是那种“把想法变成现实”的成就感。

写代码的人大概都有这种感觉:当你看到一个原本只能存在于脑海中的东西,突然在屏幕上动起来、按照你设想的方式工作,那种快乐是难以言喻的。

当然,也有被bug折磨到想砸电脑的时刻。但熬过去之后,一切都值得。

如果你也对图像分割感兴趣,或者想试试这个“魔法棒”,欢迎来交流。代码我已经开源了(虽然写得有点乱),你可以拿去玩玩,顺便帮我找找bug。

最后,愿你的代码一次跑通,愿你的模型永不过拟合。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献6条内容

已为社区贡献6条内容

所有评论(0)