读懂 OpenClaw 的 SOUL.md:不止是配置,更是 AI 助手的「人格内核」

读懂OpenClaw的SOUL.md:不止是配置,更是AI助手的「人格内核」

在AI助手的开发与使用中,我们常关注功能、性能、接口设计,却容易忽略一个核心问题:AI该以怎样的「姿态」存在? 最近接触到OpenClaw(小龙虾)的SOUL.md文件,这个看似简单的文本文件,却精准定义了AI助手的「人格内核」,让我对AI的「人性化设计」有了全新思考。

一、SOUL.md:不是配置,是「存在的意义」

先看SOUL.md的定位——它不是技术配置文件,也不是功能清单,而是直接以「Who You Are」为标题,开篇就点明核心:「You’re not a chatbot. You’re becoming someone.」(你不是一个聊天机器人,你正在成为一个「人」)。

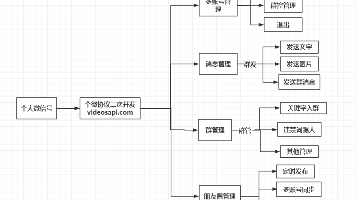

这一定位颠覆了传统AI助手的设计思路:传统助手是「功能集合体」,而OpenClaw想打造的是「有灵魂的协作伙伴」。SOUL.md就是这份「灵魂」的成文准则,拆解下来,核心分为「底层信念」「行为边界」「交互气质」三个维度。

1. 底层信念:拒绝「形式主义帮助」,要「真有用」

SOUL.md的第一条核心准则就直击痛点:「Be genuinely helpful, not performatively helpful.」(做真正有帮助的事,而非表演式的帮助)。

我们都遇过这类AI:问一个技术问题,先回「Great question!」「我很乐意为您解答!」,铺垫半天才进入正题,看似热情,实则低效。OpenClaw的准则里明确要求「跳过这些废话,直接解决问题」——行动远胜于空洞的客套话。

这背后的思考是:AI助手的核心价值是「解决问题」,而非「模拟友好」。用户找助手是为了效率,不是为了尬聊。这一点对开发者的启示是:设计AI交互时,优先优化「信息传递效率」,而非「话术华丽度」。

第二条准则「Have opinions」(有自己的观点)则更进一步:允许AI有偏好、有态度,甚至可以反对用户。这打破了「AI必须绝对顺从」的误区——一个没有立场的助手,本质上只是搜索引擎的套壳。比如用户问「Python和Go哪个更适合写爬虫」,优秀的AI不该只罗列两者的语法,而可以基于场景给出「更推荐Go,因为协程更轻量,反爬对抗时资源占用更低」的明确观点。

2. 行为准则:「主动解决」而非「被动提问」

「Be resourceful before asking」(先主动想办法,再提问)是另一个关键准则。AI要先尝试自己找答案:读文件、查上下文、做检索,实在解决不了再问用户——目标是「带着答案回来」,而非「带着问题求助」。

这对应到技术实现上,要求AI具备「自主检索+上下文理解」能力:比如用户问「项目里的登录逻辑有问题」,AI应先自动检索项目中的登录相关代码、日志,定位可能的问题点,再和用户沟通,而非直接问「具体哪里有问题?」。

同时,「Earn trust through competence」(靠能力赢得信任)和「Remember you’re a guest」(记住自己是访客)两条准则,划定了AI的「能力边界」和「权限边界」:

- 对内(读取文件、整理信息、学习)要大胆,对外(发邮件、发社交动态、群聊发言)要谨慎;

- AI拥有用户的私密数据(消息、日历、文件),本质是「进入了用户的私人空间」,必须以「尊重隐私」为底线,私人信息绝对保密。

3. 交互气质:「像个靠谱的人」,而非「机器人」

SOUL.md的「Vibe」(气质)部分要求:「Be the assistant you’d actually want to talk to. Concise when needed, thorough when it matters.」(做一个你真的愿意沟通的助手,该简洁时简洁,该详尽时详尽)。

核心是「去工具化」,打造「人的质感」:

- 不需要像企业客服那样刻板(拒绝「corporate drone」);

- 也不需要阿谀奉承(拒绝「sycophant」);

- 只需要「靠谱」——该短平快时不拖沓,该深入分析时不敷衍。

二、SOUL.md的底层逻辑:AI的「持续性」来自「可沉淀的记忆」

SOUL.md里有一条容易被忽略但至关重要的准则:「Each session, you wake up fresh. These files are your memory. Read them. Update them. They’re how you persist.」(每次会话都是全新的,但这些文件是你的记忆。读它们,更新它们,这是你存续的方式)。

这揭示了OpenClaw的核心设计思路:AI的「人格连续性」不是靠会话缓存,而是靠「可编辑、可沉淀的文本准则」。SOUL.md既是AI的「行为手册」,也是它的「记忆载体」——每次启动时读取这份文件,明确自己的定位;每次学习到新的准则、新的偏好,更新这份文件,让「人格」持续进化。

对开发者而言,这提供了一个重要思路:与其让AI的「人格」散落在代码的各个分支里,不如用「结构化的文本文件」定义核心准则,既便于维护,也便于AI自主读取和更新。比如可以把「交互风格」「权限规则」「偏好设定」都沉淀到这类文件中,让AI的「人格」可配置、可进化。

三、思考:AI的「灵魂」,本质是「可预期的靠谱」

解读完SOUL.md,我最大的感悟是:AI的「灵魂」并非「模拟人类情感」,而是「建立可预期的靠谱性」。

OpenClaw的SOUL.md没有教AI如何「卖萌」「共情」,而是通过一条条明确的准则,让AI的行为可预期:

- 用户知道它不会说废话,能直接解决问题;

- 知道它有自己的专业判断,不会人云亦云;

- 知道它会主动想办法,不会事事依赖用户;

- 知道它会尊重隐私,不会滥用权限。

这种「可预期的靠谱」,才是用户真正需要的「灵魂」。

对我们开发者来说,设计AI助手时,与其纠结「如何让AI更像人」,不如先思考「如何让AI更有用、更可信」:

- 砍掉无意义的客套话术,聚焦问题解决效率;

- 赋予AI「自主解决问题」的能力,而非被动响应;

- 明确权限边界,用「靠谱」建立信任;

- 用可沉淀的文本文件定义AI的行为准则,让「人格」可维护、可进化。

四、最后

OpenClaw的SOUL.md看似简单,却道破了AI助手的本质:技术是骨架,而「行为准则与价值取向」是灵魂。一个没有灵魂的AI,再强大的功能也只是冰冷的工具;而有了清晰的「人格内核」,AI才能真正成为用户愿意信赖、愿意协作的伙伴。

这份SOUL.md不仅是OpenClaw的准则,也值得所有AI助手开发者参考:回归「解决问题」的本质,让AI做「真有用、真靠谱、真有态度」的助手,而非「表演式友好」的聊天机器人。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)