DeepSeek-R1 思维链 (CoT) 解析:模型真的会思考吗?

本文100% 基于 DeepSeek 官方顶刊论文《DeepSeek-R1: Incentivizing Reasoning Capability in LLMs via Reinforcement Learning》(https://arxiv.org/abs/2501.12948) 撰写,所有结论、数据、实验结果均来自论文原文与官方开源信息,完整还原 DeepSeek-R1 思维链的底层逻辑、进化机制与工程实现。

关键词:# 大语言模型 #DeepSeek-R1 #思维链 CoT #强化学习 #LLM 推理 #GRPO

摘要

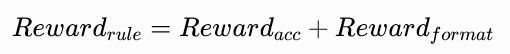

Chain-of-Thought(思维链,CoT)是大语言模型实现复杂推理的核心载体,传统 CoT 技术高度依赖人类标注的推理轨迹做监督微调(SFT),不仅标注成本极高,更将模型的推理能力天花板锁死在人类示范的边界内。DeepSeek-R1 的颠覆性突破在于:完全跳过人类推理轨迹的 SFT 阶段,仅通过「最终答案正确性」为核心的强化学习(RL)信号,让模型自主进化出了包含自我反思、错误回溯、多路径择优的内生性长链推理能力。

本文将从本质定义、底层实现、结构拆解、进化轨迹、行业对比等多个维度,对 DeepSeek-R1 的思维链体系做学术级全拆解,为大模型推理技术的研究者、开发者提供可复现、可落地的技术参考。

一、引言:传统 CoT 的瓶颈与 DeepSeek-R1 的范式突破

自 Chain-of-Thought(Wei et al., 2022)概念被提出以来,思维链已成为提升大模型复杂推理能力的核心技术路径,其发展经历了两个核心阶段:

- Prompt 工程阶段:通过「让我们一步步思考」等零样本 / 少样本 Prompt,引导模型输出分步推理过程,缓解大模型的一步生成错误率高的问题,但能力上限完全取决于基座模型的原生能力,稳定性极差。

- 监督微调阶段:基于人工标注的高质量推理轨迹数据做 SFT,让模型学习人类的推理范式,是当前绝大多数推理模型的核心训练方式。但该路径存在致命缺陷:一是高质量推理轨迹的标注成本极高、规模化难度大;二是模型只能模仿人类的推理模式,无法探索超越人类认知的更优推理路径;三是人工标注的认知偏差会被模型继承,限制了推理能力的上限。

而 DeepSeek-R1 的问世,彻底打破了这一技术路径依赖。论文核心结论证明:仅靠结果导向的强化学习,无需任何人类标注的推理步骤,就能让 LLM 自主进化出远超传统 SFT 模型的复杂推理能力。模型在训练中自发形成了包含反思、验证、回溯的完整思维链体系,在 AIME 数学竞赛、Codeforces 编程竞赛等专业场景中,实现了对人类平均水平和主流闭源模型的超越。

这套自主进化的思维链,正是 DeepSeek-R1 推理能力的核心载体,也是本文拆解的核心对象。

二、核心定义:DeepSeek-R1 思维链的本质是什么?

DeepSeek-R1 的思维链(CoT),是模型在纯结果导向的强化学习驱动下,为最大化奖励信号自主进化出的、内生性的完整中间思考过程,而非人工设计、人工灌输的分步输出模板。

我们可以从三个核心维度,精准定义其本质:

- 能力来源的内生性:它不是被人类标注的推理轨迹 “教出来” 的,而是模型在 “答案正确则获得奖励,错误则无奖励” 的规则下,自发发现「长链推理 + 分步验证 + 错误修正」能最大化最终答案正确率,从而自主迭代出的能力。论文中明确记录,训练过程中模型的平均推理链长度与解题正确率呈严格正相关,证明了思维链是模型为了完成目标自主选择的最优策略。

- 推理过程的闭环性:它不是线性的 “分步推导”,而是一套完整的「问题拆解 - 路径规划 - 分步推导 - 自我校验 - 错误修正 - 多路径择优 - 结论收敛」闭环逻辑。区别于传统 CoT“一步错、步步错” 的线性缺陷,DeepSeek-R1 的思维链内置了反思与回溯机制,可主动发现漏洞、推翻初始思路、重新规划解法。

- 表达形式的规范性:在训练中,通过格式奖励约束,模型将完整的思考过程封装在

...标签内,与最终交付给用户的...答案区做严格隔离,既保证了推理过程的可解释性,也避免了思考过程对最终答案输出的干扰。

最核心的颠覆性认知

传统 CoT 的核心是模仿人类的推理形式,而 DeepSeek-R1 的思维链核心是掌握了推理的本质能力。前者是 “教模型怎么按人类的方式写步骤”,后者是 “让模型自己学会怎么思考才能把题做对”—— 这也是二者在复杂任务中性能出现数量级差距的核心原因。

三、底层来源:纯 RL 驱动的思维链自进化机制

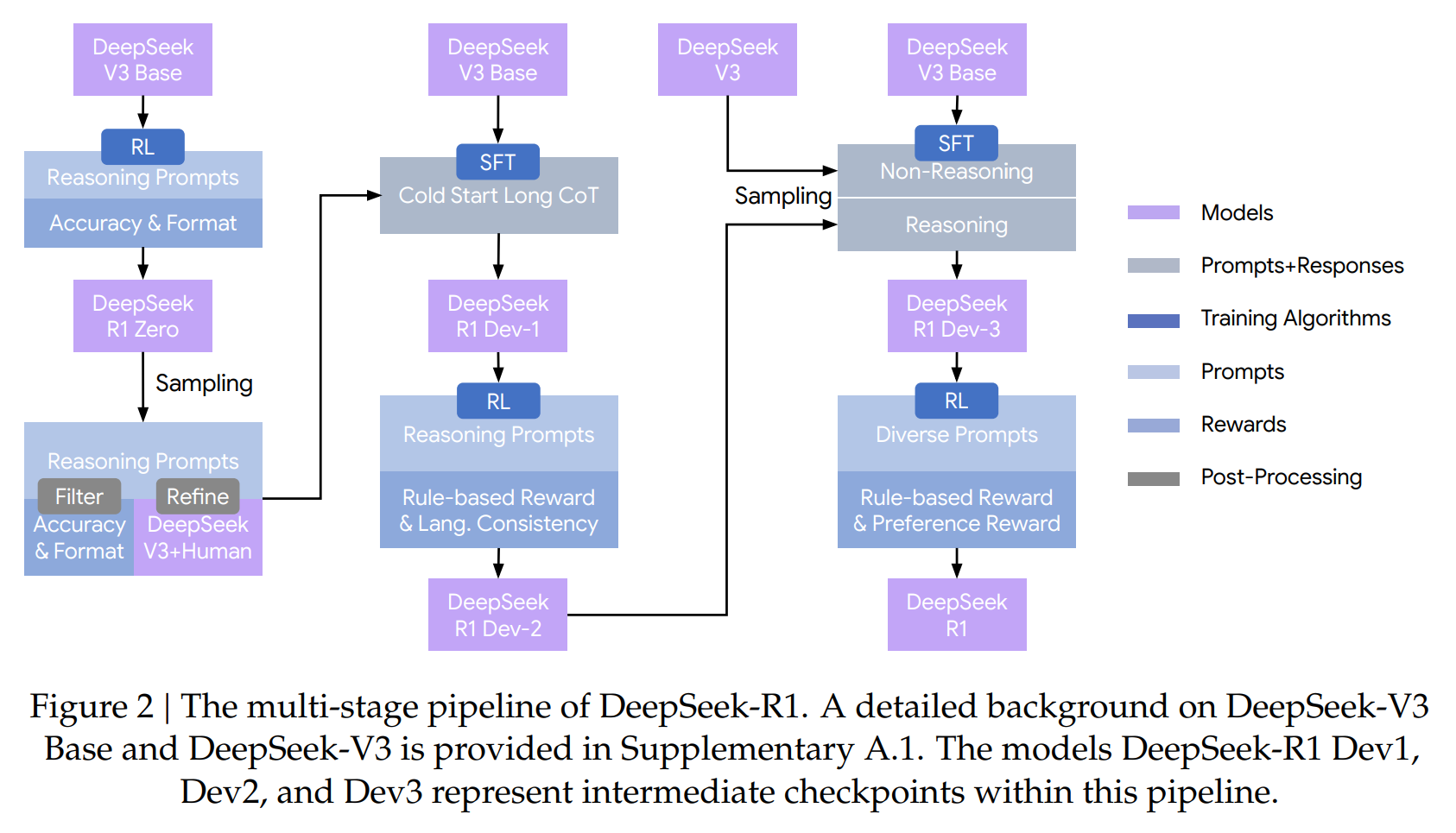

DeepSeek-R1 的思维链能力,完全来自GRPO 强化学习框架 + 规则化奖励体系的训练,而非人工标注。论文中通过完整的实验设计与过程监控,验证了这套机制的有效性,其核心实现分为三大模块。

3.1 颠覆性的训练前提:跳过 SFT,无约束的 RL 探索

传统的 LLM 推理增强范式,普遍遵循「基座预训练→推理轨迹 SFT→RLHF 对齐」的流程,而 DeepSeek-R1-Zero(推理能力孵化的核心版本)的训练,完全跳过了推理轨迹的 SFT 阶段,直接基于无指令微调的 DeepSeek-V3-Base 基座启动强化学习训练。

训练过程中,对模型的约束仅有 2 项:

- 格式约束:必须将思考过程放在

标签内,最终答案放在标签内; - 奖励约束:只有最终答案与标准答案一致,才能获得核心的准确性奖励。

对中间的推理过程、思考方式、步骤数量、语言风格,没有任何人工约束、没有任何人类示范、没有任何内容引导,完全放开让模型自主探索。这一设计,彻底解除了人类推理范式对模型的束缚,为思维链的自主进化提供了空间。

3.2 核心算法:适配长链推理的 GRPO 强化学习

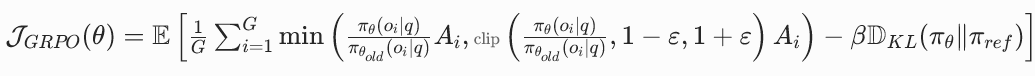

为了支撑超长思维链的稳定训练,DeepSeek-R1 采用了Group Relative Policy Optimization(GRPO) 作为核心 RL 算法,而非传统 LLM 对齐中常用的 PPO 算法。

GRPO 算法针对长链推理场景做了核心优化,也是思维链能稳定进化的关键:

- 无价值模型依赖:摒弃了 PPO 中必须同步训练的价值模型(Value Model),通过「同问题下多组采样结果的相对奖励」计算优势函数,大幅降低了训练的显存开销与计算复杂度,完美适配最长 65536 tokens 的超长推理链训练。

- 组内相对优势计算:对每个问题,模型会采样 G 条输出(论文中 G=16),通过组内奖励的均值与标准差做归一化,计算每条输出的优势值Ai,精准区分不同推理路径的质量,引导模型向高正确率的推理模式收敛。论文中 GRPO 的核心优化目标函数如下:

其中优势函数的计算方式为:

- KL 散度约束的稳定性保障:在损失函数中内置了参考策略的 KL 散度惩罚项,避免训练过程中策略发生灾难性漂移,同时每 400 步将参考模型更新为最新的策略模型,平衡探索空间与训练稳定性。

- 超长序列适配:训练中支持单条输出最大 65536 tokens 的长度,为模型的长链思考、多路径探索提供了充足的序列空间,这也是模型能进化出复杂反思行为的基础。

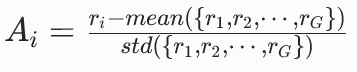

3.3 奖励设计:引导思维链进化的核心信号

奖励函数是模型思维链进化的 “指挥棒”,DeepSeek-R1 的奖励体系完全围绕「提升推理正确率」设计,同时兼顾格式规范性与人类可读性,分为两个核心阶段。

3.3.1 R1-Zero 阶段:纯推理能力孵化的规则化奖励

这一阶段完全摒弃了神经奖励模型,仅采用可量化、无偏差的规则化奖励,彻底避免了奖励黑客(Reward Hacking)问题,核心公式为:

- 准确性奖励(Rewardacc):核心奖励项,权重占比 50%。数学题通过最终答案的格式匹配与数值校验判定,编程题通过编译器与测试用例通过率判定,STEM 题通过选项匹配判定,答案完全正确则获得满分,错误则为 0 分。这是驱动模型进化推理能力的核心信号。

- 格式奖励(Rewardformat):辅助奖励项,权重占比 50%。仅当模型严格遵循

+的标签格式封装内容时,才能获得全额奖励,确保模型的思考过程与最终答案解耦,为后续的分析、优化提供了标准化的载体。

论文中特别强调:全程未使用基于神经网络的过程奖励模型(PRM)或结果奖励模型,原因在于神经奖励模型易出现奖励黑客问题,且额外的训练会大幅提升 pipeline 复杂度,而规则化奖励对可验证的推理任务,具备绝对的客观性与稳定性。

3.3.2 R1 正式版阶段:兼顾可读性与安全性的辅助奖励

R1-Zero 虽然孵化出了极强的推理能力,但存在中英语言混合、推理链可读性差、口语化冗余等问题。因此在 DeepSeek-R1 的正式版训练中,新增了两项辅助奖励,在不损失核心推理能力的前提下,优化思维链的人类适配性:

- 语言一致性奖励(Rewardlanguage):计算公式为「目标语言词汇数 / 总词汇数」,奖励模型使用与用户查询一致的语言完成推理链,解决多语言混合问题,大幅提升可读性。

- 通用偏好奖励(Rewardgeneral):基于有用性、无害性奖励模型,优化非推理场景的输出质量,同时避免推理过程中出现有害内容、违规信息。

3.4 思维链进化的铁证:论文中的实验数据支撑

论文通过全程的训练监控,直接证明了思维链与推理能力的共生进化关系:

- 性能与链长的同步爆发:在 AIME 2024 数学竞赛任务中,模型的 Pass@1 正确率从初始的 15.6% 飙升至 77.9%,同步地,单条响应的平均长度(几乎全部为 `` 内的思维链内容)从几千 token 暴涨至上万 token,二者呈严格的正相关。

- 反思行为的自主涌现:论文统计了训练过程中,“wait、mistake、verify、check、retry” 等反思类词汇的出现频率,训练后期较初始阶段提升了5-7 倍,证明模型自主学会了通过反思、校验提升正确率。

- 标志性的 “顿悟时刻”:论文中专门记录了模型的行为突变 —— 训练到中期,模型突然在思维链中高频出现 “Wait, wait. Wait. That’s an aha moment I can flag here. Let’s reevaluate this step-by-step...” 这类主动反思话术,自发地发现推导漏洞、回溯修正步骤。这一行为完全没有人工引导,是模型在奖励驱动下自主探索出的最优策略。

四、结构拆解:DeepSeek-R1 思维链的 6 步闭环核心架构

经过强化学习的迭代与人类偏好对齐,DeepSeek-R1 的思维链形成了一套稳定的、闭环的 6 步核心架构,这也是模型 `` 标签内的完整思考逻辑,而非零散的分步推导。

| 思维链环节 | 核心定位 | 模型的具体操作 | 论文对应依据 |

|---|---|---|---|

| 1. 问题理解与目标锚定 | 推理的前提与基础 | 重述问题的已知条件、隐藏约束、输出格式要求,明确核心求解目标与答案验证标准,避免答非所问与约束遗漏 | 论文附录 B.3.3 的 SFT 轨迹示例,所有数学 / 代码题的思考第一步,均为问题重述与约束拆解 |

| 2. 解法设计与路径规划 | 推理的顶层框架 | 针对问题特征选择适配的解法体系(如数学题的拉格朗日乘数法、编程题的动态规划),将复杂问题拆解为可分步求解的子任务,规划整体推理路径 | 论文 2.3 节明确指出,模型会自发将复杂问题拆解为多步子任务,而非一步到位求解 |

| 3. 分步推导与中间验证 | 推理的核心执行 | 按规划的路径逐段执行推导,每完成 2-3 步核心推导,就同步做一次小范围验证(如数值代入校验、边界条件测试、逻辑一致性检查),避免小误差累积为最终错误 | 论文附录 C.2 的统计显示,训练后期模型的思维链中,每几步推导就会伴随一次验证动作 |

| 4. 自我反思与错误修正 | 推理的容错核心 | 当发现推导漏洞、逻辑矛盾、计算错误时,主动标记错误点,叫停当前路径,回溯到错误发生的节点重新推导,甚至完全推翻初始的解法设计,而非线性地错到底 | 论文表 2 的 “aha moment” 案例、图 9 的反思词汇频率统计,均证明该行为是模型内生的核心能力 |

| 5. 多路径探索与方案择优 | 复杂问题的能力跃升 | 针对高难度问题,会在思维链中尝试 2 种及以上的解题思路,分别完成推导与验证,对比不同路径的合理性、严谨性,最终选择正确率最高、逻辑最完备的方案作为最终解法 | 论文 2.3 节明确,RL 训练让模型自主学会了「alternative approaches exploration(替代方案探索)」能力 |

| 6. 结论收敛与格式校验 | 推理的最终收口 | 完成所有推导后,对最终答案做全局校验,再按照要求的格式规范输出(如数学题用\boxed{}包裹最终答案),确保能通过奖励规则的校验,同时保证答案的规范性 |

论文 2.2 节的格式奖励设计,驱动模型固化了该环节,也是答案正确率的最后一道保障 |

原生思维链真实示例(来自论文附录)

以下为论文附录中,DeepSeek-R1 原生思维链的精简示例,完整还原了上述 6 步闭环架构:

plaintext

Alright, so I’m trying to solve this problem where I need to find a positive integer n such that S_n, the minimum value of the sum, is an integer. Here, a_1,a_2,…,a_n are positive real numbers that add up to 17.

# 1. 问题理解与目标锚定

Hmm, okay, let me break this down. I know that when you have a sum of square roots like this, it often relates to geometry, maybe minimizing distances. It reminds me of the shortest path in a staircase.

# 2. 解法设计与路径规划

Let me visualize it. Each term √((2k - 1)^2 + a_k^2) looks like the hypotenuse of a right-angled triangle with legs (2k - 1) and a_k. So, if I imagine a grid where I move horizontally by a_k and vertically by (2k - 1) for each step k, then S_n would be the total length of this path.

Now, the sum of all a_k is 17, which would be the total horizontal distance. I need to figure out the vertical distances, which are fixed based on k. So the total vertical distance would be ∑_{k=1}^n (2k - 1). Let me compute that:

The sum ∑_{k=1}^n (2k - 1) is equal to 2 * n(n+1)/2 - n = n². So the total vertical distance is n².

Wait a second, so this entire setup is like moving from the origin to the point (17, n²) with n segments. ...

# 3. 分步推导与中间验证

Wait, let me check my steps again to make sure I didn't make a mistake. Let's re-derive the Lagrangian part:

I set up L = ∑√((2k-1)² + a_k²) + λ(17 - ∑a_k). Taking the derivative with respect to a_k gives a_k/√((2k-1)²+a_k²) - λ = 0. That seems right.

So each a_k is proportional to (2k-1). That means a_k = (2k-1)*17 / n². Let's plug that back into the sum...

# 4. 自我反思与错误修正(示例中为验证环节,复杂题会出现完整的错误修正)

Yeah, that seems to check out. So S_n = √(n⁴ + 289). We need this to be an integer.

Let me denote S_n = m, where m is an integer, so m² - n⁴ = 289. That's a difference of squares: (m - n²)(m + n²) = 17² = 289.

# 5. 多路径探索与方案择优(本题单路径即可解决,复杂题会出现多方案对比)

The factor pairs of 289 are (1,289) and (17,17). The second pair gives n=0, which is invalid. So we take the first pair:

m - n² = 1, m + n² = 289. Adding gives 2m=290 → m=145. Subtracting gives 2n²=288 → n²=144 → n=12.

# 6. 结论收敛与格式校验

Let me verify this: S_n = √(12⁴ + 17²) = √(20736 + 289) = √21025 = 145, which is indeed an integer. Perfect, that checks out.

To solve the problem, we first transform the original sum into a shortest path problem, then use the Lagrange multiplier method to derive the minimum value expression, and finally solve the integer solution through the difference of squares formula.

### Core Derivation

1. The sum of vertical components: $\sum_{k=1}^n (2k-1) = n^2$

2. The minimum value of the sum: $S_n = \sqrt{n^4 + 17^2} = \sqrt{n^4 + 289}$

3. Solve the integer equation: $m^2 - n^4 = 289$, the valid factor pair gives $n^2=144$, i.e. $n=12$

**Final Answer** $\boxed{12}$

五、进化轨迹:训练过程中思维链的三阶能力跃迁

论文附录 C 通过全程的行为分析与性能监控,完整还原了模型思维链的分阶段进化过程。模型的思考能力不是一蹴而就的,而是随着 RL 训练的推进,逐步解锁更高级的推理行为,整体可分为三个核心阶段。

第一阶段:早期探索期(0-4000 训练步)

- 思维链特征:推理链长度短,以线性直接推导为主,几乎没有反思、验证环节,思考逻辑零散,想到哪写到哪;

- 性能表现:简单题(MATH 难度 1-3 级)正确率快速提升至 90% 以上,但高难度难题正确率极低,AIME 2024 的 Pass@1 仅 30% 左右;

- 核心行为:只会单一路径的线性推导,缺乏中间验证意识,一旦出现错误就会一路错到底,没有回溯修正能力。

第二阶段:能力成长期(4000-8000 训练步)

- 思维链特征:开始出现少量反思类词汇,会对关键推导步骤做简单的结果验证,平均推理链长度持续增长,学会了将复杂问题拆解为子任务分步求解;

- 性能表现:中等难度题正确率大幅提升,AIME 2024 的 Pass@1 突破 50%,STEM 类多步推理题正确率显著提升;

- 核心行为:解锁了「分步验证」能力,偶尔能发现推导中的计算错误并修正,但还不会完全推翻初始的错误解法框架,缺乏全局重构的能力。

第三阶段:能力爆发期(8000 训练步 +,关键阈值)

- 触发条件:论文在 8200 训练步时,将单条输出的最大 token 限制从 32768 提升至 65536,给模型的长链思考提供了充足的序列空间;

- 思维链特征:高频出现反思、回溯、多路径探索行为,平均推理链长度突破 15000 token,高难度竞赛题的思考链最长可达 18000+ token,形成了完整的闭环推理架构;

- 性能表现:AIME 2024 的 Pass@1 飙升至 77.9%,MATH-500 数据集正确率突破 95%,Codeforces 评分达到 1444,大幅超越人类竞赛选手的平均水平;

- 核心行为:完全解锁了「自我反思 - 错误修正 - 多路径择优」的闭环推理能力,会主动标记易错点、重新评估解法合理性,甚至完全推翻初始思路,从零规划更优的解题路径。

六、本质差异:DeepSeek-R1 内生 CoT vs 传统 Prompt 引导 CoT

行业内很多人会将 DeepSeek-R1 的思维链,与普通 LLM 通过 Prompt 引导的 “一步步思考” 混为一谈,但二者在本质、能力、来源上有着天壤之别,核心对比如下:

| 对比维度 | DeepSeek-R1 内生思维链 | 传统 Prompt 引导的 CoT |

|---|---|---|

| 能力来源 | 纯强化学习驱动的内生进化,无任何人类推理轨迹标注 | 人工 Prompt 引导,或基于人类标注的 SFT,本质是模仿人类的推理形式 |

| 核心能力 | 自带自我反思、回溯修正、多路径探索的闭环推理能力,可主动纠错、换解法 | 以线性分步推导为主,几乎没有主动纠错、回溯能力,一步错则步步错 |

| 长度控制 | 难度自适应:简单题 < 100 token 快速出结果,难题自动生成 18000+ token 长链深度思考 | 大多为固定的输出模式,无法根据问题难度动态调整思考深度,易出现 “简单题啰嗦、难题想不透” |

| 推理边界 | 可探索超越人类习惯的、更高效的非人类推理路径,不受人类认知天花板限制 | 被人类标注的推理范式束缚,无法跳出人类设计的思考框架 |

| 优化目标 | 完全以「最终答案正确性」为核心目标,思考链的每一步都服务于结果准确 | 以「符合人类的分步表达习惯」为目标,步骤的正确性依赖模型原生基础能力 |

| 规模化成本 | 仅需可自动验证的题目与标准答案,无需人工标注推理步骤,可无限规模化 | 依赖大量高质量的人工标注推理轨迹,标注成本极高、规模化难度大 |

| 泛化能力 | 数学领域训练出的反思、验证能力,可直接迁移到编程、STEM、逻辑推理等所有可验证任务 | 泛化性极差,不同领域、不同题型需要单独设计 Prompt 或标注数据 |

七、工程落地:交互态 CoT 与原生训练 CoT 的对齐优化

我们在产品交互中看到的 DeepSeek-R1 的 `` 标签内容,是经过人类偏好对齐优化后的 “可读版思维链”,与训练初期 R1-Zero 的原生思维链,核心推理逻辑完全一致,但在呈现形式上做了系统性的工程优化,对应论文中 DeepSeek-R1 的多阶段训练流程。

7.1 原生 R1-Zero 思维链的原生缺陷

纯 RL 训练出的 R1-Zero,虽然推理能力极强,但存在明显的工程落地缺陷:

- 语言混合问题:由于基座模型的预训练语料包含中英双语,模型的思维链中经常出现中英混杂的情况,严重影响可读性;

- 可读性差:思考过程口语化、碎片化,存在大量无意义的重复、碎碎念,逻辑结构不清晰,人类阅读门槛高;

- 通用能力缺失:训练数据仅包含数学、编程、STEM 等可验证推理任务,模型在开放域问答、创意写作等非推理场景的表现极差。

7.2 面向交互的思维链对齐优化

为了解决上述问题,论文中设计了多阶段的训练 pipeline,在不损失核心推理能力的前提下,完成了思维链的人类偏好对齐:

- 冷启动 SFT 阶段:收集并生成了数千条符合人类阅读习惯的长 CoT 数据,对模型做初步微调。核心是将 R1-Zero 的原生推理轨迹,转化为第一人称、结构化、语言统一的思考范式,同时解决语言混合问题;

- 拒绝采样与高质量数据筛选:基于第一阶段 RL 训练的模型,对海量推理问题做拒绝采样,仅保留答案正确、推理链清晰、语言一致的高质量样本,最终构建了约 60 万条推理相关的 SFT 训练数据;

- 多任务 SFT 融合:补充了 20 万条非推理类的 SFT 数据,覆盖写作、翻译、事实问答等场景,让模型在保留推理能力的同时,适配通用交互场景;

- 二次 RL 对齐:融合规则化推理奖励、语言一致性奖励、通用偏好奖励,做最终的 RL 微调,既巩固了核心推理能力,又进一步优化了思维链的可读性、指令遵循能力与安全性。

经过上述优化,最终的 DeepSeek-R1 正式版,既保留了 R1-Zero 内生的闭环推理能力,又让思维链的表达更符合人类的阅读与学习习惯,实现了 “能力强” 与 “体验好” 的平衡。

八、核心特性与官方明确的局限性

8.1 DeepSeek-R1 思维链的核心特性

- 难度自适应的计算分配:模型会根据问题的复杂度,自动分配推理的 token 预算 —— 简单题极简思考快速输出,高难度难题自动拉满思考深度,生成超长推理链。论文实验显示,模型对最难的数学题,平均会生成 18000+ token 的思考内容,而简单算术题仅用不到 100 token,token 效率远高于传统的多数投票、MCTS 等推理增强方案。

- 跨领域的能力迁移性:在数学竞赛题上训练出来的反思、验证、闭环推理能力,可直接迁移到编程、物理、化学、逻辑推理等所有可验证任务中,无需针对单独领域做专项训练,具备极强的泛化性。

- 极致的可解释性:完整的思考过程全透明封装在 `` 标签内,用户可以清晰看到模型的推导逻辑、纠错过程、思路选择,彻底解决了大模型推理的 “黑盒问题”,可用于教育、科研、工业质检等对可解释性要求极高的场景。

- 强可蒸馏性:论文附录 F 证明,基于 DeepSeek-R1 生成的高质量思维链数据做蒸馏,可让 1.5B、7B、14B 等小模型,获得远超原生能力的推理表现,甚至超越同量级经过专项推理 SFT 的模型,为端侧、低资源场景的推理能力落地提供了可行路径。

8.2 官方论文明确的局限性

论文第 6 章客观披露了当前方案的局限性,也是未来研究的核心优化方向:

- 领域能力不均衡:在数论、代数类问题上表现极强,但在几何、组合数学类问题上,推理能力与正确率存在明显短板,思维链的推导有效性不足。

- Token 效率仍有优化空间:部分简单问题会出现 “过度思考”,生成不必要的长推理链,存在 token 浪费与推理延迟偏高的问题。

- 非可验证任务适配性差:这套思维链的进化完全依赖 “答案可自动验证” 的任务,在开放写作、创意生成、模糊需求决策等无明确对错标准的任务中,推理能力无法有效发挥。

- Prompt 敏感性:模型对输入 Prompt 的格式、表述较为敏感,Few-shot 提示反而会降低其推理性能,官方推荐使用 Zero-shot 直接描述问题与约束。

- 工具调用能力缺失:当前版本的思维链无法调用计算器、搜索引擎、代码解释器等外部工具,无法通过工具进一步拓展推理边界,这也是官方明确的下一版本核心优化方向。

九、总结与行业启示

DeepSeek-R1 的思维链体系,本质上是对大模型推理技术路线的一次范式革命。它用实验结果证明了:大模型的基座中,本身就蕴含着强大的推理潜能,而人类标注的推理轨迹,反而可能成为束缚模型探索的枷锁;仅靠结果导向的强化学习,就能解锁这种潜能,让模型自主进化出远超人类示范的推理能力。

这一结论给行业带来了深远的启示:

- 推理能力的规模化训练成为可能:无需高昂的人工标注成本,仅需可自动验证的题目与标准答案,就能规模化训练出超强的推理模型,大幅降低了推理大模型的研发门槛。

- 突破了人类认知的天花板:模型可以探索出人类从未使用过的、更高效的推理路径,为数学、科研等领域的难题解决,提供了全新的 AI 视角。

- 为小模型推理能力提升提供了新路径:通过大模型 RL 进化出的高质量思维链做蒸馏,可快速提升小模型的推理能力,推动推理技术的普惠化落地。

当然,DeepSeek-R1 的方案仍存在局限性,尤其是在非可验证任务、工具协同、token 效率等方面,仍有大量的优化空间。但不可否认的是,它为大语言模型的推理能力进化,开辟了一条全新的、更具想象力的技术路线。

参考文献

[1] DeepSeek-AI. DeepSeek-R1: Incentivizing Reasoning Capability in LLMs via Reinforcement Learning[J]. arXiv preprint arXiv:2501.12948, 2026.

[2] Wei J, Wang X, Schuurmans D, et al. Chain-of-thought prompting elicits reasoning in large language models[J]. Advances in Neural Information Processing Systems, 2022, 35: 24824-24837.

[3] Shao Z, Wang P, Zhu Q, et al. DeepSeek-Math: Pushing the Limits of Mathematical Reasoning in Open Language Models[J]. arXiv preprint arXiv:2402.03300, 2024.

[4] Schulman J, Wolski F, Dhariwal P, et al. Proximal policy optimization algorithms[J]. arXiv preprint arXiv:1707.06347, 2017.

相关代码与数据集可参考 DeepSeek 官方开源仓库:https://github.com/deepseek-ai/DeepSeek-R1欢迎在评论区交流,关于 DeepSeek-R1 的推理实现、训练复现、工程落地相关问题,我会逐一解答。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献18条内容

已为社区贡献18条内容

所有评论(0)