大数据 Cassandra 中数据一致性的保证方法

大数据Cassandra中数据一致性的保证方法:从原理到实践的深度拆解

1. 引入:当"库存超卖"遇到Cassandra——一致性为什么是分布式系统的"心跳"?

凌晨12点,某电商平台的"618大促"刚开场10秒,一款爆款手机的库存就从1000台变成了-20台——超卖了。

技术团队紧急排查,发现问题出在分布式数据库的一致性上:当用户同时发起1000个下单请求时,数据库的多个副本之间没有及时同步库存状态,导致部分副本仍显示"有货",最终出现了"卖得比库存多"的荒诞场景。

如果这个数据库是Cassandra,会发生同样的问题吗?答案是**“不一定”——因为Cassandra的一致性模型是"可调的最终一致性"**:它既可以像Redis一样追求极致性能(牺牲部分一致性),也可以通过配置达到接近强一致性的效果(牺牲部分可用性)。

这篇文章,我们将从基础概念→核心机制→实践技巧三个维度,彻底讲清楚Cassandra如何保证数据一致性,以及如何在"性能、可用性、一致性"之间找到平衡。

2. 概念地图:先搞懂Cassandra的"底层逻辑"

在讨论一致性之前,我们需要先建立Cassandra的基础认知框架——这些概念是理解一致性的前提:

2.1 Cassandra的核心架构:环形网络(Ring)与副本(Replica)

Cassandra的集群是一个无中心的环形网络(Ring),每个节点负责处理一部分数据(Partition)。为了保证高可用性,Cassandra会将每个Partition的数据复制到多个节点上,这些复制的副本称为Replica。

- 复制因子(Replication Factor, RF):每个Partition的副本数量(比如RF=3表示每个数据会存3份)。

- 副本策略(Replication Strategy):副本的分布规则(比如

SimpleStrategy按环形顺序分布,NetworkTopologyStrategy按数据中心/机架分布)。 - 协调者节点(Coordinator):接收客户端请求的节点,负责将请求转发给所有副本,并汇总结果返回给客户端。

2.2 一致性的本质:"数据一致"到底指什么?

在分布式系统中,一致性指的是"所有节点上的同一份数据,在同一时间点的状态是相同的"。但Cassandra的一致性模型是最终一致性(Eventual Consistency)——即"只要没有新的写操作,所有副本最终会同步到相同的状态"。

为了灵活控制一致性,Cassandra定义了一致性级别(Consistency Level):客户端可以通过设置不同的级别,在"性能"和"一致性"之间做权衡。

2.3 关键术语速查:

| 术语 | 定义 |

|---|---|

| 最终一致性 | 副本最终会同步,但中间可能存在短暂不一致 |

| 强一致性 | 所有副本实时一致(Cassandra不支持纯强一致性,但可通过配置接近) |

| 一致性级别 | 客户端要求的副本确认数量(比如ONE、QUORUM、ALL) |

| Quorum | 多数派副本(计算公式:(RF/2)+1,比如RF=3时Quorum=2) |

| Read Repair | 读操作时自动修复不一致的副本 |

| Hinted Handoff | 副本宕机时,协调者暂存写请求,待节点恢复后转发 |

3. 基础理解:用"快递网点"类比Cassandra的一致性

为了让抽象的概念更直观,我们用**“快递网点”**来类比Cassandra的集群:

- 环形网络(Ring):整个城市的快递网点连成一个环(比如A→B→C→D→A)。

- Partition:每个网点负责的"快递区域"(比如A网点负责朝阳区,B负责海淀区)。

- 副本(Replica):每个快递区域的"备用网点"(比如朝阳区的快递会存在A、B、C三个网点,RF=3)。

- 协调者节点:你寄快递时去的"主网点"(比如你去A网点寄快递,A就是协调者)。

- 一致性级别:你要求的"网点确认数量"(比如:

- ONE:A网点收到快递就算成功(最快,但可能丢件);

- QUORUM:A、B两个网点收到才算成功(平衡性能和可靠性);

- ALL:A、B、C三个网点都收到才算成功(最可靠,但最慢)。

4. 层层深入:Cassandra保证一致性的5大核心机制

Cassandra的一致性不是"天生的",而是通过5大机制共同实现的。我们从"写操作"和"读操作"两个流程,逐一拆解这些机制。

4.1 机制1:写操作的"Quorum确认"——多数派原则

问题:如果只要求1个副本确认(ONE级别),当这个副本宕机时,数据会丢失;如果要求所有副本确认(ALL级别),当1个副本宕机时,写操作会失败(可用性降低)。

解决方案:Quorum机制——要求多数派副本确认写操作,既保证可靠性,又兼顾可用性。

4.1.1 Quorum的计算方式

Quorum的计算公式是:Quorum = (Replication Factor / 2) + 1(向上取整)

比如:

- RF=3 → Quorum=2(需要2个副本确认);

- RF=5 → Quorum=3(需要3个副本确认)。

4.1.2 写操作的流程(以RF=3,一致性级别=QUORUM为例)

- 客户端请求:客户端向协调者节点(比如A)发送写请求(比如"更新库存为999")。

- 协调者路由:协调者根据Partition Key(比如"商品ID=123")计算出该数据的3个副本节点(比如A、B、C)。

- 发送写请求:协调者向A、B、C三个节点发送写请求。

- 等待确认:协调者等待至少2个节点的成功响应(Quorum=2)。

- 返回结果:协调者向客户端返回"写成功"。

关键点:即使有1个副本节点(比如C)宕机,只要A、B确认,写操作依然成功——这就是Quorum的"容错性"。

4.2 机制2:读操作的"Read Repair"——自动修复不一致

问题:如果某个副本节点因为网络问题,没有收到写请求,导致副本数据不一致(比如A、B是v3,C是v2),读操作时会返回旧数据吗?

解决方案:Read Repair——读操作时,协调者会比较多个副本的数据版本,自动修复旧副本。

4.2.1 Read Repair的流程(以RF=3,一致性级别=QUORUM为例)

- 客户端请求:客户端向协调者(A)发送读请求(比如"查询商品123的库存")。

- 协调者路由:协调者向3个副本节点(A、B、C)发送读请求。

- 收集结果:协调者收到A的v3、B的v3、C的v2。

- 版本比较:协调者发现C的版本旧(v2 < v3)。

- 自动修复:协调者向C发送"同步v3"的请求。

- 返回结果:协调者将最新的v3返回给客户端。

关键点:Read Repair是异步的吗?不——修复操作是在读请求的过程中完成的,客户端会拿到最新数据,但修复的延迟可能会 slightly 增加读耗时(通常可以忽略)。

4.3 机制3:Hinted Handoff——宕机节点的"数据暂存"

问题:如果某个副本节点(比如C)宕机,协调者发送的写请求会失败吗?

解决方案:Hinted Handoff——协调者将写请求暂存为"Hint"(提示),待节点恢复后,自动转发这个请求。

4.3.1 Hinted Handoff的流程

- 副本宕机:协调者向C发送写请求,但C未响应(宕机)。

- 生成Hint:协调者将写请求保存到本地的

hints目录(默认保存3小时,可配置)。 - 节点恢复:当C恢复后,协调者通过Gossip协议感知到C的状态,将Hint转发给C。

- 数据同步:C执行Hint中的写请求,同步数据。

关键点:Hinted Handoff是最终一致性的重要保障——即使节点宕机,数据也不会丢失,只是延迟同步。

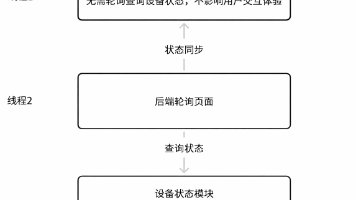

4.4 机制4:Gossip协议——集群状态的"实时同步"

问题:协调者如何知道哪些副本节点是可用的?

解决方案:Gossip协议——节点之间通过" gossip "(闲聊)的方式,实时交换集群状态信息(比如节点是否存活、数据版本等)。

4.4.1 Gossip的工作原理

- 每个节点每隔1秒,随机选择2个其他节点,交换状态信息(比如自己的存活状态、副本的版本)。

- 节点通过Gossip维护一个状态表(比如

system.peers表),记录所有节点的状态。 - 当协调者需要发送请求时,会先查询状态表,选择可用的副本节点。

关键点:Gossip是Cassandra"无中心"架构的基础——没有主节点,所有节点平等,通过Gossip保持集群的一致性。

4.5 机制5:Anti-Entropy(反熵)——定期全量同步

问题:如果Read Repair和Hinted Handoff都失败(比如节点宕机超过3小时,Hint被删除),数据会永远不一致吗?

解决方案:Anti-Entropy——定期全量同步副本数据,修复所有不一致的情况。

4.5.1 Anti-Entropy的实现:nodetool repair

Cassandra提供了nodetool repair命令,用于触发全量同步:

# 修复整个集群的所有键空间

nodetool repair

# 修复指定键空间的指定表

nodetool repair my_keyspace my_table

工作原理:

- 选择一个节点作为"源节点"(比如A)。

- 源节点与其他副本节点(比如B、C)比较数据的哈希值(Merkle Tree)。

- 发现不一致的数据,源节点将最新数据同步给其他节点。

最佳实践:

- 定期执行

nodetool repair(比如每天一次),避免数据长期不一致。 - 避免在业务高峰执行,因为repair会占用大量CPU和带宽。

5. 多维透视:Cassandra一致性的"场景化选择"

Cassandra的一致性模型不是"一刀切"的,而是场景驱动的。我们从4个视角,分析如何选择一致性策略。

5.1 历史视角:Cassandra为什么选择"最终一致性"?

Cassandra诞生于Facebook(2008年),最初用于存储收件箱消息——这个场景的核心需求是:

- 高吞吐:每天处理数十亿条消息;

- 高可用:不能因为一个节点宕机就无法收发消息;

- 最终一致:消息延迟几秒同步是可以接受的。

如果选择强一致性(比如MySQL的主从同步),当主节点宕机时,整个系统会不可用——这显然不符合Facebook的需求。因此,Cassandra选择了AP优先(Availability + Partition Tolerance)的CAP策略,通过最终一致性保证高可用和高吞吐。

5.2 实践视角:不同场景的一致性配置

我们用3个常见场景,说明如何选择一致性级别:

场景1:电商库存(要求高一致性)

- 需求:库存不能超卖,必须保证读、写的一致性。

- 配置:

- 复制因子RF=3(3个副本);

- 写一致性级别=QUORUM(需要2个副本确认);

- 读一致性级别=QUORUM(需要2个副本确认);

- 定期执行

nodetool repair(每天1次)。

效果:即使1个节点宕机,写、读操作依然可用,且数据一致。

场景2:日志存储(要求高吞吐)

- 需求:日志写入速度要快,偶尔丢失几条日志可以接受。

- 配置:

- 复制因子RF=2(2个副本);

- 写一致性级别=ONE(只需要1个副本确认);

- 读一致性级别=QUORUM(需要2个副本确认);

- 开启Read Repair(默认开启)。

效果:写操作延迟极低(<1ms),读操作通过Read Repair保证数据一致。

场景3:跨数据中心同步(要求异地高可用)

- 需求:北京、上海两个数据中心,需要保证异地数据同步。

- 配置:

- 复制因子RF=4(北京2个副本,上海2个副本);

- 写一致性级别=LOCAL_QUORUM(北京的2个副本确认);

- 读一致性级别=LOCAL_QUORUM(上海的2个副本确认);

- 使用

NetworkTopologyStrategy副本策略。

效果:即使北京数据中心宕机,上海的数据中心依然可用,且数据一致。

5.3 批判视角:Cassandra一致性的"局限性"

Cassandra的一致性模型不是"完美的",它有以下局限性:

-

Quorum的"假阳性":当网络分区时,可能出现两个"多数派"(比如RF=5,分区为3个节点和2个节点,3个节点的Quorum=3,2个节点的Quorum=3——但2个节点无法满足Quorum,所以不会出现split brain)。但如果RF=4,分区为2个节点和2个节点,此时两个分区的Quorum=3,都无法满足,写操作会失败——这是Quorum的"保守性"。

-

Read Repair的"延迟":当副本数量很多(比如RF=10),Read Repair需要比较10个副本的数据,会增加读延迟。

-

Hinted Handoff的"过期":如果节点宕机超过Hint的保存时间(默认3小时),Hint会被删除,数据会丢失——需要依赖

nodetool repair恢复。

5.4 未来视角:Cassandra一致性的"进化方向"

随着分布式系统的发展,Cassandra的一致性模型也在进化:

-

支持线性一致性(Linearizable Consistency):Cassandra 4.0引入了

Paxos协议,支持线性一致性(强一致性)——适合需要实时一致的场景(比如金融交易)。 -

流处理整合:结合Flink、Spark等流处理框架,实现"实时一致性"——比如写操作后,通过流处理同步所有副本,减少最终一致的延迟。

-

智能一致性调节:通过AI模型动态调整一致性级别——比如业务高峰时降低一致性级别(提高性能),低谷时提高一致性级别(修复数据)。

6. 实践转化:Cassandra一致性的"配置与排查"

理论讲得再多,不如动手实践。我们用3个实战技巧,解决Cassandra一致性的常见问题。

6.1 技巧1:如何设置一致性级别?

Cassandra的一致性级别可以在客户端或表级别设置:

客户端设置(Java Datastax Driver)

// 1. 创建集群连接

Cluster cluster = Cluster.builder()

.addContactPoint("127.0.0.1")

.build();

// 2. 创建会话

Session session = cluster.connect("my_keyspace");

// 3. 准备语句(INSERT)

PreparedStatement insertStmt = session.prepare(

"INSERT INTO users (id, name, email) VALUES (?, ?, ?)"

);

// 4. 绑定参数,设置一致性级别(QUORUM)

BoundStatement boundInsert = insertStmt.bind(

UUID.randomUUID(), "张三", "zhangsan@example.com"

);

boundInsert.setConsistencyLevel(ConsistencyLevel.QUORUM);

// 5. 执行语句

session.execute(boundInsert);

// 6. 准备语句(SELECT)

PreparedStatement selectStmt = session.prepare(

"SELECT * FROM users WHERE id = ?"

);

// 7. 绑定参数,设置一致性级别(QUORUM)

BoundStatement boundSelect = selectStmt.bind(

UUID.fromString("550e8400-e29b-41d4-a716-446655440000")

);

boundSelect.setConsistencyLevel(ConsistencyLevel.QUORUM);

// 8. 执行查询

ResultSet result = session.execute(boundSelect);

表级别设置(CQL)

-- 创建表时设置默认一致性级别

CREATE TABLE my_keyspace.users (

id UUID PRIMARY KEY,

name TEXT,

email TEXT

) WITH default_consistency = QUORUM;

6.2 技巧2:如何监控一致性状态?

Cassandra提供了Metrics(指标)系统,用于监控一致性相关的状态:

- ReadRepairRate:每秒执行的Read Repair次数(越高说明不一致越多)。

- HintedHandoffCount:已发送的Hint数量(越高说明节点宕机越频繁)。

- UnrepairedPartitions:未修复的分区数量(越高说明

nodetool repair执行不及时)。

如何查看Metrics?

- 使用

nodetool metrics命令:# 查看ReadRepairRate nodetool metrics -r "org.apache.cassandra.metrics:type=ReadRepair,scope=*,name=RepairedBlocking" # 查看HintedHandoffCount nodetool metrics -r "org.apache.cassandra.metrics:type=HintedHandoff,scope=*,name=HintsSent" - 使用Prometheus + Grafana可视化监控(推荐):Cassandra可以暴露Metrics给Prometheus,通过Grafana绘制仪表盘。

6.3 技巧3:如何排查数据不一致问题?

如果发现数据不一致(比如读返回旧数据),可以按照以下步骤排查:

步骤1:检查副本状态

用nodetool status命令查看节点状态:

nodetool status my_keyspace

输出示例:

Datacenter: datacenter1

=======================

Status=Up/Down

|/ State=Normal/Leaving/Joining/Moving

-- Address Load Tokens Owns (effective) Host ID Rack

UN 127.0.0.1 100 MB 256 100.0% 550e8400-e29b-41d4-a716-446655440000 rack1

UN 127.0.0.2 90 MB 256 100.0% 550e8400-e29b-41d4-a716-446655440001 rack1

UN 127.0.0.3 80 MB 256 100.0% 550e8400-e29b-41d4-a716-446655440002 rack1

- UN:节点正常(Up + Normal);

- DN:节点宕机(Down + Normal)。

如果有节点是DN状态,说明该节点无法接收写请求,需要检查节点是否存活。

步骤2:检查Hinted Handoff状态

用nodetool hintsinfo命令查看Hint的状态:

nodetool hintsinfo

输出示例:

Total hints pending: 0

Hinted handoff is enabled

Hinted handoff throttling is disabled

如果Total hints pending很大(比如>1000),说明有很多写请求未转发到宕机节点,需要等待节点恢复或手动修复。

步骤3:手动执行Read Repair

用nodetool readrepair命令手动触发Read Repair:

# 修复指定表的指定Partition

nodetool readrepair my_keyspace my_table "partition_key"

步骤4:执行全量修复

如果以上步骤都无法解决,执行nodetool repair全量修复:

# 修复指定键空间的指定表

nodetool repair my_keyspace my_table

7. 整合提升:Cassandra一致性的"核心结论"

通过以上的分析,我们可以总结出Cassandra一致性的3个核心结论:

结论1:一致性是"可调的"——没有绝对的"好"与"坏"

Cassandra的一致性级别从ONE到ALL,覆盖了"性能优先"到"一致性优先"的全光谱。选择哪个级别,取决于你的业务需求:

- 要性能:选ONE;

- 要平衡:选QUORUM;

- 要绝对一致:选ALL(但会牺牲可用性)。

结论2:一致性是"多个机制共同作用的结果"

Cassandra的一致性不是靠单一机制实现的,而是Quorum + Read Repair + Hinted Handoff + Gossip + Anti-Entropy共同作用的结果。缺少任何一个机制,都会导致一致性问题。

结论3:一致性的"最终目标"是"业务可用"

技术的本质是服务业务。Cassandra的一致性模型之所以有效,是因为它匹配了互联网业务的核心需求——高可用、高吞吐、最终一致。对于大多数互联网业务来说,“最终一致"已经足够,因为用户可以接受"数据延迟几秒同步”,但无法接受"系统不可用"。

8. 拓展任务:动手验证Cassandra的一致性

为了巩固所学知识,建议你完成以下拓展任务:

- 搭建Cassandra集群:用Docker搭建一个3节点的Cassandra集群(RF=3)。

- 测试不同一致性级别:

- 用ONE级别写数据,查看读结果(是否有不一致);

- 用QUORUM级别写数据,查看读结果(是否一致);

- 用ALL级别写数据,关闭一个节点,查看写操作是否失败。

- 模拟节点宕机:关闭一个节点,写数据,然后恢复节点,查看Hinted Handoff是否生效。

- 执行全量修复:手动修改一个副本的数据,执行

nodetool repair,查看数据是否同步。

9. 总结:Cassandra的一致性——“在矛盾中找到平衡”

Cassandra的一致性模型,本质上是**“在性能、可用性、一致性之间找到平衡”**。它不追求"绝对的一致",而是追求"符合业务需求的一致"。

对于技术人员来说,理解Cassandra的一致性,不仅仅是掌握一个数据库的特性,更是理解分布式系统的核心矛盾——在一个充满不确定性的网络环境中,如何保证数据的可靠性和可用性。

最后,送给大家一句口诀:“写用Quorum,读用Quorum,定期修repair,Hint要开启”——这是Cassandra一致性的"黄金法则"。

参考资料:

- Cassandra官方文档:https://cassandra.apache.org/doc/latest/

- 《Cassandra权威指南》(O’Reilly)

- Datastax Driver文档:https://docs.datastax.com/en/developer/java-driver/4.17/

(全文完)

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献5条内容

已为社区贡献5条内容

所有评论(0)