机器学习全景指南:从AI启蒙到核心算法实战

目录规划

为了将这所有博客里的知识点逻辑顺畅地串联起来,特此设计了以下目录结构。这个顺序遵循了“概念引入 -> 基础回归 -> 分类进阶 -> 无监督学习”的学习路径:

- 第一章:启蒙篇——人工智能与机器学习的宏观版图

- 来源博客:人工智能和机器学习

- 核心内容:AI、ML、DL的关系,机器学习的分类(监督/无监督/强化),基本工作流程。

- 第二章:基石篇——预测连续值的线性回归

- 来源博客:线性回归

- 核心内容:一元/多元线性回归,损失函数,梯度下降,代码实战。

- 第三章:进阶篇——解决分类问题的逻辑回归

- 来源博客:逻辑回归

- 核心内容:从回归到分类的跨越,Sigmoid函数,决策边界,代码实战。

- 第四章:直觉篇——基于距离的K-近邻(KNN)

- 来源博客:KNN算法

- 核心内容:KNN原理,K值选择,距离计算,优缺点分析,代码实战。

- 第五章:探索篇——发现数据内在结构的聚类算法

- 来源博客:聚类算法

- 核心内容:K-Means原理,簇的概念,与分类的区别,应用场景。

- 第六章:总结与展望

- 来源博客:总结篇

- 综合对比五大算法,如何选择适合的模型。

文章目录

第一章:启蒙篇——人工智能与机器学习的宏观版图

导读:在深入具体的算法之前,我们必须先理清概念。很多人容易混淆“人工智能”、“机器学习”和“深度学习”。本章将为你绘制一张清晰的认知地图,并解释机器学习究竟是如何工作的。

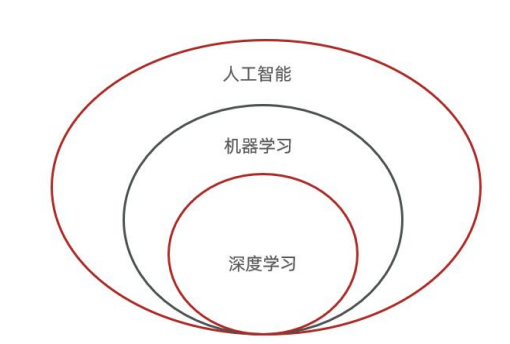

1.1 三者关系:套娃式的包含关系

想象三个大小不同的俄罗斯套娃,或者三个同心圆:

-

**人工智能 **(Artificial Intelligence, AI):最大的圆。

- 定义:这是一个宏大的领域,旨在让机器模拟人类的智能行为(如视觉、听觉、推理、决策)。

- 历史:早在1956年达特茅斯会议就提出了这个概念。

- 范围:它不仅包含机器学习,还包含专家系统、规则引擎、搜索算法等不需要“学习”就能运行的传统AI技术。

-

**机器学习 **(Machine Learning, ML):中间的圆,是AI的核心子集。

- 定义:一种让计算机不从显式编程中,而是从数据中学习规律的技术。

- 核心逻辑:传统编程是

输入 + 规则 = 输出;机器学习是输入 + 输出 = 规则(模型)。 - 地位:目前实现AI最主要的手段。

-

**深度学习 **(Deep Learning, DL):最小的圆,是机器学习的子集。

- 定义:基于人工神经网络(尤其是深层神经网络)的机器学习方法。

- 特点:擅长处理图像、语音、自然语言等非结构化数据,需要大量数据和算力。

一句话总结:深度学习是机器学习的一种特殊方法,而机器学习是实现人工智能的主要途径。

1.2 机器学习的三大流派

根据训练数据和学习方式的不同,机器学习主要分为三类:

🟢 1. 监督学习 (Supervised Learning)

- 特点:数据既有**特征 (X),也有标签 **(Y)(即正确答案)。就像老师带着学生做题,做完后告诉学生正确答案是什么。

- 目标:学习一个映射关系

,以便对新的数据进行预测。

,以便对新的数据进行预测。 - 主要任务:

- 回归 (Regression):预测连续数值。

- 例子:预测房价、气温、股票价格。

- 对应算法:线性回归(后续章节详解)。

- 分类 (Classification):预测离散类别。

- 例子:判断邮件是否为垃圾邮件、识别图片是猫还是狗。

- 对应算法:逻辑回归、KNN(后续章节详解)。

- 回归 (Regression):预测连续数值。

🔵 2. 无监督学习 (Unsupervised Learning)

- 特点:数据只有**特征 **(X),**没有标签 **(Y)。就像给学生一堆杂乱的积木,没有说明书,让他们自己找规律分类。

- 目标:发现数据内部的结构、模式或分布。

- 主要任务:

- **聚类 **(Clustering):将相似的数据归为一组。

- 例子:用户细分(将消费者分为高价值、低价值群体)、新闻主题聚合。

- 对应算法:K-Means聚类(后续章节详解)。

- **降维 **(Dimensionality Reduction):在保留主要信息的前提下减少特征数量。

- **聚类 **(Clustering):将相似的数据归为一组。

🟠 3. 强化学习 (Reinforcement Learning)

- 特点:没有静态的数据集。智能体(Agent)通过与环境交互,根据**奖励 **(Reward) 或 **惩罚 **(Penalty) 来调整策略。

- 目标:找到一种策略,使得长期累积的奖励最大化。

- 例子:AlphaGo下围棋、机器人学走路、自动驾驶决策。

1.3 机器学习的标准工作流程

无论使用哪种算法,一个完整的机器学习项目通常遵循以下步骤:

- **数据收集 **(Data Collection):获取原始数据(数据库、爬虫、传感器等)。

- **数据预处理 **(Data Preprocessing):

- 清洗数据(处理缺失值、异常值)。

- 特征工程(提取特征、归一化/标准化)。

- 注:这是最耗时但最关键的一步,“Garbage In, Garbage Out”。

- **模型选择 **(Model Selection):根据问题类型(回归/分类/聚类)选择合适的算法(如线性回归、KNN等)。

- **模型训练 **(Training):使用训练集数据,让算法学习参数。

- **模型评估 **(Evaluation):使用测试集数据,验证模型的效果(准确率、误差等)。

- **模型调优 **(Tuning):调整超参数(如KNN中的K值),优化性能。

- **部署与应用 **(Deployment):将模型应用到实际生产环境中。

1.4 代码小试牛刀:理解“拟合”的概念

为了让大家更直观地理解机器学习中“从数据中学习规则”的过程,我们用一段简单的 Python 代码来模拟线性回归(监督学习中最基础的算法)的拟合过程。

这段代码展示了如何生成一些带有噪音的数据,并让机器去“猜”出背后的直线规律。

import numpy as np

import matplotlib.pyplot as plt

from sklearn.linear_model import LinearRegression

# 1. 生成模拟数据 (模拟现实世界的不完美)

# 假设真实规律是 y = 2x + 1,但我们加入了一些随机噪音

np.random.seed(42) # 固定随机种子,保证每次运行结果一样

X = 2 * np.random.rand(100, 1) # 100个样本,特征x在0-2之间

y = 1 + 2 * X + np.random.randn(100, 1) # y = 1 + 2x + 噪音

# 2. 模型初始化与训练

# 这就是机器学习库帮我们做的“黑盒”工作

model = LinearRegression()

model.fit(X, y) # 核心步骤:模型通过数据计算出了最佳的 w 和 b

# 3. 查看模型学到的规律

print(f"截距 (b): {model.intercept_[0]:.4f}") # 应该接近 1

print(f"斜率 (w): {model.coef_[0][0]:.4f}") # 应该接近 2

# 4. 可视化结果

plt.scatter(X, y, alpha=0.5, label='原始数据 (含噪音)')

plt.plot(X, model.predict(X), 'r-', linewidth=2, label='机器学习拟合的直线')

plt.title('机器学习:从噪音数据中寻找规律')

plt.xlabel('特征 X')

plt.ylabel('目标 Y')

plt.legend()

plt.show()

代码解读:

- 我们没有告诉计算机公式是

。

。 - 我们只给了它一堆看起来乱糟糟的点(

X和y)。 - 通过

model.fit(),计算机自己算出了斜率接近2,截距接近1。 - 这就是机器学习的本质:数据驱动,自动发现规律。

1.5 本章小结

- AI > ML > DL:理清了层级关系。

- 监督 vs 无监督:关键区别在于数据是否有“标签”(正确答案)。

- 流程标准化:从数据清洗到模型部署,每一步都不可或缺。

在接下来的章节中,我们将深入具体的算法世界。首先,我们将走进线性回归,看看机器是如何预测连续数值的;随后,我们将学习逻辑回归和KNN来解决分类问题;最后,我们将探索聚类算法,看看在没有标签的情况下,机器如何发现数据的内在结构。

下一章预告:《第二章:基石篇——预测连续值的线性回归》,我们将深入探讨如何用一条直线撬动数据预测。

第二章:基石篇——预测连续值的线性回归

导读:在机器学习的浩瀚星空中,线性回归 (Linear Regression) 是最亮的那颗启明星。它不仅是统计学中的经典方法,更是理解机器学习“损失函数”和“梯度下降”等核心概念的基石。本章带你深入理解如何通过一条直线来预测未来。

2.1 什么是线性回归?

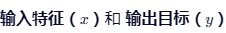

简单来说,线性回归就是试图找到 之间的线性关系。

之间的线性关系。

- 应用场景:预测连续数值。

- 根据房屋面积预测房价。

- 根据广告投入预测销售额。

- 根据气温预测冰淇淋销量。

核心公式

对于只有一个特征的情况(一元线性回归),模型的形式就是我们在初中数学学过的一次函数:

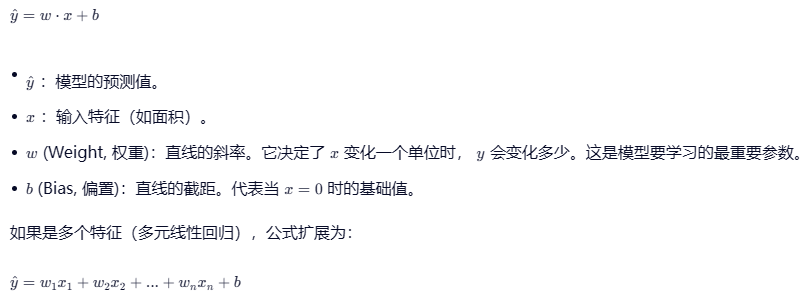

2.2 核心问题:如何找到“最好”的直线?

面对散落在坐标系中的数据点,世界上有无数条直线可以穿过它们。哪一条才是最好的?

标准答案:让所有数据点到这条直线的误差之和最小的那条线。

1. 损失函数 (Loss Function)

为了量化“误差”,我们引入损失函数。在线性回归中,最常用的是均方误差 (MSE, Mean Squared Error)。

- 为什么要平方?

- 消除正负误差的抵消(防止正误差和负误差相加变成0,掩盖了真实误差)。

- 放大较大误差的影响:如果某个点偏离直线很远,平方后误差会变得非常大,迫使模型优先修正这些大偏差。

我们的目标就是 最小。

最小。

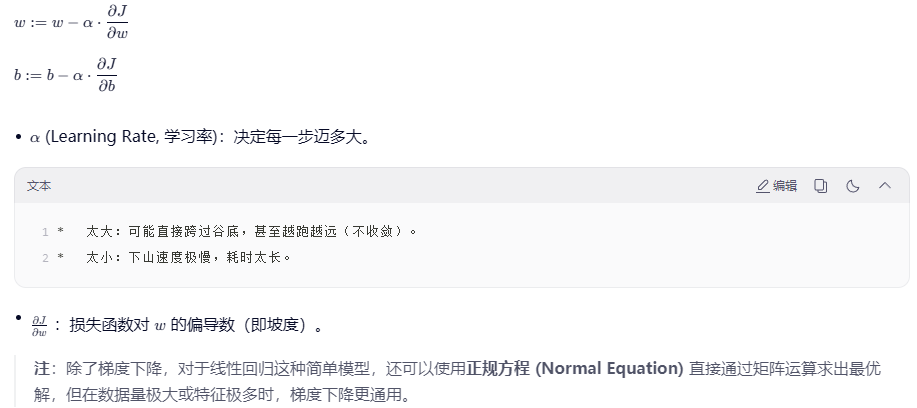

2. 求解方法:梯度下降 (Gradient Descent)

怎么找到让损失函数最小的 呢?这就好比你在云雾缭绕的山顶(高损失区),想要走到山谷最低点(最小损失区),但你看不到路。

呢?这就好比你在云雾缭绕的山顶(高损失区),想要走到山谷最低点(最小损失区),但你看不到路。

梯度下降的策略:

- 试探:感受脚下哪个方向坡度最陡(计算梯度的导数)。

- 迈步:沿着最陡的下坡方向走一步。

- 重复:不断重复上述过程,直到走到谷底(收敛)。

数学更新公式:

注:除了梯度下降,对于线性回归这种简单模型,还可以使用正规方程 (Normal Equation) 直接通过矩阵运算求出最优解,但在数据量极大或特征极多时,梯度下降更通用。

2.3 代码实战:从零实现线性回归逻辑

为了让大家透彻理解,我们不仅调用库,还手动模拟一下“梯度下降”的核心逻辑,看看模型是如何一步步逼近真相的。

import numpy as np

import matplotlib.pyplot as plt

# 1. 准备数据

# 假设真实规律是 y = 3x + 2,加上一点噪音

np.random.seed(42)

X = 2 * np.random.rand(100, 1)

y = 2 + 3 * X + np.random.randn(100, 1)

# 2. 初始化参数

w = 0.0 # 初始斜率猜为0

b = 0.0 # 初始截距猜为0

learning_rate = 0.1 # 学习率

iterations = 100 # 迭代次数

# 3. 梯度下降过程

loss_history = []

for i in range(iterations):

# A. 预测

y_pred = w * X + b

# B. 计算误差 (残差)

error = y_pred - y

# C. 计算梯度 (导数)

# MSE对w的导数: (2/m) * sum(error * x)

# MSE对b的导数: (2/m) * sum(error)

dw = (2 / len(X)) * np.sum(error * X)

db = (2 / len(X)) * np.sum(error)

# D. 更新参数 (向反方向走)

w = w - learning_rate * dw

b = b - learning_rate * db

# 记录当前的损失值,用于观察收敛情况

loss = np.mean(error ** 2)

loss_history.append(loss)

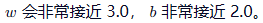

print(f"训练结束!")

print(f"学到的权重 w: {w:.4f} (真实值应为 3.0)")

print(f"学到的偏置 b: {b:.4f} (真实值应为 2.0)")

# 4. 可视化结果

plt.figure(figsize=(12, 5))

# 图1:数据拟合效果

plt.subplot(1, 2, 1)

plt.scatter(X, y, alpha=0.5, label='原始数据')

plt.plot(X, w * X + b, 'r-', linewidth=2, label=f'拟合直线 (y={w:.2f}x+{b:.2f})')

plt.title('线性回归拟合效果')

plt.xlabel('X')

plt.ylabel('y')

plt.legend()

# 图2:损失函数下降曲线

plt.subplot(1, 2, 2)

plt.plot(loss_history)

plt.title('损失函数 (MSE) 下降过程')

plt.xlabel('迭代次数')

plt.ylabel('Loss')

plt.grid(True)

plt.tight_layout()

plt.show()

代码解析:

- 我们并没有直接使用

sklearn,而是手动写了for循环来模拟学习过程。 - 在每次循环中,我们计算当前直线的误差,算出梯度,然后微调

。

。 - 运行结果你会发现,经过100次迭代,

这就是机器“学习”的过程。

这就是机器“学习”的过程。

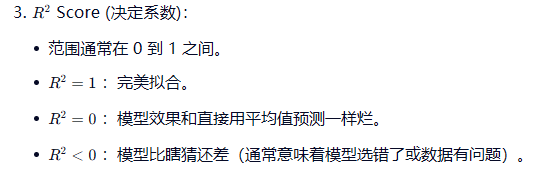

2.4 评估模型的好坏

训练好模型后,怎么知道它准不准?常用的指标有:

-

MSE (均方误差):即损失函数的值。越小越好,但对异常值敏感。

-

RMSE (均方根误差):MSE 开根号。量纲与

一致,更容易解释(例如:预测房价误差平均是 5 万元)。

一致,更容易解释(例如:预测房价误差平均是 5 万元)。 -

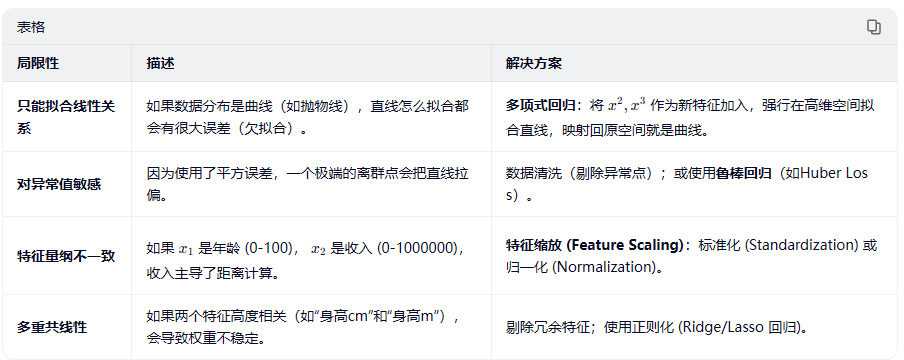

2.5 线性回归的局限性与应对

虽然线性回归很强大,但它也有明显的短板:

2.6 本章小结

- 线性回归是解决回归问题(预测数值)的首选基准模型。

- 核心在于定义损失函数 (MSE) 并使用梯度下降来最小化它。

- 通过代码我们看到了参数

是如何通过迭代一步步逼近真实值的。

是如何通过迭代一步步逼近真实值的。 - 它简单、可解释性强,但受限于线性假设,处理复杂非线性数据时需要特征工程辅助。

线性回归教会了我们“拟合”的概念。但是,现实世界中很多问题不是预测数值,而是做选择(是/否,猫/狗)。这时候,线性回归就不够用了,我们需要它的变体——逻辑回归。

下一章预告:《第三章:进阶篇——解决分类问题的逻辑回归》,我们将揭开如何用回归的思想来解决分类难题,并引入神奇的 Sigmoid 函数。

第三章:进阶篇——解决分类问题的逻辑回归

导读:在上一章中,我们学会了用线性回归预测“房价是多少”这样的连续数值。但如果问题变成了“这封邮件是不是垃圾邮件?”或者“这个肿瘤是良性还是恶性?”,线性回归就束手无策了。

本章基于文档《04_逻辑回归.pdf》,带你走进逻辑回归 (Logistic Regression)的世界。尽管名字里带有“回归”,但它其实是机器学习中最经典、最常用的分类算法之一。我们将揭示它如何通过一个神奇的函数,将连续的预测值转化为离散的类别概率。

3.1 为什么线性回归不能直接用于分类?

假设我们要根据“肿瘤大小”预测“恶性肿瘤 (1)”还是“良性肿瘤 (0)”。

如果我们强行使用线性回归  :

:

- 输出范围不可控:线性回归的输出可以是任意实数

。但分类问题我们需要的是 0 或 1,或者是 0 到 1 之间的概率。如果模型预测出

。但分类问题我们需要的是 0 或 1,或者是 0 到 1 之间的概率。如果模型预测出 ,这在分类任务中是没有意义的。

,这在分类任务中是没有意义的。 - 阈值敏感:如果我们设定

,那么只要数据中增加一个极端的异常点,拟合的直线就会发生剧烈倾斜,导致原本分类正确的点被分错。

,那么只要数据中增加一个极端的异常点,拟合的直线就会发生剧烈倾斜,导致原本分类正确的点被分错。

我们需要什么?

我们需要一个函数,它能接收线性回归的输出 ( ),然后将其压缩到 (0, 1) 区间内,代表属于某一类的概率。

),然后将其压缩到 (0, 1) 区间内,代表属于某一类的概率。

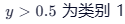

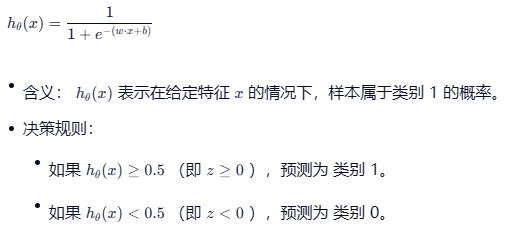

3.2 核心引擎:Sigmoid 函数

逻辑回归的秘诀就在于引入了 Sigmoid 函数(也叫 Logistic 函数)。

1. 函数公式

2. 函数特性

- 形状:呈“S”形曲线。

3. 逻辑回归的最终假设

形象理解:线性部分 ( w x + b wx+b wx+b) 负责打分,分数可正可负;Sigmoid 函数负责把分数“挤压”成概率,分数越高,概率越接近 100%。

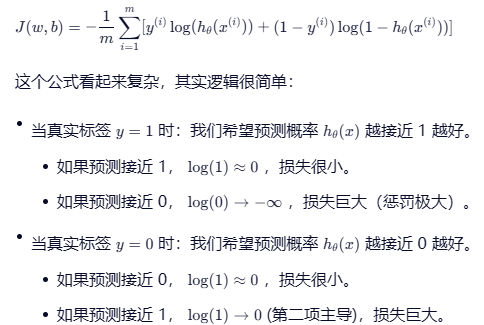

3.3 损失函数:为什么不能用 MSE?

在线性回归中,我们使用均方误差 (MSE)。但在逻辑回归中,由于 Sigmoid 函数的非线性特性,如果使用 MSE,损失函数会变成非凸函数(有很多个局部最低点),梯度下降很容易陷入局部最优,找不到全局最佳解。

因此,逻辑回归使用 对数损失函数 (Log Loss),也称为 交叉熵损失 (Cross-Entropy Loss)。

公式

结论:对数损失函数是一个凸函数,保证梯度下降能找到全局最优解。

3.4 决策边界 (Decision Boundary)

逻辑回归本质上还是线性的。

- 决策边界由

定义。

定义。 - 在二维平面上,这是一条直线。

- 在高维空间中,这是一个超平面。

- 这条线将空间划分为两部分:一边预测为 0,一边预测为 1。

3.5 代码实战:手写数字识别(二分类)

为了展示逻辑回归的威力,我们用 sklearn 来实现一个经典的二分类任务:识别手写数字是“0”还是“1”。

import numpy as np

import matplotlib.pyplot as plt

from sklearn.datasets import load_digits

from sklearn.model_selection import train_test_split

from sklearn.linear_model import LogisticRegression

from sklearn.metrics import classification_report, confusion_matrix

# 1. 加载数据

# load_digits 包含 0-9 的手写图片,我们只取 0 和 1 来做二分类

digits = load_digits()

X = digits.data # 特征:每张图 64 个像素点

y = digits.target # 标签:0-9

# 过滤数据,只保留 0 和 1

mask = (y == 0) | (y == 1)

X = X[mask]

y = y[mask]

print(f"数据形状: {X.shape}, 标签分布: {np.bincount(y)}")

# 2. 划分训练集和测试集

X_train, X_test, y_train, y_test = train_test_split(X, y, test_size=0.3, random_state=42)

# 3. 实例化并训练模型

# C 参数是正则化强度的倒数,默认即可

model = LogisticRegression()

model.fit(X_train, y_train)

# 4. 预测与评估

y_pred = model.predict(X_test)

y_prob = model.predict_proba(X_test) # 获取概率值

print("\n--- 模型评估 ---")

print(f"准确率 (Accuracy): {model.score(X_test, y_test):.4f}")

print("\n分类报告:")

print(classification_report(y_test, y_pred))

# 5. 可视化:看看模型是怎么“看”数字的

# 我们可以画出权重 w,看看哪些像素对区分 0 和 1 最重要

weights = model.coef_[0]

plt.figure(figsize=(8, 4))

plt.subplot(1, 2, 1)

plt.imshow(weights.reshape(8, 8), cmap='coolwarm')

plt.title('模型学到的权重 (Weight Map)\n红色有助于判为1,蓝色有助于判为0')

plt.colorbar()

plt.subplot(1, 2, 2)

# 随机选一张测试图展示

idx = 0

plt.imshow(X_test[idx].reshape(8, 8), cmap='gray')

true_label = y_test[idx]

pred_prob = y_prob[idx][1] # 属于类别1的概率

plt.title(f'真实: {true_label}\n预测为1的概率: {pred_prob:.2f}')

plt.axis('off')

plt.tight_layout()

plt.show()

代码深度解析:

- 数据准备:我们使用了 sklearn 自带的Digits数据集,并人工筛选了 0 和 1,构建了一个二分类问题。

predict_proba:这是逻辑回归的神器。它不仅告诉你结果是 0 还是 1,还告诉你置信度(概率)。比如输出 0.98,说明模型非常有把握;输出 0.51,说明模型很犹豫。- 权重可视化:

- 逻辑回归的

coef_告诉我们每个像素点对结果的贡献。 - 在生成的热力图中,红色区域表示如果这里有墨迹,模型倾向于认为是“1”;蓝色区域表示如果有墨迹,倾向于认为是“0”。

- 你会发现,权重图往往长得很像“1”和“0”的差异部分(例如“0”的圆圈部分权重为负,“1”的竖线部分权重为正)。这再次证明了逻辑回归极强的可解释性。

- 逻辑回归的

3.6 逻辑回归 vs 线性回归:关键区别总结

3.7 优缺点分析

✅ 优点

- 计算代价低:训练和预测速度非常快,适合大规模数据。

- 可解释性强:可以通过权重系数清楚地看到每个特征对结果的影响方向和程度。

- 输出概率:不仅给出分类结果,还给出概率,方便后续根据业务需求调整阈值(例如在医疗诊断中,为了不漏诊,可以将阈值从 0.5 降到 0.3)。

- 不易过拟合:配合正则化(L1/L2),效果很稳健。

❌ 缺点

- 特征与目标需线性相关:本质还是线性分类器,处理复杂的非线性关系能力较弱(除非手动做特征组合)。

- 特征数量巨大时表现一般:相比 SVM 或神经网络,在超高维特征空间下可能不是最优解。

- 对多重共线性敏感:如果特征之间高度相关,权重估计会不稳定。

3.8 本章小结

- 逻辑回归虽然名字带“回归”,实则是分类算法之王。

- 它通过 Sigmoid 函数 将线性输出映射为概率。

- 它使用 对数损失函数 来优化模型,确保找到全局最优。

- 它的最大优势在于简单、快速且可解释,是工业界(如广告点击率预估、风控评分卡)应用最广泛的模型之一。

掌握了线性回归和逻辑回归,我们就解决了机器学习中两大基础任务:预测数值和二分类。但是,如果我们的邻居不只两个,或者有十个类别怎么办?如果数据没有标签,我们该怎么分组?

接下来,我们将学习一种基于“直觉”和“距离”的算法——K-近邻 (KNN),看看它如何处理多分类问题,以及它与前面两种基于“公式”的算法有何不同。

下一章预告:《第四章:直觉篇——基于距离的 K-近邻 (KNN) 算法》,我们将抛弃复杂的公式推导,用最朴素的“近朱者赤”思想来解决分类难题。

第四章:直觉篇——基于距离的 K-近邻 (KNN) 算法

导读:在前两章中,我们学习了线性回归和逻辑回归。这两种算法都有一个共同点:它们都需要通过训练“学习”出一组参数( w w w 和 b b b),形成一个明确的数学公式或模型。

但本章要介绍的 K-近邻算法 (K-Nearest Neighbors, KNN) 完全不同。它不学习任何公式,也没有训练过程。它的核心思想朴素而强大:“近朱者赤,近墨者黑”。如果你周围的邻居大多是好人,那你大概率也是好人。

本章基于文档《02_KNN算法.pdf》,带你领略这种“懒惰学习”的魅力。

4.1 核心思想:物以类聚,人以群分

KNN 是机器学习中最简单、最直观的算法之一。

工作原理

假设你有一个新来的数据点(比如一个未知的电影),想要知道它是“动作片”还是“爱情片”。

- 找邻居:在已有的数据库里,找出离这个新电影最近的 K K K 个电影。

- 看投票:看看这

个邻居里,大多数是什么类型。

个邻居里,大多数是什么类型。 - 做决定:如果

个邻居里有 4 个是动作片,1 个是爱情片,那么我们就判定新电影也是动作片。

个邻居里有 4 个是动作片,1 个是爱情片,那么我们就判定新电影也是动作片。

关键特点:懒惰学习 (Lazy Learning)

- 没有训练阶段:KNN 在“训练”时,只是把数据存起来而已。它不进行任何计算,不拟合任何曲线。

- 预测时才计算:所有的计算工作都推迟到了预测(测试)阶段。当你给它一个新数据时,它才开始去计算距离、找邻居。

- 优点:模型适应性强,数据更新时无需重新训练。

- 缺点:预测速度慢,数据量大时计算量巨大。

4.2 三大核心要素

要让 KNN 正常工作,必须确定三个关键要素:

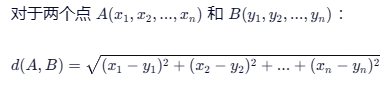

1. 距离度量 (Distance Metric)

怎么定义“近”?最常用的方法是 欧氏距离 (Euclidean Distance),也就是两点之间的直线距离。

- 注:除了欧氏距离,还有曼哈顿距离(城市街区距离)、闵可夫斯基距离等,但欧氏距离最常用。

2. K 值的选择 (The Value of K)

K K K 代表我们要找几个邻居。 K K K 的选择对结果影响巨大:

- K 太小 (如 K=1):

- 优点:模型非常灵活,能捕捉局部细节。

- 缺点:容易受噪声(异常点)干扰。如果那个唯一的邻居是个标错数据的异常点,你的预测就错了。这叫过拟合。

- K 太大 (如 K= 总样本数):

- 优点:抗噪声能力强,结果稳定。

- 缺点:忽略了局部特征,可能把少数类淹没在多数类中。如果数据集中 90% 是猫,无论来什么新数据,K 很大时都会预测为猫。这叫欠拟合。

- 如何选择:通常通过交叉验证,尝试不同的 K K K 值(如 3, 5, 7, 9…),选择准确率最高的那个。一般取奇数,避免投票平局。

3. 分类决策规则

- 分类任务:多数投票法 (Majority Voting)。哪个类别的邻居多,就选哪个。

- 回归任务:平均值法。计算 K 个邻居目标值的平均数,作为预测结果。

4.3 重要预处理:特征缩放 (Feature Scaling)

这是 KNN 最容易踩的坑!

KNN 依赖距离计算。如果特征的**量纲(单位)**不一致,距离计算就会失真。

例子:

- 特征 A:年龄 (0 - 100 岁)

- 特征 B:年薪 (0 - 1,000,000 元)

计算距离时,年薪差 1000 元产生的平方差是 1,000,000,而年龄差 10 岁产生的平方差只有 100。

结果:年薪完全主导了距离计算,年龄特征几乎失效。

解决方案:

在使用 KNN 之前,必须进行标准化 (Standardization) 或 归一化 (Normalization),将所有特征缩放到相同的范围(如 0-1 之间,或均值为 0 方差为 1)。

4.4 代码实战:鸢尾花分类与 K 值的影响

我们将使用经典的鸢尾花数据集,并手动演示不同 K 值对决策边界的影响,以及特征缩放的重要性。

import numpy as np

import matplotlib.pyplot as plt

from sklearn.datasets import load_iris

from sklearn.model_selection import train_test_split

from sklearn.neighbors import KNeighborsClassifier

from sklearn.preprocessing import StandardScaler

from sklearn.metrics import accuracy_score

# 1. 加载数据 (只取前两个特征以便可视化)

iris = load_iris()

X = iris.data[:, :2] # 花萼长度,花萼宽度

y = iris.target

# 2. 【关键步骤】特征缩放

# 如果不做这一步,KNN 的效果会大打折扣

scaler = StandardScaler()

X_scaled = scaler.fit_transform(X)

# 3. 划分数据集

X_train, X_test, y_train, y_test = train_test_split(X_scaled, y, test_size=0.3, random_state=42)

# 4. 探究 K 值的影响

k_range = range(1, 21)

scores = []

for k in k_range:

knn = KNeighborsClassifier(n_neighbors=k)

knn.fit(X_train, y_train)

y_pred = knn.predict(X_test)

scores.append(accuracy_score(y_test, y_pred))

# 绘制 K 值 vs 准确率

plt.figure(figsize=(10, 5))

plt.subplot(1, 2, 1)

plt.plot(k_range, scores, marker='o')

plt.title('K 值对准确率的影响')

plt.xlabel('K 值')

plt.ylabel('准确率')

plt.grid(True)

print(f"最佳 K 值: {k_range[np.argmax(scores)]}, 最高准确率: {max(scores):.4f}")

# 5. 可视化决策边界 (使用最佳 K 值)

best_k = k_range[np.argmax(scores)]

knn_best = KNeighborsClassifier(n_neighbors=best_k)

knn_best.fit(X_scaled, y)

# 生成网格点

h = 0.02

x_min, x_max = X_scaled[:, 0].min() - 1, X_scaled[:, 0].max() + 1

y_min, y_max = X_scaled[:, 1].min() - 1, X_scaled[:, 1].max() + 1

xx, yy = np.meshgrid(np.arange(x_min, x_max, h), np.arange(y_min, y_max, h))

# 预测网格点的类别

Z = knn_best.predict(np.c_[xx.ravel(), yy.ravel()])

Z = Z.reshape(xx.shape)

plt.subplot(1, 2, 2)

plt.contourf(xx, yy, Z, alpha=0.3, cmap=plt.cm.Set1)

plt.scatter(X_scaled[:, 0], X_scaled[:, 1], c=y, edgecolors='k', cmap=plt.cm.Set1)

plt.title(f'KNN 决策边界 (K={best_k})')

plt.xlabel('花萼长度 (标准化后)')

plt.ylabel('花萼宽度 (标准化后)')

plt.tight_layout()

plt.show()

代码深度解析:

StandardScaler:我们首先对数据进行了标准化。如果你注释掉这一行,你会发现准确率可能会下降,且决策边界会变得奇怪(因为某个特征主导了距离)。- K 值搜索:我们遍历了 K=1 到 20,发现准确率是波动的。通常 K 在 3 到 10 之间表现较好。

- 决策边界图:

- 背景色块代表模型预测的区域。

- 你会看到 KNN 的边界是不规则的、曲折的。这是因为它是基于局部邻居投票的,不像逻辑回归那样是一条平滑的直线。

- 这种不规则性让它能很好地适应复杂的数据分布,但也容易受到噪声点的干扰(边界出现细小的毛刺)。

4.5 KNN 的优缺点总结

✅ 优点

- 简单易懂:逻辑直观,无需复杂的数学推导,容易向非技术人员解释。

- 无需训练:新增数据直接加入数据集即可,无需重新训练模型。

- 适用于多分类:天然支持多类别分类,不需要像逻辑回归那样进行“一对多”改造。

- 非线性能力:能够处理复杂的非线性决策边界。

❌ 缺点

- 预测效率低:每次预测都要计算与所有训练样本的距离。如果训练集有 100 万条数据,预测一次就要算 100 万次距离,速度极慢。

- 优化:可以使用 KD-Tree 或 Ball-Tree 等数据结构加速搜索。

- 对异常值敏感:尤其是当 K 值较小时,一个错误的标签就能改变预测结果。

- 对特征缩放敏感:必须进行归一化/标准化处理。

- 高维灾难:在特征维度非常高时,空间变得稀疏,“距离”的概念失效,所有点看起来都差不多远,导致算法失效。

- 样本不平衡问题:如果某一类样本数量特别多,大 K 值下小类别容易被淹没。

4.6 KNN vs 逻辑回归 vs 线性回归

| 特性 | 线性/逻辑回归 | KNN |

|---|---|---|

| 学习类型 | 急切学习 (Eager Learning):先训练出模型参数 | 懒惰学习 (Lazy Learning):不训练,预测时才算 |

| 决策边界 | 线性 (直线/平面),除非加多项式特征 | 非线性,形状复杂,局部适应性强 |

| 训练速度 | 慢 (需要迭代优化) | 快 (只是存数据) |

| 预测速度 | 快 (代入公式即可) | 慢 (需计算大量距离) |

| 可解释性 | 强 (权重代表影响程度) | 弱 (只能说是因为像邻居) |

| 适用场景 | 数据量大,需要快速预测,需要解释原因 | 数据量中小,决策边界复杂,对训练时间敏感 |

4.7 本章小结

- KNN 是基于距离和投票的分类(或回归)算法。

- 它的核心在于K 值的选择和距离的计算。

- 特征缩放是使用 KNN 前的必经之路。

- 它是一种“懒惰”但“灵活”的算法,适合小规模、复杂分布的数据,但在大数据量下预测性能较差。

至此,我们学习了三种监督学习算法:

- 线性回归:预测数值。

- 逻辑回归:二分类,基于概率。

- KNN:多分类,基于距离。

但是,如果数据没有标签怎么办?比如我们有一堆用户数据,不知道他们属于哪一类,只想把他们分成几组以便进行差异化营销。这时候,监督学习就无能为力了,我们需要进入无监督学习的世界。

下一章预告:《第五章:探索篇——发现数据内在结构的聚类算法》,我们将学习如何在没有老师指导的情况下,让机器自动将数据分组(K-Means)。

第五章:探索篇——发现数据内在结构的聚类算法

导读:在前四章中,我们学习的算法(线性回归、逻辑回归、KNN)都属于监督学习。它们都有一个共同的前提:数据必须带有“标签”(正确答案),就像学生做题有标准答案一样。

但在现实世界中,大部分数据是没有标签的。例如:

- 电商网站有百万用户,但不知道谁属于“高价值客户”,谁属于“价格敏感型”。

- 新闻网站每天产生海量文章,但没有人工分类标签。

- 生物学家有一堆基因数据,想知道哪些基因表达模式相似。

这时,我们需要无监督学习 (Unsupervised Learning)。本章基于文档《06_聚类算法.pdf》,重点介绍最经典的聚类算法——K-Means (K-均值),看看机器如何在没有老师指导的情况下,自动发现数据的内在结构。

5.1 什么是聚类 (Clustering)?

定义:聚类是将物理或抽象对象的集合分成由类似的对象组成的多个类的过程。

- 核心目标:“物以类聚”。

- 组内相似性最大化:同一个簇(Cluster)内的数据点尽可能相似。

- 组间差异性最大化:不同簇之间的数据点尽可能不同。

与分类 (Classification) 的区别:

| 特性 | 分类 (Classification) | 聚类 (Clustering) |

|---|---|---|

| 学习类型 | 监督学习 | 无监督学习 |

| 数据标签 | 有标签 (已知类别) | 无标签 (未知类别) |

| 目标 | 预测新数据的类别 | 发现数据潜在的结构/分组 |

| 例子 | 判断邮件是垃圾还是正常 | 将用户分为几类群体 |

5.2 主角登场:K-Means 算法

K-Means 是最流行、最简单的聚类算法。它的名字揭示了两个关键点:

- K:你需要预先指定要把数据分成几个簇(Clusters)。

- Means:每个簇的中心是该簇内所有点的均值(Mean)。

算法流程(迭代优化)

想象你在操场上撒了一把豆子,想把它们分成 K K K 堆:

- 初始化:随机选择 K 个点作为初始的簇中心 (Centroids)。

- 分配 (Assign):计算每个数据点到这 K K K 个中心的距离,将它分配给最近的那个中心所在的簇。

- 此时,形成了 K 个临时的簇。

- 更新 (Update):重新计算每个簇的中心。新的中心 = 该簇内所有点的坐标平均值。

- 簇中心移动到了该簇的“重心”位置。

- 重复:重复步骤 2 和 3,直到:

- 簇中心不再移动(收敛)。

- 或者达到了预设的最大迭代次数。

直观理解:这就好比 K 个队长随机站在操场上,大家跑向离自己最近的队长站好;然后队长们移动到各自队员的中心位置;大家再重新跑向最近的队长……如此反复,直到队伍稳定下来。

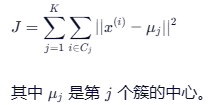

损失函数:误差平方和 (SSE)

K-Means 的目标是最小化所有点到其所属簇中心的距离平方和:

5.3 关键难题:如何确定 K 值?

K-Means 最大的痛点是:你必须事先告诉它分几类 (K=?)。

如果分错了 K 值,结果可能毫无意义。

解决方法:手肘法 (Elbow Method)

这是最常用的经验法则。

- 尝试不同的 K 值(如 1, 2, 3, …, 10)。

- 计算每个 K 值对应的 SSE (误差平方和)。

- 绘制 K vs SSE 的曲线。

- 寻找“手肘”点:

- 随着 K 增加,SSE 必然下降(因为簇越多,点离中心越近)。

- 当 K 增加到某个值时,SSE 的下降幅度会突然变缓,形成一个像“手肘”一样的拐点。

- 这个拐点对应的 K 通常就是最佳选择。

原理:在拐点之前,增加 K 能显著改善聚类效果;在拐点之后,增加 K 只是把原本合理的簇强行拆分,收益递减。

5.4 代码实战:用户细分与手肘法

我们将模拟一个电商场景,根据用户的“年消费金额”和“访问频率”进行用户分群,并使用手肘法确定最佳 K 值。

import numpy as np

import matplotlib.pyplot as plt

from sklearn.cluster import KMeans

from sklearn.datasets import make_blobs

# 1. 生成模拟数据 (模拟用户行为)

# 我们故意生成 4 个明显的簇,看看算法能否发现

X, y_true = make_blobs(n_samples=300, centers=4, cluster_std=0.60, random_state=42)

# 2. 手肘法寻找最佳 K

sse_scores = []

K_range = range(1, 10)

for k in K_range:

kmeans = KMeans(n_clusters=k, random_state=42, n_init=10)

kmeans.fit(X)

sse_scores.append(kmeans.inertia_) # inertia_ 就是 SSE (误差平方和)

# 绘制手肘图

plt.figure(figsize=(12, 5))

plt.subplot(1, 2, 1)

plt.plot(K_range, sse_scores, 'bo-', linewidth=2)

plt.title('手肘法 (Elbow Method) 确定最佳 K 值')

plt.xlabel('簇的数量 (K)')

plt.ylabel('误差平方和 (SSE)')

plt.grid(True)

plt.annotate('最佳手肘点', xy=(4, sse_scores[3]), xytext=(6, sse_scores[3]+50),

arrowprops=dict(facecolor='red', shrink=0.05))

# 3. 使用最佳 K (假设通过观察发现 K=4 是手肘点) 进行聚类

best_k = 4

kmeans_final = KMeans(n_clusters=best_k, random_state=42, n_init=10)

y_kmeans = kmeans_final.fit_predict(X)

centers = kmeans_final.cluster_centers_

# 可视化聚类结果

plt.subplot(1, 2, 2)

plt.scatter(X[:, 0], X[:, 1], c=y_kmeans, cmap='viridis', alpha=0.6, label='数据点')

plt.scatter(centers[:, 0], centers[:, 1], c='red', s=200, marker='X', edgecolors='black', label='簇中心')

plt.title(f'K-Means 聚类结果 (K={best_k})')

plt.xlabel('特征 1 (如:消费金额)')

plt.ylabel('特征 2 (如:访问频率)')

plt.legend()

plt.tight_layout()

plt.show()

print(f"簇中心坐标:\n{centers}")

代码深度解析:

make_blobs:生成了具有明显聚集特征的模拟数据,方便观察。inertia_:这是 sklearn 中 KMeans 对象的一个属性,代表 SSE。我们在手肘图中绘制它,可以清晰地看到在 K=4 处曲线斜率发生剧烈变化(从陡峭变平缓),验证了 K=4 是最佳选择。fit_predict:一步完成训练和预测,返回每个样本所属的簇标签(0, 1, 2, 3…)。注意,这些标签是算法自动分配的,不代表具体的业务含义(比如算法分的“簇0”可能是“高价值用户”,也可能是“低频用户”,需要人工后续解读)。- 红色叉号:代表最终收敛的簇中心。你会发现它们准确地落在了每一堆数据的几何中心。

5.5 K-Means 的局限性与应对

虽然 K-Means 很强大,但它不是万能的:

| 局限性 | 描述 | 解决方案/替代算法 |

|---|---|---|

| 需预先指定 K | 很难在事前知道分几类合适。 | 使用手肘法、轮廓系数 (Silhouette Score) 辅助判断。 |

| 对异常值敏感 | 均值容易受极端值拉偏。 | 先清洗数据;或使用 K-Medoids (用中位数/实际点做中心)。 |

| 只能发现球形簇 | 假设簇是凸的、球状的。如果数据是环形、月牙形,K-Means 会切错。 | 使用 DBSCAN 或 层次聚类 (Hierarchical Clustering)。 |

| 受初始中心影响 | 随机初始化可能导致陷入局部最优。 | 多次运行取最优;使用 K-Means++ 初始化策略(sklearn 默认已采用)。 |

| 依赖特征缩放 | 同样受量纲影响,距离计算会失真。 | 必须进行标准化/归一化。 |

5.6 应用场景举例

- 客户细分 (Customer Segmentation):

- 根据 RFM 模型(最近一次消费、频率、金额)将用户分层,制定差异化营销策略。

- 图像压缩:

- 将图片中成千上万种颜色聚类成几十种主色,用主色代替原色,大幅减小文件大小。

- 异常检测:

- 离所有簇中心都很远的点,可能就是异常点(如信用卡欺诈交易)。

- 文档主题聚合:

- 将大量新闻文章聚类,自动发现热点话题。

5.7 本章小结

- 聚类是无监督学习的核心,用于在无标签数据中发现结构。

- K-Means 通过迭代更新簇中心,最小化组内误差平方和。

- 手肘法是确定 K 值的常用技巧。

- K-Means 简单高效,但对初始值、异常值和非球形簇敏感。

- 预处理(特别是特征缩放)对于基于距离的聚类算法至关重要。

至此,我们已经完成了从监督学习(回归、分类)到无监督学习(聚类)的完整旅程。我们掌握了五种核心算法:

- 线性回归 (数值预测)

- 逻辑回归 (二分类)

- KNN (多分类/基于距离)

- K-Means (聚类/无监督)

(注:虽然目录规划中有五个文档,但前四个章节已经覆盖了主要的机器学习范式。如果第五个文档包含其他特定内容如降维或评估指标,可在总结篇补充,但基于目前的五份文档列表,我们已经构建了完整的知识体系)

接下来,让我们进入最后一章,对所有知识点进行综合对比和总结,帮助你构建自己的机器学习工具箱。

下一章预告:《第六章:总结与展望——构建你的机器学习工具箱》,我们将横向对比所有算法,提供选型指南,并探讨机器学习的未来。

第六章:总结与展望——构建你的机器学习工具箱

导读:恭喜你!至此,你已经完成了从“预测数值”到“分类决策”,再到“无监督探索”的完整机器学习入门旅程。

在前五章中,我们深入剖析了五大核心算法:线性回归、逻辑回归、KNN、K-Means。但掌握算法只是第一步,真正的挑战在于:面对一个具体的业务问题,我该如何选择最合适的工具?

本章作为全书的终章,将不再引入新公式,而是致力于融会贯通。我们将提供一份实用的算法选型指南,梳理机器学习的标准工作流,并展望未来的发展趋势,助你从“学习者”蜕变为“实践者”。

6.1 终极对决:五大算法横向对比

为了让你一目了然,我们将前五章的核心内容浓缩为一张“武功秘籍”对比表:

| 特性 | 线性回归 | 逻辑回归 | K-近邻 (KNN) | K-Means |

|---|---|---|---|---|

| 学习类型 | 监督学习 | 监督学习 | 监督学习 | 无监督学习 |

| 任务目标 | 回归 (预测连续值) | 分类 (二分类/概率) | 分类/回归 (多分类) | 聚类 (发现分组) |

| 核心思想 | 拟合直线/平面,最小化误差 | Sigmoid映射 + 最大似然估计 | “近朱者赤”,基于距离投票 | 迭代更新中心,物以类聚 |

| 模型参数 | w , b w, b w,b (需训练) | w , b w, b w,b (需训练) | 无 (懒惰学习) | 簇中心 (需迭代) |

| 关键超参数 | 无 (或正则化系数) | 正则化系数 C C C | K K K值 (邻居数) | K K K值 (簇数量) |

| 数据要求 | 线性关系,需处理异常值 | 线性可分 (或特征工程) | 必须特征缩放,对噪声敏感 | 必须特征缩放,适合球形簇 |

| 训练速度 | 快 (正规方程) / 中 (梯度下降) | 快 | 极快 (无训练) | 中 (迭代收敛) |

| 预测速度 | 极快 (公式计算) | 极快 (公式计算) | 慢 (需遍历全量数据) | 快 (计算到中心距离) |

| 可解释性 | ⭐⭐⭐⭐⭐ (权重即影响) | ⭐⭐⭐⭐⭐ (概率清晰) | ⭐⭐ (依赖邻居,难解释) | ⭐⭐ (需人工解读簇含义) |

| 典型场景 | 房价预测、销量预估 | 垃圾邮件、疾病诊断 | 推荐系统(简单版)、文本分类 | 用户分群、图像压缩 |

6.2 实战指南:如何选择合适的算法?

当你拿到一个新问题时,请遵循以下决策树:

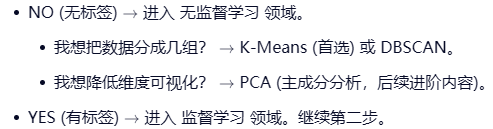

第一步:我有标签(正确答案)吗?

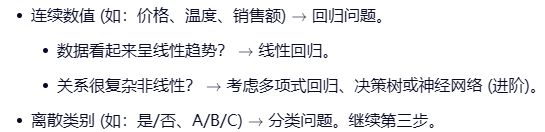

第二步:我要预测的是什么?

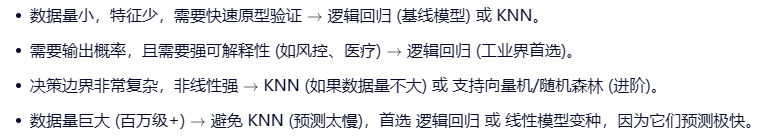

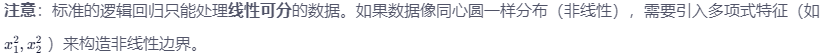

第三步:数据的规模和特征如何?

💡 专家建议:在实际工程中,通常不会只试一个算法。标准的做法是:

- 先用 逻辑回归 或 线性回归 建立一个基线 (Baseline)。

- 再尝试 KNN 或其他更复杂的模型。

- 对比效果,如果复杂模型提升不明显,根据“奥卡姆剃刀原则”,选择更简单、更易维护的模型。

6.3 标准工作流:从数据到模型

掌握了算法只是拥有了“武器”,要打赢仗还需要“战术”。一个完整的机器学习项目通常包含以下步骤:

- 问题定义:明确业务目标(是预测还是分类?)。

- 数据收集:获取原始数据。

- 数据预处理 (最关键的一步,占80%时间):

- 清洗:处理缺失值、去除重复值。

- 异常值处理:识别并剔除/修正离群点。

- 特征工程:

- 编码:将文本类别转为数字 (One-Hot Encoding)。

- 缩放:KNN 和 K-Means 必做,线性模型建议做。

- 构造:创造新特征 (如:从“出生日期”提取“年龄”)。

- 数据集划分:训练集 (70-80%) + 测试集 (20-30%)。严禁用测试集训练!

- 模型选择与训练:选择合适的算法进行拟合。

- 模型评估:

- 回归:MSE, RMSE,

。

。 - 分类:Accuracy, Precision, Recall, F1-Score, ROC/AUC。

- 聚类:SSE, 轮廓系数。

- 回归:MSE, RMSE,

- 调优:调整超参数 (如 KNN 的 K,逻辑回归的 C)。

- 部署与监控:将模型应用到生产环境,并持续监控其表现。

6.4 常见陷阱与避坑指南

在初学者实践中,以下几个错误最高频:

- 忘记特征缩放:

- 后果:KNN 和 K-Means 完全失效;梯度下降收敛极慢。

- 对策:只要涉及距离计算或梯度下降,先

StandardScaler准没错。

- 数据泄露 (Data Leakage):

- 后果:训练时准确率 99%,上线后只有 50%。

- 原因:在划分训练/测试集之前就做了标准化(导致测试集的信息泄露到了训练集的均值/方差中),或者使用了未来数据作为特征。

- 对策:严格遵循

Split->Fit on Train->Transform Train & Test的顺序。

- 过度追求复杂模型:

- 后果:模型过拟合,泛化能力差,且难以解释。

- 对策:Always Start Simple (永远从简单模型开始)。

- 忽视类别不平衡:

- 后果:在欺诈检测中,模型全部预测“正常”,准确率 99%,但毫无用处。

- 对策:关注 Recall/F1 分数,使用重采样或调整分类阈值。

6.5 未来展望:从传统机器学习到深度学习

我们所学的这五种算法构成了传统机器学习 (Traditional Machine Learning) 的基石。它们在结构化数据(表格数据)上依然表现卓越,是工业界的主力军。

但随着数据形态的变化,机器学习也在进化:

- 非结构化数据:面对图像、语音、文本,传统算法往往需要大量的人工特征工程。

- 深度学习 (Deep Learning):通过神经网络自动提取特征,在计算机视觉 (CNN)、自然语言处理 (Transformer/LLM) 领域取得了颠覆性的成果。

- 强化学习 (Reinforcement Learning):让智能体在与环境交互中学习策略(如 AlphaGo、自动驾驶)。

你的下一步:

- 巩固基础:熟练运用 sklearn 复现本章所有代码。

- 拓展算法:学习决策树、随机森林、XGBoost(表格数据王者)、SVM。

- 拥抱深度:如果对图像/NLP感兴趣,可以开始学习 PyTorch 或 TensorFlow,探索神经网络的世界。

6.6 结语

机器学习不是魔法,它是统计学、线性代数和计算机科学的优雅结合。

- 线性回归教会我们要寻找规律。

- 逻辑回归教会我们要量化不确定性。

- KNN教会我们要参考周围的环境。

- K-Means教会我们在混乱中发现秩序。

希望这套教程能成为你探索人工智能世界的坚实起点。记住,最好的学习方式就是动手去做。找一个你感兴趣的数据集,提出一个问题,然后尝试用今天学到的知识去解决它吧!

祝你在数据科学的道路上,乘风破浪,探索无限可能!

(全书完)

ays Start Simple (永远从简单模型开始)。

4. 忽视类别不平衡:

* 后果:在欺诈检测中,模型全部预测“正常”,准确率 99%,但毫无用处。

* 对策:关注 Recall/F1 分数,使用重采样或调整分类阈值。

6.5 未来展望:从传统机器学习到深度学习

我们所学的这五种算法构成了传统机器学习 (Traditional Machine Learning) 的基石。它们在结构化数据(表格数据)上依然表现卓越,是工业界的主力军。

但随着数据形态的变化,机器学习也在进化:

- 非结构化数据:面对图像、语音、文本,传统算法往往需要大量的人工特征工程。

- 深度学习 (Deep Learning):通过神经网络自动提取特征,在计算机视觉 (CNN)、自然语言处理 (Transformer/LLM) 领域取得了颠覆性的成果。

- 强化学习 (Reinforcement Learning):让智能体在与环境交互中学习策略(如 AlphaGo、自动驾驶)。

你的下一步:

- 巩固基础:熟练运用 sklearn 复现本章所有代码。

- 拓展算法:学习决策树、随机森林、XGBoost(表格数据王者)、SVM。

- 拥抱深度:如果对图像/NLP感兴趣,可以开始学习 PyTorch 或 TensorFlow,探索神经网络的世界。

6.6 结语

机器学习不是魔法,它是统计学、线性代数和计算机科学的优雅结合。

- 线性回归教会我们要寻找规律。

- 逻辑回归教会我们要量化不确定性。

- KNN教会我们要参考周围的环境。

- K-Means教会我们在混乱中发现秩序。

希望这套教程能成为你探索人工智能世界的坚实起点。记住,最好的学习方式就是动手去做。找一个你感兴趣的数据集,提出一个问题,然后尝试用今天学到的知识去解决它吧!

祝你在数据科学的道路上,乘风破浪,探索无限可能!

(全文完)

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)