参数少、跑得快、还能离线?带你读懂AI界的小宠物:小型语言模型

当整个科技界都在为数千亿甚至万亿参数的大型语言模型(LLM)狂欢时,一股“反向操作”的暗流正在涌动。算力成本的飙升、数据隐私的担忧以及边缘计算的崛起,让各大AI巨头开始将目光转向另一个战场——小型语言模型(SLM, Small Language Models)。

越大的模型真的越好吗?今天,我们就来硬核科普一下,什么是SLM,它是如何炼成的,以及它为什么代表着AI的未来走向。

01. 什么是小型语言模型(SLM)?

顾名思义,小型语言模型(SLM)在规模和参数量上远小于我们在云端常用的LLM。

如果说LLM(如GPT-4)是拥有数千亿甚至万亿参数的“重型装甲车”,那么SLM则是参数量在几百万到几百亿之间的“轻型超跑”。参数(权重和偏差)是模型在训练中学习到的内部变量,直接决定了模型的行为能力。

由于身形小巧,SLM对内存和算力的要求大幅降低。这让它成为了资源受限环境(如边缘设备、智能手机、IoT设备)的完美搭档。更重要的是,它能在完全断网的离线状态下,完成高质量的AI推理(生成响应)。

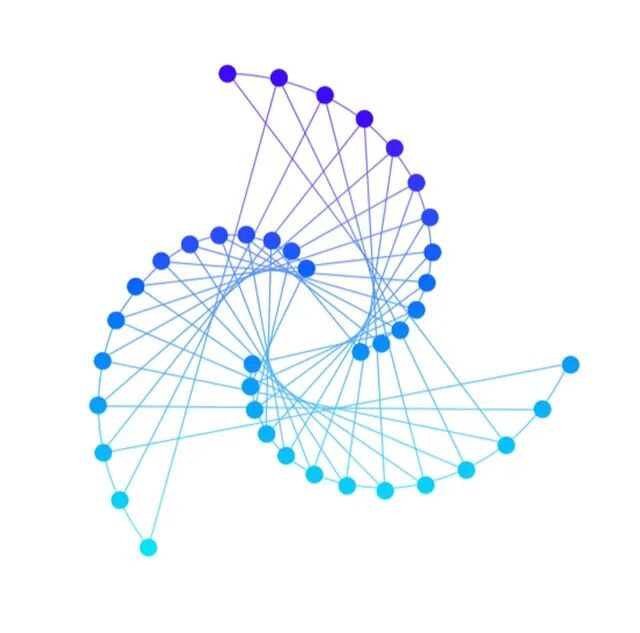

底层逻辑:与LLM一脉相承的Transformer架构

别看SLM体积小,它的“基因”和LLM完全一样,依然基于强大的Transformer架构。如果你想了解它的工作原理,可以简单拆解为三步:

- 编码器(Encoder):

将输入的文字转化为“嵌入向量(Embeddings)”,捕捉词语的语义和上下文位置。

- 自注意力机制(Self-Attention):

赋予模型“抓重点”的能力,让它能在长句子中准确识别出最关键的信息点。

- 解码器(Decoder):

结合上述信息,通过概率统计生成最合理的输出序列。

02. 给模型“瘦身”的四大黑科技

如何把一个庞然大物塞进手机芯片里,同时还能保持聪慧?AI工程师们使用了被称为**模型压缩(Model Compression)**的硬核技术。以下是四种最常用的“瘦身秘籍”:

- 修剪(Pruning):AI界的“断舍离”

直接从神经网络中剔除不重要、冗余的参数。通常会将权重接近于0的连接直接切断。修剪后的模型需要进行一次微调(Fine-tuning)来弥补精度的流失。考验技术的地方在于“火候”,过度修剪会导致模型变傻。

- 量化(Quantization):精度降维打击

将高精度的数据转化为低精度数据。比如,把模型中32位浮点数(FP32)压缩成8位整数(INT8)。这就好比把一张4K高清图压缩成1080P,虽然丢失了极其微小的细节,但体积骤降,计算和推理速度呈指数级提升。目前主流分为训练后量化(PTQ)和量化感知训练(QAT)。

- 低秩分解(Low-Rank Factorization):矩阵魔法

通过数学手段,将庞大的权重矩阵拆解为多个较小的低秩矩阵的乘积。这能大幅简化复杂的矩阵运算,降低计算量。

- 知识蒸馏(Knowledge Distillation):师徒传承

这是目前最流行的做法。找一个庞大聪明的“教师模型”(如GPT-4),让一个小巧的“学生模型”去模仿它的输出甚至底层推理逻辑。最终,大模型的智慧被“蒸馏”并浓缩到了小模型中。

03. 百花争艳:主流SLM大盘点

虽然超大模型依然是各大厂的门面,但SLM赛道早已神仙打架。以下是目前市面上最受瞩目的明星选手:

- Meta|Llama 3.2:

专为端侧打造,提供1B和3B(10亿/30亿)版本,比前代更小,速度提升2-3倍,量化后可轻松塞入移动设备。

- Google|Gemma & DistilBERT:

DistilBERT是经典的鼻祖,比原版BERT小40%但保留了97%的能力。而Gemma系列则直接继承了Gemini的超强基因,提供2B、7B等规格。其Gemini Nano版更是直接瞄准了手机端。

- OpenAI|GPT-4o mini:

取代了GPT-3.5的“性价比之王”。不仅支持多模态(图文双修),在各类基准测试中表现甚至逼近老大哥GPT-4o。

- Microsoft|Phi 系列:

微软的王牌小模型。Phi-3-mini(38亿参数)凭借超长上下文窗口,展现出了惊人的逻辑分析能力。

- Mistral|Ministral 系列:

来自欧洲的AI黑马。其8B模型引入了滑动窗口注意力机制(Sliding Window Attention),能在推理时动态聚焦固定大小的内容,极大提升了响应速度。

- IBM|Granite 3.0:

面向企业级市场的利器。引入了混合专家架构(MoE),不仅在RAG(检索增强生成)任务中表现优异,还能作为AI Agent调用外部工具。

04. “大+小”混合架构:更聪明的系统设计

在实际的商业落地中,最顶级的架构往往不是非此即彼,而是“大小协同”:

- 智能路由(Intelligent Routing):

杀鸡焉用牛刀?在网关层部署一个路由模块,简单的日常请求(如总结文本)交给本地的SLM处理;遇到需要庞大知识库的复杂难题,再调用云端的LLM。

- 混合AI模式(Hybrid AI):

终端设备和云端大脑实时协同,兼顾了响应速度与算力上限。

05. 为什么企业越来越偏爱SLM?

相比动辄烧掉千万美元的大模型,SLM展现出了令人无法拒绝的优势:

- 极速响应(低延迟):

像Granite 3.0 3B模型,推理时激活参数极少,几乎能做到“秒回”,非常适合实时交互。

- 极致的隐私与安全:

可以在企业内网或本地设备(如PC、手机)上私有化部署。数据不出域,这对金融、医疗等敏感行业具有致命吸引力。

- 降本增效:

无需购买昂贵的GPU集群,训练、微调和运行的成本呈断崖式下降。

- 绿色环保:

算力消耗低,碳足迹大幅减少,符合企业的可持续发展战略。

当然,SLM并非完美无缺。由于知识库有限,它们在处理需要海量世界知识的复杂任务时容易出现“幻觉”;同时,它们对特定场景更为依赖,泛化能力弱于大型模型。

06. SLM的典型落地场景

那么,SLM到底能用来干什么?

- 端侧AI助手与内容摘要:

比如手机上的Llama 3.2或Gemini Nano,可以离线帮你总结会议录音、提取核心待办事项。

- 本地代码生成:

使用专门微调的Code SLM(如Granite代码模型),在本地IDE中快速生成、翻译和纠错代码。

- 物联网(IoT)与预测性维护:

部署在工厂传感器上,实时分析设备数据,在断网状态下也能提前预警机器故障。

- 智能车载导航:

结合多模态能力,在车机本地运行,快速识别路况障碍物并检索交通法规,辅助安全驾驶。

- 情感分析与智能客服:

以外挂知识库(RAG)的形式,为企业提供低延迟、高精准的客服答疑和用户情绪分析。

写在最后

在人工智能的发展史中,“Scale(规模)”曾是唯一的真理。但如今,小型语言模型的爆发让我们看到了一条更加务实、高效、无处不在的AI普及之路。

未来,属于能在云端呼风唤雨的大模型,更属于能装进每个人口袋、运行在每台设备里的小模型。

更多transformer,VIT,swin tranformer

参考头条号:人工智能研究所

v号:人工智能研究Suo, 启示AI科技动画详解transformer 在线视频教程

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献19条内容

已为社区贡献19条内容

所有评论(0)