一文详解几种常见本地大模型个人知识库工具部署、微调及对比选型

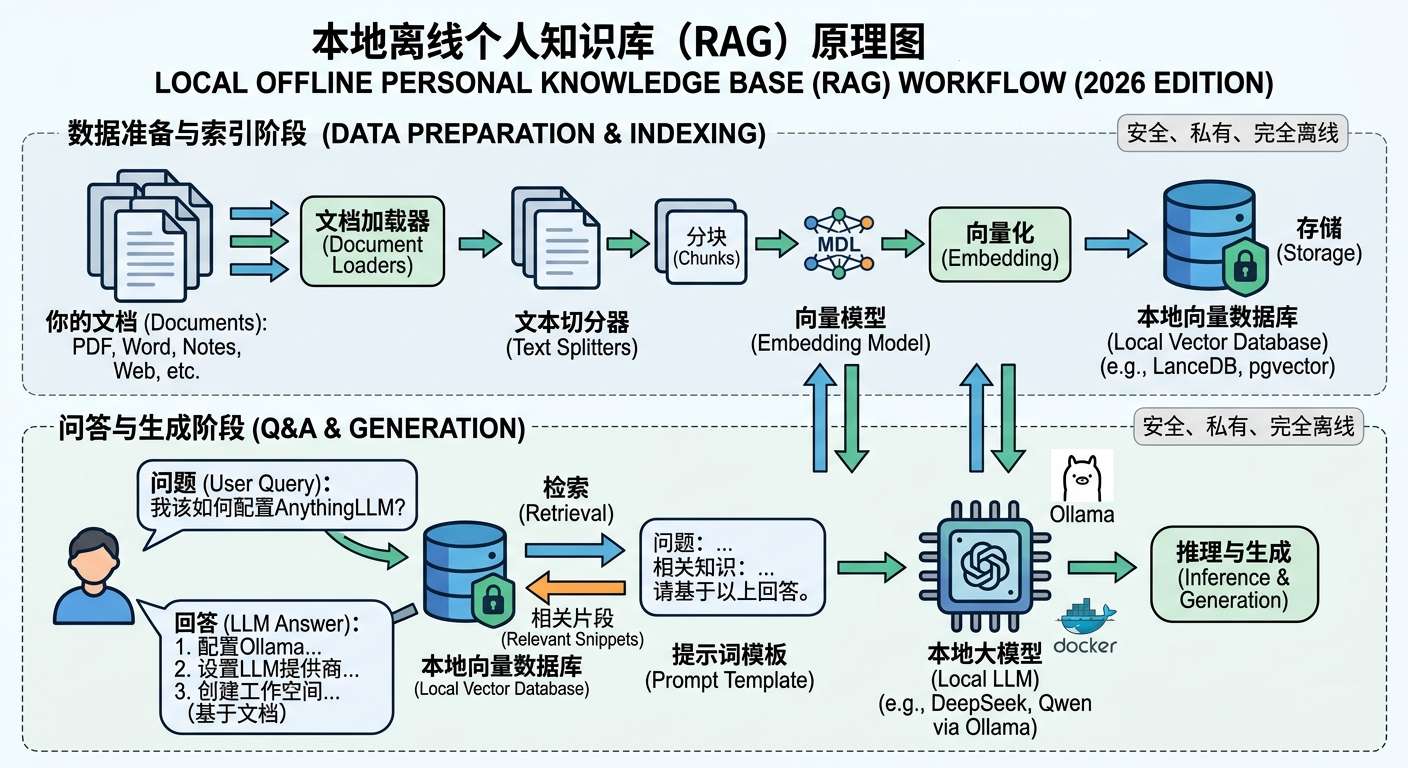

随着本地大模型(如DeepSeek、Qwen、Llama系列)的成熟,越来越多用户希望打造完全离线、私有、安全的个人知识库(Personal Knowledge Base)。核心技术是 RAG(Retrieval-Augmented Generation,检索增强生成):把你的PDF、Word、笔记等文档向量化后,让本地LLM基于真实资料回答问题,避免“幻觉”。

本文聚焦个人/小型团队场景,详解最常见的5款开源知识库工具(AnythingLLM、Open WebUI、Dify、RAGFlow、MaxKB)的部署、本地LLM集成、RAG功能,并统一说明微调方法,最后给出对比选型表格和推荐。

一、大模型侧基础:强烈推荐 Ollama(几乎所有工具都首选它)

Ollama 是本地大模型的“神器”,一行命令就能运行 DeepSeek-R1、Qwen3、Llama3.2 等模型,支持 GPU 自动加速,完全离线。

部署(全平台通用):

- 官网下载安装(Windows/Mac/Linux 均有安装包)。

- 终端运行:

ollama run qwen2.5:14b # 或 deepseek-r1:8b(推荐中文强)

- 服务模式(供 WebUI 调用):

ollama serve(默认端口 11434)。

注意:若需供 Docker 工具调用,安装后请确保环境变量 OLLAMA_HOST 设置为 0.0.0.0,否则容器内无法访问宿主机的 11434 端口。

进阶:用 Modelfile 简单定制人格(非完整微调):

FROM qwen2.5:14b

SYSTEM 你是我的私人知识助理,回答必须基于我上传的文档。

然后 ollama create my-assistant -f Modelfile。

其他备选:LM Studio(可视化界面更好)、LocalAI(OpenAI API 兼容)。

二、5款主流知识库工具详解(全部支持 Docker 一键部署)

以下工具均支持 Ollama 作为后端,实现 100% 本地运行。

1. AnythingLLM(最适合新手,桌面版秒上手)

定位:全栈隐私优先 RAG 应用,拖拽即用,像私人 ChatGPT。

部署:

- 最简单:官网下载 Desktop 版(Windows/Mac/Linux 一键安装)。

- Docker:

docker run -d -p 3001:3001 mintplexlabs/anythingllm。 - 访问 http://localhost:3001。

本地模型集成:设置 → LLM Provider 选 “Ollama”,若使用桌面版 Ollama + Docker 版 AnythingLLM,地址填 http://host.docker.internal:11434 (Windows/Mac) 或 http://172.17.0.1:11434 (Linux)。

RAG 功能:

- 支持 PDF、DOCX、TXT、网页、YouTube 等几乎所有格式。

- 内置 LanceDB(默认)或 Chroma/Pinecone 等向量库。

- 多工作空间(Workspace)隔离文档,拖拽上传 + 自动分块向量化。

- 支持多模态 + 自定义 Agent(无代码构建)。

其他:Docker 版支持多用户权限;内置 API。

微调支持:无内置,但可加载你自己微调后的 Ollama 模型。

适用人群:个人用户、零基础小白。

2. Open WebUI(聊天界面最强 + 强大 RAG)

定位:Ollama 原生 WebUI,前身 Ollama WebUI,现在是全能离线 AI 平台。

部署:

- Docker(推荐):

docker run -d -p 8080:8080 --add-host=host.docker.internal:host-gateway -v open-webui:/app/backend/data ghcr.io/open-webui/open-webui:ollama(自带 Ollama)。 - 或

pip install open-webui && open-webui serve。

本地模型集成:自动检测本地 Ollama,一键切换模型。

RAG 功能:

- 文档库 + 聊天中直接 #上传文档。

- 支持 9 种向量库(Chroma、PGVector、Qdrant 等),多种解析引擎(Tika、Docling)。

- 网页搜索、语音输入输出、图像生成全支持。

- 模型构建器(Model Builder):Web UI 直接创建自定义 Ollama 模型。

其他:RBAC 多用户 + SSO、企业认证;PWA 手机端友好。

微调支持:内置模型构建器,可直接导入 LoRA 微调模型。

适用人群:喜欢 ChatGPT 式交互、需要语音/图像的用户。

3. Dify(可视化工作流 + Agent 最强)

定位:生产级 LLM 应用平台,低代码搭建知识库 + Agent。

部署:

- Docker Compose(推荐):

cd dify/docker

cp .env.example .env

docker compose up -d

- 访问 http://localhost/install 初始化。

本地模型集成:模型提供商选 Ollama,填地址即可;支持数百种开源模型。

RAG 功能:

- 上传 PDF/PPT 等,自动提取 + 分块。

- 可视化画布构建 RAG Pipeline + Agent(50+ 工具)。

- 支持多数据集、多知识库。

其他:Prompt IDE、LLMOps 监控、Backend-as-a-Service API。

硬件:最低 2 核 4GB(推荐 8GB+)。

微调支持:通过数据集迭代优化提示词/模型表现(间接)。

适用人群:想做复杂 Agent 或企业内部工具的用户。

4. RAGFlow(复杂文档处理最强)

定位:深度文档理解 RAG 引擎,适合合同、报告等结构化文档。

部署:

- Docker:

docker compose -f docker-compose.yml up -d(官方镜像)。 - 最低硬件:4 核 16GB RAM + 50GB 磁盘。

本地模型集成:service_conf.yaml 配置 Ollama 或其他 OpenAI 兼容后端。

RAG 功能:

- 支持 Word、Excel、图片、扫描件、网页等。

- DeepDoc 模块实现“深度文档理解”(布局分析、表格提取远超普通工具)。

- Elasticsearch 向量库 + 多路召回 + 重排序。

- 可视化引用溯源。

其他:Agent 能力、API 集成。

微调支持:无内置。

适用人群:文档复杂(法律、金融、科研)的重度用户。

5. MaxKB(中文社区最友好,轻量企业级)

定位:基于 RAG 的知识库问答系统,可无缝嵌入第三方系统。

部署:

- Docker 一行命令:

docker run -d --name=maxkb -p 8080:8080 -v ~/.maxkb:/opt/maxkb 1panel/maxkb

- 默认账号:admin / MaxKB@123…(立即改密码)。

本地模型集成:系统设置 → 模型设置 → 添加 “Ollama”,填地址 + 模型名(支持 DeepSeek、Qwen 等)。

RAG 功能:

- 上传文档 + 自动爬取网页。

- 自动分块向量化(PostgreSQL + pgvector)。

- 多模态(文本/图像/音频/视频)支持。

- 内置工作流 + Agent 工具库。

其他:零代码嵌入业务系统,离线安装包友好(国内用户福音)。

微调支持:无内置。

适用人群:中文用户、想快速集成到网站/系统的个人或小团队。

三、微调(Fine-tuning)通用指南(所有工具通用)

RAG 已能解决 80% 需求,但如果你有大量领域专有数据(如公司内部文档、个人笔记),可以进一步微调模型让回答更精准。

推荐流程(2026 最简单方案):

- 准备数据集:从你的知识库导出 Q&A 对(JSONL 格式),或用 AnythingLLM/Dify 导出的对话记录。

- 微调工具(推荐):

- Unsloth(最快):支持 Qwen/Llama,LoRA 微调只需几小时,显存节省 70%。

- Llama-Factory(中文友好):Web UI 操作,GitHub 搜索即可。

- Axolotl(高级)。

- 示例命令(以 Unsloth 为例):

# 安装后运行脚本,指定 base_model = "qwen/qwen2.5-14b"

# 输出为 GGUF 格式

- 导入 Ollama:

ollama create my-finetuned-qwen -f Modelfile

然后在任意知识库工具中切换到 “my-finetuned-qwen” 模型。

注意:7B/14B 模型微调门槛低(16GB 显存即可),70B+ 需要企业级卡。个人建议先用 RAG + 系统提示词,效果已足够好。

四、对比选型表格(2026 年 3 月数据)

| 工具 | 部署难度 | 资源消耗 | 文档处理能力 | Agent/工作流 | 多用户支持 | 中文优化 | Stars(约) | 最佳场景 | 推荐指数 |

|---|---|---|---|---|---|---|---|---|---|

| AnythingLLM | ★☆☆☆☆(桌面版最易) | 低 | 优秀(多格式) | ★★★☆☆ | Docker 支持 | ★★★★☆ | 56k | 个人新手、隐私优先 | ★★★★★ |

| Open WebUI | ★★☆☆☆ | 中 | 优秀(9种向量库) | ★★★★☆ | 极强(RBAC+SSO) | ★★★★☆ | 127k | 聊天+多功能全家桶 | ★★★★★ |

| Dify | ★★☆☆☆ | 中低 | 良好 | ★★★★★ | 良好 | ★★★★★ | 132k | 复杂 Agent、可视化开发 | ★★★★★ |

| RAGFlow | ★★★☆☆ | 高(16GB+) | 顶级(深度理解) | ★★★★☆ | 基本 | ★★★★☆ | 74.7k | 合同/报告/复杂文档 | ★★★★☆ |

| MaxKB | ★☆☆☆☆(一行命令) | 中 | 良好(多模态) | ★★★★☆ | 基本 | ★★★★★ | 20.3k | 中文用户、快速嵌入业务 | ★★★★☆ |

选型推荐(按需求):

- 纯个人、想最快 5 分钟上手 → AnythingLLM Desktop + Ollama。

- 喜欢 ChatGPT 体验 + 语音图像 → Open WebUI。

- 要做智能助手/多步 Agent → Dify。

- 文档全是 PDF/表格/扫描件 → RAGFlow。

- 中文界面 + 想嵌入网站 → MaxKB。

- 硬件很弱(<16GB 内存) → AnythingLLM 或 Open WebUI。

硬件建议(2026 年):

- 入门:RTX 3060 6GB / 16GB 内存(跑 7B-14B 模型)。

- 进阶:RTX 4070+ / 32GB+(跑 32B+ 模型流畅)。

结语与进阶建议

本地知识库的核心是数据隐私 + 零成本 + 可控性。以上 5 款工具 + Ollama 组合,已能覆盖 95% 个人需求。建议先从 AnythingLLM 或 MaxKB 起步,跑通 RAG 后再尝试微调。

部署中遇到问题?欢迎评论区留言(常见坑:Docker 网络、端口冲突、向量库初始化)。数据安全第一,全部跑在本地,永不泄露!

需要的朋友可以直接复制 Docker 命令开始折腾,5 分钟后你就会拥有一个只属于自己的“超级大脑”。祝玩得开心!🚀

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献2条内容

已为社区贡献2条内容

所有评论(0)