AutoDL+Xshell+Xtfp+部署Qwen2.5-7B大模型

1.租一台GPU服务器(以AutoDL为例)

AutoDL是国内常用的GPU租用平台,按小时计费,对学生党比较友好。

1.1 注册账号

· 打开AutoDL官网(autodl.com)。AutoDL算力云 | 弹性、好用、省钱,GPU算力零售价格新标杆

· 点击右上角“注册”,用手机号注册。

· 注册后需要实名认证(上传身份证),认证通过后平台会送10元左右的优惠券,可以用来测试。也可以进行学生认证,会有些优惠。

1.2 租用实例

1. 登录后,在控制台点击“租用新实例”。

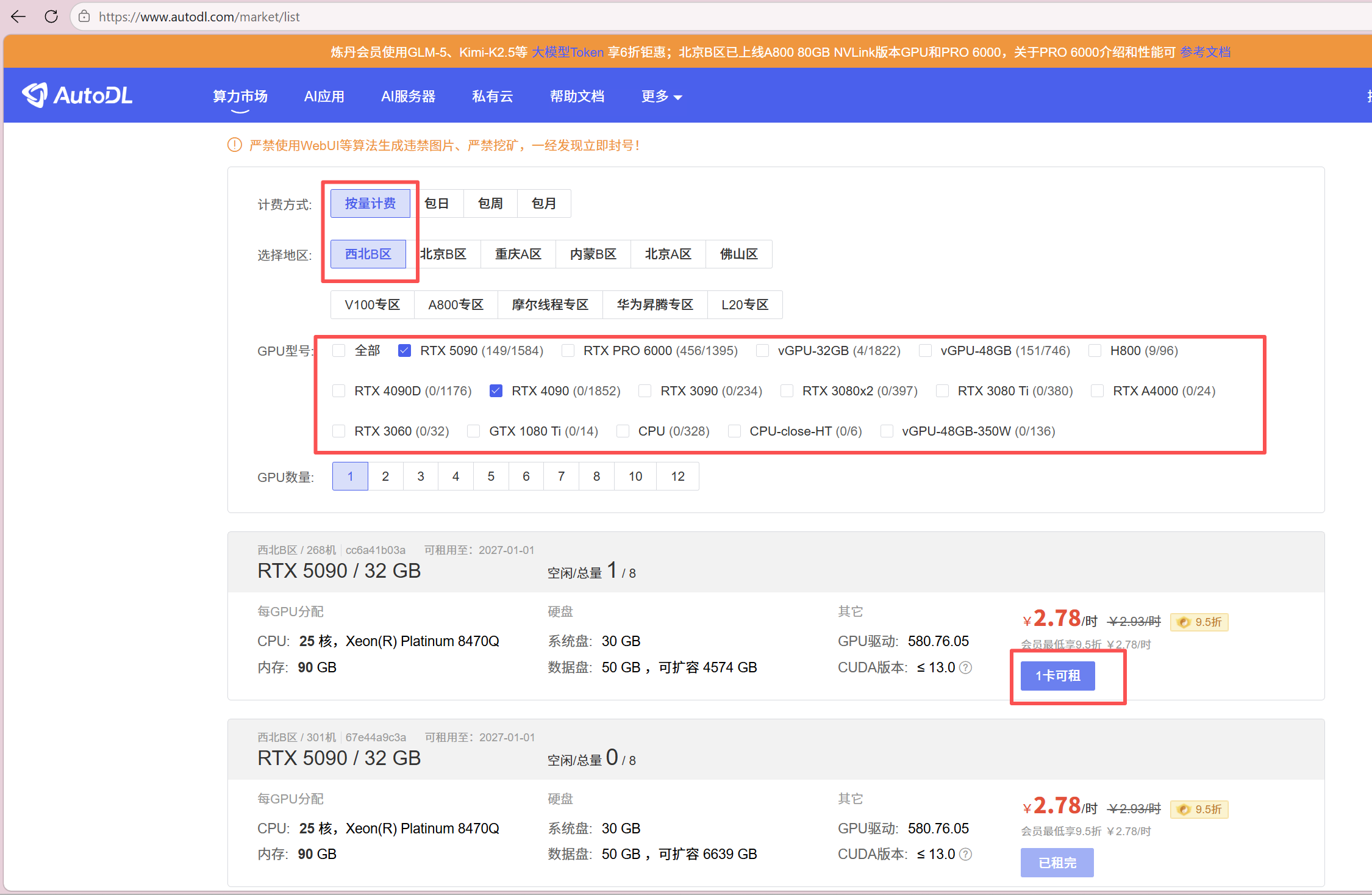

2. 选择计费方式:选“按量计费”(适合短期实验)。

3. 选择GPU型号:你的目标是跑Qwen2.5-7B,需要至少24GB显存的显卡,推荐:

· RTX 4090

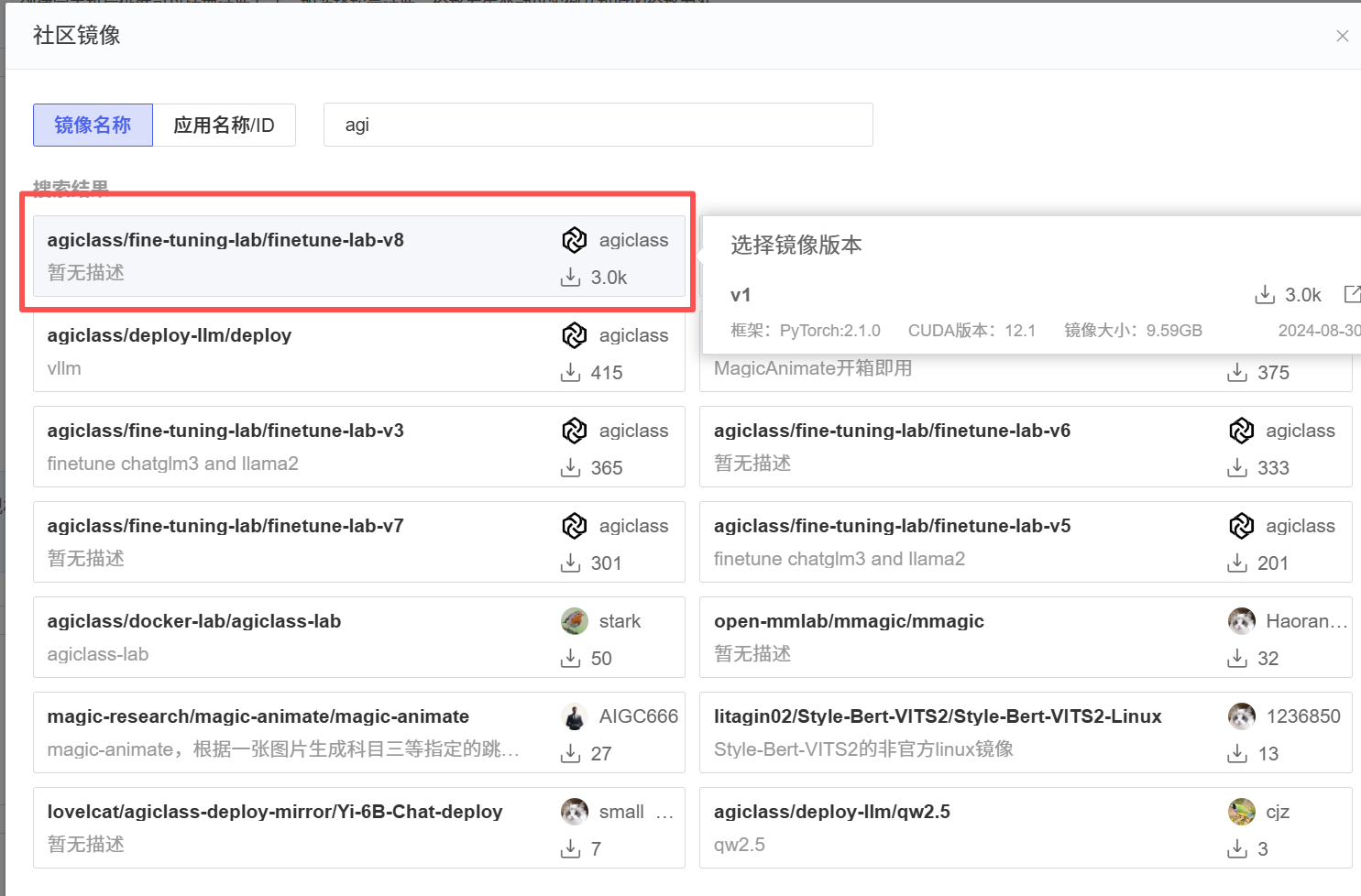

4. 选择镜像:这一步比较关键。在“社区镜像”一栏,搜索并选择:

1.3 开机后的界面

2.连接到服务器

你需要用SSH工具连接到这台远程服务器。

2.1 如果你用Windows系统

· 下载 Xshell 和Xtfp的软件(或者用系统自带的PowerShell也行,但Xshell更方便)。

下载链接:XShell免费版的安装配置教程以及使用教程(超级详细、保姆级)-CSDN博客

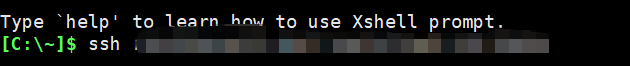

先复制Autodl实例里面你们的SSH登录下面的登录指令,例如

ssh -p ##### root@******************

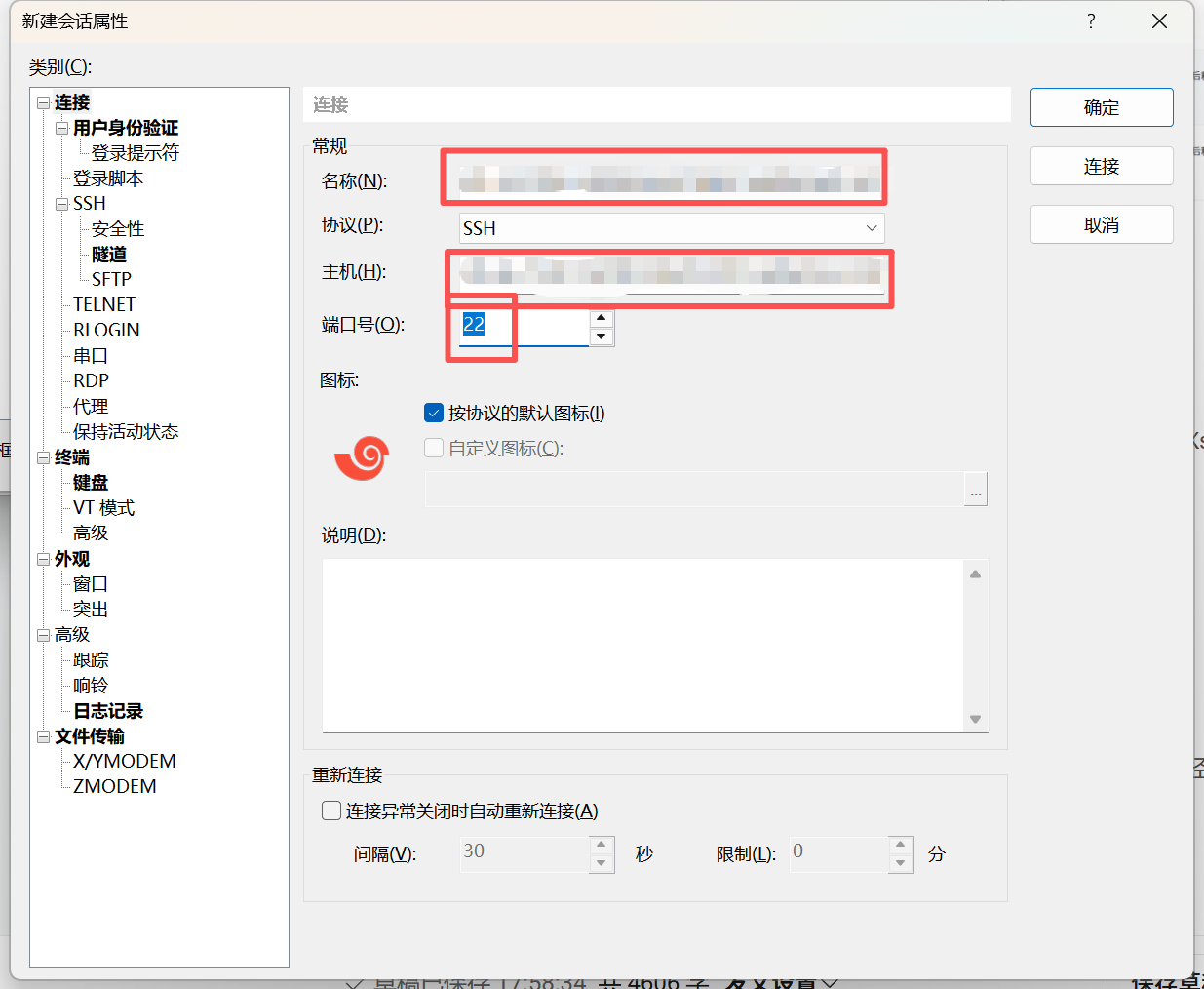

· 打开Xshell,点击“新建”:

· 名称:自己起一个

· 主机:root@******************

· 端口号:填写SSH端口(一般是22)

· 点击“连接”

· 第一次连接会弹出提示,点“接受”即可。

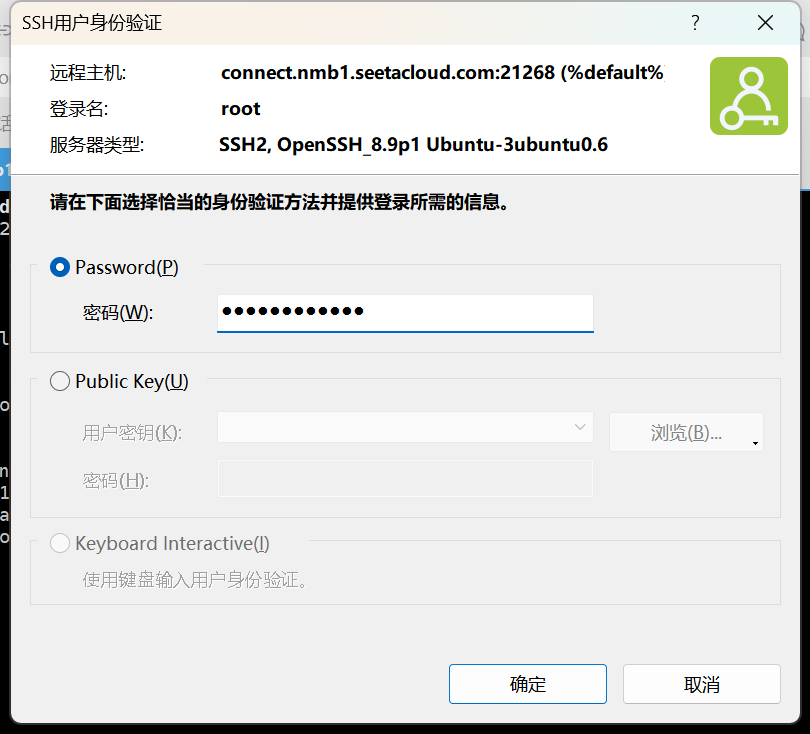

然后双击建立的链接,输入

ssh root@****************** #####

然后输入autodl里面的ssh密码

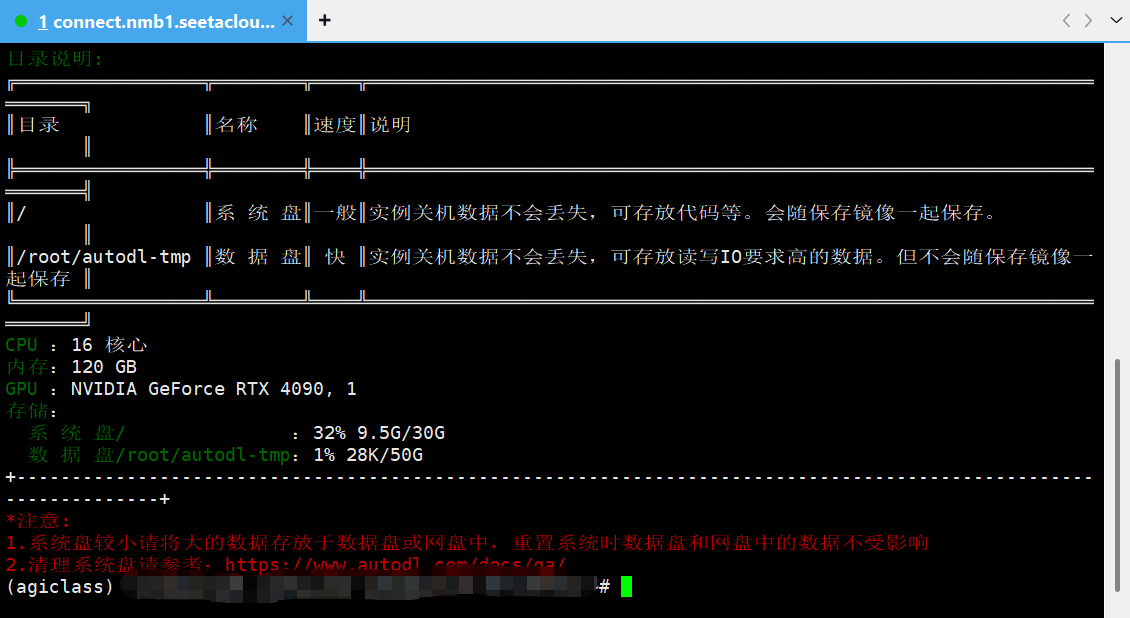

连接成功后,你会看到一个黑色的命令行窗口,光标在闪烁,说明已经登录到服务器了。

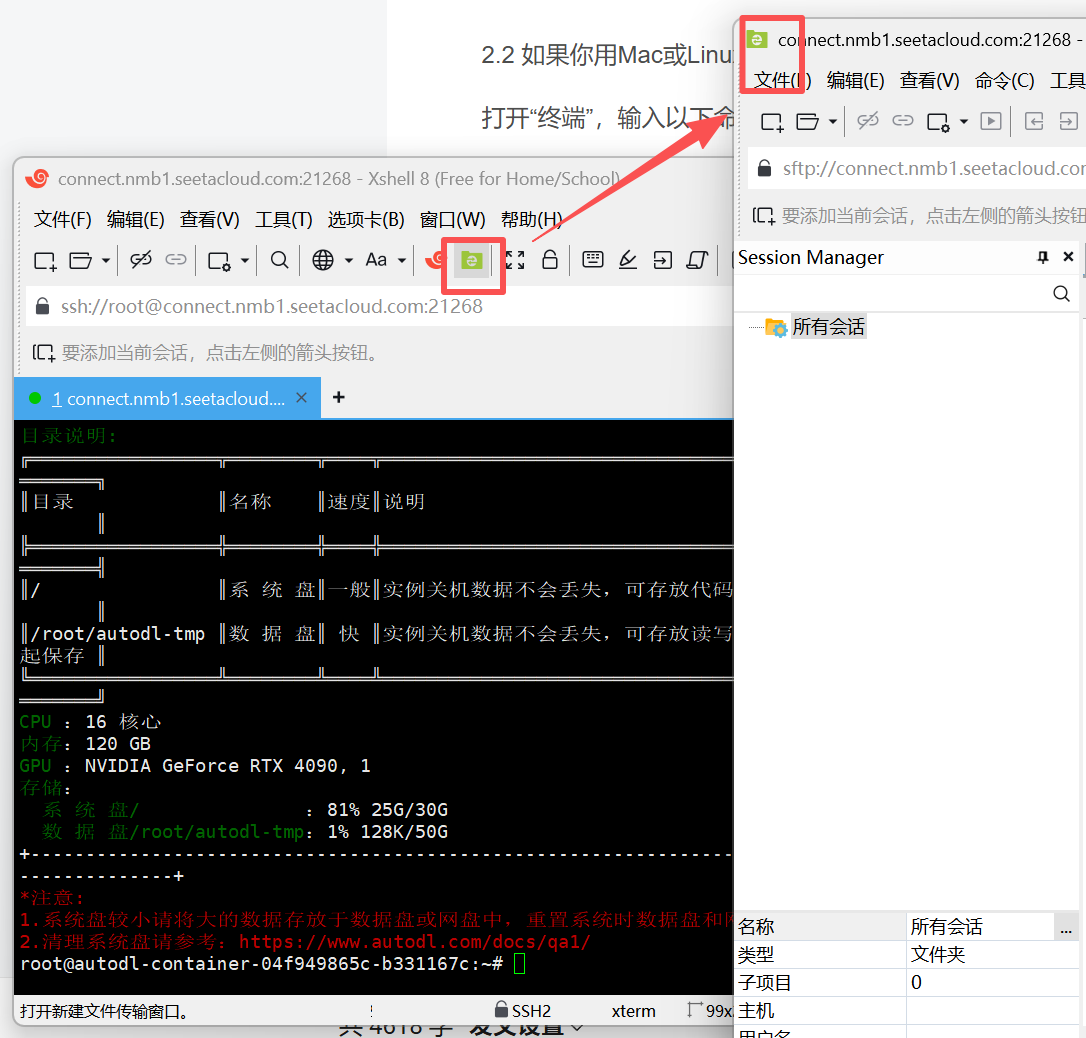

然后点击绿色标识,进入xtfp,传输程序和数据

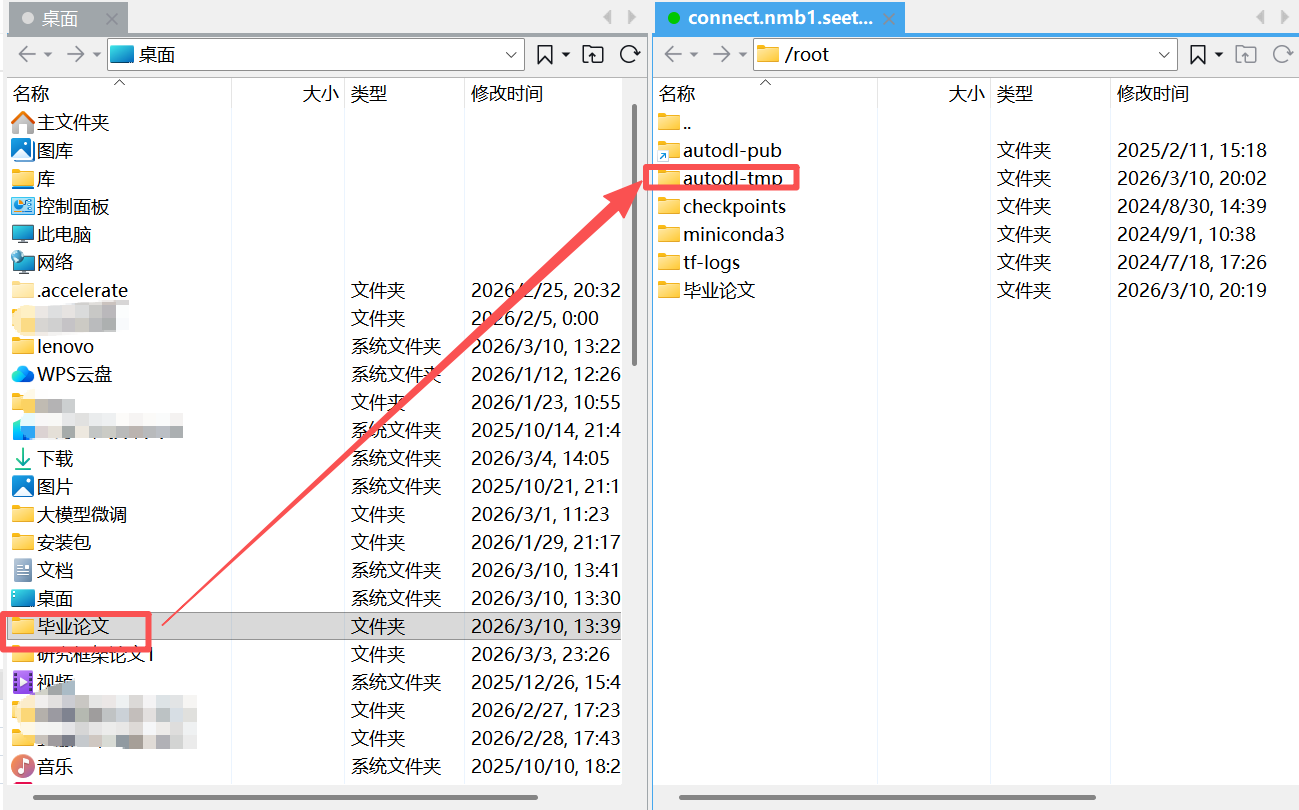

传送到tmp文件夹,这个是数据盘

如果你的是压缩包,到时候再autodl里面的终端那里进行解压就是

unzip 文件名

3.进入程序,下载模型前操作

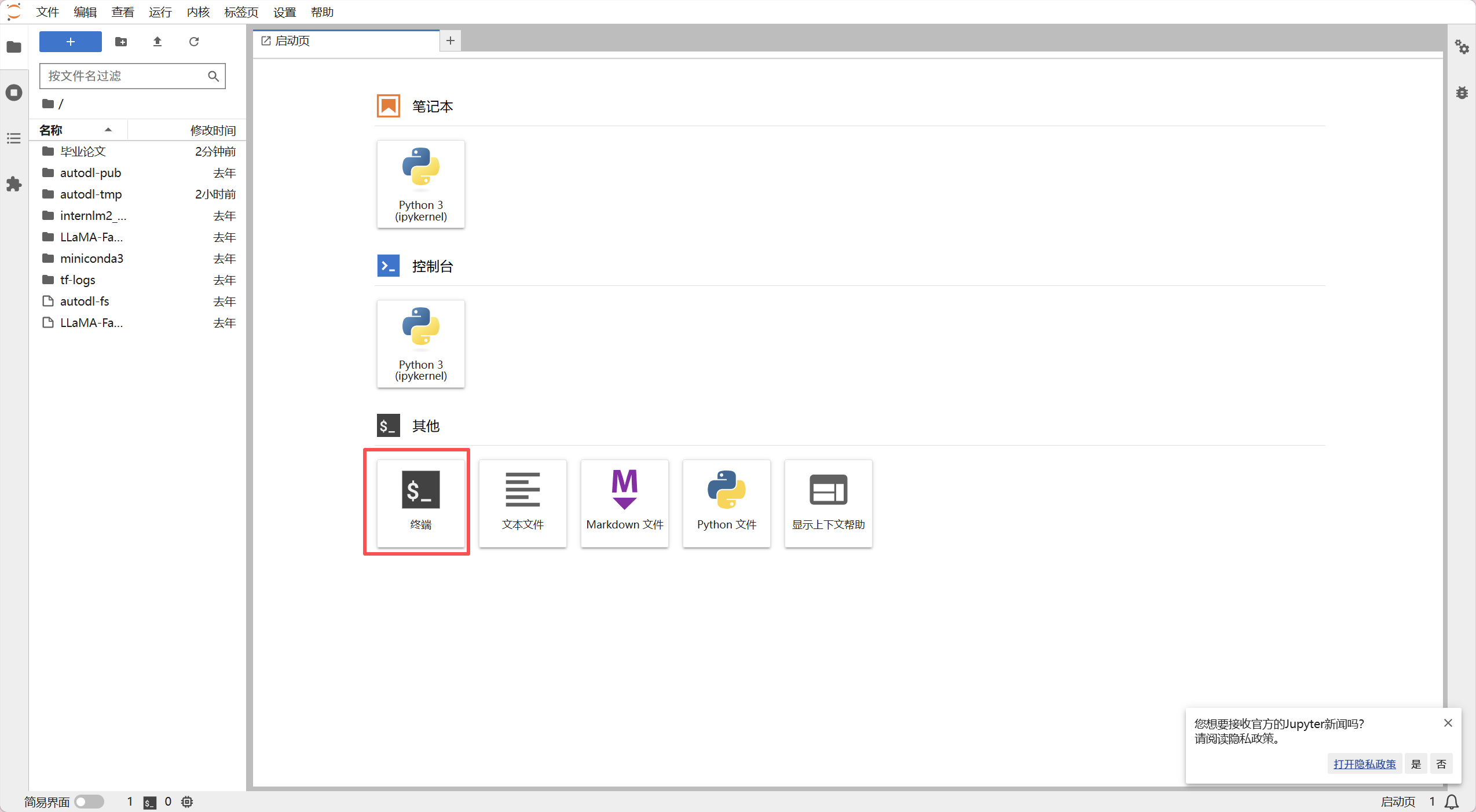

3.1 进入jupyterlab

3.2 点击“终端”

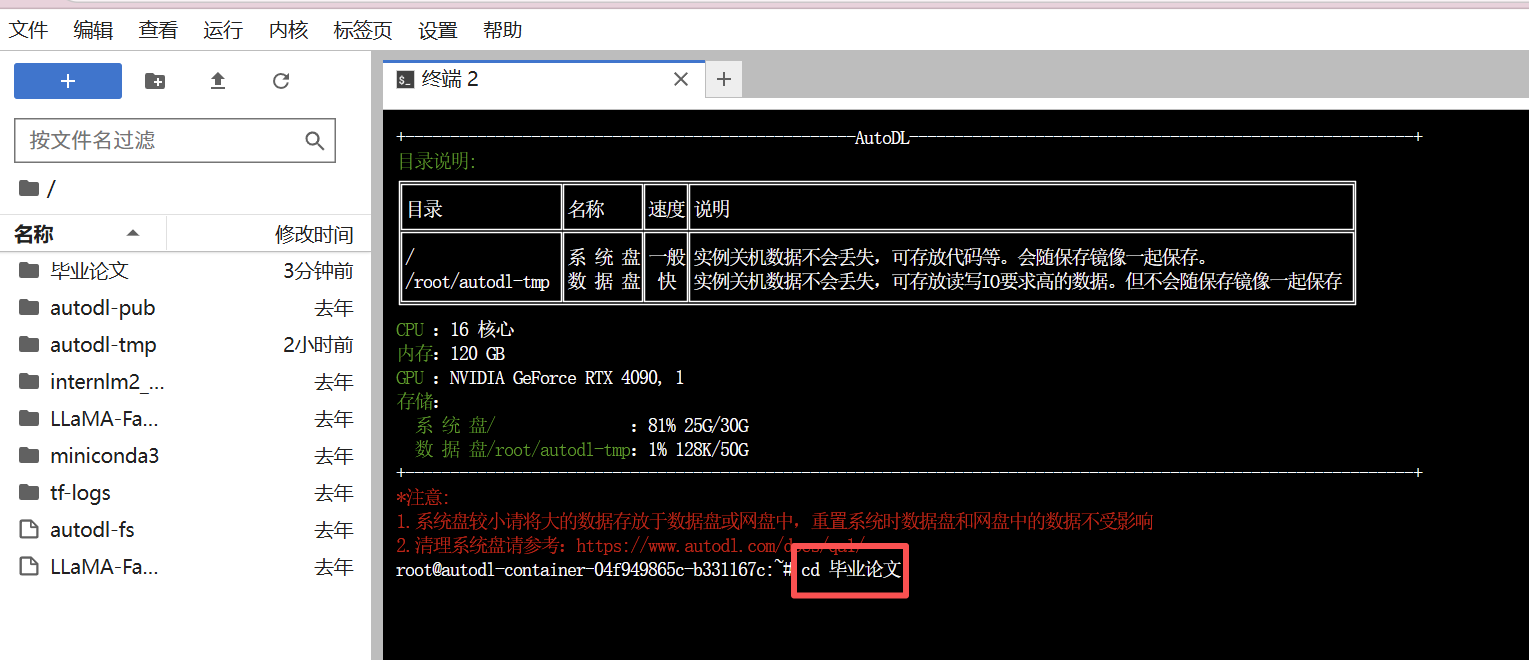

3.3 进入文件夹

3.4 初始化操作

1.环境初始化和数据移动(可选)

-

目的:将工作目录从系统盘(空间小)迁移到数据盘(空间大),避免空间不足。

-

如果刚开始没有把数据再xtfp里面传输到autodl-tmp文件夹里面,用这个代码

# 进入数据盘

cd /root/autodl-tmp

# 将毕业论文文件夹移动到数据盘

mv /root/毕业论文 /root/autodl-tmp/

# 进入新目录

cd /root/autodl-tmp/毕业论文2.安装必要的库

连接上服务器后,我们先把需要用到的Python库装上。

在命令行里逐行输入以下命令(每输入一行按回车执行):```bash

# 1. 升级pip(Python的包管理器)

pip install --upgrade pip

# 2. 安装transformers(Hugging Face的核心库)

pip install transformers

# 3. 安装modelscope(魔搭社区SDK,国内下载模型更快)

pip install modelscope

# 4. 安装peft(用于参数高效微调)

pip install peft

# 5. 安装accelerate(方便多卡训练)

pip install accelerate

# 6. 安装bitsandbytes(用于量化,节省显存)

pip install bitsandbytes

# 7. 安装datasets(处理数据集)

pip install datasets

# 8. 安装pandas、scikit-learn(数据处理和评估)

pip install pandas scikit-learn3.设置一个文件夹储存大模型

mkdir -p ./qwen_model4. 清理系统盘空间(解决 No space left on device)--如果有的话

-

目的:删除无用的大文件,释放根分区空间。

# 删除之前下载的其他模型(internlm2_5-7b-chat,约15GB)

rm -rf /root/internlm2_5-7b-chat

# 删除 pip 缓存(数据盘上的和系统盘的)

rm -rf /root/autodl-tmp/pip_cache

rm -rf /root/.cache/pip

# 清理 conda 缓存

conda clean --all -y

# 设置临时目录到数据盘(避免后续安装使用系统盘)

export TMPDIR=/root/autodl-tmp/tmp

mkdir -p $TMPDIR

echo 'export TMPDIR=/root/autodl-tmp/tmp' >> ~/.bashrc

source ~/.bashrc5. 创建虚拟环境(可选但推荐)

-

目的:隔离 Python 环境,避免包冲突

# 使用系统 Python 3.10 创建虚拟环境

python3.10 -m venv venv

# 激活环境

source venv/bin/activate6. 安装 PyTorch 2.4(CUDA 12.1 版本)

-

目的:获得与 modelscope 兼容的 PyTorch 版本(≥2.4)。

pip install torch==2.4.0 torchvision==0.19.0 torchaudio==2.4.0 --index-url https://download.pytorch.org/whl/cu121安装成功后验证:

python -c "import torch; print(torch.__version__); print(torch.cuda.is_available())"

# 应输出 2.4.0+cu121 和 True7. 安装 modelscope 及其他必需库

-

目的:用于下载模型和后续微调。

pip install modelscope datasets peft accelerate transformers4.下载Qwen2.5-7B模型

这是最核心的一步。因为你在国内,用魔搭社区(ModelScope)下载会比Hugging Face快很多(可以跑满带宽)。

有两种方法,一种是阿里云的魔塔社区,另一种是HF的镜像网站,我用的是方法一,然后我参考的博主是方法二,但是我实际操作中大部分遇到问题是AI指导的,前面的流程可能更倾向于方法一,大家可以自行斟酌

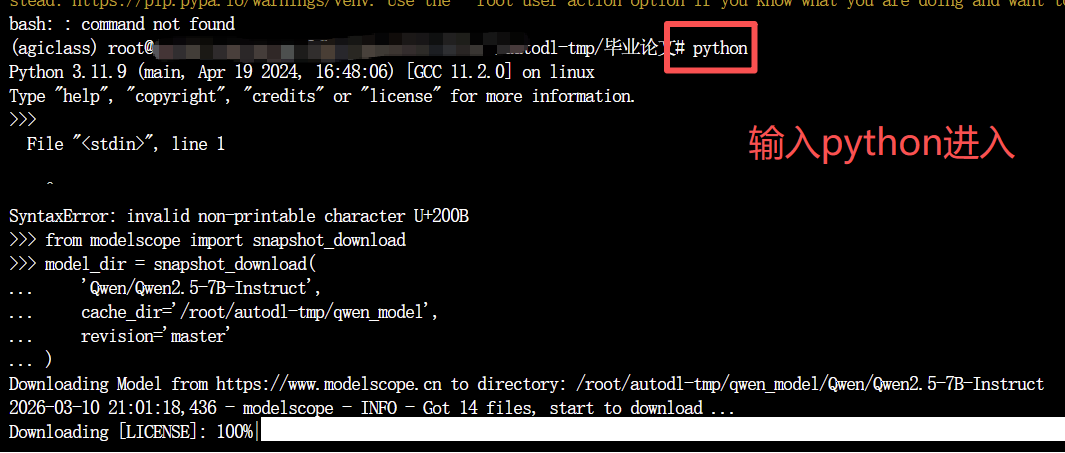

4.1方法一:魔法社区

然后复制一下代码

from modelscope import snapshot_download

model_dir = snapshot_download(

'Qwen/Qwen2.5-7B-Instruct',

cache_dir='/root/autodl-tmp/qwen_model',

revision='master'

)

print(f"模型下载完成,保存在:{model_dir}")退出python的话,用

exit()

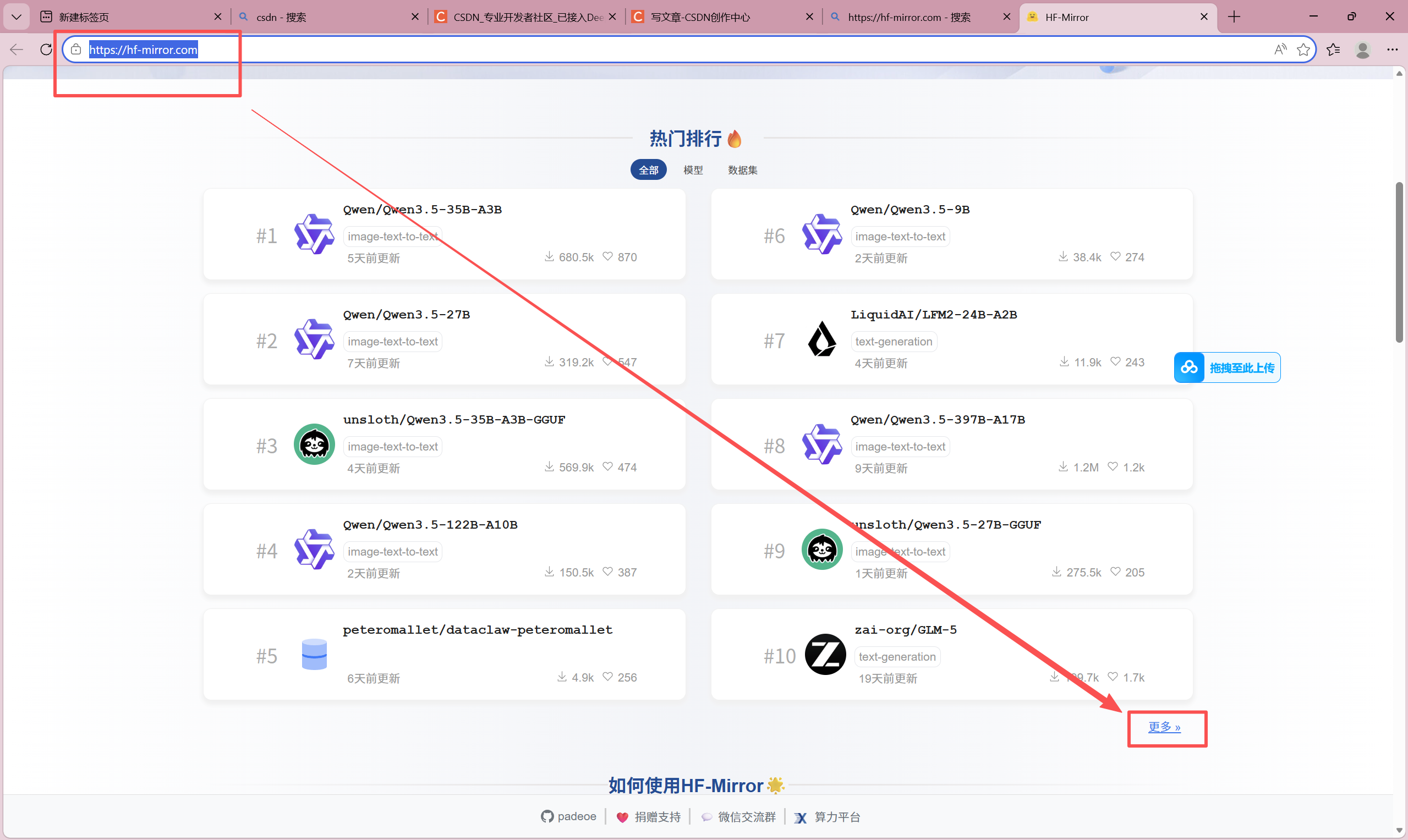

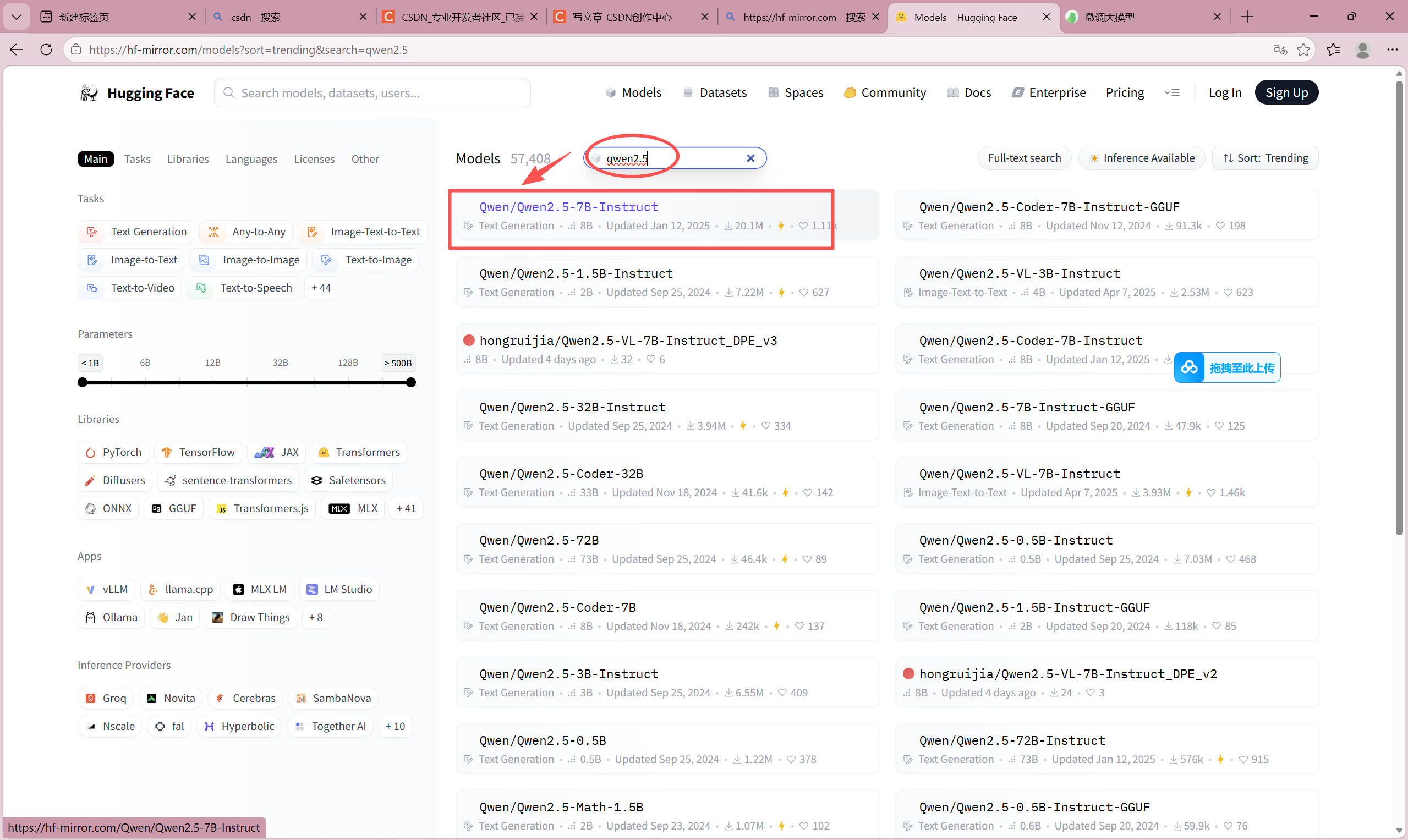

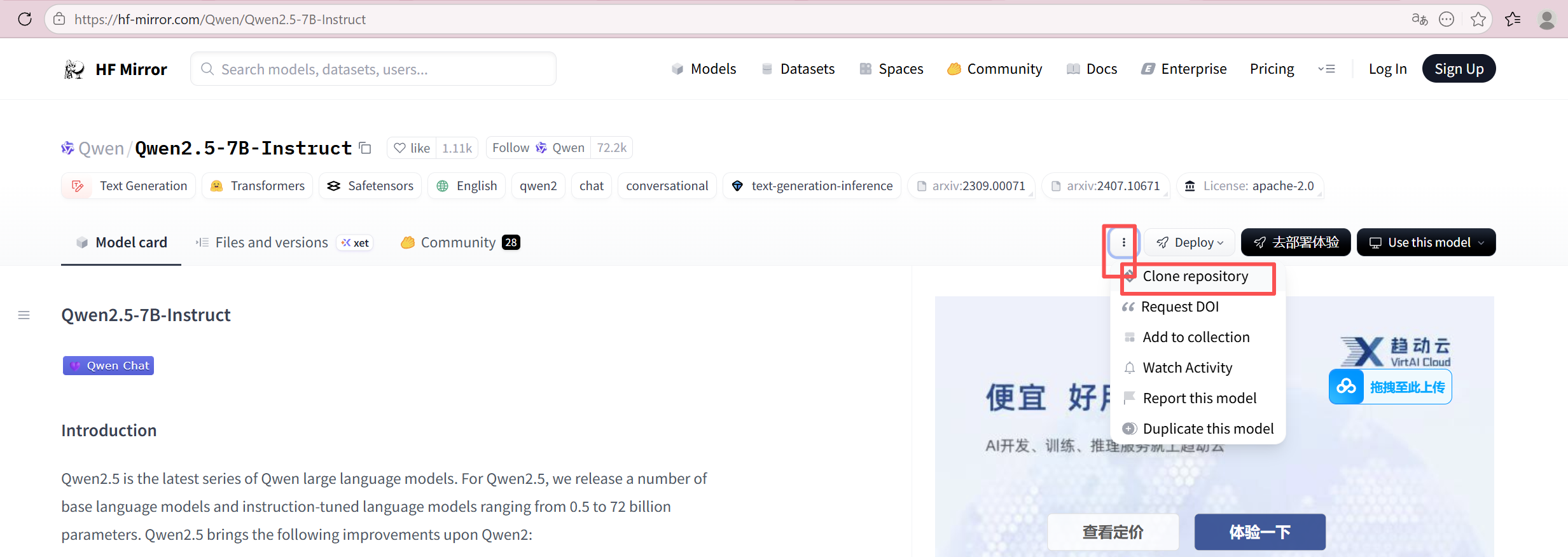

4.2方法二:HF镜像

下载预训练模型

【免费下载】 Qwen2.5-7B模型的安装与使用教程-CSDN博客

回到autodl的终端那里,运行命令

cd /root/autodl-tmp

git lfs intall

git clone https://hf-mirror.com/Qwen/Qwen2.5-7B-Instruct下载完查看文件

cd Qwen2.5-7B-Instruct

rm -rf.git #清除掉.git目录,避免数据盘空间不足

5. 如何安全地关闭当前环境

1. 保存工作

-

确保你的代码(

train.py、eval.py等)和数据(*.csv)都在/root/autodl-tmp/毕业论文下,这个目录在数据盘,关机后不会丢失。 -

如果有未保存的编辑,先保存。

2. 退出虚拟环境

deactivate3. 在AutoDL控制台关机

-

登录AutoDL网页,找到你的实例,点击 “关机”。

-

确认关机后,实例不再计费,但数据盘仍保留。

4. 关闭本地软件

-

Xshell、VSCode等可以关闭,下次连接时重新登录即可。

6.重启指南(读文献后回来)

1. 开机

-

登录AutoDL,启动实例(可能需要重新获取新的IP/端口,注意查看)。

2. 用Xshell重新连接

-

使用新的IP和端口(如果没变则用原来的)连接。

3. 进入工作目录并激活环境

bash

cd /root/autodl-tmp/毕业论文 source venv/bin/activate

4. 确认环境

bash

python -c "import torch; print(torch.__version__)"

应输出 2.4.0+cu121,且虚拟环境激活状态。

5. 继续实验

运行训练脚本:

bash

python train.py

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献9条内容

已为社区贡献9条内容

所有评论(0)