别再在这个K8s多云环境里手动搬砖了,带你上手Kurator搞定分布式云原生架构!

别再在这个K8s多云环境里手动搬砖了,带你上手Kurator搞定分布式云原生架构!

嗨,大家好,我是你们的云原生老司机。

最近群里总有兄弟吐苦水,说手头维护的 K8s 集群越来越多,今天在这个云厂商开个户,明天在那个自建机房搞一套,手里攥着几十个 kubeconfig 文件,切来切去头都晕了。业务方还老是催着要搞什么多地多活、全链路压测、灰度发布。如果你还在用脚本一个个集群去 apply yaml,那你真的是在用战术上的勤奋掩盖战略上的懒惰。

Kurator这玩意儿简直就是为了解决咱们这种“分布式云原生架构”痛点而生的。简单说,它就是给你配了个超级大管家,让你能像管理一台电脑一样管理全球的集群舰队。咱今天就从实操的角度,把它的架构、调度、流量治理这些硬核功能给拆解清楚,顺便把环境搭起来跑一跑。

一、 咱们先得有个家:Kurator 环境搭建与初体验

说一千道一万,代码跑起来才是真。很多开源项目的文档写得像天书,咱今天就来个手把手的。要玩转 Kurator,首先你得有个控制面。这个控制面本身其实就是依附于 K8s 的。

1.1 准备工作与源码获取

别急着敲键盘,先确认你本地有 Go 环境(建议 1.19 以上)和 Docker。咱们这次直接从源码搞起,为啥?因为作为开发者,以后你可能还得自己改改 Cluster Operator 的逻辑呢,源码在手,心里不慌。

打开你的终端,找个风水宝地,咱们先把代码拉下来。注意了,这个地址是官方仓库,别搞错了:

可以看到这是项目的gitCode源码

我们可以拉取下来

git clone https://github.com/kurator-dev/kurator.git

源码文件如下,接下来就可以使用了

可以注意到,这个命令kurator version可以看到版本号

拉下来之后,你会发现目录结构挺清晰的。咱不需要去细扣每一个文件,重点关注 cmd 和 pkg 目录就行。

1.2 编译与本地集群启动

通常我们在测试环境会用 Kind 或者 Minikube 先起一个 Local 的 K8s 集群作为 Host Cluster。Kurator 提供了一些 Makefile 的脚本,能帮你省不少事。

执行安装命令的时候,Kurator 会把自己的那一套 CRD(自定义资源定义)注册到你的集群里。这时候,其实就是在部署 Kurator 平台的总体架构 中的核心组件。哪怕你是在本地跑,感觉上也是在初始化一个指挥中心。

等待镜像拉取和 Pod Running 的时候,你可以喝口水。一旦 Pod 起来了,恭喜你,你已经迈出了分布式云原生架构的第一步。

二、 从单兵作战到舰队指挥:集群生命周期与架构解析

环境好了,咱们得聊聊这玩意儿到底咋工作的。以前咱们看 Kubernetes 集群的标准架构,无非就是 Master 节点加 Worker 节点,Etcd 存数据,API Server 对外吆喝。但到了多云时代,这个标准架构不够用了。

2.1 Kurator 架构与分布式云原生的关系

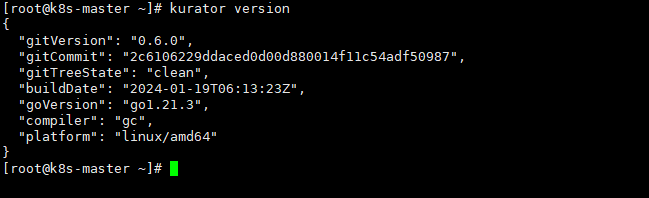

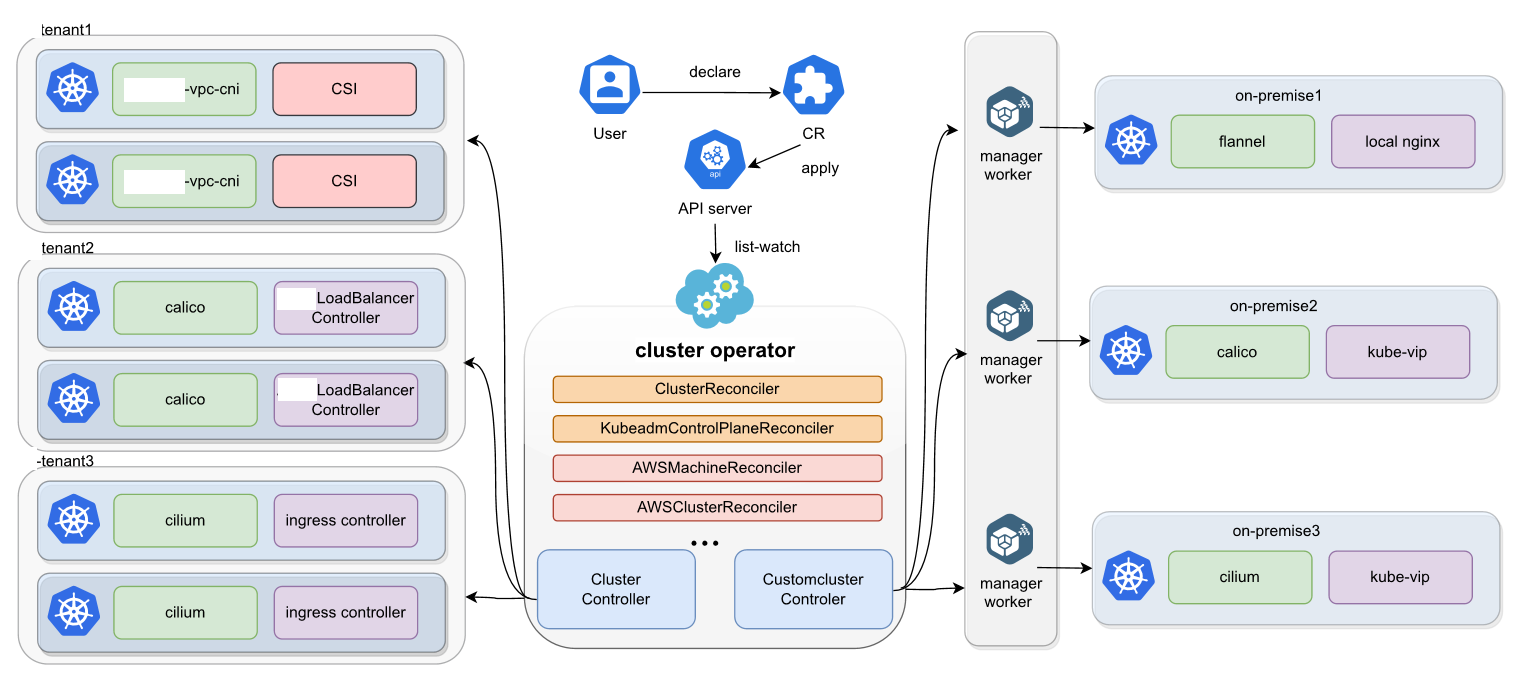

这张Kurator架构图挺清晰的,Kurator 架构分为 Fleet Manager 统一管理集群、插件、应用与策略,Operator 负责流量与同步,底层集成多云与观测组件:

Kurator 架构的设计初衷,就是承认“集群是分散的”这个事实。它在标准的 K8s 之上抽象了一层。你可以把它想象成一个“元集群”或者“联邦头节点”。

在分布式云原生架构下,网络是割裂的,基础设施是不统一的。Kurator 通过自己的 API Server 和 Controller Manager,把下层的差异给屏蔽了。对于上层应用来说,我不管你下面是阿里云的 ACK,还是亚马逊的 EKS,或者机房里的裸金属 K8s,在 Kurator 眼里,你们都是我的“小弟”,也就是 Member Cluster。

2.2 玩转 Kurator 集群生命周期管理

这是Kurator集群生命周期管理的详细参考图,展示了从用户声明、多租户插件配置,到控制器协同工作实现异构集群统一纳管的全过程。

这是最爽的一个功能。以前建集群,你得去云控制台点点点,或者写 Terraform。Kurator 引入了 Cluster API 的概念,实现了 Kurator 集群生命周期管理 的自动化。

啥叫生命周期?就是从创建(Create)、升级(Upgrade)、扩容(Scale)到销毁(Delete),全归 Kurator 管。你只需要提交一个 YAML 文件,描述你想要个啥样的集群。

这里就不得不提 Cluster Operator 的实现。这个 Operator 是 Kurator 的核心组件之一。它就像一个不知疲倦的监工,时刻盯着你提交的 Cluster 定义和实际环境的状态。

比如,你定义了一个集群需要 3 个 Master,5 个 Worker。Cluster Operator 就会去调用底层的云接口(比如 AWS 或者 OpenStack 的接口)去把机器开出来,把 K8s 装好,然后把 kubeconfig 甚至 metrics 都要回来。

下面我手搓一个简单的 Cluster 定义文件,你们感受一下这种“声明式”建集群的快乐:

apiVersion: cluster.kurator.dev/v1alpha1

kind: Cluster

metadata:

name: my-production-cluster

namespace: default

spec:

# 这里定义我们要用的云基础设施,比如是AWS还是本地Kind

infrastructureRef:

kind: AWSCluster

apiVersion: infrastructure.cluster.x-k8s.io/v1beta1

name: aws-prod-infra

# 这里定义控制面的配置,版本锁定在1.27

controlPlaneRef:

kind: KubeadmControlPlane

apiVersion: controlplane.cluster.x-k8s.io/v1beta1

name: prod-control-plane

# 咱们的舰队管理策略

topology:

class: production-class

version: v1.27.3

workers:

machineDeployments:

- class: default-worker

name: worker-nodes

replicas: 5

看到没?这一段代码下去,后台 Cluster Operator 就开始干活了。它会通过内部的状态机流转,一步步把集群给你“变”出来。这就叫 云原生舰队管理,你是指挥官,Kurator 是执行官。

三、 应用如何撒向全球:分发状态机与统一策略

集群建好了,那是空架子,咱们得跑业务啊。这时候问题来了:我有10个集群,分布在北上广深和法兰克福,我有一个 Nginx 的更新,难道我要手动切10次 kubectl context 吗?那肯定不行。

3.1 深入理解 Kurator 分发流程的状态机

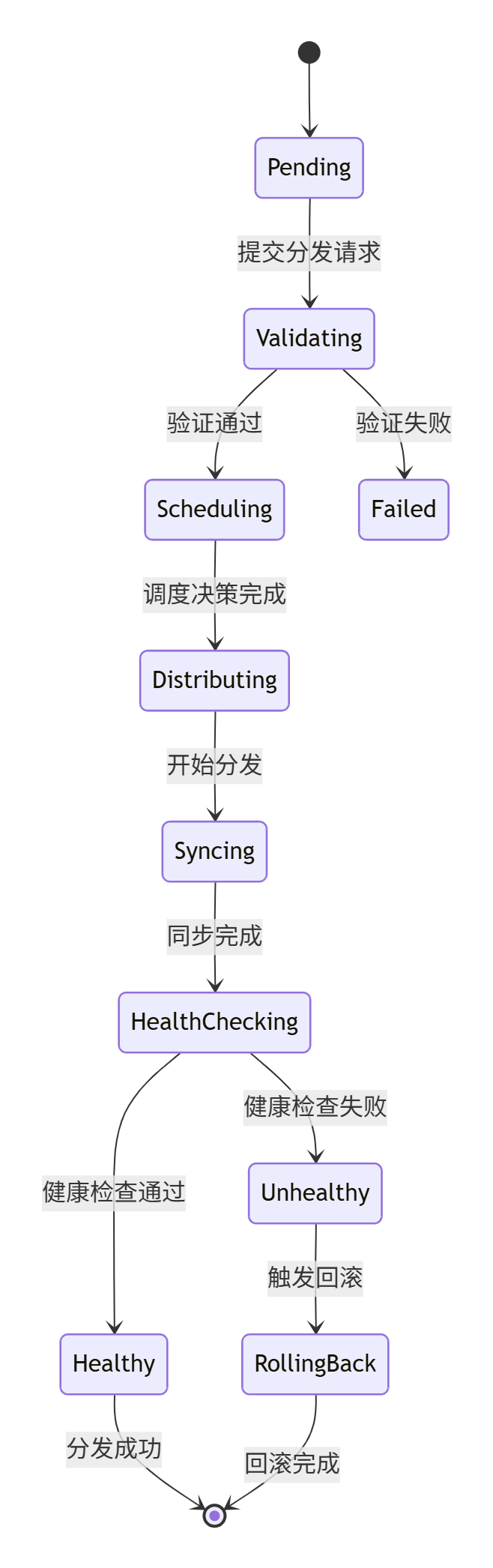

这是Kurator分发流程的状态机参考图,展示了从请求提交、调度、同步到健康检查与回滚的完整自动化发布生命周期:

Kurator 有一套非常严谨的应用分发机制。这里面涉及到一个 Kurator 分发流程的状态机。

当你下发一个应用部署任务(FleetApplication)时,它不是一股脑扔下去就不管了。状态机会经历 Pending(等待处理)、Scheduled(调度中,看该发给谁)、Syncing(正在同步资源)、Ready(同步完成)、Failed(同步失败)等状态。

这个状态机非常关键。特别是在网络不稳定的边缘计算场景下,如果某个集群暂时断连了,状态机会让任务停留在 Syncing 或 Pending 状态,等网络恢复了继续传,保证了数据的一致性。这比写脚本 kubectl apply 强太多了,脚本跑错了你都不知道错哪儿了。

3.2 Kurator 的统一策略管理架构

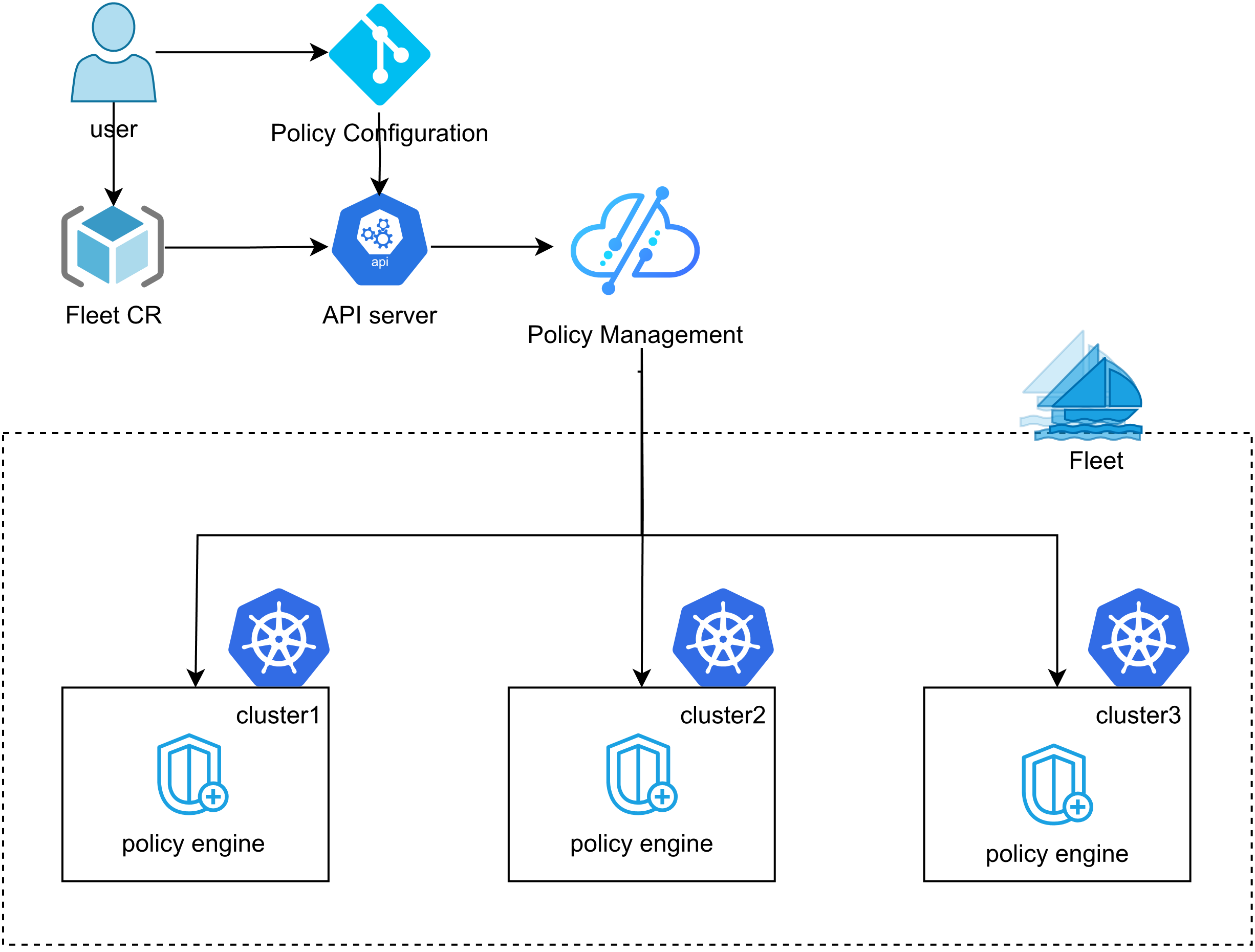

这张图展示了Kurator的统一策略管理架构,用户只需要在一处定义策略,就能通过Fleet和FluxCD自动同步到多个集群,配合Kyverno实现跨集群的一致性治理,真正做到“一次配置,全栈生效”:

光分发应用还不够,还有配置和策略(Policy)。比如,所有生产环境的 Pod 必须限制 CPU 和内存配额,所有 Service 必须不能用 NodePort。

这就是 Kurator 的统一策略管理架构 厉害的地方。它允许你定义全局的 Policy(比如基于 OPA Gatekeeper 或 Kyverno),然后通过 Label Selector 选中一批集群。Kurator 会自动把这些策略下发到每一个子集群里。

这就好比公司发红头文件,总部(Kurator)拟定一份,盖个章,瞬间下发到各个分公司(Member Clusters),而且还能强制执行。如果有人在子集群里偷偷改了配置,违反了策略,Kurator 还能给你纠正回来或者报警。

四、 算力的高级玩法:Volcano 分组调度与资源优化

现在业务跑起来了,但是资源利用率是个大问题。特别是搞 AI 训练或者大数据处理的兄弟们,对调度器的要求很高。K8s 原生的调度器比较“傻”,它是基于 Pod 逐个调度的。

4.1 引入 Volcano 分组调度

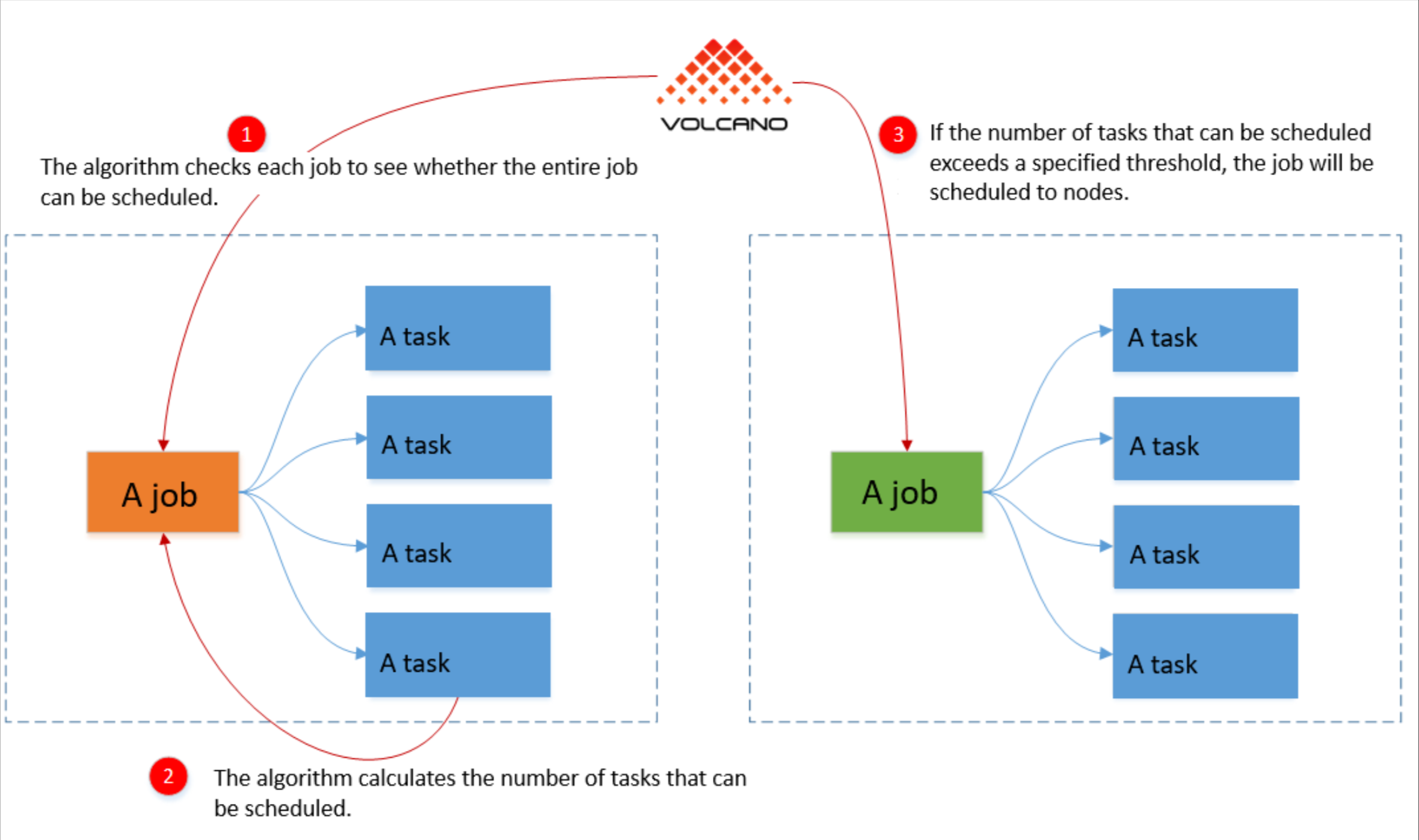

这是Volcano分组调度参考图,展示了其如何通过整体资源检查与阈值判断,实现批处理作业的成组调度与资源保障:

Kurator 深度集成了 Volcano。咱们聊聊 Volcano 分组调度(Gang Scheduling)。

啥场景用这个?比如你在跑一个 TensorFlow 的分布式训练任务,需要 10 个 Worker 节点同时启动才能开始训练。如果资源只够启动 8 个,原生调度器会先把这 8 个起起来占着坑,然后死等剩下 2 个。这 8 个就在那空转,浪费钱。

Volcano 的分组调度就是“全有或全无”(All-or-Nothing)。Kurator 对接 Volcano 后,在多云环境下,可以智能地判断哪个集群有足够的资源把这一组(Gang)Pod 全部塞进去。如果都不够,那就排队,绝不占着茅坑不拉屎。

4.2 资源利用率的提升

通过 Kurator 集成 Volcano,我们不仅能在单个集群内做优化,还能在集群间做调度。比如 A 集群晚上空闲,B 集群白天忙,Kurator 可以结合 Volcano 的队列机制,把离线计算任务调度到空闲的 A 集群去。

下面这段代码展示了如何在 Kurator 体系下定义一个带有 Volcano 调度特性的 Job,注意那个 minMember 字段,这就是 Gang Scheduling 的精髓:

apiVersion: batch.volcano.sh/v1alpha1

kind: Job

metadata:

name: ai-training-job

spec:

# 最小成员数,要么给够5个pod的资源,要么一个都别起

minAvailable: 5

schedulerName: volcano

queue: default

tasks:

- replicas: 5

name: "tensorflow-worker"

template:

spec:

containers:

- image: tensorflow/tensorflow:latest

command: ["python", "/app/train.py"]

name: tf-worker

resources:

requests:

cpu: "4"

memory: "8Gi"

restartPolicy: OnFailure

这种配置在 Kurator 平台中下发后,会自动寻找支持 Volcano 的子集群进行部署。

五、 流量的艺术:路由、灰度发布与 A/B 测试

最后,咱们得聊聊流量。服务部署好了,用户怎么访问?版本更新怎么做才稳?这就涉及到了 Kurator 的流量路由 和 Kurator 中配置 AB 测试。

5.1 Kurator 的流量路由机制

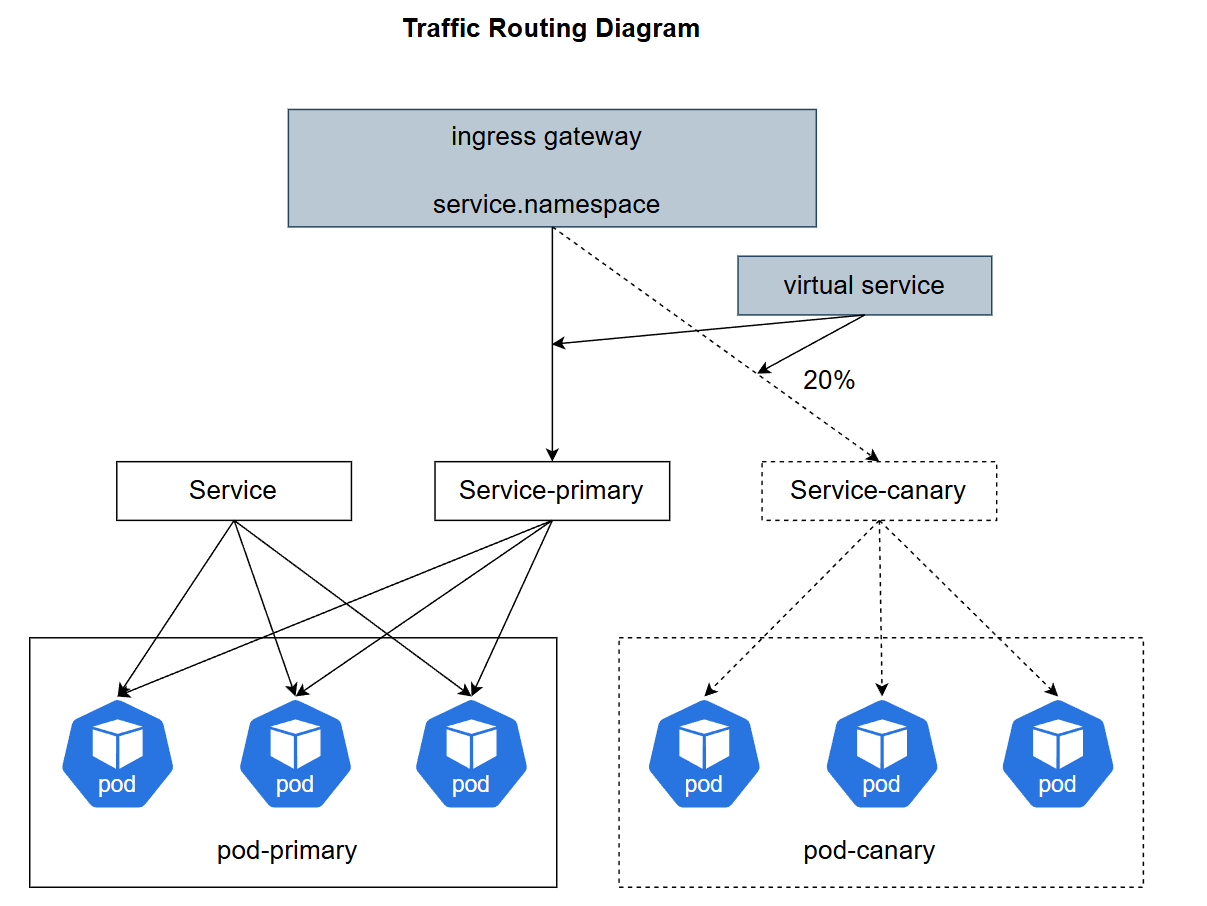

这是Kurator的流量路由参考图,展示了其如何通过入口网关和服务网格技术,在金丝雀发布中实现精确的流量分割与路由控制:

在多集群环境下,流量入口通常是复杂的。Kurator 通过集成 Istio 等服务网格组件,提供了一套全局的流量治理能力。

Kurator 的流量路由 不仅仅是简单的 Ingress,它可以基于请求头(Header)、Cookie、甚至地理位置来分发流量。比如,你可以配置一条规则:来自“iPhone 用户”的请求,路由到集群 A 的 v2 版本服务;其他的路由到集群 B 的 v1 版本。

5.2 只有实战才懂的 A/B 测试配置

老板说要上个新功能,但不确定用户喜不喜欢,先切 10% 的流量过去看看。这就叫灰度发布或者 A/B 测试。

在 Kurator 中配置 A/B 测试 非常直观。你不需要去修改业务代码,只需要下发一个 TrafficRoute 规则。Kurator 能够精准控制流量的权重。

我们可以想象这样一个场景:我们有一个电商的前端服务,分布在 3 个集群中。现在要测试一个新的 UI 界面。我们可以定义一个策略,让 HTTP Header 中包含 x-user-group: beta 的请求,全部走新版本。

这部分配置看起来大概是这样的:

apiVersion: networking.kurator.dev/v1alpha1

kind: TrafficRoute

metadata:

name: frontend-ab-test

spec:

hosts:

- "shop.example.com"

gateways:

- "my-gateway"

http:

- match:

# 匹配请求头,精准打击

- headers:

x-user-group:

exact: "beta-tester"

route:

# beta用户去新版服务

- destination:

host: frontend-service-v2

port:

number: 80

- route:

# 其他普通用户走旧版,稳字当头

- destination:

host: frontend-service-v1

port:

number: 80

weight: 100

这种配置下发后,Kurator 会自动同步到各个集群的 Ingress Controller 或者 Sidecar 中,立刻生效。

总结:Kurator 带来的改变

兄弟们,写到这里,你会发现 Kurator 平台的总体架构 其实就是要把复杂的 K8s 多集群管理变得标准化、流程化。

从最底层的 环境搭建(git clone 那一步),到中间的 集群生命周期管理(生老病死全管),再到上层的 统一策略管理架构 和 分发流程状态机,最后落实到业务侧的 Volcano 分组调度 和 流量路由。Kurator 基本上把云原生运维中那些最头疼的“坑”都填平了。

咱们做技术的,追求的不就是“稳”和“快”吗?Kurator 让你的舰队管理像操作单机一样丝滑,这才是真正的 Cloud Native 2.0 玩法。

好了,今天的实操分享就到这。大家赶紧把那个 git clone 命令跑起来,自己去感受一下。有问题咱们评论区见,回见了您嘞!

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献8条内容

已为社区贡献8条内容

所有评论(0)