搞定多云灾难现场!手把手教你用 Kurator 搓个舰队,从存储到底层集群再到流量治理,这波操作稳得一批,这才是云原生该有的样子

搞定多云灾难现场!手把手教你用 Kurator 搓个舰队,从存储到底层集群再到流量治理,这波操作稳得一批,这才是云原生该有的样子

嘿,各位兄弟姐妹们,今儿咱们直接来点那种能让你在工位上“嘴角上扬”的硬核实操。说实话,咱们搞云原生的,谁还没被多集群管理折磨过?集群多了跟散养的羊一样,配置飘移、分发困难、监控不统一,每次发布都像在走钢丝。Kurator 这玩意儿,我刚接触的时候也觉得是“又一个轮子”,但上手一搓,发现它还真有点东西。它不光是把 K8s、Karmada、Istio、Prometheus 这些云原生全家桶给你“胶水”粘起来,更像是给了你一套这种复杂系统的“遥控器”。简单说,它就是咱们运维老鸟手中的一把瑞士军刀,专门治各种“多云不服”。今儿我就带大家从零开始,把这套环境搭起来,顺便把那些最让人头秃的存储、网格、分发全给它捋顺了。

第一章:把地基打牢,从架构认知到环境“开荒”

1.1 咱们到底在折腾啥?Kurator 总体架构大起底

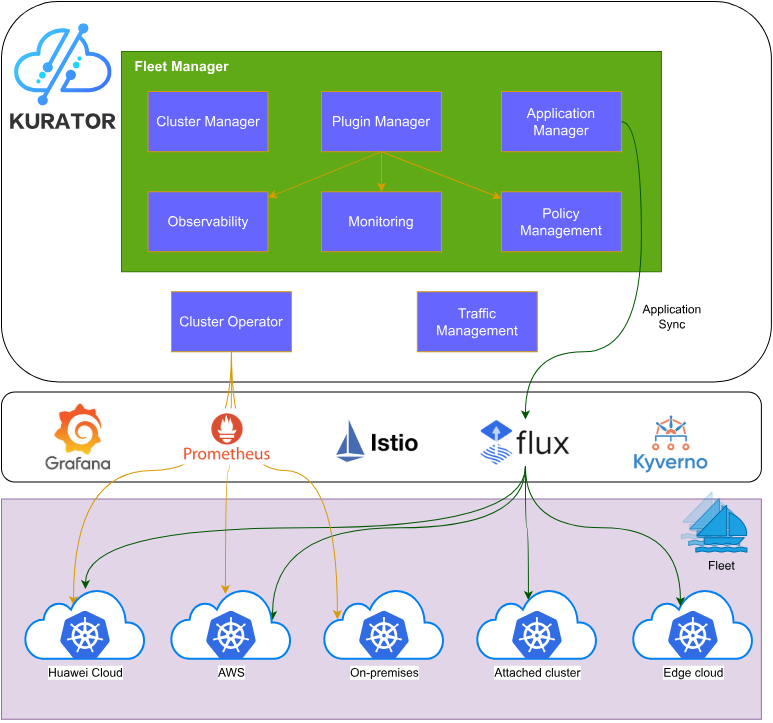

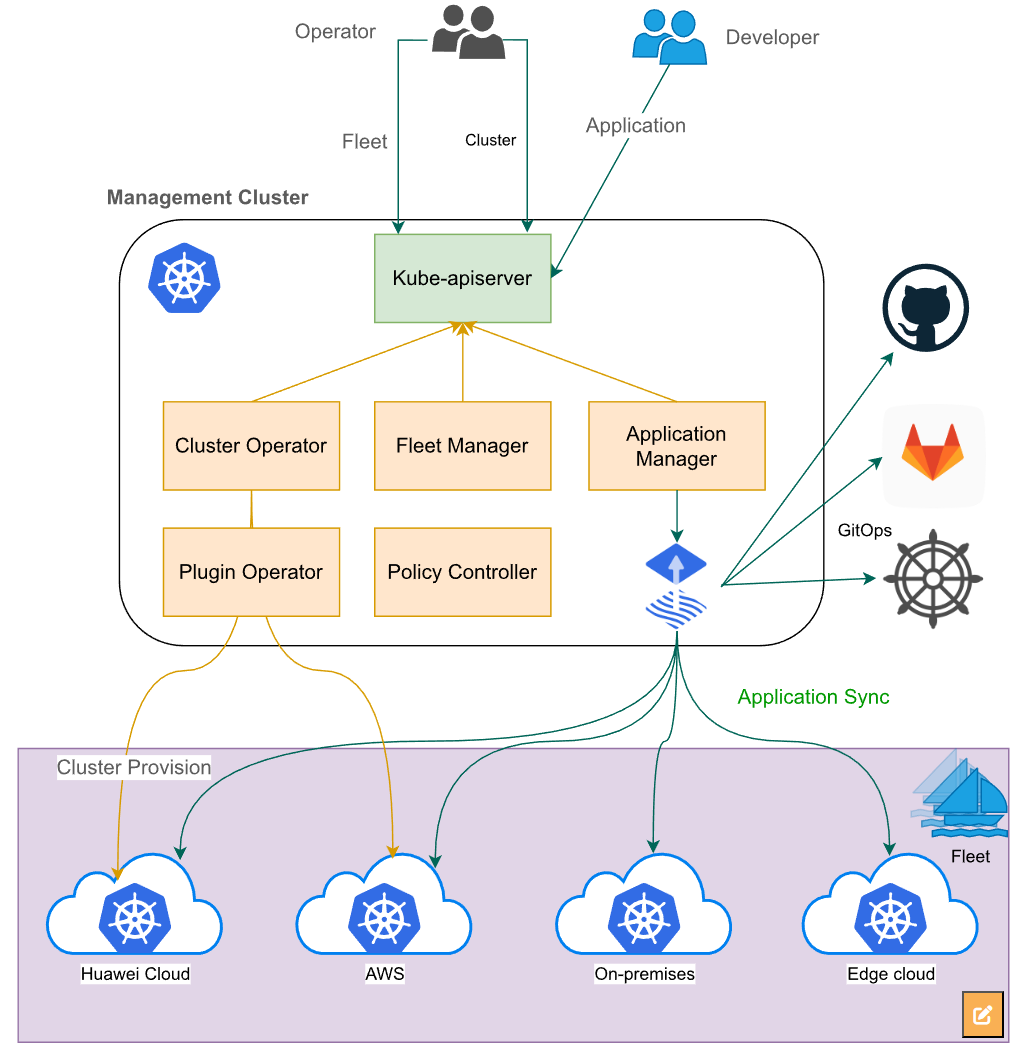

这张Kurator架构图挺清晰的,Kurator 架构分为 Fleet Manager 统一管理集群、插件、应用与策略,Operator 负责流量与同步,底层集成多云与观测组件:

咱们先得把图纸看明白了再动铲子。Kurator 的总体架构,说白了就是个“分层治理”的逻辑。你别把它想太复杂,最顶层是它的统一控制面,这块儿它集成了 Karmada,专门负责把你的应用“撒”到下面的各个集群里去。中间层是集群生命周期管理,也就是咱们常说的 Cluster Operator,这货是基于 Cluster API 的,能帮你把创建集群这事儿变成写代码。最底层?那就是咱们的一个个业务集群了,也就是 Fleet(舰队)里的那些“兵”。

你想想,传统的 Kubernetes 集群标准架构,Master 节点管 Worker 节点,这大家都熟。但在 Kurator 眼里,一个 K8s 集群只是一个“原子单位”。它要在这些原子之上,再盖一层“大脑”。这个架构最骚的地方在于,它不光管“生”(创建集群),还管“养”(装插件、监控、备份),最后还管“用”(应用分发)。它把那个复杂的 Kubernetes 标准架构封装成了乐高积木,咱们只需要关注怎么拼就行。

1.2 别废话,直接上手:环境搭建与填坑指南

好了,理论吹完了,咱们直接进实操。这一步要是卡住了,后面全是白搭。咱们今天就在你的 Linux 机器上搞,别用那是啥 Windows WSL 了,直接上真家伙。

首先,依赖环境你得有吧?Docker、Go、Kind(或者你有现成的虚拟机)都得备好。重点来了,很多兄弟在拉代码这一步就掉坑里了,要么拉错分支,要么网路不通。咱们直接用这个国内镜像源,稳得一批。

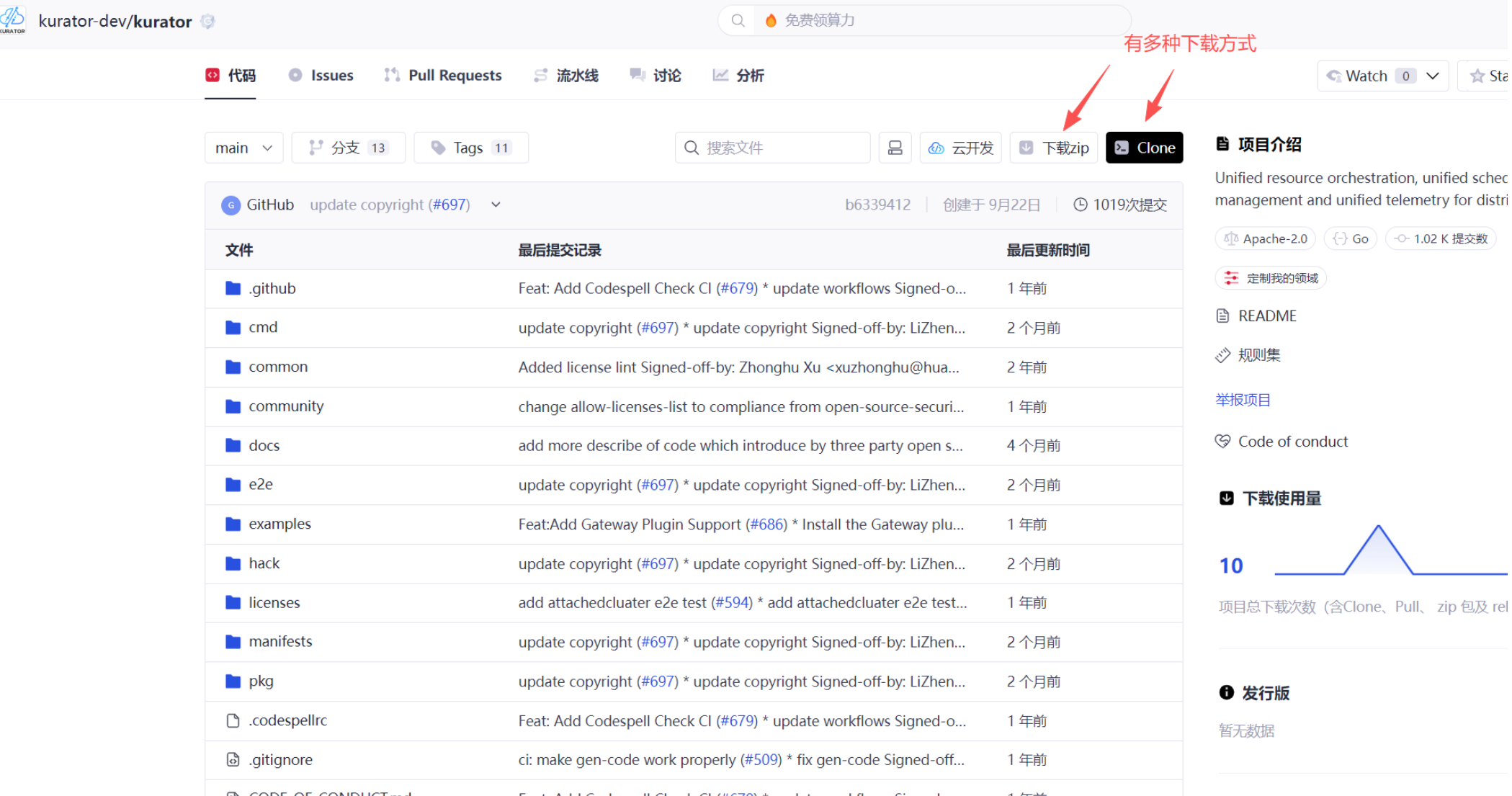

既然要玩,那没项目怎么玩嘛,所以我们第一步先来把项目下载到本地,这一步非常简单,可以直接下载或者clone

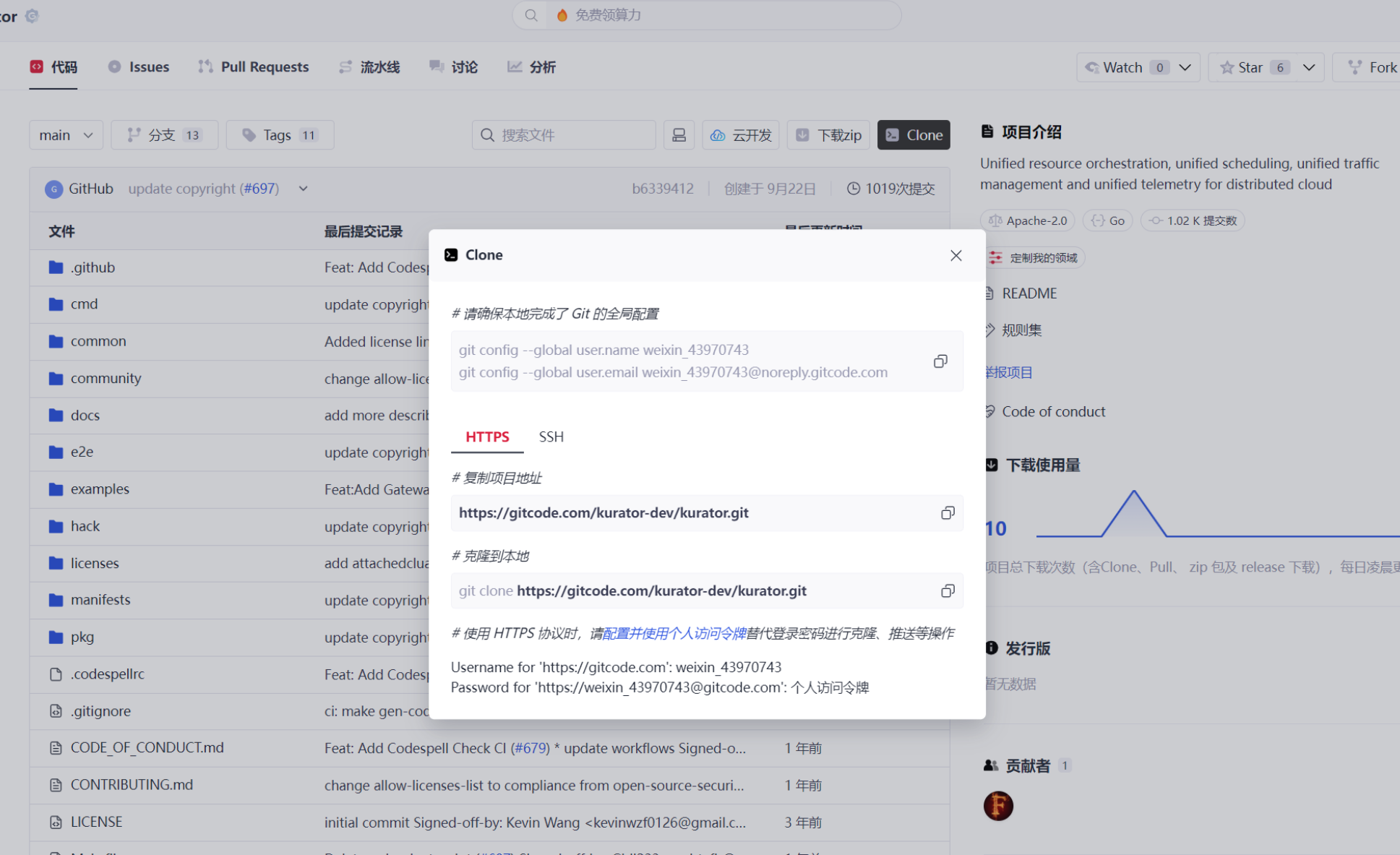

我们本地若没有安装Git插件的,那我们直接就下载zip即可。当然,我们这里直接选择通过git远程克隆吧,会高级一些~~

接着,我们输入clone 指令。

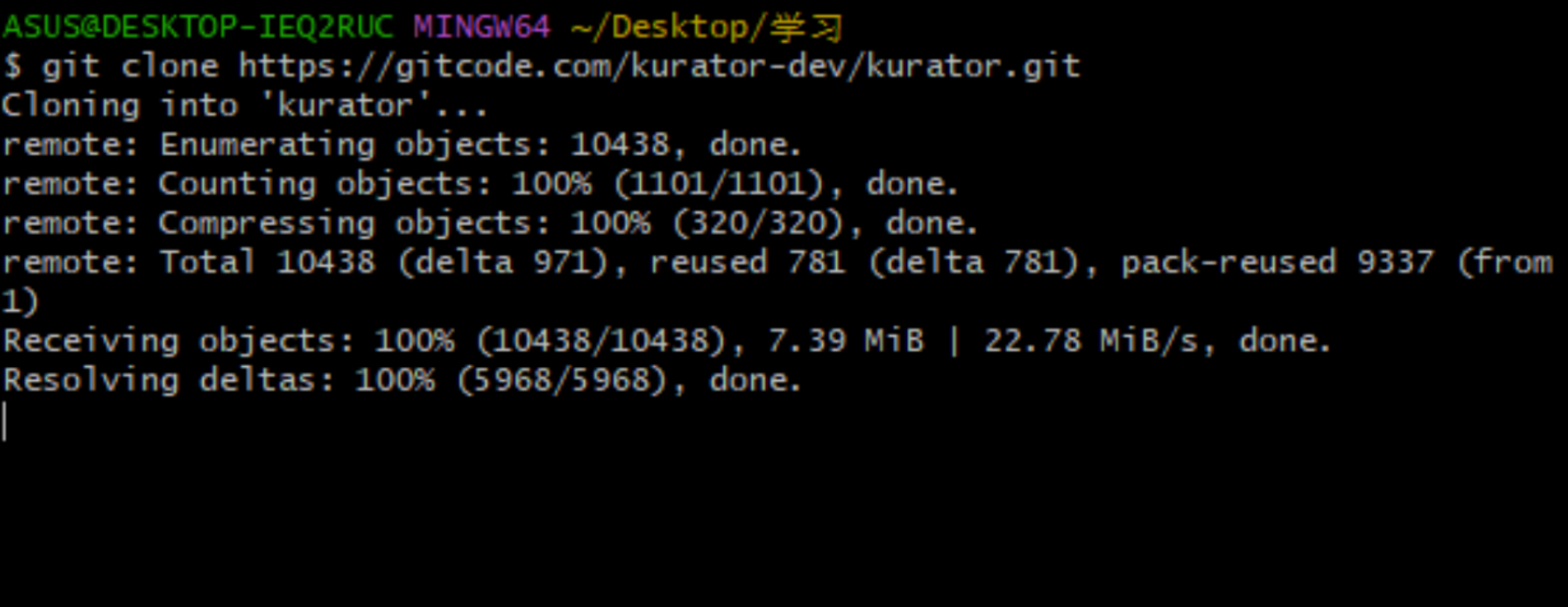

git clone https://gitcode.com/kurator-dev/kurator.git

clone之后,我们便成功拿到了完整的Kurator项目源码:

接下来你可能会遇到权限问题,记住了,chmod +x 是你的好朋友。搭建环境最怕的就是心急,特别是依赖包版本对不上的时候,咱们得耐着性子看 log。

1.3 Cluster Operator 的魔法:它是怎么把集群“变”出来的

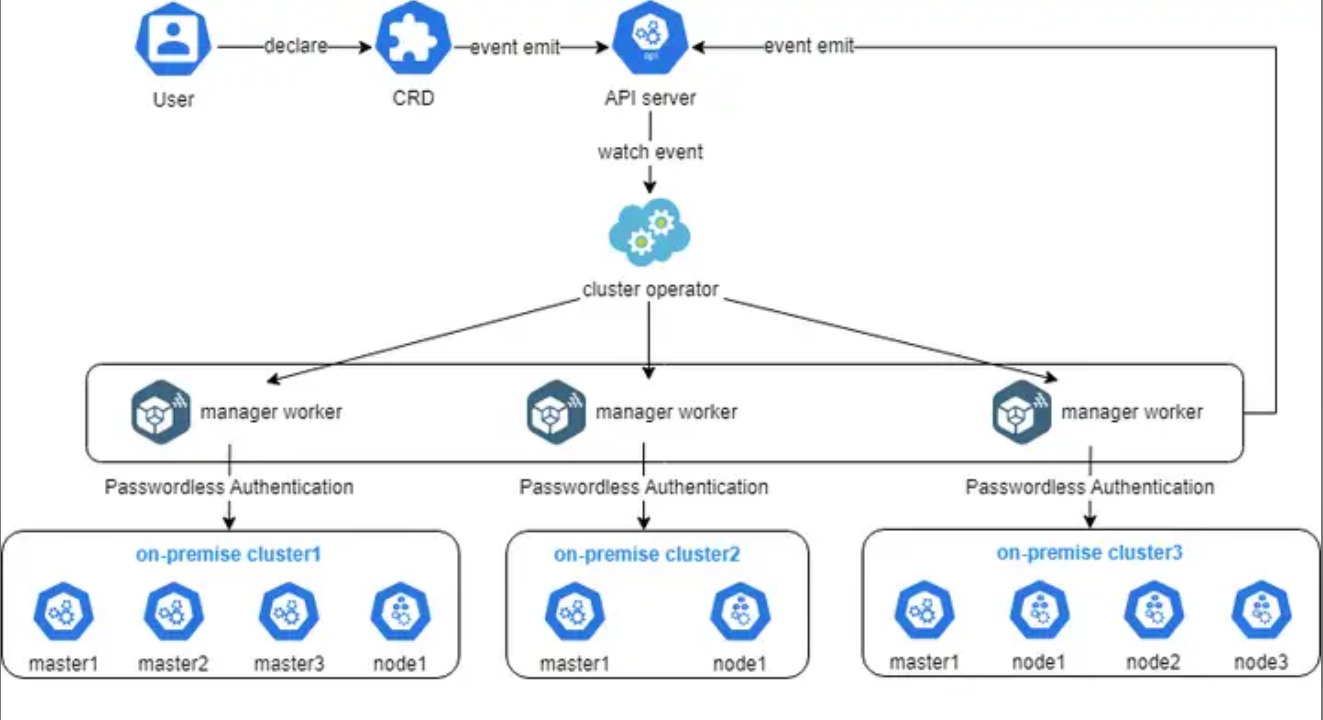

这张图展示了Cluster Operator的实现细节,其实就是用户通过声明一个CRD,触发API Server事件,然后由Operator监听并调度多个管理worker去自动对接和管理不同的本地集群,整个过程用无密码认证打通,既安全又高效:

代码拉下来了,咱们得看看 Kurator 是怎么干活的。核心就是这个 Cluster Operator。这玩意儿的实现逻辑其实非常“云原生”——它定义了一堆 CRD(自定义资源)。当你想要一个集群的时候,你不是去控制台点点点,而是写一个 YAML,告诉 Operator:“我要一个 3 节点的集群,版本 1.25”。

Operator 内部有个 Controller 一直在轮询,一旦发现你提交了这个 CRD,它就开始忙活了。它会去调用底层的基础设施 API(比如 AWS、Azure,或者是咱们本地的 Docker/Virtulization 接口),把虚拟机拉起来,把 Kubelet、Kubeadm 跑起来。这一套流程全是自动化的。这就是 Cluster Operator 的核心价值:把“人肉运维”变成了“代码逻辑”。

第二章:构建“舰队”与统一存储,让数据不再流浪

2.1 云原生舰队管理(Fleet):把散兵游勇收编

现在咱们手里有了创建集群的能力,但一个集群单打独斗没意思,咱们要的是“舰队”(Fleet)。在 Kurator 里,Fleet 就是一组逻辑上的集群集合。你可以把“北京区”的三个集群划到一个 Fleet,把“上海区”的划到另一个。

这张图讲的是云原生舰队管理,就是通过一个管理中心集群来统一管理多个下属集群,不管是创建、注册还是部署应用,都可以集中控制:

这里有个特别重要的概念,就是 Fleet 队列中服务的相同性(Sameness)。这啥意思呢?就是说,我在集群 A 里有个服务叫 user-service,在集群 B 里也有个 user-service。在 Fleet 的视角下,Kurator 得保证这俩货在逻辑上是同一个东西。这涉及到 Namespace 的一致性、Service Name 的规范化。如果这一块没做好,后面做跨集群流量调度的时候绝对炸裂。Kurator 通过标签选择器和统一的命名空间管理,强行让这些跨地域的集群“书同文、车同轨”。

2.2 存储的痛点:Kurator 统一分布式存储架构

搞定了计算资源,存储是绕不开的坎。多集群最怕啥?怕数据孤岛。集群 A 的 Pod 挂了,漂移到集群 B,结果发现 PVC(持久卷)挂载不上,因为数据还在 A 那边的盘里。这就尴尬了。

Kurator 的统一分布式存储架构,就是要解决这个问题。它不依赖特定云厂商的 EBS 或者云盘,而是倾向于使用软件定义存储(SDS)。它的思路是:在这一堆 K8s 集群之上,或者说是平行于它们,构建一个跨集群的数据平面。不管你的 Pod 跑到天涯海角,只要在 Kurator 的管辖范围内,数据卷就能跟着“飞”过去。

2.3 实战 Rook:基于 Rook 构建 Fleet 统一分布式存储

光说不练假把式,咱们用 Rook 来落地这个架构。Rook 是 Ceph 在 K8s 里的“大管家”。在 Kurator 的体系里,咱们可以通过配置,让 Rook Operator 自动在 Fleet 里的每个节点上找盘,把它们聚合起来。

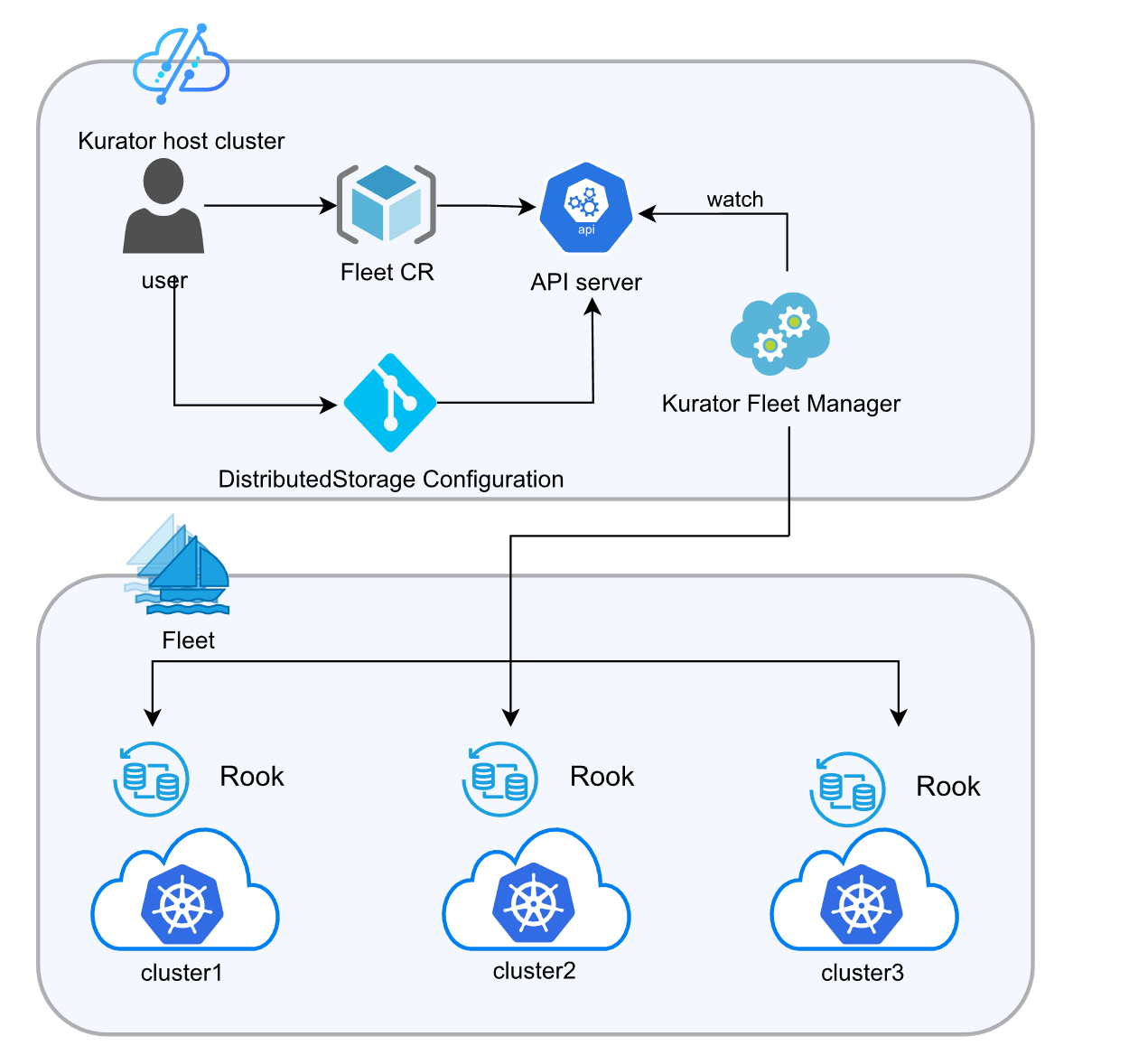

这是Fleet基于Rook构建统一分布式存储的架构图,展示了如何通过Kurator管理器统一配置多集群存储:

咱们看一段真实的配置,这可不是官方文档里那种 Hello World,这是生产环境里扒下来的精简版:

# 这是一个典型的 Rook CephCluster 配置片段

# 注意看 storage 的配置,这里直接用了 useAllNodes: true

# 生产环境咱们通常会指定 deviceFilter 来避免误伤系统盘

apiVersion: ceph.rook.io/v1

kind: CephCluster

metadata:

name: rook-ceph

namespace: rook-ceph

spec:

cephVersion:

image: quay.io/ceph/ceph:v17.2.6 # 选个稳一点的版本,别激进

dataDirHostPath: /var/lib/rook

mon:

count: 3 # 监控节点至少搞3个,不然脑裂了哭都来不及

allowMultiplePerNode: false

storage:

useAllNodes: true

useAllDevices: false

deviceFilter: "^sd[b-z]" # 兄弟们,这个正则很关键,只吃 sdb 到 sdz 的盘

config:

osdsPerDevice: "1" # 一个盘对应一个 OSD,性能比较稳

# 这一段是 Kurator 帮你自动注入的监控配置

monitoring:

enabled: true

rulesNamespace: rook-ceph

这段代码一下去,Kurator 就会指挥 Rook 把你所有集群里的空闲磁盘这一块、那一块地拼起来,变成一个巨大的资源池。以后你的应用再要 PVC,直接从这个大池子里切,根本不用管底下的物理硬盘插在哪台机器上。

第三章:流量治理与应用分发,玩转 GitOps

3.1 统一应用分发:从代码提交到全网生效

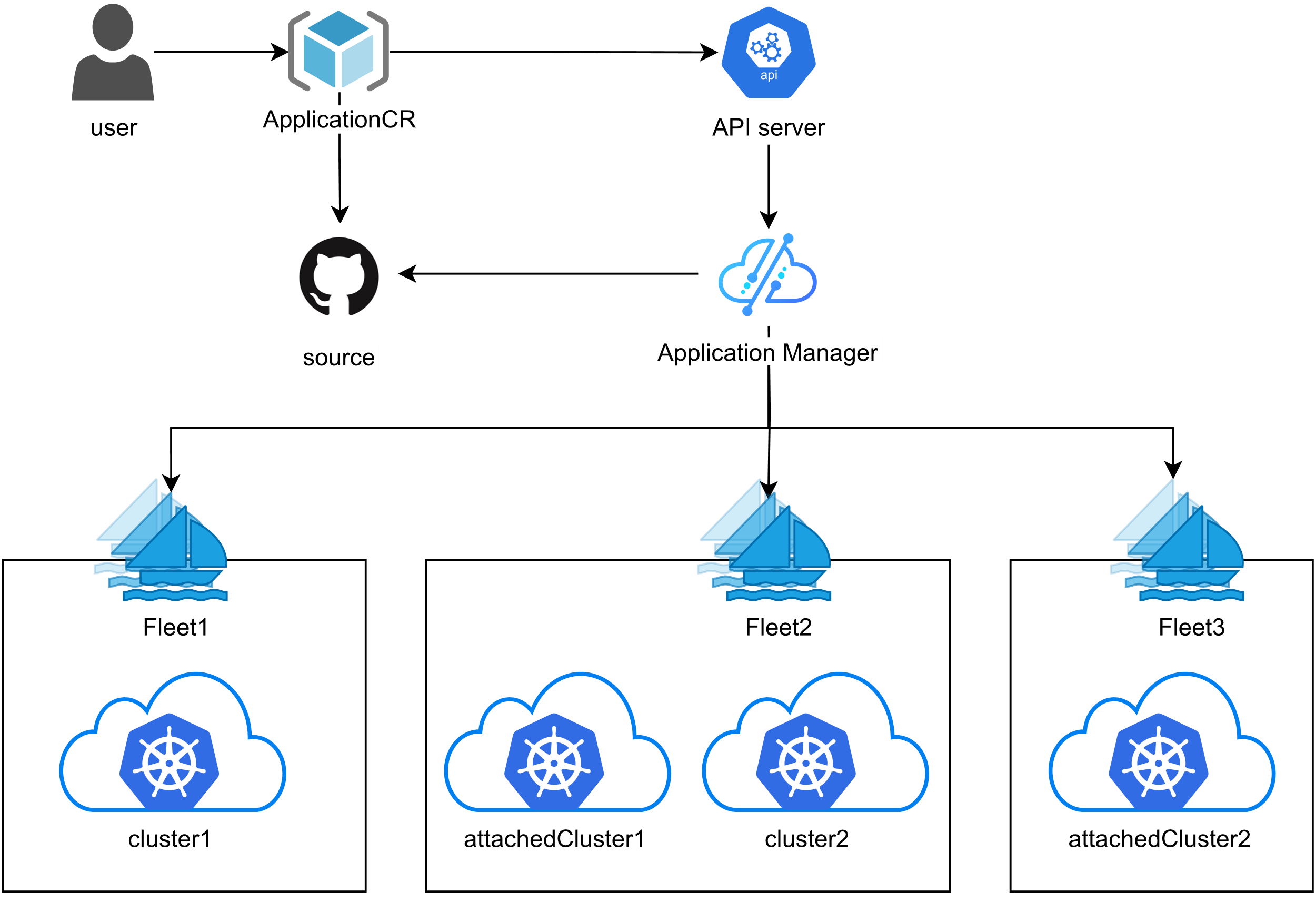

这张图展示了Kurator统一应用分发的管理架构,实现跨多集群的一致化部署和管理,整个流程简单又可控:

集群有了,存储通了,接下来就是上应用。这时候 GitOps 工作流就该登场了。咱们不用在那手动敲 kubectl apply,太 Low 了,而且容易错。Kurator 集成了 ArgoCD 这一类的 GitOps 工具,配合 Karmada 的分发能力,简直是绝配。

Kurator 的统一应用分发管理架构是这样的:你把业务代码连同 Helm Chart 往 Git 仓库里一推。GitOps Controller 检测到变化,立马拉取最新的配置。然后,注意了,它不是直接往集群里塞,而是交给 Karmada。Karmada 根据你定义的“分发策略”(PropagationPolicy),决定这个应用是发给北京的集群,还是发给纽约的集群,或者是按 50:50 的比例灰度发。

3.2 流量的大动脉:Istio 服务网格完整架构

应用发下去了,流量怎么走?这时候 Kurator 里的 Istio 组件就派上用场了。在多集群环境下,Istio 的架构稍微有点复杂。Kurator 采用的是“多主架构”或者“主从架构”的变体。通常,我们会有一个控制面(Control Plane)在主集群,或者每个业务集群有自己的控制面,但通过 Kurator 统一同步配置。

这就像是给每个集群都装了个“交警”,但这些交警听同一个指挥中心的。Istio 的 Sidecar 代理(那个 Envoy 容器)拦截了所有的进出流量。在 Kurator 的管理下,咱们不需要手动去每个集群配 VirtualService,咱们就在总控台配一次,Kurator 负责把规则同步到 Fleet 里的每一个角落。

3.3 进阶玩法:配置 AB 测试与 Karmada 集成实践

最后,咱们来个高难度的——AB 测试。老板说新功能要上线,先给 10% 的用户看,而且要是那种带特定 Header 的用户。在 Kurator 里,这事儿就是把 Karmada 的分发能力和 Istio 的流量治理结合起来。

首先,Karmada 负责把新版本(v2)的应用分发到指定的几个“金丝雀集群”或者同一集群的不同 Deployment。然后,我们通过 Kurator 下发 Istio 的流量规则。

来,看这段流量切分的配置,这才是这篇博文的灵魂所在:

# 这是一个 VirtualService 的实战配置

# 咱们通过 HTTP header 来做精准的流量路由

apiVersion: networking.istio.io/v1alpha3

kind: VirtualService

metadata:

name: shop-backend-route

namespace: production

spec:

hosts:

- shop-backend.com

http:

- match:

- headers:

x-user-type:

exact: "beta-tester" # 只有带这个标头的请求才走新版本

route:

- destination:

host: shop-backend

subset: v2 # 导流到 v2 版本

weight: 100

- route: # 其他所有吃瓜群众默认走 v1

- destination:

host: shop-backend

subset: v1

weight: 100

---

# 配合 Karmada 的分发策略,保证 v2 版本只在特定集群就位

apiVersion: policy.karmada.io/v1alpha1

kind: PropagationPolicy

metadata:

name: distribute-v2-canary

spec:

resourceSelectors:

- apiVersion: apps/v1

kind: Deployment

name: shop-backend-v2

placement:

clusterAffinity:

clusterNames:

- cluster-beijing-01 # 指定发到这个集群去抗压

第四章:总结与避坑,老司机的肺腑之言

4.1 那些年踩过的坑

兄弟们,文章最后,我得再啰嗦几句。虽然 Kurator 把这套架构封装得很好了,但在实际落地的时候,网络是最大的坑。比如 Pod IP 冲突、跨集群 Service DNS 解析超时,这些问题在 Fleet 规模大了之后很容易出现。所以在规划阶段,网段划分一定要清晰,尽量用 CNI 插件(比如 Cilium)做 overlay 网络。

4.2 回归本质

搞云原生舰队管理,工具是死的,逻辑是活的。Kurator 帮我们打通了分发、存储和网格,但怎么用好它,还得看咱们对业务场景的理解。别为了上技术而上技术,如果你的业务就跑在两个节点上,那用 shell 脚本可能比这一套都快。但如果你的目标是星辰大海,是全球同服,那这套 Kurator 的实战方案,绝对是你必须要掌握的屠龙技。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献10条内容

已为社区贡献10条内容

所有评论(0)