别再为多集群头疼了!手把手教你用 Kurator 玩转分布式云原生,实战攻略全公开

别再为多集群头疼了!手把手教你用 Kurator 玩转分布式云原生,实战攻略全公开

咱们先来盘一盘 Kurator 到底是个什么“神仙”工具 💡

兄弟们,搞云原生的肯定都深有体会:管一个 Kubernetes(K8s)集群那是享受,管十个那是折腾,管一百个分布式在不同云厂商、不同地域的集群,那简直就是噩梦。这时候,Kurator 就像是专门为咱们这些“救火队长”量身定制的“超级指挥官”。

简单来说,Kurator 不是要造一个新的 K8s,而是站在更高的维度,通过“舰队管理”的思路,把那些散落在各地的集群给拧成一股绳。不管你是要搞多云架构,还是想实现跨地域的流量调度,或者是想统一管一管安全策略,Kurator 都能帮你一站式搞定。别看它名字听着挺高大上,其实用起来特别接地气。今天我就带大家直接进场,从零开始把这套东西给“手搓”出来。

一、 核心底座:分布式云原生架构与舰队管理 🏗️

1.1 分布式云原生架构:打破集群的围墙

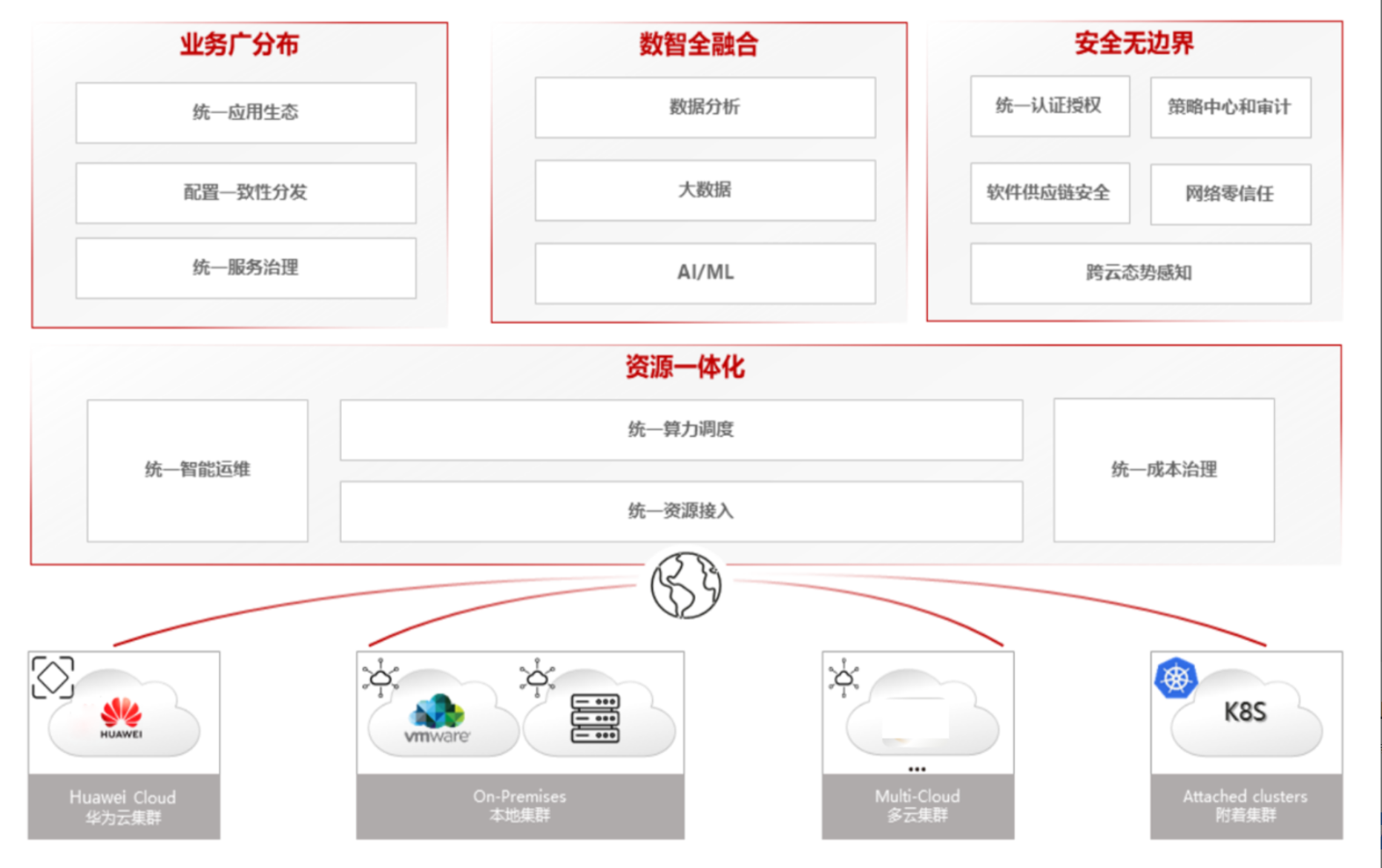

这是分布式云原生架构的参考图,展示了如何通过统一应用治理、数据融合、安全及资源调度,实现对多云、本地及边缘异构集群的一体化管理:

以前咱们聊云原生,总觉得在一个大集群里折腾就够了。但现实是,为了高可用、为了低延迟,或者是为了避开某家云厂商的“捆绑”,咱们必须走向分布式云原生架构。Kurator 的核心价值就在于此,它把原本支离破碎的资源,通过一套统一的控制平面给串起来了。

在 Kurator 架构 中,它完美地把底层基础设施的差异给屏蔽掉了。无论你的机器是物理机、虚拟机,还是各大厂的托管集群,在 Kurator 眼里,它们都是可以被编排的算力单元。

1.2 云原生舰队管理:像指挥舰队一样管集群

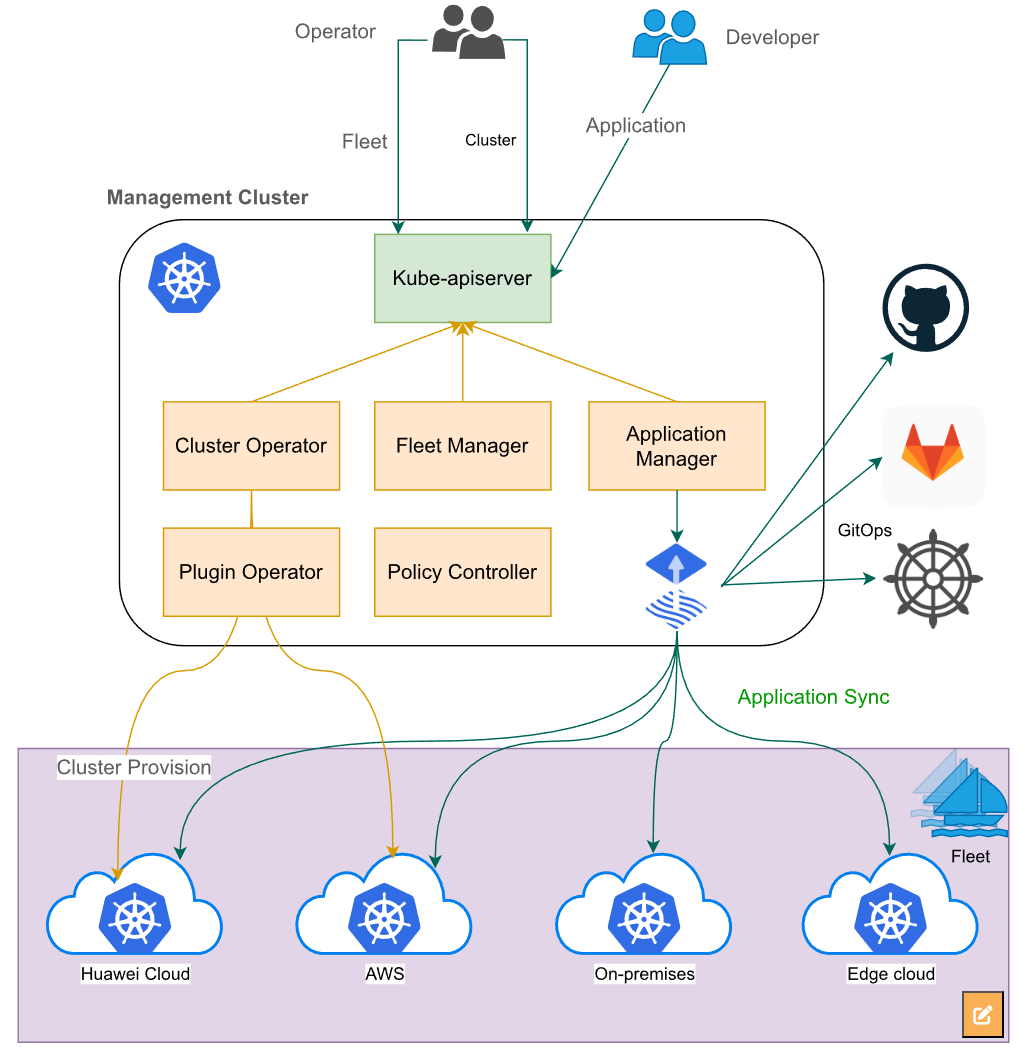

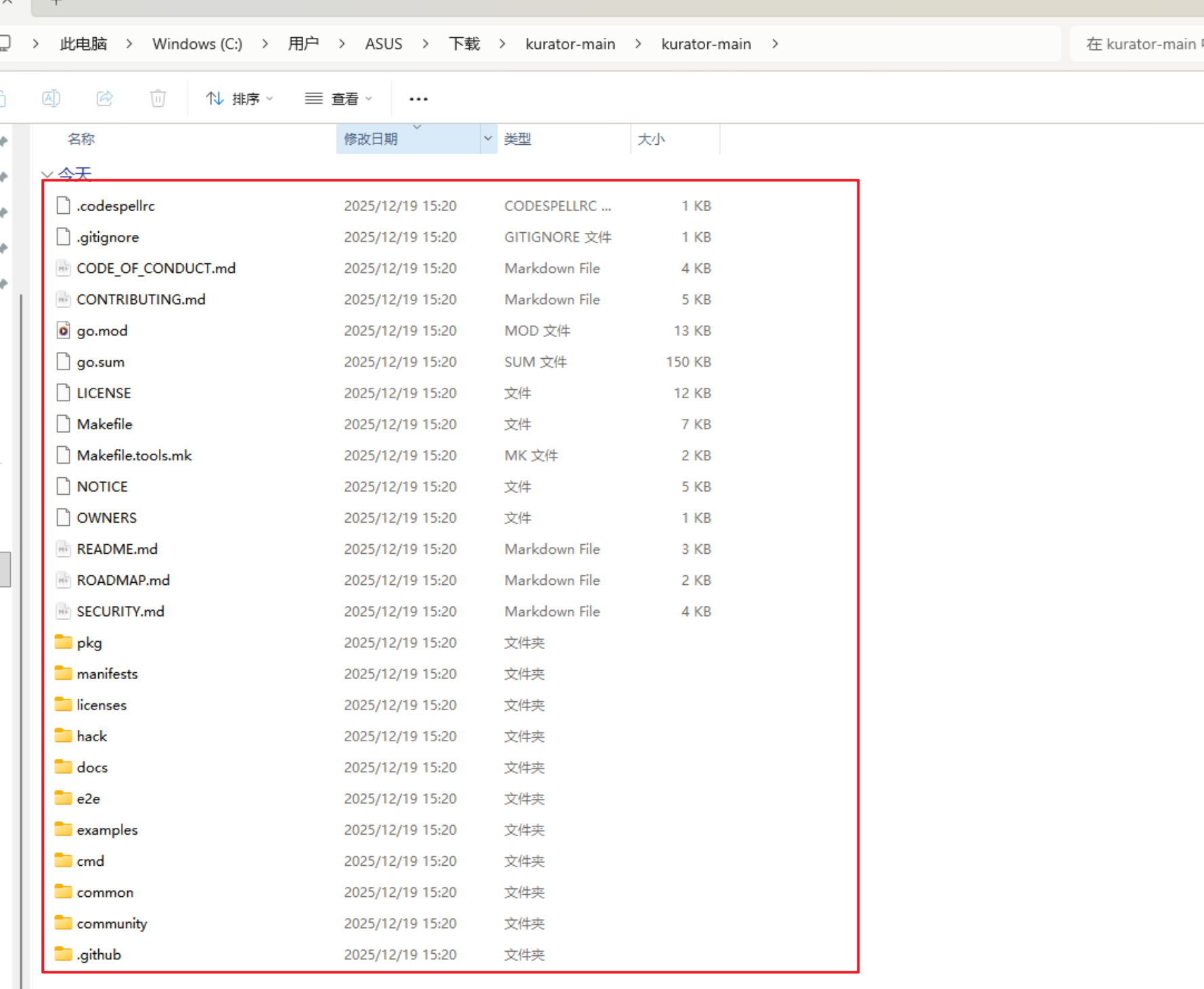

这张图讲的是云原生舰队管理,就是通过一个管理中心集群来统一管理多个下属集群,不管是创建、注册还是部署应用,都可以集中控制:

大家想象一下,如果你是舰队司令,你肯定不会去管每一艘小艇怎么加油,你只会关注整支舰队的航向。云原生舰队管理(Fleet Management)就是这个逻辑。在 Kurator 里,一个“舰队”就是一个逻辑集合,你可以把所有的开发环境集群编成一个舰队,生产环境编成另一个。

通过舰队管理,你可以实现一键式的配置分发。以前要改一百个集群的镜像仓库地址,得写一百个脚本;现在,在舰队层发个指令,Kurator 就会自动帮你同步到所有成员集群。

1.3 Kurator 平台的总体架构

从宏观来看,Kurator 平台的总体架构 可以分为“管理层”和“执行层”。管理层负责接收咱们的指令,处理复杂的逻辑,比如流量怎么分、策略怎么定;而执行层则深入到各个成员集群内部,确保每一项指令都能落到实处。这种分层设计,保证了哪怕管理层临时抽风,底下的业务集群依然能稳定运行。

二、 快速上手:环境搭建与 Cluster Operator 的奥秘 🛠️

2.1 搞定环境:先把“指挥部”盖起来

实操文嘛,废话不多说,咱们先把 Kurator 的代码拉下来。这一步是所有骚操作的开始。

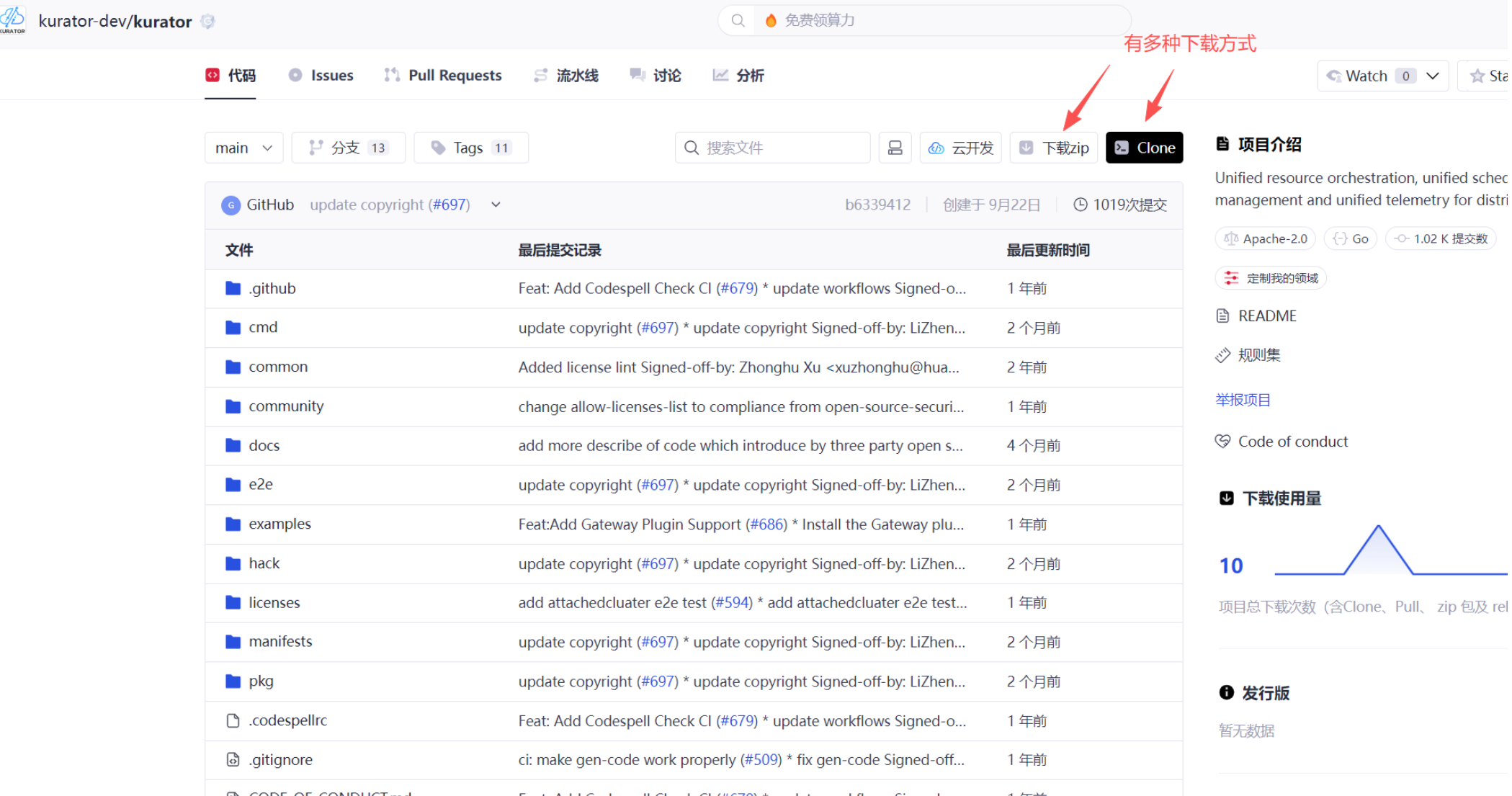

既然要玩,那没项目怎么玩嘛,所以我们第一步先来把项目下载到本地,这一步非常简单,可以直接下载或者clone

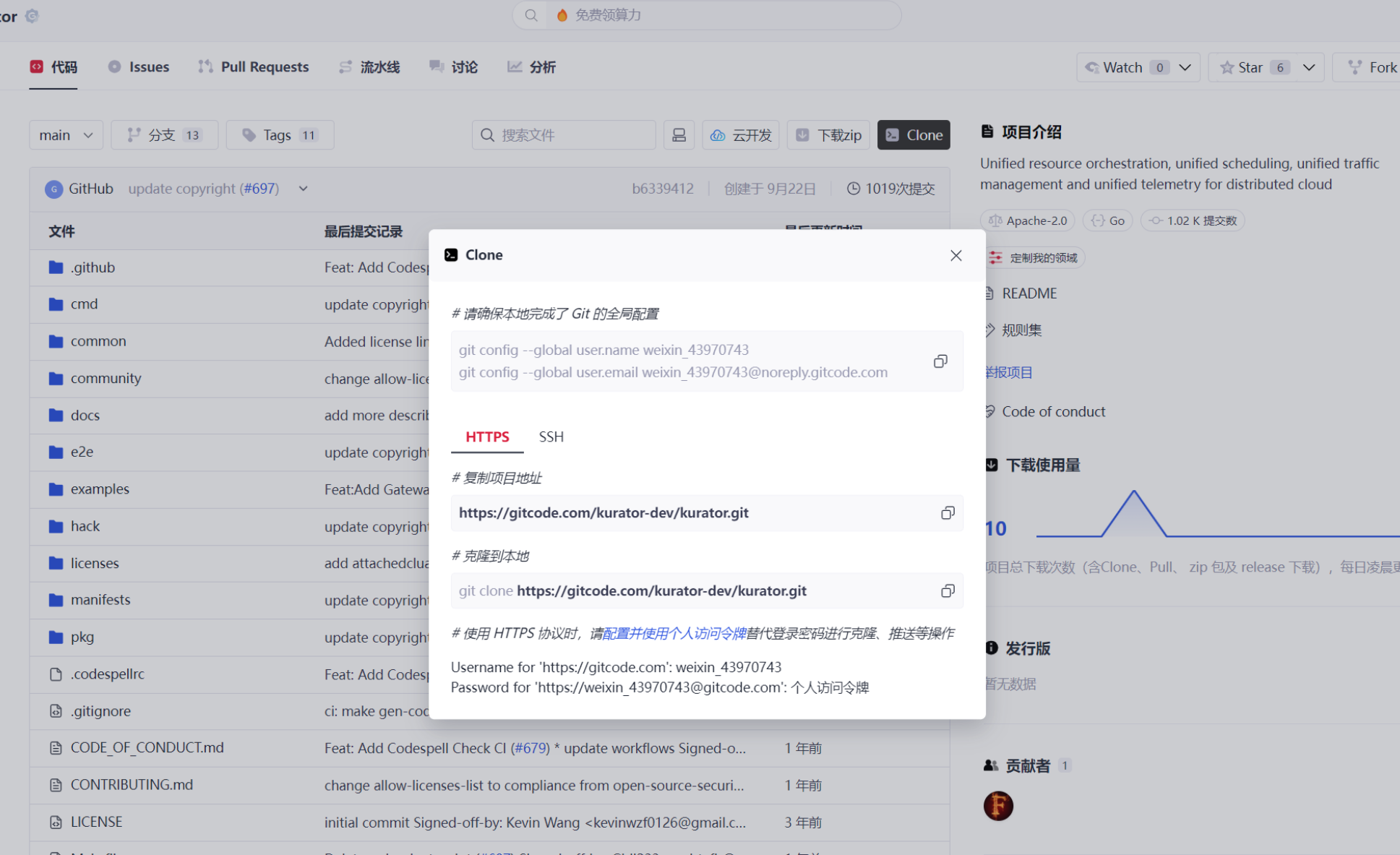

我们本地若没有安装Git插件的,那我们直接就下载zip即可。当然,我们这里直接选择通过git远程克隆吧,会高级一些~~

接着,我们输入clone 指令。

git clone https://gitcode.com/kurator-dev/kurator.git

clone之后,我们便成功拿到了完整的Kurator项目源码:

搭建环境的时候,记得先准备好一个作为“管理集群”的 K8s。Kurator 会在这个管理集群里安装一堆 Controller,用来盯着你定义的那些 CRD(自定义资源)。

2.2 Cluster Operator 的实现:集群管家的心里话

为什么 Kurator 能管那么多集群?关键就在于 Cluster Operator 的实现。它不是简单地调用 API,而是实现了一套完整的闭环逻辑。

当你定义一个集群资源时,Cluster Operator 会自动去检查底层的网络协议、证书、节点状态。如果发现某个节点的 Kubelet 挂了,它会尝试重启或者上报。这个过程对咱们运维来说是完全透明的。它就像是一个 24 小时待命的运维工程师,时刻盯着你的集群。

2.3 手搓一个 Cluster Operator 核心逻辑示例

为了让大家理解得更透彻,我简化了一下 Cluster Operator 的核心逻辑。咱们模拟一下它是怎么监控集群状态并触发更新的。

// 这是一个模拟手搓的 Cluster Operator 核心协调逻辑

// 感受一下那种声明式管理的美感

func (r *ClusterReconciler) Reconcile(ctx context.Context, req ctrl.Request) (ctrl.Result, error) {

cluster := &kuratorv1.ManagedCluster{}

// 1. 先把咱们定义的集群 CRD 给拿出来

if err := r.Get(ctx, req.NamespacedName, cluster); err != nil {

return ctrl.Result{}, client.IgnoreNotFound(err)

}

// 2. 检查一下这个集群的“生命周期阶段”

// 是刚创建?还是正在运行?还是准备销毁?

switch cluster.Status.Phase {

case "":

// 如果是新来的,那就进入初始化流程

return r.initializeCluster(ctx, cluster)

case kuratorv1.ClusterPhaseProvisioning:

// 正在盖房子,咱们得盯着进度

return r.checkProvisioningProgress(ctx, cluster)

case kuratorv1.ClusterPhaseReady:

// 集群已经 Ready,开始执行周期性的健康检查

return r.performHealthCheck(ctx, cluster)

}

return ctrl.Result{RequeueAfter: time.Minute}, nil

}

三、 精细化运营:生命周期与状态机的艺术 🔄

3.1 Kurator 集群生命周期管理

一个集群从出生到退役,要经历很多阶段:创建、加入舰队、升级、扩容、缩容、最后销毁。Kurator 集群生命周期管理 把这些过程全给自动化了。

最爽的一点是,它支持“声明式升级”。比如你想把所有集群从 K8s 1.25 升级到 1.27,你只需要在控制面改一个版本号。Kurator 会自动采用滚动升级的方式,先升级一个节点,跑一下健康检查,过了再升下一个。这就避免了那种“一键升级,全线宕机”的惨案。

这是Kurator集群生命周期管理的详细参考图,展示了从用户声明、多租户插件配置,到控制器协同工作实现异构集群统一纳管的全过程。

3.2 拆解分发流程的状态机

分发应用到几十个集群,最怕的就是状态不透明。Kurator 内部跑着一个非常硬核的分发流程的状态机。

每一个分发任务都会经历:Accepted(接收请求)-> Dispatched(已下发)-> Propagating(传播中)-> Completed(完成)或 Failed(失败)。这个状态机保证了任务的幂等性。如果同步到第 5 个集群时网络断了,状态机会记录下进度,等网络好了,它会从断点处继续,而不是从头再来。

3.3 Kubernetes 集群的标准架构与兼容

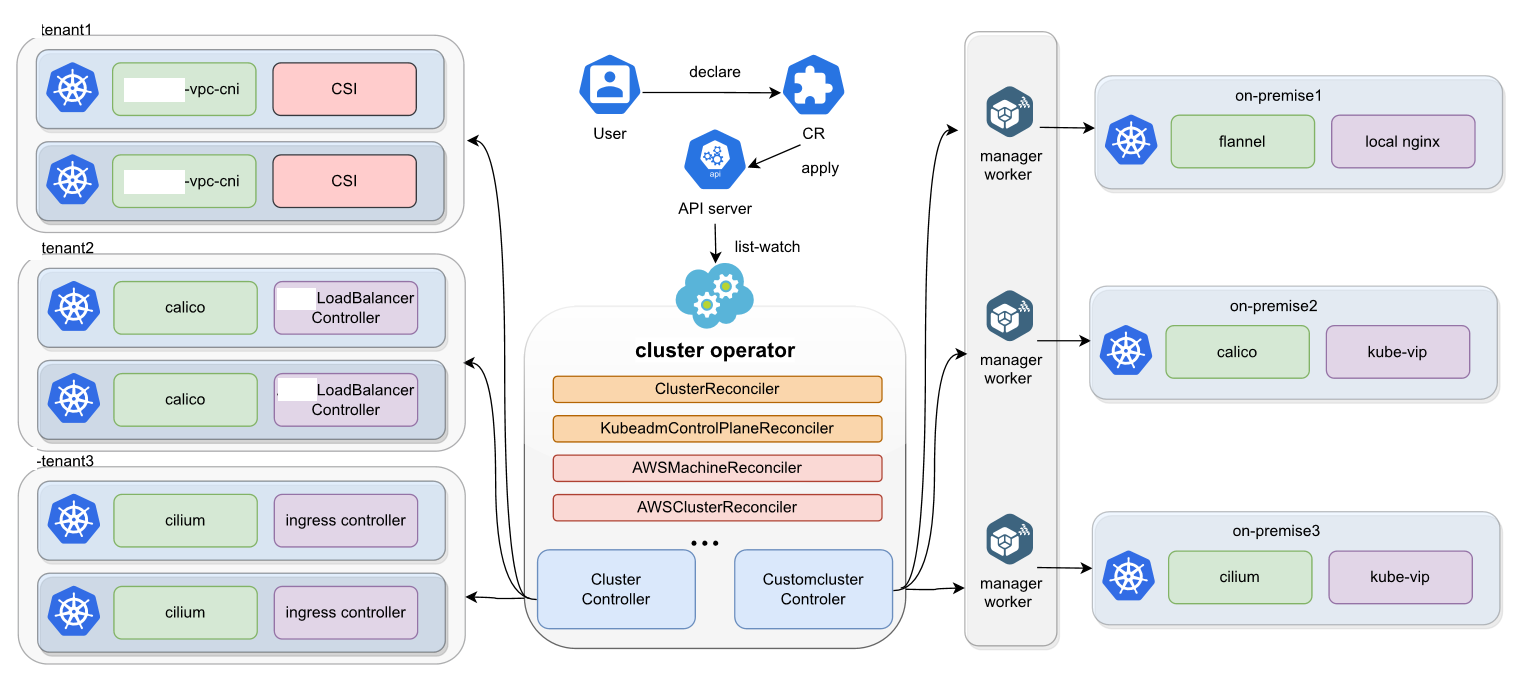

这是Kubernetes集群的标准架构参考图,展示了包含控制平面组件、工作节点及云平台集成的完整集群部署模型:

虽然 Kurator 做了很多增强,但它始终坚持 Kubernetes 集群的标准架构。这意味着你原有的 Helm Chart、YAML 文件完全不需要修改。Kurator 只是在你的标准集群外围加了一层“装甲”,让它变得更强、更好管。这种对标准的敬畏,让咱们在迁移的时候没有任何心理负担。

四、 流量与策略:如何指挥数据流精准“打击” 🚦

4.1 Kurator 的流量路由:跨越云端的桥梁

在多集群环境里,最难搞的就是流量。比如,A 集群的服务想访问 B 集群的数据库,或者是想实现根据地理位置自动路由流量。Kurator 的流量路由 机制结合了 Service Mesh 的思想,通过统一的控制面下发 Envoy 规则,让跨集群的通信变得像本地调用一样简单。

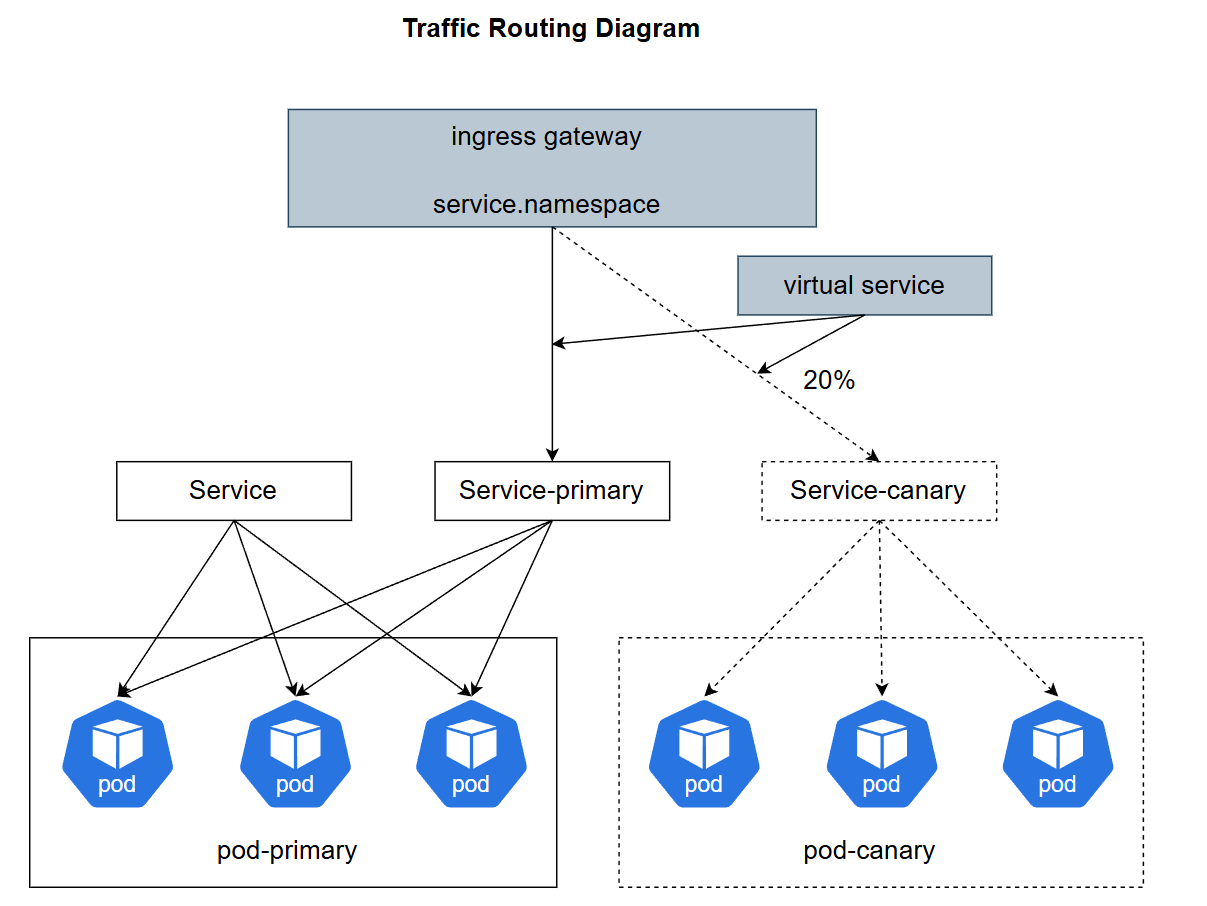

这是Kurator的流量路由参考图,展示了其如何通过入口网关和服务网格技术,在金丝雀发布中实现精确的流量分割与路由控制:

4.2 Kurator 中配置 A/B 测试

咱们做业务,肯定少不了灰度发布。在 Kurator 中配置 A/B 测试 简直是一种享受。你可以定义一套策略:比如来自上海的用户流量,80% 走旧版本集群,20% 走带新功能的新版本集群。

# 这是一个手搓的流量切分配置,贴近实操,一看就懂

apiVersion: traffic.kurator.dev/v1alpha1

kind: TrafficSplit

metadata:

name: user-service-ab-test

spec:

service: user-api

# 定义两个不同的版本权重

backends:

- clusterName: cluster-v1-stable

weight: 80 # 老版本集群拿大头流量

- clusterName: cluster-v2-beta

weight: 20 # 新版本集群拿小头流量,做灰度验证

# 还可以根据 HTTP Header 进行精准匹配

matches:

- headers:

x-user-role: "beta-tester"

destination: cluster-v2-beta

4.3 统一策略管理架构

安全是咱们的生命线。Kurator 的统一策略管理架构 允许你定义一次策略,全舰队生效。比如,你规定“所有集群都不允许使用特权容器”,你只需要写一条 Policy,Kurator 会利用各个集群的 Admission Controller 帮你死死守住这条防线。这种“上帝视角”的安全管理,比挨个集群配置要靠谱得多。

五、 高级进阶:任务调度与资源压榨 ⚡

5.1 Volcano 分组调度在 Kurator 中的妙用

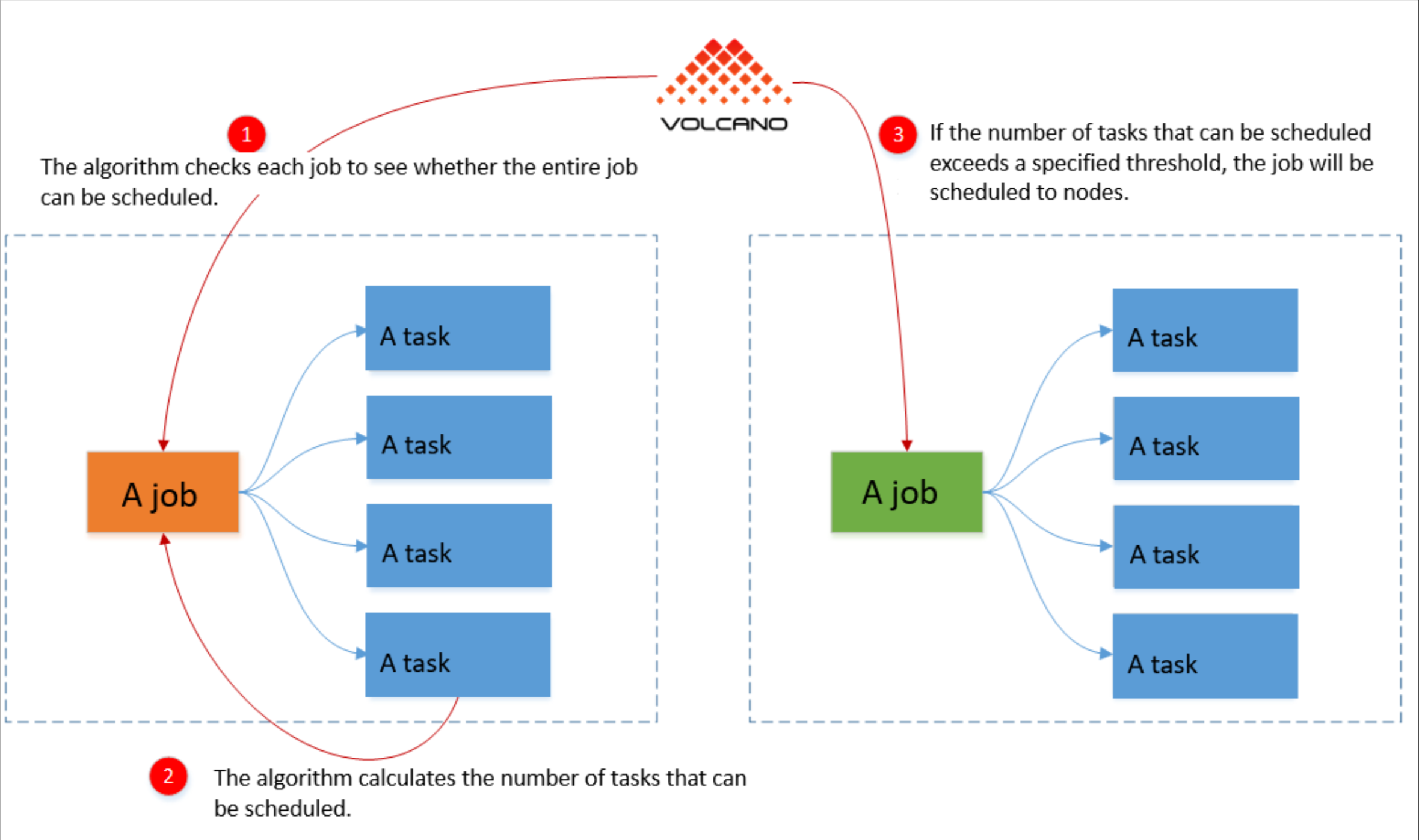

这是Volcano分组调度参考图,展示了其如何通过整体资源检查与阈值判断,实现批处理作业的成组调度与资源保障:

如果你的集群里不光跑 Web 服务,还要跑一些 AI 训练、大数据任务,那原生的 K8s 调度器可能就有点吃力了。Kurator 深度集成了 Volcano 分组调度。

Volcano 的强项在于“成组调度”(Gang Scheduling)。假设一个任务需要 10 张显卡才能跑,原生调度器可能先给它分 5 张,结果剩下的 5 张被别的任务抢走了,导致这个任务一直卡死。Volcano 的逻辑是:要么 10 张全给,要么一张都不给,这样就极大提高了资源的周转率。

5.2 实操一个 Volcano 分组调度任务

咱们来写一个简单的 Volcano 作业定义,看看它是怎么跟 Kurator 的多集群环境配合的。

# 手搓一个简单的 Volcano Job 配置

apiVersion: batch.volcano.sh/v1alpha1

kind: Job

metadata:

name: ai-training-batch

spec:

minAvailable: 3 # 核心:至少 3 个 Pod 同时到位才启动

schedulerName: volcano # 指定使用 Volcano 调度器

tasks:

- replicas: 3

name: trainer

template:

spec:

containers:

- name: training-container

image: my-ai-image:v1.0

resources:

requests:

nvidia.com/gpu: 1

5.3 总结与展望

写到这里,咱们从环境搭建到集群管理,再到流量路由和高级调度,把 Kurator 的核心能力都过了一遍。Kurator 平台的总体架构 给我们提供了一个极其稳定的基石,而那些细分的组件,比如 Cluster Operator、状态机、Volcano 等,则是咱们手中的武器。

最后咱们对比一下核心概念,防止记混 📝

| 功能点 | 解决的问题 | 实操核心 |

|---|---|---|

| 舰队管理 | 集群太多,手忙脚乱 | 逻辑分组,一键配置同步 |

| 状态机分发 | 发布过程像黑盒,怕断点 | 严格的 Phase 迁移,保证幂等 |

| 流量路由 | 跨云访问难,灰度上线难 | 权重切分,AB 测试配置 |

| Volcano 调度 | 算力被闲置,AI 任务难跑 | 成组调度,资源压榨 |

| 统一策略 | 安全合规无法统一审计 | 声明式策略,全局强制执行 |

各位老铁,云原生这条路,说简单也简单,说难也难。有了 Kurator 这种“神兵利器”,咱们运维和开发的压力确实减轻了不少。但别忘了,工具再好,也得靠咱们这一双“手搓”出来的手去掌握。

如果你现在正被几十个集群折腾得睡不着觉,赶紧去 GitCode 把 Kurator 跑起来试试。相信我,只要你迈出第一步,那种“运筹帷幄之中,决胜千里之外”的感觉,真的会上瘾!

有什么实操中的坑,或者哪块逻辑没绕清楚,欢迎随时找我探讨。咱们云原生这条路上,大家一起抱团取暖,一起牛 X!加油!

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献13条内容

已为社区贡献13条内容

所有评论(0)