【前瞻创想】手搓分布式云原生架构,从环境搭建到多集群实战的全能指南 [特殊字符]

【前瞻创想】手搓分布式云原生架构,从环境搭建到多集群实战的全能指南 🚀

分布式云原生这玩意儿,听着高大上,其实说白了就是怎么让你在几十个甚至上百个集群里,像指挥一个人一样指挥千军万马。

Kurator 这哥们儿出现的正是时候。它不是在造什么“新轮子”,它是把业界那些已经封神的工具——像 Karmada、Istio、Volcano、Kyverno 什么的——给整合成了一个“超级控制台”。你可以把它看成是一个“云原生全家桶”,不仅帮你把地基打好,连上面的水电煤(网络、安全、调度)全给配齐了。

🛠️ 第一站:先别急着写代码,环境搭建得稳如老狗

很多人一听说要搞“分布式云原生架构”,第一反应就是:那得多少机器啊?其实在咱们本地,用几个容器模拟一下就能玩得转。咱们的实战就从最基础的拉取代码开始。

源码入坑与基础准备

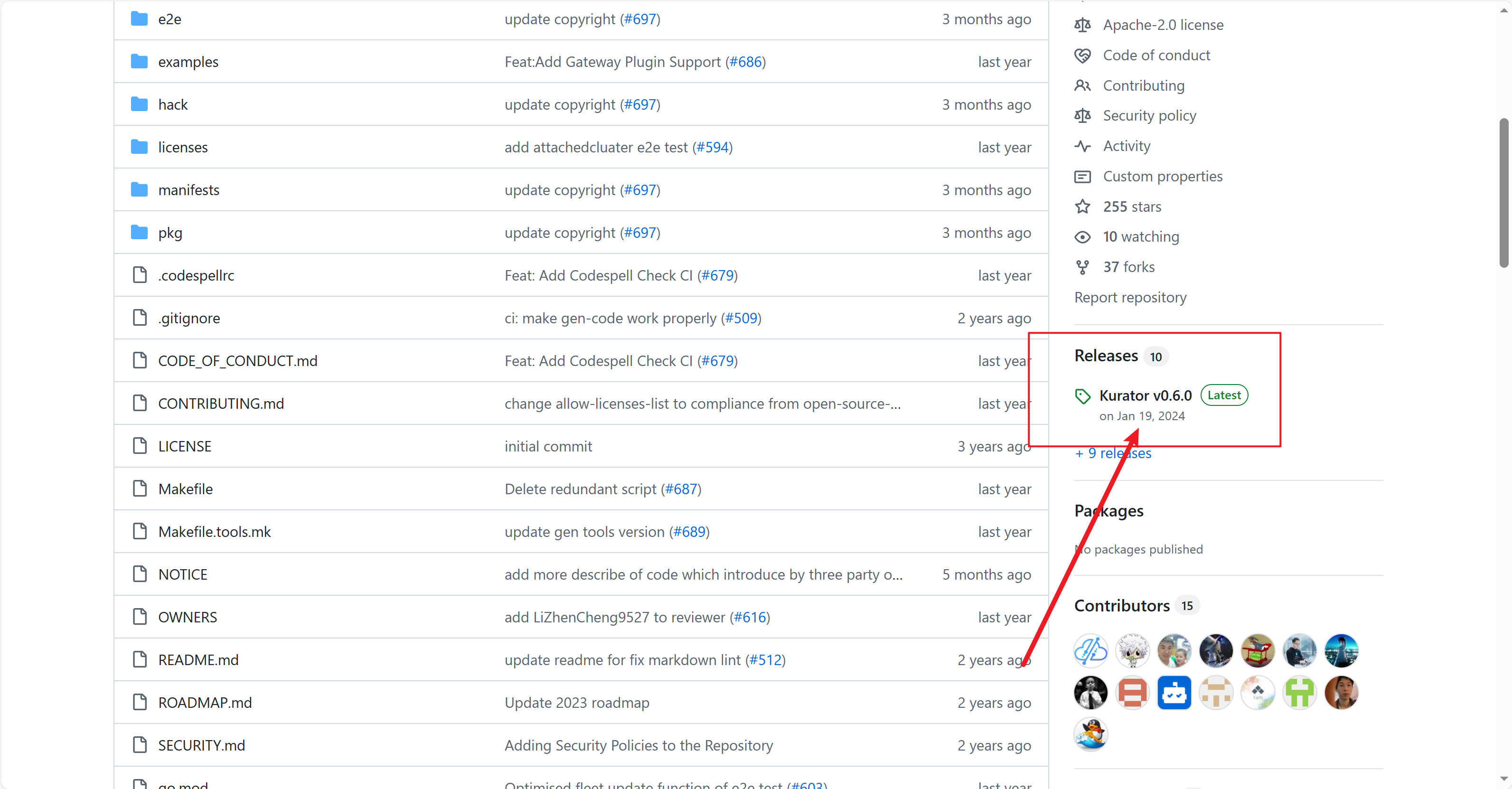

你要想深入了解一个项目,光看文档是不够的,得看它的“内脏”。所以,咱们第一步就是去 Kurator 开源项目的 GitHub 主页 逛逛,顺便把代码拽下来。

我们可以从github上面下载源码,我把源码标注出来啦

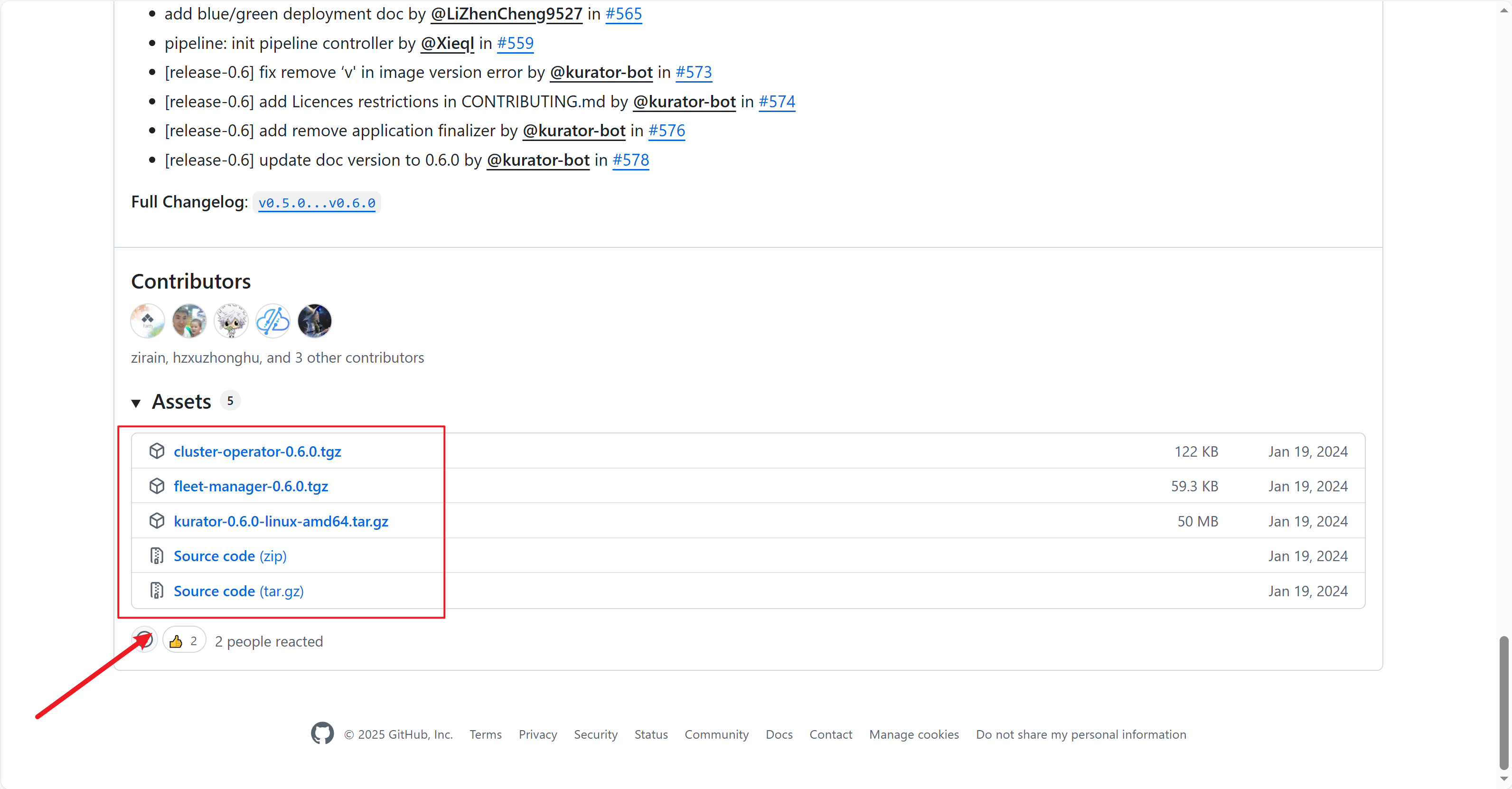

点击后拉到最下面就可以看到源码压缩包啦,不同需求的朋友可以下载不同平台的源码

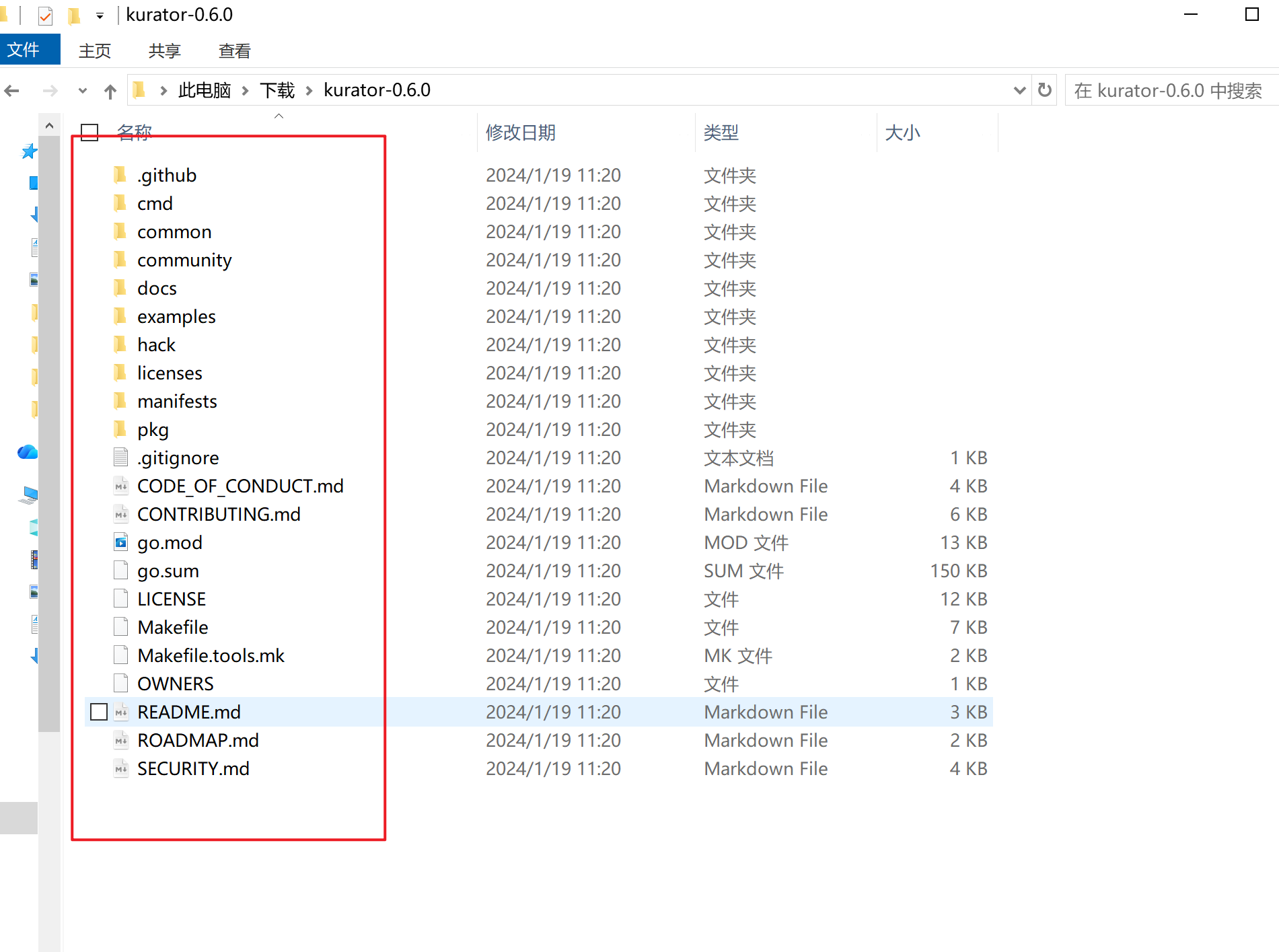

下载下来解压就可以看到源码文件啦

环境初始化脚本手搓

别整那些复杂的安装命令了,我给你手写一个简单的初始化脚本。这个脚本能帮你把主集群和成员集群的架子搭起来,省得你一个个敲 kind create cluster。

#!/bin/bash

# 这是一段手搓的 Kurator 环境预检与初始化脚本

echo "--- 正在启动我的分布式云原生实验室 ---"

# 定义集群名称

HOST_CLUSTER="kurator-host"

MEMBER_CLUSTER="kurator-edge-1"

# 1. 创建主控集群

if ! kind get clusters | grep -q $HOST_CLUSTER; then

kind create cluster --name $HOST_CLUSTER

echo "✅ 主控集群 $HOST_CLUSTER 已就位"

fi

# 2. 创建一个模拟的边缘集群

if ! kind get clusters | grep -q $MEMBER_CLUSTER; then

kind create cluster --name $MEMBER_CLUSTER

echo "✅ 边缘集群 $MEMBER_CLUSTER 已就位"

fi

# 3. 切换上下文到主集群

kubectl config use-context kind-$HOST_CLUSTER

echo "🚀 环境 Ready!现在你可以去探索 Kurator 架构的奥秘了。"

观察 Kurator 分发流程的状态机

环境搭好了,当你尝试往集群里扔一个资源时,Kurator 分发流程的状态机 就开始转动了。这玩意儿就像是一个快递追踪系统。它会经历 Pending(打包中)、Dispatched(运输中)、Acknowledged(对方已签收)这些状态。你在主集群改一下配置,状态机就会自动发现差异,然后像个勤劳的小蜜蜂一样把更新同步过去。如果同步失败了,它还会自动重试,直到最终状态一致。

🏗️ 第二站:拆解 Kurator 的“骨架”与策略心脏

搞定了环境,咱们得聊聊 Kurator 架构 到底是怎么设计的。它为什么能管得住那么多乱七八糟的集群?

核心蓝图:分布式云原生架构

在 分布式云原生架构 中,最核心的痛点是“割裂”。你的应用可能跑在阿里云,也可能跑在自家机房的边缘节点上。Kurator 的做法是建立一个统一的平面。Kurator 的统一策略管理架构 就是为了解决“政出多门”的问题。你不需要在 A 集群配置一遍防火墙,又去 B 集群配置一遍准入规则。你在 Kurator 这一端定义好 Policy,它自动会帮你翻译并分发到各个角落。

身份的奥秘:Fleet 队列中身份相同性

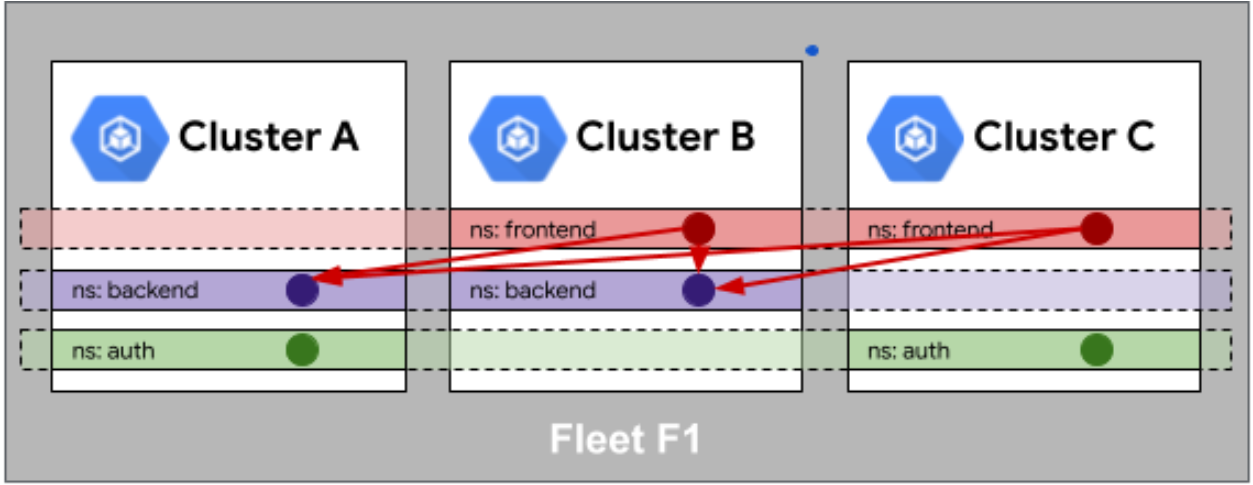

这是Fleet队列中身份相同性的官方示意图,直观展示了跨集群的命名空间与部署服务间关联映射关系:

多集群里最怕的是什么?是身份冲突。我在主集群叫 admin,分发到子集群是不是还叫 admin?Fleet 队列中身份相同性 这个设计非常精妙。它确保了在一个 Fleet(集群舰队)里,同一个 ServiceAccount 或者 User 的身份是互认的。这为你后续做跨集群的权限控制打下了铁一样的基础,不会出现“你是谁?你从哪来?”这种尴尬的哲学问题。

安全护航:Fleet 基于 Kyverno 的多集群策略管理架构

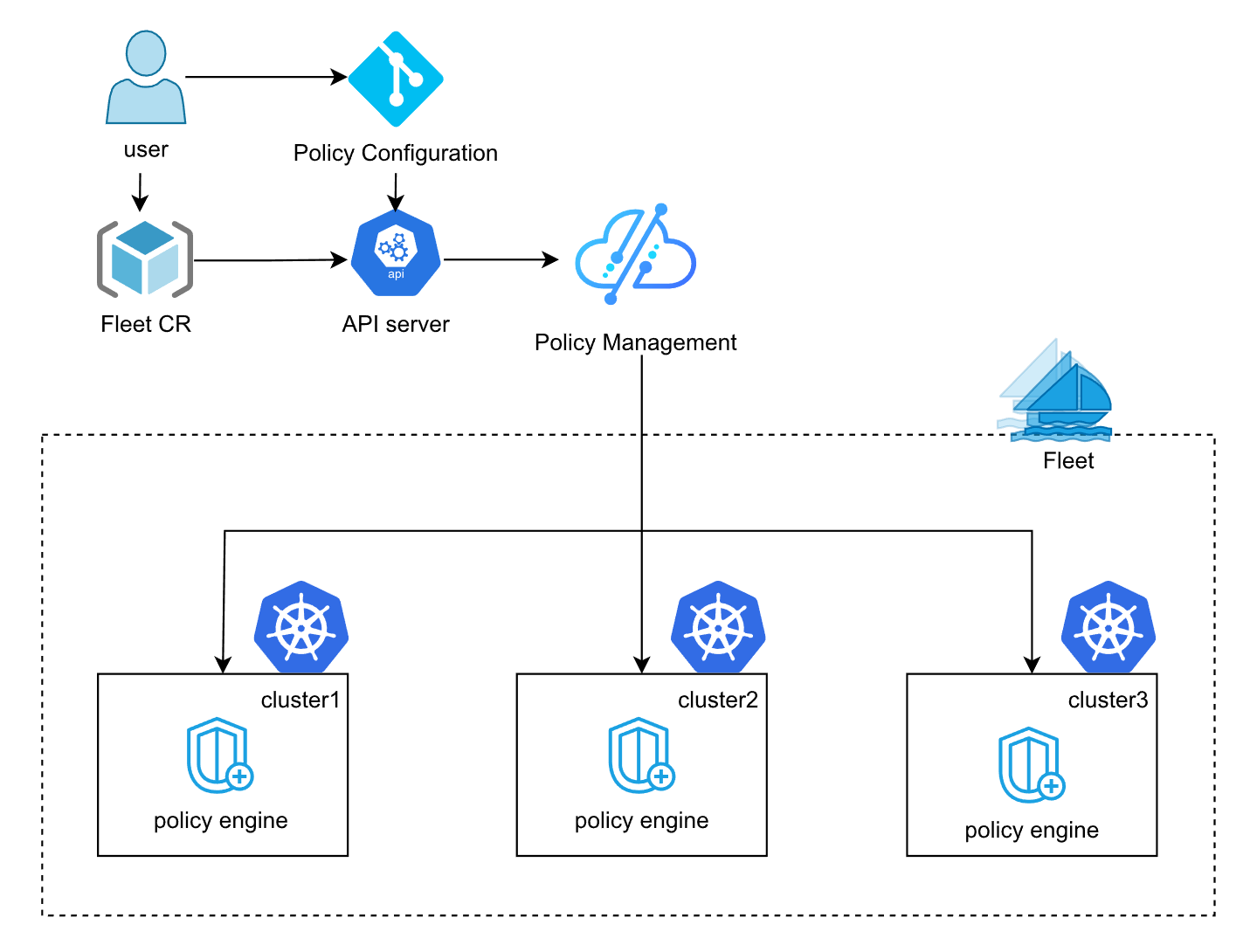

这是Fleet基于Kyverno的多集群策略管理架构图,展示了策略配置如何通过Fleet分发到各集群执行引擎:

既然身份搞定了,那规矩怎么定?这就得靠 Fleet 基于 Kyverno 的多集群策略管理架构 了。Kyverno 这东西好就好在它不用写复杂的 Rego 语言,直接写 YAML 就能搞定。

| 功能点 | 说明 | 实战意义 |

|---|---|---|

| 策略定义 | 在 Fleet 级别定义统一的 Kyverno 规则 | 一处定义,全舰队生效 |

| 自动修复 | 发现配置不合规,自动进行 Mutate 修改 | 强制所有 Pod 必须带上业务标签,不带就不让跑 |

| 跨集群同步 | Kurator 负责把这些规则“空投”到子集群 | 运维人员再也不用手动去每个集群 apply 策略了 |

🚀 第三站:多集群调度的“大杀器”:Karmada 与 Volcano

如果说 Kurator 是大脑,那 Karmada 就是它的双手。

动力之源:Karmada 多集群管理平台的核心架构

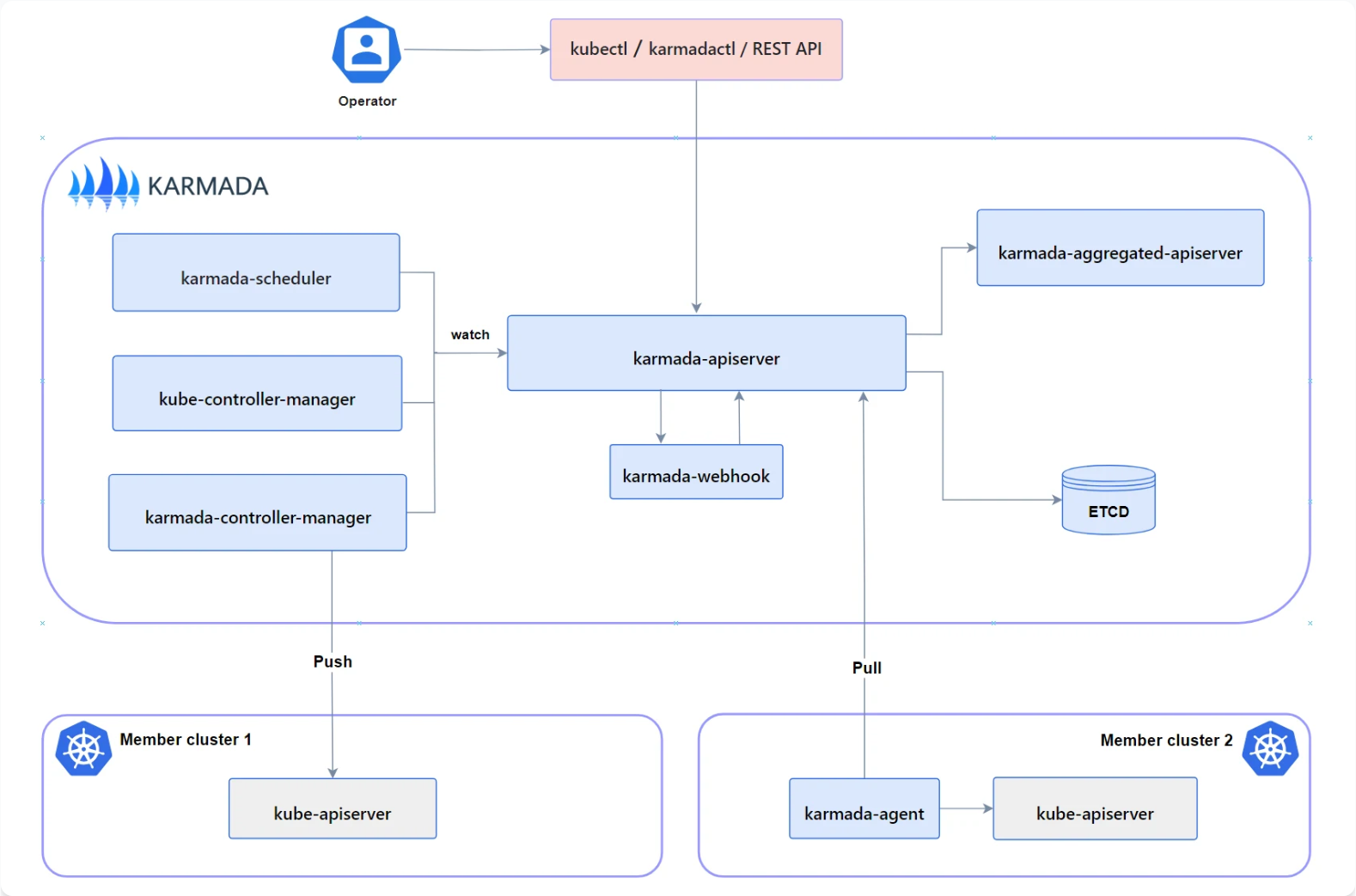

这是Karmada多集群管理平台的核心架构图,展示了控制平面如何通过推送和拉取两种模式与成员集群进行协同管理:

Karmada 多集群管理平台的核心架构 提供了极其强大的资源分发能力。它把复杂的 K8s 原生对象做了抽象,让你可以定义“我想把这个应用发给上海和北京的集群,比例是 6:4”。这种精细化的控制,是单集群完全无法想象的。Kurator 深度集成了 Karmada,把这种能力通过更简单的接口暴露给了用户。

弹性起飞:Karmada 跨集群弹性伸缩策略

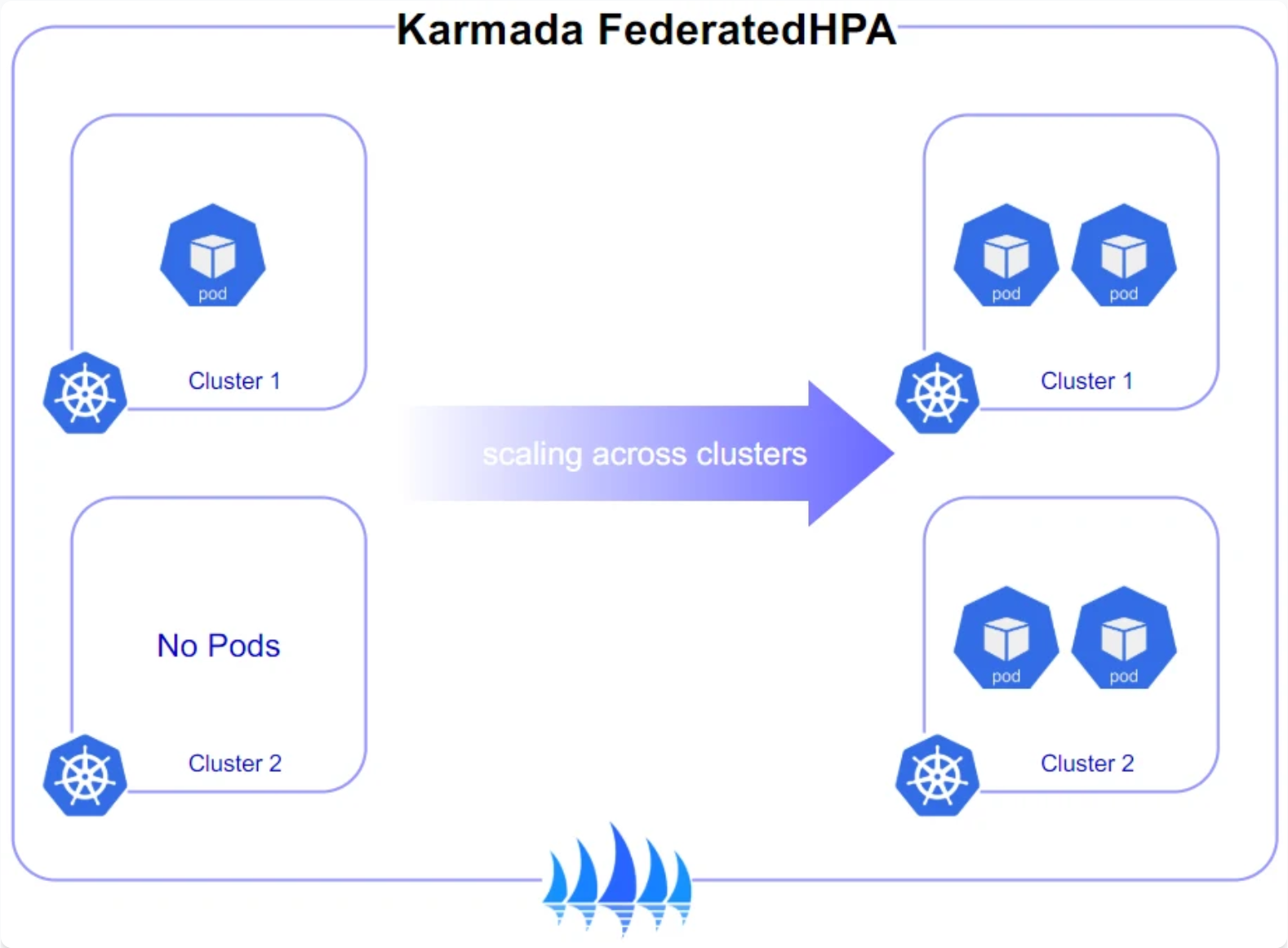

这是Karmada跨集群弹性伸缩策略参考图,展示了其如何通过FederatedHPA策略在多个成员集群间协调Pod副本数实现统一伸缩:

业务突然爆量了怎么办?单集群资源满了怎么搞?Karmada 跨集群弹性伸缩策略 派上用场了。它可以监测全域的资源水位。比如上海集群 CPU 飙升到 80% 了,它能自动感应到,并在资源还算宽裕的成都集群里多开几个副本。这种“乾坤大挪移”式的伸缩,才是真正的分布式云原生。

高性能补丁:Volcano 分组调度

对于跑 AI 训练或者大数据作业的兄弟来说,普通的调度器太弱了。Kurator 引入了 Volcano 分组调度。Volcano 的核心在于 Gang Scheduling。

# 手搓一个简单的 Volcano Job 示例,感受一下成组调度的逻辑

apiVersion: batch.volcano.sh/v1alpha1

kind: Job

metadata:

name: kurator-ai-training

spec:

minAvailable: 3 # 核心逻辑:最少得有3个副本同时启动,否则一个都不跑

schedulerName: volcano

tasks:

- replicas: 5

name: worker

template:

spec:

containers:

- name: train-container

image: my-ai-image:v1

resources:

requests:

cpu: "2"

这种“成组调度”能有效避免资源碎片化导致的死锁,是高并发、高性能计算场景下的必选方案。

🌐 第四站:连接边缘与服务:GitOps 与 Istio 网格

最后咱们得聊聊怎么把触角伸向边缘,以及怎么让这些服务互相说话。

末梢神经:GitOps 边缘计算

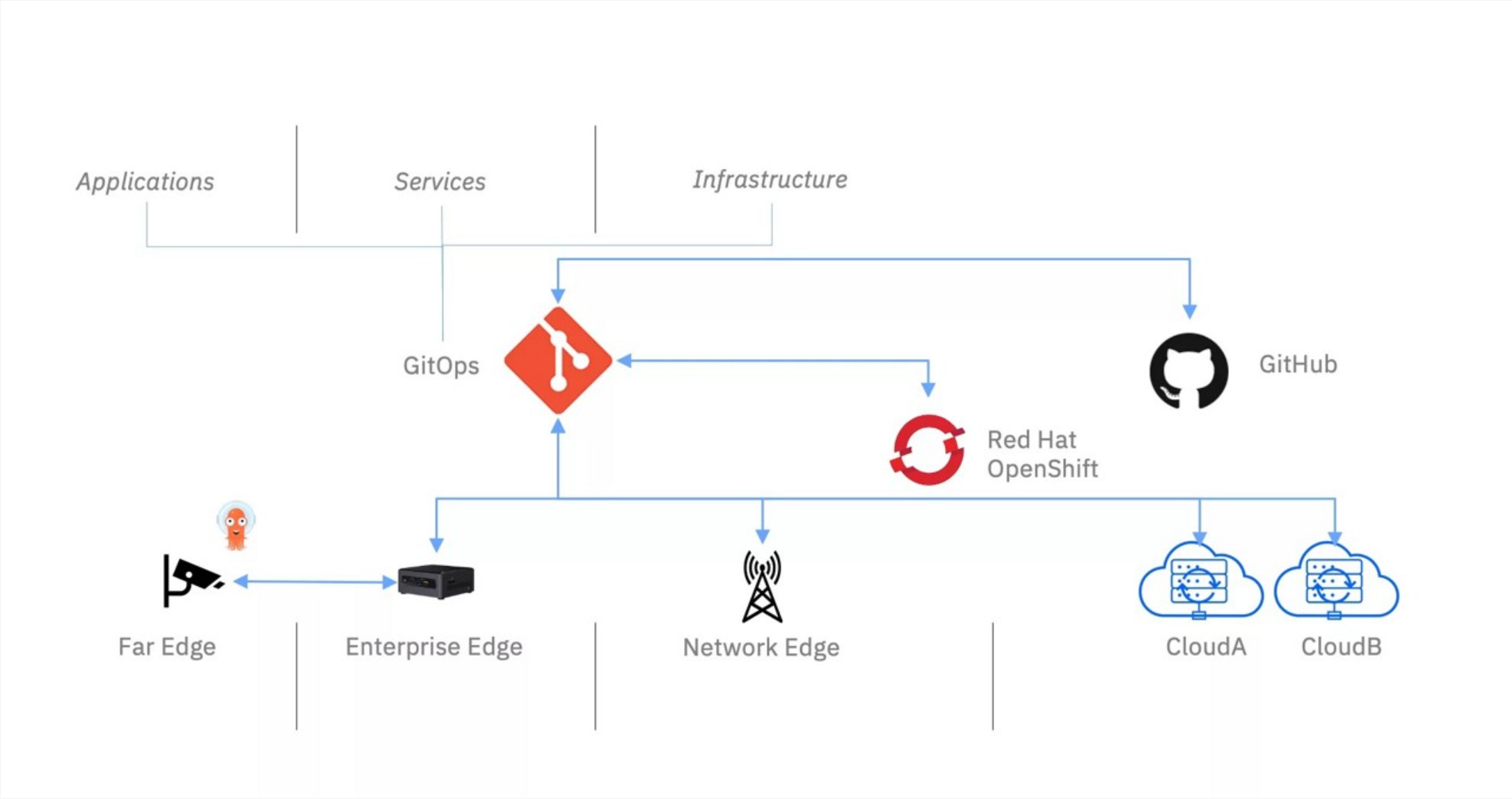

这是GitOps边缘计算的官方参考图,展示了从应用到基础设施如何在从远边缘到云的多层级实现统一声明式管理:

边缘节点(比如工厂里的工控机、路边的监控)网络往往不稳定。直接从主集群往边缘推配置,大概率会超时报错。所以 Kurator 采用了 GitOps 边缘计算 的模式。边缘节点不听主集群的“实时命令”,而是盯着 Git 仓库看。主集群想改配置,就往 Git 里 push 一下,边缘节点等网络通了自己去拉。这种“拉模式”极大地提高了边缘架构的容错性。

流量导向:Istio 服务网格

这么多集群,服务之间怎么通信?Istio 服务网格 就是干这个的。它在 Kurator 体系里构建了一个跨集群的 Service Mesh。不管你的服务是在私有云还是公有云,通过 Istio 的东西向流量治理,它们就像在一个局域网里一样顺滑地互相调用。

下面我手搓一段 Istio 的网关配置,用来演示如何把流量引入这个复杂的分布式架构。

# 手搓一个简单的 Istio Gateway 和 VirtualService

apiVersion: networking.istio.io/v1alpha3

kind: Gateway

metadata:

name: kurator-global-gateway

spec:

selector:

istio: ingressgateway

servers:

- port:

number: 80

name: http

protocol: HTTP

hosts:

- "my-app.kurator.com"

---

apiVersion: networking.istio.io/v1alpha3

kind: VirtualService

metadata:

name: route-to-multi-cluster

spec:

hosts:

- "my-app.kurator.com"

gateways:

- kurator-global-gateway

http:

- route:

- destination:

host: my-service-shanghai

weight: 70

- destination:

host: my-service-beijing

weight: 30

实战总结:把所有点串起来

到这里,咱们把 Kurator 的全貌看清了。

| 核心组件 | 解决什么问题 | 关键技术点 |

|---|---|---|

| 分布式管理 | 解决集群散乱、割裂 | 分布式云原生架构、Karmada 核心架构 |

| 统一调度 | 解决资源利用率与弹性 | Volcano 分组调度、弹性伸缩策略 |

| 策略安全 | 解决多集群合规与身份 | Fleet 身份相同性、Kyverno 策略管理 |

| 边缘与网格 | 解决复杂网络与离线同步 | GitOps 边缘计算、Istio 服务网格 |

📝 专家寄语:Kurator 的未来不仅仅是“管”

写了这么多,大家应该能感觉到,Kurator 实际上是在帮我们“减负”。它把那些复杂的分布式逻辑给封装起来,让我们这些苦逼的运维和开发能把精力放在业务逻辑上,而不是天天去调那些该死的网络插件。

如果你还没尝试过,赶紧按照前面的步骤,去 Kurator 开源项目的 GitHub 主页 逛逛。从 git clone 开始,亲手感受一下 Kurator 分发流程的状态机 是如何精准工作的。

云原生的下半场,拼的就是“分布式管理”的能力。别等你的集群多到管不过来的时候才后悔没早点上手 Kurator。有什么问题,尽管在社区留言,咱们一起探讨。

祝大家的集群永不宕机,代码零 Bug!回见!👋

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献21条内容

已为社区贡献21条内容

所有评论(0)