【探索实战】Kurator 构建企业级分布式云原生平台的深度实践

【探索实战】Kurator 构建企业级分布式云原生平台的深度实践

在过去几年,云原生技术生态在国内外快速爆发,从 Kubernetes 单集群走向多集群、从集中式控制走向分布式调度、从单一云厂商绑定走向多云并存。Kurator 的出现,为「分布式云原生平台」提供了一条真正可落地的道路。它不是一个新的编排系统,而是站在 Kubernetes 生态之上,整合 Karmada、Istio、KubeEdge、Volcano、Prometheus 等优秀项目,让分布式云原生环境的构建从复杂工程演进到可开箱即用的体系化方案。

一、体验 Kurator:从单集群到分布式云原生的“加速器”

1. Kurator 安装环境准备

我们最初的目标是构建 “三地五中心” 的分布式云原生环境,包含边缘节点、两类业务集群以及一个跨云的中央管理平面。传统做法需要自行编译 Karmada、安装 Istio、设计多集群网格拓扑、部署监控与策略治理体系。而 Kurator 则对这些进行了结构化封装。

使用 kuratorctl 安装

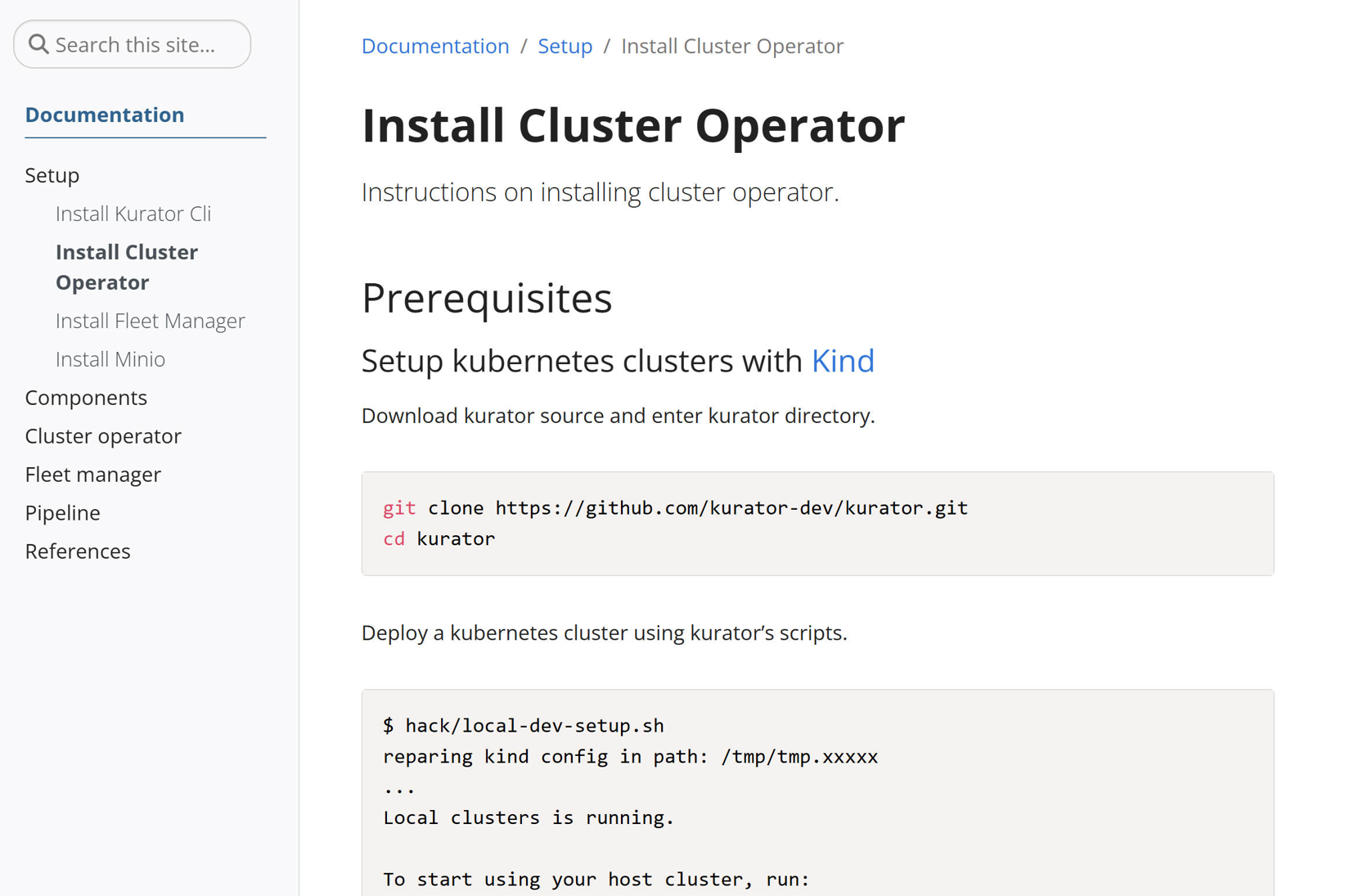

以下是我在 PoC 阶段使用的最简启动流程(Linux 环境):

curl -LO https://github.com/kurator-dev/kurator/releases/latest/download/kuratorctl

chmod +x kuratorctl

sudo mv kuratorctl /usr/local/bin/

# 创建一个最简控制面

kuratorctl init --enable-karmada --enable-istio --enable-observability

第一次安装过程中遇到的主要问题是:

问题1:控制面节点 CPU 不足导致 Istiod Pending

原因是默认 istiod Request 设置偏高,测试环境只有 2C。

解决方式如下:

kubectl -n istio-system patch deploy istiod \

-p '{"spec":{"template":{"spec":{"containers":[{"name":"discovery","resources":{"requests":{"cpu":"200m"}}}]}}}}'

问题2:Karmada webhook 未及时启动,kurator 状态检查失败

这是因为节点镜像拉取慢,增加 imagePullPolicy 与 registry 镜像加速后即可解决。

二、Kurator 核心能力实践:以集群生命周期治理与统一应用分发为例

我们在落地区域主要使用 Kurator 的两个能力:

- Cluster LifeCycle(集群生命周期管理)

- Application Distribution(统一应用分发)

1. 集群生命周期治理:让多集群不再是配置地狱

在引入 Kurator 之前,管理十几个业务集群需要:

- 单独维护 kubeconfig

- 手动管理 ClusterRole/CRD

- 自行打通多集群网络

- 统一监控靠 Prometheus Federation 编排

Kurator 对此做了完整抽象:

kuratorctl register cluster --name prod-cluster-1 \

--kubeconfig ./prod1.kubeconfig

注册成功后,控制面自动完成:

- 集群健康检查

- CRD 同步

- 跨集群访问凭证下发

- 自动纳管进 Karmada

这一点直接解决了以往多集群管理的运维复杂度,并且后续升级也只需一条命令:

kuratorctl upgrade cluster prod-cluster-1 --version v1.30

这种“声明式升级”在我们团队内部被认为是 Kurator 最有价值的能力之一。

2. 应用分发:基于 Karmada 的增强版本,真正做到多集群一致性

Kurator 引入 Karmada 作为多集群调度和分发核心,但在企业实践中,裸用 Karmada 会遇到以下问题:

- Placement 策略过于复杂

- 多集群 Istio sidecar 未对齐

- 应用 CRD 国际化能力不足(Helm/Kustomize 混合分发较难)

Kurator 针对这些做了增强,以下是一段真实使用中的分发 YAML(示例为多集群灰度发布):

apiVersion: apps.kurator.dev/v1alpha1

kind: MultiClusterApp

metadata:

name: payment-service

spec:

template:

apiVersion: apps/v1

kind: Deployment

spec:

replicas: 3

template:

spec:

containers:

- name: payment

image: hub.example.com/payment:v1.2

placement:

clusters:

- name: prod-cluster-1

weight: 80

- name: prod-cluster-2

weight: 20

traffic:

strategy: istio

rules:

- cluster: prod-cluster-2

percentage: 20

在业务灰度流程中,我们可以动态调整权重,实现真正意义上的 跨集群灰度发布。这是之前基于原生 Karmada 与 Istio 几乎无法做到的能力。

三、企业级落地经验:从技术选型到生态协同

1. 为什么最终选择 Kurator?

我们曾试过 4 套方案:

| 方案 | 问题 |

|---|---|

| 原生 Kubernetes + 自研多集群控制器 | 开发成本巨大 |

| Rancher + Istio | 多云一致性弱,扩展性差 |

| 自建 Karmada | 架构复杂、可维护性弱 |

| Kurator(最终选择) | 封装合理、生态完整、可扩展性优 |

Kurator 的优势主要体现在:

- 多项目生态统一整合(Karmada + Istio + Observability)

- 企业级声明式 API

- 分布式架构可扩展至边缘场景

- 基于 CNCF 项目的二次增强,但保持兼容

它解决了我们在分布式云原生平台遇到的 80% 痛点。

四、深度实战案例:三地五中心的分布式应用治理体系

我们最终构建的架构如下:

- 中央控制面(Kurator):统一治理中心

- 华东/华南主站:主要业务集群(Karmada 管理)

- 边缘站点:KubeEdge 集群(Kurator 自动适配)

- 数据服务特化集群:与 Volcano 集成,用于批计算任务

落地效果:

1. 业务部署效率提升 70%

统一应用分发后,业务团队不再需要维护多套 YAML 和 kubeconfig。

2. 跨中心容灾从小时级降低到分钟级

通过 Placement 动态调整和 Istio 流量治理,我们实现了跨集群级别的流量迁移。

3. 监控体系重构成本降低 50%

得益于 Kurator 的统一 Observability,我们无需自己维护 Prometheus Federation。

五、专业思考:Kurator 的未来突破点

作为一名深度参与云原生生态的工程师,我认为 Kurator 后续可以在三个方向持续创新:

1. 多集群调度智能化

引入机器学习策略,根据:

- 节点压力

- 应用特征

- 流量指标

实现自适应 Placement 和流量调度。

2. 边缘计算的更强融合

目前 KubeEdge 方案已较成熟,但仍缺乏:

- 边缘/中心混合调度

- 异构设备管理

- 边缘模型推理协同

Kurator 可以成为连接云、边、端的“统一控制面”。

3. 面向行业的治理模板化

例如:

- 金融行业的多活模板

- IoT 的边缘自治模板

- 游戏行业的全球分布式部署模板

Kurator 完全可以成为行业场景的一套标准化解决方案体系。

总结

Kurator 不是简单的多集群管理工具,而是 新一代分布式云原生平台的“架构加速器”。从企业实践来看,它极大降低了多集群治理成本,让团队能够把精力集中在业务创新,而不是底层编排工程。

如果你正在寻找可落地的云原生分布式体系,Kurator 值得深入尝试。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献6条内容

已为社区贡献6条内容

所有评论(0)