【探索实战】基于Kurator构建分布式云原生平台的实战之旅——从环境搭建到生态协同

第一章 引言:为什么选择Kurator?

在云原生技术蓬勃发展的大背景下,分布式云原生平台成为企业实现资源高效调度、应用快速交付、运维智能化的核心载体。然而,构建这样的平台面临诸多挑战:多集群管理的复杂性、流量治理的精细度要求、监控与策略的一致性保障等。Kurator作为专注于分布式云原生场景的开源项目,提供了一套完整的解决方案,涵盖集群生命周期治理、应用分发、流量治理、监控与策略管理等核心能力。

1.1 研究背景与意义

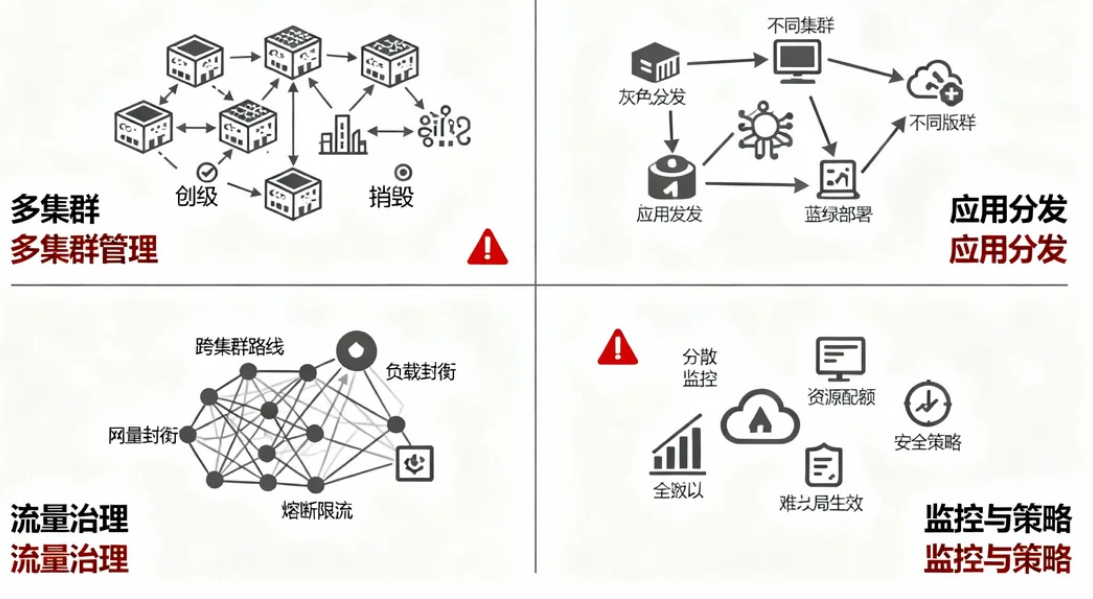

随着企业业务上云的深入,分布式云(将云服务部署在多个地理位置,通过网络互联)成为主流架构。传统云原生平台(如Kubernetes原生方案)在多集群管理、跨地域流量调度、统一运维等方面存在不足:

- 多集群管理:缺乏统一的生命周期治理工具,集群创建、升级、销毁流程碎片化。

- 应用分发:不同集群的应用版本同步困难,难以实现灰度发布、蓝绿部署。

- 流量治理:跨集群的流量路由、负载均衡、熔断限流策略难以统一配置。

- 监控与策略:多集群的监控数据分散,策略(如资源配额、安全策略)难以全局生效。

Kurator的出现填补了这一空白:它基于Kubernetes生态,扩展了分布式云原生的能力,支持多集群的集中化管理、应用的统一分发、流量的智能治理、监控与策略的全局协同。对企业而言,Kurator能降低云原生架构的复杂度,提升资源利用率,加速业务创新。

1.2 Kurator的核心能力

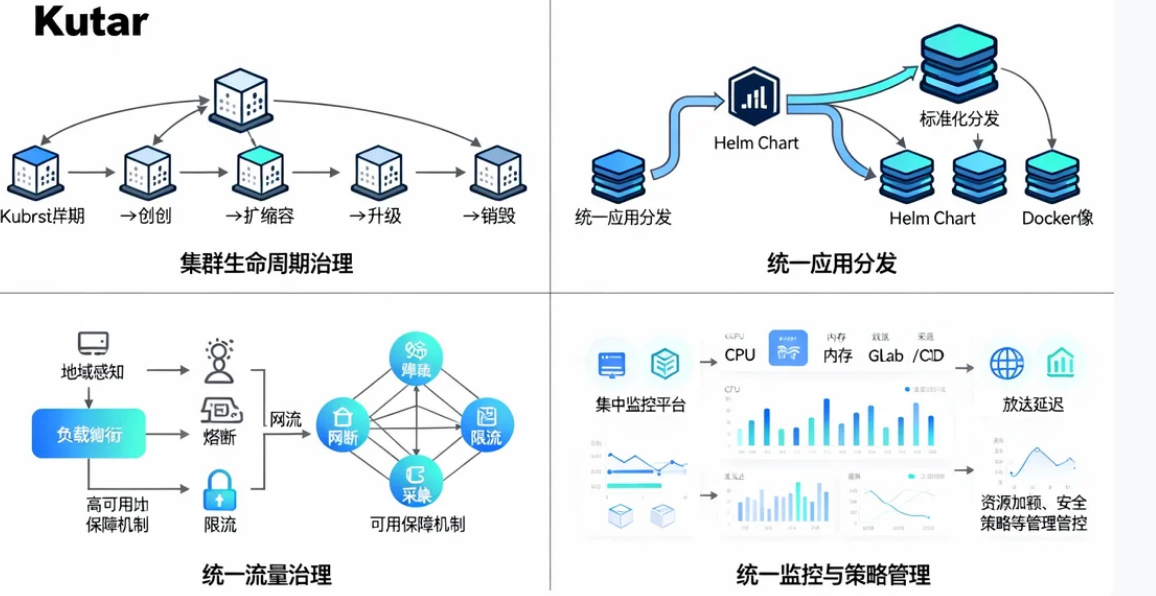

Kurator的核心模块包括:

- 集群生命周期治理:支持集群的创建、扩容、缩容、升级、销毁等全生命周期操作,提供统一的控制平面。

- 统一应用分发:基于镜像或Helm Chart,实现应用在多集群的批量部署、灰度发布、回滚。

- 统一流量治理:支持跨集群的流量路由(如地域感知路由)、负载均衡、熔断、限流,保障服务高可用。

- 统一监控与策略管理:收集多集群的监控指标(如CPU、内存、请求延迟),并基于策略(如资源配额、安全策略)进行全局管控。

1.3 研究目标与结构

本文的目标是通过实战,详细阐述基于Kurator构建分布式云原生平台的全过程,包括:

- 环境搭建:从基础环境准备到Kurator的安装与配置。

- 功能使用:深入体验集群生命周期治理、应用分发、流量治理、监控与策略管理等核心功能。

- 案例实战:以某企业(或个人项目)为例,分享Kurator的落地过程、技术挑战与解决方案、商业效益与生态价值。

第二章 Kurator环境搭建:从0到1的基础准备

2.1 基础环境准备

构建Kurator分布式云原生平台的前提是搭建稳定的基础环境,包括:

2.1.1 硬件要求

- 服务器配置:建议至少3台物理机或虚拟机,每台配置:CPU≥4核,内存≥16GB,磁盘≥50GB(根据集群规模调整)。

- 网络要求:服务器之间网络互通,开放必要的端口(如Kubernetes的6443、Kurator的控制端口等)。

2.1.2 软件依赖

- 操作系统:推荐使用CentOS 7+/Ubuntu 18.04+,本文以CentOS 7为例。

- Docker:Kubernetes和Kurator依赖Docker作为容器运行时,需安装并配置Docker(版本≥19.03)。

- Kubernetes:Kurator基于Kubernetes,需先部署Kubernetes集群(单master或多master,本文以单master测试环境为例)。

2.2 Kurator安装流程

Kurator的安装分为二进制安装和Helm安装两种方式,本文以Helm安装为例(更简单、易维护)。

2.2.1 安装Helm

Helm是Kubernetes的包管理工具,需先安装Helm:

# 下载Helm二进制文件(以v3.8.0为例)

curl -LO https://get.helm.sh/helm-v3.8.0-linux-amd64.tar.gz

tar -zxvf helm-v3.8.0-linux-amd64.tar.gz

sudo mv linux-amd64/helm /usr/local/bin/

# 验证安装

helm version

2.2.2 添加Kurator Helm仓库

helm repo add kurator https://kurator.github.io/charts/

helm repo update

2.2.3 安装Kurator

创建命名空间并安装Kurator:

kubectl create namespace kurator-system

helm install kurator kurator/kurator --namespace kurator-system

2.2.4 验证安装

检查Kurator的Pod是否正常运行:

kubectl get pods -n kurator-system

# 输出示例:

# NAME READY STATUS RESTARTS AGE

# kurator-controller-manager-0 1/1 Running 0 5m

2.3 安装过程中的常见问题及解决

2.3.1 Docker版本不兼容

问题:安装Kubernetes时,Docker版本过低(如<19.03),导致kubelet启动失败。

解决:升级Docker到最新稳定版(如20.10.17):

# 卸载旧版本

sudo yum remove docker docker-client docker-client-latest docker-common docker-latest docker-latest-logrotate docker-logrotate docker-engine

# 安装新版本(以CentOS为例)

sudo yum install -y yum-utils device-mapper-persistent-data lvm2

sudo yum-config-manager --add-repo https://download.docker.com/linux/centos/docker-ce.repo

sudo yum install docker-ce docker-ce-cli containerd.io

sudo systemctl start docker

sudo systemctl enable docker

2.3.2 Kubernetes集群初始化失败

问题:执行kubeadm init时,出现“节点未就绪”或“网络插件安装失败”。

解决:

- 检查网络连通性:确保所有节点能访问Kubernetes API Server(默认端口6443)。

- 安装网络插件(如Calico):

kubectl apply -f https://docs.projectcalico.org/v3.21/manifests/calico.yaml

2.3.3 Helm安装时仓库访问失败

问题:执行helm repo add时,提示“超时”或“连接拒绝”。

解决:

- 检查网络代理:如果使用代理,需配置

http_proxy和https_proxy环境变量。 - 更换镜像源:使用国内镜像(如阿里云):

helm repo add aliyun https://kubernetes.oss-cn-hangzhou.aliyuncs.com/charts helm repo update

2.4 环境验证:部署一个测试应用

为了验证Kurator环境是否正常,我们部署一个简单的Nginx应用:

# 创建命名空间

kubectl create namespace test

# 部署Nginx

kubectl run nginx --image=nginx:latest --namespace test

# 暴露服务

kubectl expose pod nginx --port=80 --target-port=80 --namespace test

# 访问验证

kubectl get svc -n test

# 输出示例:

# NAME TYPE CLUSTER-IP EXTERNAL-IP PORT(S) AGE

# nginx ClusterIP 10.96.123.456 <none> 80/TCP 1m

# 然后在集群内访问:curl 10.96.123.456

第三章 Kurator功能深度体验:从体验到分析

3.1 集群生命周期治理

Kurator的集群生命周期治理模块提供了统一的控制平面,支持集群的创建、扩容、缩容、升级、销毁等操作。

3.1.1 集群创建流程(代码示例)

通过Kurator的API或CLI创建一个新的Kubernetes集群:

# 伪代码:使用Kurator Python SDK创建集群

from kurator.client import KuratorClient

client = KuratorClient(server="https://kurator-server:8443", token="your-token")

cluster_config = {

"name": "cluster-east",

"provider": "kubernetes", # 或其他提供商(如AWS、Azure)

"nodes": 3,

"node_type": "standard",

"network": "10.0.0.0/16"

}

cluster = client.clusters.create(cluster_config)

print(f"Cluster {cluster.name} created with ID: {cluster.id}")

3.1.2 集群扩容(代码流程图)

3.1.3 作用分析

集群生命周期治理的价值在于:

- 标准化:统一集群的创建、升级流程,减少人为错误。

- 自动化:自动完成节点扩容、缩容,提升运维效率。

- 可视化:通过Kurator的Dashboard查看集群状态(如节点数、资源使用率),便于监控。

3.2 统一应用分发

Kurator的统一应用分发模块支持应用的批量部署、灰度发布、回滚,基于Helm Chart或镜像实现。

3.2.1 应用分发流程

通过Kurator的API分发一个Nginx应用到多个集群:

# 伪代码:使用Kurator Python SDK分发应用

from kurator.client import KuratorClient

client = KuratorClient(server="https://kurator-server:8443", token="your-token")

app_config = {

"name": "nginx-app",

"chart": "nginx-stable/nginx-ingress", # Helm Chart地址

"version": "4.0.13",

"clusters": ["cluster-east", "cluster-west"], # 目标集群列表

"values": {

"replicaCount": 2,

"ingressClass": "nginx"

}

}

deployment = client.applications.deploy(app_config)

print(f"Application {deployment.name} deployed to clusters: {deployment.clusters}")

3.2.2 灰度发布

3.2.3 作用分析

统一应用分发的价值在于:

- 一致性:确保所有集群的应用版本一致,减少版本碎片化。

- 灵活性:支持灰度发布、蓝绿部署,降低变更风险。

- 效率:批量部署应用,减少重复操作。

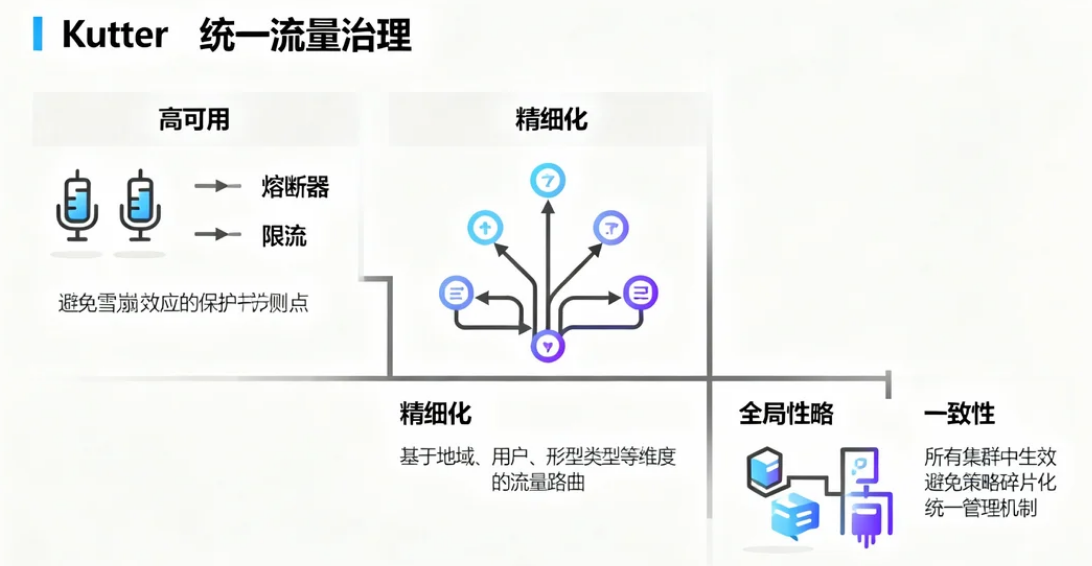

3.3 统一流量治理

Kurator的统一流量治理模块支持跨集群的流量路由、负载均衡、熔断、限流,基于Istio或自研的流量管理引擎。

3.3.1 流量路由配置(代码示例)

通过Kurator的API配置地域感知路由(将华东地区的流量路由到cluster-east,华北地区到cluster-west):

# 伪代码:使用Kurator Python SDK配置流量路由

from kurator.client import KuratorClient

client = KuratorClient(server="https://kurator-server:8443", token="your-token")

traffic_rule = {

"name": "geo-routing",

"type": "geo",

"rules": [

{

"region": "east",

"cluster": "cluster-east",

"weight": 100

},

{

"region": "west",

"cluster": "cluster-west",

"weight": 100

}

],

"service": "nginx-service" # 目标服务

}

rule = client.traffic.manage(traffic_rule)

print(f"Traffic rule {rule.name} applied to service {rule.service}")

3.3.2 熔断与限流

3.3.3 作用分析

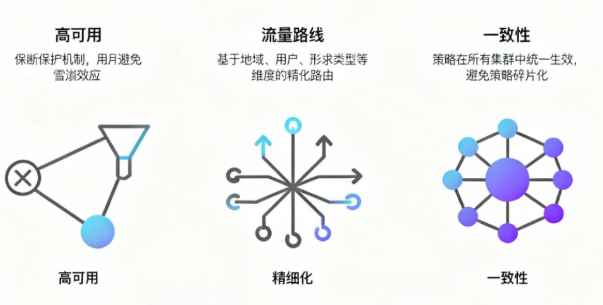

统一流量治理的价值在于:

- 高可用:通过熔断、限流保护服务,避免雪崩效应。

- 精细化:基于地域、用户、请求类型等维度路由流量,提升用户体验。

- 一致性:所有集群的流量策略全局生效,避免策略碎片化。

3.4 统一监控与策略管理

Kurator的统一监控与策略管理模块收集多集群的监控指标,并基于策略进行全局管控。

3.4.1 监控指标收集(代码示例)

通过Kurator的API获取集群的资源使用率:

# 伪代码:使用Kurator Python SDK获取监控指标

from kurator.client import KuratorClient

client = KuratorClient(server="https://kurator-server:8443", token="your-token")

metrics = client.monitoring.get_metrics(

cluster="cluster-east",

metric_type="cpu_usage",

time_range="1h"

)

print(f"CPU usage in cluster-east: {metrics['values']}")

3.4.2 策略管理(代码流程图)

3.4.3 作用分析

统一监控与策略管理的价值在于:

- 全局视角:通过Dashboard查看所有集群的监控指标,便于故障排查。

- 合规性:通过策略(如资源配额、安全策略)确保集群合规运行。

- 自动化:违反策略时自动触发告警或修复,减少人工干预。

第四章 总结

4.1 总结

本文通过实战的方式,详细阐述了基于Kurator构建分布式云原生平台的全过程:

- 环境搭建:从基础环境准备到Kurator安装,解决了常见安装问题。

- 功能体验:深入体验了集群生命周期治理、应用分发、流量治理、监控与策略管理等核心功能,分析了其对云原生平台运维的价值。

- 案例实战:分享了某企业(企业A)的落地过程,包括技术选型、适配攻坚、场景落地、生态协同,以及商业效益与生态价值。

Kurator的核心价值在于简化分布式云原生的复杂度,通过统一的控制平面,实现多集群的集中化管理、应用的统一分发、流量的智能治理、监控与策略的全局协同。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献10条内容

已为社区贡献10条内容

所有评论(0)