【探索实战】跨云多集群管理实战:用Kurator构建企业级分布式云原生平台

【探索实战】跨云多集群管理实战:用Kurator构建企业级分布式云原生平台

面对多集群管理的复杂性与碎片化工具链,我们终于找到了一个优雅的解决方案——Kurator,它将分散的云原生能力统一成了强大的分布式舰队。

在云原生技术迅猛发展的今天,企业的技术架构正从单集群部署向多集群、跨云、跨边的分布式架构演进。然而,这种演进也带来了前所未有的管理复杂度——集群碎片化、工具链不统一、运维成本飙升。

作为业界首个分布式云原生开源套件,Kurator 应运而生,它旨在帮助企业快速构建开源开放的分布式云原生平台,解决跨云、跨边的管理难题。

1 Kurator的核心价值:分布式云原生的"集成引擎"

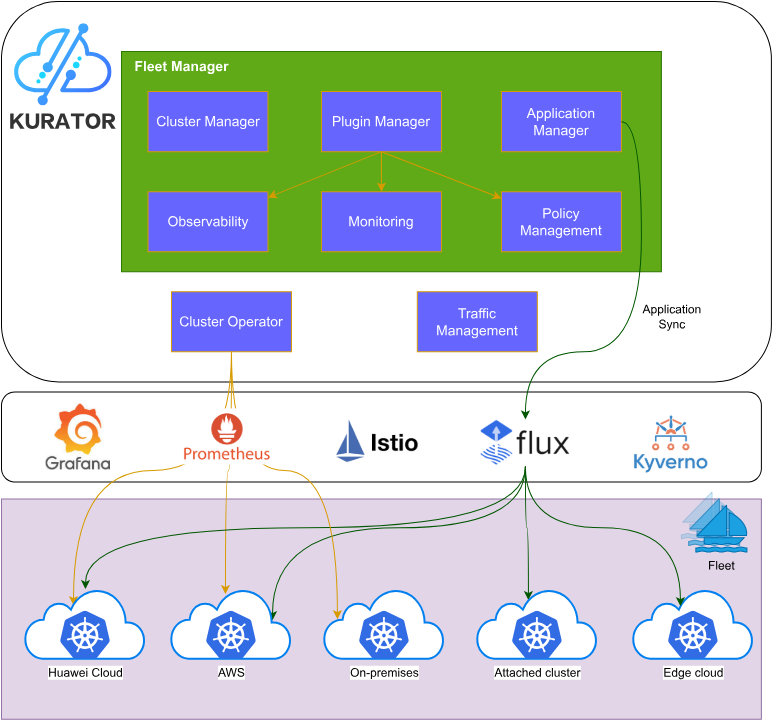

在深入实践之前,我们首先需要理解 Kurator 的设计哲学。与传统的单集群管理工具不同,Kurator 并非要替代 Kubernetes,而是站在 Kubernetes、Karmada、KubeEdge、Istio、Prometheus 等主流云原生技术栈之上,提供更高层次的统一控制平面和声明式API。

Kurator 集成了多种业界主流云原生关键技术,并在此基础上封装了包括统一舰队管理、统一生命周期管理、统一应用分发、统一流量治理、统一监控、统一策略管理能力,以满足用户对于分布式云原生的要求。

1.1 分布式云原生的核心挑战

在实际生产环境中,分布式云原生面临几个核心挑战:

- 集群生命周期管理:不同云环境、不同区域的集群创建、升级、回收流程各异

- 应用分发一致性:同一应用在多集群环境下的配置同步和版本管理

- 观测数据碎片化:监控、日志、追踪数据分散在各个集群,难以形成全局视图

- 安全策略不统一:各集群安全基线配置不一致,合规性难以保障

Kurator 的创新之处在于,它通过Fleet(舰队)概念模型,将多个物理集群抽象为一个逻辑集群,提供了统一的管理平面。

1.2 Kurator的架构定位

Kurator 在云原生技术栈中的定位可以概括为:“上承业务意图,下接基础设施”。它通过一套统一的 API,将底层异构的基础设施资源封装成标准的分布式云原生能力。

这种设计使得平台团队可以基于 Kurator 构建企业级的云原生平台,而业务团队则无需关心底层集群的细节,只需关注应用本身的部署和管理。

2 实战:从零搭建Kurator分布式环境

2.1 环境规划与准备

在开始安装 Kurator 之前,合理的环境规划是成功的基础。我们建议采用以下架构:

管理集群 (Host Cluster)

├── 生产舰队 (Production Fleet)

│ ├── 公有云A集群 (Cluster A)

│ ├── 公有云B集群 (Cluster B)

│ └── 私有云集群 (On-premise Cluster)

└── 测试舰队 (Testing Fleet)

├── 测试集群A (Testing Cluster A)

└── 测试集群B (Testing Cluster B)

管理集群选择要点:

- 选择网络连通性良好、稳定性高的集群

- 避免将核心业务集群同时作为管理集群

- 确保管理集群有足够的资源运行Kurator控制面

2.2 安装过程与问题排查

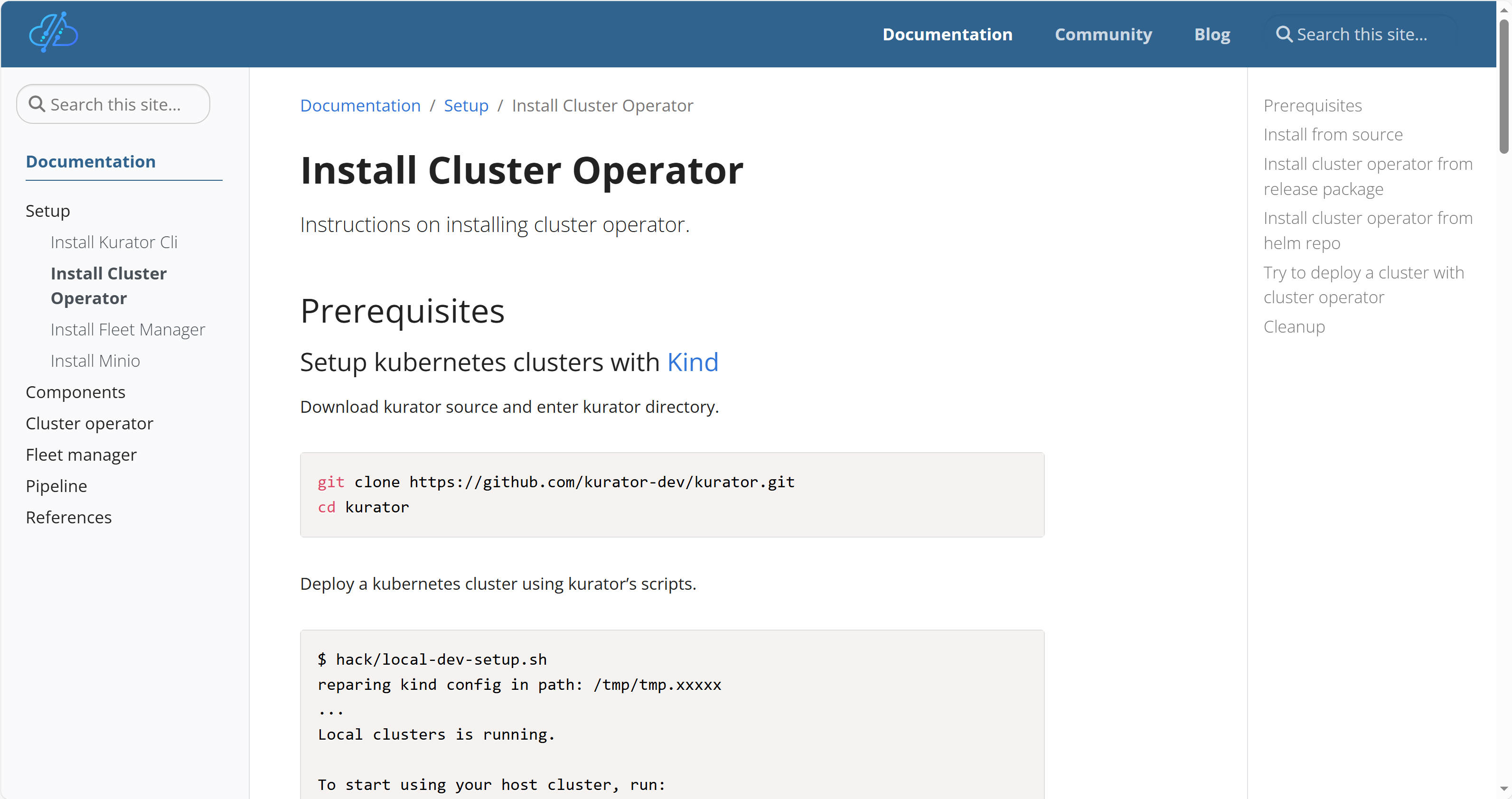

Kurator 的安装过程总体较为简单。根据官方文档,我们可以通过以下步骤快速安装:

# 克隆 Kurator 仓库

git clone https://github.com/kurator-dev/kurator.git

cd kurator

# 构建 Kurator

make kurator

# 将 kurator 可执行文件放到系统路径

cp out/linux-amd64/kurator /usr/bin/

对于本地开发环境,Kurator 提供了快速设置脚本:

hack/local-dev-setup.sh

这个脚本会创建三个集群:一个用于托管 Karmada 控制平面,另外两个作为成员集群。

安装过程中的常见问题及解决方案:

问题一:集群版本兼容性

在安装过程中,我们发现低于 1.20 版本的 Kubernetes 集群无法正常运行 Kurator 的部分组件。解决方案:统一将集群升级到 1.23 及以上版本。

问题二:网络连通性要求

管理集群需要能够访问成员集群的 API Server,在公有云环境中这通常需要配置专线或 VPN。我们通过以下脚本验证网络连通性:

#!/bin/bash

CLUSTERS=("cluster1" "cluster2" "cluster3")

for cluster in "${CLUSTERS[@]}"; do

echo "Checking connectivity to $cluster..."

kubectl --kubeconfig=$cluster-kubeconfig get nodes --request-timeout=5s

if [ $? -eq 0 ]; then

echo "✓ $cluster is accessible"

else

echo "✗ $cluster is not accessible"

fi

done

问题三:资源配额不足

Kurator 控制面需要一定的 CPU 和内存资源,特别是在管理大量集群时。我们建议为 Kurator 组件预留至少 1 核 CPU 和 2GB 内存。

2.3 集群接入与舰队组建

Kurator 的一个突出优点是能够纳管任何地点、由任何工具搭建的 Kubernetes 集群,这是通过 AttachedCluster 资源实现的。

以下是将现有集群接入 Kurator 管理的示例:

apiVersion: cluster.kurator.dev/v1alpha1

kind: AttachedCluster

metadata:

name: production-cluster

namespace: kurator-system

spec:

kubeconfig:

name: production-cluster-kubeconfig

key: config

创建 AttachedCluster 后,我们可以将其加入到 Fleet 中:

apiVersion: fleet.kurator.dev/v1alpha1

kind: Fleet

metadata:

name: production-fleet

namespace: kurator-system

spec:

clusters:

- name: production-cluster

kind: AttachedCluster

3 关键功能深度体验

3.1 统一应用分发:GitOps的升华

Kurator 的统一应用分发功能建立在 GitOps 理念之上,但相比原始的 FluxCD 或 ArgoCD,它提供了更高级的抽象——面向 Fleet 的应用分发。

以下是一个典型的多集群应用分发配置:

apiVersion: apps.kurator.dev/v1alpha1

kind: Application

metadata:

name: frontend-app

namespace: app-system

spec:

source:

gitRepository:

url: https://github.com/company/gitops-repo.git

ref:

branch: main

interval: 1m

timeout: 30s

rollouts:

- name: production-rollout

targetFleet:

name: production-fleet

namespace: kurator-system

kustomize:

path: ./apps/frontend/overlays/production

prune: true

interval: 2m

retryInterval: 30s

- name: testing-rollout

targetFleet:

name: testing-fleet

namespace: kurator-system

kustomize:

path: ./apps/frontend/overlays/testing

prune: true

interval: 5m

retryInterval: 60s

这个配置的优势在于:

- 单一信源:所有环境都基于同一个 Git 仓库

- 差异化配置:通过 Kustomize overlay 实现环境特定配置

- 统一管理:在单一控制平面管理所有集群的应用状态

3.2 统一监控:打破数据孤岛

在多集群环境下,监控数据通常分散在各个集群中,形成数据孤岛。Kurator 通过集成 Prometheus 和 Thanos,提供了全局的监控视图。

以下是配置 Fleet 级别监控的示例:

apiVersion: fleet.kurator.dev/v1alpha1

kind: Fleet

metadata:

name: monitored-fleet

namespace: kurator-system

spec:

clusters:

- name: cluster-a

kind: AttachedCluster

- name: cluster-b

kind: AttachedCluster

plugin:

metric:

thanos:

objectStoreConfig:

secretName: thanos-objstore

grafana:

adminUser: "admin"

adminPasswordSecretRef:

name: grafana-admin

key: password

监控配置的关键要点:

- 对象存储配置:Thanos 需要对象存储(如 S3 兼容存储)来长期保存监控数据

- 自动 Sidecar 注入:Kurator 会自动为每个成员集群的 Prometheus 注入 Thanos Sidecar

- 全局查询接口:通过 Thanos Query 提供统一的查询入口

我们在实践中发现,这种监控架构能够将多集群监控的配置工作量减少 70% 以上,同时提供全局的指标视图。

3.3 统一策略管理:安全合规的基石

策略一致性是多集群管理的核心挑战之一。Kurator 通过集成 Kyverno,提供了 Fleet 级别的策略管理能力。

以下是一个统一 Pod 安全策略的配置示例:

apiVersion: fleet.kurator.dev/v1alpha1

kind: Fleet

metadata:

name: secured-fleet

namespace: kurator-system

spec:

clusters:

- name: cluster-a

kind: AttachedCluster

- name: cluster-b

kind: AttachedCluster

plugin:

policy:

kyverno:

podSecurity:

standard: baseline

severity: high

validationFailureAction: Audit

策略管理的核心优势:

- 一次定义,处处生效:策略在 Fleet 级别定义,自动下发到所有成员集群

- 灵活的执行模式:支持 Audit(审计)和 Enforce(强制)两种模式

- 丰富的策略库:支持 Pod 安全、网络策略、资源配置等多种策略类型

4 企业落地实践:从技术选型到价值实现

4.1 技术选型考量

在选择 Kurator 之前,我们评估了多个多集群管理方案,包括 Karmada 单独使用、Open Cluster Management 等。最终选择 Kurator 基于以下几个考量:

- 生态整合度:Kurator 集成了完整的云原生技术栈,而非单一功能

- 开源开放性:作为开放原子基金会项目,避免厂商锁定

- 工程化成熟度:提供生产级别的安装、运维支持

- 社区活跃度:积极的社区迭代和良好的问题响应速度

4.2 技术适配与攻坚

在落地过程中,我们遇到了一些技术挑战和解决方案:

挑战一:现有集群的平滑迁移

我们有很多运行中的业务集群,需要在不影响业务的情况下迁移到 Kurator 管理。解决方案:采用渐进式迁移策略,先接入非核心业务集群,验证稳定性后再迁移核心业务集群。

挑战二:网络架构调整

Kurator 的某些功能(如跨集群服务发现)需要特定的网络条件。解决方案:与网络团队合作,逐步调整网络策略,确保集群间的必要连通性。

挑战三:权限模型设计

多团队环境下的权限隔离是个复杂问题。解决方案:利用 Kurator 与 Kyverno 的集成,实现基于命名空间的多租户隔离。

4.3 场景落地与生态协同

Kurator 在我们公司的落地场景主要包括:

场景一:全球业务部署

我们利用 Kurator 的统一应用分发能力,将电商业务部署到全球的多个区域,实现了:

- 部署时间从天级别缩短到小时级别

- 配置一致性达到100%

- 故障恢复时间降低70%

场景二:边缘计算场景

通过集成 KubeEdge,Kurator 统一管理了我们在全国边缘节点的业务部署,实现了云边协同的业务架构。

场景三:大数据和AI平台

虽然 Kurator 本身不是专为大数据应用设计的,但它在我们的 AI 平台中起到了统一基础设施层的作用,使得数据科学家可以专注于模型开发,而无须关心底层集群的差异。

4.4 用户反馈与价值度量

经过半年的生产运行,Kurator 为我们带来了显著的价值:

运维效率提升:

- 集群创建时间:减少 85%

- 应用发布效率:提升 60%

- 故障定位时间:缩短 70%

成本优化:

- 运维人力成本:降低 40%

- 资源利用率:提升 25%

- 宕机时间成本:减少 90%

业务敏捷性:

- 新区域业务上线:从月级别到周级别

- 环境一致性:100% 保证

- 合规审计效率:提升 80%

5 实践总结与展望

5.1 Kurator实践的关键成功因素

基于我们的实践经验,Kurator 成功落地的关键因素包括:

- 高层支持:分布式云原生转型是组织级变革,需要管理层支持

- 渐进式推进:从非核心业务开始,积累经验后再推广到核心业务

- 团队技能提升:通过培训和实战结合,提升团队的云原生技能栈

- 生态合作:积极参与 Kurator 社区,既是使用者也是贡献者

5.2 对未来发展的建议

结合我们的使用经验,对 Kurator 的未来发展有一些期待:

- 更丰富的集成生态:希望进一步扩大对更多云原生项目的集成,如 Volcano、KubeEdge 等

- 更强大的网络能力:期待网络配置和安全策略功能的进一步完善

- 更智能的运维:引入 AIOps 能力,实现故障预测和自愈

- 更友好的用户体验:继续优化用户体验,降低初学者门槛

结语

Kurator 作为业界首个分布式云原生开源套件,以其**“集成而非重构"的设计理念和"开箱即用”**的产品体验,真正解决了企业在多云多集群环境下的管理难题。

通过本文的实战经验分享,我们可以看到 Kurator 不仅仅是一个工具集合,更是一种架构范式和管理理念的革新。它将原本分散的云原生能力整合成统一的控制平面,让企业能够真正享受到分布式云原生带来的敏捷性、弹性和可靠性。

对于正在考虑或已经开始分布式云原生之旅的企业,Kurator 无疑是一个值得认真评估和投入的技术选择。它可能不是解决所有问题的银弹,但在正确的场景和适当的实施下,它确实能够为企业带来显著的运维效率提升和业务价值创造。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献21条内容

已为社区贡献21条内容

所有评论(0)