【前瞻创想】还在为搞不定分布式云原生发愁吗?来聊聊Kurator这把瑞士军刀是如何把Karmada、Istio这些大咖捏合在一起,让你轻松驾驭多云环境的那些事儿

【前瞻创想】还在为搞不定分布式云原生发愁吗?来聊聊Kurator这把瑞士军刀是如何把Karmada、Istio这些大咖捏合在一起,让你轻松驾驭多云环境的那些事儿

这就是Kurator,完全开源,主打的就是一个分布式云原生套件。你也知道,现在这云原生圈子,技术栈碎得跟二维码似的,想把那一堆工具组装起来哪怕是跑个Hello World都得脱层皮。Kurator出来的目的很简单,不是为了再造一个轮子,而是把现有的这些像Karmada、KubeEdge、Volcano这些最顶级的“轮子”组装成一辆跑车,让你开箱即用。咱今天不整那些虚头巴脑的概念,就单纯从一个老工友的角度,聊聊这东西到底解决了啥痛点,以及咋用才顺手。

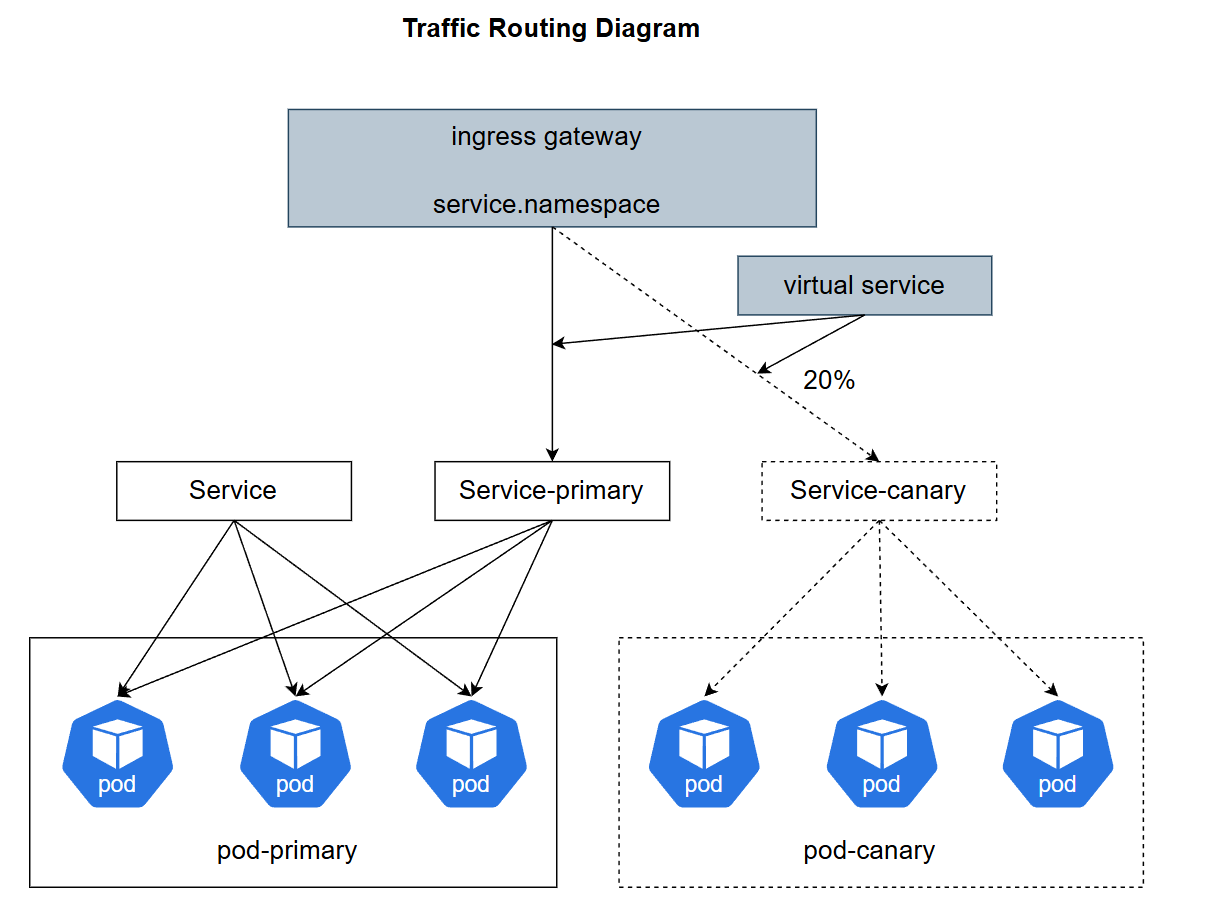

Kurator推广的流量路由图,官网的图片,感兴趣的朋友可以去看看更详细的:

一、 别光看不练,先把环境工棚搭起来,咱们边跑边聊

咱们既然是搞技术的,光说不练假把式。要想深入了解Kurator,手里没个环境肯定不行。很多人一提起搭环境就头大,觉得是不是又要配一大堆环境变量,装一堆依赖库?其实真没那么复杂。Kurator的设计初衷就是简化,连安装这一步都尽量给你省事儿。

1. 简单粗暴的源码获取

你随便找台Linux机器,或者你本地的Mac也行,先把源码拉下来。这就像是咱们进厨房得先有米面油一样。咱们直接去官方仓库把它的主分支代码搞下来,它是开源的,随便折腾。

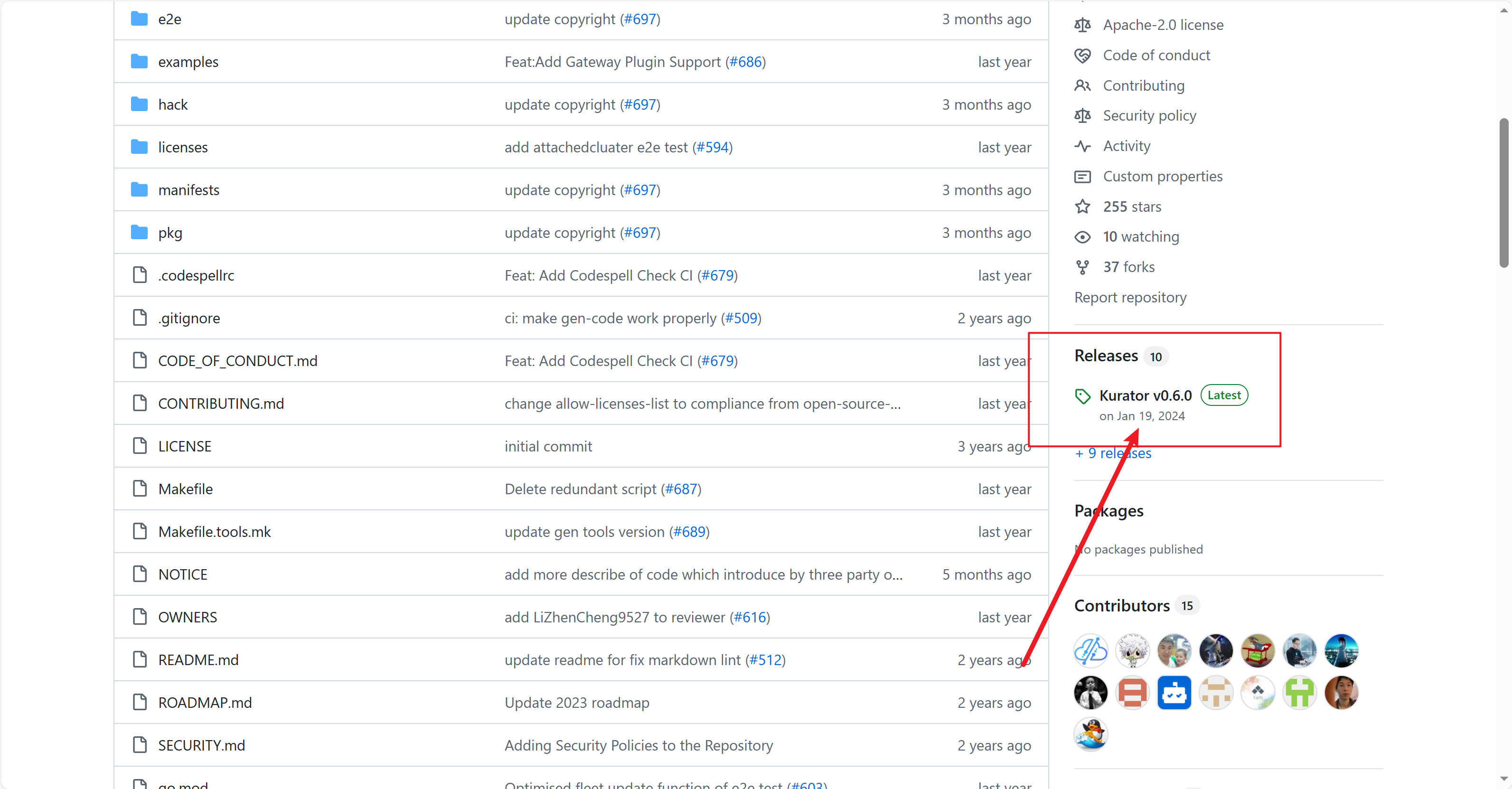

我们可以从github上面下载源码,我把源码标注出来啦

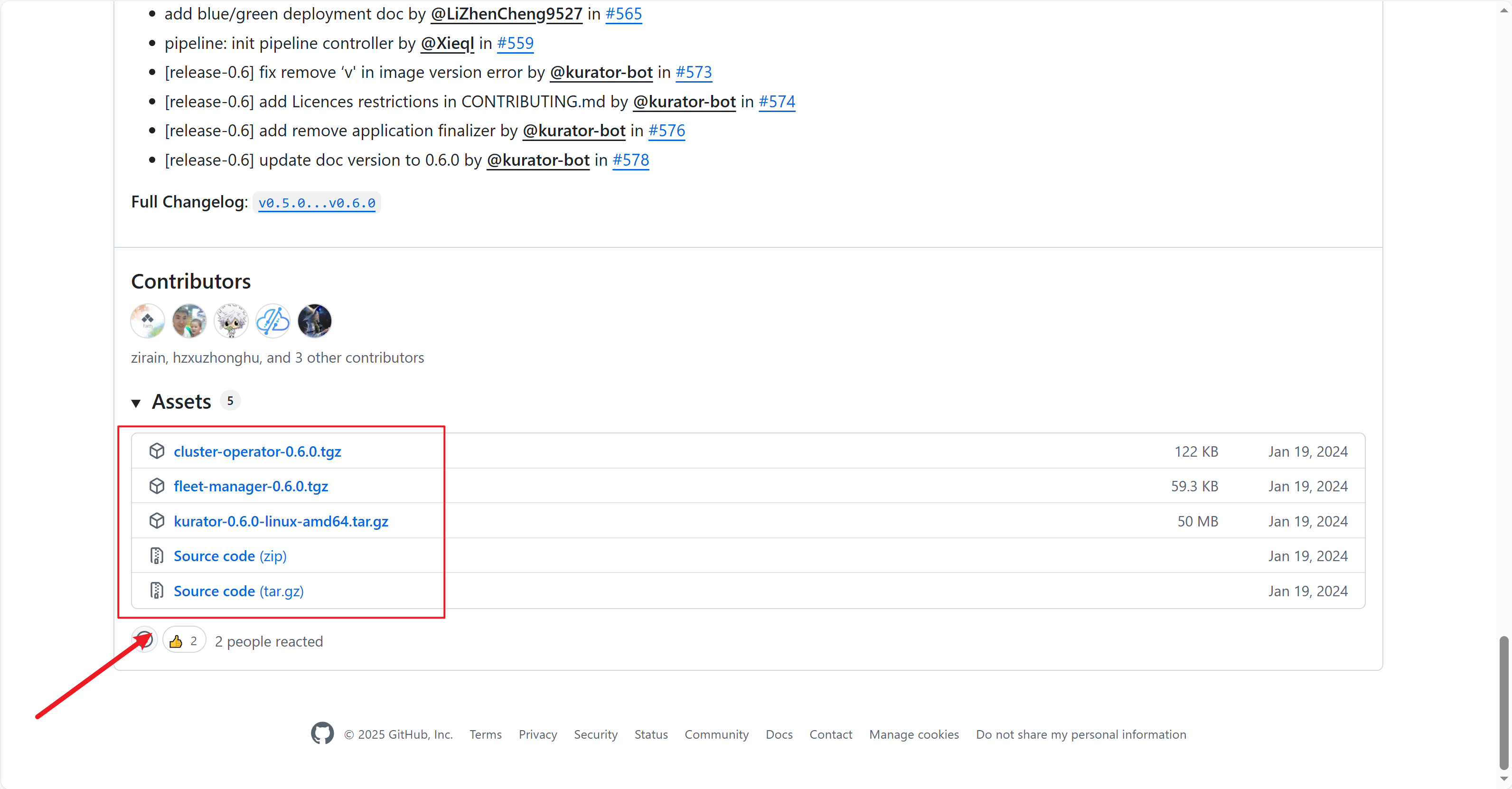

点击后拉到最下面就可以看到源码压缩包啦,不同需求的朋友可以下载不同平台的源码

下载下来解压就可以看到源码文件啦

代码拉下来解压之后,你进去目录瞄一眼,结构非常清晰,不会让你有一种“这是啥玩意”的迷茫感。

2. 依赖工具的那些坑

咱们都知道,玩云原生,Docker或者Containerd总得有吧,Go环境最好也备一个。Kurator虽然尽可能做到了开箱即用,但底层的一些基础设施还是依赖的。不过你放心,它不像某些老牌软件那样,对版本号挑剔到令人发指。基本上主流的稳定版本都能跑得通。这里有个小经验,如果是在国内网络环境下,配置Go Proxy是很关键的一步,不然拉依赖的时候能让你等到花儿都谢了。

3. 这里的“一键”是真的“一键”

很多项目号称“一键部署”,结果按下那键之后报错报得满屏都是。Kurator在这方面做得还算良心。它提供了一些Makefile脚本或者安装脚本,能帮你快速地把一个最小化的控制面拉起来。你把它理解成一个指挥中心,只有指挥中心立起来了,后面纳管几十个、上百个集群,那才是它发威的时候。

二、 Kurator的前瞻愿景:不仅仅是缝合怪,而是生态整合者

咱们聊聊Kurator这东西的核心逻辑。很多人第一眼看,会觉得:“哎,这不就是把Karmada和Prometheus打包了吗?我自己写个Shell脚本不是也能干?” 这话对,也不对。写脚本那是把东西堆在一起,而Kurator是在做生态的整合和抽象。

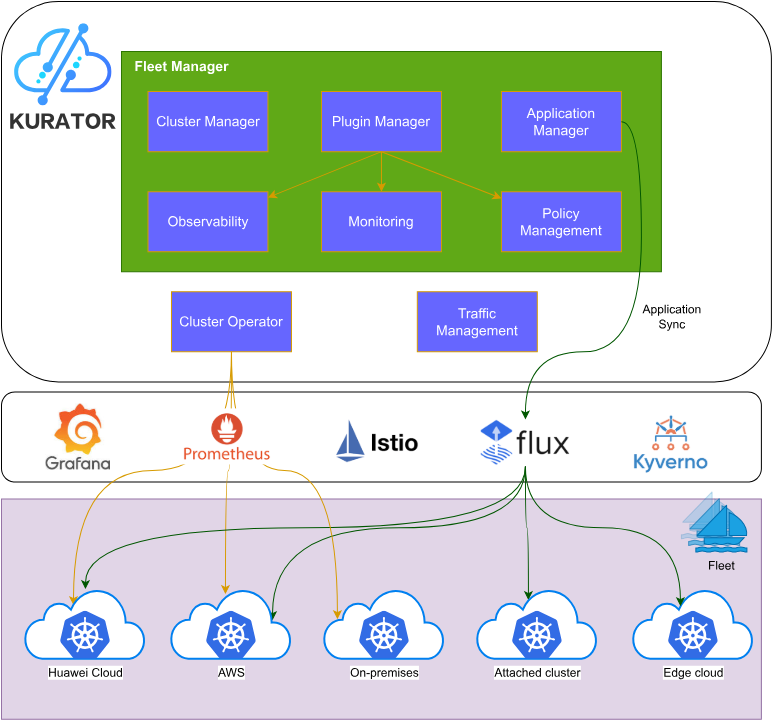

这张Kurator架构图挺清晰的,Kurator 架构分为 Fleet Manager 统一管理集群、插件、应用与策略,Operator 负责流量与同步,底层集成多云与观测组件:

1. 从“散装”到“整机”的思维转变

以前咱们搞分布式云原生,那是真的累。要想做多云调度,得去研究Karmada;要想做服务网格,得去啃Istio;要想做监控,得搞Prometheus全家桶。学会了这些还得自己写代码把它们串起来。这就好比你去买电脑,以前是买CPU、显卡、主板自己组装,还得担心兼容性。Kurator现在的思路是,我直接给你一台调教好的高性能工作站。它所具备的“前瞻性”在于,它预判了未来云原生的复杂度会指数级上升,单一工具再强也解决不了系统级的问题,必须有一个统一的层级来屏蔽底层的碎裂。

2. 定义未来的多云标准接口

你有没有发现,现在每家云厂商、每个开源项目都有自己的API风格?Kurator试图在做一件很难但很有意义的事,就是定义一套统一的声明式API。无论你底层是用AWS、阿里云,还是用私有云,甚至是一堆树莓派组成的边缘节点,在Kurator这一层,操作体验应该是一致的。这种“顶层设计”的思维,是很多单纯的工具类项目所不具备的。它想做的是云原生时代的“操作系统”,而不仅仅是一个应用软件。

3. 解决“Day 2”运维的终极难题

安装只是第一步(Day 1),真正磨人的是后面的运维(Day 2)。升级挂了怎么办?证书过期了怎么办?节点扩缩容怎么搞?Kurator内部集成了一套生命周期管理的逻辑,它是奔着长期主义去的。它不仅管生(安装),还管养(运维),甚至管送终(卸载清理)。这种全生命周期的管理视角,才是它作为一个开源套件最大的创想所在。

三、 站在巨人的肩膀上:内置大咖项目的深度解析

Kurator之所以能打,不是因为它自己重写了所有代码,而是它非常聪明地集成了社区里最棒的项目。比如Prometheus、Karmada、Volcano等等。咱们挑两个最有代表性的——Karmada和Prometheus,来聊聊Kurator是怎么把它们玩出花的。

1. Karmada:多云编排的大脑

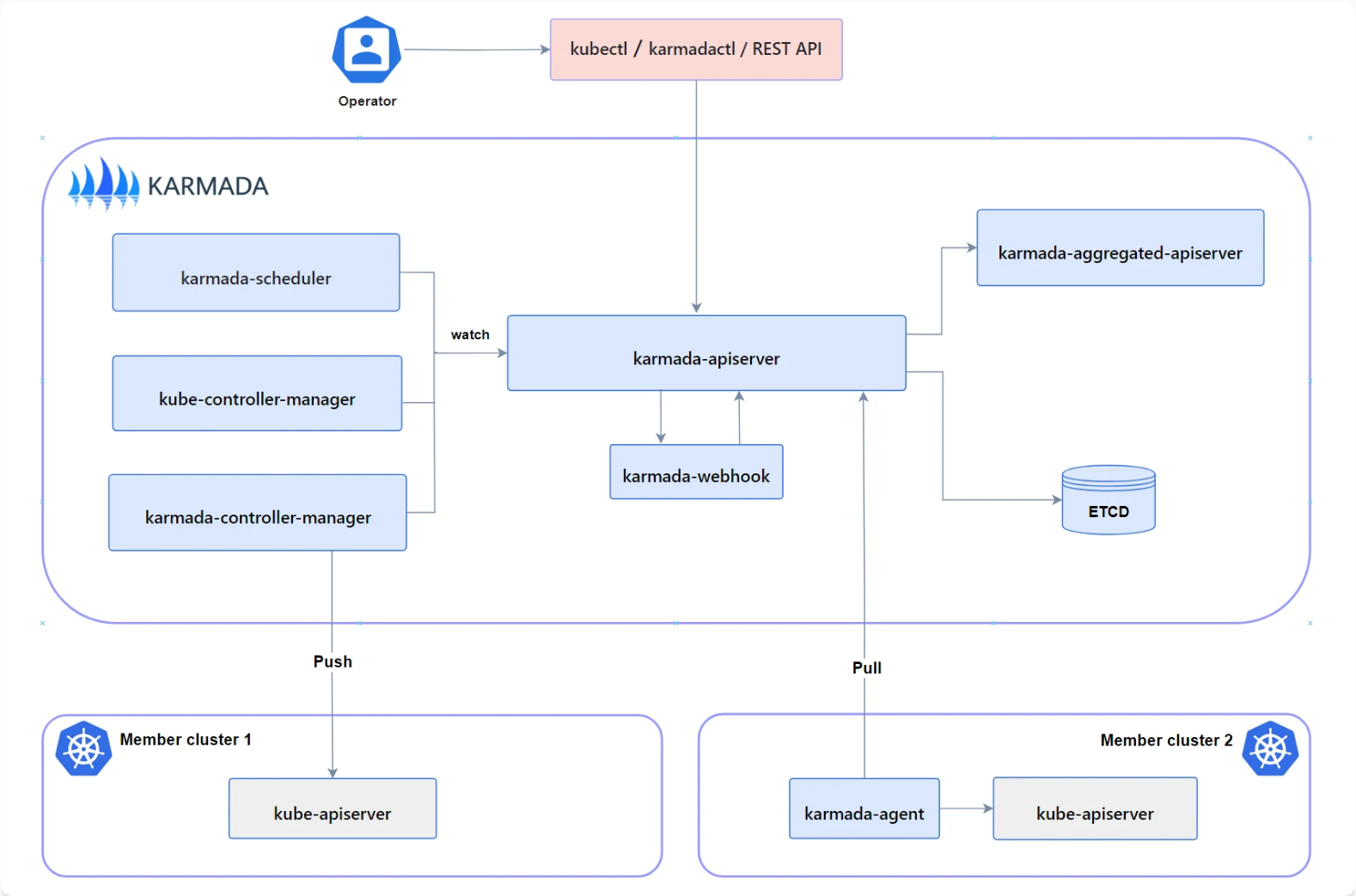

Karmada(K8s Armada)这几年在多云编排领域那是红得发紫。它的核心能力就是把一堆K8s集群当成一个大集群来用。但是,Karmada的学习曲线其实挺陡峭的,什么PropagationPolicy、OverridePolicy,新手一看就晕。

Kurator在这里做了一层非常友好的封装。它把Karmada作为一个核心组件集成进来,你不需要去手动搭建Karmada的控制面,Kurator帮你搞定。更重要的是,Kurator利用Karmada的能力,让应用的分发变得像在单机上部署一样简单。它屏蔽了Karmada复杂的配置细节,提供了一些更上层的抽象。这就好比Karmada是一台复杂的单反相机,功能强大但参数多,而Kurator给它加了一个“智能模式”,你只需要按快门,也能拍出大片。

Karmada是一个有趣的东西,这个是karmada架构官方参考图,感兴趣的朋友们可以看看了解一下:

2. Prometheus:统一监控的火眼金睛

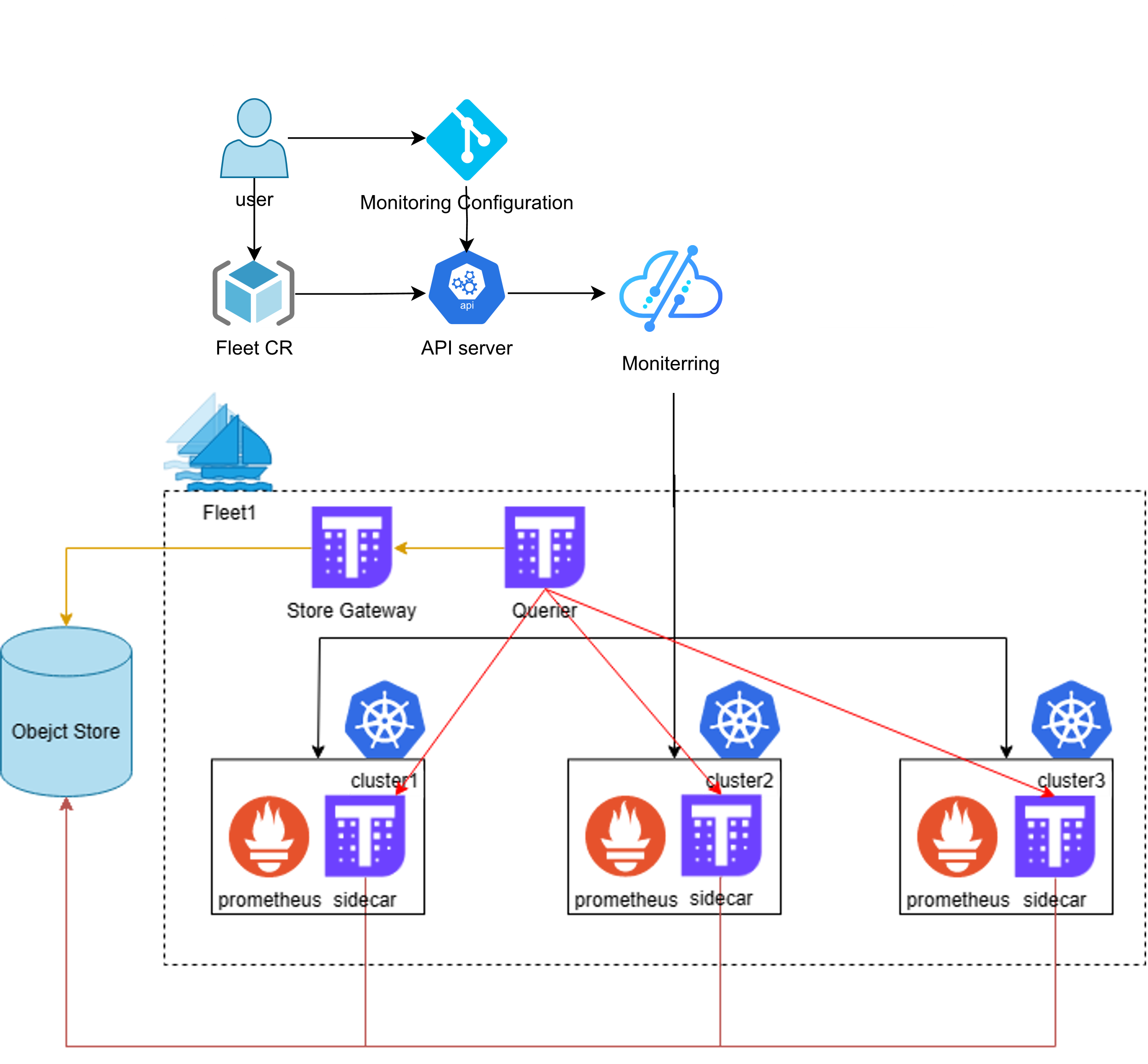

在分布式环境下,监控是噩梦。你有10个集群,就有10套Prometheus,数据怎么聚合?告警怎么统一?Kurator集成的Prometheus不是简单的单点部署,而是奔着“联邦模式”或者“Thanos/Cortex”这种集中式存储方案去的思路。

它会预先配置好很多最佳实践的告警规则。你想啊,咱们平时自己配Prometheus,是不是得去搜各种Dashboard模板,还得调试PromQL语句?Kurator直接给你内置了一套针对多云环境极其好用的监控模板。它知道在分布式场景下,哪些指标是关键的,哪些是可以忽略的。这种“专家经验”的代码化,极大地降低了我们搭建监控体系的门槛。

这张图展示了Kurator的统一监控架构,通过集中式配置和自动同步,把多个集群的监控数据汇聚到一起,实现跨集群的统一观测和管理,让运维更省心、排查问题也更快:

3. Kurator的创新:1+1 大于 2

把Karmada和Prometheus放在一起,妙处在哪?Kurator打通了它们。比如,你可以基于Prometheus采集到的某个集群的负载数据,通过Karmada动态地调整应用的调度策略。如果你单纯只装这两个工具,它们之间是孤岛,数据是不通的。Kurator在中间做了一层“胶水”逻辑,让监控数据能够反哺调度决策,这才是真正的自动化运维。

这有一个简单的示例,展示Kurator怎么去定义一个集成了监控能力的集群配置,你看这YAML写得多清爽:

apiVersion: cluster.kurator.dev/v1alpha1

kind: Cluster

metadata:

name: my-distributed-cluster

spec:

# 这里的配置简化了底层Karmada和Prometheus的连接细节

controlPlane:

type: karmada

monitoring:

enabled: true

type: prometheus

storage:

persistence: true

size: 100Gi

nodes:

- role: worker

count: 3

四、 从泥坑里爬出来的经验:Kurator的独家创新优势

这一段咱们得聊点干货。作为一名在云原生泥坑里摸爬滚打多年的老兵,我深知“整合”这两个字说起来容易做起来有多难。Kurator的优势不仅仅是把工具装上了,而是在“怎么用好”这些工具上做了文章。

1. 统一的Fleet管理概念

Kurator引入了“Fleet(舰队)”的概念。这词儿听着就霸气。在以前,如果你有开发环境、测试环境、生产环境,每个环境跨了三个云厂商,管理起来就是灾难。Kurator允许你把这一堆集群定义为一个Fleet。你可以对这一整个Fleet下达指令。比如发布一个安全补丁,你不需要去一个个集群操作,只需要对Fleet说:“嘿,更新一下。”剩下的事Kurator自动帮你分发。这种批量化、标准化的操作能力,对于那些动辄几十个集群的大厂来说,简直是救命稻草。

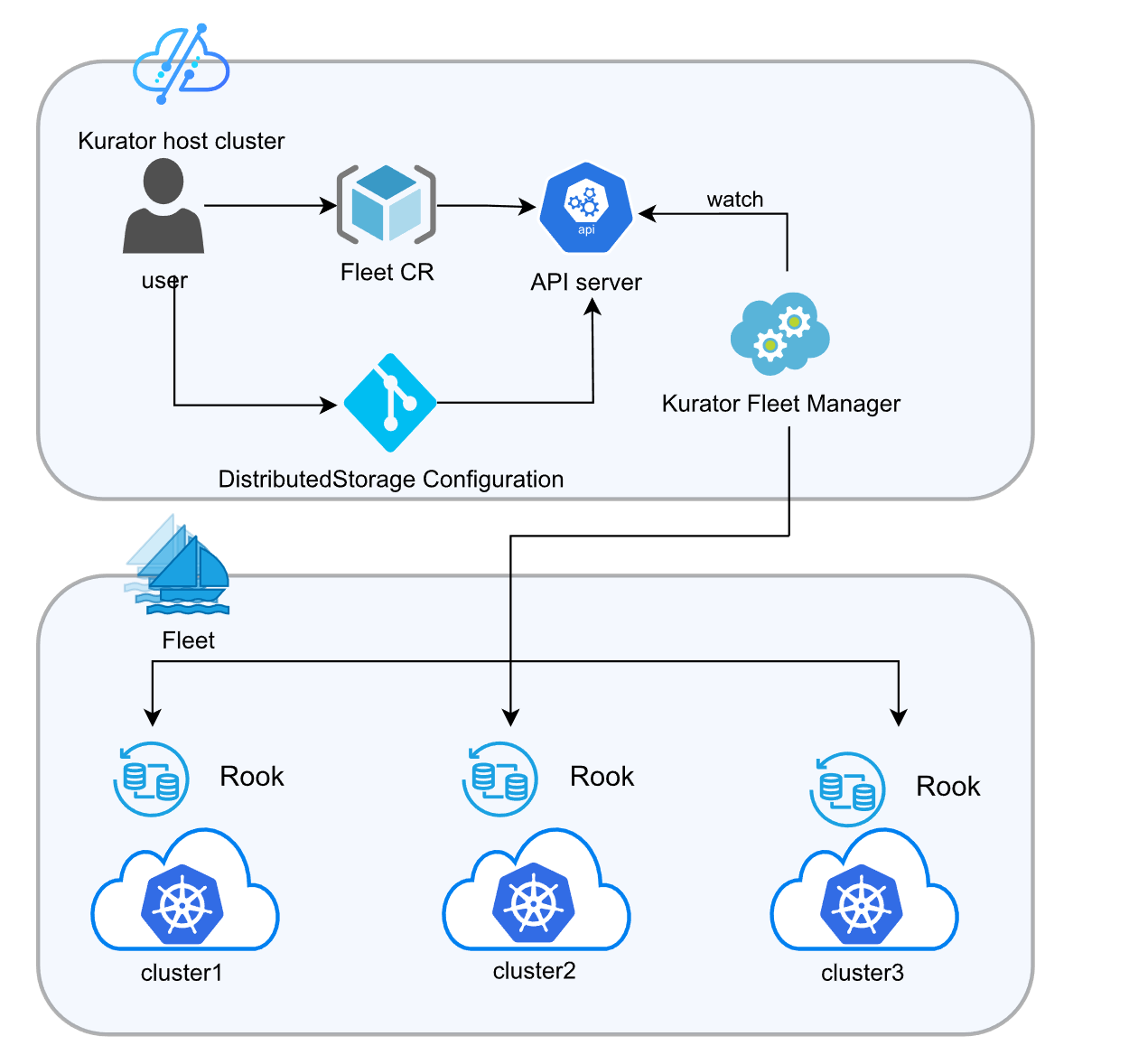

这是Fleet基于Rook构建统一分布式存储的架构图,展示了如何通过Kurator管理器统一配置多集群存储:

2. 声明式的声明式

不论是K8s还是Karmada,核心都是声明式API。但Kurator做到了“声明式的广场”。它把不同组件的配置,都在Kurator自己的CRD(Custom Resource Definition)里做了统一。你不需要去学Prometheus Operator的CRD怎么写,也不用深究Volcano的Job怎么配,Kurator试图提取出一套公约数。这种抽象层虽然增加了一点点系统的复杂度,但对于使用者来说,心智负担大大降低了。你只需要掌握Kurator这一种“方言”,就能和所有的底层组件对话。

3. 极速的边缘接入体验

现在KubeEdge也很火,但边缘计算有个大问题就是网络不稳定、环境异构。Kurator针对边缘场景做了特别优化。比如它的安装脚本里就考虑到了边缘节点可能没有公网IP,或者网络带宽极低的情况。它提供了一些离线包的机制,或者是代理转发的机制,让边缘节点能顺利“入网”。这种细节上的打磨,体现了开发团队是真的在实战场景下遭遇过毒打的。

五、 给分布式云原生未来的几句掏心窝子建议

说了这么多Kurator的好,最后还得跳出来,站在更高的维度看看这行当未来的路怎么走。作为在这个圈子里混了有些年头的人,咱们不仅要埋头拉车,还得抬头看路。

1. 复杂度的治理是核心命题

咱们现在总是倾向于把架构搞得很复杂,好像不搞个微服务、不上个Service Mesh都不好意思跟人打招呼。但未来的趋势一定是“回归简单”。像Kurator这样的工具,它的使命就是把复杂留给自己,把简单留给用户。如果你正在规划你们公司的云原生架构,请一定记住:能用一套集群解决的,别搞多套;能由平台屏蔽的细节,别暴露给业务研发。 分布式云原生不是为了炫技,是为了降本增效。如果不加节制地引入新技术,最后技术债务会压垮团队。

2. 安全!安全!还是TMD安全!

在单集群时代,安全边界比较清晰,就是那道防火墙。到了多云分布式时代,网络边界消失了。你的Pod可能跑在阿里云,也可能跑在客户机房的物理机上。这时候,零信任(Zero Trust)就不再是一个时髦词汇,而是必须落地的标准。我觉得未来的开源社区,谁能把身份认证、数据加密、准入控制做得最无感、最严密,谁就能赢。Kurator目前也在加强这块,比如集成一些安全扫描和策略管理的工具,这是非常对的路子。大家在选型的时候,一定要把安全能力作为一票否决项。

3. AI与云原生的双向奔赴

这年头不提AI好像落伍了,但确实是这么回事。现在的应用越来越重,模型训练、推理对算力的调度要求极高。Volcano这种批处理调度器为什么火?就是因为K8s原生的调度器搞不定AI任务。未来,云原生平台不仅是跑Web服务的,更是跑大模型的基座。我建议大家关注那些能把GPU资源池化、能做弹性AI推理的开源项目。Kurator如果能在这块进一步加强,比如内置一套针对AI训练任务的一键环境准备,那绝对是杀手级的功能。

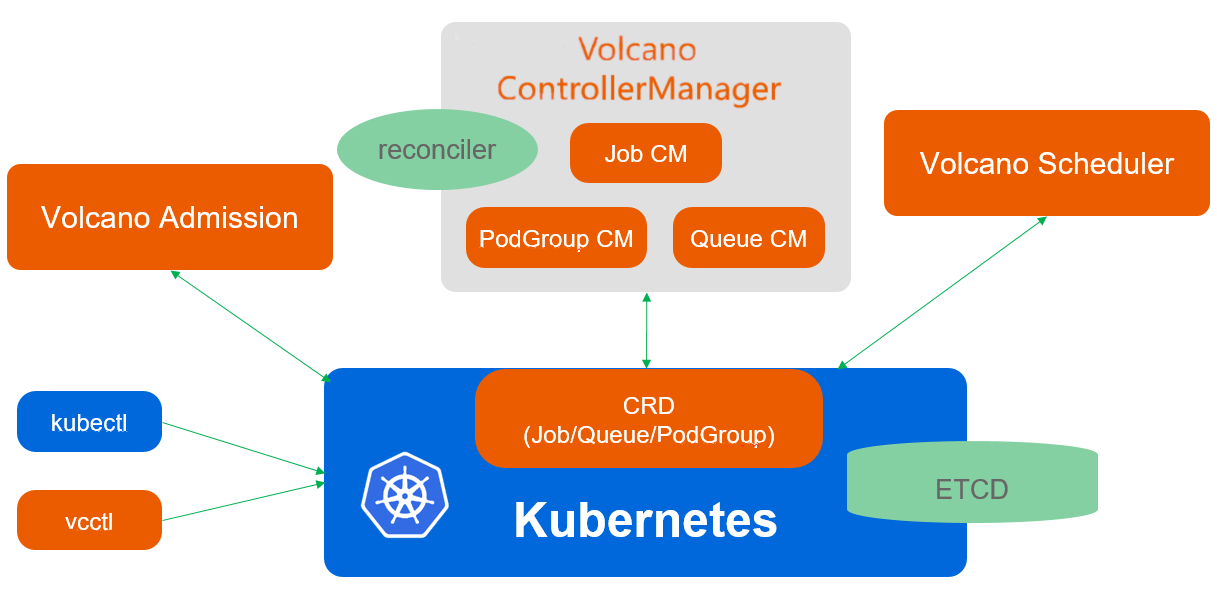

这是Volcano调度架构参考图,展示了其核心组件如何通过CRD、控制器和调度器协同工作,实现对批量计算作业的统一管理:

六、 总结一下

咱聊了这么多,Kurator到底是个啥?它不是神丹妙药,但它绝对是一个趁手的兵器库。在分布式云原生这个充满荆棘的战场上,你是想赤手空拳去搏斗,还是想开着Kurator这辆装甲车推进?

它帮我们把Karmada的多云能力、Prometheus的监控能力、Volcano的调度能力统统打包好了。它用统一的API、统一的Fleet概念,试图帮我们抹平底层的差异。虽然它还在发展中,肯定也有不完美的地方,但这个方向——“屏蔽复杂,统一治理”,是绝对正确的。

代码这东西,写出来就是为人服务的。如果你正被多云管理搞得焦头烂额,不妨下载Kurator跑跑看。

最后的最后,把那个创建应用的简单例子放这儿,感受下这种清爽:

apiVersion: apps.kurator.dev/v1alpha1

kind: Application

metadata:

name: my-web-app

namespace: default

spec:

source:

repoURL: https://github.com/my-org/my-app-charts

path: charts/web-app

destination:

fleet: my-global-fleet # 直接指定分发到哪个舰队,就是这么豪横

syncPolicy:

automated:

prune: true

selfHeal: true

行了,话不多说,赶紧去Github拉代码试试吧。咱们云原生这条路,道阻且长,但有了好工具,走起来总归能吹着口哨轻快点。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献8条内容

已为社区贡献8条内容

所有评论(0)