【探索实战】聊聊 Kurator:怎么用这把瑞士军刀搞定分布式云原生架构和多云舰队管理

【探索实战】聊聊 Kurator:怎么用这把瑞士军刀搞定分布式云原生架构和多云舰队管理

说实话,这两年云原生圈子里最让人头大的问题,早就不是“怎么建一个 K8s 集群”了,而是“手里攥着几十上百个集群,散落在天南地北,这玩意儿到底该怎么管?”。Kurator 就是为了解决这个痛点诞生的。你也别把它想得太玄乎,它其实就是咱们运维和架构师手里的那个“大管家”,专门帮咱们在分布式云原生的环境里,把那些杂乱无章的集群、应用、策略给统统收纳好。

咱们今天不念教科书,就直接掰开了揉碎了,聊聊 Kurator 的底层逻辑、它怎么搞定舰队管理,还有流量路由那些好玩的功能。

🚀 啥是 Kurator?咱们先从它的老底和架构唠起

咱先得把地基打牢了,看看 Kurator 到底是基于什么样的环境长出来的。

分布式云原生架构是个啥

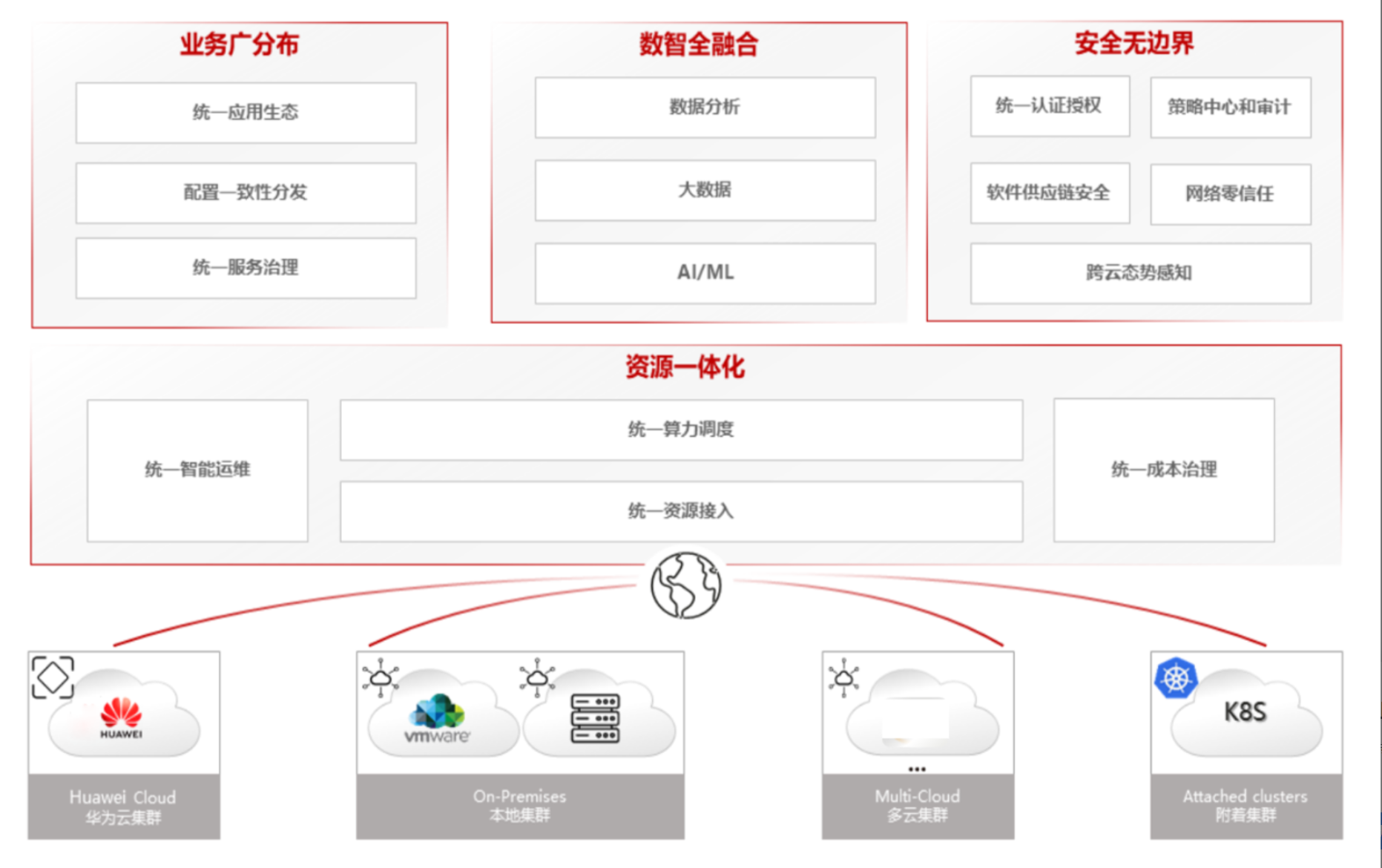

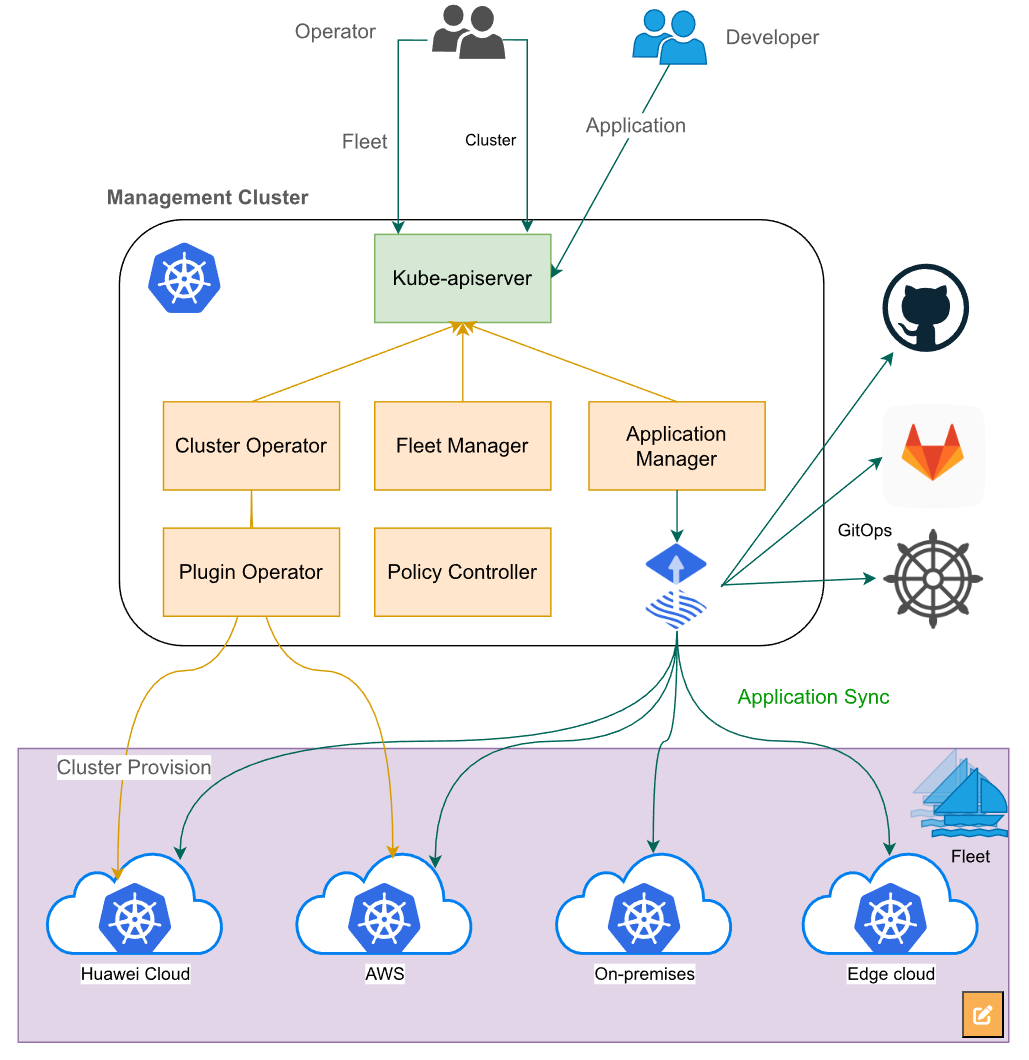

这是分布式云原生架构的参考图,展示了如何通过统一应用治理、数据融合、安全及资源调度,实现对多云、本地及边缘异构集群的一体化管理:

你想象一下,以前咱们部署应用,就像在自家后院种菜,这就是单集群模式。但现在业务做大了,你可能在阿里云有一片地,AWS 上有一片地,甚至在这个边缘机房、那个客户的私有环境里都有地。这就叫分布式云原生架构。

这种架构听着高大上,其实维护起来特遭罪。你得保证这边的西红柿和那边的黄瓜都能喝到水,还得保证由于网络抖动(那个水管偶尔漏水)的时候,业务不能挂。Kurator 在这里的角色,就是那个智能灌溉系统。它不光是连接各个云,更重要的是在这些异构的基础设施之上,盖了一层“被子”,让上层的应用感觉不到底下的差异。它把计算能力、存储能力都给抽象化了,让咱们能像用一台电脑一样去用这一堆云。

Kurator 平台的总体架构长这样

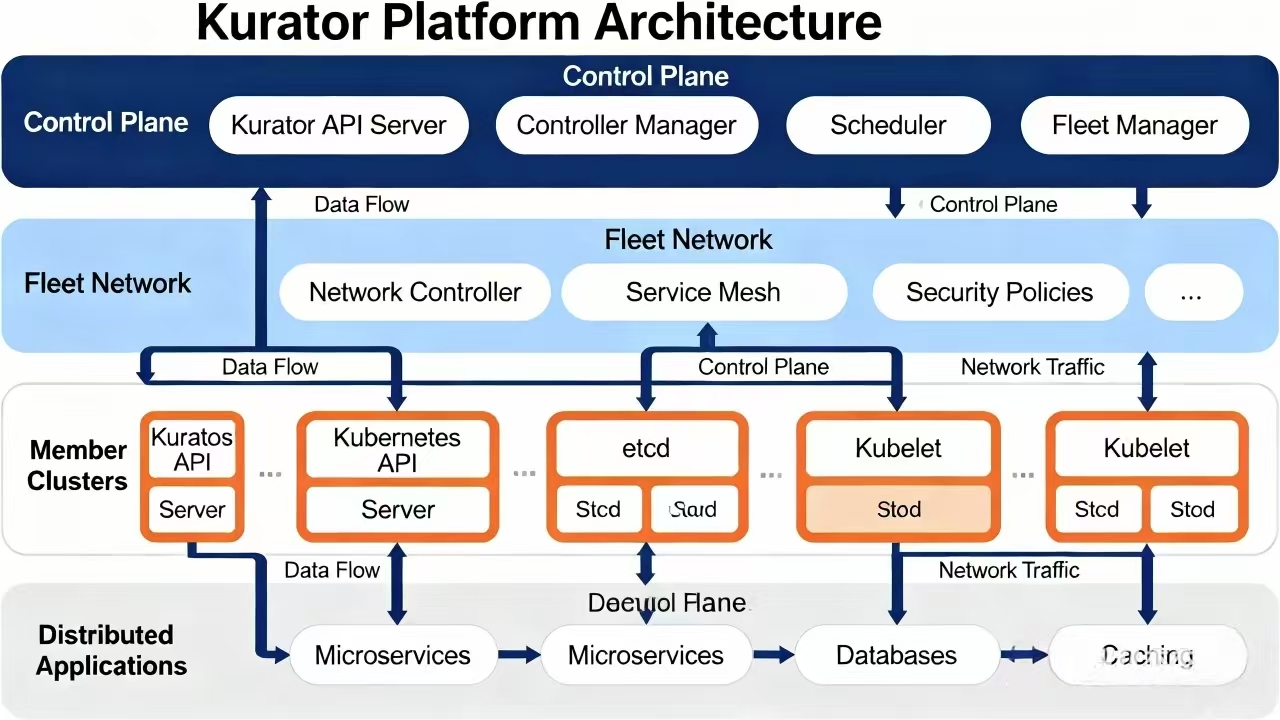

这是Kurator平台的总体架构图,展示了控制平面、集群网络、成员集群及应用层在统一管理框架下的数据流与组件关系:

咱们来看 Kurator 的全貌,也就是Kurator 平台的总体架构。你可以把它看成一个汉堡包。

最底下那层,就是咱们刚说的各种基础设施,公有云、私有云、边缘节点,那是面包底。

中间那层,也就是核心层,Kurator 搞了一套控制平面。这个控制平面负责两件大事:一个是管集群(造集群、升级集群、销毁集群),一个是管应用(把应用分发到不同的集群去)。

最上面那层,就是咱们的业务场景了,什么 AI 训练啊、微服务啊、大数据处理啊。

Kurator 在这里面起到承上启下的作用。它本身的设计非常解耦,很多组件都是可以插拔的。不像有些重型平台,装上去就得全家桶,Kurator 你想用它的多集群管理就用,想用它的调度就用,很灵活。

Kurator 架构的核心逻辑

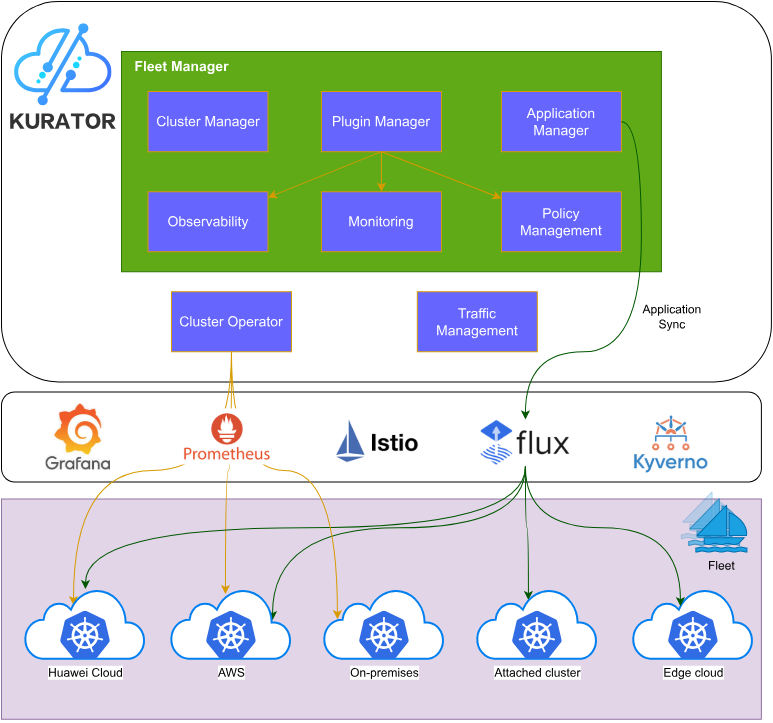

这张Kurator架构图挺清晰的,Kurator 架构分为 Fleet Manager 统一管理集群、插件、应用与策略,Operator 负责流量与同步,底层集成多云与观测组件:

再往深了挖一下 Kurator 架构。它其实是站在巨人的肩膀上的,它深度集成了像 Karmada、Volcano、Istio 这些顶级的开源项目,但不是简单的堆砌。

Kurator 把这些组件串联成了一个有机的整体。比如,它用 Cluster Operator 来统一管理集群的生命周期,用 Fleet Manager 来处理舰队级别的事务。它的架构核心在于“声明式 API”。啥意思呢?就是你只需要告诉 Kurator:“嘿,我要一个由 3 个集群组成的舰队,每个集群都要装这个版本的监控组件”,剩下的脏活累活,Kurator 自己去计算差异,然后一步步去达成这个状态。这种架构最大的好处就是容错性强,中间挂了一次没关系,它会不断重试,直到达成你的目标。

🛠️ 搞起!先把环境搭起来再说

光说不练假把式。咱们得先把 Kurator 跑起来,你才有感觉。环境搭建其实不难,关键是网速得给力,其他的跟着我做就行。

准备工作

首先,你得有一台 Linux 的机器,或者 Mac 也行。Docker 和 Go 语言环境肯定是少不了的,Kind 或者 Minikube 最好也备一个,方便咱们在本地模拟多集群环境。

拉取代码的独特姿势

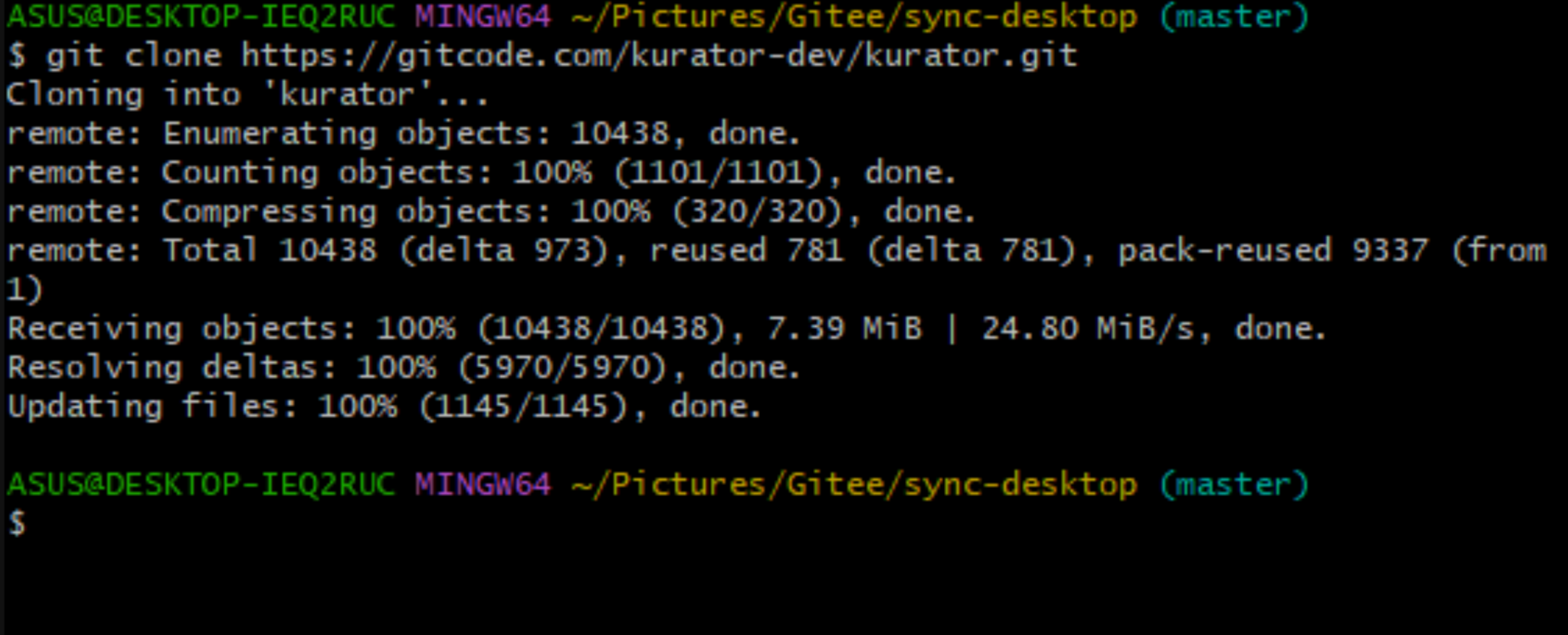

可以看到这是项目的gitCode源码

我们可以拉取下来

git clone https://github.com/kurator-dev/kurator.git

源码文件如下,接下来就可以使用了

可以注意到,这个命令kurator version可以看到版本号

跑起来看看

这里我给你写了个简单的 Makefile 风格的脚本,模拟一下咱们平时手搓环境的过程。这代码稍微有点“土”,但绝对好使,主要是为了检查一下咱们的依赖齐不齐。

#!/bin/bash

# 这脚本是我平时用来快速检查 Kurator 运行环境的,凑合看哈

echo "=== 正在检查咱们的家伙事儿齐不齐 ==="

# 看看 Go 都在不在

if ! command -v go &> /dev/null; then

echo "❌ 哎呀,Go 语言环境没装,这可不行,Kurator 跑不起来的。"

exit 1

fi

echo "✅ Go 环境 OK"

# 看看 Docker 活着没

if ! docker info &> /dev/null; then

echo "❌ Docker 好像没启动?或者权限不对?快去检查一下。"

exit 1

fi

echo "✅ Docker 也是活的"

# 尝试编译一下,看看能不能过

echo "=== 试着编译一下 Kurator 控制面二进制 ==="

# 注意:这里假设你已经在代码目录里了

# make build 可能会有点慢,去喝口水

make build

if [ $? -eq 0 ]; then

echo "🎉 妥了!编译成功,环境搭建没毛病,可以开始玩了!"

else

echo "💀 编译炸了,看看报错日志吧兄弟。"

fi

环境通了之后,你通常只需要运行 make deploy 就能把 Kurator 的整套控制面部署到你本地的 K8s 集群里了。

⚓ 管集群这就跟管舰队一样简单

环境好了,咱们聊聊正事儿。Kurator 最核心的能力之一就是管理集群。在它的概念里,集群不是一个个孤岛,而是一支“舰队”。

云原生舰队管理是咋回事

云原生舰队管理(Fleet Management),听着像打仗似的,其实道理差不多。当你有几十个集群的时候,你不可能一个一个去 kubectl apply。Kurator 引入了“舰队”的概念,你可以把标签相同的集群(比如所有带有 region=beijing 的集群)编成一个舰队。

一旦编成了舰队,你对舰队下达的指令,就会自动广播到舰队里的每一艘“船”(集群)上。比如你要给所有北京的集群打一个安全补丁,你只需要对着“北京舰队”操作一次,Kurator 就会自动去分发。这不仅仅是省事,更重要的是一致性。它能保证你所有的集群配置都是一模一样的,不会出现“哎呀,这台机器漏了配置”这种低级错误。

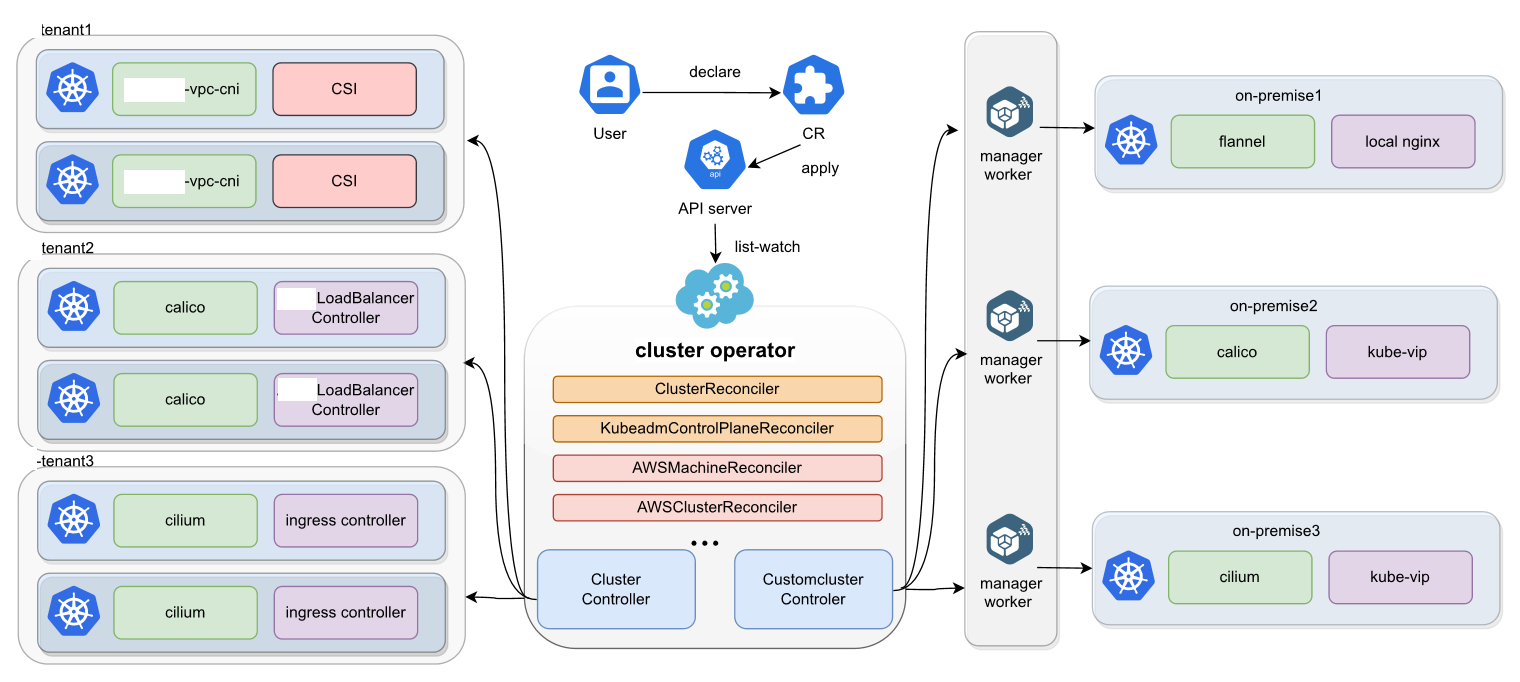

这张图讲的是云原生舰队管理,就是通过一个管理中心集群来统一管理多个下属集群,不管是创建、注册还是部署应用,都可以集中控制:

Kurator 集群生命周期管理

这一块是很多运维最头疼的。Kurator 集群生命周期管理覆盖了从出生到坟墓的全过程:创建(Provisioning)、升级(Upgrading)、扩缩容(Scaling)、销毁(Deleting)。

Kurator 这里的厉害之处在于它不挑食。不管你是想在 AWS 上开 EC2 建集群,还是在自家机房的裸金属服务器上搞,或者是想接入一个现有的集群,它都有一套统一的 API。它利用 Cluster API (CAPI) 的能力,把底层的云厂商差异给屏蔽了。你只需要定义“我要 3 个 Master,5 个 Worker,版本 v1.29”,剩下的 Kurator 会去调各家的接口帮你搞定。

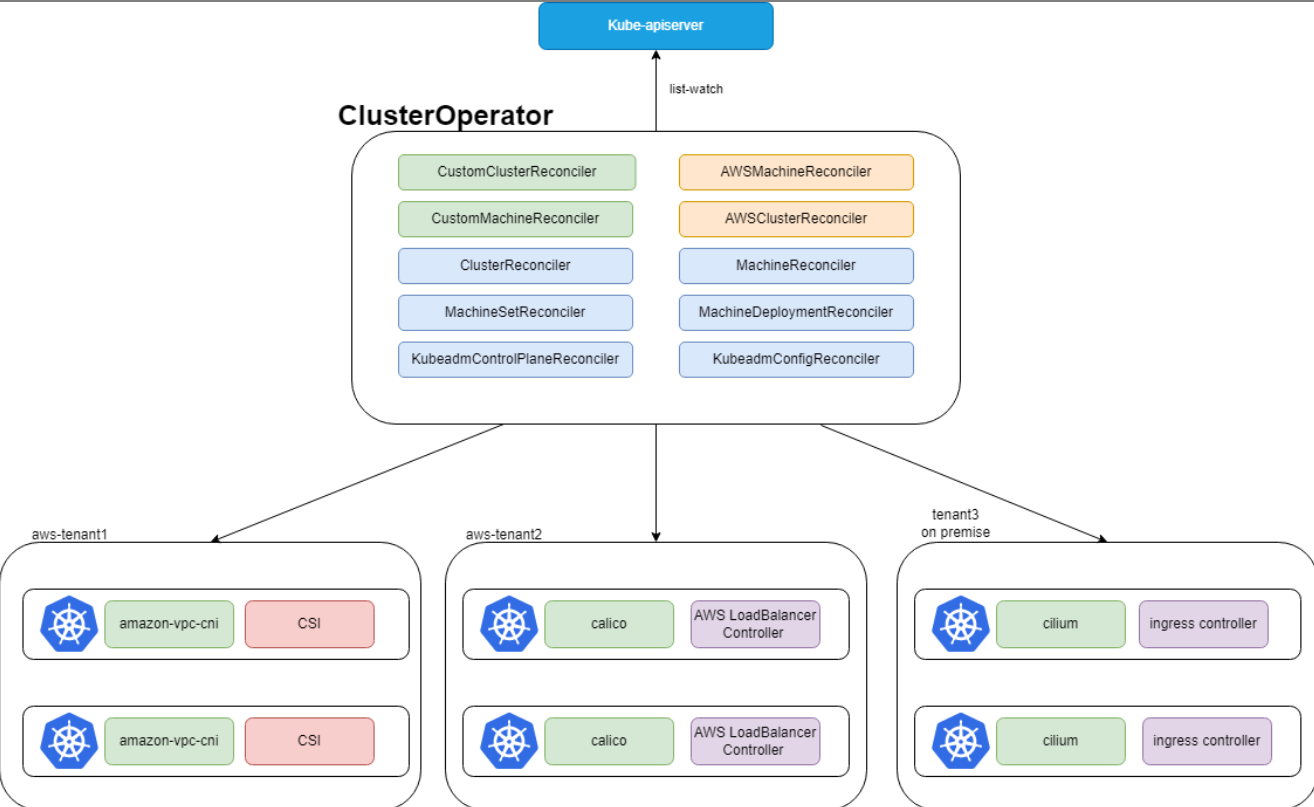

这是Kurator集群生命周期管理的详细参考图,展示了从用户声明、多租户插件配置,到控制器协同工作实现异构集群统一纳管的全过程。

Kubernetes 集群的标准架构与 Cluster Operator 的实现

要理解它是怎么管的,得看看 Kubernetes 集群的标准架构。通常一个标准的 K8s 集群包含控制平面(API Server, ETCD, Controller Manager, Scheduler)和数据平面(Kubelet, Kube-proxy)。

Kurator 里的 Cluster Operator 的实现 就是基于 Operator 模式来监管这些组件的。Cluster Operator 就像一个不知疲倦的监工,它死死盯着你定义的“期望状态”。

这张图展示了Kurator Cluster Operator的整体架构,它通过监听API Server的资源变化,自动管理不同环境下的集群和机器:

下面这段 Go 代码,模拟了 Cluster Operator 内部的一个核心调谐(Reconcile)逻辑。我故意写得简单点,去掉了很多复杂的错误处理,让你能看懂它的核心思路:

// Reconcile 就像是 Operator 的心脏,不停地跳动检查状态

func (r *ClusterReconciler) Reconcile(ctx context.Context, req ctrl.Request) (ctrl.Result, error) {

// 1. 先去看看咱们那个 Cluster 的定义文件还在不在

var cluster kuratorv1.Cluster

if err := r.Get(ctx, req.NamespacedName, &cluster); err != nil {

// 如果找不到对象,可能已经被删了,那咱们也不用干活了

return ctrl.Result{}, client.IgnoreNotFound(err)

}

// 2. 看看这集群是不是被标记要删除了

if !cluster.ObjectMeta.DeletionTimestamp.IsZero() {

fmt.Println("⚠️ 这集群要被销毁了,准备处理后事...")

// 这里会执行一些清理逻辑,比如删云资源

return r.handleDeletion(ctx, &cluster)

}

// 3. 检查当前状态和期望状态是不是一样

// 比如用户想要 5 个节点,现在只有 3 个

if cluster.Status.ReadyNodes < cluster.Spec.Replicas {

fmt.Println("🔧 节点不够了,正在这就去扩容,老铁稍等...")

// 调用底层接口去加机器

if err := r.scaleUp(ctx, &cluster); err != nil {

fmt.Println("💥 扩容失败了:", err)

return ctrl.Result{Requeue: true}, err // 失败了就等会儿再试

}

}

// 4. 更新一下状态,告诉用户现在咋样了

cluster.Status.Phase = "Running"

r.Status().Update(ctx, &cluster)

return ctrl.Result{}, nil

}

这段逻辑就是 Cluster Operator 每天干的事:对比->修正->汇报。

🚦 流量和任务怎么分?这里面门道不少

集群管好了,接下来就是怎么用好这些集群。这涉及到了流量怎么走,任务怎么分。

Kurator 的流量路由与 AB 测试

在多集群环境下,Kurator 的流量路由能力非常关键。你可能希望美国的流量走美国的集群,欧洲的走欧洲的,或者 VIP 用户的流量走高性能集群。Kurator 集成了 Istio 等服务网格的能力,并在上面做了一层封装。

咱们重点说说 Kurator 中配置 AB 测试。这是业务上线经常用的。比如你发了个新版本的 App,只想让 10% 的用户先试用,如果没有问题再全量推。在 Kurator 里,你不需要去改复杂的 Envoy 配置,它提供了一种更简化的配置方式。

看下面这个 YAML 片段,这就像是我们平时手写的一个路由规则,非常直观:

apiVersion: networking.kurator.dev/v1alpha1

kind: TrafficRoute

metadata:

name: ab-test-demo

spec:

# 咱们针对的是 'user-service' 这个服务

hosts:

- user-service.prod.svc.cluster.local

http:

- name: "canary-route"

match:

- headers:

# 如果请求头里带了 user-type: beta,那就走这条路

user-type:

exact: "beta"

route:

- destination:

host: user-service

subset: v2-beta # 导向 v2 版本

weight: 100

- name: "default-route"

route:

- destination:

host: user-service

subset: v1-stable # 其他人都去 v1 版本待着

weight: 100

通过这种简单的配置,Kurator 会自动把它翻译成底层 Istio 的 VirtualService 和 DestinationRule,直接下发到各个集群,业务那边甚至都不需要感知。

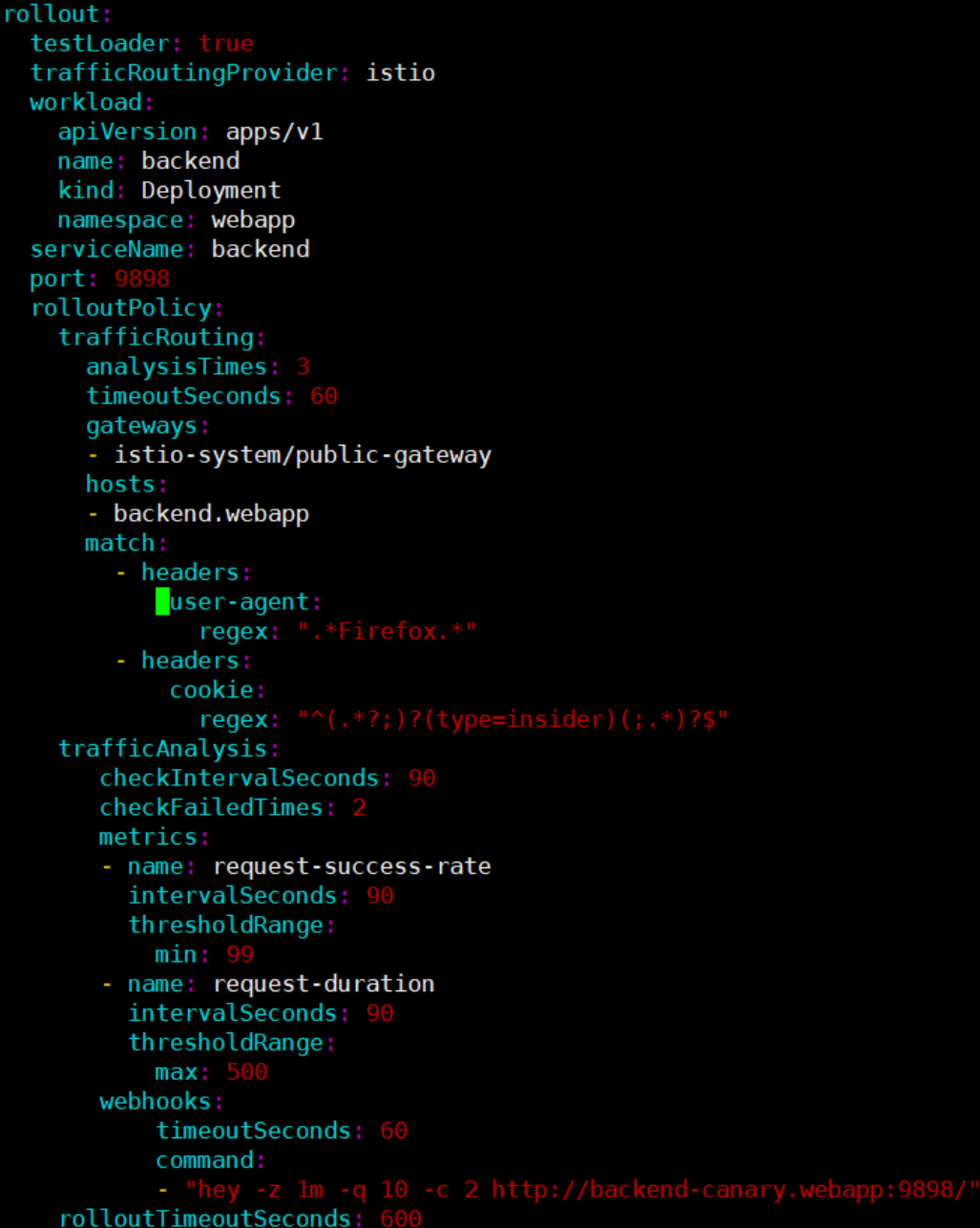

这是在Kurator中配置A/B测试的YAML示例,展示了如何基于用户代理和Cookie的头部匹配规则进行精细化流量分割与多维度指标分析:

Volcano 分组调度是干啥的

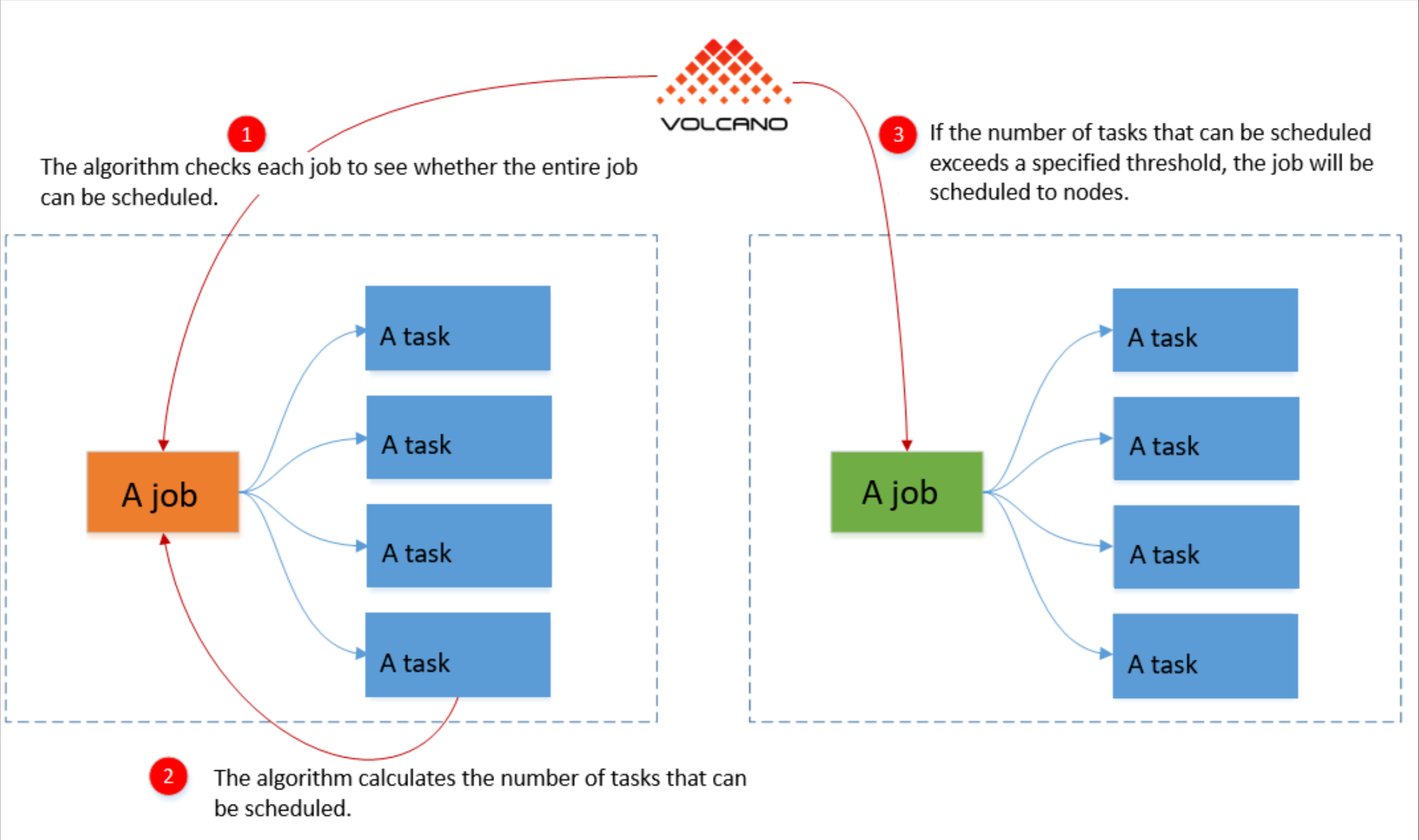

这是Volcano分组调度参考图,展示了其如何通过整体资源检查与阈值判断,实现批处理作业的成组调度与资源保障:

聊完了在线流量,咱们聊聊离线任务。做 AI 训练或者大数据计算的同学都知道,有时候一个任务需要 10 台机器同时跑,少一台都跑不起来。K8s 原生的调度器是一个个调度的,很容易出现“死锁”——任务 A 占了 5 台等剩下 5 台,任务 B 占了 5 台等剩下 5 台,结果谁也跑不了。

这就轮到 Volcano 分组调度(Gang Scheduling)出场了。Kurator 集成了 Volcano,支持把一组 Pod 看作一个整体(Gang)。要么这一组 10 个 Pod 都有资源,一起启动;要么就都不启动,排队等着。这对昂贵的 GPU 资源来说,利用率提升简直是巨大的。

Kurator 分发流程的状态机

不管是应用分发还是配置分发,Kurator 内部维护了一个 Kurator 分发流程的状态机。这玩意儿就像是一个严谨的办事员。

一个分发任务通常会经历这么几个状态:

- Pending(等待中):任务刚提交,正在排队。

- Dispatching(分发中):控制面正在把配置推送到各个目标集群。

- Applied(已应用):配置已经到了目标集群,并且 apply 下去了。

- Ready(就绪):不仅 apply 了,而且底下的 Pod 真的跑起来了,健康检查也过了。

- Failed(失败):中间任何环节出岔子了。

这个状态机是闭环的。如果一直停在 Dispatching,它会有超时机制;如果 Failed 了,它有重试策略。这种确定性的状态流转,让你在 Dashboard 上一眼就能看出哪个集群掉链子了。

📜 规矩得立好,统一策略管理

最后,咱们来聊聊治理。Kurator 的统一策略管理架构 是为了解决“无法无天”的问题的。

当你有几百个开发人员在操作集群时,你必须得立规矩。比如:不能使用 root 用户启动容器、必须配置 CPU 限制、镜像必须来自公司内部仓库。

Kurator 基于 Kyverno 或者 OPA Gatekeeper 构建了统一策略层。你不需要去每个集群里配置策略。你只需要在 Kurator 的控制面定义一条“全公司通用安全策略”,Kurator 就会把这个策略同步到所有纳管的集群里。

这就好比你是总部的法务部,发了一份红头文件,下面的分公司(集群)都得无条件执行。如果有谁试图创建一个违规的 Pod,在 API Server 准入控制(Admission Control)阶段就会被直接拦截下来,并且报错“Hey,你违反了公司第 3 条规定,回去重写 YAML”。

总结一下

这一圈聊下来,你应该对 Kurator 有个底了吧?它从分布式云原生架构的底座出发,用 Cluster Operator 把集群管得服服帖帖,通过 Volcano 和 流量路由 搞定了任务和流量的分配,最后用 统一策略管理 守住了安全的底线。

它就像一把瑞士军刀,在这个多云、异构、复杂的云原生时代,给了咱们运维人员一种掌控全局的能力。东西确实是好东西,虽然上手可能需要啃一点文档,但一旦你把它跑顺了,那是真香!加油,环境搭起来,玩一玩就懂了!💪

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献10条内容

已为社区贡献10条内容

所有评论(0)