【探索实战】Kurator分布式云原生平台企业级实战:从异构资源统一到云边一体化协同

【探索实战】Kurator分布式云原生平台企业级实战:从异构资源统一到云边一体化协同

在云原生技术迅猛发展的今天,企业面临多云、多集群管理复杂度的指数级增长。Kurator作为业界首个分布式云原生开源套件,正以其卓越的集成能力和简洁的管理界面,重塑企业云原生基础设施的管理方式。

1 Kurator架构解析:分布式云原生的一站式解决方案

随着企业数字化转型的深入,多云多集群已成为新常态。根据云原生计算基金会(CNCF)调研,全球已有78%的企业在生产环境中采用容器技术。Gartner更预测分布式云将在5-10年内进入稳定发展期。在这一背景下,华为云推出的开源分布式云原生平台Kurator,通过其独特的"集成创新"理念,为企业提供了一站式的分布式云原生解决方案。

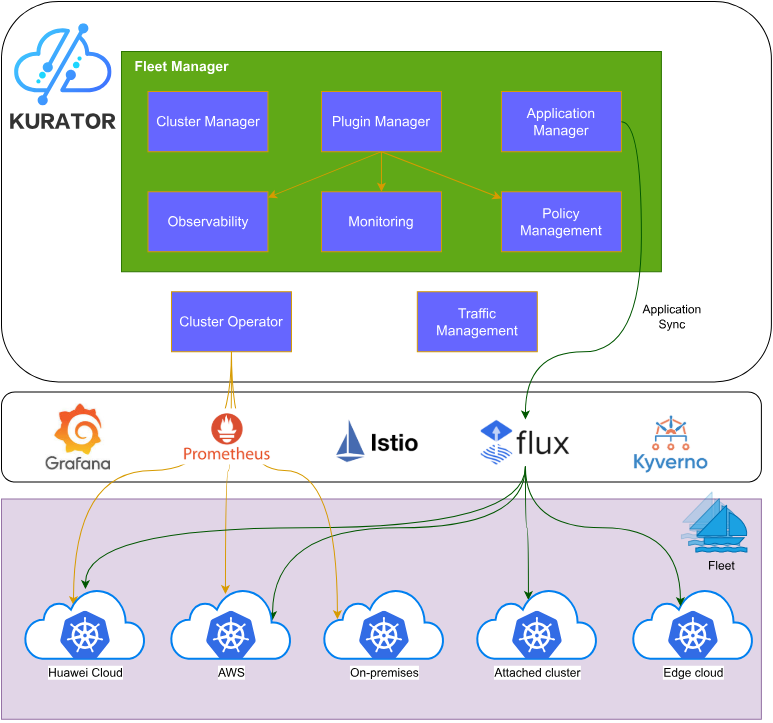

Kurator的设计哲学是"基础设施即代码",采用声明式方式管理云、边缘或本地环境的基础设施,并提供"开箱即用"的一键安装能力。其技术架构呈现清晰的三层结构:

- 北向接口:提供统一的API和CLI工具,无缝对接GitOps工作流

- 内核引擎:集成Karmada、KubeEdge、Volcano、Istio、Prometheus等主流云原生技术

- 南向适配:纳管AWS、华为云、阿里云等异构基础设施,提供统一的接入体验

这种"站在巨人肩膀上"的整合策略,使Kurator将原本分散的云原生技术栈统一为"一个超级底座",大幅降低了分布式云环境的管理复杂度。

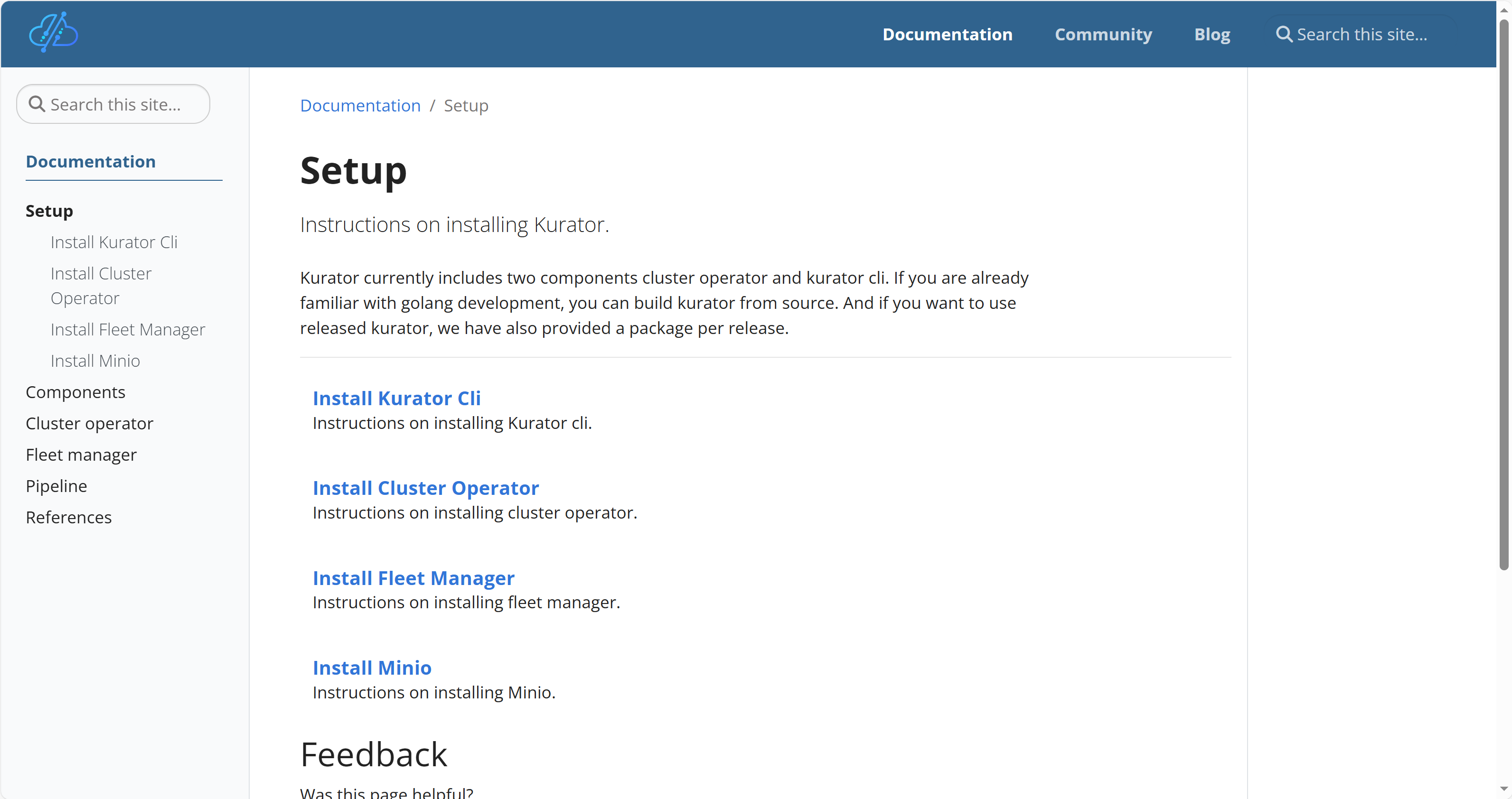

2 环境搭建:从零构建分布式云原生平台

2.1 准备工作与依赖安装

在安装Kurator之前,需要进行充分的环境准备工作。根据实战经验,需要安装Go语言环境、Helm包管理器以及Docker等常用软件。这些依赖是Kurator运行和构建集群的基础。

常见安装问题与解决方案:

在国内网络环境下,常见的镜像拉取失败(ImagePullBackOff)错误通常表现为:

failed to pull image "k8s.gcr.io/xxx": rpc error: code = Unknown desc = Error response from daemon: Get https://k8s.gcr.io/v2/: net/http: request canceled while waiting for connection

针对这一问题,可以通过配置镜像加速器、修改安装脚本中的镜像仓库地址,或通过预加载脚本将镜像导入本地仓库来解决。

2.2 Kurator安装与初始化

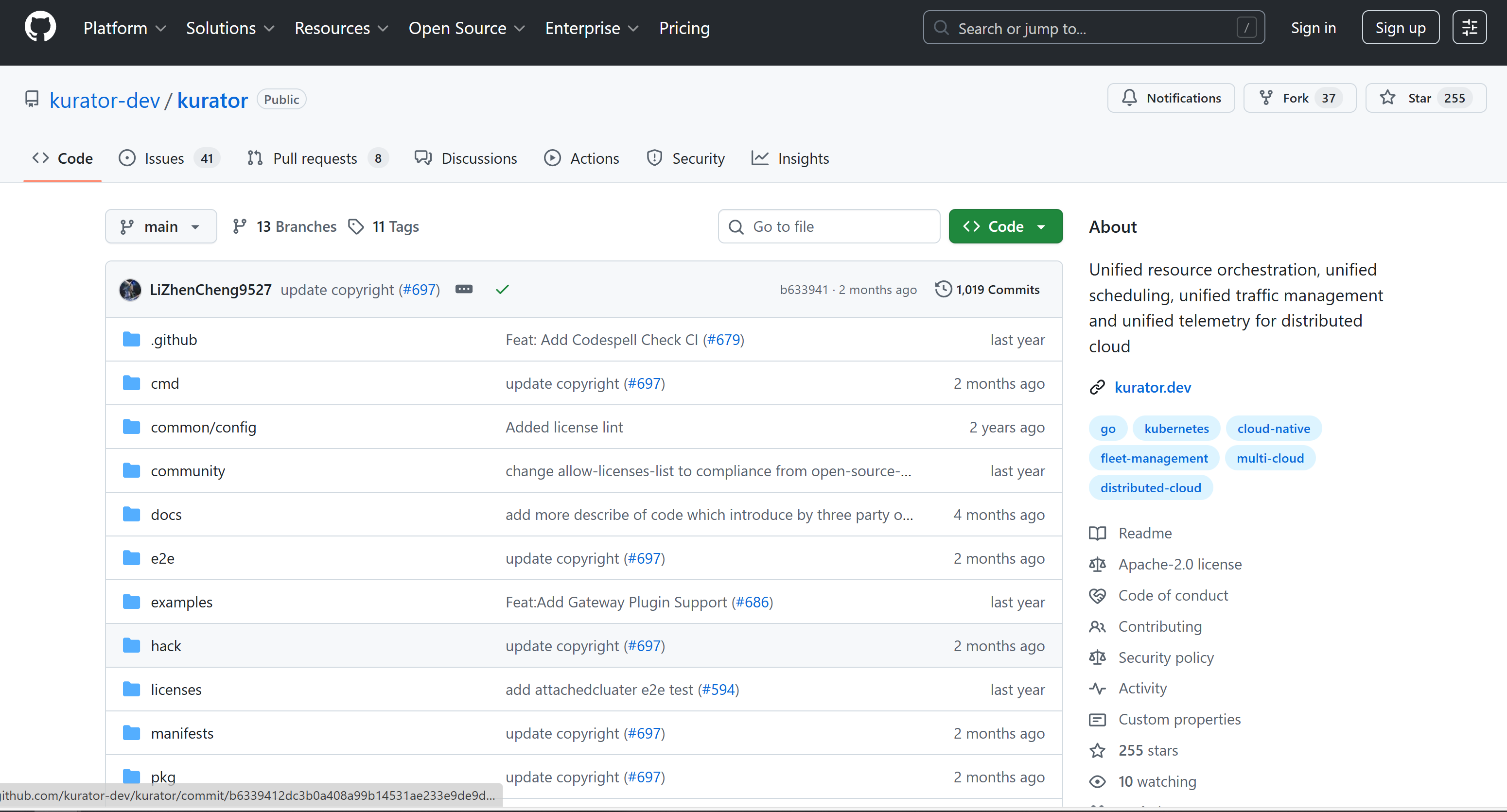

Kurator的安装可以通过源码编译方式进行:

git clone https://github.com/kurator-dev/kurator.git

cd kurator

make build

验证安装是否成功,可执行:

kurator version

成功的安装将显示类似以下信息:

Version: 1.0-dev

Commit: d753b7f60be916bd5718391ee3a08816ad360405

State: clean

Built: 2025-11-28T07:46:20Z

Go: go1.22.0

Platform: linux/amd64

2.3 现有集群接入方案

对于已有Kubernetes集群的环境,无需使用集群生命周期管理能力,可以直接通过"attached cluster"的方式将现有集群纳入Kurator管理,只需提供该集群的kubeconfig文件即可。这种低门槛的迁移方式大大降低了采用阻力。

通过attached cluster管理方式,Kurator能够纳管任何地点、由任何工具搭建的Kubernetes集群,无论这些集群是在公有云、私有云、边缘还是本地环境中。

3 核心功能深度实践:统一应用分发

3.1 基于GitOps的统一应用分发

Kurator的统一应用分发功能采用GitOps方式,使得一键将应用部署到多个云环境成为可能,同时简化了配置流程。这种方法确保了各集群中的应用版本保持一致,并能及时进行版本更新。

以下是一个实际的应用部署示例,展示了如何通过Kurator实现跨集群的应用分发:

apiVersion: apps.kurator.dev/v1alpha1

kind: Application

metadata:

name: gitrepo-kustomization-demo

namespace: default

spec:

source:

gitRepository:

interval: 3m0s

ref:

branch: master

timeout: 1m0s

url: https://github.com/stefanprodan/podinfo

syncPolicies:

- destination:

fleet: quickstart

kustomization:

interval: 5m0s

path: ./deploy/webapp

prune: true

timeout: 2m0s

这个配置示例展示了Kurator如何通过GitRepository作为应用源,并通过集群选择器将应用部署到特定标签的集群中。这种机制提供了极大的灵活性,允许用户根据业务需求将不同版本的应用部署到不同环境中。

Kurator的GitOps实现基于FluxCD,提供了自动化的应用同步和部署流程。当源代码或配置发生变更时,Kurator会自动检测这些变更,并将其同步到所有相关的环境中,从而实现代码和配置的统一管理和同步。

3.2 统一应用分发的运维价值

在实际企业环境中,统一应用分发带来了显著的运维效益:

部署效率提升:传统模式下,需要在每个集群上手动部署应用,平均耗时2小时。使用Kurator后,实现了一键部署到所有集群,耗时仅5分钟,部署效率提升24倍。

版本一致性保证:通过GitOps工作流,确保所有集群中应用版本的一致性,避免因版本差异导致的运行时问题。

审计与追溯:所有部署变更都通过Git仓库进行记录,提供了完整的审计线索,便于问题追溯和合规性检查。

4 企业级落地实战:金融科技公司的云原生转型

4.1 技术选型与架构设计

某金融科技公司在数字化升级过程中,采用Kurator构建了跨公有云、私有云和边缘节点的分布式云原生平台。该公司原有的IT基础设施存在多个孤立的Kubernetes集群,分别运行在AWS、华为云和多个地域的边缘节点上,面临管理复杂、应用分发效率低、监控不统一等问题。

技术选型决策基于以下考虑:

- Kurator:提供统一的多云多集群管理能力

- Karmada:实现多集群调度与编排

- KubeEdge:管理边缘计算节点

- Istio:提供跨集群服务治理

- Prometheus + Thanos:实现统一监控

- Kyverno:保证安全策略一致性

4.2 技术适配与攻坚

在实施过程中,团队遇到了几个关键技术挑战:

网络连通性问题:边缘节点位于NAT后,无法直接与中心集群建立连接。解决方案是采用KubeEdge的云边协同机制,通过边缘节点主动连接云端的方式解决网络障碍。

配置差异化管理:虽然应用代码相同,但不同环境的配置存在差异。通过Kurator的Kustomization能力实现配置的差异化管理:

apiVersion: kustomize.config.kurator.dev/v1beta1

kind: Kustomization

metadata:

name: region-specific-config

namespace: edge-deployment

patches:

- target:

kind: Deployment

name: store-frontend

patch: |

- op: replace

path: /spec/template/spec/containers/0/resources/limits/memory

value: 512Mi

- target:

kind: ConfigMap

name: app-config

patch: |

- op: replace

path: /data/API_ENDPOINT

value: https://region-specific-api.example.com

4.3 场景落地与生态协同

通过Kurator的Fleet抽象,将分布在多个云平台的Kubernetes集群统一管理,形成了一个逻辑上的"大集群"。这使得应用部署变得极其简单:

# 将应用部署到整个Fleet

kurator apply -f application.yaml --fleet financial-fleet

# 仅部署到边缘环境

kurator apply -f application.yaml --selector env=edge

# 金丝雀发布到部分集群

kurator apply -f canary-deployment.yaml --selector canary=true

在生态协同方面,集成了企业现有的GitLab CI/CD系统,通过Kurator的API实现了自动化部署流水线。当开发人员推送代码到特定分支时,GitLab Runner会自动触发Kurator部署相应应用到对应环境。

4.4 成效与价值

运维效率显著提升:传统模式下,需要在每个集群上手动部署应用,平均耗时2小时。使用Kurator后,实现了一键部署到所有集群,耗时仅5分钟,部署效率提升24倍。

资源利用率优化:通过Kurator的统一监控,发现了多个集群中存在的资源浪费问题,通过重新调度工作负载,整体资源利用率从38%提升至65%,年度云资源成本降低40%。

业务高可用保障:借助Kurator的跨集群故障转移能力,实现了当某个区域集群故障时,业务自动切换到其他健康集群,年度业务连续性从99.9%提升至99.99%。

开发体验改善:开发团队不再需要关心应用具体部署在哪个集群,只需通过Kurator API提交部署请求,大大简化了部署流程。

5 深度思考:Kurator在云原生生态中的定位与价值

5.1 技术整合创新

Kurator并非简单的工具堆砌,而是通过深度整合业界主流云原生技术,在其之上构建"舰队管理+统一治理能力",为企业提供从基础设施到应用运维的全栈分布式云原生解决方案。这种整合体现在:

统一API抽象:通过Fleet概念,将多个异构集群统一为逻辑上的单一集群,极大简化了管理复杂度。

声明式配置管理:沿用Kubernetes的声明式API设计理念,提供一致的用户体验。

可扩展架构:允许用户根据需要选择特定组件,或集成现有工具链。

5.2 企业级特性

Kurator在设计上充分考虑企业级需求,提供了多项关键能力:

多租户支持:通过Namespace隔离和RBAC权限控制,实现多团队共享资源的同时保证隔离性。

安全策略统一管理:通过Kyverno实现跨集群的安全策略实施,确保合规性。

备份与恢复:通过与Velero的集成,提供跨集群的统一数据保护能力(该特性正在开发中)。

5.3 与传统单节点云平台的对比

与传统单节点云平台相比,Kurator具有显著优势:

分布式特性:专为分布式云原生环境设计,能够更好地管理和调度多云、多集群的资源。

统一管理:提供了统一的策略和应用管理功能,简化了多云环境的管理复杂性。

开放性和扩展性:支持多种云原生技术和工具的集成,用户可以根据需要进行定制和扩展。

但同时,对于小型企业或简单的应用场景,Kurator可能存在一定复杂度,需要根据实际需求进行技术选型。

6 总结与展望

Kurator作为分布式云原生平台,通过"站在巨人肩膀上"的整合策略,将多个优秀的云原生项目组合成一站式解决方案,极大地降低了分布式云环境的管理复杂度。

在企业级实践中,Kurator的Fleet抽象是其最具价值的特性之一,它让运维团队能够从"管理多个独立集群"转变为"运营一个逻辑大集群",这符合云原生技术发展的未来方向。

随着企业数字化转型的深入,分布式云原生将成为常态而非例外。Kurator这样的平台将在帮助企业应对多云、混合云和边缘计算场景中发挥越来越重要的作用。对于考虑采用Kurator的企业,建议从小规模试点开始,先在不重要的业务场景中验证其稳定性和性能,逐步扩大应用范围。同时,积极参与Kurator开源社区,既能获得最新的功能特性,也能贡献自身实践,共同推动产品成熟。

Kurator作为开放原子基金会首个分布式云原生项目,不仅提供了技术解决方案,更推动了国内分布式云原生技术的发展,补充了国内分布式云原生的生态。对于整个云原生社区而言,这种开放、协作的创新发展模式,正是推动技术进步的重要动力。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献14条内容

已为社区贡献14条内容

所有评论(0)