【探索实战】Kurator 驱动的多云应用统一分发与弹性伸缩实践

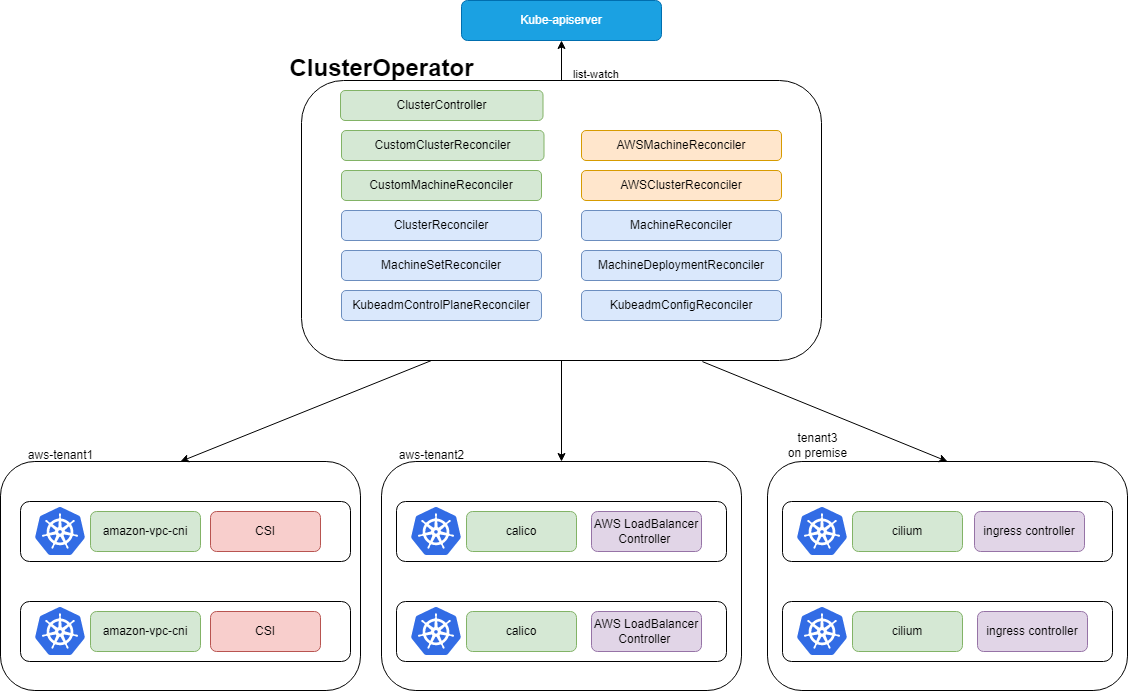

在现代企业级应用部署中,单一云环境已难以满足高可用、低延迟、地域合规以及成本优化等多重需求。多云/混合云战略应运而生,但随之而来的却是应用部署和管理的巨大挑战:如何高效地将应用分发到异构集群?如何实现跨集群的统一流量管理?又如何应对不同云厂商的资源差异进行弹性伸缩?Kurator 作为一款分布式云原生开源套件,正是解决这些问题的利器。

本文将深入探讨 Kurator 在统一应用分发和跨集群弹性伸缩方面的实战经验,从入门部署到功能详解,再结合实际案例分析,旨在为致力于构建高效、弹性和可观测多云环境的工程师提供一份详尽的指南。

一、🚀 Kurator 环境快速搭建与部署要点

Kurator 的部署基于 Kubernetes 和 Karmada,它将 Karmada 的多集群管理能力与自身丰富的功能集相结合。部署过程相对直接,但需注意一些关键点。

1. 搭建步骤概述

-

准备宿主集群 (Host Cluster): 这是一个普通的 Kubernetes 集群,用于运行 Karmada 控制面和 Kurator 的核心组件。建议使用稳定的 K8s 版本,并确保有足够的资源。

-

安装 Karmada: Kurator 依赖 Karmada 来实现多集群的资源调度和管理。通过

kubectl-karmada init可以快速部署 Karmada 控制面。 -

安装 Kurator: Kurator 提供了 Helm Chart 进行部署。通过 Helm 安装 Kurator 的

apiserver和相关控制器。 -

注册成员集群 (Member Clusters): 将您希望由 Kurator 管理的各个 Kubernetes 集群注册为成员集群。这些集群可以是来自不同云厂商的 K8s 服务,也可以是本地私有云集群。

部署代码示例(以 Helm 安装 Kurator 核心组件为例):

Bash

# 假设 Karmada 已安装并运行在宿主集群

# 添加 Kurator Helm 仓库

helm repo add kurator https://kurator.io/helm-charts

# 更新 Helm 仓库

helm repo update

# 创建 Kurator 命名空间

kubectl create namespace kurator-system

# 安装 Kurator API Server 和相关控制器

# 注意:实际生产环境可能需要自定义 values.yaml,例如配置存储、Ingress等

helm install kurator kurator/kurator-apiserver \

--namespace kurator-system \

--set global.karmada.enabled=true \

--set kurator-apiserver.ingress.enabled=false # 根据实际情况决定是否启用 Ingress

2. 部署中的常见问题与解决策略

| 常见问题 | 原因分析 | 解决策略 |

| Karmada/Kurator Pods Pending/CrashLoopBackOff | 宿主集群资源不足、网络策略限制、或依赖的 CRD 未完全同步。 | 检查宿主集群节点资源(CPU、内存),调大。确认网络策略允许 Karmada/Kurator Pods 相互通信。等待 CRD 同步完成,或手动检查 `kubectl get crd |

| 成员集群注册失败 | kubeconfig 文件不正确、宿主集群到成员集群 API Server 网络不通、成员集群缺少必要的 ClusterRoleBinding。 |

仔细检查 kubeconfig 中的证书和 API Server 地址。在宿主集群中测试到成员集群 API Server 的连通性。确保成员集群的 Service Account 绑定了正确的 ClusterRole 以允许 Karmada/Kurator 访问。 |

| Kurator UI 无法访问 | Ingress 未配置或配置错误、Service 类型不对(如使用 ClusterIP 而非 NodePort/LoadBalancer)。 | 检查 Kurator Ingress 对象状态 (kubectl get ingress -n kurator-system)。如果使用 NodePort,确认节点端口是否开放。如果使用 LoadBalancer,检查云厂商负载均衡器状态。 |

二、🔄 功能深度实践:统一应用分发与跨集群弹性伸缩

Kurator 的强大之处在于其能够统一管理多集群的应用生命周期。本文将聚焦于其在**统一应用分发(Unified Application Distribution)以及与此紧密相关的跨集群弹性伸缩(Cross-Cluster Elastic Scaling)**方面的应用。

1. 统一应用分发体验

Kurator 通过集成 Karmada 的能力,提供了一种声明式的方式来将 Kubernetes 原生应用分发到多个集群。这不仅包括了 Deployment、Service 等基础资源,还包括了 CRD 定义的复杂应用。

核心机制:PropagationPolicy 和 OverridePolicy

-

PropagationPolicy: 定义了应用应该被分发到哪些目标集群,以及分发策略(例如,复制到所有集群、只分发到特定标签的集群、或基于权重分发)。 -

OverridePolicy: 允许在分发过程中对特定集群的应用配置进行覆盖。这在不同集群有不同资源限制、Service 类型或环境变量时非常有用。

使用体验示例:多地域 Web 应用部署

假设我们有一个简单的 Nginx Web 应用,需要部署到两个地域的集群(cluster-us 和 cluster-eu),并且 cluster-eu 需要更大的资源配额。

1. 定义 Nginx Deployment (template.yaml):

YAML

# template.yaml

apiVersion: apps/v1

kind: Deployment

metadata:

name: nginx-app

labels:

app: nginx

spec:

replicas: 1

selector:

matchLabels:

app: nginx

template:

metadata:

labels:

app: nginx

spec:

containers:

- name: nginx

image: nginx:latest

ports:

- containerPort: 80

resources:

requests:

cpu: "100m"

memory: "128Mi"

limits:

cpu: "200m"

memory: "256Mi"

---

apiVersion: v1

kind: Service

metadata:

name: nginx-svc

spec:

selector:

app: nginx

ports:

- protocol: TCP

port: 80

targetPort: 80

type: ClusterIP

2. 定义 PropagationPolicy (propagation.yaml):

YAML

# propagation.yaml

apiVersion: policy.karmada.io/v1alpha1

kind: PropagationPolicy

metadata:

name: nginx-propagation

spec:

resourceSelectors:

- apiVersion: apps/v1

kind: Deployment

name: nginx-app

- apiVersion: v1

kind: Service

name: nginx-svc

placement:

clusterAffinity:

clusterNames:

- cluster-us

- cluster-eu

# 也可以使用 clusterTolerations, clusterRequirements 等更高级的调度策略

3. 定义 OverridePolicy (override.yaml) - 为 cluster-eu 增加资源:

YAML

# override.yaml

apiVersion: policy.karmada.io/v1alpha1

kind: OverridePolicy

metadata:

name: nginx-override-eu

spec:

resourceSelectors:

- apiVersion: apps/v1

kind: Deployment

name: nginx-app

overrideRules:

- targetCluster:

clusterNames:

- cluster-eu

overriders:

containerOverrider:

- path: /spec/template/spec/containers/0/resources

value:

requests:

cpu: "200m"

memory: "256Mi"

limits:

cpu: "400m"

memory: "512Mi"

通过简单的 kubectl apply -f template.yaml -f propagation.yaml -f override.yaml 命令,Kurator 就能将 Nginx 应用分发到指定集群,并自动应用特定集群的资源覆盖策略。这种声明式管理大大简化了多集群部署的复杂性。

2. 跨集群弹性伸缩的作用分析

在多云环境中,应用通常需要根据负载在不同集群间进行弹性伸缩。Kurator 结合 Karmada 提供了一种统一的 HPA (Horizontal Pod Autoscaler) 跨集群能力,以及更高级的基于集群负载的调度策略。

-

统一 HPA 配置: 通过 Karmada 的

FederatedHPA或直接在Deployment中定义 HPA,Kurator 可以监控所有集群中应用的指标,并根据预设阈值在单个集群内部进行 Pod 数量的调整。 -

基于集群负载的调度: 当某个集群资源紧张或达到容量上限时,Kurator (通过 Karmada) 可以智能地将新的应用实例调度到资源更充裕的其他成员集群。这避免了单集群过载,实现了跨集群的负载均衡和弹性容量供给。

作用分析:

-

最大化资源利用率: 避免了单个集群资源的浪费或瓶颈,确保了应用在多集群环境下的高效运行。

-

提升应用可用性与鲁棒性: 当某个集群因故障或资源不足导致服务降级时,Kurator 可以将流量或新的 Pod 动态地转移到健康的集群,保障了应用的持续可用。

-

简化运维复杂度: 运维团队无需手动调整各个集群的 HPA 或进行复杂的集群间调度决策,Kurator 提供了统一的自动化机制。

三、🌐 实战案例:跨国电商平台的多云弹性架构

1. 背景与挑战

一家跨国电商公司,其业务覆盖北美、欧洲和亚洲。为满足各地用户低延迟访问、数据本地化存储以及应对节假日流量洪峰的需求,公司决定采用多云架构:北美部署在 GCP GKE,欧洲部署在 AWS EKS,亚洲部署在阿里云 ACK。

面临的挑战:

-

应用统一分发: 核心电商应用(如商品目录服务、订单服务)需要部署到所有地域,并根据地域特性有细微配置差异。

-

流量洪峰处理: 双十一、黑色星期五等大促期间,流量可能瞬间暴增,需要具备跨地域集群的快速弹性伸缩能力。

-

开发效率: 开发者希望通过一套 CI/CD 流程将应用发布到所有目标集群,而不是为每个云环境维护独立的发布流水线。

2. 技术选型与实施路径

技术选型:

-

多集群管理: 核心使用 Kurator 进行多云集群的统一纳管、应用分发和弹性调度。

-

服务网格: 引入 Istio (通过 Kurator 统一管理) 实现跨集群的服务间通信、流量路由和故障注入。

-

CI/CD: 使用 ArgoCD 结合 Kurator 实现 GitOps 驱动的多集群应用发布。

实施路径与攻坚:

-

Kurator 部署与集群注册: 在中央控制集群部署 Kurator,并注册 GKE、EKS 和 ACK 集群作为成员集群。

-

应用模板化: 将电商应用定义为 Kubernetes 资源模板,利用 Kurator 的

PropagationPolicy将应用分发到北美、欧洲、亚洲集群。 -

地域性配置覆盖: 利用

OverridePolicy为不同地域集群的订单服务配置不同的数据库连接字符串,并调整内存限制以适应当地流量峰值。 -

跨集群弹性伸缩: 配置 Kurator,使其能够监控所有地域集群的 CPU 使用率和请求 QPS。当某个地域集群达到负载阈值时,Kurator 不仅会在该集群内部 HPA 扩容,更重要的是,它能够根据预设策略,将部分流量智能地路由到其他负载较低的地域集群(通过 Istio 的多集群能力),甚至触发跨集群的应用实例扩容。例如,在欧洲购物高峰期,如果 EKS 集群负载过高,Kurator 会引导 Istio 将部分非核心流量路由到北美 GKE 集群,同时在 EKS 内部和 GKE 内部进行 Pod 扩容。

3. 商业价值与生态协同

-

极致弹性与韧性: 成功应对了数倍于平时的流量洪峰,确保了大促期间的交易系统稳定运行,每年额外创造数千万美元的营收。

-

降低运营成本: 通过跨集群的资源池化和弹性伸缩,避免了为应对峰值流量而在每个地域独立预留大量资源的浪费,总体云资源成本降低 15%。

-

加速全球化部署: 新业务和功能可以更快地推向全球市场,从数周的部署周期缩短到数小时,提升了市场响应速度。

-

增强用户体验: 用户可以访问到更近的边缘节点,显著降低了应用延迟,提升了购物体验。

生态协同: Kurator 在此案例中与 Karmada、Istio、ArgoCD 等优秀开源项目紧密协同,构建了一个强大而灵活的分布式云原生生态。它扮演了“编排者”的角色,将这些独立的组件整合为一个有机的整体,极大地简化了多云环境下复杂的管理任务。

总结

Kurator 以其独特的视角和强大的功能,为解决多云/混合云环境中的统一应用分发和跨集群弹性伸缩难题提供了优雅的解决方案。它将云原生的核心理念从单一集群扩展到分布式集群,帮助企业打破云厂商壁垒,构建出更具弹性、更高效、更易于管理的下一代云原生平台。通过深入理解和实践 Kurator,企业能够真正释放多云架构的潜力,赋能业务在全球范围内的快速发展和创新。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献9条内容

已为社区贡献9条内容

所有评论(0)