【探索实战】从零到一构建企业级分布式云原生平台:Kurator实战全攻略与深度解析

【探索实战】从零到一构建企业级分布式云原生平台:Kurator实战全攻略与深度解析

【探索实战】从零到一构建企业级分布式云原生平台:Kurator实战全攻略与深度解析

开篇:为什么分布式云原生需要Kurator?

在当前多云和边缘计算成为常态的背景下,企业面临着异构集群管理复杂、应用分发效率低下、流量治理困难以及监控策略碎片化等核心挑战。传统的单一集群管理方式已无法满足跨云、跨地域、跨环境的统一管控需求。这正是Kurator应运而生的背景——它不仅仅是一个工具,而是一个开箱即用的分布式云原生管理平台,旨在为用户提供面向分布式云原生环境的一站式解决方案。

Kurator的独特价值在于其集成化与一体化的设计哲学。它并非从零造轮子,而是站在众多优秀开源项目的肩膀上,包括Karmada(多集群编排)、Istio(服务网格)、Prometheus(监控)、KubeEdge(边缘计算)和Volcano(批量计算)等,并将这些组件有机融合,形成了一套完整的分布式云原生能力栈。通过本文,我将带你从环境搭建开始,深入核心功能,并分享实战落地经验,全面解析Kurator如何化解分布式云的管理之痛。

一、轻松入门:Kurator分布式云原生环境搭建全记录

1.1 前期准备与Kurator CLI安装

在开始搭建之前,请确保你的操作环境中已安装以下基础依赖:Kubernetes集群(版本1.20+,用于安装Kurator的控制面)、kubectl、Helm(3.0+)以及Go(1.19+,如需从源码构建)。Kurator提供了多种安装方式,最简单快捷的是使用其官方发布的CLI工具。

首先,通过以下命令下载并安装Kurator CLI工具。这个过程会从官方仓库获取最新的稳定版本。

# 使用curl下载安装(假设最新版本为v0.5.0,请以官网为准)

curl -LO https://github.com/kurator-dev/kurator/releases/download/v0.5.0/kurator-cli-v0.5.0-linux-amd64.tar.gz

tar -xzf kurator-cli-v0.5.0-linux-amd64.tar.gz

sudo mv kurator-cli /usr/local/bin/

# 验证安装是否成功

kurator version

如果网络环境允许从GitHub直接克隆,你也可以选择通过源码构建,以获取最前沿的特性:

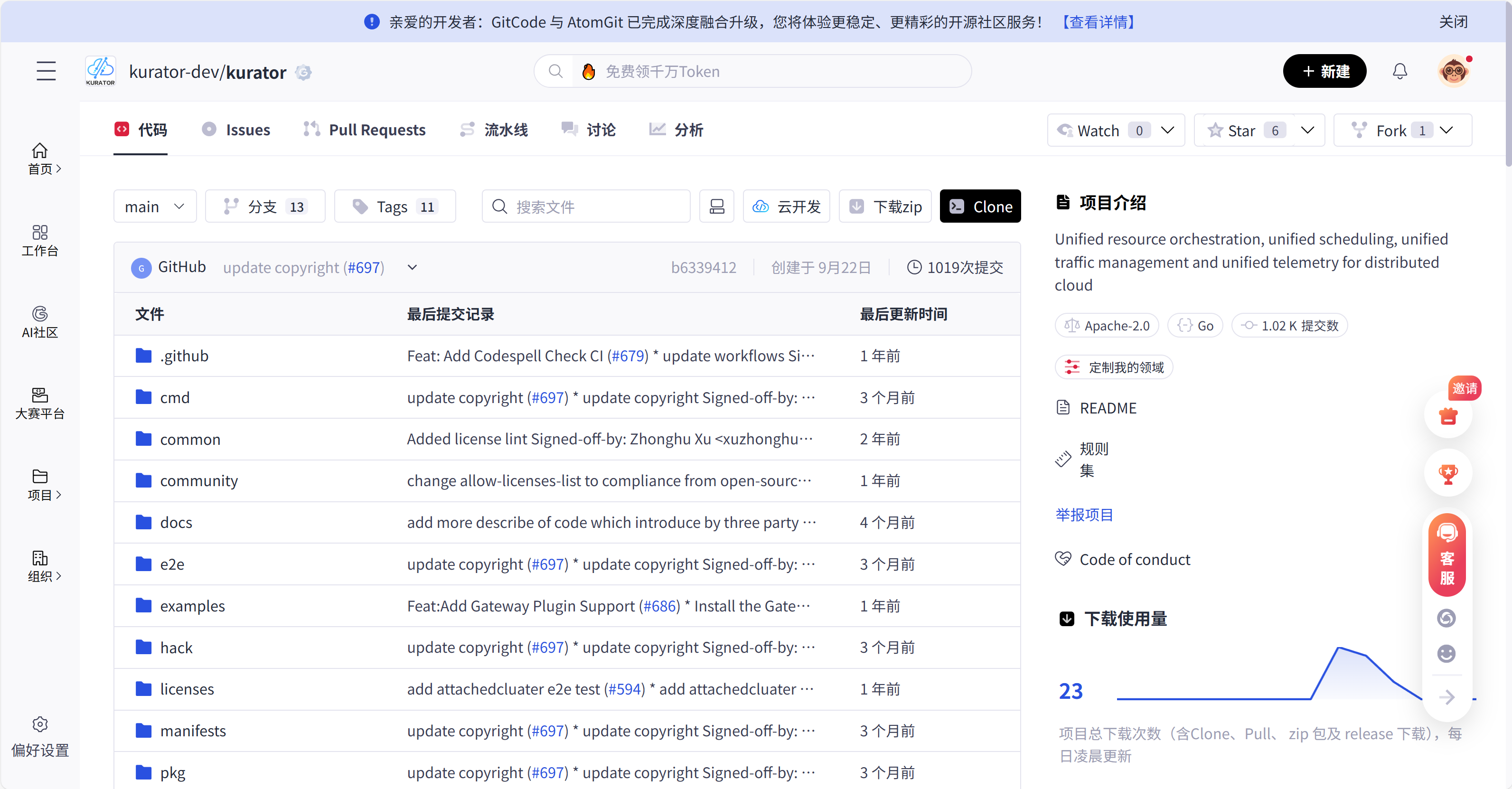

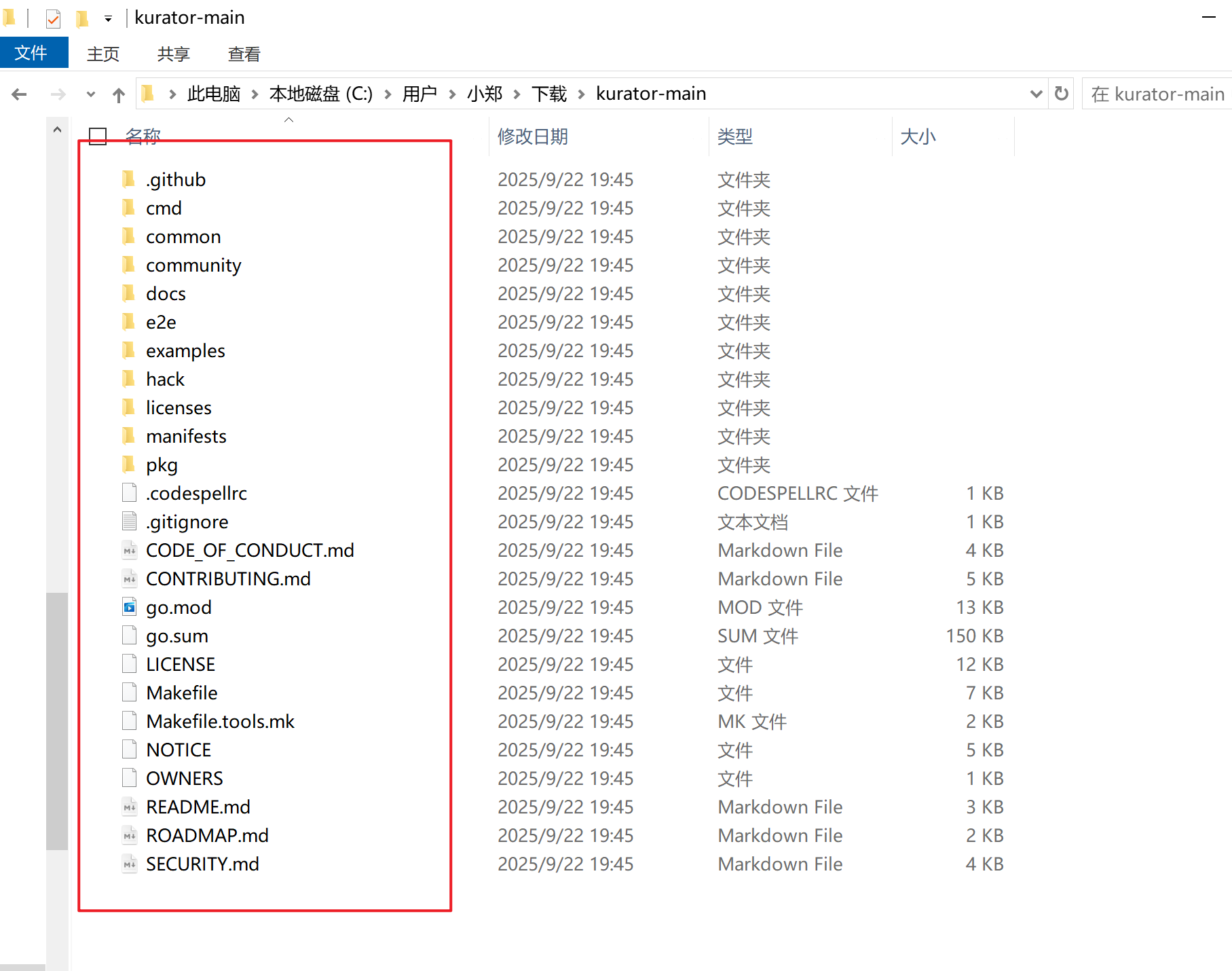

如图这是kurator的gitCode站内资源

点击项目中可以看到如下的源码文件内容

到这一步我们下载源码就分成方便啦

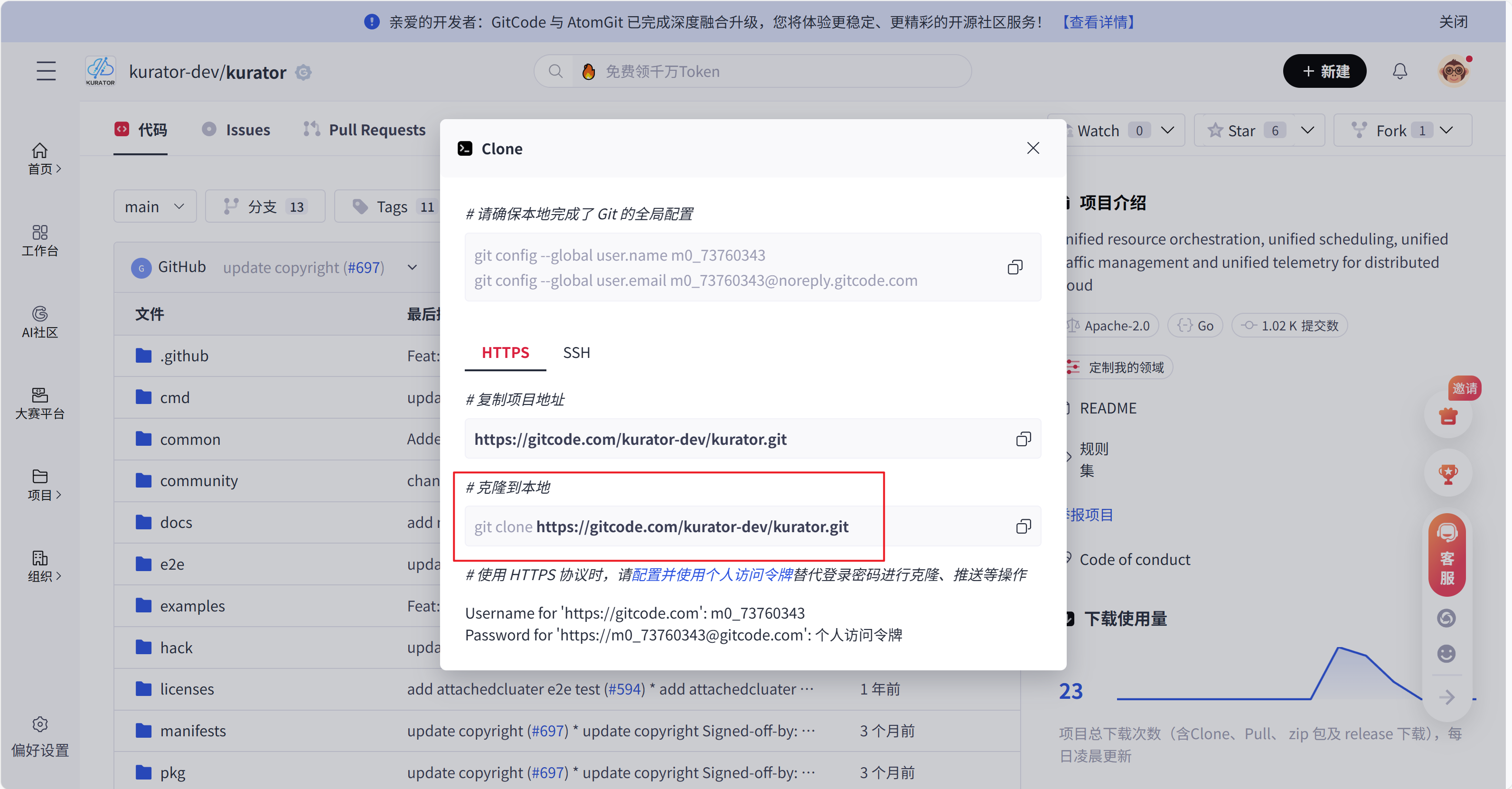

如果我们有git环境就可以直接用命令clone到本地

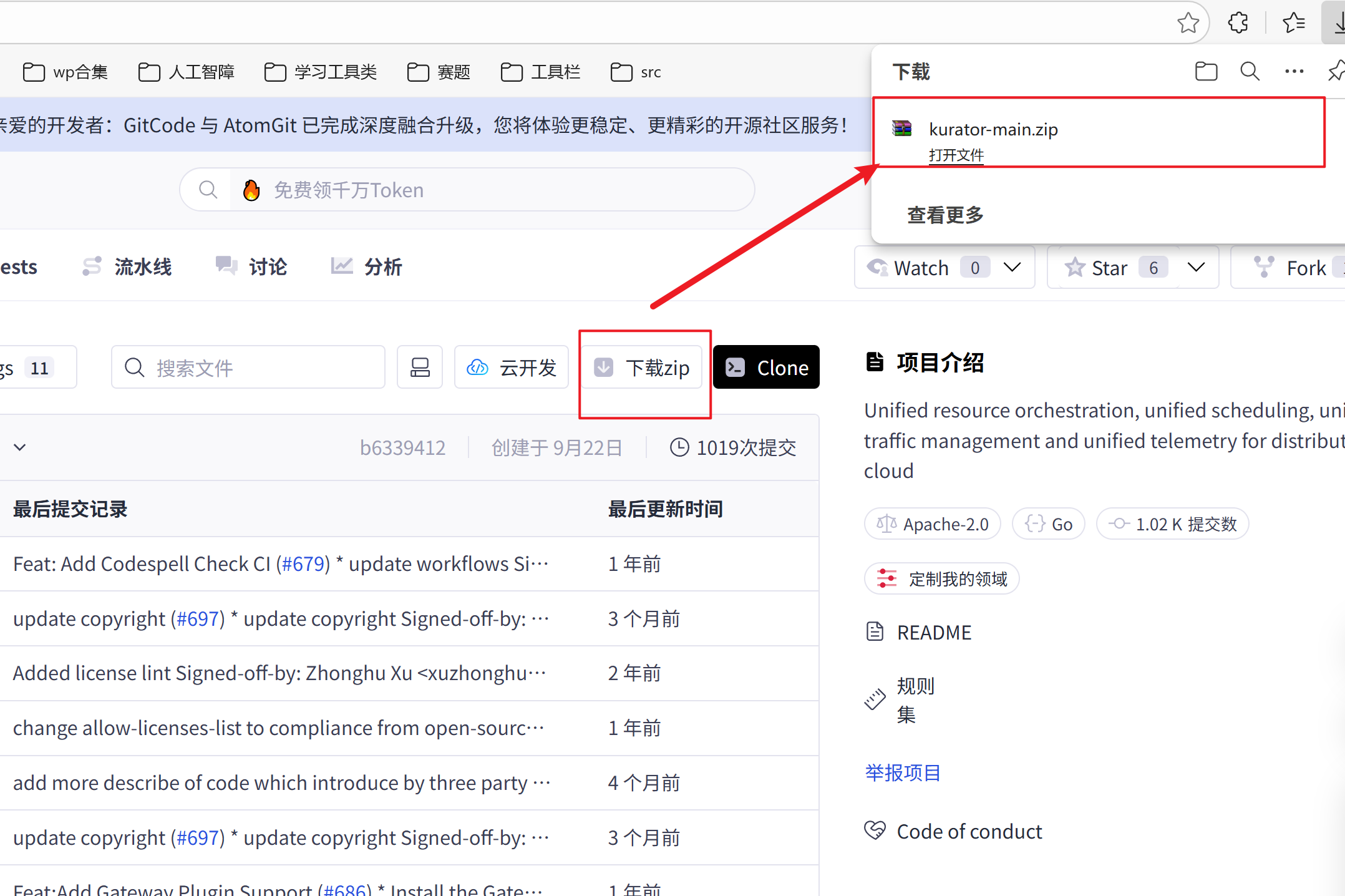

如果没有的话也可以直接下载zip包

下载下来解压缩就能得到源码文件啦

如下是源码文件

安装小贴士与常见问题:在国内网络环境下,从GitHub直接下载Release包可能会很慢或失败。一个有效的解决办法是使用镜像站,或者先通过代理工具下载到本地。如果遇到权限错误,请确保解压后的二进制文件具有可执行权限(chmod +x kurator-cli)。

1.2 核心组件:Cluster Operator与Fleet Manager部署

Kurator的核心运行依赖于两个关键组件:Cluster Operator 和 Fleet Manager。它们分别负责单个集群的生命周期管理和多个集群(舰队)的统一协调。

我们使用Helm来安装这些组件,这能极大地简化依赖管理和配置流程。

# 1. 添加Kurator的Helm仓库

helm repo add kurator https://kurator-dev.github.io/kurator/

helm repo update

# 2. 安装Cluster Operator

helm install cluster-operator kurator/cluster-operator -n kurator-system --create-namespace

# 3. 安装Fleet Manager

helm install fleet-manager kurator/fleet-manager -n kurator-system

部署完成后,使用以下命令验证所有Pod是否运行正常。这是确保后续所有功能可用的基础。

kubectl get pods -n kurator-system

你应该看到类似 cluster-operator-xxxx 和 fleet-manager-xxxx 的Pod状态均为 Running。

1.3 集成外部集群与舰队创建实战

Kurator真正的威力在于管理多个集群。本节将演示如何将一个外部集群(例如,一个在公有云上的业务集群)注册到Kurator,并加入到一个“舰队”(Fleet)中。

首先,我们需要在Kurator的控制集群中创建一个 Fleet 资源,这是一个逻辑上的集群分组。

# fleet-demo.yaml

apiVersion: fleet.kurator.dev/v1alpha1

kind: Fleet

metadata:

name: production-fleet

namespace: default

spec:

clusters:

- name: on-premise-cluster # 你的主集群,即Kurator安装所在的集群

kubeconfig: {} # 留空表示使用当前上下文

# 其他外部集群将通过后续步骤动态加入

应用这个配置:kubectl apply -f fleet-demo.yaml。

接下来,要将一个外部集群(假设其kubeconfig文件为 remote-cluster-kubeconfig.yaml)加入舰队,Kurator CLI提供了简洁的命令。该命令会在目标集群中安装必要的代理组件,并完成注册。

kurator fleet join production-fleet --kubeconfig ./remote-cluster-kubeconfig.yaml --cluster-name cloud-cluster-01

关键点解析:这个 join 过程背后,Kurator会自动处理服务账户创建、权限绑定以及在目标集群中部署kurator-agent。完成后的舰队,为后续的统一应用分发、流量治理和监控奠定了基石。

二、核心功能深潜:统一应用分发如何重塑运维流程

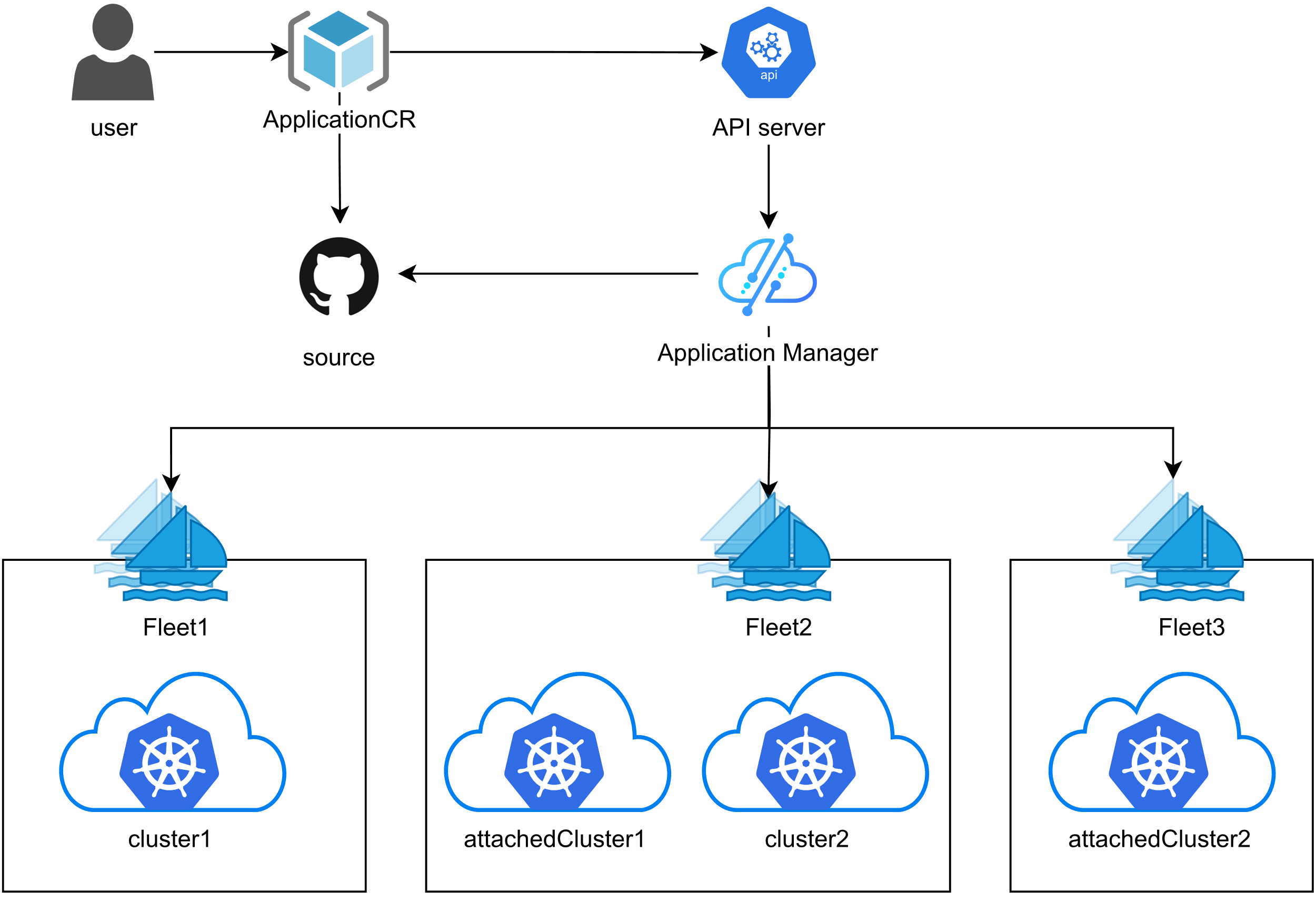

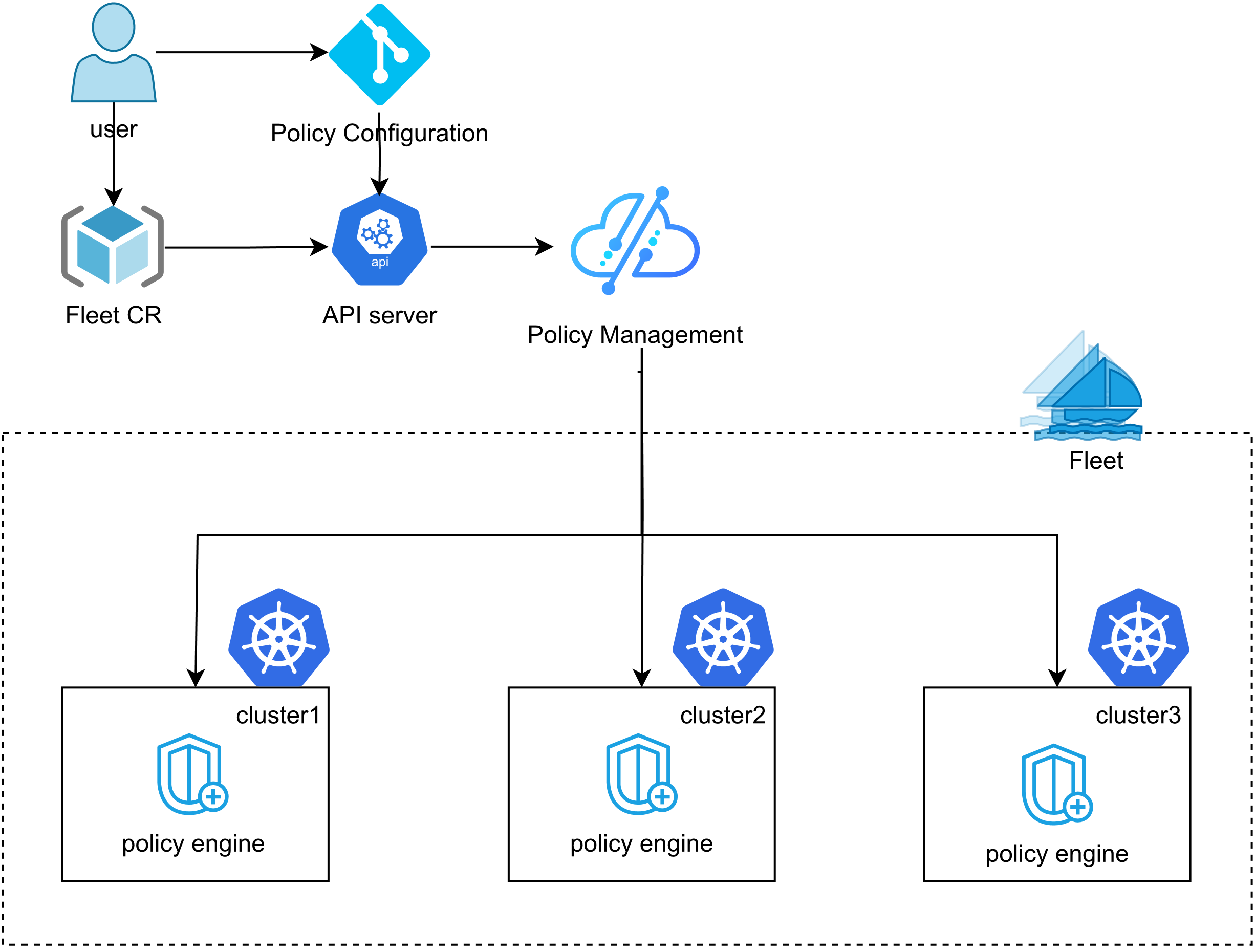

如图是Kurator 统一应用分发流程,可以看到从user到集群的过程,想了解更详细内容的朋友可以去官网看看哟:

2.1 跨越集群鸿沟:GitOps驱动的应用部署

在传统多集群环境中,运维团队需要分别登录每个集群,执行kubectl apply或维护多套Helm Release,极易导致配置漂移和发布错误。Kurator的统一应用分发功能,基于FluxCD和Karmada,实现了真正的“一次定义,处处运行”。

其核心是通过一个 DistributionPolicy 资源,来精准定义应用应该部署到舰队中的哪些集群、哪个命名空间,甚至可以根据集群标签进行差异化配置。下面是一个将前端应用部署到所有带有 env: production 标签集群的示例:

# app-distribution.yaml

apiVersion: apps.kurator.dev/v1alpha1

kind: Application

metadata:

name: frontend-app

namespace: apps

spec:

source: # 应用来源,支持Helm仓库、Git仓库或OCI镜像

helm:

chart: nginx-ingress

version: 4.0.0

repoURL: https://helm.nginx.com/stable

distribution: # 分发策略

fleet: production-fleet

placement:

clusterSelector:

matchLabels:

env: production

overrides: # 可选的集群差异化配置

- targetClusters:

clusterSelector:

matchLabels:

region: us-west

values: # 为美国西部的集群覆盖特定的values

controller:

replicaCount: 3

应用此配置后,Kurator的Fleet Manager会与Karmada协作,自动将Helm Chart渲染并分发到所有匹配的集群中。你无需关心每个集群的具体操作,只需在中心控制面观察整体的部署状态。

2.2 作用分析:从效率提升到风险管控

统一应用分发带来的变革是深远的:

- 运维效率的指数级提升:部署10个集群的应用,从以往数小时的手动或脚本操作,缩短到几分钟的声明式配置。发布、回滚、更新都变得集中且可控。

- 配置一致性的根本保证:通过中心化的策略管理,彻底杜绝了因人工操作失误导致的集群间配置差异,为应用提供了稳定一致的运行环境。

- 灰度发布与多集群蓝绿部署的基石:借助精细的

placement和overrides,你可以轻松实现将新版本应用先部署到少数“金丝雀”集群进行验证,随后再逐步铺开,极大降低了生产变更的风险。

三、驾驭流量:统一服务治理在混合云中的实践

3.1 构建跨集群的服务网格网络

在分布式云环境中,服务间的通信不再局限于单一集群内部。Kurator基于 Istio 构建的统一流量治理能力,抽象了复杂的多集群服务网格搭建过程,让跨集群的服务发现和调用如同在同一个集群内一样简单。

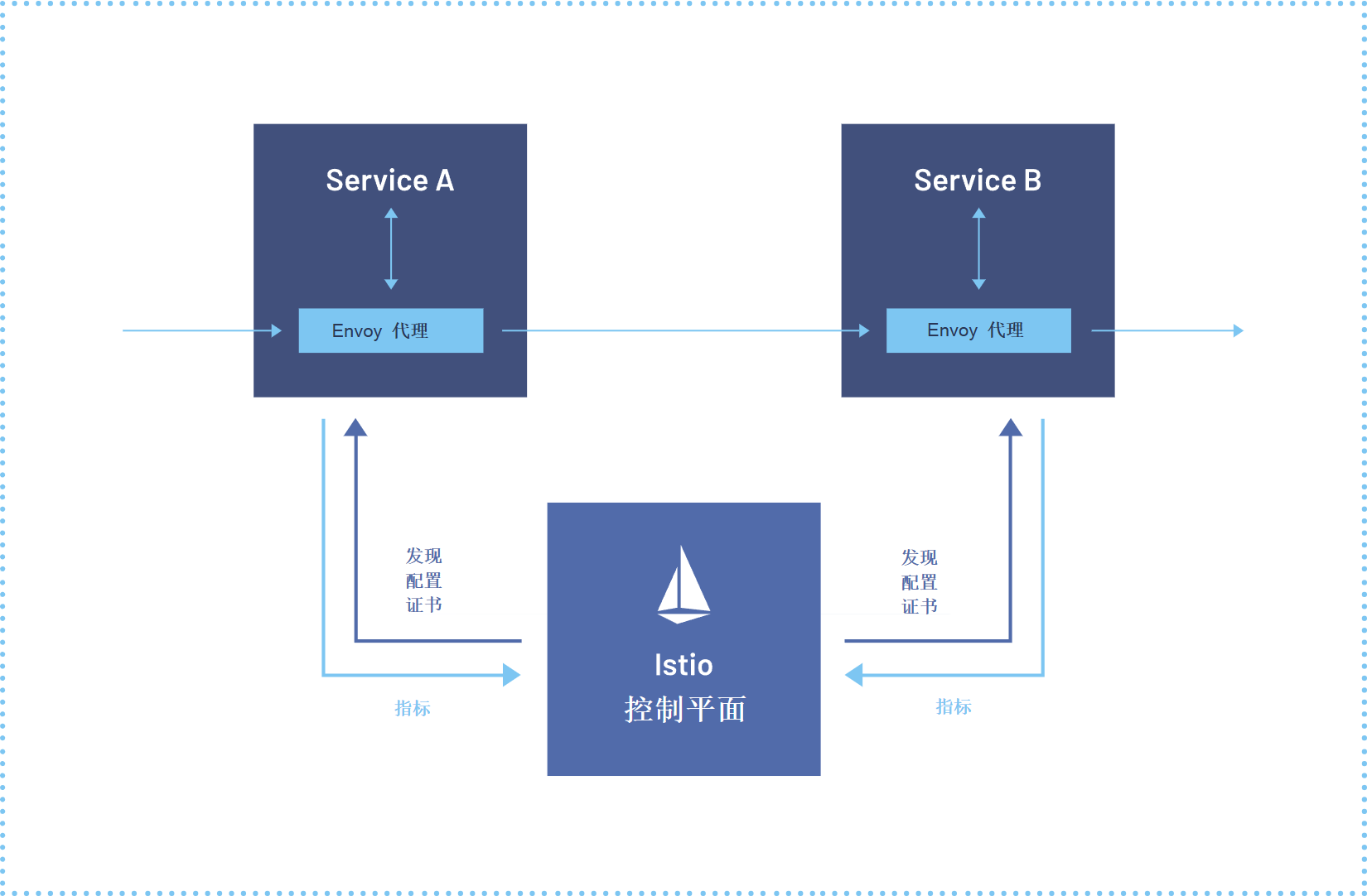

如图是lstio服务网格流程图,不同服务从代理结果listo控制平面的流量控制: Kurator通过 Fleet 资源,自动在舰队内的各个集群中协调部署Istio控制平面和数据平面,并配置好集群间的网络对等与信任关系。对于应用开发者而言,他们几乎感知不到集群的边界。定义一个跨集群的VirtualService,即可将流量按地域、负载或其他自定义规则路由到不同集群的后端服务。

Kurator通过 Fleet 资源,自动在舰队内的各个集群中协调部署Istio控制平面和数据平面,并配置好集群间的网络对等与信任关系。对于应用开发者而言,他们几乎感知不到集群的边界。定义一个跨集群的VirtualService,即可将流量按地域、负载或其他自定义规则路由到不同集群的后端服务。

# global-virtual-service.yaml

apiVersion: networking.istio.io/v1beta1

kind: VirtualService

metadata:

name: global-review-service

namespace: kurator-fleet-production-fleet # 注意这个特殊的命名空间,由Kurator管理

spec:

hosts:

- reviews.prod.svc.cluster.local # 全局服务名

http:

- match:

- headers:

region:

exact: asia

route:

- destination:

host: reviews # 服务名

subset: v1

weight: 80

- destination:

host: reviews

subset: v2

weight: 20

- route: # 默认路由到其他区域

- destination:

host: reviews

subset: v1

这个配置实现了一个经典的跨集群灰度发布场景:来自亚洲区域的流量,80%流向v1版本,20%流向v2版本;其他区域流量全部流向v1版本。所有后端Pod可能分布在不同的Kubernetes集群中,但流量治理策略却是统一、清晰的。

3.2 价值凸显:简化网络复杂度,赋能全局治理

统一流量治理的价值在于:

- 网络复杂性的抽象:运维人员无需手动配置繁琐的Istio多集群主从架构、网关证书交换和ServiceEntry。Kurator以“舰队”为中心,提供了自动化的一键式网格搭建体验。

- 全局服务视图与治理:运维团队获得了一个统一的控制台(可结合Istio原生UI或Kiali),可以查看跨越所有集群的服务拓扑、流量指标和调用链,实现真正的全局可观测性。

- 提升应用架构韧性:轻松实现跨集群的故障转移、负载均衡和地域亲和性路由,当某个集群或区域发生故障时,流量可以自动、快速地被引导至健康集群,极大提升了业务的连续性和韧性。

四、洞悉全局:统一监控与策略管理构建合规防线

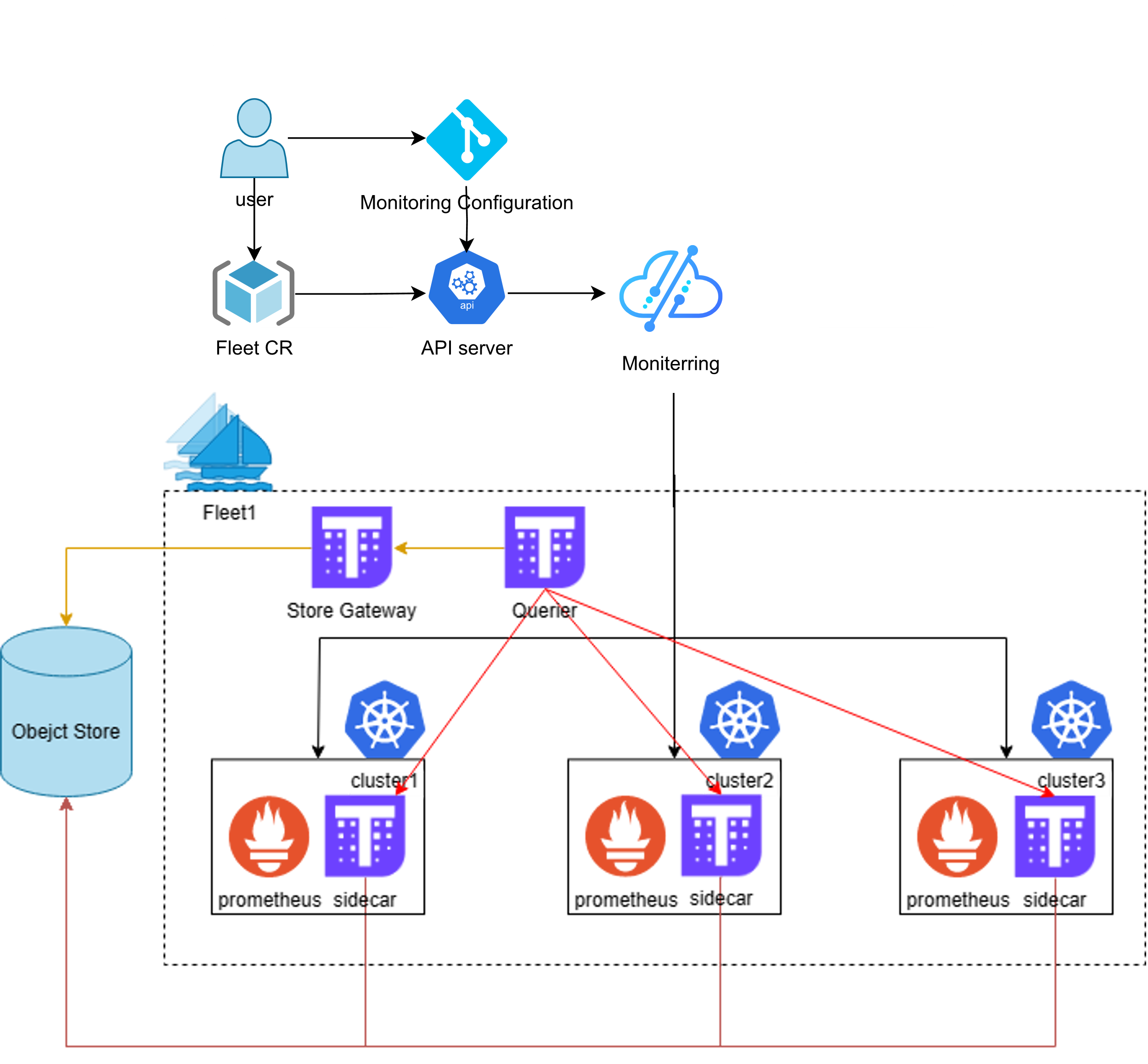

这是Kurator 统一监控流程图,可以看到user从头到尾的监控整体性:

4.1 聚合所有集群的可观测性数据

监控碎片化是分布式云的另一大痛点。Kurator内置集成了 Prometheus 和 Thanos,提供了开箱即用的统一监控方案。它在每个成员集群中部署Prometheus采集数据,并通过Thanos实现数据的全局查询与聚合。

配置舰队级别的监控,只需要在Fleet资源中启用监控特性,并指定存储配置(例如集成的MinIO)。

# fleet-with-monitoring.yaml

apiVersion: fleet.kurator.dev/v1alpha1

kind: Fleet

metadata:

name: observed-fleet

spec:

clusters: [...]

plugin:

monitor:

thanos:

objectStore:

minio:

endpoint: minio.kurator-system.svc.cluster.local:9000

bucket: thanos-metrics

accessKey: minioadmin

secretKey: minioadmin

启用后,你可以在中心位置使用统一的Grafana面板,查询类似 sum(container_cpu_usage_seconds_total{cluster=\"cloud-cluster-01\"}) 这样的指标,cluster标签由Kurator自动注入,从而轻松实现指标按集群、按命名空间等多维度聚合分析。

4.2 以策略即代码保障集群安全与合规

如图为Kurator 统一策略管理参考图:

统一策略管理功能基于 Kyverno,允许你定义舰队级别的安全策略、合规性检查和资源规范。这些策略会作为“护栏”自动下发并强制执行到每一个成员集群。

# fleet-policy.yaml

apiVersion: kyverno.io/v1

kind: ClusterPolicy

metadata:

name: require-labels

annotations:

policies.kurator.dev/fleet: observed-fleet # 关键注解,指定生效的舰队

spec:

validationFailureAction: Enforce

rules:

- name: check-for-cost-center

match:

any:

- resources:

kinds:

- Pod

validate:

message: "All pods must have a `cost-center` label."

pattern:

metadata:

labels:

cost-center: "?*" # 要求必须存在cost-center标签,且值非空

这个策略会强制要求observed-fleet舰队下所有集群内的每一个Pod都必须带有cost-center标签。任何试图创建不符合该策略的Pod的请求都会被直接拒绝,从源头保障了资源的规范性和成本的可追溯性。

五、实战复盘:某电商企业分布式云平台落地记

5.1 技术选型与适配攻坚

我们曾协助一家业务覆盖全球的电商企业构建其云原生平台。其核心挑战在于:华北、北美、欧洲三地的Kubernetes集群(分别来自不同云厂商和自建IDC)独立运营,大促时流量调度不灵,故障排查如同“黑盒”。

在技术选型阶段,我们评估了多个多集群管理方案。Karmada在编排能力上表现出色,但其在完整的“开箱即用”体验、尤其是与监控、治理等下游生态的集成上仍有欠缺。而Kurator提出的“电池 included but removable”(内置电池但可拆卸)理念,即提供完整集成方案又允许替换底层组件,完美匹配了客户“既要快速见效,又要长期可控”的需求。

在适配攻坚期,主要挑战在于企业现有的自研网络插件与Kurator默认的跨集群网络方案存在冲突。我们并没有修改Kurator核心代码,而是利用其良好的扩展性,与社区共同协作,通过实现一个自定义的 NetworkProvider 插件接口,成功将自研网络集成进去。这个过程体现了Kurator架构的灵活性。

5.2 场景落地与价值实现

在“黑五”大促场景中,我们利用Kurator实现了关键落地:

- 统一应用分发:将促销活动的后端服务和应用配置,一次性、无误地发布到全球三个区域的集群。

- 智能流量治理:通过统一配置的VirtualService,将北美用户的流量优先引导至北美集群,并在任一区域集群负载超过80%时,自动将部分流量权重调整至其他低负载区域,实现了跨洲际的负载均衡与容灾。

- 全局监控大盘:运维团队在一个Grafana界面下,即可实时对比三大区域的订单处理延迟、服务错误率等核心业务指标,定位问题时间从小时级缩短到分钟级。

用户反馈显示,平台运维团队的发布效率提升了70%,因配置错误导致的线上问题减少了95%。商业效益上,高效的资源调度和容灾能力,预计在大促期间为企业避免了因系统过载可能导致的数百万美元潜在营收损失。在生态价值层面,该企业将自研网络插件的集成经验反馈给社区,丰富了Kurator的生态实践,形成了良性循环。

六、展望与建议:分布式云原生的未来之路

6.1 Kurator的创新集成优势

Kurator的独创性不在于替代,而在于卓越的集成与体验优化。它将Karmada、Istio、Prometheus等星海中的明星项目,通过“舰队”这个核心抽象,整合成了一艘功能完备的“星际战舰”。

- 声明式的舰队API:这是高于单个集群的更高层抽象,用户通过操作Fleet、Application等资源来管理整个分布式系统,心智负担显著降低。

- 一体化的安装与配置:它提供了经过验证的、优化的默认配置组合,避免了用户自行集成“Karmada+Istio+Prometheus”时可能遇到的无数兼容性和配置陷阱。

- 插件化架构:无论是网络、存储还是调度器,Kurator都设计了清晰的插件接口。这意味着企业可以“融入”而非“推翻”现有技术栈,保护了既有投资。

6.2 对分布式云原生技术发展的思考与建议

基于社区参与经验,我认为分布式云原生技术将向以下方向发展,而Kurator已走在正确的道路上:

- 智能化的协同调度:未来的调度器不应只考虑单个Pod的资源请求,而应具备跨集群、跨地域的全局资源视图和成本意识,能根据实时网络延迟、数据位置、电力和带宽成本做出更优的调度决策。建议Kurator进一步深化与Volcano等批量调度器的集成,探索AI驱动的调度策略。

- 边缘原生的深度强化:随着IoT和5G发展,边缘场景将更复杂(弱网、断网、资源极端受限)。Kurator已集成KubeEdge,下一步应更聚焦于边缘单元自治、边缘应用模型和边缘数据协同的原生支持,例如定义“EdgeApplication” CRD来简化边缘侧的状态同步与生命周期管理。

- 安全模型的零信任化:在多租户、多边界的分布式云中,传统的基于网络边界的安全模型已然失效。建议Kurator强化基于身份的服务间认证、动态的策略下发和统一的证书管理能力,将零信任安全深度植入到流量治理和策略管理框架中。

结语

Kurator以其务实的设计、深度的集成和开放的架构,为企业和开发者打开了一扇通往高效、统一的分布式云原生管理的大门。它降低了分布式云的使用门槛,让团队能将更多精力聚焦于业务创新而非基础设施的粘合与调试。无论是刚刚开始多集群之旅,还是正在复杂混合云环境中挣扎,Kurator都值得你深入探索和实践。

Kurator分布式云原生开源社区地址:https://gitcode.com/kurator-dev

Kurator分布式云原生项目部署指南:https://kurator.dev/docs/setup/

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献20条内容

已为社区贡献20条内容

所有评论(0)