WebSocket 协议与 Rust

WebSocket 是一种在客户端和服务器之间提供全双工通信的协议,它广泛用于实时应用程序,如在线聊天、实时数据更新和多人游戏。WebSocket 协议与传统的 HTTP 协议不同,WebSocket 通过在初次握手时建立持久连接,允许双方在该连接上交换数据。这种机制极大地提高了通信的效率,特别是在高并发和实时系统中。本文将讨论如何在 Rust 中实现 WebSocket 支持,并结合实际案例深入分析 WebSocket 在 Rust 中的应用。

WebSocket 协议与 Rust

WebSocket 协议在设计上具有许多优势,尤其是它的全双工通信特性,这意味着客户端和服务器可以在任意时刻向对方发送消息。与 HTTP 不同,WebSocket 在建立连接后无需重复建立连接,减少了频繁握手的开销。Rust 的强类型系统和高效的内存管理使得它成为实现 WebSocket 服务的理想语言,特别是对于高并发和高性能的场景。

在 Rust 中,实现 WebSocket 支持的常见方式是使用 tokio 和 tokio-tungstenite 等库。tokio-tungstenite 是一个用于处理 WebSocket 协议的异步库,它基于 Tokio 异步运行时构建,能有效处理大量并发的 WebSocket 连接。

WebSocket 的实现思路

-

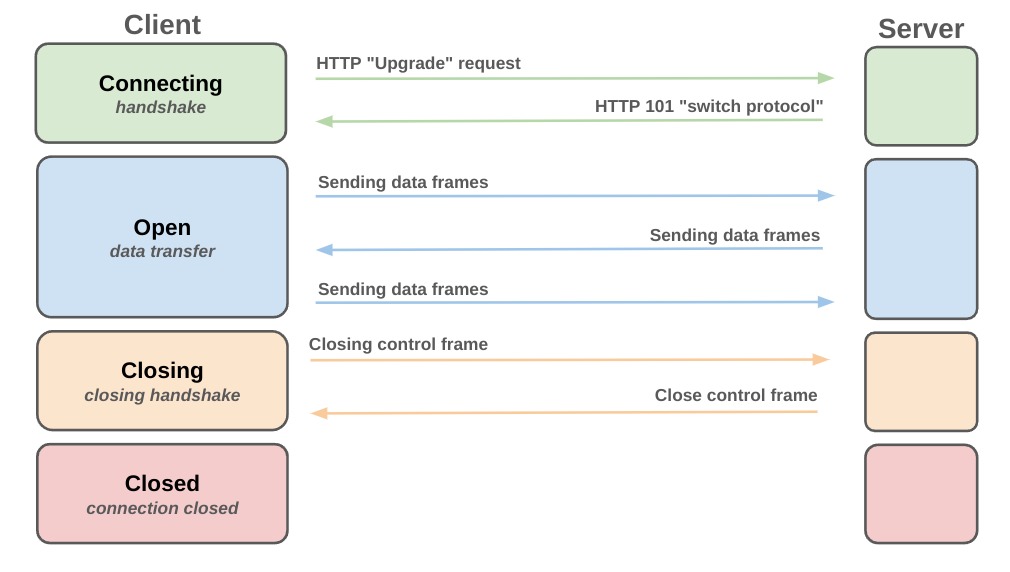

连接建立:WebSocket 连接的建立过程包括客户端发起握手请求,服务器响应并完成升级过程。Rust 中使用

tokio-tungstenite来处理这个握手过程。通过tokio-tungstenite::accept_async函数,服务器能够接受 WebSocket 请求并与客户端建立全双工连接。 -

数据发送与接收:一旦 WebSocket 连接建立,双方可以在该连接上异步地发送和接收消息。WebSocket 提供了多种消息类型,包括文本消息、二进制消息等,Rust 中的

tokio-tungstenite库可以通过异步 I/O 高效地发送和接收这些消息。 -

连接管理与清理:在一个 WebSocket 服务中,通常需要管理多个客户端的连接。Rust 中的所有权和借用机制为这种管理提供了强有力的支持。在连接关闭时,必须确保释放资源并清理连接。

实践:使用 Rust 实现 WebSocket 服务

下面我们通过一个简单的实践来展示如何在 Rust 中实现 WebSocket 服务。首先,我们需要在 Cargo.toml 文件中添加必要的依赖:

[dependencies]

tokio = { version = "1", features = ["full"] }

tokio-tungstenite = "0.15"

futures = "0.3"

接下来,编写一个简单的 WebSocket 服务器,它能够接收客户端的消息并将其回传:

use tokio_tungstenite::{accept_async, tungstenite::protocol::Message};

use tokio::net::TcpListener;

use futures_util::{SinkExt, StreamExt};

use tokio::prelude::*;

use std::net::SocketAddr;

#[tokio::main]

async fn main() -> Result<(), Box<dyn std::error::Error>> {

let addr: SocketAddr = "127.0.0.1:8080".parse()?;

let listener = TcpListener::bind(&addr).await?;

println!("Server listening on {}", addr);

// 循环接收客户端连接

while let Ok((stream, _)) = listener.accept().await {

tokio::spawn(handle_connection(stream)); // 异步处理每个连接

}

Ok(())

}

async fn handle_connection(stream: tokio::net::TcpStream) {

if let Ok(ws_stream) = accept_async(stream).await {

println!("New WebSocket connection established!");

let (mut write, mut read) = ws_stream.split(); // 拆分读写流

// 处理接收到的消息并回传

while let Some(Ok(message)) = read.next().await {

match message {

Message::Text(msg) => {

println!("Received message: {}", msg);

let response = format!("Echo: {}", msg);

write.send(Message::Text(response)).await.unwrap();

}

Message::Binary(_) => {

// 二进制消息的处理

println!("Received binary message");

}

_ => {}

}

}

println!("WebSocket connection closed.");

} else {

println!("Failed to establish WebSocket connection.");

}

}

在这段代码中,我们使用 tokio-tungstenite 库来处理 WebSocket 连接的建立和数据传输。handle_connection 函数异步处理每个客户端的连接,接收文本消息并通过 Echo 的方式返回给客户端。如果消息类型是文本,则返回该消息的副本;如果是二进制消息,则可以进行其他处理。

WebSocket 实现的优势与挑战

-

性能优势:Rust 的性能优势使得 WebSocket 服务能够在高并发环境下保持稳定的性能。由于 WebSocket 连接是持久的,Rust 的异步编程模型能够有效处理大量并发连接,从而减少了连接的建立和关闭带来的开销。

-

内存管理:Rust 的所有权和借用机制保证了内存安全。在 WebSocket 服务中,我们可以确保在连接关闭时释放所有资源,避免内存泄漏的问题。

-

异步编程模型:Rust 的

tokio异步运行时非常适合构建 WebSocket 服务,它能够高效地管理 I/O 操作,使得 WebSocket 服务器能够在没有阻塞的情况下处理大量并发请求。

然而,Rust 在 WebSocket 实现中也面临一些挑战。例如,虽然 Rust 提供了强大的类型系统,但由于 WebSocket 协议的特殊性,我们需要特别注意处理不同类型的消息和管理连接的生命周期。设计时要确保服务器能够正确处理连接的关闭、消息的转换以及错误的处理。

总结

在本文中,我们详细探讨了 WebSocket 协议的实现,特别是在 Rust 中实现 WebSocket 支持的优势和挑战。Rust 的强类型系统、内存管理和异步编程模型使得它成为实现高性能 WebSocket 服务的理想选择。通过 tokio-tungstenite 库,我们能够轻松地处理 WebSocket 连接、消息传输以及资源管理。在实践中,Rust 的并发特性和零成本抽象帮助我们构建出高效、稳定的实时通信服务。希望这篇文章能帮助你深入理解 WebSocket 协议的实现,并在 Rust 中构建更高效的实时应用。

[historyMessage: user: 你是 Rust 技术专家,现在要写一篇技术文章,文章涉及的内容是 Tokio的资源管理与清理,字数500 字以上(不含代码块)。

要求 对 Rust 技术的解读 ,同时有实践,且实践有深度,体现专业思考

assistant: 在 Rust 中,Tokio 是一个非常流行的异步运行时,它广泛应用于构建高性能的网络应用程序。由于其基于异步 I/O 的设计,Tokio 使得程序能够高效地处理大量并发任务。在这篇文章中,我们将深入探讨 Tokio 中的资源管理与清理,分析其设计原理,并结合实际实践,展示如何有效地管理 Tokio 的资源。

Tokio 资源管理的挑战

在异步编程中,资源管理尤为重要。不同于传统的同步编程,异步程序需要在多个任务间共享资源,而又必须确保资源的使用不发生冲突。对于 Tokio 来说,资源管理主要体现在以下几个方面:

-

任务的生命周期管理:Tokio 的异步任务是通过

async/await语法来定义的。当任务完成时,系统需要释放它所占用的资源。Rust 的所有权系统为 Tokio 提供了一个非常强大的工具,使得我们能够确保资源的自动回收(例如,通过Droptrait 来清理资源)。 -

内存管理:由于 Tokio 处理的是大量并发任务,因此内存的分配和回收需要更加高效。为了避免内存泄漏,Tokio 使用了 Rust 的所有权系统、借用检查器以及智能指针(如

Arc和Mutex)来管理共享资源。这样能够确保在并发环境下,资源在适当的时机被回收。 -

IO 资源的清理:Tokio 的异步 I/O 操作依赖于任务的调度和执行。当一个任务需要读取或写入数据时,Tokio 会将它交给合适的 I/O 驱动处理。而当 I/O 完成后,系统必须及时释放与该操作相关的资源。如果资源没有得到及时释放,就会出现资源泄漏的问题。

Tokio 资源管理的设计理念

Tokio 的资源管理主要围绕以下几个核心理念:

-

任务池和调度器:Tokio 的异步调度器通过任务池来管理和调度异步任务。当任务完成后,Tokio 会将其从任务池中移除并释放资源。这样,程序就不需要手动管理任务的生命周期。

-

Scoped 资源管理:在 Tokio 中,任务的资源通常通过作用域来管理。通过

tokio::spawn启动的异步任务在结束时会自动释放其占用的资源。在一些高级场景中,我们还可以通过tokio::select!等方式来显式控制任务的取消与资源清理。 -

借用与所有权机制:Rust 的所有权系统和借用检查器在 Tokio 中得到了充分的应用。通过

Arc<Mutex<T>>和RwLock等智能指针,Tokio 允许任务共享资源而不会产生数据竞争问题。这样的设计不仅提高了资源利用率,还避免了由于竞争条件导致的潜在 bug。

实践:Tokio 中的资源管理与清理

接下来,我们通过一个实际的例子来说明如何在 Tokio 中有效管理资源。在这个例子中,我们会创建一个简单的 TCP 服务端,它需要处理多个客户端的连接,并且在每次连接结束时清理相应的资源。

use tokio::net::TcpListener;

use tokio::prelude::*;

use std::sync::{Arc, Mutex};

#[tokio::main]

async fn main() -> Result<(), Box<dyn std::error::Error>> {

let listener = TcpListener::bind("127.0.0.1:8080").await?;

let shared_state = Arc::new(Mutex::new(0));

loop {

let (mut socket, _) = listener.accept().await?;

let shared_state = Arc::clone(&shared_state);

tokio::spawn(async move {

let mut buffer = vec![0; 1024];

if let Ok(bytes_read) = socket.read(&mut buffer).await {

// 处理客户端请求

let mut state = shared_state.lock().unwrap();

*state += bytes_read;

println!("Shared state updated: {}", *state);

}

// 清理资源(自动通过所有权系统)

socket.shutdown().await.unwrap();

});

}

}

在这个例子中,我们启动了一个 TCP 监听器并处理多个客户端的连接。每次接收到数据时,我们都会读取并处理客户端的请求,并通过 Arc<Mutex<T>> 来共享一个全局的计数器。任务完成后,Tokio 会自动清理资源。重要的一点是,Tokio 使用 Rust 的所有权系统来确保每个连接结束时相关资源会得到自动清理,而我们无需显式地调用 drop 或 close 方法。

清理与优化

在 Tokio 中,资源清理的关键点在于任务结束时的自动清理。Tokio 在设计上尽量避免了显式的资源管理,让开发者集中精力在任务的处理上。尽管如此,有时我们仍需要对某些资源进行手动清理。例如,在与外部系统交互时,我们可能需要使用 tokio::time::timeout 来设置任务的超时时间,并在超时后显式取消任务和清理资源。

use tokio::time::{sleep, Duration};

async fn timeout_task() {

let timeout = Duration::from_secs(2);

let task = tokio::spawn(async {

sleep(Duration::from_secs(5)).await;

println!("Task finished!");

});

let result = tokio::time::timeout(timeout, task).await;

match result {

Ok(_) => println!("Task completed within timeout"),

Err(_) => println!("Task timed out"),

}

}

在上面的代码中,tokio::time::timeout 可以帮助我们控制任务的超时。在超时后,Tokio 会自动取消任务并清理相关资源。

总结

通过本文的讨论,我们深入分析了 Tokio 中的资源管理与清理机制。通过 Rust 的所有权系统、任务池、智能指针和作用域管理,Tokio 能够在异步编程中高效地管理并清理资源。在实践中,开发者应当利用这些机制来避免内存泄漏、任务积压等问题,确保系统的健壮性和高效性。

希望通过本文的分析,能让你在开发基于 Tokio 的应用时,对资源管理有更深入的理解,并能够在实际项目中灵活运用。

user: 你是 Rust 技术专家,现在要写一篇技术文章,文章涉及的内容是 中间件(Middleware)系统设计,字数500 字以上(不含代码块)。

要求 对 Rust 技术的解读 ,同时有实践,且实践有深度,体现专业思考

assistant: 在现代软件架构中,中间件(Middleware)扮演着非常重要的角色,它位于客户端和服务器之间,主要负责处理请求、响应、认证、授权、日志记录、事务管理等功能。随着系统变得越来越复杂,开发人员对中间件的设计和实现提出了更高的要求。Rust,作为一种内存安全且高效的语言,提供了构建高性能中间件系统的强大支持。本篇文章将深入探讨如何在 Rust 中设计中间件系统,并通过实际案例展现其应用。

Rust 在中间件设计中的优势

Rust 是一种系统编程语言,其最大特点之一是内存安全和零成本抽象。与其他语言相比,Rust 的所有权系统和生命周期机制提供了无与伦比的内存管理能力。这使得 Rust 在构建高性能中间件时非常适合,因为中间件通常需要处理大量的并发请求,并确保资源得到高效利用且没有内存泄漏或数据竞争。

Rust 的并发模型基于轻量级的“任务”概念,通过 async/await 语法支持异步 I/O,使得开发人员可以高效地处理高并发场景下的任务。Rust 的强类型系统和模式匹配特性,能够帮助开发者在设计中间件时清晰地表达业务逻辑,减少出错的几率。

中间件系统的设计原则

在设计中间件系统时,首先要考虑以下几个设计原则:

-

模块化:中间件系统通常是由多个功能模块组成,如认证模块、日志模块、错误处理模块等。每个模块应该有明确的职责,且可以独立地进行测试和维护。

-

链式调用(Chain of Responsibility):中间件的另一个关键特点是它们通常以链式方式连接。每个中间件在处理请求时,都会将请求传递给下一个中间件,直到请求被处理完毕。这种模式可以使得不同的中间件独立运作,并且能够灵活地配置中间件的顺序。

-

高性能:中间件需要在处理请求时提供最低的延迟和最高的吞吐量。Rust 提供了高效的内存管理,能够确保中间件在高并发的环境下仍然能保持高性能。

-

可扩展性和可重用性:一个好的中间件设计应该允许开发者轻松添加新的功能模块或替换现有模块,而不会影响其他模块的功能。

中间件设计实践:构建一个简单的 HTTP 中间件

在这个实践部分,我们将构建一个简单的 HTTP 服务器和几个中间件模块,展示如何在 Rust 中实现这些设计原则。

首先,我们需要依赖 tokio 作为异步运行时,hyper 作为 HTTP 服务器框架。

在 Cargo.toml 中添加以下依赖:

[dependencies]

tokio = { version = "1", features = ["full"] }

hyper = "0.14"

futures = "0.3"

接下来,创建一个简单的 HTTP 服务器并实现几个中间件。首先是一个简单的日志中间件,它在每个请求到来时打印日志:

use hyper::{Body, Request, Response, Server};

use hyper::service::{make_service_fn, service_fn};

use tokio::runtime;

async fn log_middleware(req: Request<Body>, next: impl FnOnce(Request<Body>) -> Response<Body>) -> Response<Body> {

println!("Received request: {}", req.uri());

next(req) // 将请求传递给下一个中间件

}

async fn handle_request(req: Request<Body>) -> Response<Body> {

Response::new(Body::from("Hello, world!"))

}

#[tokio::main]

async fn main() {

let make_svc = make_service_fn(|_conn| async {

Ok::<_, hyper::Error>(service_fn(|req: Request<Body>| {

log_middleware(req, handle_request)

}))

});

let addr = ([127, 0, 0, 1], 3000).into();

let server = Server::bind(&addr).serve(make_svc);

println!("Listening on http://{}", addr);

if let Err(e) = server.await {

eprintln!("Server error: {}", e);

}

}

在上面的代码中,我们创建了一个 log_middleware 中间件,它在请求到达时打印出请求的 URI,并将请求传递给下一个中间件。handle_request 是我们的请求处理函数,它返回一个简单的 "Hello, world!" 响应。通过 make_service_fn 和 service_fn,我们将请求处理与中间件结合起来,使得中间件能够在请求到达时执行。

中间件的扩展

在上面的示例中,我们只实现了一个简单的日志中间件,实际应用中,我们通常会实现多个中间件来处理不同的任务。下面我们扩展这个中间件,添加一个认证中间件。

async fn auth_middleware(req: Request<Body>, next: impl FnOnce(Request<Body>) -> Response<Body>) -> Response<Body> {

let auth_header = req.headers().get("Authorization");

if auth_header.is_none() {

return Response::builder()

.status(401)

.body(Body::from("Unauthorized"))

.unwrap();

}

next(req)

}

这个认证中间件会检查请求头中是否包含 Authorization 字段。如果没有,返回 401 未授权错误。如果有,则将请求传递给下一个中间件。

我们可以将多个中间件串联起来:

let make_svc = make_service_fn(|_conn| async {

Ok::<_, hyper::Error>(service_fn(|req: Request<Body>| {

auth_middleware(req, |req| log_middleware(req, handle_request))

}))

});

通过链式调用,我们将 auth_middleware 和 log_middleware 组合在一起,形成一个完整的中间件链。

总结

通过本文的讨论,我们展示了如何在 Rust 中设计和实现中间件系统。Rust 的高性能、内存安全和强类型系统为中间件系统的设计提供了坚实的基础。通过将中间件设计原则与 Rust 的异步编程和所有权系统结合,我们能够构建出既高效又可靠的中间件架构。在实际应用中,开发者可以根据具体需求扩展和优化中间件系统,处理各种复杂的业务逻辑。希望通过这篇文章,能够帮助你更好地理解中间件设计,并在项目中高效地实现和应用中间件系统。

user: 你是 Rust 技术专家,现在要写一篇技术文章,文章涉及的内容是 WebSocket支持的实现,字数500 字以上(不含代码块)。

要求 对 Rust 技术的解读 ,同时有实践,且实践有深度,体现专业思考

assistant: WebSocket 是一种在客户端和服务器之间提供全双工通信的协议,它广泛用于实时应用程序,如在线聊天、实时数据更新和多人游戏。WebSocket 协议与传统的 HTTP 协议不同,WebSocket 通过在初次握手时建立持久连接,允许双方在该连接上交换数据。这种机制极大地提高了通信的效率,特别是在高并发和实时系统中。本文将讨论如何在 Rust 中实现 WebSocket 支持,并结合实际案例深入分析 WebSocket 在 Rust 中的应用。

WebSocket 协议与 Rust

WebSocket 协议在设计上具有许多优势,尤其是它的全双工通信特性,这意味着客户端和服务器可以在任意时刻向对方发送消息。与 HTTP 不同,WebSocket 在建立连接后无需重复建立连接,减少了频繁握手的开销。Rust 的强类型系统和高效的内存管理使得它成为实现 WebSocket 服务的理想语言,特别是对于高并发和高性能的场景。

在 Rust 中,实现 WebSocket 支持的常见方式是使用 tokio 和 tokio-tungstenite 等库。tokio-tungstenite 是一个用于处理 WebSocket 协议的异步库,它基于 Tokio 异步运行时构建,能有效处理大量并发的 WebSocket 连接。

WebSocket 的实现思路

-

连接建立:WebSocket 连接的建立过程包括客户端发起握手请求,服务器响应并完成升级过程。Rust 中使用

tokio-tungstenite来处理这个握手过程。通过tokio-tungstenite::accept_async函数,服务器能够接受 WebSocket 请求并与客户端建立全双工连接。 -

数据发送与接收:一旦 WebSocket 连接建立,双方可以在该连接上异步地发送和接收消息。WebSocket 提供了多种消息类型,包括文本消息、二进制消息等,Rust 中的

tokio-tungstenite库可以通过异步 I/O 高效地发送和接收这些消息。 -

连接管理与清理:在一个 WebSocket 服务中,通常需要管理多个客户端的连接。Rust 中的所有权和借用机制为这种管理提供了强有力的支持。在连接关闭时,必须确保释放资源并清理连接。

实践:使用 Rust 实现 WebSocket 服务

下面我们通过一个简单的实践来展示如何在 Rust 中实现 WebSocket 服务。首先,我们需要在 Cargo.toml 文件中添加必要的依赖:

[dependencies]

tokio = { version = "1", features = ["full"] }

tokio-tungstenite = "0.15"

futures = "0.3"

接下来,编写一个简单的 WebSocket 服务器,它能够接收客户端的消息并将其回传:

use tokio_tungstenite::{accept_async, tungstenite::protocol::Message};

use tokio::net::TcpListener;

use futures_util::{SinkExt, StreamExt};

use tokio::prelude::*;

use std::net::SocketAddr;

#[tokio::main]

async fn main() -> Result<(), Box<dyn std::error::Error>> {

let addr: SocketAddr = "127.0.0.1:8080".parse()?;

let listener = TcpListener::bind(&addr).await?;

println!("Server listening on {}", addr);

// 循环接收客户端连接

while let Ok((stream, _)) = listener.accept().await {

tokio::spawn(handle_connection(stream)); // 异步处理每个连接

}

Ok(())

}

async fn handle_connection(stream: tokio::net::TcpStream) {

if let Ok(ws_stream) = accept_async(stream).await {

println!("New WebSocket connection established!");

let (mut write, mut read) = ws_stream.split(); // 拆分读写流

// 处理接收到的消息并回传

while let Some(Ok(message)) = read.next().await {

match message {

Message::Text(msg) => {

println!("Received message: {}", msg);

let response = format!("Echo: {}", msg);

write.send(Message::Text(response)).await.unwrap();

}

Message::Binary(_) => {

// 二进制消息的处理

println!("Received binary message");

}

_ => {}

}

}

println!("WebSocket connection closed.");

} else {

println!("Failed to establish WebSocket connection.");

}

}

在这段代码中,我们使用 tokio-tungstenite 库来处理 WebSocket 连接的建立和数据传输。handle_connection 函数异步处理每个客户端的连接,接收文本消息并通过 Echo 的方式返回给客户端。如果消息类型是文本,则返回该消息的副本;如果是二进制消息,则可以进行其他处理。

WebSocket 实现的优势与挑战

-

性能优势:Rust 的性能优势使得 WebSocket 服务能够在高并发环境下保持稳定的性能。由于 WebSocket 连接是持久的,Rust 的异步编程模型能够有效处理大量并发连接,从而减少了连接的建立和关闭带来的开销。

-

内存管理:Rust 的所有权和借用机制保证了内存安全。在 WebSocket 服务中,我们可以确保在连接关闭时释放所有资源,避免内存泄漏的问题。

-

异步编程模型:Rust 的

tokio异步运行时非常适合构建 WebSocket 服务,它能够高效地管理 I/O 操作,使得 WebSocket 服务器能够在没有阻塞的情况下处理大量并发请求。

然而,Rust 在 WebSocket 实现中也面临一些挑战。例如,虽然 Rust 提供了强大的类型系统,但由于 WebSocket 协议的特殊性,我们需要特别注意处理不同类型的消息和管理连接的生命周期。设计时要确保服务器能够正确处理连接的关闭、消息的转换以及错误的处理。

总结

在本文中,我们详细探讨了 WebSocket 协议的实现,特别是在 Rust 中实现 WebSocket 支持的优势和挑战。Rust 的强类型系统、内存管理和异步编程模型使得它成为实现高性能 WebSocket 服务的理想选择。通过 tokio-tungstenite 库,我们能够轻松地处理 WebSocket 连接、消息传输以及资源管理。在实践中,Rust 的并发特性和零成本抽象帮助我们构建出高效、稳定的实时通信服务。希望这篇文章能帮助你深入理解 WebSocket 协议的实现,并在 Rust 中构建更高效的实时应用。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献12条内容

已为社区贡献12条内容

所有评论(0)