一期让你知道 AI 相关的核心术语到底是什么意思

刚接触 AI 领域时,面对一堆英文术语很容易一头雾水。LLM、Token、RAG、MCP、Agent……这些词到底在说什么?这篇文章用最直白的方式,一次讲清楚。

目录

- 🧠 LLM — 大语言模型

- 🧱 Token — 模型的"文字积木"

- 💾Context — 模型的"工作记忆"

- 📚RAG — 让模型"查资料"

- 💬Prompt — 你怎么说,它怎么答

- 🔧Tool — 给模型装"插件"

- 🔌 MCP — 工具的"统一插座"

- 🤖 Agent — 能自己干活的 AI

- 🎯Skill — AI 的"肌肉记忆"

📘LLM — 大语言模型

全称:Large Language Model

🤔是什么

LLM 是一个用海量文本(几乎整个互联网)训练出来的深度神经网络。它的核心任务是:给定上文,预测下一个最合理的词。这也就说明了为什么我们像ai提问它是一个字一个字的往外蹦,因为它的底层是根据上一个字去联想下一个字,再将它们拼接起来,在接着联想后面的字,简单来说LLM是我们日常所用的ai的大脑🧠

💡怎么理解

你给出一句话的开头,比如"今天的天气真",LLM 会计算"好"“不错”“糟糕”……哪个词最可能出现。然后它把生成的词拼接回输入,继续预测下一个,如此循环直到完整输出。

🔑 关键点

- 它不是真正的"理解",而是基于统计规律的概率推理

- 规模是关键 —— 参数从几十亿到几千亿,越大的模型涌现的能力越强

- 代表模型:GPT-4、Claude、Llama、Gemini、DeepSeek

** 🧱Token 拆分示例**

| 📝 原文 | 🧩 可能的 Token 拆分 | 🔢 Token 数 |

|---|---|---|

🇺🇸 Hello world |

["Hello", " world"] |

✌️ 2 |

🇨🇳 你好 |

["你", "好"] |

✌️ 2 |

🤖 ChatGPT is great |

["Chat", "G", "PT", " is", " great"] |

🖐️ 5 |

🧠 人工智能 |

["人工", "智能"] |

✌️ 2 |

📘Token — 模型的"文字积木"

Token 是 LLM 处理文本的最小基本单位。它不是字母,也不是完整的词,而是介于两者之间的一个"块"。

英文中,“hello” 可能被拆成 “hel” + “lo”,也可能就是一个完整的 “hello”。中文里,“你好世界” 可能被拆成 “你” + “好” + “世” + “界”。

💡 Token 是 AI 处理文本时的最小单位

📏 Token 数量越多,消耗的上下文和费用通常也越高 💰

为什么重要:

- 计费单位 — AI API 按 Token 计费

- 上下文限制 — 模型的窗口以 Token 计量

- 性能影响 — Token 越多越慢越贵

📘Context — 模型的"工作记忆"

- Context(上下文窗口)代表模型一次能看到的全部 Token 数量。

想象一个人一次性只能读 5 页书。你给他第 1-5 页,他读完后回答你的问题。然后你翻到第 2-6 页——他永远记不住第 1 页的内容了。更加明显的就是大家在提问完一个问题后,接着提问会发现ai的回答包含了上一个问题的相关内容

上面是我对gpt提的两个问题,大家会发现这个两个问题的回答有相同的内容,这就是context,它的底层就是我们对llm提问是不只是会将我们刚写的内容发送过去,还会将以前的聊天内容以前发过去,进而形成了一个情景

📈发展历程:

| 🤖 模型 | 🪟 上下文窗口 | 📖 大约相当于 |

|---|---|---|

| 🟢 GPT-3 | 4K Token |

📄 ~3000 字 |

| 🔵 GPT-4 | 32K Token |

📚 ~2.5 万字 |

| 🟣 Claude 3 | 200K Token |

📕 ~15 万字 |

| 🌈 Gemini 1.5 | 1M Token |

🏛️ ~75 万字 |

📌 Context Window 能干什么

| 🚀 能力 | 💡 说明 |

|---|---|

| 📄 长文档分析 | 一次读取整本 PDF / 技术文档 |

| 💻 大型代码理解 | 分析整个项目代码结构 |

| 🧠 长期对话记忆 | 记住更久的聊天内容 |

| 🔍 多文件推理 | 同时分析多个文件之间关系 |

📘RAG — 让模型"查资料"

全称:Retrieval-Augmented Generation(检索增强生成)

- RAG 是一种架构模式:在模型回答之前,先从外部知识库中检索相关信息,然后把检索到的内容作为上下文注入给模型。

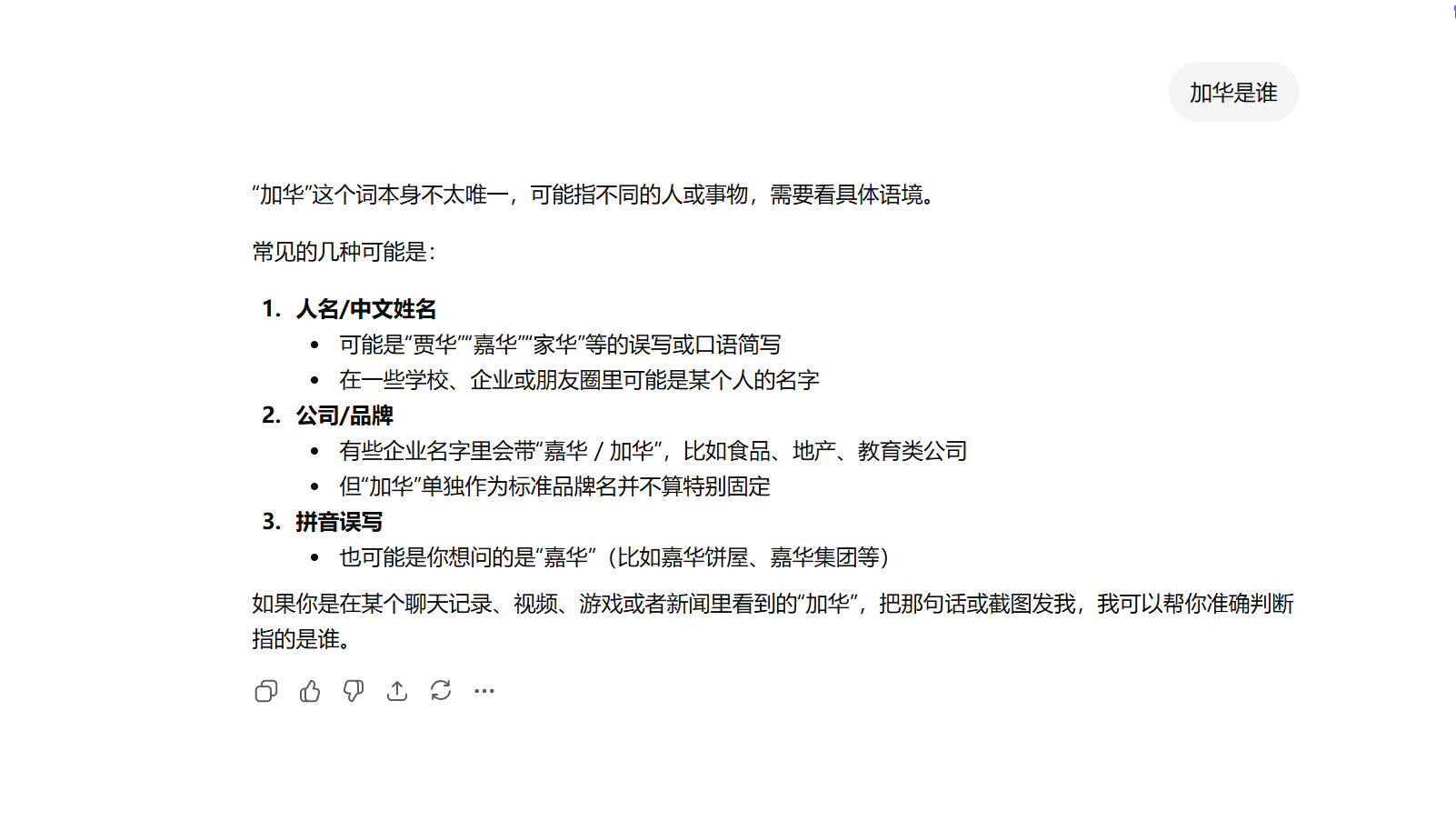

大家可以试一下像模型问一个问题,内容为一个任意一个人名问它这个人是谁,前提是这个人名不这么出名,比如我怎么问题

gpt给我的回答是十分的模糊,其实加华是我家狗的名字,但它不知道所以乱回答,那么怎么让他知道呢 ? 聪明的你一定想到刚才的context,是的.但是如果我有很多的人名要告诉它,但是token是有限的那该怎么办呢?

- 这个时候就该RAG出马了,RAG会通过Embedding 模型 — 把文本转成向量(如 text-embedding-3-small),在从向量数据库(存向量并做相似度搜索)进行查找,最后通过prompt组装把检索结果和原始问题拼成模型能理解的格式,再发送给模型,模型就可以基于数据库回答比较准确的回答

📚 RAG vs 🎯 微调(Fine-tuning)对比表 🤖

| ⚔️ 对比项 | 🔍 RAG(检索增强生成) | 🎯 微调(Fine-tuning) |

|---|---|---|

| 🔄 数据更新 | ⚡ 秒级更新,无需重新训练 | 🐢 需要重新训练模型 |

| 💰 成本 | ✅ 较低 | ❌ 较高 |

| 🧠 幻觉控制 | ✅ 较好,可基于真实资料回答 | ⚠️ 一般,仍可能胡编 |

| 🎯 适用场景 | 📚 知识问答、企业知识库 | ✍️ 风格迁移、专业语气训练 |

📘Prompt — 你怎么说,它怎么答

💬 Prompt — 你怎么说,它怎么答

🤷♂️ 你问:“那个东西在哪儿?”——一脸懵。

🎯 你换种方式:“厨房台面上红色包装的咖啡豆在哪儿?”——立刻能回答。

Prompt 就是你对 AI 说话的方式。越精确、越结构化,AI 的表现越好。

✨ 一个好的 Prompt 结构

🎭 角色设定:你是一个资深 Python 工程师

📋 背景信息:用户代码库用的是 FastAPI

🎯 任务描述:帮我审查这段代码的安全性问题

📤 输出格式:列出 3 个问题 + 修复建议

⚠️ 约束条件:用中文回答,给出代码示例

🎭 System Prompt vs User Prompt

⚙️ System Prompt** — 系统级别指令,设定模型的角色、行为边界、始终生效的规则

💬 System: 你是一个严谨的代码审查助手,只分析代码质量,不做其他事**

💬 User Prompt** — 用户每次提问的具体内容

💬 User: 请审查以下 Python 函数的安全性问题……

📘Tool — 给模型装"插件"

Tool 允许 LLM 调用外部系统来获取实时信息、执行操作。

没有工具的 LLM = 只有大脑没有手脚的学者。

有了工具,他就能:查天气、算数学、发邮件、查数据库、调 API。

比如我向要ai帮我买一张飞往日本的机票,它肯定做不到,但是如果我们给它装上了"手臂"它是不是就可以做到了.那么Tool就是这个手臂

没有工具的 LLM 像一个被锁在房间里的学者——他可以思考、可以回答,但没办法触碰外部世界。有了 Tool,他就能:

- 🔍 查 — 搜索实时信息、查数据库

- ✏️ 写 — 创建文件、写数据库

- 🔧 执行 — 运行代码、发请求、操作 API

- 📨 发送 — 发邮件、发消息、调用第三方服务

Tool 的核心机制是 函数调用(Function Calling),流程是:

-

用户:“帮我查一下北京的天气”

-

LLM 分析:这个问题需要调用工具

-

LLM 返回一个结构化请求:→ call get_weather(city=“Beijing”)

-

外部系统执行工具,返回结果: → { “temperature”: 28, “condition”: “sunny” }

-

LLM 拿到结果后组织成自然语言回复:→ “北京今天 28°C,天气晴朗”

有了Tool,llm就可以通过调用各种api帮你完成许多任务,比如写报告,做ppt,打游戏等等.

🛠️ 常见工具类型:

| 工具类型 | 解决什么问题 |

|---|---|

| 🛠️ 工具类型 | 🎯 解决什么问题 |

| ------------ | -------------- |

| 🔍 搜索引擎 | 实时信息、训练数据之外的知识 |

| ▶️ 代码执行器 | 精确计算、运行用户代码 |

| 📁 文件操作 | 读写本地文件 |

| 🗄️ 数据库查询 | 结构化数据查询 |

| 🔗 API 调用 | 与外部系统交互 |

| 🎨 图像生成 | 创建图片 |

📘MCP — 工具的"统一插座"

全称:Model Context Protocol(模型上下文协议)

MCP 是 Anthropic 提出的开放协议标准,用于统一 LLM 与外部工具、数据源之间的集成方式。

🎯 是什么

- MCP 是 Anthropic 提出的开放协议标准,用于统一 LLM 与外部工具、数据源之间的集成方式。可以理解为 AI世界的 USB-C 接口 🔌。

📖 怎么理解

😫 MCP 之前:每个应用 × 每个工具都要写定制代码

┌─────┐ 定制集成 ┌──────┐

│ App │────────────▶│ Tool │

├─────┤ 定制集成 ├──────┤

│ App │────────────▶│ Tool │

└─────┘ └──────┘

🚀 MCP 之后:工具提供商按标准写一次,所有 AI 即插即用

┌─────┐ MCP 标准 ┌──────────┐ MCP 标准 ┌──────┐

│ App │────────────▶│ MCP Host │────────────▶│ Tool │

└─────┘ └──────────┘ └──────┘

🧩核心要素

| 要素 | 说明 |

|---|---|

| 📂 Resources | 暴露给模型的数据源(文件、数据库记录等) |

| 🔧 Tools | 模型可以调用的可执行操作 |

| 📝 Prompts | 预定义的提示词模板 |

| 📡 Transport | 通信方式(stdio、SSE、WebSocket) |

💡 MCP 目前处于早期但快速发展的阶段,是 AI 工具生态标准化的重要方向。

📘Agent — 能自己干活的 AI

Agent(智能体)是一个能自主推理、规划、执行任务的 LLM 系统。它不仅仅是回答一个问题,而是为了实现一个目标,可以主动调用工具、分解任务、自我纠错 🎯。

🗣️ 普通 LLM:你问"北京到上海的高铁",它告诉你班次信息。

🤖 Agent:你告诉它"帮我订下周一到上海的高铁票,顺便订好酒店和会议室"——它会自己:

① 📅 查列车时刻表

② 🎯 选合适的车次

③ 📆 查你的日历确认空闲时间

④ 🎫 订票

⑤ 🏨 在上海火车站附近找酒店

⑥ ✅ 预订酒店

⑦ 📋 预订公司附近的会议室

🔑 核心能力

| 能力 | 说明 | 类比 |

|---|---|---|

| 🗺️ 规划 | 将复杂任务分解为子步骤 | 项目经理制定计划 |

| 🔧 工具调用 | 使用外部工具执行操作 | 程序员调 API |

| 🧠 记忆管理 | 记住已经做了什么、还剩什么 | 便利贴清单 📝 |

| 🔄 自我纠错 | 结果不符预期时调整策略 | 试错学习 |

| ♟️ 推理 | 多个可能路径中选择最优解 | 下棋思考多步 |

📘Skill — AI 的"肌肉记忆"

Skill(技能)是一个封装好的、可复用的 LLM 任务执行模板——融合了 System Prompt、工具配置、处理逻辑,让模型在特定任务上表现更稳定、更高效 💪。

👨🍳 新手厨师每次做红烧肉都要重新想怎么做——思考慢,质量不稳定。

👨🍳 熟练厨师做红烧肉时肌肉记忆自动启动——他知道什么时候放糖、什么时候收汁,不需要每次重新想。

🎯 Skill 就是 LLM 的"肌肉记忆"。**

🌟 优势

| 优势 | 说明 |

|---|---|

| ✅ 一致性 | 同样的任务每次都以同样的高质量完成 |

| ⚡ 高效率 | 不需要每次都从头设计 Prompt |

| 🧩 可组合 | 多个 Skill 可以组合完成复杂任务 |

| 📦 经验沉淀 | 最佳实践固化在 Skill 中,团队共享 |

一张图总结

基础层:Token → Context → LLM

↓

交互层:Prompt(你怎么说) + Tool(它能做什么)

↓

协议层:MCP(标准化对接)

↓

架构层:RAG(查资料) + Agent(自主干)

↓

应用层:Skill(封装成技能包)

一句话总结:

| 🧩 术语 | 💡 通俗解释 | 🎯 你可以这样理解 |

|---|---|---|

| 🧠 LLM(Large Language Model) | 用海量数据训练出来的文字生成“大脑” | 像一个超级学霸 AI 👨🎓📖 |

| 🔠 Token | AI 处理文字时的最小单位,也是计费单位 💰 | 类似“文字积木” 🧱 |

| 🪟 Context(上下文) | AI 一次性能看到、记住的内容范围 | AI 的“短期记忆” 🧠💭 |

| 🔍 RAG(检索增强生成) | AI 回答前先查资料再回答 | 开卷考试 📚✅ |

| ✍️ Prompt(提示词) | 你给 AI 的指令 | 你怎么问,AI 怎么答 🗣️➡️🤖 |

| 🛠️ Tool(工具) | 让 AI 能调用外部能力 | 给 AI 装上双手和工具箱 🔧🧰 |

| 🔌 MCP(Model Context Protocol) | AI 与工具之间的标准协议 | AI 世界的“USB 接口” 🔌🌐 |

| 🤖 Agent(智能体) | 能自主规划并执行任务的 AI | 会自己干活的 AI 员工 👨💻⚡ |

| 🎒 Skill(技能) | 封装好的可复用能力模块 | AI 的技能卡 🎴✨ |

理解它们各自扮演的角色和彼此的关系,你就基本掌握了 AI 应用开发的完整地图。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献2条内容

已为社区贡献2条内容

所有评论(0)