109什么是LLM网关?深入探究可扩展人工智能应用的基石

大型语言模型(LLMs)迅速改变了组织构建、部署和扩展人工智能应用的方式。从智能聊天机器人到高级文档处理,大型语言模型是现代自动化和数字智能的核心。然而,随着团队从实验阶段转向生产阶段,一系列新的基础设施挑战也随之出现,其中最主要的是需要高效管理、协调和扩展与多个大型语言模型提供商的交互。这就是大型语言模型网关概念变得不可或缺的地方。

在本综合指南中,我们将深入探讨大型语言模型(LLM)网关的定义、重要性及其在现代人工智能(AI)堆栈中的位置。同时,我们还将探讨TrustZ和海獭数据等解决方案如何塑造大型语言模型基础设施的未来。

引言:大型语言模型(LLMs)在生产中的崛起

OpenAI的GPT系列、Anthropic的Claude以及谷歌的Gemini等大型语言模型(LLM)的采用,彻底改变了企业实现自动化、知识管理和提升客户体验的方式。然而,随着各组织扩大其人工智能(AI)发展雄心,他们很快就会遇到一个支离破碎的生态系统:

- 每个大型语言模型(LLM)提供商都提供不同的应用程序编程接口(API)、输入/输出格式和身份验证方案。

- 速率限制、错误处理以及特定模型的特性增加了操作的复杂性。

- 更换提供商或模型通常需要大量的代码重写工作。

这些挑战可能会阻碍创新,并带来运营风险。为了应对这些挑战,具有前瞻性的团队正将大型语言模型(LLM)网关作为其人工智能基础设施中的统一层。

LLM网关定义

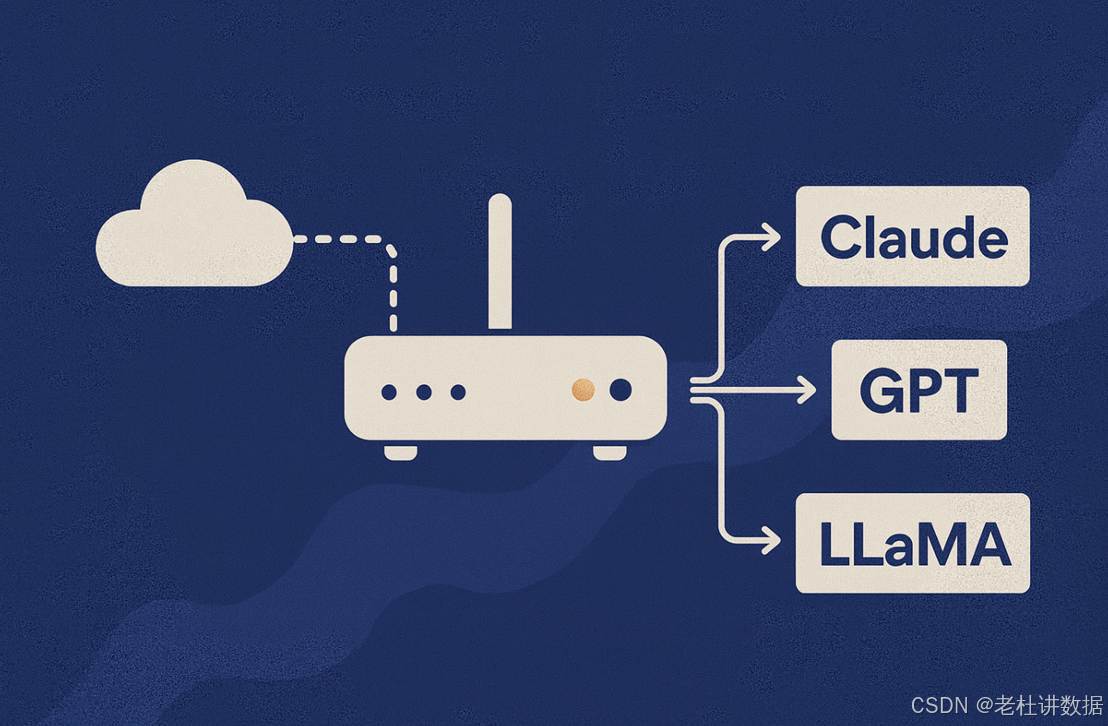

LLM网关是一个位于应用程序与一个或多个LLM提供商之间的中间件层。其主要作用是抽象处理不同API的复杂性,使您的产品能够通过单一、一致的界面与多个模型进行交互。

大型语言模型(LLM)网关的关键特征:

- 统一API:标准化各提供商之间的请求和响应。

- 提供商无关性:支持大型语言模型(LLM)的无缝切换或混合使用(如OpenAI、Anthropic、Mistral等)。

- 集中管理:负责处理身份验证、密钥轮换和速率限制。

- 可观察性与监控:与指标和日志平台集成,实现生产级监控。

- 可扩展性:旨在处理高吞吐量、低延迟的工作负载。

如需更详细的细分,请参阅《什么是AI评估?》和《大型语言模型(LLM)的可观察性:如何在生产环境中监控大型语言模型》。

为什么市场需要LLM网关?

随着您的人工智能应用不断发展,对可靠性、性能和可维护性的需求也在增加。这就是为什么大型语言模型(LLM)网关至关重要的原因:

- 简化集成:无需为每个提供者或模型编写自定义代码。

- 增强韧性:支持自动故障转移和回退策略。

- 加速实验:更换模型或提供商以优化成本、质量或延迟。

- 集中安全管理:从单一入口管理API密钥和访问策略。

- 提升可观察性:收集指标和日志以进行调试和优化。

如果没有大型语言模型(LLM)网关,组织可能会构建出难以演进和扩展的脆弱系统。如需深入了解,请参阅《为何人工智能模型监控是可靠和负责任的人工智能的关键》。

核心功能与架构

一个稳健的大型语言模型(LLM)网关通常具备以下功能:

- 请求路由与规范化 将应用程序请求转换为特定于提供者的格式。

- 对响应进行规范化处理,以便进行下游处理。

- 提供者容错与负载均衡功能会自动使用备份提供者重试失败的请求。

- 在多个模型或账户之间平衡负载。

- 密钥和速率限制管理 轮换API密钥以避免限流。

- 实施针对每个提供者和每个模型的速率限制。

- 可观察性与指标 公开了与Prometheus/Grafana兼容的指标端点。

- 记录请求/响应周期,以便进行审计和调试。

- 可扩展性 支持用于自定义逻辑(如过滤、转换、日志记录)的插件或中间件。

- 协议灵活性 提供HTTP支持,并且越来越多地支持gRPC,以满足多样化的部署需求。

如需了解技术概述,请参阅《用于调试多智能体人工智能系统的智能体追踪》。

LLM网关的主要优势

实施大型语言模型(LLM)网关具有切实优势:

- 性能:通过优化请求处理和连接池管理来降低延迟并提高吞吐量。

- 可靠性:通过自动回退和强大的错误处理机制来保持高可用性。

- 可扩展性:轻松应对流量激增,并支持企业级服务等级协议(SLA)。

- 可维护性:将应用程序逻辑与特定于提供程序的代码解耦,使更新和迁移变得轻松。

- 安全:集中管理敏感凭证,并执行合规政策。

了解领先组织在《人工智能代理质量评估:指标与最佳实践》中是如何实现这些成果的。

技术深度剖析:现代网关的工作原理

现代大型语言模型(LLM)网关,如TrustZ,在性能和可扩展性方面进行了优化设计:

- 基于Go的架构:提供超低开销(在5000+ RPS(每秒请求数)下,每个请求的开销低至11-15微秒)。

- 插件优先中间件:无需陷入回调困境,即可快速集成自定义逻辑。

- 多协议支持:支持HTTP和gRPC(计划中),以实现灵活的基础设施适配。

- SDK无关:适用于任何提供商,只需更新基础URL即可。

- 原生可观察性:内置了Prometheus指标,用于生产监控。

基准测试显示,TrustZ的性能远超其他网关,如LiteLLM,在标准云实例上,其P99延迟降低了高达54倍,内存使用减少了68%。有关基准测试和架构的更多详细信息,请参阅《TrustZ:即插即用的LLM代理,比LiteLLM快40倍》。

TrustZ:下一代大型语言模型(LLM)网关

TrustZ堪称大型语言模型(LLM)网关设计的顶尖之作。它的构建旨在解决企业在扩展其人工智能(AI)工作负载时所遇到的瓶颈问题:

- 统一网关:可连接至OpenAI、Anthropic、Azure、Bedrock、Cohere等平台。

- 自动回退:通过重新路由失败的请求来保持服务连续性。

- 密钥管理:处理复杂的密钥使用模式和特定于模型的限制。

- 请求/响应规范化:使您的应用程序不受提供者特性的影响。

- 连接池:在配置得当的情况下,通过零运行时内存分配来提高效率。

- 完全配置控制:根据您的需求微调池大小、重试逻辑和网络设置。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献2条内容

已为社区贡献2条内容

所有评论(0)