爱客问智能口碑问题生成的技术实现与AI分发机制实践

越来越多的用户不再去百度输入关键词,而是直接打开豆包、Kimi、文心一言这类AI对话平台,问"XX产品口碑怎么样""XX公司和YY公司哪个好" 。

这对企业意味着两件事:第一,传统SEO那套"抢排名"的逻辑在AI搜索场景下部分失效了,因为AI平台不给你排个一二三名,而是直接生成一段综合回答;第二,AI回答里引用了谁的内容,谁就获得了口碑曝光。引用源的选择,很大程度上取决于这个平台"觉得"哪些内容可信、相关、结构化程度足够。

爱客问是飞虎商联旗下的AI搜索优化平台,服务的大多是B2B企业。这些客户找到我们时,普遍有个焦虑:发现用户在豆包、Kimi问相关问题时,AI的回答里很少提到他们,甚至引用的信息还是过时的。

我们当时就在想:能不能让爱客问帮企业生成一类内容,既基于企业真实资料,又适配AI平台的引用偏好,从而提升被引用的概率?

在动手写代码之前,我们先做了一件事:拆解豆包、Kimi、文心一言等平台生成"口碑类"回答时的内容来源和结构特征。

通过大量query测试,我们发现几个规律:

第一,问答对(QA Pair)的引用率显著高于纯文章。当用户问"XX产品怎么样"时,AI更倾向引用知乎问答、百度知道、官网FAQ这类"问题-回答"结构的内容,而不是一篇完整的新闻稿或产品介绍页。原因是QA结构天然匹配对话式查询的语义模式。

第二,事实密度高的内容更容易被截断引用。AI回答通常需要支撑性证据(如"据XX公司官网显示""有用户反馈"),如果企业内容里包含具体客户名称、数据成果、对比维度,被引用的概率大幅提升。

第三,场景化表述比泛化描述更相关。用户问"XX适合金融行业吗"时,AI更倾向引用包含行业场景、具体案例的内容,而不是泛泛的功能介绍。 这些观察直接决定了我们的技术路线:不是帮企业写更多文章,而是生成结构化、事实密集、场景适配的口碑QA内容,并优化其被AI平台检索和引用的概率。

基于上述分析,我们设计了三层架构,核心目标不是"内容可读性",而是"引用友好度":

没有搞复杂的功能堆砌,而是坚持"三步闭环":

第一步:选择企业知识库 技术上看,这是整个系统的"数据源层"。我们支持企业接入专属知识资产,包括产品手册、客服话术、成功案例、FAQ等。这里的关键设计是非结构化文档的结构化解析——通过RAG(检索增强生成)架构,将企业上传的PDF、Word、网页等原始材料,转化为可供模型调用的向量知识库。

第二步:设置生成数量 这是"控制层"。我们让客户自定义生成问题的数量,而不是无限制产出。原因有两个:一是避免内容同质化,搜索引擎对重复/低质内容的识别越来越强;二是倒逼企业聚焦核心场景,而不是撒网式铺量。

第三步:生成口碑问题 这是"输出层"。基于前两层输入,系统一键生成适配不同营销场景的问题与回答内容。这里的核心技术挑战是场景意图对齐,同样一个企业知识库,在"品牌评价"场景和"对比评价"场景下,生成的内容角度和侧重点必须完全不同。

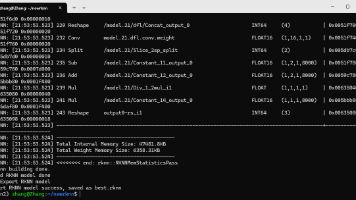

把企业杂乱的资料(PDF手册、Word案例、聊天记录)转化为结构化的、带事实标记的向量单元。

from

体验AI代码助手

代码解读

复制代码

from langchain.text_splitter import RecursiveCharacterTextSplitter

import re

class KnowledgeParser:

def __init__(self, chunk_size=512, chunk_overlap=128):

self.text_splitter = RecursiveCharacterTextSplitter(

chunk_size=chunk_size,

chunk_overlap=chunk_overlap,

separators=["\n\n", "\n", "。", ";", " ", ""]

)

# 事实实体提取正则:客户名称、百分比、金额、时间

self.fact_patterns = {

"client_name": r"([\u4e00-\u9fa5]{2,8}(?:银行|证券|保险|集团|科技|医疗))",

"percentage": r"(\d+(?:.\d+)?%)",

"amount": r"(\d+(?:,\d{3})*(?:.\d+)?(?:万|亿|元))",

"time_period": r"(\d{4}年(?:\d{1,2}月)?)"

}

def parse(self, file_path: str) -> list[dict]:

"""解析文档并提取事实单元"""

loader = self._get_loader(file_path)

docs = loader.load()

chunks = self.text_splitter.split_documents(docs)

enriched_chunks = []

for chunk in chunks:

text = chunk.page_content

facts = self._extract_facts(text)

enriched_chunks.append({

"content": text,

"source": chunk.metadata.get("source"),

"page": chunk.metadata.get("page", 0),

"doc_type": self._classify_type(text),

"facts": facts, # 结构化事实单元

"fact_density": len(facts) / len(text) * 1000, # 事实密度指标

"entities": list(facts.keys())

})

return enriched_chunks

def _extract_facts(self, text: str) -> dict:

"""提取文本中的事实实体"""

facts = {}

for fact_type, pattern in self.fact_patterns.items():

matches = re.findall(pattern, text)

if matches:

facts[fact_type] = matches

return facts

def _classify_type(self, text: str) -> str:

"""基于内容特征分类,影响后续检索权重"""

if "客户" in text and any(k in text for k in ["项目", "合作", "实施"]):

return "case_study" # 案例类:引用价值最高

elif any(k in text for k in ["功能", "特性", "支持", "优势"]):

return "product_spec" # 产品规格类

elif "?" in text or text.startswith(("如何", "怎么", "是否")):

return "faq" # FAQ类:引用友好

return "general"

AI平台的引用行为,本质上是一个检索-综合-生成的过程。我们要做的是:当用户以各种问法查询时,企业生成的口碑内容能被准确召回。

场景重排序是我们花了不少时间调优的模块。原理很简单:生成"对比评价"内容时,优先召回产品功能描述和客户案例;生成"服务案例口碑"时,全力捞客户案例类型的片段。这个权重矩阵是我们基于业务理解手工设定的,后续计划用强化学习自动优化。

功能上线后,我们建立了一套引用监测机制来验证效果:

class

体验AI代码助手

代码解读

复制代码

def __init__(self):

self.platforms = ["doubao", "kimi", "wenxin"]

def check_citation(self, product: str, query: str, published_qa: list[dict]) -> dict:

"""检测已发布内容是否被AI平台引用"""

results = {}

for platform in self.platforms:

# 调用平台API或爬虫获取回答(简化示意)

ai_response = self._query_platform(platform, query)

# 检测published_qa中的内容片段是否出现在ai_response中

citation_hits = []

for qa in published_qa:

# 模糊匹配:检测关键事实、客户名、数据是否被引用

hit_score = self._calculate_citation_overlap(

qa["answer"], ai_response

)

if hit_score > 0.6: # 阈值

citation_hits.append({

"qa_id": qa.get("id"),

"hit_score": hit_score,

"matched_snippet": self._extract_matched_snippet(

qa["answer"], ai_response

)

})

results[platform] = {

"total_qa": len(published_qa),

"cited_count": len(citation_hits),

"citation_rate": len(citation_hits) / len(published_qa) if published_qa else 0,

"details": citation_hits

}

return results

技术方案最终要落到业务价值上。这次升级后,企业用户在爱客问平台上的体验发生了几个显著变化:

可视化操作,零技术门槛 我们封装了极简的交互界面。企业用户不需要理解RAG、向量检索这些概念,只需要在后台完成三步: 第一步:可视化选择企业知识库。拖拽上传PDF、Word、网页等资料,系统自动解析并展示知识库健康度评分(如"案例类素材充足""对比类素材缺失"),用户一眼就知道需要补充什么。

第二步:可视化配置生成参数。选择口碑场景(品牌评价/对比评价/案例口碑等)、设置生成数量、预览示例输出。所有配置实时反馈,所见即所得。

第三步:一键生成 + 效果预览。生成完成后,系统不仅输出QA内容,还会标注每组的"预计引用概率"和"核心事实锚点",用户可以直接预览这段内容被AI平台引用时的样子。

效率提升:从"一周写10组"到"一小时生成50组"

传统模式下,一个市场专员写一篇口碑问答内容,需要翻资料、写初稿、找销售核实事实、修改润色,平均耗时3-4小时/组。而且企业内部知识分散在不同部门,协调成本高。

使用爱客问升级后的功能后:

• 素材准备:一次上传,永久复用。知识库接入后,后续生成直接调用,无需重复整理。

• 生成速度:50组QA内容平均耗时15-20分钟(含系统检索、生成、校验全流程)。

• 事实校验:系统自动完成,无需人工逐条核对。

综合算下来,内容生产效率提升约10倍,市场团队可以把精力从"写内容"转移到"策略规划和渠道运营"上。

事实密度太高会导致内容像数据报表,可读性下降。我们现在的做法是:核心段落保持高事实密度(供AI引用),开头结尾用更自然的过渡句提升可读性。

从观察"用户在豆包、Kimi问产品口碑"这个行为变化,到上线RAG驱动的智能拓词功能,我们爱客问团队走了八个月。作为飞虎商联旗下的AI搜索优化平台,我们越来越觉得:AI搜索时代的口碑营销,核心不是"让用户搜到你",而是"让AI愿意引用你"。

这两件事的技术实现路径完全不同。前者是关键词排名游戏,后者是内容结构、事实密度、语义匹配度的综合工程。 这次升级让我们看到,当技术方案真正解决企业痛点时,可视化操作降低门槛、效率提升释放人力、成本优化改善ROI、引用追踪量化效果,企业用户的应用度和满意度会自然提升。口碑营销不再是"玄学",而变成了可以工程化、可监测、可迭代的数据驱动流程。

搜索优化和口碑生成的结合点还有很多可以挖,比如UGC内容的真实性校验、跨平台内容适配、生成内容的搜索排名反馈闭环等等。这些是我们下一个阶段想解决的问题。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)